一种数字人实体化机器人系统及其交互驱动方法

本发明涉及机器人,具体涉及一种数字人实体化机器人系统及其交互驱动方法。

背景技术:

1、数字人是指通过人工智能技术创造出来的具有人类特征和能力的虚拟实体。数字人可以模拟人类的语言、情感和行为,甚至具备学习和适应环境的能力。随着人工智能技术的不断进步,数字人在许多领域都有着重要的应用。

2、数字人拥有强大的计算能力和智能思维,可以进行复杂的计算和推理工作。通过与大量的数据进行交互,数字人可以不断学习和进化,从而具备越来越高的智能水平。与传统的机器人相比,数字人更接近于人类的智能,可以更好地理解和回应人类的需求。

3、当前数字人具有逼真度高、可定制性强的优点,但是与人交互的方式主要是语音交互、文字交互、视觉交互等非接触方式,缺乏肢体交互、触摸交互等接触式的交互方式来传达更丰富的信息和意图,用户体验的真实感不足。

4、现有技术中,大多数数字人仅局限于呈现图像、声音、表情,在提供服务时,交互过程中的表情呆板,欠缺变化,交互的维度简单,没有和用户产生肢体动作互动,无法与人类产生情感上的共鸣,导致人机交互效果差,用户体验感不佳。

技术实现思路

1、因此,本发明要解决的技术问题是现有的大多数数字人局限于呈现图像、声音、表情的非接触式交互,交互的维度简单,没有和用户产生肢体动作互动,且在提供服务时,交互过程中的表情呆板,欠缺变化,,导致人机交互效果差,用户体验感不佳。

2、为了解决上述技术问题,本发明提供一种数字人实体化机器人系统,包括感知单元、控制模块、通讯单元、存储单元和电源连通模块,机械单元,所述机械单元包括机械结构,所述机械机构包括机身主体、可伸展的腿部、可伸展的足部、可伸展的机械臂和可转动的人形脸部外壳;所述感知单元、所述控制模块、所述通讯单元、所述存储单元和所述电源连通模块均安装在所述机身主体上,

3、所述感知单元用于机器人感知外部环境和获取交互对象发出的指令信息;

4、所述通讯单元接收所述感知单元发送过来的信息,并将信息发送给所述控制模块;

5、所述存储单元用于存储操作系统、控制程序、感知算法、核心功能所需的数据及代码、感知数据、用户交互记录和地图;

6、所述电源连通模块与电源电性连接,给所述感知单元、所述控制模块、所述通讯单元和所述存储单元供电;

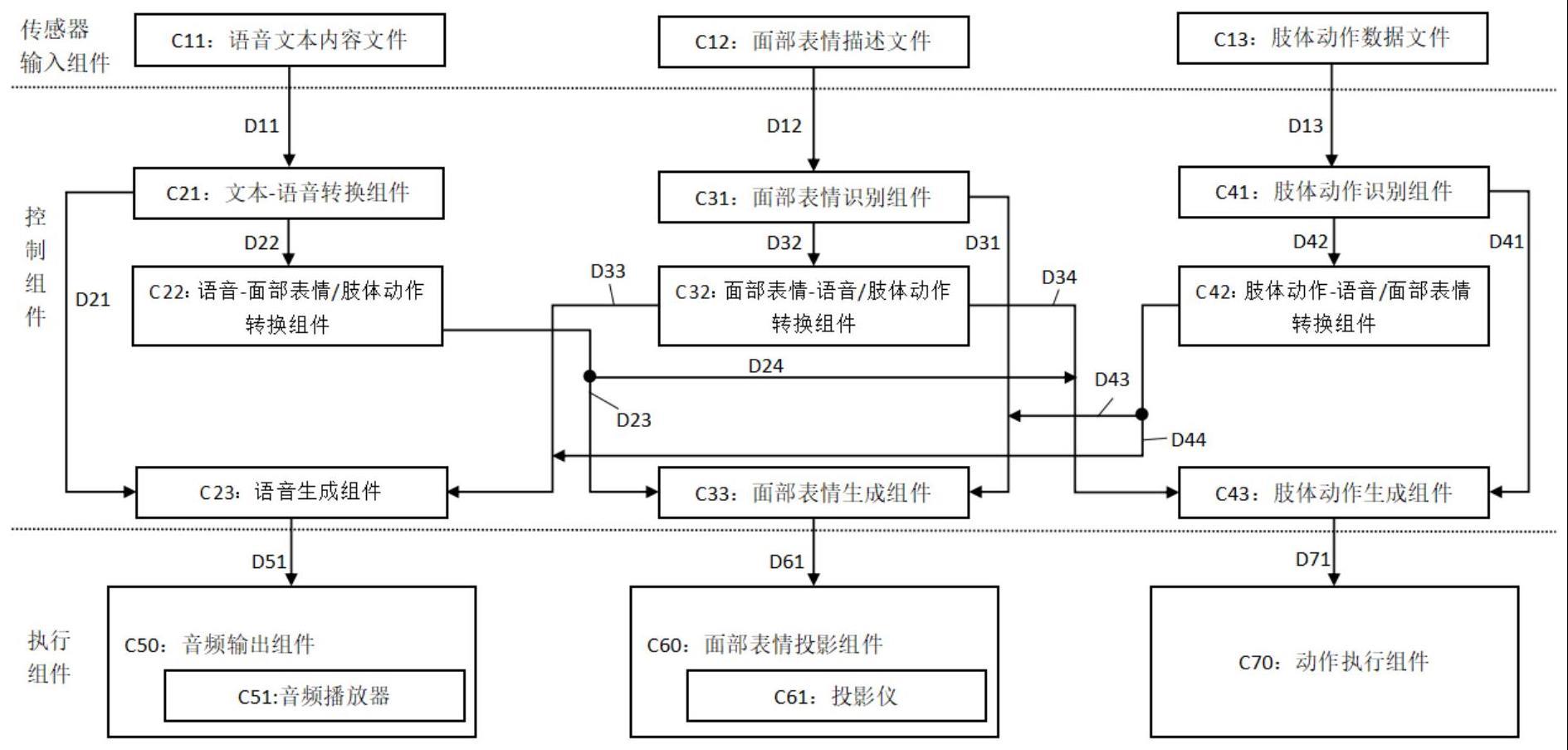

7、所述控制模块包括调用组件、传感器输入组件、控制组件和执行组件,所述控制模块根据所述通讯单元发送过来的信息,选择运行或执行存储在所述存储单元内的软件程序,以及选调存储在存储单元内的数据,控制所述执行组件执行相应的动作,使得机器人发出声音、做出肢体动作和做出面部表情中的其中一种或一种以上反应。

8、一种数字人实体化机器人系统的交互驱动方法,包括三大部分:

9、一、机器人发出语音

10、如果感知单元感知到交互对象发出语音、面部表情和肢体动作信息时,会将面部表情信息和肢体动作信息转化成面部表情-语音文本和肢体动作-语音文本,

11、1、调用组件调用传感器输入组件的语音文本内容文件;

12、2、语音文本内容文件传送给文本-语音转换组件,从而将语音文本内容文件转化成机器人需要播报的语音信号;

13、3、语音信号传送给语音-面部表情/肢体动作转换组件,从而将语音信号转化成与语音信号协调一致的面部表情信号和肢体动作信号;

14、4、语音信号还传送给语音生成组件,从而生成机器人所需要播放的语音;

15、5、语音传送到音频输出组件,播放机器人语音;

16、6、面部表情信号和肢体动作信号分别传送给面部表情生成组件和肢体动作生成组件,机器人从而做出与语音协调一致的面部表情和肢体动作;

17、二、机器人做出面部表情

18、如果感知单元感知到交互对象发出语音、面部表情和肢体动作信息时,会将语音信息和肢体动作信息分别转化成语音-面部表情描述文件和肢体动作-面部表情描述文件,

19、1、调用组件调用传感器输入组件的面部表情描述文件;

20、2、面部表情描述文件传送给面部表情识别组件,从而将面部表情描述文件转化成机器人需要做出的表情信号;

21、3、表情信号传送给面部表情-语音/肢体动作转换组件,从而将表情信号转化成与表情信号协调一致的语音信号和肢体动作信号;

22、4、表情信号还传送给面部表情生成组件,从而生成机器人需要投影的面部表情;

23、5、面部表情传送到面部表情投影组件,面部表情投影组件将面部表情投影到人形脸部外壳上;

24、6、语音信号和肢体动作信号分别传送给语音生成组件和肢体动作生成组件,机器人从而播放与面部表情协调一致的语音和做出与面部表情协调一致的肢体动作;

25、三、机器人做出肢体动作

26、如果感知单元感知到交互对象发出语音、面部表情和肢体动作信息时,会将语音信息和面部表情信息分别转化成语音-肢体动作数据文件和面部表情-肢体动作数据文件,

27、1、调用组件调用传感器输入组件的肢体动作数据文件;

28、2、肢体动作数据文件传送给肢体动作识别组件,从而将肢体动作数据文件转化成机器人需要做出的肢体动作信号;

29、3、肢体动作信号传送给肢体动作-语音/面部表情转换组件,从而将肢体动作信号转化成与肢体动作信号协调一致的语音信号和面部表情信号;

30、4、肢体动作信号还传送给肢体动作生成组件,从而生成机器人所需要执行的动作控制序列;

31、5、动作控制序列传送到动作执行组件,动作执行组件将动作控制序列发送给所述腿部、所述足部和所述机械臂上执行动作;

32、6、语音信号和面部表情信号分别传送给语音生成组件和面部表情生成组件,机器人从而播放与肢体动作协调一致的语音和做出与肢体动作协调一致的面部表情;

33、以上三部分执行时为并行执行。

34、本发明的技术方案,具有如下有益效果:

35、本发明提供一种数字人实体化机器人系统及其交互驱动方法,通过将感知单元感知到的外部环境信息和获取到的交互对象发出的指令信息——动作、表情、语音中的其中之一或以上,可以转化成与指令信息协调一致的语音信号、面部表情信号和肢体动作信号,不但使得机器人做出的反馈形式丰富立体,不再拘泥于文字、语音、视觉方面的交互,而是增加了接触式交互这种功能-肢体动作交互,通过将数字人配置实体化的机械结构,使得机器人可以做出肢体动作时,例如伸出手臂表示要握手,或张开双臂表示要拥抱,能够与交互对象进行接触式交互,与人类产生情感上的共鸣,而且使得机器人做出的表情可以根据交互对象发出的多数形式的指令信息产生丰富的变化,避免了数字人表情呆板的情况,大大提升了人机交互的效果和用户体验感。

技术特征:

1.一种数字人实体化机器人系统,包括感知单元(102)、控制模块(110)、通讯单元(103)、存储单元(105)和电源连通模块(111),其特征在于,

2.如权利要求1所述的一种数字人实体化机器人系统的交互驱动方法,其特征在于,包括三大部分:

技术总结

本发明涉及机器人技术领域,本发明提供一种数字人实体化机器人系统及其交互驱动方法,包括感知单元、控制模块、通讯单元、存储单元、电源连通模块和机械单元,所述机械单元包括机械结构,所述机械机构包括机身主体、可伸展的腿部、可伸展的足部、可伸展的机械臂和可转动的人形脸部外壳;所述感知单元、所述控制模块、所述通讯单元、所述执行组件和所述电源连通模块均安装在所述机身主体上,通过将感知单元感知到的外部环境信息和获取到的交互对象发出的指令信息,可以转化成与信息协调一致的语音信号或/和面部表情信号或/和肢体动作信号,并且能够与交互对象进行接触式交互,能够与人类产生情感上的共鸣,提升了用户体验感。

技术研发人员:鲍晟,田雨洁,袁建军,杜亮,王明远

受保护的技术使用者:上海大学

技术研发日:

技术公布日:2024/1/16

- 还没有人留言评论。精彩留言会获得点赞!