一种基于Tacotron2改进的语音合成方法

一种基于tacotron2改进的语音合成方法

技术领域

1.本发明属于利用语音合成及标点符号恢复语音技术领域,具体是一种基于tacotron2(端到端文本转语音深度神经网络模型)改进的语音合成方法,涉及到深度神经网络的模型,特别涉及到利用深度神经网络合成高质量语音的方法。

背景技术:

2.原始的tacotron2是将整段语音预测后全部输出,然而模型中使用的rnn(卷积神经网络)在应对长文本问题时总会产生失真严重及重复等问题。为了解决该问题,研究工作者用waveglow(wavenet改进的基于流的文本转语音网络模型)声码器替代wavenet(用于文本转语音的网络模型)声码器,waveglow声码器是基于流的生成模型,它有效的估计了密度,确保了快速高效的采样,但在一定程度上牺牲了语音合成的质量。因此,本发明首先提出了在语音合成模型之前附加标点符号恢复模块,通过标点符号对文本进行适当的分割,从而最大化的利用了模型的性能,合成高质量的语音。

技术实现要素:

3.本发明的主要目的是为了解决现有技术问题,提供一种基于tacotron2改进的语音合成方法。

4.基于tacotron2改进的语音合成方法,包括以下步骤:

5.a.文本预处理。

6.a1.使用数据库预训练标点符号的预测模型,然后将文本输入标点恢复模块,对标点符号进行预测。

7.a2.根据标点符号的预测对文本进行切分,并将分割好的文本按次序输入。

8.a3.将分割好的文本按照对应规则转化为拼音与声调的字符序列。

9.b.输入编码器以及解码器预测合成语音的梅尔谱图。

10.b1.将拼音与声调的字符序列输入3层卷积神经网络及双向lstm(长短时记忆网络)网络组成的编码器。

11.b2.通过加性注意力机制将编码器的输出送入解码器中进行预测。

12.c.利用wavenet声码器还原语音。

13.c1.通过三层卷积层获得梅尔频谱特征。

14.c2.梅尔频谱特征表达逆变换为时域波形样本。

15.其优点在于:

16.本发明首先将文本输入标点恢复模块,对文本进行分割,将分割好的文本按照对应规则转化为拼音与声调的字符序列,输入编码器以及解码器预测合成语音的梅尔谱图,最后利用wavenet声码器将梅尔频谱特征表达还原成合成的语音。

17.这种方法通过标点符号对文本进行适当的分割,简化了注意力模型,从而最大化的利用了模型的性能,合成高质量的语音。

附图说明

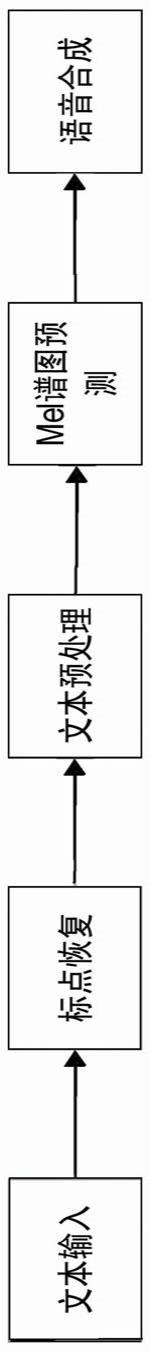

18.附图1是本发明中的语音合成的总体流程图。

19.附图2是本发明中的语音合成系统的具体流程图。

20.附图3是本发明中的语音合成系统的中间表征梅尔谱图(图3左边是中间表征梅尔谱图,右边是标尺,单位:梅尔)。

21.附图4是本发明中合成语音与真实语音的频域比较图。

22.附图5是本发明中合成语音与真实语音的时域比较图。

具体实施方式

23.为使本发明实施例的目的、技术方案及其优点更加清楚,下面结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚完整的描述,整体算法流程图如图1所示:

24.a.文本预处理。

25.所述步骤a具体包含以下步骤:

26.a1.首先,预训练标点符号的预测模型,训练集由python(爬虫,一种编程语言)的gensim(用于从原始的非结构化的文本中,无监督地学习到文本隐层的主题向量表达的开源工具包)库以及opencc(中文繁简体转换的开源工具包)库对维基百科最新数据库(2020-12-01)进行处理,筛选并最终获得1.2万条语句,并将每一个标点符号标注在语句中(例:’,comma’或’。period’),训练集:验证集:测试集的比例为7:2:1,相关参数为batch_size=100,epoch=10,learning_rate=0.1,hidden_size=600,projection_size=100。

27.然后将文本输入由lstm网络组成的标点符号预测网络,对标点符号进行预测,并输出由文本以及符号合并的文本。

28.a2.根据标点符号的预测对文本进行切分,规则为每遇到一个标点符号进行一次分割,并将分割好的文本按次序输入。

29.a3.将分割好的文本按照对应规则转化为拼音与声调的字符序列,每个字的序列由三部分组成,声母、韵母以及声调,声母与韵母之间有空格分隔,韵母及声调之间不加空格,韵母及声调与下一个声母之间有空格分隔(例:语音会被转化为’y u3 y in1’)。

30.b.输入编码器以及解码器预测合成语音的梅尔谱图。

31.所述步骤b具体包含以下步骤:

32.b1.将拼音与声调的字符序列输入3层卷积神经网络及双向lstm网络组成的编码器。采用的数据集为标贝科技的bznsyp(中文合成语音数据库)数据集,由于后期实验需要,我们又增加了1000条自录制数据,共计11000条语音及对应的已标注文本。标注文本的规则与上文步骤a3中将文本转化为拼音与声调的字符序列的规则时一致的。

33.b2.通过加性注意力机制将编码器的输出送入解码器中进行预测。其中,编码器和解码器的重要参数如下:batch_size=32,epoch=10,learning_rate=0.001,zoneout_rate=0.1,dropout_rate=0.5,adam_beta1=0.9,adam_beta2=0.999,adam_eplison=1e-6。

34.c.利用wavenet声码器还原语音。

35.c1.通过三层卷积层获得梅尔频谱特征。wavenet声码器的相关参数为learning_

rate=0.001,batch_size=32,epoch=10。

36.c2.梅尔频谱特征表达逆变换为时域波形样本使用的是短时傅里叶变换,短时傅里叶变换的公式为其中x(n)表示时间为n时的输入信号,w(n)表示窗长,r表示步长。

技术特征:

1.一种基于tacotron2改进的语音合成方法,其特征在于包括下列步骤:a.语音预处理;b.输入编码器以及解码器预测合成语音的梅尔谱图;c.利用wavenet声码器还原语音。2.根据权利要求1所述的一种基于tacotron2改进的语音合成方法,其特征在于包括下列步骤:所述步骤a具体包含以下步骤:a1.使用数据库预训练标点符号的预测模型,然后将文本输入标点恢复模块,对标点符号进行预测;a2.根据标点符号对文本进行切分,并将分割好的文本按次序输入;a3.将分割好的文本按照对应规则转化为拼音与声调的字符序列。3.根据权利要求1所述的一种基于tacotron2改进的语音合成方法,其特征在于包括下列步骤:所述步骤b具体包含以下步骤:b1.将拼音与声调的字符序列输入3层卷积神经网络及双向lstm网络组成的编码器;b2.通过加性注意力机制将编码器的输出送入解码器中进行预测。4.根据权利要求1所述的一种基于tacotron2改进的语音合成方法,其特征在于包括下列步骤:所述步骤c具体包含以下步骤:c1.通过三层卷积层获得梅尔频谱特征;c2.梅尔频谱特征表达逆变换为时域波形样本。

技术总结

一种基于Tacotron2改进的语音合成方法,属于语音合成技术领域,提供了一种基于Tacotron2改进的语音合成方法。本方法的特征是将文本输入标点恢复模块,对文本进行分割,将分割好的文本按照对应规则转化为拼音与声调的字符序列,输入编码器以及解码器预测合成语音的梅尔谱图,最后利用Wavenet声码器将梅尔频谱特征表达还原成合成的语音。实验证明本发明算法性能良好,最大化的利用了模型的性能,能够有效合成高质量的语音。能够有效合成高质量的语音。能够有效合成高质量的语音。

技术研发人员:于玲 周骁群

受保护的技术使用者:辽宁工业大学

技术研发日:2021.12.21

技术公布日:2022/5/17

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1