基于语义信息引导的视频-音频生成方法及系统与流程

本发明涉及智能语音领域,尤其涉及一种基于语义信息引导的视频-音频生成方法及系统。

背景技术:

1、v2a(video-to-audio,视频到音频)生成模型的进步促进了人工智能生成内容的发展,尤其在电影和视频后处理的应用中。v2a生成有两个关键目标:1、语义对齐:生成的声音事件应与视频内容一致;2、时间对齐:生成的声音应与视频帧同步。现有的v2a工作试图从两个方向提高发电性能。一个方向是采用更先进的网络,例如,生成对抗网络或自回归模型。另一个方向是通过结合各种条件来提高发电质量和可控性。具体的应用有diff-foley以及foley-crafter模型,通过输入视频,根据视频的信息生成与视频内容相关的音频。

2、在实现本发明过程中,发明人发现相关技术中至少存在如下问题:

3、尽管现有方法在v2a生成中表现出更好的时间对齐,但它们仍存在某些局限性。具体来说,上述现有模型无法为具有移动视觉存在的视频(例如飞行中的飞机和屏幕外的声音警报器)生成连续、长时间的声音。这表明指导不足的一个方面:时间条件不够准确。另一个方面源于语义视频条件的低时间分辨率。例如,diff-foley中视频功能的分辨率为4fps,远低于普通视频中的30fps。视频特征的低时间分辨率导致音频和视频之间的粗略同步,影响时间对齐性能。

技术实现思路

1、为了至少解决现有技术中现有的v2a模型无法为具有移动视觉存在的视频生成连续、长时间的声音以及对齐性较差的问题。

2、第一方面,本发明实施例提供一种基于语义信息引导的视频-音频生成方法,包括:

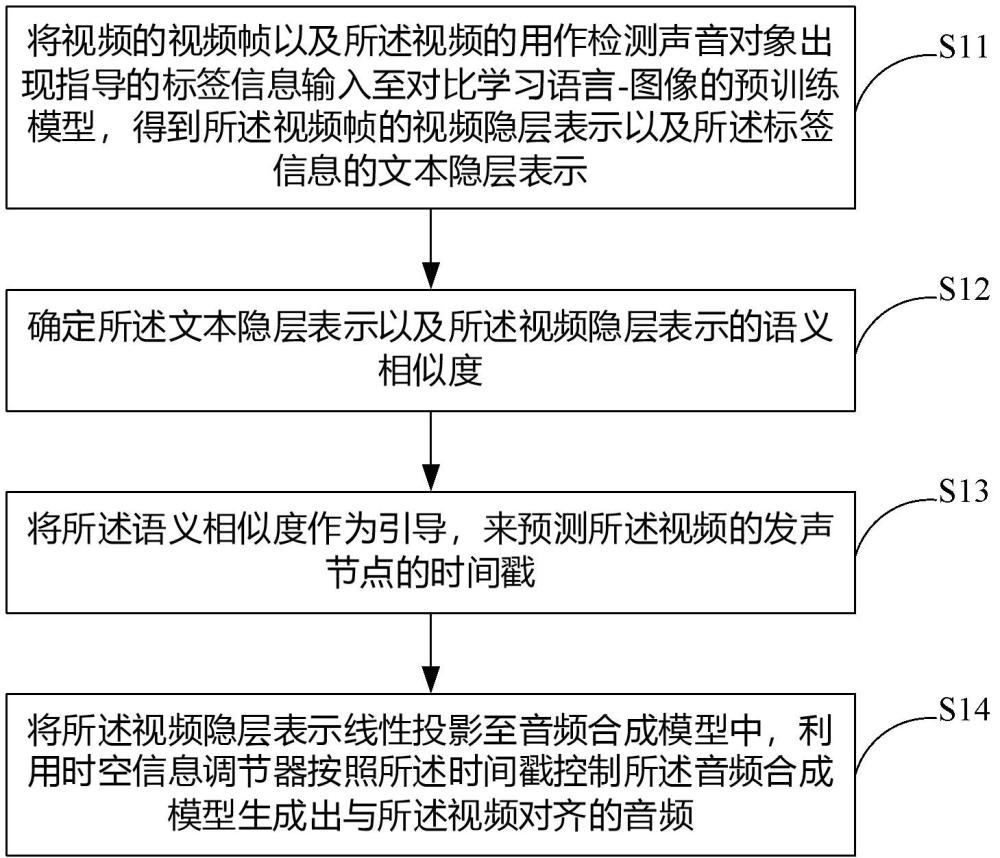

3、将视频的视频帧以及所述视频的用作检测声音对象出现指导的标签信息输入至对比学习语言-图像的预训练模型,得到所述视频帧的视频隐层表示以及所述标签信息的文本隐层表示;

4、确定所述文本隐层表示以及所述视频隐层表示的语义相似度;

5、将所述语义相似度作为引导,来预测所述视频的发声节点的时间戳;

6、将所述视频隐层表示线性投影至音频合成模型中,利用时空信息调节器按照所述时间戳控制所述音频合成模型生成出与所述视频对齐的音频。

7、第二方面,本发明实施例提供一种基于语义信息引导的视频-音频生成模型的训练方法,包括:

8、将视频的视频帧以及所述视频的标签信息输入至所述视频-音频生成模型,其中,所述视频-音频生成模型包括:对比学习语言-图像的预训练模型、用于将所述对比学习语言-图像的预训练模型适用于视频转音频的视觉编码器和框架适配器、分别独立训练的帧适配器以及时空信息调节器、音频合成模型;

9、通过所述对比学习语言-图像的预训练模型的编码器,得到所述视频帧的视频隐层表示以及所述标签信息的文本隐层表示;

10、利用带有投影层的视觉编码器和框架适配器对所述文本隐层表示以及所述视频隐层表示适配处理,确定所述文本隐层表示以及所述视频隐层表示的语义相似度,其中,所述投影层是可学习训练的;

11、将所述语义相似度作为引导,来预测所述视频的发声节点的时间戳;

12、利用所述帧适配器将所述视频隐层表示线性投影至音频合成模型中,利用时空信息调节器按照所述时间戳控制所述音频合成模型生成出与所述视频对齐的预测音频;

13、基于所述预测音频确定的扩散损失分别独立的对所述帧适配器以及所述时空信息调节器进行训练,直至达到训练要求为止。

14、第三方面,本发明实施例提供一种基于语义信息引导的视频-音频生成系统,包括:

15、嵌入确定模块,用于将视频的视频帧以及所述视频的用作检测声音对象出现指导的标签信息输入至对比学习语言-图像的预训练模型,得到所述视频帧的视频隐层表示以及所述标签信息的文本隐层表示;

16、相似度确定模块,用于确定所述文本隐层表示以及所述视频隐层表示的语义相似度;

17、时间戳预测模块,用于将所述语义相似度作为引导,来预测所述视频的发声节点的时间戳;

18、生成模块,用于将所述视频隐层表示线性投影至音频合成模型中,利用时空信息调节器按照所述时间戳控制所述音频合成模型生成出与所述视频对齐的音频。

19、第四方面,本发明实施例提供一种基于语义信息引导的视频-音频生成模型的训练系统,包括:

20、输入模块,用于将视频的视频帧以及所述视频的标签信息输入至所述视频-音频生成模型,其中,所述视频-音频生成模型包括:对比学习语言-图像的预训练模型、用于将所述对比学习语言-图像的预训练模型适用于视频转音频的视觉编码器和框架适配器、分别独立训练的帧适配器以及时空信息调节器、音频合成模型;

21、嵌入确定模块,用于通过所述对比学习语言-图像的预训练模型的编码器,得到所述视频帧的视频隐层表示以及所述标签信息的文本隐层表示;

22、相似度确定模块,用于利用带有投影层的视觉编码器和框架适配器对所述文本隐层表示以及所述视频隐层表示适配处理,确定所述文本隐层表示以及所述视频隐层表示的语义相似度,其中,所述投影层是可学习训练的;

23、时间戳预测模块,用于将所述语义相似度作为引导,来预测所述视频的发声节点的时间戳;

24、生成模块,用于利用所述帧适配器将所述视频隐层表示线性投影至音频合成模型中,利用时空信息调节器按照所述时间戳控制所述音频合成模型生成出与所述视频对齐的预测音频;

25、训练模块,用于基于所述预测音频确定的扩散损失分别独立的对所述帧适配器以及所述时空信息调节器进行训练,直至达到训练要求为止。

26、第五方面,提供一种电子设备,其包括:至少一个处理器,以及与所述至少一个处理器通信连接的存储器,其中,所述存储器存储有可被所述至少一个处理器执行的指令,所述指令被所述至少一个处理器执行,以使所述至少一个处理器能够执行本发明任一实施例的基于语义信息引导的视频-音频生成以及视频-音频生成模型的训练方法的步骤。

27、第六方面,本发明实施例提供一种存储介质,其上存储有计算机程序,其特征在于,该程序被处理器执行时实现本发明任一实施例的基于语义信息引导的视频-音频生成方法的步骤。

28、第七方面,本发明实施例提供一种计算机程序产品,包括计算机程序/指令,其特征在于,该计算机程序/指令被处理器执行时实现本发明任一实施例的基于语义信息引导的视频-音频生成以及视频-音频生成模型的训练方法的步骤。

29、本发明实施例的有益效果在于:通过数据集中已有的数据标签信息,通过视频信息与数据标签信息的相似度来确认视频的每个时刻是否应该有音频生成,从而通过引入数据标签信息的引导来生成视频-音频颗粒度对齐更好的音频,进而实现了持续性声音场景下的视频-音频合成,弥补了现有技术中视频-音频生成模型仅仅只能在短时事件中有较好效果的不足。要说明的是,本方法的生成方法依托于本方法构建的基于语义信息引导的视频-音频的生成模型来生成与视频对齐的音频。

技术特征:

1.一种基于语义信息引导的视频-音频生成方法,包括:

2.根据权利要求1所述的方法,其中,所述用作检测声音对象出现指导的标签信息包括:视频中不同声音对象的多个标签信息。

3.根据权利要求1所述的方法,其中,所述语义相似度通过所述文本隐层表示以及所述视频隐层表示的嵌入余弦相似度确定。

4.一种基于语义信息引导的视频-音频生成模型的训练方法,包括:

5.根据权利要求4所述的方法,其中,在训练所述帧适配器时,同时训练投影层,在训练所述时空信息调节器时,同时训练音频合成模型。

6.一种基于语义信息引导的视频-音频生成系统,包括:

7.根据权利要求6所述的系统,其中,所述用作检测声音对象出现指导的标签信息包括:视频中不同声音对象的多个标签信息。

8.根据权利要求6所述的系统,其中,所述语义相似度通过所述文本隐层表示以及所述视频隐层表示的嵌入余弦相似度确定。

9.一种基于语义信息引导的视频-音频生成模型的训练系统,包括:

10.根据权利要求9所述的系统,其中,所述训练模块用于:

11.一种计算机程序产品,包括计算机程序/指令,其特征在于,该计算机程序/指令被处理器执行时实现权利要求 1-5中任一项所述方法的步骤。

12.一种电子设备,其包括:至少一个处理器,以及与所述至少一个处理器通信连接的存储器,其中,所述存储器存储有可被所述至少一个处理器执行的指令,所述指令被所述至少一个处理器执行,以使所述至少一个处理器能够执行权利要求1-5中任一项所述方法的步骤。

13.一种存储介质,其上存储有计算机程序,其特征在于,该程序被处理器执行时实现权利要求1-5中任一项所述方法的步骤。

技术总结

本发明实施例提供一种基于语义信息引导的视频‑音频生成方法及系统。该方法包括:将视频帧以及视频的用作检测声音对象出现指导的标签信息输入至对比学习语言‑图像的预训练模型,得到视频帧的视频隐层表示以及标签信息的文本隐层表示;确定文本隐层表示以及视频隐层表示的语义相似度;将语义相似度作为引导,来预测视频的发声节点的时间戳;将视频隐层表示线性投影至音频合成模型中,利用时空信息调节器按照时间戳控制音频合成模型生成出与视频对齐的音频。本发明实施例通过视频帧以及标签信息,视频信息与数据标签信息的相似度来确认视频的每个时刻是否应该有音频生成,从而通过引入数据标签信息的引导来生成视频‑音频颗粒度对齐更好的音频。

技术研发人员:吴梦玥,张耀匀

受保护的技术使用者:思必驰科技股份有限公司

技术研发日:

技术公布日:2025/1/13

- 还没有人留言评论。精彩留言会获得点赞!