一种获得光学相干层析大焦深图像的处理方法

1.本发明属于图像处理和成像技术领域,尤其是涉及一种获得光学相干层析大焦深图像的处理方法。

背景技术:

2.光学相干层析术(optical coherence tomography, oct)是一种非接触、非侵入的成像技术。oct的横向分辨率由样品聚焦光束的衍射限制光斑大小决定。作为一种三维成像技术,oct的横向分辨率越高,焦深就会越小。为了获得大深度成像,在oct系统开发中通常会在横向分辨率和焦深方面进行折中选择。

3.如何在高分辨率的情况下,提高oct图像的焦深一直是一个难点。典型的硬件方法是使用二元相位空间滤波器或轴向透镜来实现贝塞尔光束以拓展焦深。此外,2017年e. bo等人利用多重孔径合成来拓展焦深(bo e, luo y, chen s, liu x, wang n, ge x, wang x, chen s, chen s, li j, liu l. depth

‑

of

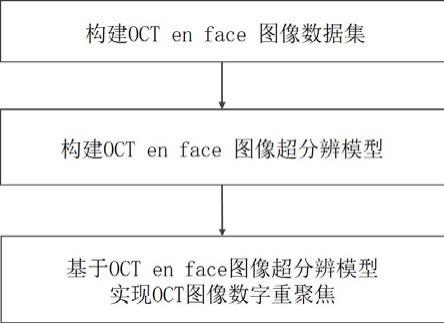

‑

focus extension in optical coherence tomography via multiple aperture synthesis. optica. 2017, 4(7), 701

‑

706.)。然而,硬件方法通常需要开发复杂的成像系统,稳定性差。

4.与基于硬件的方法相比,数字信号处理方法提供了替代的和相对便宜的解决方案。例如,干涉合成孔径显微术(interferometric synthetic aperture microscopy, isam) (ralston t s, marks d l, carney p s, boppart s a. interferometric synthetic aperture microscopy. nature physics. 2007; 3(2), 129

‑

134.) 可以在大深度范围内进行高分辨成像,但在采集过程中需要保证绝对的相位稳定。

技术实现要素:

5.本发明的主要目的是解决如何在提高横向分辨率的情况下获得大焦深图像的问题,提供一种获得光学相干层析大焦深图像的处理方法。

6.本发明方法首先建立不同离焦量下配准的oct en face低分辨图像和高分辨图像对所构成的数据集,然后构建oct en face图像超分辨模型,通过深度学习方法,学习oct en face高分辨率图像和低分辨率图像间的映射关系,获得oct三维图像的数字重聚焦,以便得到oct图像焦深拓展后的高分辨图像即大焦深图像。

7.为实现以上目的,本发明采用如下技术方案:一种获得光学相干层析大焦深图像的处理方法,包括三个步骤:构建光学相干层析(optical coherence tomography, oct)en face图像数据集、构建oct en face图像超分辨模型以及基于构建的oct en face图像超分辨模型实现oct图像数字重聚焦三个步骤;步骤1:构建oct en face图像数据集;所述oct en face图像数据集是指不同离焦量下配准的oct en face低分辨图像和高分辨图像对所构成的数据集;具体构建方法:步骤1.1:把入射光束聚焦在样品内部,对所述样品内部的选定区域以等间隔方式

采集oct en face图像序列;具体方法如下:沿指定方向移动样品台,采集入射光束聚焦于m+1个位置时所述样品内部的选定区域的oct en face图像序列,每个图像序列采集的图像数目均为p个;其中,在入射光束的原有焦深范围内采集的一组oct en face图像序列作为基准图像序列,所述基准图像序列属于oct en face高分辨图像;其余不在入射光束的原有焦深范围内的m个位置采集的m组图像序列为不同离焦量下的oct en face低分辨图像序列,所述不同离焦量下的oct en face低分辨图像序列对应不同的分辨率;所述样品内部的选定区域的长度等于入射光束原有焦深的0.8

‑

1倍;所述m为2

‑

8之间的自然数;所述每个图像序列采集的图像数目p为4

‑

100之间的自然数;步骤1.2:对于不同分辨率的oct en face低分辨图像序列,在所述基准图像序列中利用oct en face图像配准方法寻找并配准对应位置的oct en face高分辨图像,建立m个不同离焦量下的数据集,每个数据集中包含p个配准的oct en face低分辨图像和高分辨图像对;其中,所述oct en face图像配准方法包括两步:oct en face低分辨图像和高分辨图像对的选择、oct en face低分辨图像和高分辨图像的精细配准;(1)所述oct en face低分辨图像和高分辨图像对的选择方法是,对于从某一个离焦位置采集的所述oct en face低分辨图像序列中提取的每一个离焦的oct en face低分辨图像,从所述基准图像序列中选择一个oct en face高分辨图像进行配对;获得一个图像对的具体方法:将某个离焦的oct en face低分辨图像与所述基准图像序列中的每一个oct en face高分辨图像初步配准;然后,计算初步配准后的离焦的oct en face低分辨图像与所述每一个oct en face高分辨图像之间的相关系数r,从中选择相关系数最高的oct en face高分辨图像与离焦的oct en face低分辨图像作为配对图像;两幅图像间的相关系数r由以下公式计算:

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(1)其中f(x,y)和g(x,y)分别代表高分辨图像和低分辨图像的灰度值,x表示图像的横坐标,y表示图像的纵坐标,代表高分辨图像的平均灰度值,代表低分辨图像的平均灰度值。

8.所述oct en face低分辨图像和高分辨图像初步配准的方法包括仿射变换法、刚体变换法、投影变换法、非线性变换法或矩和主轴法;(2)oct en face低分辨图像和高分辨图像的精细配准方法包括金字塔配准法、小波变换配准法、最大互信息配准法和图谱配准法;步骤2:构建oct en face图像超分辨模型;通过深度学习方法分别学习oct en face高分辨图像和m组不同分辨率的oct en face低分辨图像间的映射关系,构建m个oct en face图像超分辨模型;

en face图像序列;具体方法如下:沿指定方向移动样品台,采集入射光束聚焦于m+1个位置时样品内部的选定区域的oct en face图像序列,每个图像序列采集的图像数目均为p个;其中,在入射光束的原有焦深范围内采集的一组oct en face图像序列作为基准图像序列,所述基准图像序列属于oct en face高分辨图像;其余不在入射光束的原有焦深范围内的m个位置采集的m组图像序列为不同离焦量下的oct en face低分辨图像序列,所述不同离焦量下的oct en face低分辨图像序列对应不同的分辨率;利用oct en face图像配准方法寻找并配准对应位置的oct en face高分辨图像,建立m个不同离焦量下的数据集,每个数据集中包含p个配准的oct en face低分辨图像和高分辨图像对;具体实施方法如下:首先把入射光束聚焦在样品内部,以等间隔方式采集所述样品内部的选定区域的oct en face图像序列(图像序列的图像数量p在自然数4

‑

100之间选择,本实施例选为20),样品内部的选定区域oct en face图像序列采集示意图如附图2所示,201表示扫描物镜,202表示待测样品,203表示样品台,204表示样品内部的选定区域。样品内部的选定区域的长度等于入射光束原有焦深的0.8

‑

1倍,本实施例中入射光束原有焦深为60微米,样品内部的选定区域的长度取入射光束原有焦深的1倍,取为60微米。如附图2(a)所示,把入射光束聚焦在样品内部,在入射光束的原有焦深范围内采集一组oct en face图像序列作为基准图像序列,所述基准图像序列属于oct en face高分辨图像;然后沿指定方向移动样品台203,使待测样品202的位置逐步远离或靠近扫描物镜201,改变光束在样品内部的聚焦位置,使得样品内部的选定区域204具有不同的离焦量。依据不同离焦量设置,采集m个不同离焦量下的oct en face低分辨图像序列,所述不同离焦量下的oct en face低分辨图像序列对应不同的分辨率。在本实施例中,我们使得样品202逐步远离扫描物镜201,设置m=4,离焦量分别设置为60μm,120μm,180μm和240μm,分别如附图2(b)

‑

2(e)所示。

13.对于不同分辨率的oct en face低分辨图像序列,在所述基准图像序列中利用oct en face图像配准方法寻找并配准对应位置的oct en face高分辨图像,建立4个不同离焦量下的数据集,每个数据集中包含20个配准的oct en face低分辨图像和高分辨图像对。

14.实施例中的oct en face图像配准方法设计如附图3所示,包括;首先选择oct en face低分辨图像和高分辨图像对,具体步骤如下:对于从某一个离焦位置采集的oct en face低分辨图像序列中提取的每一个离焦的oct en face低分辨图像,从基准图像序列中选择一个oct en face高分辨图像进行配对;获得一个图像对的具体方法:将某个离焦的oct en face低分辨图像与基准图像序列中的每一个oct en face高分辨图像利用仿射变换初步配准;然后,计算初步配准后的离焦的oct en face低分辨图像与每一个oct en face高分辨图像之间的相关系数r,从中选择相关系数最高的oct en face高分辨图像与离焦的oct en face低分辨图像作为配对图像;两幅图像间的相关系数r由以下公式计算:

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(1)其中f(x,y)和g(x,y)分别代表高分辨图像和低分辨图像的灰度值,x表示图像的横坐标,y表示图像的纵坐标,代表高分辨图像的平均灰度值,代表低分辨图像的平均灰度值。

15.然后,采用金字塔配准算法在初步配准的oct en face低分辨图像和高分辨图像对上完成精细的多尺度图像配准,具体实施方法如下:图像首先被分成n

×

n个图像块(实施例中取n=5),计算对应图像块的二维归一化互相关图。

16.高分辨图像f和低分辨图像g间的互相关图(cross

‑

correlation map, ccm)定义如下:

ꢀꢀ

(2)其中u和v分别表示ccm的横坐标和纵坐标。

17.高分辨图像f和低分辨图像g间的归一化互相关图(normalized cross

‑

correlation map, nccm)计算如下所示:(3)其中ppmcc是皮尔逊积矩相关系数(pearson product

‑

moment correlation coefficient, ppmcc), cov()代表协方差函数,是f的标准差,是g的标准差,max表示求最大值,min表示求最小值,是ppmcc的最大值,是ppmcc的最小值。

18.然后将归一化互相关图拟合为二维高斯函数,如下定义:

ꢀꢀꢀꢀꢀꢀꢀ

(4)其中x0和y0分别代表输入图像对在两个方向上的亚像素位移值,a表示灰度值,和分别表示x和y方向上的标准差。二维高斯函数的峰值坐标就对应每个图像块的位移;5

×

5个图像块得到5

×

5个位移,把这些位移分别沿x和y方向插值到图像的像素个数,获得与原图像大小一致的位移图,利用该图像进行oct en face低分辨图像和高分辨图像配准。如果位移图中的最大灰度值(或者容差)大于设定值,则重复附图3中的步骤 2.2.2

‑

2.2.4。如果容差小于设定值,判断图像块大小是否小于设定的最小图像块大小,如果不小于设定值,则增加n值(赋值n=n+2)并执行附图3中的步骤2.2.1

‑

2.2.5。如果小于设定的最小图像块大小,则完成图像配准,此时输入的低分辨图像和高分辨图像就达到了亚像素级配准。本

实施例中容差的设定值为0.2;最小图像块大小为40

×

40(像素

×

像素)。

19.在图像配准之后,建立了4个不同离焦量下配准的oct en face低分辨图像和高分辨图像对数据集,每个数据集包含20个图像对。其中,图像大小为1000

×

1000(像素

×

像素),对应于3mm

×

3mm的视野范围。把大图像划分为大小为80

ꢀ×ꢀ

80(像素

×

像素)的图像块,在划分时去除特征信息较少的图像块,然后经过翻转、旋转等数据扩充,生成3000对80

ꢀ×ꢀ

80(像素

×

像素)oct en face低分辨图像和高分辨图像对数据集。最后,按照3:1:1的比例分配训练集、验证集和测试集。

20.步骤2:构建oct en face 图像超分辨模型;具体实施方法如下:在oct en face 图像超分辨模型构建中,通过深度学习方法学习oct en face高分辨图像和不同分辨率的oct en face低分辨图像间的映射关系,获得oct三维图像的数字重聚焦,实现oct图像焦深的拓展。

21.本实施例采用生成对抗神经网络作为深度学习的超分辨模型(图像超分辨模型还可以选择卷积神经网络、胶囊网络或图神经网络)。生成对抗神经网络由一个生成器和一个判别器组成,输入低分辨图像到生成对抗网络的生成器中得到生成图像,该生成图像和高分辨图像被输入到判别器中,判别器用于预测真实高分辨图像比生成图像更真实的概率,并返回损失结果更新生成器和判别器权重参数,如此往复训练直至生成对抗神经网络收敛。

22.判别器的预测概率如下式所示:

ꢀꢀꢀ

(5)其中为生成图像, 为高分辨图像,表示判断高分辨图像真实的概率,表示判断超分辨图像更真实的概率,c(x)为判别器的输出,和分别代表对所有生成数据和高分辨取平均值的操作。对抗损失结果由判别器生成,用于更新判别器的对抗损失函数由公式(6)计算,更新生成器的对抗损失函数由公式(7)计算;

ꢀꢀꢀꢀꢀ

(6)

ꢀꢀꢀꢀꢀ

(7)像素损失函数计算方法如公式(8)所示:

ꢀꢀꢀꢀꢀ

(8)其中w和h分别代表图像的宽度和高度方向上的像素总数,x和y表示图像的横坐标和纵坐标。实施例中w和h均等于80。

23.特征损失函数通过预先训练的图像分类网络来衡量图像之间的语义差异,采用k. simonyan等人(simonyan k, zisserman a. very deep convolutional networks for large

‑

scale image recognition. in proceedings of international conference on learning representations. 2015, 1

–

14.)描述的预先训练的vgg19网络提取感知域特

征。vgg19是一个卷积神经网络,由16个卷积层和3个全连接层组成。特征损失函数采用公式(9)定义:

ꢀꢀꢀꢀꢀ

(9)其中,表示在vgg19网络中第i层池化层后第j层卷积层输出的特征图, 和 是特征图的高和宽。在这里使用特征图 定义的 作为特征损失函数。

24.实施例中采用对抗损失函数为判别器的损失函数;生成器的损失函数包含对抗损失函数、像素损失函数和特征损失函数,其计算方法如公式(10):

ꢀꢀꢀꢀꢀꢀꢀ

(10)其中采用加权参数m、θ和η来控制三种损失函数之间的权衡。本实施例中m=0.01,θ=1,η=0.005。

25.实施例生成对抗网络中生成器网络结构如附图4所示,包括卷积模块、特征提取模块和特征重建模块;卷积模块包括一个卷积层conv;特征提取模块包括64个残差密连接块rrdb block。每个残差密连接块结构如附图5所示,每个残差密连接块由23个密集连接块组成,同时每个密集连接块之间都加入了跳跃连接;密集连接块由五个卷积层conv和四个lrelu层组成,在每个块中,每层的特征图都与相同尺度的所有先前特征连接在一起。

26.特征重建模块由两个卷积层conv和一个lrelu层组成,用于将学习到的特征重建为超分辨图像。

27.实施例生成器网络中各卷积层对应的卷积核大小(k)、个数(n)、步长(s)在图4和图5中已标注。

28.实施例判别器结构如附图6所示,包含8个具有3

ꢀ×ꢀ

3滤波器核的卷积层conv。除了第一层之外,每个卷积层后面都有一个批处理归一化层bn和一个lrelu层。卷积层之后是两个线性层和一个lrelu层。各卷积层对应的卷积核大小(k)、个数(n)、步长(s)在图6中已标注。

29.利用4个不同离焦量下配准的oct en face低分辨图像和高分辨图像数据集,分别训练生成对抗神经网络,得到4个不同离焦量下的oct en face图像超分辨模型,所述oct en face图像超分辨模型均采用adam算法进行优化,超参数分别为α =0, β1= 0.9, β2= 0.99。设置训练迭代次数为150000次。所述生成对抗神经网络的训练和测试使用深度学习框架pytorch完成。

30.步骤3:基于构建的oct en face图像超分辨模型实现oct图像数字重聚焦;具体实施方法如下:对于待处理的oct三维图像数据,首先确定入射光束的聚焦位置,依据聚焦位置、原有焦深和所述离焦量划分待处理的oct三维图像,获得在原有焦深范围内的oct en face高分辨图像序列和分别沿深度方向的焦深范围前和焦深范围后各4组(共计8组)oct en face低分辨图像序列;其中,oct en face高分辨图像不需要进行超分辨处理;沿深度方向

的焦深范围前和焦深范围后各4组oct en face低分辨图像序列对应的离焦量分别为30μm

‑

90μm,90μm

‑

150μm,150μm

‑

210μm,210μm以上。分别采用构建的4个对应离焦量(60μm,120μm,180μm和240μm)下的oct en face图像超分辨模型对不同离焦量下划分的焦深范围前和焦深范围后各4组oct en face低分辨图像序列进行超分辨处理,获得焦深范围前和焦深范围后各4组oct en face超分辨图像序列,实现图像重聚焦,提高了待处理的oct三维图像中原有焦深之外的oct en face图像的横向分辨率,最后把没有进行超分辨处理的焦深范围内的一组oct en face高分辨图像序列和处理得到的8组oct en face超分辨图像序列分别沿深度方向的焦深范围前和焦深范围后重新堆叠起来形成重聚焦的oct三维图像,实现焦深拓展。

31.如附图7、附图8和附图9所示,给出了本发明的oct en face图像数字重聚焦结果。图7为离焦量240 μm的斑马鱼oct en face低分辨图像,图8为相同样品在焦深范围内获得的一个oct en face高分辨图像,图9为本发明输出的图7的数字重聚焦图像或者超分辨图像,从数字重聚焦图像中可以看到清晰的斑马鱼结构。这表明通过本发明的方法,离焦的oct en face图像的横向分辨率得到提高,实现了oct图像的焦深拓展。

32.本发明实施时,首先依据离焦量设置,利用图像配准算法构建oct en face高分辨图像和低分辨图像对数据集,然后构建oct en face图像超分辨模型,通过深度学习方法学习oct en face高分辨图像和不同分辨率的oct en face低分辨图像间的映射关系,基于不同离焦量下的oct en face图像超分辨模型获得oct三维图像的数字重聚焦,实现oct图像焦深的拓展。本发明可以在不增加oct系统硬件复杂度的情况下实现光学相干层析图像的焦深拓展,速度快、可移植性强。

33.上述实施例为说明本发明的技术构思及特点,其目的在于让熟悉此项技术的人员能够了解本发明内容并加以实施,并不能以此限制本发明的保护范围,凡根据本发明实质所做的等效变化或修饰,都应涵盖在本发明的保护范围内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1