模型训练方法及系统、计算机可存储介质与流程

本公开涉及计算机,特别涉及基于联邦学习的模型训练方法及系统、计算机可存储介质。

背景技术:

1、联邦学习可以使多个参与方在保证数据隐私的前提下共同完成模型训练任务。联邦学习被广泛应用于移动通信领域,并且已经成为3gpp((3rd generation partnershipproject,第三代合作伙伴计划)等标准组织的重点研究内容。

2、相关技术中,为参与联邦学习的多个ue(user equipment,用户设备)预先人工设定相同的本地联邦学习模型的超参数的值。

技术实现思路

1、相关技术中,通过为不同ue人工设定相同的本地联邦学习模型的超参数的值,未考虑不同ue的不同情况,联邦学习模型的准确率有待提高。

2、针对上述技术问题,本公开提出了一种解决方案,可以提高联邦学习模型的准确率。

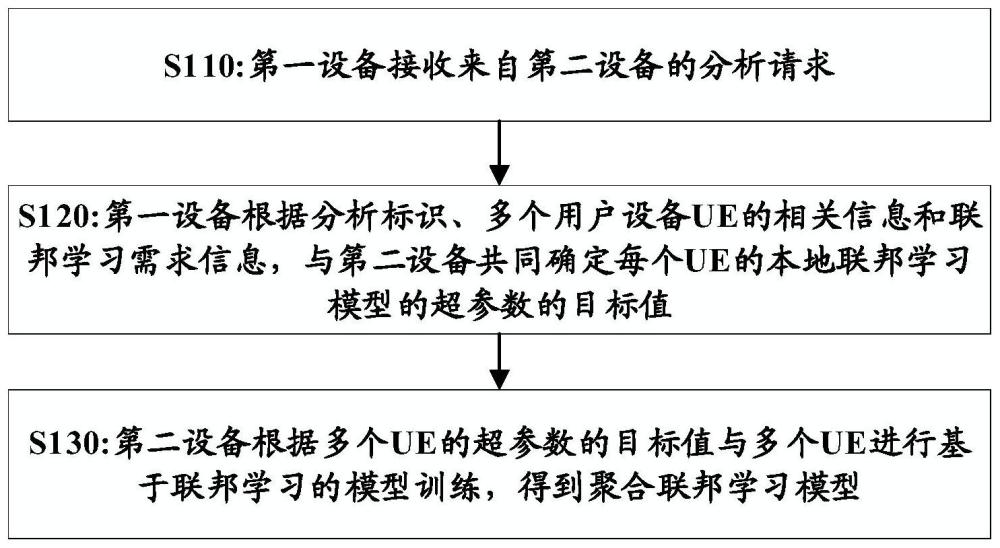

3、根据本公开的第一方面,提供了一种基于联邦学习的模型训练方法,包括:第一设备接收来自第二设备的分析请求,所述分析请求包括分析标识、多个用户设备ue的相关信息和联邦学习需求信息;所述第一设备根据所述分析标识、所述多个用户设备ue的相关信息和所述联邦学习需求信息,与所述第二设备共同确定所述每个ue的本地联邦学习模型的超参数的目标值;所述第二设备根据所述多个ue的超参数的目标值与所述多个ue进行基于联邦学习的模型训练,得到聚合联邦学习模型。

4、在一些实施例中,与所述第二设备共同确定所述每个ue的本地联邦学习模型的超参数的目标值包括:响应于在第一时间接收到所述分析请求,所述第一设备根据所述分析标识,获取与每个ue相关的第一时间的性能数据;所述第一设备根据所述分析标识、所述多个用户设备ue的相关信息、所述联邦学习需求信息和与所述每个ue相关的第一时间的性能数据,与所述第二设备共同确定所述每个ue的本地联邦学习模型的超参数的目标值。

5、在一些实施例中,所述第一设备根据所述分析标识、所述多个用户设备ue的相关信息、所述联邦学习需求信息和与所述每个ue相关的第一时间的性能数据,与所述第二设备共同确定所述每个ue的本地联邦学习模型的超参数的目标值包括:所述第一设备根据所述分析标识、所述多个用户设备ue的相关信息、所述联邦学习需求信息和与所述每个ue相关的第一时间的性能数据,利用第一预配置策略或预训练机器学习模型,确定所述每个ue的本地联邦学习模型的超参数的中间值;所述第一设备发送所述超参数的中间值到所述第二设备;所述第二设备根据所述超参数的中间值,利用第二预配置策略,确定所述每个ue的本地联邦学习模型的超参数的目标值。

6、在一些实施例中,所述超参数包括丢弃率,所述方法还包括:所述第二设备根据每个ue的本地联邦学习模型的丢弃率的目标值,确定所述每个ue的本地联邦学习模型;所述第二设备发送所述每个ue的本地联邦学习模型和与所述每个ue对应的超参数的目标值到所述每个ue用于对所述每个ue的本地联邦学习模型进行本地训练;所述第二设备接收来自所述每个ue的训练后的本地联邦学习模型;所述第二设备对所述多个ue的训练后的本地联邦学习模型进行模型聚合,得到所述聚合联邦学习模型。

7、在一些实施例中,所述模型训练方法还包括:在基于联邦学习的模型训练过程中,所述第二设备发送联邦学习反馈信息到所述第一设备;所述第一设备根据来自所述第二设备的联邦学习反馈信息,与所述第二设备共同更新所述每个ue的本地联邦学习模型的超参数的目标值。

8、在一些实施例中,所述联邦学习反馈信息包括所述分析标识,与所述第二设备共同更新所述每个ue的本地联邦学习模型的超参数的目标值包括:响应于在第二时间接收所述联邦学习反馈信息,所述第一设备根据所述分析标识,获取与每个ue相关的第二时间的性能数据;所述第一设备根据所述联邦学习反馈信息和与每个ue相关的第二时间的性能数据,与所述第二设备共同更新所述每个ue的本地联邦学习模型的超参数的目标值。

9、在一些实施例中,所述第一设备根据所述联邦学习反馈信息和与每个ue相关的第二时间的性能数据,与所述第二设备共同更新所述每个ue的本地联邦学习模型的超参数的目标值包括:所述第一设备根据所述联邦学习反馈信息和与每个ue相关的第二时间的性能数据,利用第一预配置策略或预训练机器学习模型,更新所述每个ue的本地联邦学习模型的超参数的中间值,其中,所述联邦学习反馈信息包括所述分析标识、多个ue的相关信息、联邦学习需求信息、每个ue的超参数的目标值、每个ue的训练时延信息和每个ue的通信时延信息中的至少一种;所述第二设备根据更新后的超参数的中间值,利用第二预配置策略,更新所述每个ue的本地联邦学习模型的超参数的目标值。

10、在一些实施例中,所述性能数据包括ue的网络性能数据和ue性能数据中的至少一种,其中,所述网络性能数据包括上行吞吐量、下行吞吐量、上行数据传输速率、下行数据传输速率和服务质量qos中的至少一种。

11、在一些实施例中,所述超参数包括丢弃率、本地迭代次数、学习率和批数据的大小中的至少一种;和/或所述多个ue的相关信息包括所述多个ue的用户标识列表、所述多个ue的兴趣区aoi信息、所述多个ue在联邦学习中的权重信息、所述多个ue的本地数据量信息和所述多个ue的计算能力信息中的至少一种;和/或所述联邦学习需求信息包括联邦学习的时间窗信息和联邦学习模型的模型大小中的至少一种。

12、在一些实施例中,所述第一设备包括网络数据分析功能nwdaf网元,所述第二设备包括应用功能af网元;或所述第一设备包括人工智能ai分析网元,所述第二设备包括应用层网元。

13、根据本公开第二方面,提供了一种基于联邦学习的模型训练系统,包括:第一设备,被配置为:接收来自第二设备的分析请求,所述分析请求包括分析标识、多个用户设备ue的相关信息和联邦学习需求信息;并根据所述分析标识、所述多个用户设备ue的相关信息和所述联邦学习需求信息,与所述第二设备共同确定所述每个ue的本地联邦学习模型的超参数的目标值;和所述第二设备,被配置为根据所述多个ue的超参数的目标值与所述多个ue进行基于联邦学习的模型训练,得到聚合联邦学习模型。

14、根据本公开第三方面,提供了一种基于联邦学习的模型训练系统,包括:存储器;以及耦接至所述存储器的处理器,所述处理器被配置为基于存储在所述存储器的指令,执行上述任一实施例所述的基于联邦学习的模型训练系统方法。

15、根据本公开的第四方面,提供了一种计算机可存储介质,其上存储有计算机程序指令,该指令被处理器执行时实现上述任一实施例所述的基于联邦学习的模型训练系统方法。

16、在上述实施例中,可以提高联邦学习模型的准确率。

技术特征:

1.一种基于联邦学习的模型训练方法,包括:

2.根据权利要求1所述的模型训练方法,其中,与所述第二设备共同确定所述每个ue的本地联邦学习模型的超参数的目标值包括:

3.根据权利要求2所述的模型训练方法,其中,所述第一设备根据所述分析标识、所述多个用户设备ue的相关信息、所述联邦学习需求信息和与所述每个ue相关的第一时间的性能数据,与所述第二设备共同确定所述每个ue的本地联邦学习模型的超参数的目标值包括:

4.根据权利要求3所述的模型训练方法,其中,所述超参数包括丢弃率,所述模型训练方法还包括:

5.根据权利要求1-4任一项所述的模型训练方法,还包括:

6.根据权利要求5所述的模型训练方法,其中,所述联邦学习反馈信息包括所述分析标识,与所述第二设备共同更新所述每个ue的本地联邦学习模型的超参数的目标值包括:

7.根据权利要求6所述的模型训练方法,其中,所述第一设备根据所述联邦学习反馈信息和与每个ue相关的第二时间的性能数据,与所述第二设备共同更新所述每个ue的本地联邦学习模型的超参数的目标值包括:

8.根据权利要求2所述的模型训练方法,其中,所述性能数据包括ue的网络性能数据和ue性能数据中的至少一种,其中,所述网络性能数据包括上行吞吐量、下行吞吐量、上行数据传输速率、下行数据传输速率和服务质量qos中的至少一种。

9.根据权利要求1所述的模型训练方法,其中,所述超参数包括丢弃率、本地迭代次数、学习率和批数据的大小中的至少一种;和/或

10.根据权利要求1所述的模型训练方法,其中,

11.一种基于联邦学习的模型训练系统,包括:

12.一种基于联邦学习的模型训练系统,包括:

13.一种计算机可存储介质,其上存储有计算机程序指令,该指令被处理器执行时实现如权利要求1至10任一项所述的模型训练方法。

技术总结

本公开涉及基于联邦学习的模型训练方法及系统、计算机可存储介质,涉及计算机技术领域。基于联邦学习的模型训练方法包括:第一设备接收来自第二设备的分析请求,所述分析请求包括分析标识、多个用户设备UE的相关信息和联邦学习需求信息;所述第一设备根据所述分析标识、所述多个用户设备UE的相关信息和所述联邦学习需求信息,与所述第二设备共同确定所述每个UE的本地联邦学习模型的超参数的目标值;所述第二设备根据所述多个UE的超参数的目标值与所述多个UE进行基于联邦学习的模型训练,得到聚合联邦学习模型。根据本公开,可以提高联邦学习模型的准确率。

技术研发人员:于梦晗,李鹏宇

受保护的技术使用者:中国电信股份有限公司

技术研发日:

技术公布日:2024/1/22

- 还没有人留言评论。精彩留言会获得点赞!