机器翻译方法和机器翻译训练方法、电子设备和存储介质与流程

1.本技术实施例涉及人工智能技术领域,特别是涉及一种机器翻译和机器翻译训练方法、电子设备和存储介质。

背景技术:

2.机器翻译是通过计算机将一种自然语言转换为另一种自然语言的过程,它是计算语言学的一个分支,是人工智能的终极目标之一,具有重要的科学研究价值。

3.同时,机器翻译又具有重要的实用价值。随着经济全球化及互联网的飞速发展,机器翻译技术在促进政治、经济、文化交流等方面起到越来越重要的作用。

4.相关技术中,通过非自回归神经机器翻译的方法将待翻译句子中的待翻译词按照目标语言的结构进行重排序,得到伪翻译句子,再将伪翻译句子使用非自回归方法翻译成所述目标语言的目标句子,缺陷是在非自回归模型中,每个单词之间没有依赖关系,整个输出序列的每个单词被并行地同步预测,虽然其推断速度得到了很大改善,但是生成质量却往往较差。

5.进一步地,通过建模协同关系来提高非自回归神经机器翻译质量的方法来生成翻译结果,但是由于目前的依存句法分析的准确度不高而且现有模型无法很好的对依存句法树进行建模,容易引入错误信息,对翻译结果产生负面影响。

技术实现要素:

6.本发明实施例提供了一种机器翻译方法和机器翻译训练方法以及装置,用于至少解决上述技术问题之一。

7.第一方面,本发明实施例提供了一种机器翻译方法,包括:对输入文本进行编码得到编码表示;对所述编码表示进行对应于目标语言文本的长度预测,并构建非自回归解码输入;对所述非自回归解码输入进行解码获取非自回归解码输出;将所述非自回归解码输出作为自回归解码输入,获取自回归解码输出;判断所述非自回归解码输出与所述自回归解码输出是否一致且末尾是否是终止符号;若所述非自回归解码输出与所述自回归解码输出一致且末尾是终止符号,输出目标语言文本。

8.第二方面,本发明实施例提供了一种机器翻译训练方法,包括:获取与解码器输入对应的自回归解码输出与非自回归解码输出;基于所述自回归解码输出的后验概率和真实标签以及所述非自回归解码输出的后验概率和真实标签计算得到所述自回归解码输出的交叉熵损失函数和所述非自回归解码输出的交叉熵损失函数;基于所述自回归解码输出的交叉熵损失函数和所述非自回归解码输出的交叉熵损失函数的误差,计算所述自回归解码输出与所述非自回归解码输出的一致性。

9.第三方面,本发明实施例提供一种电子设备,其包括:至少一个处理器,以及与所述至少一个处理器通信连接的存储器,其中,所述存储器存储有可被所述至少一个处理器执行的指令,所述指令被所述至少一个处理器执行,以使所述至少一个处理器能够执行本

发明上述任一项机器翻译和机器翻译训练方法。

10.第四方面,本发明实施例提供一种存储介质,所述存储介质中存储有一个或多个包括执行指令的程序,所述执行指令能够被电子设备(包括但不限于计算机,服务器,或者网络设备等)读取并执行,以用于执行本发明上述任一项机器翻译和机器翻译训练方法。

11.第五方面,本发明实施例还提供一种计算机程序产品,所述计算机程序产品包括存储在存储介质上的计算机程序,所述计算机程序包括程序指令,当所述程序指令被计算机执行时,使所述计算机执行上述任一项机器翻译和机器翻译训练方法。

12.本技术的方法通过使用一个共享参数的解码器,分别进行自回归解码与非自回归解码,由于自回归与非自回归解码器各有优势,其中自回归更符合语言模型建模,非自回归包含上下文信息,因此通过让自回归解码和非自回归解码的输出尽量的一致来让他们相互学习。从而可以确定迭代次数,改变解码长度,有效的提升目标语言文本的生成质量并增强鲁棒性。

附图说明

13.为了更清楚地说明本发明实施例的技术方案,下面将对实施例描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

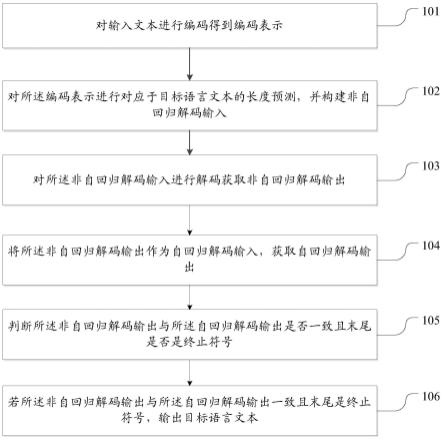

14.图1为本发明一实施例提供的一种机器翻译方法的流程图;

15.图2为本发明一实施例提供的另一种机器翻译方法的流程图;

16.图3为本发明一实施例提供的一种机器翻译训练方法的流程图;

17.图4为本发明一实施例提供的另一种机器翻译训练方法的流程图;

18.图5为本发明一实施例提供的机器翻译和机器翻译训练方法的一个具体示例的机器翻译和机器翻译训练流程图;

19.图6是本发明一实施例提供的电子设备的结构示意图。

具体实施方式

20.为使本发明实施例的目的、技术方案和优点更加清楚,下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有作出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

21.请参考图1,其示出了本发明一实施例提供的一种机器翻译方法的流程图。

22.如图1所示,在步骤101中,对输入文本进行编码得到编码表示;

23.在步骤102中,对所述编码表示进行对应于目标语言文本的长度预测,并构建非自回归解码输入;

24.在步骤103中,对所述非自回归解码输入进行解码获取非自回归解码输出;

25.在步骤104中,将所述非自回归解码输出作为自回归解码输入,获取自回归解码输出;

26.在步骤105中,判断所述非自回归解码输出与所述自回归解码输出是否一致且末尾是否是终止符号;

27.在步骤106中,若所述非自回归解码输出与所述自回归解码输出一致且末尾是终止符号,输出目标语言文本。

28.在本实施例中,对于步骤101,机器翻译装置对输入文本进行编码得到编码表示例如,对获取到的输入文本进行对应的预处理,加入起始符号和终止符号和/或分词等,之后,可以使用lstm(长短期记忆网络,long short-term memory)、gru(门控循环单元,gated recurrent unit)或transformer作为编码器,对预处理后的源语言文本进行编码得到编码表示,其中,lstm是一种时间循环神经网络,是为了解决一般的rnn(循环神经网络)存在的长期依赖问题而专门设计出来的,所有的rnn都具有一种重复神经网络模块的链式形式。在标准rnn中,这个重复的结构模块只有一个非常简单的结构,例如一个tanh层。

29.对于步骤102,机器翻译装置对编码表示进行对应于目标语言文本的长度预测,并构建非自回归解码输入,例如,基于输入文本的编码表示预测目标语言文本长度的概率分布,然后对语言文本中的每一个词预测在目标语言文本中的位置和对应的单词,最后根据目标语言文本长度的概率分布和语言文本中的每一个词在目标语言文本中的位置和对应的单词构建非自归解码输入,

30.对于步骤103,机器翻译装置对非自回归解码输入进行解码获取非自回归解码输出,其中,非自回归可以让每个单词之间没有依赖关系,能够使整个输出序列的每个单词被并行地同步预测。

31.对于步骤104,机器翻译装置将非自回归解码输出作为自回归解码输入,然后对自回归解码输入进行解码获取自回归解码输出,例如,使用一个共享参数的解码器,分别进行自回归解码与非自回归解码,由于自回归与非自回归解码器各有优势,其中,自回归更符合语言模型建模,而非自回归包含上下文信息。

32.对于步骤105,判断非自回归解码输出与自回归解码输出是否一致且末尾是否是终止符号,由于自回归与非自回归解码器各有优势,可以通过让自回归解码和非自回归解码的输出尽量的一致来让他们相互学习。

33.对于步骤106,若非自回归解码输出与自回归解码输出一致且末尾是终止符号,输出与输入文本对应的目标语言文本,一具体机器翻译情况如下:

34.非自回归解码输出=fill out the form with words describing the.《/s》

35.自回归解码输出=fill out the form with words describing the.《/s》

36.可以看出非自回归解码输出与自回归解码输出一致且末尾为终止符号,输出fill out the form with words describing the。其中,《/s》为终止符号。

37.本实施例的方法通过使用一个共享参数的解码器,分别进行自回归解码与非自回归解码,从而可以确定迭代次数,改变解码长度,有效的提升目标语言文本的生成质量并增强鲁棒性。

38.在上述实施例的方法中,在所述判断所述非自回归解码输出与所述自回归解码输出是否一致且末尾是否是终止符号之后,还包括:

39.若非自回归解码输出与自回归解码输出不一致,基于非自回归解码输出与自回归解码输出中最大重合部分重新构建非自回归解码输入,一具体机器翻译情况如下:

40.非自回归解码输出=fill out the form with a word describing the human matter.

41.自回归解码输出=fill out the form with words describing the person.《/s》

42.根据最大重合部分“fill out the form with”,重构非自回归解码输入=fill out the form with words《mask》《mask》《mask》《mask》《mask》《mask》。

43.本实施例的方法通过基于非自回归解码输出与自回归解码输出中最大重合部分重新构建非自回归解码输入,从而可以确定迭代次数,改变解码长度,有效的提升目标语言文本的生成质量并增强鲁棒性。

44.在一些可选的实施例中,在所述判断所述非自回归解码输出与所述自回归解码输出是否一致且末尾是否是终止符号之后,还包括:

45.若非自回归解码输出和/或自回归解码输出的末尾不是终止符号,在非自回归解码输出末尾增加pad符号并重新构建非自回归解码输入,其中,pad符号可以认为是一个空的占位符。一具体机器翻译情况如下:

46.非自回归解码输出=fill out the form with words describing the。

47.自回归解码输出=fill out the form with words describing the。

48.这种情况下末尾不为不是终止符号,在非自回归解码输出增加《pad》符号=fill out the form with words describing the《mask》。

49.本实施例的方法通过在非自回归解码输出末尾增加pad符号并重新构建非自回归解码输入,从而可以确定迭代次数,改变解码长度,有效的提升目标语言文本的生成质量并增强鲁棒性。

50.进一步请参考图2,其示出了本发明一实施例提供的另一种机器翻译方法,该流程图主要是对流程图1“对所述编码表示进行对应于目标语言文本的长度预测”的流程进一步限定的步骤的流程图。

51.如图2所示,在步骤201中,对所述编码表示进行对应于目标语言文本的长度预测;

52.在步骤202中,基于长度预测的结果预测所述输入文本中的每一个词在所述目标语言文本中的预测位置;

53.在步骤203中,对所述编码表示进行对应于所述目标语言文本的词级翻译得到所述输入文本中的每一个词对应的目标语言文本的预测单词;

54.在步骤204中,确定所述输入文本中的每一个词在所述目标语言文本中预测位置和预测单词。

55.在本实施例中,对于步骤201,机器翻译装置对输入文本的编码表示进行对应于目标语言文本的长度预测;然后,对于步骤202,机器翻译装置基于长度预测的结果预测输入文本中的每一个词在目标语言文本中的预测位置;之后,对于步骤203,机器翻译装置对所述编码表示进行对应于所述目标语言文本的词级翻译得到所述输入文本中的每一个词对应的目标语言文本的预测单词;最后,对于步骤204,机器翻译装置确定输入文本中的每一个词在所述目标语言文本中预测位置和预测单词,使用起始符号《s》对应的编码表示h0,预测目标端文本长度的概率分布p

len

=softmax(mlp

len

(h0)),其中mlp

len

代表多层感知机,是长度预测器的参数,softmax为归一化指数函数。取p

len

中概率最高者,记为argmax(p

len

),其对应概率为max(p

len

)。在一具体机器翻译方法中,以“中国的首都是北京。”翻译为英文为例,预处理和分词后变为“起始符号,中国,的,首都,是,北京,。,终止符号”,起始符号为0,

对应的终止符号就是8,那么对应于目标语言文本的预测长度就为8,中国一词翻译成英文的位置预测在第四个位置是0.83,首都一词翻译成capital的概率是0.96。

56.本实施例的方法通过对输入文本的编码表示进行对应于目标语言文本的长度预测以及词级翻译,从而可以确定源语言文本中的每一个词在目标语言文本中预测位置和预测单词,大大减小了解码时的搜索空间,提升了生成结果的质量。

57.请参考图3,其示出了本发明一实施例提供的一种机器翻译训练方法的流程图。

58.如图3所示,在步骤301中,获取与解码器输入对应的自回归解码输出与非自回归解码输出;

59.在步骤302中,基于所述自回归解码输出的后验概率和真实标签,以及所述非自回归解码输出的后验概率和真实标签,计算得到所述自回归解码输出的交叉熵损失函数和所述非自回归解码输出的交叉熵损失函数;

60.在步骤303中,基于所述自回归解码输出的交叉熵损失函数和所述非自回归解码输出的交叉熵损失函数的误差,计算所述自回归解码输出与所述非自回归解码输出的一致性。

61.在本实施例中,对步骤301,机器翻译训练装置获取与解码器输入对应的自回归解码输出与非自回归解码输出,其中,可以使用transformer作为解码器,分别基于自回归与非自回归方式生成目标语言文本,例如,解码器decoder对解码器输入z和编码器编码后的源语言文本表示h进行解码,获取目标语言文本输出y={y0,y1,...,ym},其中,yi=argmax(softmax(decoder(z,h))),其中,softmax为归一化指数函数。取p

len

中概率最高者,记为argmax(p

len

),其对应概率为max(p

len

)。

62.然后,对于步骤302,机器翻译训练装置基于自回归解码输出的后验概率和真实标签,以及非自回归解码输出的后验概率和真实标签,计算得到自回归解码输出的交叉熵损失函数和非自回归解码输出的交叉熵损失函数,其中,交叉熵代价函数(cross-entropy cost function)是用来衡量人工神经网络的预测值与实际值的一种方式。与二次代价函数相比,它能更有效地促进人工神经网络的训练。

63.最后,对于步骤303,机器翻译训练装置基于自回归解码输出的交叉熵损失函数和非自回归解码输出的交叉熵损失函数的误差,计算自回归解码输出与非自回归解码输出的一致性,例如,自回归与非自回归的后验概率与真实标签计算交叉熵损失lossauto与lossnon-auto。同时,利用均方误差计算自回归与非自回归的一致性损失lossconsistency。最终的损失函数为:

64.loss=loss

auto

+loss

non-auto

+αloss

consistency

65.其中α为一致性损失loss

consistency

的权重。

66.本实施例的方法通过自回归解码输出的交叉熵损失、非自回归解码输出的交叉熵损失和自回归-非自回归一致性交叉熵损失,从而可以让自回归解码和非自回归解码的输出尽量的一致来让他们相互学习。

67.进一步请参考图4,其示出了本发明一实施例提供的另一种机器翻译和机器翻译训练方法,该流程图主要是对流程图3“获取与解码器输入对应的自回归解码输出与非自回归解码输出”之前的流程进一步限定的步骤的流程图。

68.如图4所示,在步骤401中,对源语言文本进行编码得到编码表示;

69.在步骤402中,对所述编码表示进行对应于目标语言文本的长度预测,以及对所述编码表示进行对应于所述目标语言文本的词级翻译;

70.在步骤403中,至少基于长度预测的结果和词级翻译的结果构建解码器输入。

71.在本实施例中,对于步骤401,机器翻译训练装置对源语言文本进行编码得到编码表示,例如,对获取到的源语言文本进行对应的预处理,加入起始符号和终止符号和/或分词等,之后,可以使用lstm、gru或transformer作为编码器,对预处理后的源语言文本进行编码得到编码表示。

72.然后,对于步骤402,机器翻译训练装置对编码表示进行对应于目标语言文本的长度预测,以及对编码表示进行对应于所述目标语言文本的词级翻译,例如,使用起始符号对应的编码表示预测目标语言文本长度的概率分布,之后对语言文本中的每一个词预测在目标语言文本中的位置和对应的单词。

73.最后,对于步骤403,机器翻译训练装置至少基于长度预测的结果和词级翻译的结果构建解码器输入,例如,例如,可以使用lstm、gru或transformer作为解码器,基于长度预测的结果和词级翻译的结果构建解码器输入,之后分别基于自回归与非自回归方式生成目标语言文本。

74.本实施例的方法通过对源语言文本进行编码得到编码表示,之后对编码表示进行对应于目标语言文本的长度预测以及词级翻译,来构建解码器输入,从而可以大大减小了解码时的搜索空间,提升了生成结果的质量。

75.在一些可选的实施例中,在所述对源语言文本进行编码得到编码表示之前,还包括:

76.机器翻译训练装置获取源语言文本,对源语言文本进行预处理,其中,预处理包括在源语言文本首部加入起始符号,在源语言文本尾部加入终止符号,进一步地,若源语言文本为中文时进行分词。

77.在上述任一实施例中,使用的编码器和解码器包括lstm、gru或transformer。

78.请参考图5,其示出了本发明一实施例提供的机器翻译和机器翻译训练方法的一个具体示例的机器翻译和机器翻译训练流程图。

79.如图5所示,训练阶段:

80.步骤1:获取源语言文本,并进行对应的预处理,加入起始符号《s》和终止符号《/s》等。中文需进行分词等。例如:中国的首都是北京。

‑‑

》《s》中国的首都是北京。《/s》。

81.步骤2:编码器,可以使用lstm、gru或transformer作为编码器encoder,对输入文本进行编码。

82.步骤3:长度预测以及词级翻译。

83.步骤4:解码器解码分别基于自回归与非自回归方式生成目标语言文本。

84.步骤5:由步骤4得到自回归与非自回归的后验概率与真实标签计算交叉熵损。

85.预测阶段:

86.步骤1:编码器对输入文本进行编码。

87.步骤2:预测解码长度l,构建非回归解码输入。

88.步骤3:解码器进行非自回归解码得到非自回归输出。

89.步骤4:将非自回归输出作为自回归解码输入,得到自回归输出。

90.步骤5:如果非自回归输出和自回归输出一致且末尾为《\s》,输出解码结果否则重构非回归解码输入非自回归输入,重复步骤3至步骤5:

91.不一致:根据从左到右两者最大重合部分重构非回归解码输入。

92.自回归输出的末尾不为《\s》:在非回归解码输出末尾增加《pad》。《pad》可以认为是一个空的占位符。

93.与普通非自回归翻译模型的效果对比,本技术提出方法的翻译结果更流畅,质量更高,一具体示例如下:

94.示例1:用描述人物的单词填写表格。

95.普通非自回归:fill out the form with a word describing the human matter.

96.本发明:fill out the form with words describing the person.

97.示例2:听一听并勾出托尼和贝蒂喜欢的音乐类型。

98.普通非自回归:listen to and sok out tony and betty'favorite types of music.

99.本发明:listen and tick off the types of music tony and betty like.

100.示例3:你们一路上将会犯错,但是从你们的错误中学习并且决不放弃是关键。

101.普通非自回归:you will make a mistake on the way,but learning from your mistakes never give up is key.

102.本发明:you will make mistakes along the way,but learning from your mistakes and never giving up is the key.

103.与普通自回归翻译模型的效果对比,本技术提出方法的翻译速度更快,一具体示例如下:

104.在2000条平均长度为15个汉字的中英测试集上:

105.自回归:avg=0.725s,max=5.112s,min=0.215s

106.半自回归(本技术):avg=0.318s,max=0.822s,min=0.11s

107.在另一些实施例中,本发明实施例还提供了一种非易失性计算机存储介质,计算机存储介质存储有计算机可执行指令,该计算机可执行指令可执行上述任意方法实施例中的机器翻译和机器翻译训练方法;

108.作为一种实施方式,本发明的非易失性计算机存储介质存储有计算机可执行指令,计算机可执行指令设置为:

109.对输入文本进行编码得到编码表示;

110.对所述编码表示进行对应于目标语言文本的长度预测,并构建非自回归解码输入;

111.对所述非自回归解码输入进行解码获取非自回归解码输出;

112.将所述非自回归解码输出作为自回归解码输入,获取自回归解码输出;

113.判断所述非自回归解码输出与所述自回归解码输出是否一致且末尾是否是终止符号;

114.若所述非自回归解码输出与所述自回归解码输出一致且末尾是终止符号,输出目标语言文本。

115.作为另一种实施方式,本发明的非易失性计算机存储介质存储有计算机可执行指令,计算机可执行指令设置为:

116.获取与解码器输入对应的自回归解码输出与非自回归解码输出;

117.基于所述自回归解码输出的后验概率和真实标签,以及所述非自回归解码输出的后验概率和真实标签,计算得到所述自回归解码输出的交叉熵损失函数和所述非自回归解码输出的交叉熵损失函数;

118.基于所述自回归解码输出的交叉熵损失函数和所述非自回归解码输出的交叉熵损失函数的误差,计算所述自回归解码输出与所述非自回归解码输出的一致性。

119.非易失性计算机可读存储介质可以包括存储程序区和存储数据区,其中,存储程序区可存储操作系统、至少一个功能所需要的应用程序;存储数据区可存储根据机器翻译和机器翻译训练装置的使用所创建的数据等。此外,非易失性计算机可读存储介质可以包括高速随机存取存储器,还可以包括非易失性存储器,例如至少一个磁盘存储器件、闪存器件、或其他非易失性固态存储器件。在一些实施例中,非易失性计算机可读存储介质可选包括相对于处理器远程设置的存储器,这些远程存储器可以通过网络连接至机器翻译和机器翻译训练装置。上述网络的实例包括但不限于互联网、企业内部网、局域网、移动通信网及其组合。

120.本发明实施例还提供一种计算机程序产品,计算机程序产品包括存储在非易失性计算机可读存储介质上的计算机程序,计算机程序包括程序指令,当程序指令被计算机执行时,使计算机执行上述任一项机器翻译和机器翻译训练方法。

121.图6是本发明实施例提供的电子设备的结构示意图,如图6所示,该设备包括:一个或多个处理器610以及存储器620,图6中以一个处理器610为例。机器翻译和机器翻译训练方法的设备还可以包括:输入装置630和输出装置640。处理器610、存储器620、输入装置630和输出装置640可以通过总线或者其他方式连接,图6中以通过总线连接为例。存储器620为上述的非易失性计算机可读存储介质。处理器610通过运行存储在存储器620中的非易失性软件程序、指令以及模块,从而执行服务器的各种功能应用以及数据处理,即实现上述方法实施例机器翻译和机器翻译训练方法。输入装置630可接收输入的数字或字符信息,以及产生与实施例机器翻译和机器翻译训练装置的用户设置以及功能控制有关的键信号输入。输出装置640可包括显示屏等显示设备。

122.上述产品可执行本发明实施例所提供的方法,具备执行方法相应的功能模块和有益效果。未在本实施例中详尽描述的技术细节,可参见本发明实施例所提供的方法。

123.作为一种实施方式,上述电子设备应用于机器翻译和机器翻译训练装置中,包括:至少一个处理器;以及,与至少一个处理器通信连接的存储器;其中,存储器存储有可被至少一个处理器执行的指令,指令被至少一个处理器执行,以使至少一个处理器能够:

124.对输入文本进行编码得到编码表示;

125.对所述编码表示进行对应于目标语言文本的长度预测,并构建非自回归解码输入;

126.对所述非自回归解码输入进行解码获取非自回归解码输出;

127.将所述非自回归解码输出作为自回归解码输入,获取自回归解码输出;

128.判断所述非自回归解码输出与所述自回归解码输出是否一致且末尾是否是终止

符号;

129.若所述非自回归解码输出与所述自回归解码输出一致且末尾是终止符号,输出目标语言文本。

130.作为另一种实施方式,上述电子设备应用于机器翻译和机器翻译训练装置中,包括:至少一个处理器;以及,与至少一个处理器通信连接的存储器;其中,存储器存储有可被至少一个处理器执行的指令,指令被至少一个处理器执行,以使至少一个处理器能够:

131.获取与解码器输入对应的自回归解码输出与非自回归解码输出;

132.基于所述自回归解码输出的后验概率和真实标签,以及所述非自回归解码输出的后验概率和真实标签,计算得到所述自回归解码输出的交叉熵损失函数和所述非自回归解码输出的交叉熵损失函数;

133.基于所述自回归解码输出的交叉熵损失函数和所述非自回归解码输出的交叉熵损失函数的误差,计算所述自回归解码输出与所述非自回归解码输出的一致性。

134.本技术实施例的电子设备以多种形式存在,包括但不限于:

135.(1)移动通信设备:这类设备的特点是具备移动通信功能,并且以提供话音、数据通信为主要目标。这类终端包括:智能手机(例如iphone)、多媒体手机、功能性手机,以及低端手机等。

136.(2)超移动个人计算机设备:这类设备属于个人计算机的范畴,有计算和处理功能,一般也具备移动上网特性。这类终端包括:pda、mid和umpc设备等,例如ipad。

137.(3)便携式娱乐设备:这类设备可以显示和播放多媒体内容。该类设备包括:音频、视频播放器(例如ipod),掌上游戏机,电子书,以及智能玩具和便携式车载导航设备。

138.(4)服务器:提供计算服务的设备,服务器的构成包括处理器、硬盘、内存、系统总线等,服务器和通用的计算机架构类似,但是由于需要提供高可靠的服务,因此在处理能力、稳定性、可靠性、安全性、可扩展性、可管理性等方面要求较高。

139.(5)其他具有数据交互功能的电子装置。

140.以上所描述的装置实施例仅仅是示意性的,其中作为分离部件说明的单元可以是或者也可以不是物理上分开的,作为单元显示的部件可以是或者也可以不是物理单元,即可以位于一个地方,或者也可以分布到多个网络单元上。可以根据实际的需要选择其中的部分或者全部模块来实现本实施例方案的目的。本领域普通技术人员在不付出创造性的劳动的情况下,即可以理解并实施。

141.通过以上的实施方式的描述,本领域的技术人员可以清楚地了解到各实施方式可借助软件加必需的通用硬件平台的方式来实现,当然也可以通过硬件。基于这样的理解,上述技术方案本质上或者说对现有技术做出贡献的部分可以以软件产品的形式体现出来,该计算机软件产品可以存储在计算机可读存储介质中,如rom/ram、磁碟、光盘等,包括若干指令用以使得一台计算机设备(可以是个人计算机,服务器,或者网络设备等)执行各个实施例或者实施例的某些部分的方法。

142.最后应说明的是:以上实施例仅用以说明本发明的技术方案,而非对其限制;尽管参照前述实施例对本发明进行了详细的说明,本领域的普通技术人员应当理解:其依然可以对前述各实施例所记载的技术方案进行修改,或者对其中部分技术特征进行等同替换;而这些修改或者替换,并不使相应技术方案的本质脱离本发明各实施例技术方案的精神和

范围。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1