一种文本生成领域的解码方法、装置、设备及介质与流程

本申请实施例涉及自然语言处理,尤其涉及一种文本生成领域的解码方法、装置、设备及介质。

背景技术:

1、文本生成和文本理解是自然语言处理中的两大领域。文本生成技术在智能写作、文本摘要、机器翻译等细分任务上有着重要用途。经过多年的发展,基于深度学习的神经网络模型已经成为文本生成领域的主导技术。通常而言,一个基于深度学习技术的文本生成模型由“编码器”和“解码器”组成。编码器将文本转化为表征向量,然后输入到解码器中,由后者根据训练时学到的输入样本文本与输出样本文本的语义对应映射关系,将表征向量转化为解码后的文本,即完成文本生成任务。

2、尽管神经网络模型在文本生成领域已取得了很大的进步,但对于生成任务来,解码策略的选择很重要,即使是使用目前最强大的语言模型,例如使用常见的beam search(beam search本质上也是一种贪心搜索方法,每次会选择在beam中最大概率的词汇)等方法,很容易导致生成的文本出现不连贯、文字重复等问题。而另一种常见解码思路是top-k采样:在解码的每个时间步从前k个概率最大的词中按它们出现的概率进行采样,但top-k采样中如何选择k是个挑战,k选大了可能会采样出长尾词,导致语句不连贯,而k选小了又退化成了beam search。

技术实现思路

1、以下是对本文详细描述的主题的概述。本概述并非是为了限制权利要求的保护范围。

2、本公开实施例的主要目的在于提出一种文本生成领域的解码方法、装置、设备及介质,既能确保解码后生成的文本的连贯,也能够实现较好的文本多样性。

3、为实现上述目的,本公开实施例的第一方面提出了一种文本生成领域的解码方法,所述文本生成领域的解码方法包括:

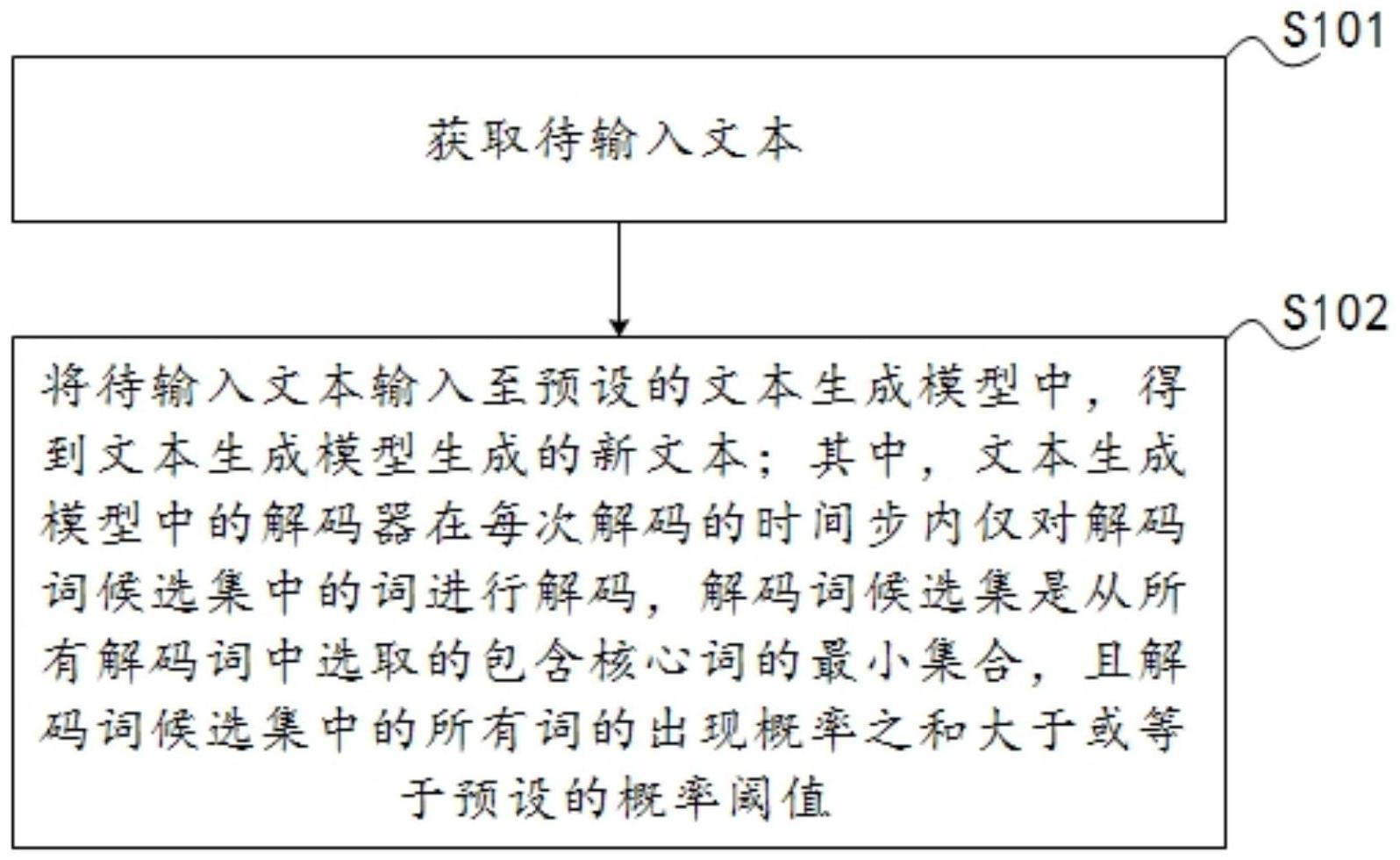

4、获取待输入文本;

5、将所述待输入文本输入至预设的文本生成模型中,得到所述文本生成模型生成的新文本;其中,所述文本生成模型中的解码器在每次解码的时间步内仅对解码词候选集中的词进行解码,所述解码词候选集是从所有解码词中选取的包含核心词的最小集合,且所述解码词候选集中的所有词的出现概率之和大于或等于预设的概率阈值。

6、在一些实施例中,所述解码器对所述解码词候选集中的词进行解码的过程包括:

7、

8、其中,v表示所有解码词的词汇表,xi∈vp,vp表示所述解码词候选集,ul表示所述解码器在最后一层之前的输出向量,t表示超参数,t的取值范围为[0,1)。

9、在一些实施例中,所述概率阈值与所述解码词候选集中的所有词的出现概率之和的数量关系包括:

10、pc=p+δp

11、其中,pc表示所述解码词候选集中的所有词的出现概率之和,p表示所述概率阈值,δp表示所述解码器每次从行动集合中选取的值,所述行动集合包括:δp的取值为(1-p)/k,k为[0,m]之间的一个整数,m为预先设定。

12、在一些实施例中,通过dqn对所述解码器每次从所述行动集合中选取δp进行优化,所述dqn的目标函数包括:

13、

14、其中,jq(θ)表示目标函数,r(s,a)表示奖励函数,s表示状态,a表示选取δp的动作,γ表示衰减系数,a表示所述行动集合,qθ(s,a)表示目标q网络,θ表示所述目标q网络的参数,qθ-(s′,a′)表示与所述目标q网络网络结构相同的辅助网络,θ-表示所述辅助网络的参数,所述辅助网络的参数来源于所述目标q网络的参数的赋值,所述辅助网络和所述目标q网络的输入向量为所述解码器在最后一层之前的输出向量。

15、在一些实施例中,所述dqn采用贪心策略对所述解码器每次从所述行动集合中选取δp进行优化。

16、在一些实施例中,所述目标q网络通过如下方式得到输出向量:

17、o1=relu(w1*v+b1)

18、o2=relu(w2*o1+b2)

19、o3=softmax(o2)

20、其中,w1为第一隐藏层权重矩阵,b1为第一偏置量,v表示所述解码器在最后一层之前的输出向量,w2为第二隐藏层权重矩阵,b2为第二偏置量,relu表示激活函数。

21、在一些实施例中,所述文本生成领域的解码方法还包括:

22、采用adam梯度下降方法对所述目标q网络和所述辅助网络进行参数的优化。

23、为实现上述目的,本公开实施例的第二方面提出了一种文本生成领域的解码装置,所述文本生成领域的解码装置包括:

24、文本获取单元,用于获取待输入文本;

25、文本生成单元,用于将所述待输入文本输入至预设的文本生成模型中,得到所述文本生成模型生成的新文本;其中,所述文本生成模型中的解码器在每次解码的时间步内仅对解码词候选集中的词进行解码,所述解码词候选集是从所有解码词中选取的包含核心词的最小集合,且所述解码词候选集中的所有词的出现概率之和大于或等于预设的概率阈值。

26、为实现上述目的,本公开实施例的第三方面提出了一种电子设备,包括至少一个存储器;

27、至少一个处理器;

28、至少一个计算机程序;

29、所述计算机程序被存储在所述存储器中,处理器执行所述至少一个计算机程序以实现:

30、如第一方面实施例任一项所述的文本生成领域的解码方法。

31、为实现上述目的,本公开实施例的第四方面还提出一种计算机可读存储介质,所述计算机可读存储介质存储有计算机可执行指令,所述计算机可执行指令用于使计算机执行:

32、如第一方面实施例任一项所述的文本生成领域的解码方法。

33、本申请实施例第一方面提供了一种文本生成领域的解码方法,不同于top-k通过固定窗口采样,本方法在解码器每个解码的时间步内,不再是选取固定长度的词作为解码时的候选集合,而是选择那些出现概率超过概率阈值的词作为候选集合,候选集合内包含着核心词,确保解码词还是从头部候选词中进行筛选,而且随着每次时间步的解码词的概率分布不同,概率阈值也可进行动态调整,候选词集合的大小会动态变化,这样不仅能够保证解码后生成的文本的连贯,也能够实现较好的文本多样性。

34、可以理解的是,上述第二方面至第四方面与相关技术相比存在的有益效果与上述第一方面与相关技术相比存在的有益效果相同,可以参见上述第一方面中的相关描述,在此不再赘述。

技术特征:

1.一种文本生成领域的解码方法,其特征在于,所述文本生成领域的解码方法包括:

2.根据权利要求1所述的文本生成领域的解码方法,其特征在于,所述解码器对所述解码词候选集中的词进行解码的过程包括:

3.根据权利要求1所述的文本生成领域的解码方法,其特征在于,所述概率阈值与所述解码词候选集中的所有词的出现概率之和的数量关系包括:

4.根据权利要求3所述的文本生成领域的解码方法,其特征在于,通过dqn对所述解码器每次从所述行动集合中选取δp进行优化,所述dqn的目标函数包括:

5.根据权利要求4所述的文本生成领域的解码方法,其特征在于,所述dqn采用贪心策略对所述解码器每次从所述行动集合中选取δp进行优化。

6.根据权利要求4所述的文本生成领域的解码方法,其特征在于,所述目标q网络通过如下方式得到输出向量:

7.根据权利要求6所述的文本生成领域的解码方法,其特征在于,所述文本生成领域的解码方法还包括:

8.一种文本生成领域的解码装置,其特征在于,所述文本生成领域的解码装置包括:

9.一种电子设备,其特征在于,包括:

10.一种计算机可读存储介质,其特征在于,所述计算机可读存储介质存储有计算机可执行指令,所述计算机可执行指令用于使计算机执行:

技术总结

本申请实施例涉及自然语言处理技术领域,特别涉及一种文本生成领域的解码方法、装置、设备及介质,不同于top‑k通过固定窗口采样,本方法在解码器每个解码的时间步内,不再是选取固定长度的词作为解码时的候选集合,而是选择那些出现概率超过概率阈值的词作为候选集合,候选集合内包含着核心词,确保解码词还是从头部候选词中进行筛选,而且随着每次时间步的解码词的概率分布不同,概率阈值也可进行动态调整,候选词集合的大小会动态变化,这样不仅能够保证解码后生成的文本的连贯,也能够实现较好的文本多样性。

技术研发人员:王伟,张黔,陈焕坤,曾志贤,钟焰涛

受保护的技术使用者:华润数字科技有限公司

技术研发日:

技术公布日:2024/1/13

- 还没有人留言评论。精彩留言会获得点赞!