基于CIFAR数据集的深度神经网络模型压缩方法及压缩装置与流程

本发明涉及人工智能领域,尤其是一种基于cifar数据集的深度神经网络模型压缩方法及压缩装置。

背景技术:

1、近几年,深度学习受到极大关注,在图像处理、自然语言处理、语音处理等方面都取得了成功应用,已经成为机器学习中的热点领域,在计算机视觉、语音识别、自然语言处理、自动驾驶等领域获得广泛应用,并且在移动端与嵌入式系统的边缘设备上有巨大的应用前景。深度学习之所以会取得成功,一方面是因为模型具有更深层数和更多参数,这使得模型具有更强大的非线性拟合能力;另一方面是因为硬件设备不断更新为深度学习模型快速训练提供了可能。但深度卷积神经网络由于计算量大,难以在资源受限的设备上部署。信道剪枝是一种减少计算量、加速网络推理的有效方法。大多数通道剪枝方法都是从稀疏网络的单个结构(卷积层或批处理归一化层)中统计数据来评估通道的重要性。这些方法的局限性在于,它经常会错误地删除重要的通道。

2、cifar数据集cifar数据集是物体的分类数据集,包含两个不同的数据子集,分别是cifar10和cifar100,这两个数据集均有60000张32x32大小的图像,其中每个数据集被分成训练集和测试集两类,训练集有50000张图像,测试集有10000张图像。对于cifar10数据集来说,这些图像被分成不同的10类,cifar100数据集则是将这些图像分成不同的100类。

3、cifar10是一个用于识别普适物体的小型数据集。一共包含10个类别的rgb彩色图片:飞机(airlane)、汽车(automobile)、鸟类(bird)、猫(cat)、鹿(deer)、狗(dog)、蛙类(frog)、马(horse)、船(ship)和卡车(truck)。cifar100为cifar10中的10个大类的10个小类,即每个大类下有10个小类,类别之间的交集为空。

技术实现思路

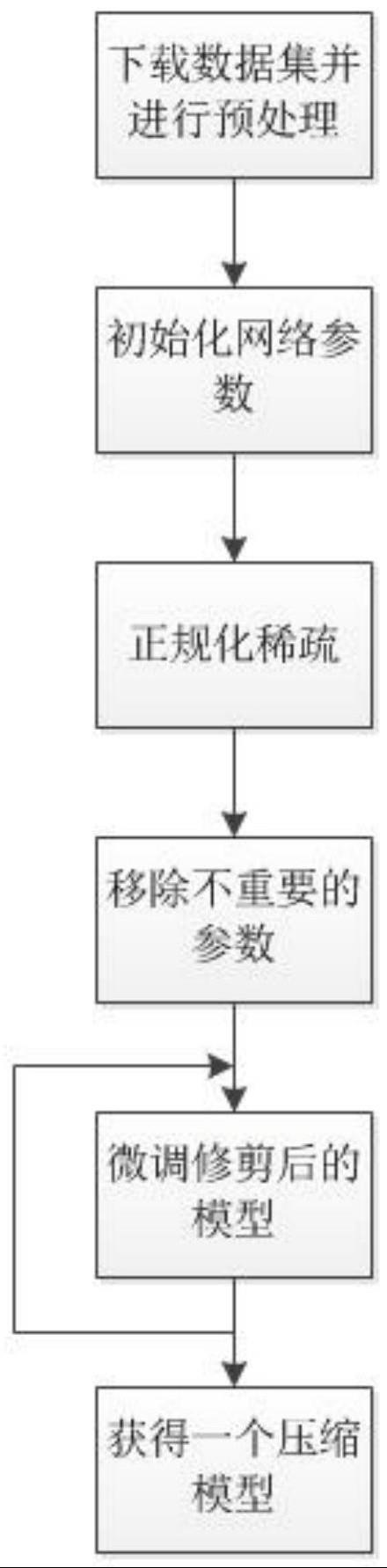

1、本发明针对上述问题,提出了一种基于cifar数据集的深度神经网络模型压缩方法及压缩装置,该方法首先分别对卷积层权值和bn层比例因子进行正则化处理。然后结合卷积层的权值和bn层的比例因子来评估信道的重要性。最后,它可以在不降低模型性能的情况下删除不重要的通道。

2、本发明提供如下技术方案:一种基于cifar数据集的深度神经网络模型压缩方法,包括如下步骤:

3、步骤1、下载cifar数据集,并对数据集进行预处理;

4、步骤2、在cifar数据集上初始化训练深度神经网络,给神经网络训练出来最好的卷积核权值;

5、步骤3、用正则化稀疏神经网络的参数;

6、步骤4、将部分卷积核参数移除,以便能够压缩神经网络,减少模型的参数;

7、步骤5、训练微调被稀疏修剪得神经网络,并且继续不断得修剪不重要得卷积核正则化参数,最终获得了一个被压缩得深度神经网络。

8、对数据集预处理时:首先将三维图像转换为灰度值的二维灰度图像,然后将二维灰度图像进行归一化处理。为后续处理提供便捷。

9、对神经网络模型的卷积层的卷积核进行前向运算和反向传播的训练和更新,就得到卷积核的权值,将得到的权值做为初始权值。

10、将得到的初始权值通过非线性激励函数实现函数值归一化,然后利用梯度下降算法求最小值得到权重的误差系数,利用误差系数和权值不断求和更新权值,获得最终卷积核权值。

11、进行正规化稀疏时,需要添加惩罚因子,

12、l′=l+λr(x)

13、其中l′是添加惩罚因子的损失函数,l是原损失函数,λr(x)为添加的惩罚因子,λ是正则化稀疏,r(·)是正则化范数,x表示卷积核的权值或bn层的缩放因子α,对于卷积核w={w1,w2,......,wm},m为卷积核w中权重参数w的数目;缩放因子α,r(α)=|α|。

14、稀疏正则化处理:

15、g′x=gx+λsign(x)

16、其中,g′x是稀疏化处理后梯度,λ是正则化系数,sign(·)是符号函数,对梯度g x对应的权重x的符号进行判断,在x<0,x=0,x>0时分别取-1,0,1。

17、将部分卷积核参数移除时,将低于设定阈值的卷积核权值移除。

18、步骤5中,使用贪婪算法在全局层次上迭代地修剪所有通道。深度神经网络的大量冗余通道中的特征被更彻底的挤压到了少量重要通道中,从而获得结构化稀疏的深度神经网络。在每次通道剪枝迭代中,采用全局贪婪搜索,在所有网络层中全局地搜索冗余通道,并且根据通道重要性的大小,贪婪地去除重要性最低的通道;并且在每次通道剪枝迭代中,对每层网络的最大剪枝比例做了限制,不能有超过设定比例的通道被移除。

19、一种基于cifar数据集的深度神经网络模型压缩装置,包括:数据集获取模块,用于下载cifar数据集,并对数据集进行预处理;训练模块,用于在cifar数据集上初始化训练深度神经网络,给神经网络训练出来最好的卷积核权值;选取模块,用于正则化稀疏神经网络的参数,设定阈值,将低于设定阈值的卷积核权值移除,减少模型的参数;压缩模块,用于训练微调被稀疏修剪得神经网络,并且继续不断得修剪不重要得卷积核正则化参数,获得了一个被压缩得深度神经网络。

20、通过上述描述可以看出,本方案提出了一种新的评估信道重要性的方法及压缩装置,即协同信道剪枝,它结合了卷积层权值和bn层比例因子。与以往方法不同的是,该方法考虑了卷积层和bn层之间的关系进行信道修剪。首先,我们分别对卷积层权值和bn层比例因子进行l1正则化。然后结合卷积层权重和bn层缩放因子来判断信道的重要性,而不是仅仅依靠单层的统计数据来评估信道的重要性。最后,我们可以在不降低模型性能的情况下删除不重要的通道。我们使用贪婪算法在全局层次上迭代地修剪所有通道。本发明的方法相对现有技术的有益效果:1、对数据集进行特有预处理操作;2、训练最好的神经网络参数;3、用正则化稀疏神经网络的参数;4、将不重要的模型参数移除;5、用贪心算法微调网络。

技术特征:

1.一种基于cifar数据集的深度神经网络模型压缩方法,其特征在于包括如下步骤:

2.根据权利要求1所述基于cifar数据集的深度神经网络模型压缩方法,其特征在于,

3.根据权利要求1所述基于cifar数据集的深度神经网络模型压缩方法,其特征在于,

4.根据权利要求3所述基于cifar数据集的深度神经网络模型压缩方法,其特征在于,

5.根据权利要求1或4所述基于cifar数据集的深度神经网络模型压缩方法,其特征在于,

6.根据权利要求5所述基于cifar数据集的深度神经网络模型压缩方法,其特征在于,

7.根据权利要求1或6所述基于cifar数据集的深度神经网络模型压缩方法,其特征在于,

8.根据权利要求1所述基于cifar数据集的深度神经网络模型压缩方法,其特征在于,

9.根据权利要求8所述基于cifar数据集的深度神经网络模型压缩方法,其特征在于,

10.一种基于cifar数据集的深度神经网络模型压缩装置,其特征在于包括:

技术总结

本发明涉及一种基于CIFAR数据集的深度神经网络模型压缩方法及压缩装置,包括:步骤1、下载CIFAR数据集,并对数据集进行预处理;步骤2、在CIFAR数据集上初始化训练深度神经网络,给神经网络训练出来最好的卷积核权值;步骤3、用正则化稀疏神经网络的参数;步骤4、将部分卷积核参数移除,以便能够压缩神经网络吗,减少模型的参数;步骤5、训练微调被稀疏修剪得神经网络,继续不断得修剪不重要得卷积核正则化参数,获得了一个被压缩得深度神经网络。本发明首先分别对卷积层权值和BN层比例因子进行正则化处理。然后结合卷积层的权值和BN层的比例因子来评估信道的重要性,可以在不降低模型性能的情况下删除不重要的通道。

技术研发人员:吴华,曹乃虹,王贵忠,杨继明,徐文海,王自强,徐明寿

受保护的技术使用者:宁夏青铜峡市华能雷避窑光伏发电有限公司

技术研发日:

技术公布日:2024/1/13

- 还没有人留言评论。精彩留言会获得点赞!