视频生成及模型训练方法、装置、设备、存储介质与流程

本公开涉及但不限于人工智能,尤其涉及一种视频生成及模型训练方法、装置、设备、存储介质。

背景技术:

1、语音驱动说话人合成指的是通过语音信息驱动目标人物的面部动作,以获得逼真的目标人物说话视频。随着人工智能技术的发展,语音驱动说话人合成的应用越来越广泛。但是,相关技术中,语音驱动生成的说话人视频中,人物的说话动作不够合理逼真,导致视频质量不够高。

技术实现思路

1、有鉴于此,本公开实施例至少提供一种视频生成及模型训练方法、装置、设备、存储介质,能够提高生成的视频中人物整体说话动作的合理性和逼真度,从而提升生成的视频质量。

2、本公开实施例的技术方案是这样实现的:

3、本公开实施例提供一种视频生成方法,所述方法包括:

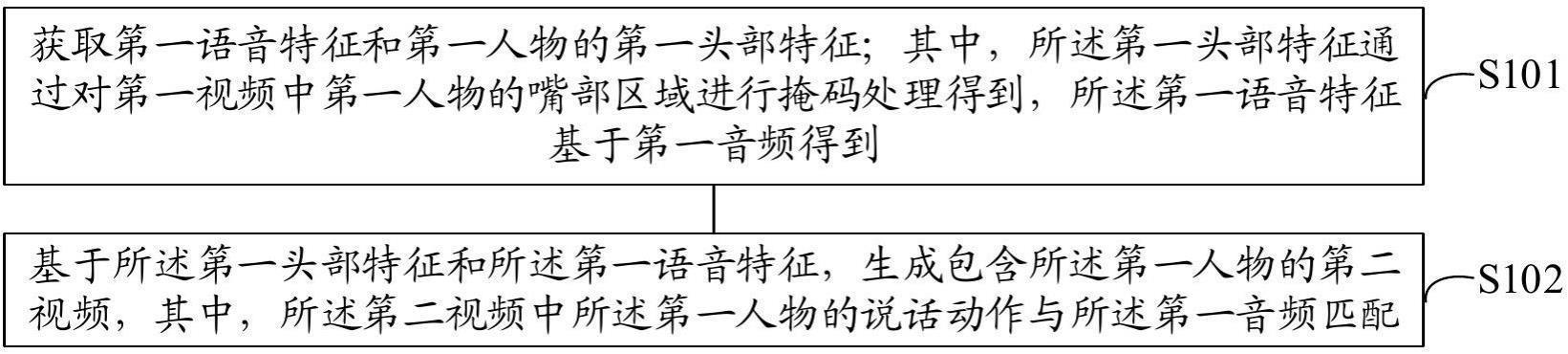

4、获取第一语音特征和第一人物的第一头部特征;其中,所述第一头部特征通过对第一视频中第一人物的嘴部区域进行掩码处理得到,所述第一语音特征基于第一音频得到;

5、基于所述第一头部特征和所述第一语音特征,生成包含所述第一人物的第二视频;所述第二视频中所述第一人物的说话动作与所述第一音频匹配。

6、本公开实施例提供一种模型训练方法,所述方法包括:

7、获取第一语音训练数据和第二人物的第一头部训练数据;其中,所述第一头部训练数据通过对训练视频中所述第二人物的嘴部区域进行掩码处理得到,所述第一语音训练数据基于训练音频得到;

8、将所述第一语音训练数据和所述第一头部训练数据输入待训练模型,得到包含所述第二人物的第五视频;

9、利用所述第五视频确定目标损失,并基于所述目标损失对所述待训练模型进行参数调节;

10、在所述第五视频中所述第二人物的说话动作与所述训练音频匹配的情况下,确定所述待训练模型训练完成。

11、本公开实施例提供一种视频生成装置,所述装置包括:

12、第一获取模块,用于获取第一语音特征和第一人物的第一头部特征;其中,所述第一头部特征通过对第一视频中第一人物的嘴部区域进行掩码处理得到,所述第一语音特征基于第一音频得到;

13、第一生成模块,用于基于所述第一头部特征和所述第一语音特征,生成包含所述第一人物的第三视频;所述第三视频中所述第一人物的说话动作与所述第一音频匹配。

14、本公开实施例提供一种模型训练装置,所述装置包括:

15、第二获取模块,用于获取第一语音训练数据和第二人物的第一头部训练数据;其中,所述第一头部训练数据通过对训练视频中所述第二人物的嘴部区域进行掩码处理得到;所述第一语音训练数据基于训练音频得到;

16、第二生成模块,用于将所述第一语音训练数据和所述第一头部训练数据输入待训练模型,得到包含所述第二人物的第五视频;

17、调节模块,用于利用所述第五视频确定目标损失,并基于所述目标损失对所述待训练模型进行参数调节;

18、第一确定模块,用于在所述第五视频中所述第二人物的说话动作与所述训练音频匹配的情况下,确定所述待训练模型训练完成。

19、本公开实施例提供一种计算机设备,包括存储器和处理器,所述存储器存储有可在处理器上运行的计算机程序,所述处理器执行所述程序时实现上述视频生成方法或模型训练方法中的部分或全部步骤。

20、本公开实施例提供一种计算机可读存储介质,其上存储有计算机程序,该计算机程序被处理器执行时实现上述视频生成方法或模型训练方法中的部分或全部步骤。

21、本公开实施例中,通过获取第一语音特征和第一人物的第一头部特征,并基于第一头部特征和第一语音特征,生成包含第一人物的第二视频,且第二视频中第一人物的说话动作与第一音频匹配。这样,由于第一头部特征是通过对第一视频中第一人物的嘴部区域进行掩码处理得到的,因此第一头部特征不受嘴部区域的影响,更加合理和准确,并且第一语音特征是基于第一音频得到的,从而基于该第一头部特征和第一语音特征生成的第二视频中,第一人物的头部外观姿态会更准确,且该头部外观姿态与第一音频会更加匹配,进而使得人物整体说话动作更加合理和逼真。如此,能够提高生成的第二视频中第一人物整体说话动作的合理性和逼真度,从而提升生成的第二视频的质量。

22、应当理解的是,以上的一般描述和后文的细节描述仅是示例性和解释性的,而非限制本公开的技术方案。

技术特征:

1.一种视频生成方法,其特征在于,所述方法包括:

2.根据权利要求1所述的方法,其特征在于,所述第一头部特征包括第一非嘴部区域特征和第一头部动作特征;

3.根据权利要求1所述的方法,其特征在于,所述基于所述第一头部特征和所述第一语音特征,生成包含所述第一人物的第二视频,包括:

4.根据权利要求3所述的方法,其特征在于,所述第一语音特征包括第一内容特征和第一情绪特征;

5.根据权利要求4所述的方法,其特征在于,所述基于所述第一融合特征和所述第一情绪特征,生成所述第二视频,包括:

6.根据权利要求1至5中任一项所述的方法,其特征在于,所述第一头部特征基于第三视频得到,所述方法还包括:

7.根据权利要求6所述的方法,其特征在于,所述方法还包括:

8.根据权利要求7所述的方法,其特征在于,所述人脸关键点包括表征上嘴唇的第一关键点、以及表征下嘴唇的第二关键点;

9.根据权利要求1至5中任一项所述的方法,其特征在于,所述基于所述第一头部特征和所述第一语音特征,生成包含所述第一人物的第二视频,包括:

10.一种模型训练方法,其特征在于,包括:

11.根据权利要求10所述的方法,其特征在于,所述待训练模型包括渲染生成网络,所述第一语音训练数据包括第二语音特征,所述第一头部训练数据包括第二头部特征;

12.根据权利要求10所述的方法,其特征在于,所述待训练模型包括渲染生成网络、以及第一特征提取网络和第二特征提取网络二者中的至少之一;

13.根据权利要求12所述的方法,其特征在于,所述待训练模型包括所述渲染生成网络和所述第一特征提取网络;

14.根据权利要求12所述的方法,其特征在于,所述第一特征提取网络包括第一编码器和映射子网络,所述第二头部特征包括第二非嘴部区域特征和第二头部动作特征;

15.根据权利要求12所述的方法,其特征在于,所述利用所述渲染生成网络,基于所述第二头部特征和所述第二语音特征,生成包含所述第二人物的第五视频,包括:

16.根据权利要求15所述的方法,其特征在于,所述待训练模型包括所述渲染生成网络和所述第二特征提取网络,所述第二特征提取网络包括第二编码器和第三编码器,所述第二语音特征包括第二内容特征和第二情绪特征;

17.根据权利要求16所述的方法,其特征在于,所述渲染生成网络包括第四编码器和第一解码器;

18.根据权利要求12至17中任一项所述的方法,其特征在于,所述模型还包括人脸检测网络;所述方法还包括:

19.根据权利要求18所述的方法,其特征在于,所述模型还包括第三特征提取网络;所述方法还包括:

20.根据权利要求10至17中任一项所述的方法,其特征在于,所述利用所述第五视频确定目标损失,包括:

21.根据权利要求20所述的方法,其特征在于,所述利用所述第五视频确定目标损失,还包括:

22.根据权利要求21所述的方法,其特征在于,所述利用所述第五视频确定目标损失,还包括:

23.根据权利要求22所述的方法,其特征在于,所述利用所述第五视频确定目标损失,还包括:

24.一种视频生成装置,其特征在于,所述装置包括:

25.一种模型训练装置,其特征在于,所述装置包括:

26.一种计算机设备,包括存储器和处理器,所述存储器存储有可在处理器上运行的计算机程序,其特征在于,所述处理器执行所述程序时实现权利要求1至9中任一项或者10至23中任一项所述方法中的步骤。

27.一种计算机可读存储介质,其上存储有计算机程序,其特征在于,该计算机程序被处理器执行时实现权利要求1至9中任一项或者10至23中任一项所述方法中的步骤。

技术总结

本公开实施例提供了一种视频生成及模型训练方法、装置、设备、存储介质,其中,所述方法包括:获取第一语音特征和第一人物的第一头部特征;其中,第一头部特征通过对第一视频中第一人物的嘴部区域进行掩码处理得到,第一语音特征基于第一音频得到;基于第一头部特征和第一语音特征,生成包含第一人物的第二视频;第二视频中第一人物的说话动作与第一音频匹配。根据本公开实施例,能够提高生成的视频中人物整体说话动作的合理性和逼真度,从而提升生成的视频质量。

技术研发人员:请求不公布姓名

受保护的技术使用者:摩尔线程智能科技(北京)有限责任公司

技术研发日:

技术公布日:2024/1/13

- 还没有人留言评论。精彩留言会获得点赞!