一种联邦学习提升方法及装置与流程

本发明涉及联邦学习领域,具体提供一种联邦学习提升方法及装置。

背景技术:

1、联邦学习是一种保护数据隐私的分布式学习方法,但其在准确率方面不如传统的集中式学习。一个可能的原因是联邦学习中各个节点之间的数据分布差异导致的,这些不同的分布就像噪声一样,干扰了梯度向最优点的收敛。

2、如何解决联邦学习中准确率不高的问题是本领域技术人员亟待解决的问题。

技术实现思路

1、本发明是针对上述现有技术的不足,提供一种实用性强的联邦学习提升方法。

2、本发明进一步的技术任务是提供一种设计合理,安全适用的联邦学习提升装置。

3、本发明解决其技术问题所采用的技术方案是:

4、一种联邦学习提升方法,具有如下步骤:

5、s1、数据收集;

6、s2、联邦学习模型和集中式学习模型的训练;

7、s3、去噪模型c的训练;

8、s4、去噪模型的应用;

9、s5、模型评估和验证。

10、进一步的,在步骤s1中,收集适用于联邦学习的大规模数据集,并同时收集与之相对应的集中式学习数据集;

11、所述数据集包含多个参与方的数据,且具有不同的数据分布。

12、进一步的,在步骤s2中,使用收集到的数据集,分别使用联邦学习和集中式学习的方式对数据进行训练。

13、进一步的,所述联邦学习模型训练使用联邦学习算法和分布式计算,在各个参与方的本地数据上训练一系列模型a(a1,a2,...,an),每个参与方使用自己的数据进行训练,并通过联邦学习算法进行模型参数的聚合,得到联邦学习模型的集合;

14、所述集中式学习模型训练使用传统的机器学习算法,使用整合所有参与方数据的集中式数据集进行训练,得到一系列模型b(b1,b2,...,bn)。

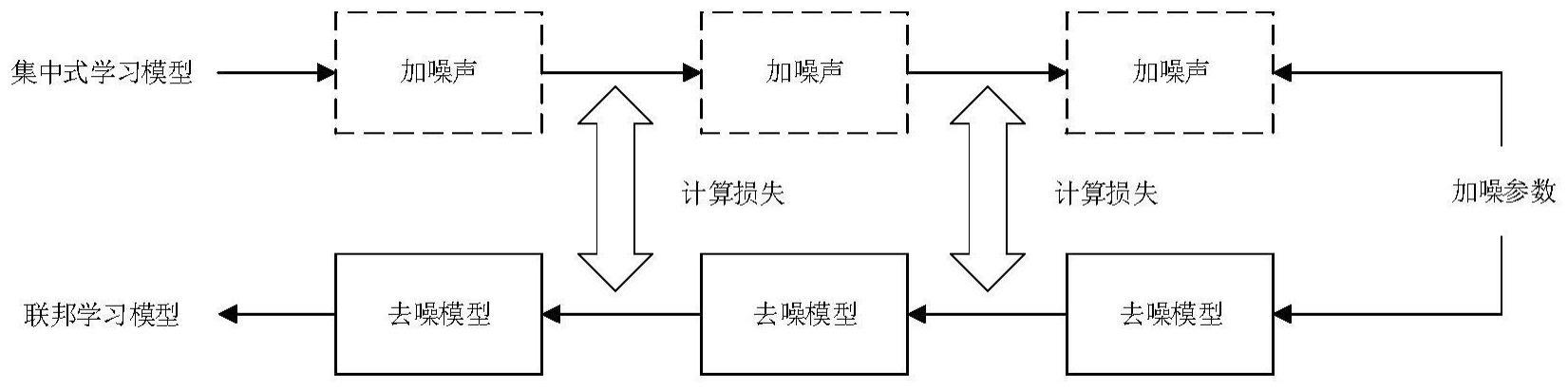

15、进一步的,在步骤s3中,将基于联邦学习的模型a作为输入,利用模型的特征和标签,训练一个去噪模型c;

16、去噪模型c为一个深度神经网络,深度神经网络的结构包括卷积层、池化层和全连接层;

17、使用反向传播算法和适当的损失函数进行训练,最小化联邦学习模型的输出与集中式学习模型的输出之间的差异。

18、进一步的,在步骤s4中,将训练好的去噪模型c应用于任意一个无法在集中式学习环境下训练的联邦学习模型;

19、对于新的联邦学习模型,将输出作为输入输入到去噪模型c中,得到经过去噪处理的输出结果,即修正后的输出结果;

20、根据需要,将去噪模型c与联邦学习模型进行集成,使在联邦学习过程中自动应用去噪处理。

21、进一步的,在步骤s5中,对去噪处理后的联邦学习模型进行评估和验证,比较准确率和性能与原始联邦学习模型的差异,使用各种指标来评估模型的性能。

22、一种联邦学习提升装置,包括:至少一个存储器和至少一个处理器;

23、所述至少一个存储器,用于存储机器可读程序;

24、所述至少一个处理器,用于调用所述机器可读程序,执行一种联邦学习提升方法。

25、本发明的一种联邦学习提升方法及装置和现有技术相比,具有以下突出的有益效果:

26、本发明解决了联邦学习中不同数据分布对模型性能的干扰问题,提高了模型准确率。基于大量数据集的训练,使得去噪模型能够充分学习数据分布特征,生成高质量的模型。可应用于任意无法在集中式学习环境下训练的联邦学习模型,具有广泛的适用性。

技术特征:

1.一种联邦学习提升方法,其特征在于,具有如下步骤:

2.根据权利要求1所述的一种联邦学习提升方法,其特征在于,在步骤s1中,收集适用于联邦学习的大规模数据集,并同时收集与之相对应的集中式学习数据集;

3.根据权利要求2所述的一种联邦学习提升方法,其特征在于,在步骤s2中,使用收集到的数据集,分别使用联邦学习和集中式学习的方式对数据进行训练。

4.根据权利要求3所述的一种联邦学习提升方法,其特征在于,所述联邦学习模型训练使用联邦学习算法和分布式计算,在各个参与方的本地数据上训练一系列模型a(a1,a2,...,an),每个参与方使用自己的数据进行训练,并通过联邦学习算法进行模型参数的聚合,得到联邦学习模型的集合;

5.根据权利要求4所述的一种联邦学习提升方法,其特征在于,在步骤s3中,将基于联邦学习的模型a作为输入,利用模型的特征和标签,训练一个去噪模型c;

6.根据权利要求5所述的一种联邦学习提升方法,其特征在于,在步骤s4中,将训练好的去噪模型c应用于任意一个无法在集中式学习环境下训练的联邦学习模型;

7.根据权利要求6所述的一种联邦学习提升方法,其特征在于,在步骤s5中,对去噪处理后的联邦学习模型进行评估和验证,比较准确率和性能与原始联邦学习模型的差异,使用各种指标来评估模型的性能。

8.一种联邦学习提升装置,其特征在于,包括:至少一个存储器和至少一个处理器;

技术总结

本发明涉及联邦学习领域,具体提供了一种联邦学习提升方法及装置,具有如下步骤:S1、数据收集;S2、联邦学习模型和集中式学习模型的训练;S3、去噪模型C的训练;S4、去噪模型的应用;S5、模型评估和验证。与现有技术相比,本发明解决了联邦学习中不同数据分布对模型性能的干扰问题,提高了模型准确率。

技术研发人员:李彬,贾荫鹏,李圣伟,孙善宝,罗清彩,李锐

受保护的技术使用者:山东浪潮科学研究院有限公司

技术研发日:

技术公布日:2024/1/15

- 还没有人留言评论。精彩留言会获得点赞!