一种基于音视频的说话人定位方法、装置、设备及介质与流程

本发明涉及人工智能,尤其涉及一种基于音视频的说话人定位方法、装置、设备及介质。

背景技术:

1、随着通信技术的发展,音视频的应用越来越广泛,在银行领域均通过音视频进行各种业务操作,如保险行业,代理人向客户销售各种保险,根据保监会的要求,必须全程录音录像,并且保证客户清晰保险合同内容,在很多环节,都需要客户读合同条款,防止代理人诱导或代替读条款,需要对音视频中的说话人进行定位,以判断是否为本人进行了合同读取,现有技术中,对音视频中说话人进行定位一般是通过声源定位的方式从多个用户中确定说话人,即通过说话人的声音来源来确定说话人的位置,进而根据说话人的位置来确定说话人。然而,在确定说话人位置时,声音来源容易受到背景噪声与房间混响的影响,降低了说话人位置确定的准确性,因此,在对音视频中说话人进行定位时,如何提高定位准确度成为亟需解决的问题。

技术实现思路

1、基于此,有必要针对上述技术问题,提供一种基于音视频的说话人定位方法、装置、设备及介质,以解决在对音视频中说话人进行定位时,定位准确度较低的问题。

2、本申请实施例的第一方面提供了一种基于音视频的说话人定位方法,所述说话人定位方法包括:

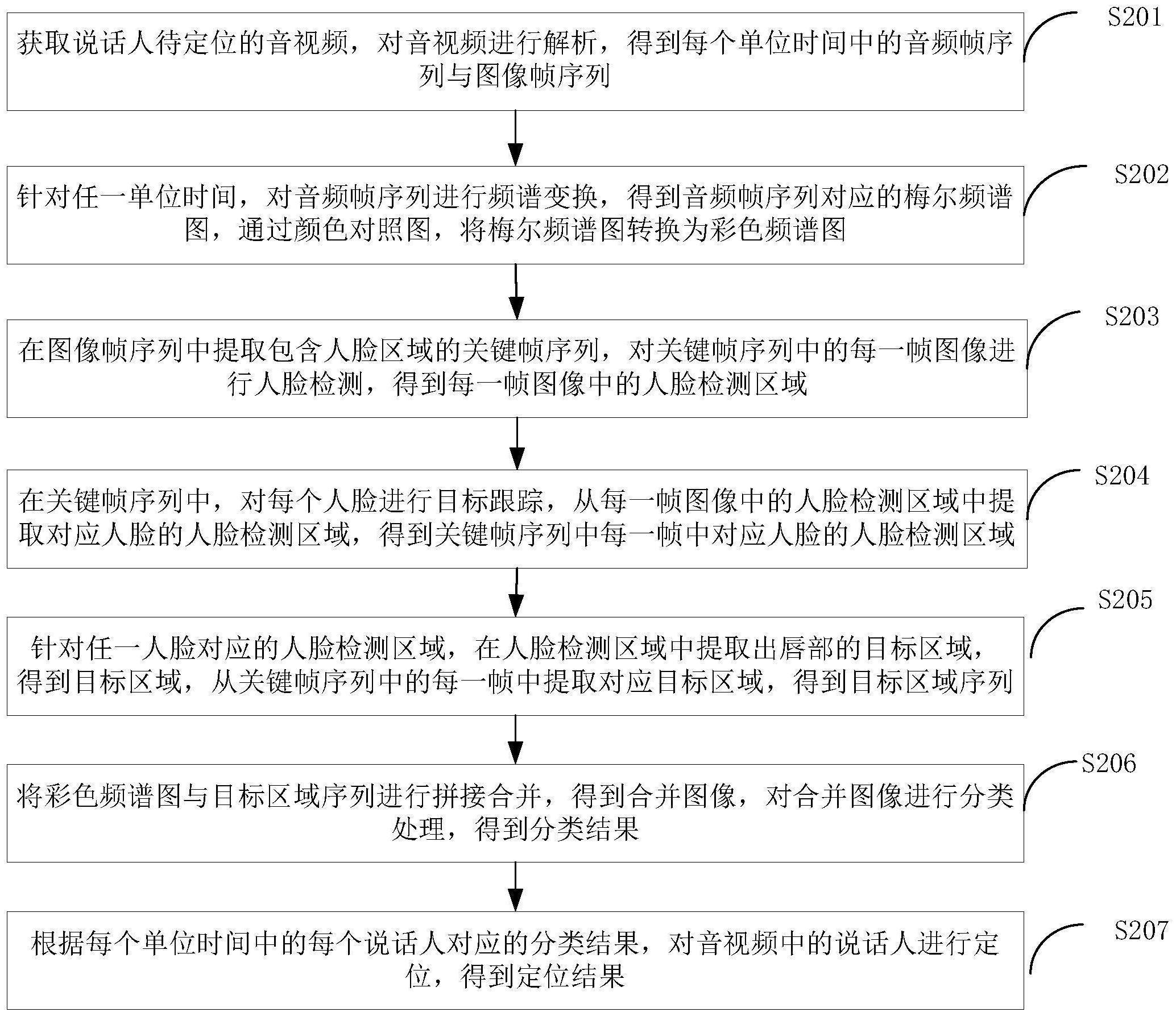

3、获取说话人待定位的音视频,对所述音视频进行解析,得到每个单位时间中的音频帧序列与图像帧序列;

4、针对任一单位时间,对所述音频帧序列进行频谱变换,得到所述音频帧序列对应的梅尔频谱图,通过颜色对照图,将所述梅尔频谱图转换为彩色频谱图;

5、在所述图像帧序列中提取包含人脸区域的关键帧序列,对所述关键帧序列中的每一帧图像进行人脸检测,得到每一帧图像中的人脸检测区域;

6、在所述关键帧序列中,对每个人脸进行目标跟踪,从每一帧图像中的人脸检测区域中提取对应人脸的人脸检测区域,得到所述关键帧序列中每一帧中对应人脸的人脸检测区域;

7、针对任一人脸对应的人脸检测区域,在所述人脸检测区域中提取出唇部的目标区域,得到目标区域,从所述关键帧序列中的每一帧中提取对应目标区域,得到目标区域序列;

8、将所述彩色频谱图与所述目标区域序列进行拼接合并,得到合并图像,对所述合并图像进行分类处理,得到分类结果;

9、根据每个单位时间中的每个说话人对应的分类结果,对所述音视频中的说话人进行定位,得到定位结果。

10、本申请实施例的第二方面提供了一种基于音视频的说话人定位装置,所述说话人定位装置包括:

11、获取模块,用于获取说话人待定位的音视频,对所述音视频进行解析,得到每个单位时间中的音频帧序列与图像帧序列;

12、变换模块,用于针对任一单位时间,对所述音频帧序列进行频谱变换,得到所述音频帧序列对应的梅尔频谱图,通过颜色对照图,将所述梅尔频谱图转换为彩色频谱图;

13、检测模块,用于在所述图像帧序列中提取包含人脸区域的关键帧序列,对所述关键帧序列中的每一帧图像进行人脸检测,得到每一帧图像中的人脸检测区域;

14、标记模块,用于在所述关键帧序列中,对每个人脸进行目标跟踪,从每一帧图像中的人脸检测区域中提取对应人脸的人脸检测区域,得到所述关键帧序列中每一帧中对应人脸的人脸检测区域;

15、提取模块,用于针对任一人脸对应的人脸检测区域,在所述人脸检测区域中提取出唇部的目标区域,得到目标区域,从所述关键帧序列中的每一帧中提取对应目标区域,得到目标区域序列;

16、拼接模块,用于将所述彩色频谱图与所述目标区域序列进行拼接合并,得到合并图像,对所述合并图像进行分类处理,得到分类结果;

17、定位模块,用于根据每个单位时间中的每个说话人对应的分类结果,对所述音视频中的说话人进行定位,得到定位结果。

18、第三方面,本发明实施例提供一种终端设备,所述终端设备包括处理器、存储器以及存储在所述存储器中并可在所述处理器上运行的计算机程序,所述处理器执行所述计算机程序时实现如第一方面所述的基于音视频的说话人定位方法。

19、第四方面,本发明实施例提供一种计算机可读存储介质,所述计算机可读存储介质存储有计算机程序,所述计算机程序被处理器执行时实现如第一方面所述的基于音视频的说话人定位方法。

20、本发明与现有技术相比存在的有益效果是:

21、获取说话人待定位的音视频,对音视频进行解析,得到每个单位时间中的音频帧序列与图像帧序列,针对任一单位时间,对音频帧序列进行频谱变换,得到音频帧序列对应的梅尔频谱图,通过颜色对照图,将梅尔频谱图转换为彩色频谱图,在图像帧序列中提取包含人脸区域的关键帧序列,对关键帧序列中的每一帧图像进行人脸检测,得到每一帧图像中的人脸检测区域,在关键帧序列中,对每个人脸进行目标跟踪,从每一帧图像中的人脸检测区域中提取对应人脸的人脸检测区域,得到关键帧序列中每一帧中对应人脸的人脸检测区域,针对任一人脸对应的人脸检测区域,在人脸检测区域中提取出唇部的目标区域,得到目标区域,从关键帧序列中的每一帧中提取对应目标区域,得到目标区域序列,将彩色频谱图与目标区域序列进行拼接合并,得到合并图像,对合并图像进行分类处理,得到分类结果,根据每个单位时间中的每个说话人对应的分类结果,对音视频中的说话人进行定位,得到定位结果。本申请中,将音视频中的人脸区域中的唇部特征与音频特征结合,进行分类判断是否为说话人,从而定位出音视频中的音频对应的说话人,唇部特征与音频特征结合,丰富了特征信息,可以提高判断待检测人脸是否为说话人的准确度,从而提高了说话人定位的准确度,在保险销售行业,对说话人进行高准确度的定位可以有效防止销售人员代替客户读合同条款的情况。

技术特征:

1.一种基于音视频的说话人定位方法,其特征在于,所述说话人定位方法包括:

2.如权利要求1所述的说话人定位方法,其特征在于,所述对所述音频帧序列进行频谱变换,得到所述音频帧序列对应的梅尔频谱图,包括:

3.如权利要求1所述的说话人定位方法,其特征在于,所述在所述图像帧序列中提取包含人脸区域的关键帧序列,包括:

4.如权利要求1所述的说话人定位方法,其特征在于,所述对所述关键帧序列中的每一帧图像进行人脸检测,得到每一帧图像中的人脸检测区域之后,还包括:

5.如权利要求1所述的说话人定位方法,其特征在于,所述在所述人脸检测区域中提取出唇部的目标区域,包括:

6.如权利要求1所述的说话人定位方法,其特征在于,所述根据每个单位时间中的每个说话人对应的分类结果,对所述音视频中的说话人进行定位,得到定位结果,包括:

7.一种基于音视频的说话人定位装置,其特征在于,所述说话人定位装置包括:

8.如权利要求7所述的说话人定位装置,其特征在于,所述变换模块包括:

9.一种终端设备,其特征在于,所述终端设备包括处理器、存储器以及存储在所述存储器中并可在所述处理器上运行的计算机程序,所述处理器执行所述计算机程序时实现如权利要求1至6任一项所述的说话人定位方法。

10.一种计算机可读存储介质,所述计算机可读存储介质存储有计算机程序,其特征在于,所述计算机程序被处理器执行时实现如权利要求1至6任一项所述的说话人定位方法。

技术总结

本发明涉及人工智能技术领域,尤其涉及一种基于音视频的说话人定位方法、装置、设备及介质,本申请中,提取音视频中的图像帧中人脸区域的唇部部分与音视频中的音频,将音视频中的人脸区域中的唇部特征与音频特征结合,进行分类判断是否为说话人,从而定位出音视频中的音频对应的说话人,唇部特征与音频特征结合,丰富了特征信息,可以提高判断待检测人脸是否为说话人的准确度,从而提高了说话人定位的准确度,在保险销售行业,对说话人进行高准确度的定位可以有效防止销售人员代替客户读合同条款的情况。

技术研发人员:崔希鹏

受保护的技术使用者:中国平安人寿保险股份有限公司

技术研发日:

技术公布日:2024/1/16

- 还没有人留言评论。精彩留言会获得点赞!