面向图像分类的深度神经网络无数据普适对抗攻击方法

本发明属于人工智能领域,涉及深度神经网络对抗样本生成方法,具体为一种面向图像分类的深度神经网络无数据普适对抗攻击方法。

背景技术:

1、深度神经网络是目前大多数机器学习任务中取得最先进结果的方法。然而,这种网络容易受到对抗样本的影响。研究表明,存在图像不可知扰动,当添加这些扰动时,大多数数据样本都可以欺骗目标分类器。这种扰动被称为“普适对抗扰动(uap)”,即单个噪声可以对抗性地扰动来自多个类别的样本。这种扰动具有普适性,uap对图像分类模型的部署构成了严重威胁。生成uap对于验证模型的鲁棒性、评估模型的安全性以及研究对抗训练和防御策略等方面都具有重要的意义,可以帮助更好地理解和改进深度神经网络的性能和安全性。

2、为了生成uap,通常需要依赖于大量的训练数据。然而,在实际应用中,获取训练数据是一项困难的任务。因此,在无法获得训练数据的情况下,目前还缺乏高效的普适对抗攻击方法。

技术实现思路

1、为了解决无数据环境下的普适对抗攻击问题,本发明提供一种面向图像分类的深度神经网络无数据普适对抗攻击方法,能够消除对训练数据的依赖,并高效率地生成普适对抗扰动。

2、本发明为解决其技术问题所采用的技术方案是:

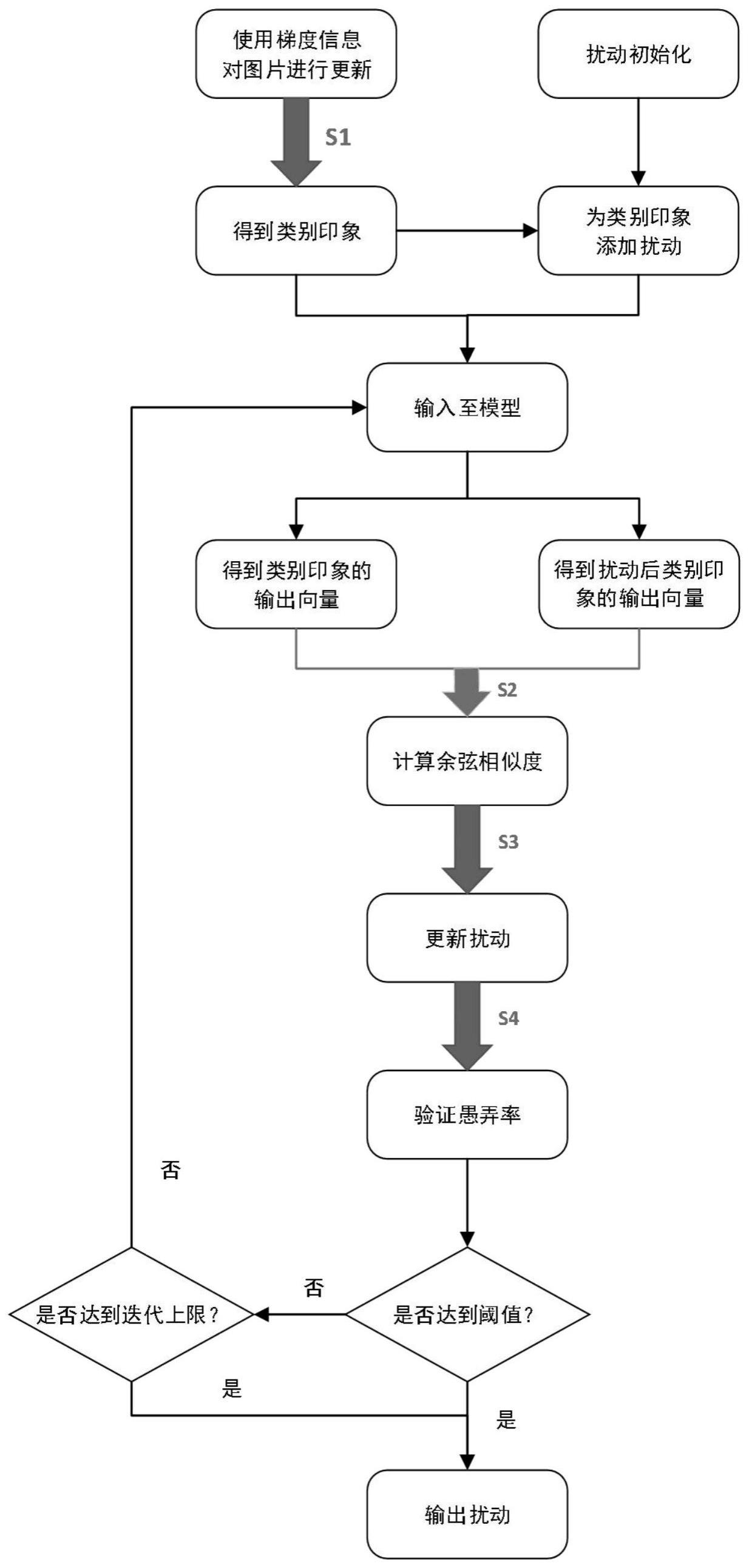

3、一种面向图像分类的深度神经网络无数据普适对抗攻击方法,步骤包括:

4、步骤1、生成类别印象:利用模型的梯度对原始输入图片进行迭代更新,得到不同置信度的类别印象;

5、步骤2、扰动初始化:将初始扰动设置为与输入图片数据同维度的零向量;

6、步骤3、通过最小化输出向量的余弦相似度进行对抗攻击:将类别印象作为训练数据分批次输入至模型,得到原始数据在模型最后一个全连接层的输出向量;将同批次训练数据添加扰动后输入至模型,得到扰动后数据在模型最后一个全连接层的输出向量;计算添加扰动前后该批次训练数据输出向量间的余弦相似度均值,得到损失值和梯度信息,交由优化器对扰动进行更新;

7、步骤4、验证攻击效果:将扰动添加至测试集样本图片中,经模型分类后与添加扰动前的分类结果不同即为攻击成功;统计攻击成功的样本占总体样本的比例,即愚弄率,若愚弄率达到设定阈值,执行步骤5;若愚弄率未达到设定阈值,循环执行步骤3和步骤4,直到达到设定的迭代上限;

8、步骤5、输出扰动向量并可视化。

9、作为本发明的进一步实施方案,所述步骤1的具体实现方法为:

10、步骤1.1、随机初始化原始图片作为模型的输入,为该图片设置一个真值标签;

11、步骤1.2、将置信度区间划分为[55,65],[65,75],[75,85],[85,95],模拟模型对同类别不同分类难度的样本;

12、步骤1.3、用交叉熵损失衡量原始图片的分类结果与其真值标签的误差,得到损失值;

13、步骤1.4、损失值对输入求导得到梯度信息,使用adam优化器更新原始图片并将更新后的图片输入至模型,若该图片真值标签所属类别的置信度在步骤1.2所述区间中,停止更新并保存,该图片即为类别印象;否则迭代将图片输入至模型,利用梯度信息更新图片,直到该图片置信度落在步骤1.2所述区间中。

14、作为本发明的进一步实施方案,步骤1.3所述用交叉熵损失衡量原始图片的分类结果与其真值标签的误差,具体公式为:

15、

16、式(1)中,i是样本;n是样本总数;j是类别;m是类别总数;yij是符号函数,符号函数为0或1,如果样本i的真实类别等于j则取1,否则取0;aij是样本i属于类别j的预测概率。

17、作为本发明的进一步实施方案,步骤1.4所述类别印象为挖掘模型的记忆获取到的训练数据的代表性样本,用于模拟底层分布的实际数据样本。

18、作为本发明的进一步实施方案,步骤3的具体实现方法为:

19、步骤3.1、对每一个类,从步骤1.2所述置信度区间中取等数量的类别印象构成生成uap的代理训练集;

20、步骤3.2、将代理训练集数据划分为若干批次,计算添加扰动前后同一批次数据在模型最后一个全连接层的输出向量的余弦相似度,损失值为该批次数据添加扰动前后输出向量的余弦相似度均值;

21、步骤3.3、损失值对输入求导得到梯度信息,使用adam优化器根据梯度信息改变扰动的像素值,使得扰动的像素值朝着损失降低的方向更新;

22、步骤3.4、对扰动进行裁剪,以满足扰动的范数约束。

23、作为本发明的进一步实施方案,步骤3.2所述余弦相似度用于衡量添加扰动前后同一张图片的输出向量的相似程度,其计算公式为:

24、

25、式(2)中,a和b是两个属性向量,n是向量的维数,ai和bi分别是向量a和向量b的各分量。

26、作为本发明的进一步实施方案,步骤3.2所述损失值的计算公式为:

27、

28、式(3)中,b是超参数,用于控制批次大小;similarityi是当前批次中第i对输出向量间的余弦相似度。

29、作为本发明的进一步实施方案,扰动的目标为单个噪声对抗性地干扰来自多个类别的样本,扰动的目标表示为:

30、

31、式(4)中,是已训练好的分类器,x是测试样本,v是普适扰动,μ是样本服从的分布,p是范数,ξ是像素变化的阈值。

32、作为本发明的进一步实施方案,步骤4中所述攻击成功的标准表示为:

33、

34、作为本发明的进一步实施方案,愚弄率的计算公式为:

35、

36、式(6)中,是添加扰动后分类结果发生改变的样本数,n是测试集样本总数。

37、本发明的有益效果包括:

38、通过使用类别印象作为训练数据的方法对底层分布的实际数据进行模拟,可以有效消除uap生成过程中对实际数据的依赖,提高普适对抗攻击的实用性;通过将模型输出向量的余弦相似度均值作为损失值,避免uap生成过程中大量的迭代计算,实现无数据环境下对目标模型的高效攻击。

技术特征:

1.一种面向图像分类的深度神经网络无数据普适对抗攻击方法,其特征步骤包括:

2.根据权利要求1所述的面向图像分类的深度神经网络无数据普适对抗攻击方法,其特征在于,所述步骤1的具体实现方法为:

3.根据权利要求2所述的面向图像分类的深度神经网络无数据普适对抗攻击方法,其特征在于,步骤1.3所述用交叉熵损失衡量原始图片的分类结果与其真值标签的误差,具体公式为:

4.根据权利要求2所述的面向图像分类的深度神经网络无数据普适对抗攻击方法,其特征在于,步骤1.4所述类别印象为挖掘模型的记忆获取到的训练数据的代表性样本,用于模拟底层分布的实际数据样本。

5.根据权利要求2所述的面向图像分类的深度神经网络无数据普适对抗攻击方法,其特征在于,步骤3的具体实现方法为:

6.根据权利要求5所述的面向图像分类的深度神经网络无数据普适对抗攻击方法,其特征在于,步骤3.2所述余弦相似度用于衡量添加扰动前后同一张图片的输出向量的相似程度,其计算公式为:

7.根据权利要求6所述的面向图像分类的深度神经网络无数据普适对抗攻击方法,其特征在于,步骤3.2所述损失值的计算公式为:

8.根据权利要求1所述的面向图像分类的深度神经网络无数据普适对抗攻击方法,其特征在于,扰动的目标为单个噪声对抗性地干扰来自多个类别的样本,扰动的目标表示为:

9.根据权利要求8所述的面向图像分类的深度神经网络无数据普适对抗攻击方法,其特征在于,步骤4中所述攻击成功的标准表示为:

10.根据权利要求9所述的面向图像分类的深度神经网络无数据普适对抗攻击方法,其特征在于,愚弄率的计算公式为:

技术总结

本发明提供一种面向图像分类的深度神经网络无数据普适对抗攻击方法,包括:步骤1、得到不同置信度的类别印象;步骤2、扰动初始化;步骤3、将类别印象作为训练数据分批次输入至模型,得到原始数据在模型最后一个全连接层的输出向量;将同批次训练数据添加扰动后输入至模型,得到扰动后数据在模型最后一个全连接层的输出向量;计算添加扰动前后该批次训练数据输出向量间的余弦相似度均值,得到损失值和梯度信息,交由优化器对扰动进行更新;步骤4、验证攻击效果;步骤5、输出扰动向量并可视化。本发明能够消除对训练数据的依赖,并高效率地生成普适对抗扰动。

技术研发人员:侯刚,朱龙,孔维强,熊焕璋,秦月源

受保护的技术使用者:大连理工大学

技术研发日:

技术公布日:2024/1/15

- 还没有人留言评论。精彩留言会获得点赞!