基于触控屏的视触结合交互方法、装置、设备和可读介质

本公开的实施例涉及计算机,具体涉及基于触控屏的视触结合交互方法、装置、设备和可读介质。

背景技术:

1、视线是揭示人理解外界环境方式的重要线索,通过追踪用户的眼睛运动和注视点,从而获得用户的注意力和意图。在人机交互方面,视线估计可以用于改善用户的界面交互体验,提供更直观、自然的交互方式。目前,在使用视线估计进行界面交互时,通常采用的方式为:通过预先训练的神经网络模型确定用户的注视点位置,以及确定视线停留时间,确定交互意图并进行界面交互。

2、然而,当采用上述方式使用视线估计进行界面交互时,经常会存在如下技术问题:

3、第一,通过视线停留时间确定交互意图,可能会因视线停留时间无法把控而导致时间过长或过短,从而导致执行了错误的界面交互操作。

4、第二,在对神经网络模型进行校正时,通常设定固定的校正时间进行校正,可能因神经网络模型出现问题而未到校正时间,导致无法准确识别注视点位置,无法进行界面交互;在注视环境发送改变时,预先训练的模型无法适应环境的变化,导致无法对注视点进行识别,从而无法进行界面交互。

5、第三,通过对神经网络模型的参数进行校正,且在用户未完成界面交互时,需要耗费较长的时间对模型的参数进行校正,从而需要耗费较长的时间进行界面交互的响应,影响用户体验。

6、第四,在使用队列中的样本对神经网络模型进行在线校正时,未考虑到样本存储的时间和头部姿态不同,导致校正后的神经网络模型所识别的注视点可能会存在偏差,造成无法对注视点进行识别,从而无法进行界面交互。

7、该背景技术部分中所公开的以上信息仅用于增强对本发明构思的背景的理解,并因此,其可包含并不形成本国的本领域普通技术人员已知的现有技术的信息。

技术实现思路

1、本公开的内容部分用于以简要的形式介绍构思,这些构思将在后面的具体实施方式部分被详细描述。本公开的内容部分并不旨在标识要求保护的技术方案的关键特征或必要特征,也不旨在用于限制所要求的保护的技术方案的范围。

2、本公开的一些实施例提出了基于触控屏的视触结合交互方法、装置、电子设备和计算机可读介质,来解决以上背景技术部分提到的技术问题中的一项或多项。

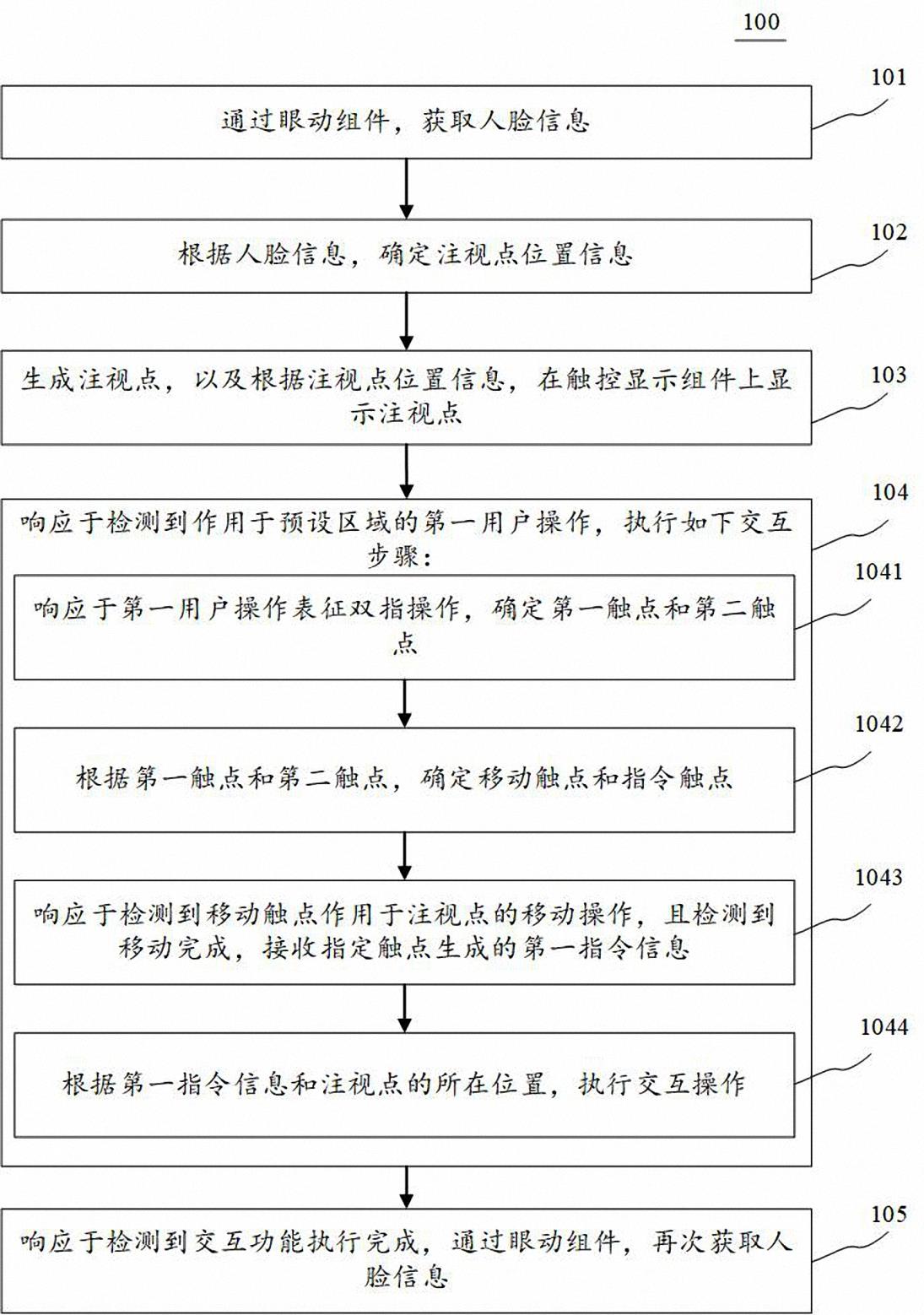

3、第一方面,本公开的一些实施例提供了一种基于触控屏的视触结合交互方法,该方法包括:通过上述眼动组件,获取人脸信息;根据上述人脸信息,确定注视点位置信息;生成注视点,以及根据上述注视点位置信息,在上述触控显示组件上显示上述注视点;响应于检测到作用于预设区域的第一用户操作,执行如下交互步骤:响应于上述第一用户操作表征双指操作,确定第一触点和第二触点;根据上述第一触点和上述第二触点,确定移动触点和指令触点;响应于检测到上述移动触点作用于上述注视点的移动操作,且检测到移动完成,接收上述指令触点生成的第一指令信息;根据上述第一指令信息和上述注视点的所在位置,执行交互操作;响应于检测到上述交互步骤执行完成,通过上述眼动组件,再次获取人脸信息。

4、第二方面,本公开的一些实施例提供了一种基于触控屏的视触结合交互装置,装置包括:第一获取单元,被配置成通过上述眼动组件,获取人脸信息;确定单元,被配置成根据上述人脸信息,确定注视点位置信息;生成单元,被配置成生成注视点,以及根据上述注视点位置信息,在上述触控显示组件上显示上述注视点;执行单元,被配置成响应于检测到作用于预设区域的第一用户操作,执行如下交互步骤:响应于上述第一用户操作表征双指操作,确定第一触点和第二触点;根据上述第一触点和上述第二触点,确定移动触点和指令触点;响应于检测到上述移动触点作用于上述注视点的移动操作,且检测到移动完成,接收上述指令触点生成的第一指令信息;根据上述第一指令信息和上述注视点的所在位置,执行交互操作;第二获取单元,被配置成响应于检测到上述交互步骤执行完成,再次通过上述眼动组件,获取人脸信息。

5、第三方面,本公开的一些实施例提供了一种电子设备,包括:一个或多个处理器;存储装置,其上存储有一个或多个程序,当一个或多个程序被一个或多个处理器执行,使得一个或多个处理器实现上述第一方面任一实现方式所描述的方法。

6、第四方面,本公开的一些实施例提供了一种计算机可读介质,其上存储有计算机程序,其中,程序被处理器执行时实现上述第一方面任一实现方式所描述的方法。

7、本公开的上述各个实施例中具有如下有益效果:通过本公开的一些实施例的基于触控屏的视触结合交互方法,可以避免执行错误的界面交互操作。具体来说,造成执行错误的界面交互操作的原因在于:通过视线停留时间确定交互意图,可能会因视线停留时间无法把控而导致时间过长或过短,从而导致执行了错误的界面交互操作。基于此,本公开的一些实施例的基于触控屏的视触结合交互方法,首先,通过上述眼动组件,获取人脸信息。由此,可以通过对人脸信息进行识别,确定人眼的注视点位置。其次,根据上述人脸信息,确定注视点位置信息。由此,可以生成注视点,并将注视点显示在确定的注视点位置上。然后,生成注视点,以及根据上述注视点位置信息,在上述触控显示组件上显示上述注视点;响应于检测到作用于预设区域的第一用户操作,执行如下交互步骤:响应于上述第一用户操作表征双指操作,确定第一触点和第二触点。由此,可以确定双指操作的触点位置。第二,根据上述第一触点和上述第二触点,确定移动触点和指令触点。由此,可以区分出移动注视点的触点和进行指令输入的触点。第三,响应于检测到上述移动触点作用于上述注视点的移动操作,且检测到移动完成,接收上述指令触点生成的第一指令信息。由此,可以根据第一指令信息确定需要进行的交互操作。第四,根据上述第一指令信息和上述注视点的所在位置,执行交互操作。由此,完成双指交互步骤。因此,可以在检测到作用于触控区域(预设区域)的用户操作时,根据生成的注视点进行对应的界面交互,从而可以通过触控组件与视线结合的方式进行界面交互,而未使用视线停留时间进行交互,从而避免了因视线停留时间过长或过短导致的执行错误的界面交互操作。最后,响应于检测到上述交互步骤执行完成,通过上述眼动组件,再次获取人脸信息。由此,可以在检测到上一界面交互完成后,再次获取人脸信息以进行下一次的界面交互。避免了执行错误的界面交互操作。

技术特征:

1.一种基于触控屏的视触结合交互方法,其中,所述触控屏包括眼动组件和触控显示组件,包括:

2.根据权利要求1所述的方法,其中,所述注视点为以下之一:光标点、区域特效、显示内容高亮。

3.根据权利要求1所述的方法,其中,所述预设区域为预先设定的所述触控显示组件中的任意区域,所述触控显示组件为以下之一:正触控屏、反触控屏、触控板。

4.根据权利要求1所述的方法,其中,所述根据所述人脸信息,确定注视点位置信息,包括:

5.根据权利要求1所述的方法,其中,所述交互步骤还包括:

6.根据权利要求4所述的方法,其中,所述方法还包括:

7.根据权利要求1所述的方法,其中,所述交互步骤还包括:

8.一种基于触控屏的视触结合交互装置,包括:

9.一种电子设备,包括:

10.一种计算机可读介质,其上存储有计算机程序,其中,所述程序被处理器执行时实现如权利要求1至7中任一所述的方法。

技术总结

本公开的实施例公开了基于触控屏的视触结合交互方法、装置、设备和可读介质。该方法的一具体实施方式包括:通过眼动组件,获取人脸信息;根据人脸信息,确定注视点位置信息;生成注视点,以及根据注视点位置信息,在触控显示组件上显示注视点;响应于检测到作用于预设区域的第一用户操作,执行如下交互步骤:确定第一触点和第二触点;根据第一触点和第二触点,确定移动触点和指令触点;接收指令触点生成的第一指令信息;根据第一指令信息和注视点的所在位置,执行交互操作;响应于检测到交互步骤执行完成,通过眼动组件,再次获取人脸信息。该实施方式避免了执行错误的界面交互操作。

技术研发人员:陆峰

受保护的技术使用者:北京航空航天大学

技术研发日:

技术公布日:2024/1/15

- 还没有人留言评论。精彩留言会获得点赞!