一种基于深度学习的异源传感器坐标映射方法

本发明属于机器视觉,具体涉及一种基于深度学习的异源传感器坐标映射方法。

背景技术:

1、随着近现代战场环境变得日益复杂,红外成像传感器与可见光成像传感器的远距协同探测需求也日益增长,常常包含复杂的环境和气候背景。但由于远距探测环境的复杂多变与恶劣的气象环境,独立红外传感器所探测的信息量可能无法满足识别检测目标的需求,需要可见光传感器协同获取信息。目前主要通过可见光与红外异源传感器形成的光电设备进行协同探测,提升对目标信息的获取能力,同时发展异源传感器坐标映射关系标定技术。

2、目前关于异源传感器坐标映射关系并没有具体方法,在实际使用异源传感器摄像机时主要为异源图像融合应用。但由于实际探测的异源传感器成像原理不同,设备分辨率相差较大等原因,难以做到稳定的异源图像融合或信息增强等效果。当前已有机载、舰载、地基等光电探测设备固定时,异源传感器通常不进行目标坐标信息映射,容易出现局部匹配困难、检测失败、跟踪丢失等问题。

技术实现思路

1、本发明的目的在于克服上述现有技术的缺点,提供一种基于深度学习的异源传感器坐标映射方法,以解决现有技术中异源图像融合光电设备远距探测低、慢、小目标复杂背景环境在异源传感器的成像坐标映射关系。

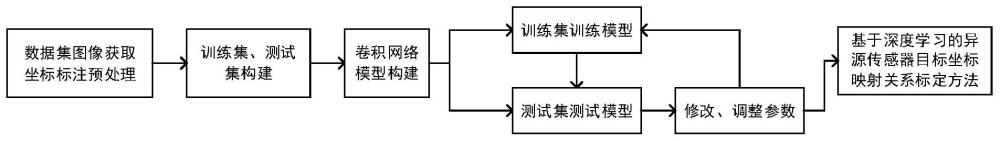

2、为达到上述目的,本发明采用以下技术方案予以实现:

3、一种基于深度学习的异源传感器坐标映射方法,包括以下步骤:

4、步骤1,同时采集红外图像与可见光图像;

5、步骤2,将红外图像中目标像素点坐标输入至可见光卷积网络模型中,获得目标像素点在可见光图像中的坐标;或者是将可见光图像中目标像素点输入至红外卷积网络模型中,获得可见光图像中目标点在红外图像中的坐标;

6、所述可见光卷积网络模型的运行过程为:将红外图像中的目标像素点坐标可见光摄像机的变倍参数和红外传感器的目标中心距输入至深度学习网络中,获得目标像素点坐标新张量、可见光摄像机的变倍参数新张量和红外传感器的目标中心距新张量,将新张量拼接后进行压缩降维,降维后输出在可见光图像中目标像素点的预测坐标;

7、所述红外卷积网络模型的运行过程为:将可见光图像中的目标像素点坐标、可见光摄像机的变倍参数和红外传感器的目标中心距输入至深度学习网络中,获得目标像素点坐标新张量、可见光摄像机的变倍参数新张量和红外传感器的目标中心距新张量,将新张量拼接后进行压缩降维,降维后输出在红外图像中目标像素点的预测坐标。

8、本发明的进一步改进在于:

9、优选的,步骤2中,可见光卷积网络模型及红外卷积网络模型运行过程中,将目标像素点坐标、可见光摄像机的变倍参数和红外传感器的目标中心距输入至深度学习网络前,将数据升级为三维。

10、优选的,步骤2,可见光卷积网络模型及红外卷积网络模型中,所述深度学习网络均包括从下到上的卷积层、激活层、批归一化层和一维自适应平均池化层。

11、优选的,步骤2,可见光卷积网络模型及红外卷积网络模型中,新张量拼接的过程为:将目标像素点坐标新张量、可见光摄像机的变倍参数新张量和红外传感器的目标中心距新张量相互关联。

12、优选的,所述可见光卷积网络模型和红外卷积网络模型为:

13、modelmap=mappingcoordinates(xir,yir,zoom,d)train (7)

14、其中,xiryir为目标像素坐标,zoom为可见光摄像机的变倍参数,d为红外传感器的目标中心距。

15、优选的,所述可见光卷积网络模型和红外卷积网络模型均经过训练获得,训练的过程为:

16、(1)同时多张采集红外图像数据与可见光图像数据,建立图像数据集;

17、(2)在红外图像和可见光图像上标注目标像素坐标位置,获得目标像素坐标数据集;将目标像素数据集分为训练集和测试集;

18、(3)构建卷积神经网络,所述卷积神经网络的输入为目标像素点坐标、可见光摄像机的变倍参数和红外传感器的目标中心距,输出为目标像素点坐标新张量、可见光摄像机的变倍参数新张量和红外传感器的目标中心距新张量;

19、(3)将新张量进行拼接;

20、(4)通过拼接后的张量生成预测的目标像素点坐标、可见光摄像机的变倍参数和红外传感器的目标中心距;

21、(5)通过损失函数计算预测的目标像素点坐标损失值、可见光摄像机的变倍参数损失值和红外传感器的目标中心距损失值,获得总损失值;

22、(6)判断总损失值是否满足设定阈值或迭代次数,如果满足,则模型训练结束,如果不满足,则重复步骤(3)~步骤(5),直至损失函数满足需求,或达到迭代次数;

23、(7)通过测试集测试可见光卷积网络模型和红外卷积网络模型。

24、优选的,步骤(4)中,总损失值的计算公式为:

25、loss=lossx+lossy+lossd+losszoom (6)

26、其中,loss为总损失值,lossx为x坐标的损失值,lossy为y坐标的损失值,lossd为可见光摄像机的变倍参数损失值,losszoom为红外传感器的目标中心距损失值。

27、优选的,步骤(6)中,在重复步骤(3)~(5)的过程中,通过随机梯度下降优化器sgd更新模型参数。

28、优选的,步骤(7)中,测试过程中通过贝叶斯搜索方法进行超参数调优。

29、优选的,红外图像和可见光图像通过在同一个光电球设备中的两个摄像机分别获得。

30、与现有技术相比,本发明具有以下有益效果:

31、本发明一方面公开了一种基于深度学习的异源传感器坐标映射方法,该方法在已有光电探测设备为异源传感器的情况下,增强了得到的已知目标信息,利用光电设备实际拍摄数据进行处理分析,实现了深度学习模型下的可见光/红外异源传感器坐标映射关系标定方法。主要解决了光电设备远距探测复杂环境背景情况下低、慢、小目标在异源传感器的成像坐标映射关系,通过红外传感器得到目标位置信息映射至可见光传感器目标位置信息,或者是通过可见光传感器得到的目标位置信息映射至红外传感器目标位置信息。该方法提高了异源传感器获取目标信息的协同能力,降低后期异源图像融合、目标检测、跟踪等过程中的局部匹配难度等问题。

技术特征:

1.一种基于深度学习的异源传感器坐标映射方法,其特征在于,包括以下步骤:

2.根据权利要求1所述的一种基于深度学习的异源传感器坐标映射方法,其特征在于,步骤2中,可见光卷积网络模型及红外卷积网络模型运行过程中,将目标像素点坐标、可见光摄像机的变倍参数和红外传感器的目标中心距输入至深度学习网络前,将数据升级为三维。

3.根据权利要求1所述的一种基于深度学习的异源传感器坐标映射方法,其特征在于,步骤2,可见光卷积网络模型及红外卷积网络模型中,所述深度学习网络均包括从下到上的卷积层、激活层、批归一化层和一维自适应平均池化层。

4.根据权利要求1所述的一种基于深度学习的异源传感器坐标映射方法,其特征在于,步骤2,可见光卷积网络模型及红外卷积网络模型中,新张量拼接的过程为:将目标像素点坐标新张量、可见光摄像机的变倍参数新张量和红外传感器的目标中心距新张量相互关联。

5.根据权利要求1所述的一种基于深度学习的异源传感器坐标映射方法,其特征在于,所述可见光卷积网络模型和红外卷积网络模型为:

6.根据权利要求1所述的一种基于深度学习的异源传感器坐标映射方法,其特征在于,所述可见光卷积网络模型和红外卷积网络模型均经过训练获得,训练的过程为:

7.根据权利要求6所述的一种基于深度学习的异源传感器坐标映射方法,其特征在于,步骤(4)中,总损失值的计算公式为:

8.根据权利要求6所述的一种基于深度学习的异源传感器坐标映射方法,其特征在于,步骤(6)中,在重复步骤(3)~(5)的过程中,通过随机梯度下降优化器sgd更新模型参数。

9.根据权利要求6所述的一种基于深度学习的异源传感器坐标映射方法,其特征在于,步骤(7)中,测试过程中通过贝叶斯搜索方法进行超参数调优。

10.根据权利要求1所述的一种基于深度学习的异源传感器坐标映射方法,其特征在于,红外图像和可见光图像通过在同一个光电球设备中的两个摄像机分别获得。

技术总结

本发明公开了一种基于深度学习的异源传感器坐标映射方法,该方法在已有光电探测设备为异源传感器的情况下,通过构建可见光卷积网络模型和红外光卷积网络模型中,利用光电设备实际拍摄数据进行处理分析,实现了深度学习模型下的可见光/红外异源传感器坐标映射关系标定方法。主要解决了光电设备远距探测复杂环境背景情况下低、慢、小目标在异源传感器的成像坐标映射关系,通过红外传感器得到目标位置信息映射至可见光传感器目标位置信息,或者是通过可见光传感器得到的目标位置信息映射至红外传感器目标位置信息。

技术研发人员:李少毅,林健,杨曦,孟中杰

受保护的技术使用者:西北工业大学

技术研发日:

技术公布日:2024/4/17

- 还没有人留言评论。精彩留言会获得点赞!