用户界面的个性化校准的制作方法

本公开涉及电子设备的用户界面,包括增强现实(ar)使能的可穿戴电子设备,诸如智能眼镜。更特别地,但不是通过限制的方式,本公开描述了检测用户的生理特征(诸如手臂长度和手部大小),基于检测到的生理特征来调整用户界面(ui)控件的参数,并且然后将定制的ui渲染给电子设备的技术。

背景技术:

1、可穿戴电子设备的用户可以通过与可穿戴电子设备的交互来选择显示特征。可穿戴电子设备(诸如电子眼睛佩戴设备)可以具有接受手势输入的用户界面。当与这种电子眼睛佩戴设备交互时,用户的手臂和手部可以在电子眼睛佩戴设备的ar相机前方移动,以做出手势,其被电子眼睛佩戴设备识别为不同的输入命令以控制电子眼睛佩戴设备的操作。然而,并非所有用户都具有相同大小的附属肢体(诸如手臂和手部)。一些用户与其他用户相比可以具有不同大小的手部,不同的手臂长度等。例如,具有长臂和大手的成年人可以与具有短臂和小手的儿童不同地与电子设备的用户界面交互。如果ui控件没有以正确的大小或距离为相应的用户渲染,则用户界面(ui)控件可能潜在地离用户太远或太近。

技术实现思路

技术特征:

1.一种眼睛佩戴设备,包括:

2.根据权利要求1所述的眼睛佩戴设备,还包括:参数存储器,其中所述处理器通过执行指令来执行所述校准过程以将所述眼睛佩戴设备配置为:

3.根据权利要求1所述的眼睛佩戴设备,其中,所述至少一个附属肢体包括手部或手臂中的至少一者,并且其中,识别出的校准参数包括所述用户的手掌大小、最大可达距离、指关节间距或手指长度中的至少一者。

4.根据权利要求1所述的眼睛佩戴设备,其中,所述指令的执行还致使所述处理器在捕捉到的图像中检测到另一个校准手势时重新发起所述校准过程。

5.根据权利要求1所述的眼睛佩戴设备,其中,所述校准手势包括所述用户的预定手部手势,由此用户的至少一个手部上的所有手部关节都是可见的。

6.根据权利要求5所述的眼睛佩戴设备,其中,所述指令的执行还致使所述处理器识别用户的手部或手臂中的至少一者的界标位置,并且测量相应界标位置之间的相对距离。

7.根据权利要求1所述的眼睛佩戴设备,还包括:参数存储器,其中,所述校准参数作为系统参数被存储在所述参数存储器中。

8.根据权利要求1所述的眼睛佩戴设备,其中,调整所述用户界面包括:基于识别出的校准参数修改所述用户界面的至少一个可交互元素。

9.根据权利要求8所述的眼睛佩戴设备,其中,修改所述用户界面的至少一个可交互元素包括:使用测量出的最大可达距离来将所述用户界面的至少一个可交互元素的位置调整到所述用户的可达距离内。

10.根据权利要求9所述的眼睛佩戴设备,其中,所述指令的执行还致使所述处理器:确定可召唤用户界面元素是否位于与用户的手部相距一个超过所述测量出的最大可达距离的距离的位置处,并且当所述可召唤用户界面元素位于超过测量出的最大可达距离的位置时,将所述可召唤用户界面元素从超过测量出的最大可达距离的位置移位到在用户的手部的可达距离内的位置。

11.根据权利要求10所述的眼睛佩戴设备,其中,所述指令的执行还致使所述处理器:在与所述可召唤用户界面元素的交互完成时,将所述可召唤用户界面元素返回到超过所述测量出的最大可达距离的位置。

12.根据权利要求6所述的眼睛佩戴设备,其中,所述指令的执行还致使所述处理器:将可召唤用户界面元素或用户锁定视图从所述显示器中被物理物品从用户的视图遮挡的位置移位到所述显示器中未被所述物理物品遮挡的位置,由此所述用户能够与所述可召唤用户界面元素交互或查看所述用户锁定视图。

13.根据权利要求1所述的眼睛佩戴设备,其中,所述指令的执行还致使所述处理器使用识别出的校准参数来调整用户界面元素的缩放比例,或调整要缩放到所述用户的手部大小的用户界面元素组的间距。

14.根据权利要求1所述的眼睛佩戴设备,其中,所述指令的执行还致使所述处理器使用识别出的校准参数来调整用于用所述相机捕捉图像的交互和手势半径。

15.根据权利要求1所述的眼睛佩戴设备,其中,所述指令的执行还致使所述处理器检测所述眼睛佩戴设备的新用户,并且当新用户被检测到时,发起所述校准过程。

16.一种校准眼睛佩戴设备的用户界面(ui)的方法,包括:

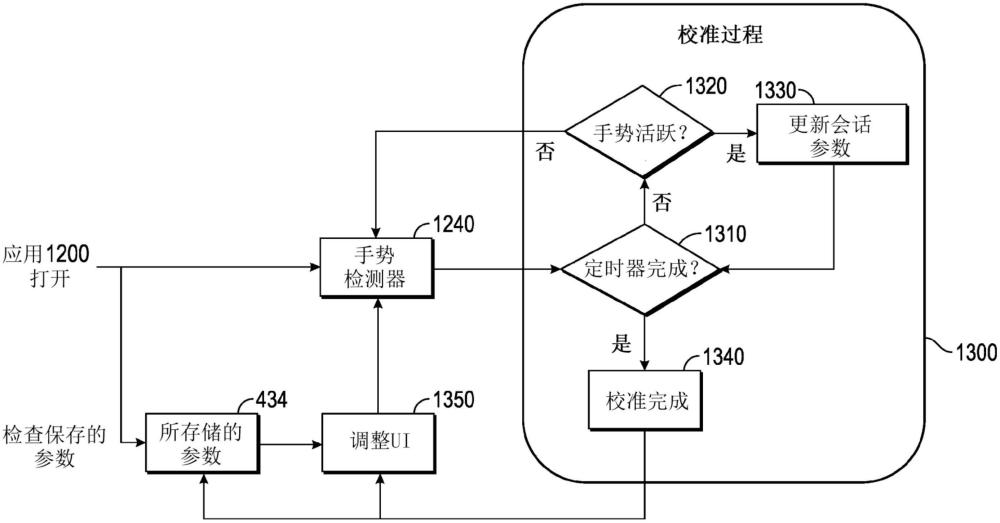

17.根据权利要求16所述的方法,其中,执行所述校准过程包括:

18.根据权利要求16所述的方法,其中,所述至少一个附属肢体包括手部或手臂中的至少一者,并且其中,识别出的校准参数包括所述用户的手掌大小、最大可达距离、指关节间距或手指长度中的至少一者。

19.根据权利要求16所述的方法,其中,检测所述校准手势并执行所述校准过程包括:

20.一种非暂时性计算机可读存储介质,其存储了指令,所述指令在由至少一个处理器执行时,致使所述至少一个处理器通过执行包括以下步骤的操作来校准眼睛佩戴设备的用户界面(ui):

技术总结

一种用于眼睛佩戴设备的增强现实(AR)校准过程,其为佩戴者定制AR用户界面(UI)。诸如手臂长度和手部大小的生理特征从由眼睛佩戴设备捕捉到的图像确定,以用于在渲染UI之前调整UI控件。

技术研发人员:葛林辉,凯蒂·卢

受保护的技术使用者:斯纳普公司

技术研发日:

技术公布日:2024/11/14

- 还没有人留言评论。精彩留言会获得点赞!