解码加速方法、装置、设备、计算机可读存储介质及产品与流程

本公开涉及人工智能中的深度学习,尤其涉及一种解码加速方法、装置、设备、计算机可读存储介质及产品。

背景技术:

1、当前主流场景的大语言模型预测方式为自回归解码的方案,该方案在预测一条文本时,主要包括两个阶段,第一个阶段为prefill阶段(编码阶段),第二个阶段为decode阶段(解码阶段)。

2、在获取到编码阶段生成的隐藏状态之后,大语言模型在解码阶段进行推理操作时,是执行一次前向计算,只输出一个预测文本单位(token)。不断执行,直到输出完所有token。但是,采用上述方法进行解码操作往往效率比较低,导致预测操作耗时较长。

技术实现思路

1、本公开提供了一种用于对大语言模型解码阶段进行加速的解码加速方法、装置、设备、计算机可读存储介质及产品。

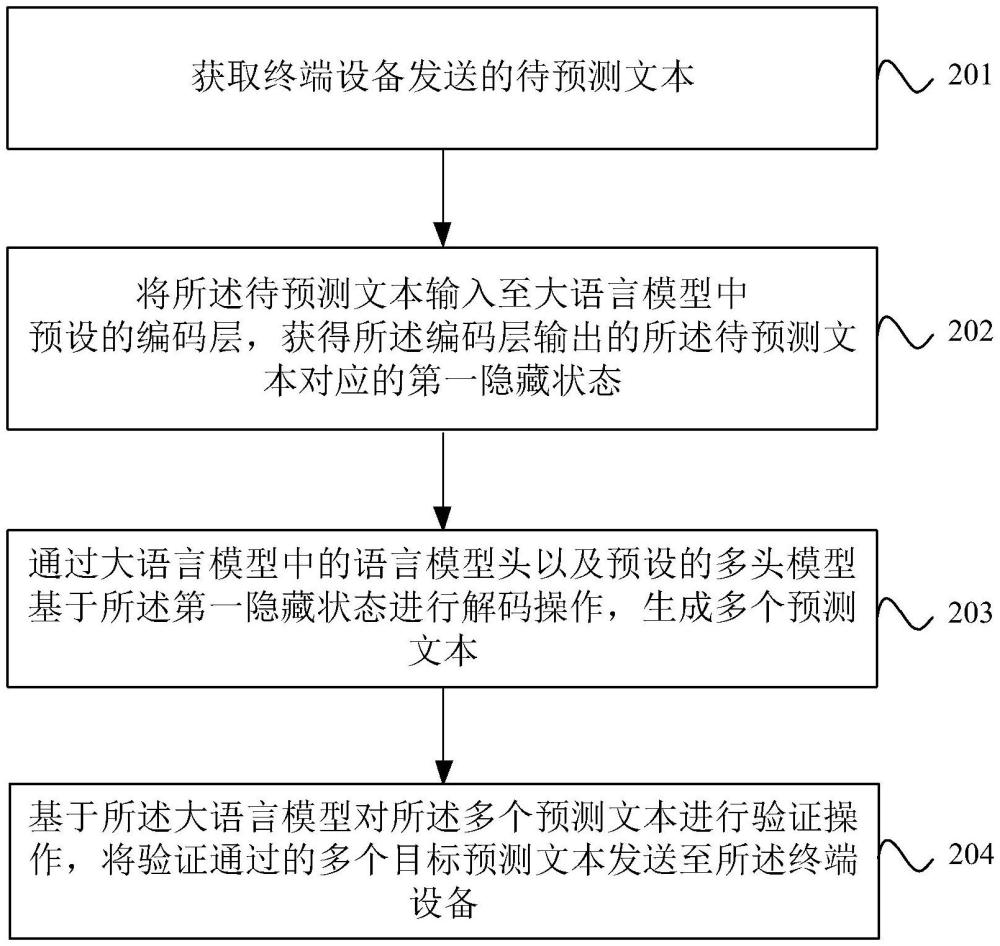

2、根据本公开的第一方面,提供了一种解码加速方法,包括:

3、获取终端设备发送的待预测文本;

4、将所述待预测文本输入至大语言模型中预设的编码层,获得所述编码层输出的所述待预测文本对应的第一隐藏状态;

5、通过大语言模型中的语言模型头以及预设的多头模型基于所述第一隐藏状态进行解码操作,生成多个预测文本,所述多头模型中包括多个解码模块,所述解码模块包括多层感知机以及语言模型头,所述多个解码模块复用所述语言模型头;

6、基于所述大语言模型对所述多个预测文本进行验证操作,将验证通过的多个目标预测文本发送至所述终端设备。

7、根据本公开的第二方面,提供了一种解码加速装置,包括:

8、获取模块,用于获取终端设备发送的待预测文本;

9、编码模块,用于将所述待预测文本输入至大语言模型中预设的编码层,获得所述编码层输出的所述待预测文本对应的第一隐藏状态;

10、解码模块,用于通过大语言模型中的语言模型头以及预设的多头模型基于所述第一隐藏状态进行解码操作,生成多个预测文本,所述多头模型中包括多个解码模块,所述解码模块包括多层感知机以及语言模型头,所述多个解码模块复用所述语言模型头;

11、验证模块,用于基于所述大语言模型对所述多个预测文本进行验证操作,将验证通过的多个目标预测文本发送至所述终端设备。

12、根据本公开的第三方面,提供了一种电子设备,包括:

13、至少一个处理器;以及

14、与所述至少一个处理器通信连接的存储器;其中,

15、所述存储器存储有可被所述至少一个处理器执行的指令,所述指令被所述至少一个处理器执行,以使所述至少一个处理器能够执行第一方面所述的方法。

16、根据本公开的第四方面,提供了一种存储有计算机指令的非瞬时计算机可读存储介质,其中,所述计算机指令用于使所述计算机执行第一方面所述的方法。

17、根据本公开的第五方面,提供了一种计算机程序产品,所述计算机程序产品包括:计算机程序,所述计算机程序存储在可读存储介质中,电子设备的至少一个处理器可以从所述可读存储介质读取所述计算机程序,所述至少一个处理器执行所述计算机程序使得电子设备执行第一方面所述的方法。

18、根据本公开的技术提高了大语言模型在解码阶段的速度,提高了大语言模型进行数据处理的效率。

19、应当理解,本部分所描述的内容并非旨在标识本公开的实施例的关键或重要特征,也不用于限制本公开的范围。本公开的其它特征将通过以下的说明书而变得容易理解。

技术特征:

1.一种解码加速方法,包括:

2.根据权利要求1所述的方法,其中,所述通过大语言模型中的语言模型头以及预设的多头模型基于所述第一隐藏状态进行解码操作,生成多个预测文本,包括:

3.根据权利要求2所述的方法,其中,所述通过所述语言模型头对所述第一隐藏状态进行解码操作,获得首轮解码获得的第一预测文本,包括:

4.根据权利要求2所述的方法,其中,所述通过所述多头模型中的多个解码模块依次基于上一轮解码操作的预测文本以及所述第一隐藏状态生成多个第二预测文本,包括:

5.根据权利要求4所述的方法,其中,所述确定所述下一解码模块输出的未归一化预测值关联的置信度,基于所述置信度确定当前是否满足预设的终止条件,包括:

6.根据权利要求5所述的方法,其中,所述多头模型中多个解码模块顺序连接,每一解码模块关联的预设阈值的大小与所述解码模块的序号大小成正比。

7.根据权利要求5所述的方法,所述基于所述大语言模型对所述多个预测文本进行验证操作,将验证通过的多个目标预测文本发送至所述终端设备之后,还包括:

8.根据权利要求1-7任一项所述的方法,其中,解码模块中还包括上下文信息整合层,所述上下文信息整合层用于整合所述解码模块的输入数据的上下文信息;

9.根据权利要求1-7任一项所述的方法,其中,所述基于所述大语言模型对所述多个预测文本进行验证操作,包括:

10.根据权利要求1-7任一项所述的方法,所述方法还包括:

11.一种解码加速装置,包括:

12.根据权利要求11所述的装置,其中,所述解码模块包括:

13.根据权利要求12所述的装置,其中,所述第一解码单元包括:

14.根据权利要求12所述的装置,其中,所述第二解码单元包括:

15.根据权利要求14所述的装置,其中,所述终止子单元,用于:

16.根据权利要求15所述的装置,其中,所述多头模型中多个解码模块顺序连接,每一解码模块关联的预设阈值的大小与所述解码模块的序号大小成正比。

17.根据权利要求15所述的装置,所述装置还包括:

18.根据权利要求11-17任一项所述的装置,其中,解码模块中还包括上下文信息整合层,所述上下文信息整合层用于整合所述解码模块的输入数据的上下文信息;

19.根据权利要求11-17任一项所述的装置,其中,所述验证模块包括:

20.根据权利要求11-17任一项所述的装置,所述装置还包括:

21.一种电子设备,包括:

22.一种存储有计算机指令的非瞬时计算机可读存储介质,其中,所述计算机指令用于使所述计算机执行根据权利要求1-10中任一项所述的方法。

23.一种计算机程序产品,包括计算机程序,该计算机程序被处理器执行时实现权利要求1-10中任一项所述方法的步骤。

技术总结

本公开提供了解码加速方法、装置、设备、计算机可读存储介质及产品,涉及人工智能领域,尤其涉及深度学习领域。具体实现方案为:获取终端设备发送的待预测文本;将待预测文本输入至大语言模型中预设的编码层,获得编码层输出的待预测文本对应的第一隐藏状态;通过大语言模型中的语言模型头以及预设的多头模型基于第一隐藏状态进行解码操作,生成多个预测文本,多头模型中包括多个解码模块,解码模块包括多层感知机以及语言模型头,多个解码模块复用语言模型头;基于大语言模型对多个预测文本进行验证操作,将验证通过的多个目标预测文本发送至终端设备。从而提高了大语言模型在解码阶段的速度,提高了大语言模型进行数据处理的效率。

技术研发人员:邱讷敏,李明昊,周兆京,王豪爽,党青青,沙燕霖,于佃海,马艳军

受保护的技术使用者:北京百度网讯科技有限公司

技术研发日:

技术公布日:2025/4/6

- 还没有人留言评论。精彩留言会获得点赞!