一种基于人脸面形空间分布的无相位展开三维人脸重建方法及系统与流程

1.本发明涉及光学三维成像领域,尤其涉及一种基于人脸面形空间分布的无相位展开三维人脸重建方法及系统。

背景技术:

2.三维人脸识别技术快速走向应用的前提是大规模三维人脸数据的建库,基于三角测量原理的光学三维测量技术具有全场非接触、精度高、速度快等显著优点,被认为是获取高速高精度三维人脸数据重要推崇的技术之一。通过投影结构光光场至待测人脸表面获取三维面形数据,通常采用单目或双目相机来拍摄受到待测人脸表面调制的变形图像序列,并提取相位信息来重建三维模型。而结构光编码的目的在于丰富或增加被测弱纹理人脸表面的特征,从而提高三维重建结果的准确性、可靠性以及建模的完整性。目前,结构光编码主要有散斑结构光和条纹结构光,其中,基于条纹结构光编码的双目立体匹配系统因其高精度显著优点被应用广泛。而条纹结构光系统中,相移轮廓术(psp),以其更高的精度,更大的分辨率,更低的复杂度以及对环境光的不敏感性而闻名。

3.psp的应用前提是被测量对象是相对静止的。然而,与测量静态对象不同的是,面部或多或少地处于运动中,例如呼吸,眨眼,抽搐或具有其他动态表情。而在动态三维人脸识别过程中,除了精度要求外,我们还希望能获取实时的三维人脸模型。因此,对于高精度的正弦条纹结构光三维人脸重建系统,我们还面临以下两个挑战:

4.应尽可能的减少图像采集数量,节省采集时间。传统方法中投影条纹数量较多,如多频法、格雷码法等,相位解算过程中往往需要投影多帧低频信号去解算高频信号才能得到高精度的绝对相位,不仅大大增加了采集时间,而且会因人脸运动造成的伪像而降低建模精度。

5.尽可能优化重建算法,节省计算时间。当前最流行的相位展开算法主要有两种:空间相位展开算法和时间相位展开算法。空间相位展开算法首先确定截断相位图上的2π不连续位置,然后通过添加或减去2π的整数倍来删除其不连续性,但其存在因展开路径误差积累造成的鲁棒性较差的问题。而时间相位展开虽然能很好的克服空间相位展开的难题,且这些年来已经开发了许多方法,如多频法和格雷码法等,但其条纹投影数量依然是目前待解决问题。

6.公开号为cn109903377a,名为“一种无需相位展开的三维人脸建模方法及系统”的中国专利公开了一种利用人脸几何信息约束条件去对齐截断相位级次标记线,从而直接使用截断相位进行立体匹配来重建三维人脸模型的方法。但是本发明是通过三角剖分得到人脸面形空间粗视差分布图,再利用截断相位信息对粗视差信息进行精确匹配。虽然都是无相位展开方法,但是实现方法不一样。

技术实现要素:

7.针对背景技术中存在投影条纹数量多的具体问题,提供一种基于人脸面形空间分布的无相位展开三维人脸重建方法及系统,通过绘制三角网格替换传统的相位展开方案进行三维重建,无需进行相位展开,即可完成高精度三维重建。

8.为了实现上述目的,本发明采用的技术方案包括以下各方面。

9.一种基于人脸面形空间分布的无需相位展开三维人脸重建算法,包括:

10.步骤501,以不相同的m个拍摄角度采集n帧被测物的在条纹结构光场中的人脸图像,分别对所采集到的条纹结构光场中的人脸图像进行极线校正,得到截断相位;其中,n是大于等于3的整数,m是大于等于2的整数;

11.步骤502,从级线校正后的人脸图像中解析出所蕴含的纹理信息,形成纹理图相对;并根据所述纹理图像对,提取人脸特征点;

12.步骤503,基于所述人脸特征点,以人脸特征点锚点,对人脸面部进行三角剖分,形成基于三角形的人脸面形空间分布图;

13.步骤504,基于所述人脸面形空间分布图,形成网格视差图,通过对网格内部点进行插值,得到粗视差图;

14.步骤505,基于所述粗视差图结合所述左右截断相位,通过搜索得到精视差图;

15.步骤506,基于所述精视差图结合系统标定信息,完成三维重建,得到面部的高精度三维点云数据。

16.优选的,一种基于人脸面形空间分布的无需相位展开三维人脸重建算法中,采用delaunay三角剖分法对人脸面部进行三角剖分,得到所述基于三角形的人脸面形空间分布图。

17.优选的,一种基于人脸面形空间分布的无需相位展开三维人脸重建算法中,采用candide 3为人脸模型对人脸进行三角剖分,得到所述基于三角形的人脸面形空间分布图。

18.优选的,一种基于人脸面形空间分布的无需相位展开三维人脸重建算法中,在人脸特征点基础上初始绘制的三角形,采用迭代法通过三角形内部取重心或三角形边上取中点,有序扩增稀疏面上特征点的数量,增加三角形的数量。

19.优选的,一种基于人脸面形空间分布的无需相位展开三维人脸重建算法中,步骤504具体包括:计算每个三角形顶点的视差值,通过对三角形每条边进行线性插值形成网格视差图,再采用相关插值算法,以顶点视差值为基准计算三角形内部每个像素点的视差值,形成粗视差值。

20.优选的,一种基于人脸面形空间分布的无需相位展开三维人脸重建算法中,步骤505具体还包括:通过相移光栅条纹解得的截断相位,对获得的粗视差图上每一个像素点的对应视差值重新进行精确匹配,得到精匹配的高密度视差图。

21.优选的,一种基于人脸面形空间分布的无需相位展开三维人脸重建算法中,每个像素点的粗视差值的误差小于一个光栅条纹周期,即

22.一种基于人脸面形空间分布的无相位展开三维人脸建模系统,其特征在于,包括一个控制单元,以及与所述控制单元通讯连接的光场投影装置、2个成像系统,所述成像系统在外触发信号作用下同步采集受人脸表面调制的变形条纹图像序列,并传送至所述控制单元,所述控制单元用于控制协调的所述光场投影装置、成像系统的工作流程,以使所述系

统能够执行上述基于人脸面形空间分布的无需相位展开三维人脸建模方法。

23.综上所述,由于采用了上述技术方案,本发明至少具有以下有益效果:

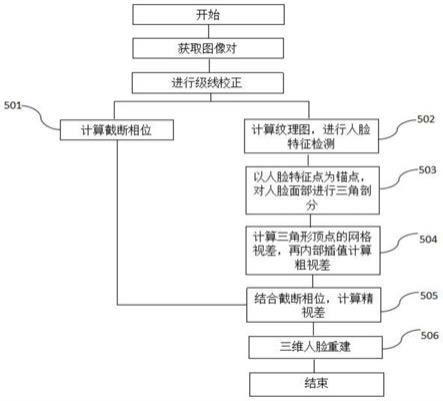

24.本发明基于人脸特征点对人脸面部进行三角剖分,首先计算每个三角形的顶点视差,生成网格视差图,再通过相关插值法生成粗视差,最后基于截断相位辅助粗视差进行精确匹配,生成高密度视差图,进而重建三维人脸。这种三维人脸重建方法,一方面无需投影附加结构光场或嵌入其它信号(如散斑三角波等),只需投影大于或等于3帧正弦相移图像即可完成三维人脸重建,大大节省了图像采集时间,降低了对动态场景的敏感度;另一方面,算法只依赖于从采集的图像中解析的人脸特征点信息、截断相位信息即可完成稠密视差图的计算,无需进行相位展开,算法简单可并行运算,大大节省了计算时间;此外,与传统方法相比,该方法不受投影的条纹频率、测量深度范围等限制,有较强的鲁棒性。因此,本专利中发明的方法可应用于精度及实时性要求均较高的动态三维人脸测量场合,在三维人脸识别领域中有着重要应用价值。

附图说明

25.图1是根据本发明示例性实施例的基于结构光投影装置的三维人脸重建系统原理图。

26.图2为根据本发明示例性实施例的一种典型条纹结构光投影拍摄时序图;

27.图3为根据本发明示例性实施例的三维人脸建模方法的流程图。

28.图4为根据本发明示例性实施例的由相移光栅条纹解析得到的截断相位图。

29.图5为根据本发明示例性实施例的candide 3人脸模型。

30.图6为根据本发明示例性实施例的由相移光栅条纹计算所得纹理图、人脸特征点检测图及基于candide 3的三角剖分图。

31.图7为根据本发明示例性实施例的网格视差图及粗视差图。

32.图8为根据本发明示例性实施例的由截断相位辅助粗视差图进行精确视差匹配的示意图。

33.图9为为本发明实施例的基于截断相位信息进行精确匹配的方法示意图。

34.图10为本发明实施例1所示得到三维人脸重建结果图。

35.图中标记:100

‑

光场投影装置,201

‑

左成像装置,202

‑

右成像装置,300

‑

所投影条纹结构光场(以3帧条纹结构光场为例),400

‑

控制单元。

具体实施方式

36.下面结合附图及实施例,对本发明进行进一步详细说明,以使本发明的目的、技术方案及优点更加清楚明白。应当理解,此处所描述的具体实施例仅用以解释本发明,并不用于限定本发明。

37.实施例1

38.一种基于人脸面形空间分布的无相位展开的三维人脸建模方法及系统如图1所示,包括以光场投影装置100、左成像装置201、右成像装置202、控制单元400。所述光场投影装置100投射可调图像数量的n(n≥3)幅正弦条纹结构光场序列300至人脸表面,同时输出同步控制信号给所述成像系统201

‑

202;所述成像系统201

‑

202工作于外触发状态,在光场

投影装置100所输出的同步控制信号控制下拍摄被正弦条纹结构光场300照明下的人脸表面作为建模图像传送至所述控制单元400;所述控制单元400控制协调三维人脸建模实现系统的工作流程,基于接收的调制图像序列完成三维人脸建模。以需投影3帧条纹结构光场为例,一种典型条纹结构光投影拍摄时序图如2所示。

39.所述三维人脸建模方法的流程图如图3所示,包括如下步骤:

40.步骤500,三维人脸建模方法实现系统拍摄条纹结构光场照明下的人脸图像得到6张条纹图,左右相机各3张,并对左右相机拍摄的条纹图依据系统标定信息进行极线校正。

41.步骤501,当正弦条纹投影于三维物体表面上时,拍摄到的变形条纹为:

[0042][0043]

其中,(x,y)为像素坐标;r(x,y)是人脸表面反射率的分布;a(x,y)为背景光强,b(x,y)/a(x,y)表示了条纹的对比度;φ(x,y)是表示条纹结构光场所蕴含的相位信息;n为编码φ(x,y)所选用的条纹图数目,表相移次数;n为条纹图序号,表第n次相移,其取值范围为1到n。

[0044]

对于n步相移的相位测量轮廓术,人脸表面纹理图像可由对应的n幅条纹生成。以用3帧条纹结构光场投影时为例,当n等于3时,拍摄到变形条纹为:

[0045]

i1(x,y)=r(x,y)[a(x,y)+b(x,y)cos(φ(x,y)+α](2)

[0046]

i2(x,y)=r(x,y)[a(x,y)+b(x,y)cos(φ(x,y)](3)

[0047]

i3(x,y)=r(x,y)[a(x,y)+b(x,y)cos(φ(x,y)

‑

α](4)

[0048]

利用最小二乘法分别解析图像中所蕴含的拥有

‑

π到π(或0~2π)跳变边缘的截断相位信息,得到截断相位,通过公式(2)~(4)计算得:

[0049][0050]

步骤502,分别解析所述2台成像装置201

‑

202所拍摄建模图像中所蕴含的纹理信息,形成纹理图像对,并检测人脸特征点,人脸特征点检测为任意方法,如dlib,seetaface,baiduapi等;以基于dlib库在纹理图像对上分别进行人脸特征点检测为例,共检测68个特征点。通过公式(2)~(4),纹理图可通过以下公式计算:

[0051][0052]

当使用3帧条纹结构光场投影时,计算所得的纹理图如图4所示。对于n不等于3的情况,各帧条纹图的系数需做相应变化。

[0053]

步骤503,以检测的68个人脸特征点为锚点,采用三角剖分法,得到面部的三角面形,用于描述人脸的基本轮廓。以选择candide 3模型为例,通过识别人脸特征点,进行快速的低精度的模型构建,得到基于candide 3的三角面形,具体的,其包含113点,并把这些点有顺序的链接成三角形网格状,其中每一个三角形称为一个面片,共计184个面片。模型可以被描述为:

[0054]

[0055]

其中,s为放大系数,r=r(r

x

,r

y

,r

z

)为旋转矩阵,为标准模型,a为运动单元,s为形状单元,t

a

,t

s

分别为其对应的变化参数。t=t(t

x

,t

y

)为模型在空间上的转换向量,g为期望得到的人脸模型。

[0056]

其中,candide 3人脸模型如图5所示,得到的纹理图、人脸特征点检测图及基于candide 3的三角剖分图如图6所示。

[0057]

步骤504,基于上述三角面形的113个顶点坐标以及184个面片,根据公式d=x

l

‑

x

r

求取每个顶点的视差值,再对每条边进行线性差值,得到网格视差图,再采用相关插值算法,以顶点视差值为基准,计算三角形内部每个像素点的视差值,以此形成粗视差图,插值方法可以为但不限于单线性插值法、双线性插值法、曲线插值法以及计算机图形学中的重心坐标法等;以计算机图形学中的重心坐标法为例,得到的网格视差图及粗视差图如图7所示。

[0058]

具体的,所述实施例中的重心坐标法,即寻找三角形s顶点v1,v2,v3对应的权重。重心坐标提供了一个将顶点信息平滑地插入三角面内部点的工具,内部点的插值是顶点处参数值的一个简单线性组合,组合的权值为该点的重心坐标。

[0059]

令s={v1,v2,v3}是一个仿射无关集,则对应三角形平面s中每一个点p,p的唯一表达式为:

[0060]

p=c1v1+c2v2+c3v3且,c1+c2+c3=1(8)

[0061]

则,c1,c2,c3称为p的重心坐标(或者称为仿射坐标)。观察(8)式等价于单个方程:

[0062][0063]

式(9)包含所有点的齐次形式,对(9)式的增广矩阵做行简化即可得到p的重心坐标,将重心坐标对应系数权重带入三个顶点的视差值d

v1

,d

v2

,d

v3

,就得到对p点的视差插值dp,即:

[0064]

dp=c1d

v1

+c2d

v2

+c3d

v3

(10)

[0065]

步骤505,基于截断相位信息辅助面部每个像素点对应的粗视差重新进行精确匹配,得到高密度精确视差图,由截断相位辅助粗视差图进行精确视差匹配的示意图如图8所示。

[0066]

具体的,基于截断相位信息进行精确匹配的方法,设粗视差图中某像素点p(u1,v1)的视差值为d,是左相位中匹配像素点x1(u1,v1)的相位值,是右相位中匹配像素点x2(u2,v2)的相位值,则根据视差计算公式,u2=u1‑

d。由于截断相位中某一行上每个单周期(

‑

π~π)内的相位信息都是单调递增的,即假如所以由点x2开始向右搜索第一个相位值大于的辅助匹配点,记为x3(u3,v3),其对应相位值为则通过单线性插值公式(10)就可以得到亚像素匹配点x的列坐标u,如图9所示;假如则通过式(11)来得到亚像素匹配点x的列坐标u。最后,再根据d=u1‑

u,即可求得精确视差值。

[0067]

[0068][0069]

步骤506,基于所述精视差图,结合系统标定信息完成高精度三维点云计算,三维人脸重建结果图如图10所示。

[0070]

以上所述,仅为本发明具体实施方式的详细说明,而非对本发明的限制。相关技术领域的技术人员在不脱离本发明的原则和范围的情况下,做出的各种替换、变型以及改进均应包含在本发明的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1