一种基于多尺度级联的糖尿病视网膜病变分级方法

1.本发明涉及计算机视觉领域以及医疗领域,特别是涉及一种基于多尺度级联的糖尿病视网膜病变分级方法。

背景技术:

2.糖尿病视网膜病变(diabetic retinopathy,dr)是一种由糖尿病微血管恶化导致的一种眼底并发症,并且最终会造成视觉缺陷或出现不可逆失明。糖尿病视网膜病变的病理特征主要包括以下几类:微动脉瘤、出血、硬渗出物和软渗出物。根据其类型和眼底图像出现的病变数量,国际临床糖尿病视网膜病变分级标准将糖尿病视网膜病变分五个阶段:无明显糖尿病视网膜病变、轻度非增值性糖尿病视网膜病变、中度非增值性糖尿病视网膜病变、重度非增值性糖尿病视网膜病变、增值性糖尿病视网膜病变。在目前临床诊断中,dr分级主要依靠眼科医生检查眼底彩色图像。由于dr患者数量庞大,经验丰富的眼科医生较少,给数量有限的眼科医生带来了巨大的负担;并且随着糖尿病患者数量的增加,眼底图像的数量越来越多,越来越难以人工实时分析。因此,有必要使用计算机辅助诊断,以减轻眼科医生的负担和检查时间,使患者及时了解自己的病情。

3.卷积神经网络(convolutional neural networks,cnn)将特征提取与分类端到端相结合,在图像分类、目标检测、语义分割等任务上取得了重大突破。由于cnn具有强大的高水平特征提取能力和表征能力,它也被广泛应用于视网膜血管分割等医学图像分析任务中。但是五个dr等级在颜色和纹理上非常相似,因此在分级任务中很容易出现混淆,这对不同级别间的多样性产生了不利影响。其次,眼底图像中有些病变非常小,只有几个像素,如图3所示。这些小病变在卷积过程中很容易被忽略,会对最终的dr分级结果造成影响。

4.因此,亟需一种针对颜色和纹理非常相似的糖尿病视网膜病变分级方法来有效提高其分级效果成为研究人员热门的话题。

技术实现要素:

5.本发明的目的是提供一种基于多尺度级联的糖尿病视网膜病变分级方法,通过提取多尺度信息的方式减少浅层信息的丢失,并通过级联的方式对浅层信息和高层信息进行信息之间的融合,利用不同尺度信息之间的互补性来增强对信息的获取,结合多尺度和级联能有效提高dr的分级效果,具有一定的临床意义及算法意义。

6.为实现上述目的,本发明提供一种基于多尺度级联的糖尿病视网膜病变分级方法,具体包括以下步骤:

7.s1、将采集带有标签的糖尿病视网膜病变眼底图像作为原始数据集;并将所述原始数据集按照比例划分为训练集和测试集;

8.s2、构建res2net网络模型,并设置所述res2net网络模型的输入批量大小参数;

9.s3、根据所述输入批量大小参数,将所述训练集输入到所述res2net网络模型中进行训练,并采用sgd优化器进行优化,得到训练完成的res2net网络模型;

10.s4、将所述测试集输入到所述训练完成的res2net网络模型中进行预测,将输出的预测结果与真实标签作比对,得到尺度级联网络糖尿病视网膜病变分级模型;

11.s5、利用所述尺度级联网络糖尿病视网膜病变分级模型对糖尿病视网膜病变进行分级,并利用图像分类度量指标对分级效果进行综合评价。

12.优选的,所述原始数据集采用的是kaggle上的aptos 2019blindness detection公开数据集。

13.优选的,所述原始数据集是按照8:2比例随机抽样组合的方式划分为训练集和测试集。

14.优选的,所述输入批量大小参数为20;所述输入批量大小参数是按照随机抽取方式对所述训练集进行抽取。

15.优选的,所述res2net网络模型是采用多尺度训练策略来训练网络,以进行信息互补。

16.优选的,所述多尺度训练策略具体为:

17.步骤1:对所述res2net网络进行预训练;

18.步骤2:采用imagenet对预训练后的res2net网络进行特征提取;

19.步骤3:在所述预训练后的res2net网络中添加注意力模块和感受野模块,获得多尺度特征;

20.步骤4:基于多尺度训练策略,将所述多尺度特征通过聚合模块进行信息融合,得到训练完成的res2net网络。

21.优选的,所述步骤2具体为:

22.采用imagenet对预训练后的res2net网络的前五层提取两组低层特征f0、f1和三组高层特征f2、f3、f4。

23.优选的,所述步骤3具体为:

24.在所述预训练后的res2net网络第一层中添加该注意力模块,所述f0通过所述注意力模块得到增强的特征图a0;在所述预训练后的res2net网络中第二、三、四、五层分别添加感受野模块,所述f1、f2、f3、f4均通过所述感受野模块依次获得多尺度特征图f'1、f'2、f'3、f'4。

25.优选的,所述步骤4具体为:

26.所述a0依次与所述f'1、f'2、f'3、f'4通过聚合模块得到特征图a1、a2、a3、a4;然后再将所述a0依次与所述a1、a2、a3、a4进行相加,分别得到a1、a2、a3、a4,得到训练完成res2net网络。

27.优选的,所述s4中,对所述训练完成的res2net网络模型中进行预测方法具体为:

28.将所述a1、a2、a3、a4进行通道相加操作来进行信息融合;然后对融合后的特征进行全局平均池化输出一个结果,把一个w*h*c的张量变成1*1*c的张量;最后通过全连接层将输出结果映射到真实标签空间中来对分类结果进行预测。

29.与现有技术相比,本发明具有以下技术效果:

30.本发明使用多尺度级联的方式来对dr图像进行的分类,一方面利用提取多尺度特征来多保留更多的细节信息,防止信息在传播的过程中出现丢失,另一方面使用级联的方式将底层空间信息和高层语义信息进行融合,实现网络中的信息互补,提高网络的性能。

附图说明

31.为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动性的前提下,还可以根据这些附图获得其他的附图。

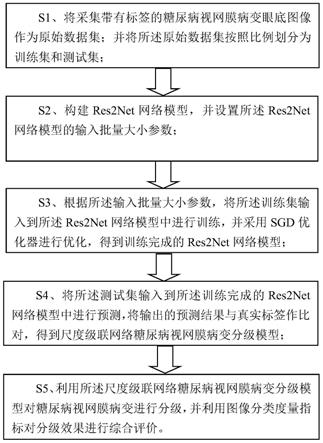

32.图1为本发明方法流程图;

33.图2为本发明多尺度级联网络糖尿病视网膜病变分级模型示意图;

34.图3为本发明糖尿病视网膜病变眼底图像的小病变示例图;其中,(a)为眼底图像的小病变原始图;(b)为眼底图像的小病变标注图;

35.图4为本发明聚合模块网络示意图。

具体实施方式

36.下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

37.为使本发明的上述目的、特征和优点能够更加明显易懂,下面结合附图和具体实施方式对本发明作进一步详细的说明。

38.实施例1

39.参照图1所示,本发明提出一种基于多尺度级联的糖尿病视网膜病变分级方法,具体包括以下步骤:

40.s1、将采集带有标签的糖尿病视网膜病变眼底图像作为原始数据集;并将所述原始数据集按照比例划分为训练集和测试集;

41.所述原始数据集采用的是kaggle上的aptos 2019blindness detection公开数据集。

42.所述原始数据集是按照8:2比例随机抽样组合的方式划分为训练集和测试集,以减少网络的随机误差。

43.s2、构建res2net网络模型,并设置所述res2net网络模型的输入批量大小参数;

44.s3、根据所述输入批量大小参数,将所述训练集输入到所述res2net网络模型中进行训练,并采用sgd优化器进行优化,得到训练完成的res2net网络模型;

45.所述输入批量大小参数为20;所述输入批量大小参数是按照随机抽取方式对所述训练集进行抽取。

46.s4、将所述测试集输入到所述训练完成的res2net网络模型中进行预测,将输出的预测结果与真实标签作比对,得到尺度级联网络糖尿病视网膜病变分级模型;

47.所述res2net网络模型是采用多尺度训练策略来训练网络,以进行信息互补。

48.参照图2所示,所述多尺度训练策略具体为:

49.步骤1:对所述res2net网络进行预训练;

50.步骤2:采用imagenet对预训练后的res2net网络进行特征提取;

51.对于输入的眼底图像训练集,采用imagenet对预训练后的res2net网络的前五层

提取两组低层特征f0、f1和三组高层特征f2、f3、f4。

52.步骤3:在所述预训练后的res2net网络中添加注意力模块和感受野模块,获得多尺度特征;

53.在所述预训练后的res2net网络第一层中添加该注意力模块,即所述f0通过所述注意力模块得到增强的特征图a0;其中,注意力模块(squeeze

‑

and

‑

excitation,se)可以学习通道之间的相关性,提取主要特征,提高网络的学习能力。在所述预训练后的res2net网络中第二、三、四、五层分别添加感受野模块(receptive field block,rfb),所述f1、f2、f3、f4均通过所述感受野模块依次获得多尺度特征图f'1、f'2、f'3、f'4,至此获得了网络的多尺度特征。

54.步骤4:基于多尺度训练策略,将所述多尺度特征通过聚合模块进行信息融合,得到训练完成的res2net网络,参照图4所示。

55.所述a0依次与所述f'1、f'2、f'3、f'4通过聚合模块得到特征图a1、a2、a3、a4;然后再将所述a0依次与所述a1、a2、a3、a4进行相加,分别得到a1、a2、a3、a4,得到训练完成res2net网络。

56.参照图4所示,使用聚合模块将第一层获得的特征图a0与后一层的特征图f'1进行融合,经过聚合模块获得特征图a1,然后再将特征图a0和特征图a1进行相加获得a1,依次类推。即让前一层的特征a

i

(i=0,1,2,3)与后一层的特征f’i+1

(i=1,2,3,4)通过聚合模块进行特征之间的信息融合获得a

i

(i=1,2,3,4),然后再将特征图a

i

(i=0,1,2,3),和特征图a

i

(i=1,2,3,4),进行相加获得a

i+1

(i=0,1,2,3),至此完成多尺度级联。通过这种级联的方式将底层空间信息和高层语义信息进行信息融合,达到信息互补的效果,提高网络的性能。

57.s5、利用所述尺度级联网络糖尿病视网膜病变分级模型对糖尿病视网膜病变进行分级,并利用图像分类度量指标对分级效果进行综合评价。

58.所述训练完成的res2net网络模型中进行预测方法具体为:

59.将所述a1、a2、a3、a4直接进行通道相加操作来进行信息融合;然后对融合后的特征进行全局平均池化输出一个结果,把一个w*h*c的张量变成1*1*c的张量,其中w为宽度(width)、h为高度(height)、c为通道(channel);最后通过全连接层将输出结果映射到真实标签空间中来对分类结果进行预测。

60.为了验证技术效果,本发明将kaggle上的aptos 2019blindness detection公开数据集作为基于多尺度级联的糖尿病视网膜病变分级方法的数据集,共3662张图像。从中随机选择20%作为测试集,剩余80%作为训练集。其中训练集有2930张图像,测试集有732张图像。数据集的划分如表1所示。

61.表1

62.数据集训练集测试集3662张2930张732张

63.本发明的网络模型在pytorch平台上实现,图像为jpeg格式。由于图像拍摄问题和图片尺寸不统一,因此,需要对图片进行裁剪,统一裁剪成352*352的大小,输入到网络,并采用多尺度训练策略提高网络的泛化能力,采用多尺度级联进行信息互补来训练网络。网络模型使用sgd优化器,学习率设置为0.01,网络使用批量大小为32,迭代次数为60。网络训练结束后,用732张有标签数据进行测试,将网络的预测分类结果和真实标签进行比对,计

算分级的准确率。网络采用的评价指标是被广泛使用的图像分类度量指标:accuracy准确率系数。accuracy的值越接近于1,表示算法预测的分级效果越好,能够对各个级别的图片进行准确分级。

64.本发明提出的方法在公开的aptos 2019blindness detection数据集上进行测试。实验结果表明,由本发明计算得出的accuracy为0.83,效果较单独使用res2net5提高了2%。

65.以上所述的实施例仅是对本发明的优选方式进行描述,并非对本发明的范围进行限定,在不脱离本发明设计精神的前提下,本领域普通技术人员对本发明的技术方案做出的各种变形和改进,均应落入本发明权利要求书确定的保护范围内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1