一种基于方向特征增强的书法图像风格分类方法

1.本发明属于人工智能领域,具体涉及一种基于方向特征增强的书法图像风格分类方法。

背景技术:

2.中国书法作品是文化瑰宝,具有重要的研究价值。在中华文化发展的历史中留下了难以计数,内涵丰富的书法字体。我国古代著名的楷书四大家:欧阳询,颜真卿,柳公权,赵孟頫。他们所创的书法风格:欧体,颜体,柳体,赵体影响深远,至今仍被许多人喜欢和临摹。

3.这四种书法风格本质属于楷体书法。他们之间笔画的特征差别较小,这对于未经训练过的人来说难以分辨。如果寻找有经验的书法家来完成四种书法风格之间的分类工作,相当耗费人力。

4.在此之前虽然有使用卷积神经网络(cnn)等方法来自动分类四种书法风格,但是分类结果的精度还有继续提升的空间。随着cnn结构的不断发展,很多研究已经表明随着cnn层数的增加,深度卷积神经网络(dcnn)从图像中学习到的特征更加丰富。然而它们学习特征的行为被认为是黑盒子,通常忽略了一些特定领域的先验信息。

技术实现要素:

5.本发明的目的在于克服上述不足,提供一种基于方向特征增强的书法图像风格分类方法,解决了现有技术中存在的书法风格分类准确率不高的问题,并提高分类模型的泛化能力。

6.为了达到上述目的,本发明包括以下步骤:

7.s1,提取不同的书法风格的原始图像,组成数据集,并分成训练集和测试集;

8.s2,构建深度卷积神经网络dcnn;

9.s3,采用2d-gabor滤波器对训练集图像进行八个方向的特征提取,转换为方向特征图像;

10.s4,将s3中提取的方向特征图像与原始图像一起送入到s2构建的深度卷积神经网络dcnn中进行训练;

11.s5,每训练固定次数后,将训练后的深度卷积神经网络dcnn在测试集上进行测试,得到每次的测试准确率,选取准确率最高的权重参数以及对应的深度卷积神经网络dcnn作为最终书法风格分类的分类器。

12.s1的具体步骤如下:

13.利用最小包围盒切算法从不同的书法风格的整幅作品中分割出单个字符图像,每种书法风格的书法字符图像数量相等;

14.将每种书法风格的书法字符图像按预设比例分为训练集和测试集。

15.s2中,深度卷积神经网络dcnn包括卷积层conv、最大池化层maxpool、批量归一化

层bn、relu非线性激活函数、注意力模块cbam、全局平均池化层global average pool、全连接层fc和非线性激活函数softmax。

16.s3中,2d-gabor滤波器通过如下公式对训练集图像进行八个方向的特征提取:

[0017][0018]

其中,x和y为输入图像的像素,α为滤波器的旋转角度,θk为旋转的八个不同的方向,k取0,1,2...7,β的计算方法如下:

[0019][0020]

g1的计算方法如下:

[0021][0022]

将八个方向提取的特征图转化为方向特征图像的具体方法如下:

[0023]

f(x,y,α,θk)=i(x,y)*g(x,y,α,θk)

[0024]

其中,i(x,y)为输入图像,g(x,y,α,θk)为2d-gabor滤波器,f(x,y,α,θk)为转化后的方向特征图像。

[0025]

s4中,将不同卷积核窗口的大小生成的方向特征图像与原始图像串连接,构建成多通道数的增强图像,将多通道数的增强图像输入深度卷积神经网络dcnn中进行训练。

[0026]

多通道数的增强图像的表达式为:

[0027]n×n×9[0028]

其中,n

×

n为多通道数的增强图像的空间大小,9为多通道数的增强图像的通道数。

[0029]

s5中,训练次数为200次,atch size为32,learning rate为0.0001,损失函数选择交叉熵损失函数,并且使用小批量梯度下降算法优化深度卷积神经网络。

[0030]

s5中,保存每一次的测试准确率所对应的深度卷积神经网络的权重参数,测试准确率最高的深度卷积神经网络以及对应的权重参数共同组成最终的书法风格分类的分类器。

[0031]

与现有技术相比,本发明提取不同的书法风格的原始图像,将收集好的原始图像分为训练集和测试集,使用2d-gabor滤波器对训练集图像中的每一张图像进行八个方向的方向特征提取,然后将提取到的方向特征对原始图像进行增强,输入深度卷积神经网络中进行训练,每训练一定次数,将深度卷积神经网络在测试集上进行测试,得到测试准确率,将其中最高的测试准确率对应的权重参数保存下来,和深度卷积神经网络组成最终的书法风格分类器。本发明采用2d-gabor滤波器提取书法图像方向特征映射作为先验知识,来增强原始图像的特征表示,从而使本发明不仅具有较高的分类准确率,同时具备较好的泛化能力。

附图说明

[0032]

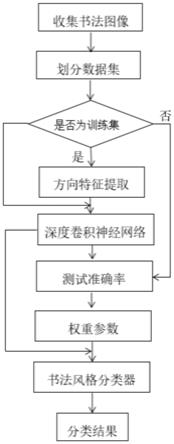

图1为本发明的流程图;

[0033]

图2为本发明中的深度神经网络结构图;

[0034]

图3为本发明中使用2d-gabor滤波器提取书法字体方向特征来增强原始图像的流程图。

具体实施方式

[0035]

下面结合附图对本发明做进一步说明。

[0036]

实施例:

[0037]

参见图1,本发明包括以下步骤:

[0038]

s1,获取欧体、颜体、柳体和赵体四种书法风格的图像,组成数据集并分成训练集和测试集;

[0039]

s11,利用现有的最小包围盒切算法从四位书法家的整幅楷书作品中分割出单个字符图像,每种风格的书法字符图像数量相等;

[0040]

s12,将每种风格的书法字符图像按3:1的比例分成训练集和测试集;

[0041]

s2,构建深度卷积神经网络dcnn,深度卷积神经网络dcnn的结构和参数如图2所示;

[0042]

深度卷积神经网络dcnn包括卷积层conv、最大池化层maxpool、批量归一化层bn、relu非线性激活函数、注意力模块cbam、全局平均池化层global average pool、全连接层fc和非线性激活函数softmax。

[0043]

深度卷积神经网络dcnn的网络参数由它里面每一个层的参数组成,conv层中的k表示卷积核窗口的大小,n表示卷积核组的数量,s表示卷积核的步长,bn表示对卷积层的输出结果批量归一化,relu表示对卷积层的输出结果使用relu激活函数。maxpool层中的k表示池化窗口的大小,s表示池化窗口的步长。cbam注意力模块中,r表示衰减率,n表示卷积核组的数量。

[0044]

s3,采用2d-gabor滤波器对训练集图像进行八个方向的特征提取,转换为方向特征图像;

[0045]

s31,对训练集图像进行八个方向的特征提取:

[0046][0047]

其中,x和y为输入图像的像素,α为滤波器的旋转角度,θk为旋转的八个不同的方向,k取0,1,2...7,β的计算方法如下:

[0048][0049]

g1的计算方法如下:

[0050][0051]

将八个方向上的2d-gabor滤波器对输入图像进行滤波得到方向特征图,具体方法如下:

[0052]

f(x,y,α,θk)=i(x,y)*g(x,y,α,θk)

[0053]

其中,i(x,y)为输入图像,g(x,y,α,θk)为2d-gabor滤波器,f(x,y,α,θk)为转化

后的方向特征图像。

[0054]

s4,将s3中获得的方向特征图像与原始图像一起输入到s2构建好的深度神经网络dcnn中训练200个epoch;

[0055]

s41,将s3中得到的不同卷积核窗口的大小k产生的方向特征图与原始图像串连接起来,即构建一个n

×n×

9大小的多通道数的增强图像,将其作为s2构建的深度卷积神经网络dcnn的输入值。其中,n

×

n是多通道数的增强图像的空间大小,9为多通道数的增强图像的通道数。

[0056]

s42,深度卷积神经网络的训练参数epoch为200,batch size为32,learning rate为0.0001;损失函数选择交叉熵损失函数,并且使用小批量梯度下降算法优化深度卷积神经网络。

[0057]

s5,每训练固定次数后,将训练后的深度卷积神经网络dcnn在测试集上进行测试,得到每次的测试准确率,一共得到200个测试结果,同时保存每一次测试时深度卷积神经网络的权重参数,在200个测试结果中,选取准确率最高的权重参数以及对应的深度卷积神经网络dcnn作为最终书法风格分类的分类器。

[0058]

本实施例将四种楷体书法风格,欧体,颜体,柳体,赵体进行了更高精度的分类。解决了现有技术中存在的书法风格分类困难的问题,进一步提高分类的准确率。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1