施工现场人员属性检测方法、系统、装置及介质与流程

1.本发明涉及图像目标检测技术领域,具体地,涉及一种远近结合的施工现场人员属性检测方法、系统、装置及介质。

背景技术:

2.人员属性检测是施工场所保证施工安全的重要环节。建筑业属于生产安全事故频发的行业。依据《企业职工伤亡事故分类》(gb 6441—86),对我国建筑业近十年出现的生产安全事故进行统计分析,其中起重伤害、坍塌、机械以及物体打击一共发生1 041起,占事故总数的50.42%。人员属性不合规范的情况诸如未佩戴安全帽、在易燃场所吸烟等会给施工现场带来严重的安全隐患。因此,针对工人的人员属性是否规范进行检测,及时进行信息上报与预警,是防止生产安全事故的重要手段。

3.建筑业相对于其他行业,安全管理主要依赖管理人员的主观监测,受人员流动性、环境动态性以及生产过程复杂性等因素,导致人工检测效率低下、速度慢、成本高昂且信息不易集成等问题。因此,需要对建筑施工场所的安全管理办法进行创新提升。

4.近年来,随着计算机视觉技术的不断发展,将基于深度学习的目标检测技术应用于工业生产成了研究热点。基于深度学习的目标检测算法在近年来取得许多重大突破,r-cnn算法是利用深度学习进行目标检测的开山之作,通过在输入图像上进行选择性搜索获得候选区域送入神经网络中提取特征,再将特征送入到svm进行分类。spp-net算法将特征金字塔池化引入特征提取网络以实现任意图像大小的输入。fast r-cnn算法通过先提取特征图再将候选区域在最后一层映射的方式,避免了特征的重复运算。faster r-cnn算法将特征提取、候选区域提取、边界框的位置回归和分类都结合到了一个统一网络,解决了计算瓶颈。同时,进行目标框类别和位置回归的单阶段检测器应运而生。yolo算法开创性地将目标检测转化为单阶段的回归问题,采用一个统一网络同时进行边界框位置坐标和类别的回归,大大缓解了之前两阶段检测速度低下的问题。yolov2、yolov3、yolov4和yolov5算法,通过设计更深更鲁棒的网络,并融入了一系列目标检测前沿的优化技巧,达到了检测精度和速度平衡的最优解。基于深度学习的目标检测技术可以自主学习施工人员与人员属性的特征,学习到的特征鲁棒性强、适应性高,因此检测精度高。并且检测速度快,可以实现实时处理。因此基于深度学习的目标检测在速度、精度、适应性等方面有很大的发展空间。

5.但是,目前工业生产中应用深度学习进人员属性检测的实际落地项目较少,且尚不存在对较大施工场景下的小尺度人员属性对象专门设计并优化的目标检测技术。现有的一些通用目标检测算法应用在小尺度、低分辨率下的人员属性检测任务中性能不够理想。针对大型施工场景下的人员属性检测存在诸多难点。首先受限于拍摄视角与拍摄距离,实际采集的图像中人员属性的尺寸较小、分辨率低下。其次人员属性不易与复杂的施工背景进行区分,受建筑场所中的遮挡问题也容易造成大量误检。除此之外,在实际的应用场景中,实际投入使用中需要对监控图像进行实时检测与报警,对模型的推理速度、检测精度等方面存在较高要求,静态检测与已有检测模型在实际检测精度和速度等方面存在一定局

限,不能在人员属性检测任务中直接使用。

6.经检索,中国发明专利申请cn 110738178a,该专利公开了一种园区施工安全检测方法、装置、计算机设备及存储介质,其中方法包括:获取实时采集的园区施工现场的待检测图像;识别所述待检测图像中的人员图像;对所述人员图像进行行为检测,检测所述人员图像中是否存在违规行为,其中,所述违规行为是指预先定义的在所述园区施工现场禁止实施的行为;当检测到存在所述违规行为时,获取所述人员图像中的人脸图像;识别所述人脸图像对应的施工人员;记录所述施工人员对应的违规行为。该专利对园区施工场景采取移动物体检测融合人体识别的方式,人员检测的效率较低。再者,该专利采用内置跟踪算法对移动物体进行追踪,在每次跟踪时均需要人工地对视野中的目标进行框选初始化,增加人力成本。此外,该专利同时需要在施工现场的各个地区布设摄像机,每个摄像机只关注局部视野,成本较高。采用单路摄像机如何兼顾局部与全局视野,仍然是一个研究难题。

7.因此,如何解决目前人员属性检测方法的不足,并构建出一套完整的系统和装置,来高效可靠地实现施工现场的人员属性检测,具有极高的研究价值和现实意义。

技术实现要素:

8.本发明针对以上场景中存在的问题,提出了一种远远近结合的施工现场人员属性检测方法、系统、装置及介质。

9.根据本发明的一个方面,提供了一种施工现场人员属性检测方法,包括:

10.获取待检测施工区域的巡检图像;

11.构建一级人员检测模型,将所述巡检图像输入至所述一级人员检测模型并进行目标人员识别,获得所述目标人员的所在区域图像,获取所述所在区域图像内的所述目标人员的像素尺寸大小以及置信度,并使得所述目标人员的尺度大小和置信度满足人员属性识别条件;

12.构建二级人员属性识别模型,将满足人员属性识别条件的所述目标人员的所在区域图像输入至所述二级人员属性识别模型并进行人员属性识别,得到所述目标人员的属性检测结果,并判断所述目标人员的属性检测结果是否符合施工安全规范,完成对施工现场人员的属性检测。

13.优选地,所述构建一级人员检测模型,包括:

14.获取包含人员的图像,对所述包含人员的图像进行人员标注,构建多尺度人员数据集;

15.将所述多尺度人员数据集进行数据增强处理,生成训练数据集;

16.对所述训练数据集进行聚类分析,并将聚类中心作为优化后的锚框值;

17.基于深度卷积神经网络,利用所述优化后的锚框值在所述目标检测模型头部网络获得的每个尺度的特征图之后增加注意力机制网络,获得优化后的目标检测模型;

18.将所述训练数据集输入至所述优化后的目标检测模型,对所述优化后的目标检测模型进行训练,构建得到具有多尺度的一级人员检测模型。

19.优选地,所述注意力机制网络,包括:

20.颈部网络单元,该单元采用双向特征金字塔颈部网络结构,对多个分支的不同尺度的特征图进行双向融合,实现多个尺度的特征增强;

21.多尺度注意力单元,该单元采用通道注意力与空间注意力相结合的结构,用于关注重点通道和重点空间位置的特征;

22.预测头单元,该单元采用多个头部网络对所述颈部网络单元的多个分支进行检测,并将多个尺度的检测结果进行合并和非极大值抑制的后处理,去除重叠框。

23.优选地,所述人员属性识别条件,包括:

24.所述目标人员的像素尺寸大于预设尺度阈值;

25.所述目标人员的置信度大于预设置信度阈值;

26.优选地,所述使得所述目标人员的尺度大小和置信度满足人员属性识别条件,包括:

27.判断所述目标人员的尺度大小和置信度是否满足人员属性识别条件;

28.若满足,则进行人员属性识别;

29.若不满足,则进行如下处理:

30.对所述目标人员进行跟踪和聚焦处理;

31.若跟踪与聚焦处理后的所述目标人员的尺度大小和置信度满足人员属性识别条件,则进行人员属性识别;

32.若跟踪与聚焦处理次数达到上限仍不满足人员属性识别条件,则视为未检测到人员。

33.优选地,所述对所述目标人员进行跟踪和聚焦处理,包括:

34.根据所述目标人员在所述巡检图像上的坐标位置,得到所述目标人员的检测框;

35.获取所述目标人员的所在区域图像与所述巡检图像中心区域之间的位置关系,确定图像采集设备的转动方向和幅度,并通过控制云台对图像采集设备进行转动处理,其中,所述转动方向由所述检测框中心与所述巡检图像中心的相对矢量方向决定;所述转动幅度由所述检测框中心与所述巡检图像中心的欧式距离决定;当所述欧氏距离小于设定像素时,图像采集设备的转动幅度为0,此时认为所述目标人员处于所述巡检图像中心区域,记所述目标人员的检测框中心为(x,y),所述巡检图像中心为(x

center

,y

center

),所述巡检图像尺寸为w*h,k为当前物距下调整相机单位移动距离的参数,在实际测试过程中进行确定,则转动时间转动速度v保持不变;根据转动时间来确定每次目标人员检测后图像采集设备的转动量,直至转动到预定位置,完成一次跟踪过程;

36.根据所述目标人员的尺度大小和置信度是否达到预设阈值来判断是否进行焦距拉近:当所述目标人员的尺度大小与置信度未达到预设阈值,则拉近焦距,然后进行自动聚焦;当所述目标人员的尺度大小与置信度达到预设阈值,则进行自动聚焦,完成一次聚焦过程;

37.基于跟踪和聚焦处理后图像,重新进行一级人员检测,并根据所述一级人员检测结果对图像采集设备的转动方向、幅度和焦距进行调整;重复执行跟踪和聚焦过程,直至所述目标人员的尺度大小和置信度满足人员属性识别条件或跟踪与聚焦处理次数达到上限,完成本轮跟踪和聚焦处理过程。

38.优选地,所述参数k的确定方法为:当跟踪目标的像素尺寸小于60*60像素时,k为

0.15;当跟踪目标的像素尺寸大于60*60像素小于100*100像素时,k为0.35,当跟踪目标的像素大于100*100像素小于250*250时,k为0.45;当跟踪目标的像素大于250*250像素时,k为0。

39.优选地,若跟踪与聚焦处理后的所述目标人员的尺度大小和置信度满足人员属性识别条件,还包括:

40.以最后一次跟踪和聚焦处理后图像中检出的目标人员所在区域,进行空间上下文扩充,获取扩充后目标人员所在区域的图像作为二级人员属性识别的输入图像。

41.优选地,所述构建二级人员属性识别模型,包括:

42.获取包含人员以及所述人员相关属性的图像,形成人员数据集;

43.对所述人员数据集进行数据增强处理,生成训练数据集;

44.将所述人员数据集输入至所述一级人员检测模型并进行目标人员识别,得到包含目标人员的图像数据;

45.对所述包含目标人员的图像数据进行截选和多次样条变换,形成新的图像数据集;

46.对所述新的图像数据集进行聚类分析,并将聚类中心作为优化后的锚框值;

47.基于深度神经网络建立属性识别模型,将所述训练数据集和所述优化后的锚框值输入至所述属性识别模型对所述属性识别模型进行训练,构建得到二级人员属性检测模型。

48.优选地,所述判断所述目标人员的属性检测结果是否符合施工安全规范,包括:

49.若符合施工安全规范,则所述目标人员的属性检测结果作为施工现场人员的属性检测结果;

50.若不符合施工安全规范,则对所述目标人员的属性检测结果进行包含时序滤波和检出框区域选择的后处理,得到的处理结果作为施工现场人员的属性检测结果。

51.优选地,所述进行包含时序滤波和检出框区域选择的后处理,包括:

52.对所述目标人员的属性检测结果进行连续多帧的相同位置人员的属性检测,完成时序滤波过程;

53.滤除距离所述目标人员的属性检测结果上下左右周界设定像素以内的检出框,完成检出框区域选择过程;其中:

54.所述检出框包括所述目标人员以及所述目标人员的相关属性标签。

55.根据本发明的另一个方面,提供了一种施工现场人员属性检测系统,包括:

56.图像获取模块,该模块用于获取待检测施工区域的巡检图像;

57.一级人员检测模块,该模块用于构建一级人员检测模型,将所述巡检图像输入至所述一级人员检测模型并进行目标人员识别,获得所述目标人员的所在区域图像,并获取所述所在区域图像内的所述目标人员的像素尺寸大小以及置信度,并使得所述目标人员的尺度大小和置信度满足人员属性识别条件;

58.二级人员属性识别模块,该模块用于构建二级人员属性识别模型,将满足人员属性识别条件的所述目标人员的所在区域图像输入至所述二级人员属性识别模型并进行人员属性识别,得到所述目标人员的属性检测结果,并判断所述目标人员的属性检测结果是否符合施工安全规范,完成对施工现场人员的属性检测。

59.根据本发明的第三个方面,提供了一种施工现场人员属性检测装置,包括:图像采集设备、云台控制部件以及控制终端;其中:

60.所述云台控制部件与所述图像采集设备驱动连接;

61.所述控制终端控制所述云台控制部件按照预设方向移动,进而控制所述图像采集设备转动及调焦;

62.所述控制终端包括存储器、处理器及存储在存储器上并可在处理器上运行的计算机程序,所述处理器执行所述程序时可用于执行上述任一项所述的方法,或,运行上述的系统。

63.根据本发明的第四个方面,提供了一种计算机可读存储介质,其上存储有计算机程序,该程序被处理器执行时可用于执行上述任一项所述的方法,或,运行上述的系统。

64.由于采用了上述技术方案,本发明与现有技术相比,具有如下至少一项的有益效果:

65.本发明提供的施工现场人员属性检测方法、系统、装置及介质,采用两级检测,即先采用人员检测模型检测人员,再通过截选人员区域并放大和插值的扩充方式去补充图像细节,再进行人员属性的检测;同时,针对小尺度的人员检测模型进行采用多尺度注意力机制等改进,有效提高了人员属性的检出率。

66.本发明提供的施工现场人员属性检测方法、系统、装置及介质,采用了远近结合的图像检测,基于图像采集设备的云台控制功能和一级人员检测模型的输出结果,实现了图像采集设备跟踪与调焦,使得图像采集设备在巡检过程中可以将镜头拉近到施工现场的人员附近,保持清晰且较大的人员图像,从而有效降低了系统的误报率。

67.本发明提供的施工现场人员属性检测方法、系统、装置及介质,可以满足施工现场实际的人员属性检测需求,从而可以在一定程度上代替人力劳动,节省人力成本。

附图说明

68.通过阅读参照以下附图对非限制性实施例所作的详细描述,本发明的其它特征、目的和优点将会变得更明显:

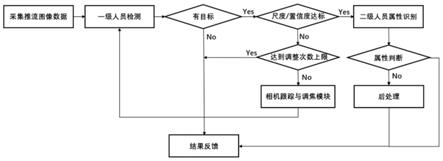

69.图1为本发明一实施例中施工现场人员属性检测方法的流程图。

70.图2为本发明一优选实施例中施工现场人员属性检测方法的流程图。

71.图3为本发明一优选实施例中人员检测模型以及多尺度注意力模块的结构示意图。

72.图4为本发明一实施例中施工现场人员属性检测系统的组成模块示意图。

73.图5为本发明一实施例中施工现场人员属性检测装置的组成结构示意图。

具体实施方式

74.下面结合具体实施例对本发明进行详细说明。以下实施例将有助于本领域的技术人员进一步理解本发明,但不以任何形式限制本发明。应当指出的是,对本领域的普通技术人员来说,在不脱离本发明构思的前提下,还可以做出若干变形和改进。这些都属于本发明的保护范围。

75.图1为本发明一实施例提供的施工现场人员属性检测方法的流程图。

76.如图1所示,该实施例提供的施工现场人员属性检测方法,可以包括如下步骤:

77.s100,获取待检测施工区域的巡检图像;

78.s200,构建一级人员检测模型,将巡检图像输入至一级人员检测模型并进行目标人员识别,获得目标人员的所在区域图像,获取所在区域图像内的目标人员的像素尺寸(即尺度)大小以及置信度,并使得目标人员的尺度大小和置信度满足人员属性识别条件;

79.s300,构建二级人员属性识别模型,将满足人员属性识别条件的目标人员的所在区域图像输入至二级人员属性识别模型并进行人员属性识别,得到目标人员的属性检测结果,并判断目标人员的属性检测结果是否符合施工安全规范,完成对施工现场人员的属性检测。

80.在该实施例的s200中,作为一优选实施例,构建一级人员检测模型,可以包括如下步骤:

81.s201,获取包含人员的图像,对包含人员的图像进行人员标注,构建多尺度人员数据集;

82.s202,将多尺度人员数据集进行数据增强处理,生成训练数据集;

83.s203,对训练数据集进行聚类分析,并将聚类中心作为优化后的锚框值;

84.s204,基于深度卷积神经网络,利用优化后的锚框值在目标检测模型头部网络获得的每个尺度的特征图之后增加注意力机制网络,获得优化后的目标检测模型;

85.s205,将训练数据集输入至优化后的目标检测模型,对优化后的目标检测模型进行训练,构建得到具有多尺度的一级人员检测模型。

86.在该实施例的s204中,作为一优选实施例,注意力机制网络,可以包括如下功能单元:

87.颈部网络单元,该单元采用双向特征金字塔颈部网络结构,对多个分支的不同尺度的特征图进行双向融合,实现多个尺度的特征增强;

88.多尺度注意力单元,该单元采用通道注意力与空间注意力相结合的结构,用于关注重点通道和重点空间位置的特征;

89.预测头单元,该单元采用多个头部网络对颈部网络单元的多个分支进行检测,并将多个尺度的检测结果进行合并和非极大值抑制的后处理,去除重叠框。

90.在该实施例的s200中,作为一优选实施例,人员属性识别条件,可以包括:

91.目标人员的像素尺寸大于预设尺度阈值,即巡检图像中目标人员的像素高度与像素宽度均大于预设像素阈值(尺度阈值)。像素尺寸大小达标可以使得人员属性尽可能清晰,便于进行人员属性识别。

92.目标人员的置信度大于预设置信度阈值,即巡检图像中目标人员置信度大于预设置信度阈值。置信度达标可以减少人员的误检,提高人员属性识别的准确率。

93.在该实施例的s200中,作为一优选实施例,使得目标人员的尺度大小和置信度满足人员属性识别条件,可以包括如下步骤:

94.判断目标人员的尺度大小和置信度是否满足人员属性识别条件;

95.若满足,则进行人员属性识别;

96.若不满足,则进行如下处理:

97.对目标人员进行跟踪和聚焦处理;

98.若跟踪与聚焦处理后的目标人员的尺度大小和置信度满足人员属性识别条件,则进行人员属性识别;

99.若跟踪与聚焦处理次数达到上限仍不满足人员属性识别条件,则视为未检测到人员。

100.进一步地,作为一优选实施例,对目标人员进行跟踪和聚焦处理,可以包括如下步骤:

101.s20i,根据目标人员在巡检图像上的坐标位置,得到目标人员的检测框;

102.s20ii,获取目标人员的所在区域图像与巡检图像中心区域之间的位置关系,确定图像采集设备的转动方向和幅度,并通过控制云台对图像采集设备进行转动处理,其中,转动方向由检测框中心与巡检图像中心的相对矢量方向决定;转动幅度由检测框中心与巡检图像中心的欧式距离决定;当欧氏距离小于设定像素时,图像采集设备的转动幅度为0,此时认为目标人员处于巡检图像中心区域,记目标人员的检测框中心为(x,y),巡检图像中心为(x

center

,y

center

),巡检图像尺寸为w*h,k为当前物距下调整相机单位移动距离的参数,在实际测试过程中进行确定,则转动时间转动速度v保持不变;根据转动时间来确定每次目标人员检测后图像采集设备的转动量,直至转动到预定位置,完成一次跟踪过程;其中,参数k的确定方法为:当跟踪目标的像素尺寸小于60*60像素时,k为0.15;当跟踪目标的像素尺寸大于60*60像素小于100*100像素时,k为0.35,当跟踪目标的像素大于100*100像素小于250*250时,k为0.45;当跟踪目标的像素大于250*250像素时,k为0;

103.s20iii,根据目标人员的尺度大小和置信度是否达到预设阈值来判断是否进行焦距拉近:当目标人员的尺度大小与置信度未达到预设阈值,则拉近焦距,然后进行自动聚焦;当目标人员的尺度大小与置信度达到预设阈值,则进行自动聚焦,完成一次聚焦过程;

104.s20iv,基于跟踪和聚焦处理后图像,重新进行一级人员检测,并根据一级人员检测结果对图像采集设备的转动方向、幅度和焦距进行调整;重复执行跟踪和聚焦过程,直至目标人员的尺度大小和置信度满足人员属性识别条件或跟踪与聚焦处理次数达到上限,完成本轮跟踪和聚焦处理过程。

105.进一步地,作为一优选实施例,若跟踪与聚焦处理后的目标人员的尺度大小和置信度满足人员属性识别条件,还可以包括如下步骤:

106.以最后一次跟踪和聚焦处理后图像中检出的目标人员所在区域,进行空间上下文扩充(放大和插值),获取扩充后目标人员所在区域的图像作为二级人员属性识别的输入图像。

107.在该实施例的s300中,作为一优选实施例,构建二级人员属性识别模型,可以包括如下步骤:

108.s301,获取包含人员以及人员相关属性的图像,形成人员数据集;

109.s302,对人员数据集进行数据增强处理,生成训练数据集;

110.s303,将人员数据集输入至一级人员检测模型并进行目标人员识别,得到包含目标人员的图像数据;

111.s304,对包含目标人员的图像数据进行截选和多次样条变换,形成新的图像数据

集;

112.s305,对新的图像数据集进行聚类分析,并将聚类中心作为优化后的锚框值;

113.s306,基于深度神经网络建立属性识别模型,将所述训练数据集和所述优化后的锚框值输入至所述属性识别模型对所述属性识别模型进行训练,构建得到二级人员属性检测模型;

114.s307,将训练数据集输入至优化后的属性识别模型,对优化后的属性识别模型进行训练,构建得到二级人员属性检测模型。

115.在该实施例的s300中,作为一优选实施例,目标人员的属性检测结果符合规范中的规范,可以包括:

116.施工现场人员正确佩戴安全帽:正确佩戴安全帽指人员头部佩戴未受到遮挡的安全帽。诸如手持安全帽、不包含安全帽上遮挡如雨伞、草帽等其他物品等情况均视为未正确佩戴安全帽。

117.施工现场人员未吸烟:未吸烟是指人员的手部未持香烟。

118.施工现场人员姿态正常:姿态正常是指人员的姿态未处于不平衡状态。诸如平躺、趴着、跌倒过程等图像均视为不平衡状态。

119.施工现场人员未聚集:未聚集是指在人员周围空间内的其他人员不超过6人。

120.在该实施例的s300中,作为一优选实施例,判断目标人员的属性检测结果是否符合施工安全规范,可以包括如下内容:

121.若符合施工安全规范,则目标人员的属性检测结果作为施工现场人员的属性检测结果;

122.若不符合施工安全规范,则对目标人员的属性检测结果进行包含时序滤波和检出框区域选择的后处理,得到的处理结果作为施工现场人员的属性检测结果。

123.进一步地,作为一优选实施例,进行包含时序滤波和检出框区域选择的后处理,可以包括如下步骤:

124.s30i,对目标人员的属性检测结果进行连续多帧的相同位置人员的属性检测,完成时序滤波过程;

125.s30ii,滤除距离目标人员的属性检测结果上下左右周界设定像素以内的检测框,完成检出框区域选择过程;其中:

126.检出框包括目标人员以及目标人员的相关属性标签。

127.本发明上述实施例提供的施工现场人员属性检测方法,通过远近结合的二级检测结构,将人员与人员属性进行分级检出,同时还可以利用图像采集设备跟踪与聚焦方法,联合检测算法形成远近结合的施工现场人员属性检测方法,有利于提高人员属性的检出率,降低误检率,从而满足施工场景下人员属性检测需求,节省人力成本,降低施工隐患。

128.图2为本发明一优选实施例提供的施工现场人员属性检测方法的流程图。

129.如图2所示,该优选实施例提供的施工现场人员属性检测方法,可以包括如下步骤:

130.s1,采集待检测施工区域的巡检图像。

131.s2,将s1中图像输入至一级人员检测模型中识别人员,定位其所在区域,获得人员所在区域图像,以及该人员目标的置信度。若未检测到人员,则进入s7。

132.s3,判断s2中得到的人员目标的尺度大小和置信度是否均满足二级人员属性识别的条件。若尺度与置信度满足二级人员属性识别条件,则进入s4,若尺度或置信度未满足二级人员属性识别条件,则进入s5。

133.s4,将s2中获得的人员所在区域图像输入至二级人员属性识别模型,进行人员属性识别,若人员属性符合规范,则进入s7。若人员属性不合规范,则进入s6。

134.s5,基于s2中得到的人员定位区域,采用图像采集设备跟踪与调焦方法,进行二级巡检,图像采集设备将对当前视角下识别出来的人员进行跟踪和聚焦处理,使得获得的图像中人员尺度更大,细节更清晰。若跟踪与聚焦处理后,人员置信度满足二级检测要求,则进入s2;若置信度未满足二级检测要求但图像采集设备调整次数达到上限,则视为未检测到人员,进入s7。

135.s6,对s4中得到的人员属性检测结果进行包含时序滤波和检出框区域选择的后处理,并进入s7。

136.s7,根据得到的人员检测与人员属性识别结果,对相应结果进行可视化与结果反馈处理。

137.在一优选实施例中,s2中,通过人员检测模型进行施工现场人员的检测,其中可以基于改进的yolov5l模型构造一个人员检测模型。当然,在其他实施例中,也可以采用其他的检测模型,并不限于yolov5l模型。

138.在一具体实施例中,s2中构建人员检测模型,可以参照以下操作:

139.s21,从公有数据集和施工现场中采集包含人员的图像,对与新采集的施工现场人员图像进行人员的矩形框标注,构建多尺度人员数据集。

140.s22,将s21数据集应用常规数据增强和马赛克增强的数据增强方法,获得增广后的人员数据集,并划分训练集和测试集。其中,常规数据增强包括随机翻转、裁剪和缩放等几何变换,以及模糊、锐化、噪声和色彩抖动等色彩变换。马赛克数据增强是通过随机取四张样本进行常规数据增强后分别组合拼接在一张图的四个方向,并对超出边界的部分进行裁剪。

141.s23,对s22数据集进行k-means聚类分析,取前3个聚类中心作为优化后的锚框值。

142.s24,利用但不限于yolov5l模型,针对人员尺度不一,且与背景区域视觉特征差异大的特点,在头部网络获得的每个尺度的特征图之后增加注意力机制网络。用于更好的提取人员特征,获得优化后的检测模型结构。具体的,参照图3所示,首先对输入图像通过yolov5l模型的骨干网络对输入图像进行多尺度特征图的提取,接着,在yolov5l模型尺度一特征图(下采样8倍)、尺度二特征图(下采样16倍)和尺度三特征图(下采样32倍)之后。然后将三个尺度的特征图通过颈部网络的双向特征金字塔结构进行多尺度特征的融合。然后在三个尺度上的特征图分别先后通过通道注意力单元和空间注意力单元。通道注意力单元首先采取空间上的全局平均和最大池化获得对各通道的描述符,然后通过简单的多级感知机学习各通道的重要性响应,并将该响应加权到特征图上。空间注意力则采取通道上的全局平均和最大池化获得各空间位置的描述符,然后通过简单的卷积层学习个空间位置的重要性响应,同样将该相应加权到特征图上。经过两次注意力加权的三个尺度的特征图将被送入输出头,获得最后的检测结果。人员检测模型以及多尺度注意力模块的结构如图3所示。

143.s25,将s21中的训练集输入至s24所属的优化模型中训练生成多尺度人员检测模型,并通过测试集。

144.s24中,多尺度注意力注意力机制网络,包括:

145.采用双向特征金字塔颈部网络结构对三个分支的不同大小的特征图进行双向融合,实现三个尺度的特征增强。

146.采用通道注意力与空间注意力结合的结构,使得模型更加关注重点通道和重点空间位置的特征。

147.采用三个头部网络对所述颈部网络的三个输出分支进行检测,保证小尺度人员的检出率,并将三尺度的检测结果进行合并和非极大值抑制的后处理,去除重叠框。

148.本优选实施例中,应用上述两种数据增强方法可以有效地增加样本的多样性,抑制过拟合,提高模型的泛化能力,同时降低训练过程中对显存资源的消耗。通过对数据集进行聚类得到优化锚框,可以提高模型学习效率。通过对yolov5l模型进行都多尺度的空间注意力和通道注意力等改进,可以提高模型对较小人员和难分辨人员的检测效果,增加一级人员检测的检出率。

149.在一优选实施例中,s4中,通过人员属性检测模型进行人员所在区域中的人员属性的定位识别,采用yolov5m模型构造一个人员属性检测模型。当然,在其他实施例中,也可以采用其他的检测模型,并不限于yolov5m模型。

150.在一具体实施例中,s4中构建人员属性检测模型,可以参考以下操作:

151.s41,从公有数据集和施工现场中采集包含人员与相关人员属性的图像。使用一级人员检测模型,对图像数据进行人员目标的提取,对含人员图像进行截选和包括但不限于三次样条上变换,形成新的高分辨率的图像数据。

152.s42,将s41数据集应用多种数据增强方法,获得增广后的人员属性数据集,并划分训练集和测试集。

153.s43,对s42数据集进行聚类分析,将聚类中心作为优化后的锚框值。

154.s44,采用s42中的训练集输入到优化后的yolov5m模型中,利用s43中的优化后的锚框值进行训练获得人员属性检测模型,设置输入图片的尺寸为288x288,并通过测试集对模型进行测试。

155.本优选实施例中,采用yolov5m模型构建人员属性检测模型,可以利用yolov5m模型参数少,高帧率等特点,同时缩小输入图像尺寸,进一步降低检测时间,实现人员属性的快速检测。

156.在一优选实施例中,s5中,通过图像采集设备跟踪与调焦方法来对一级检测中的模糊人员,小尺度人员进行放大和跟踪处理,为二级人员属性识别提供更加清晰的图像。由于施工现场环境复杂,图像采集设备架设角度高,大视野下的人员佩戴的人员属性并不清晰,这些样本会导致人员属性的漏检。因此,需要通过图像采集设备跟踪与调焦方法,将图像采集设备视角调整到模糊人员或小尺度人员的区域,并进行焦距拉大的处理,直到满足二级人员属性识别的要求。当然,在其他示例中,也可以采用其他的远近结合的检测方法,不限于图像采集设备跟踪与调焦的方法。

157.在一具体实施例中,s5中图像采集设备跟踪与调焦方法,可以参照以下操作:

158.s51,中断图像采集设备的巡检模式,进入二级巡检,二级巡检将s2中得到的人员

区域的尺度、置信度等信息作为图像采集设备跟踪与调焦方法的原始信息。

159.s52,进入跟踪过程,根据人员区域与图像中心区域之间的位置关系确定图像采集设备的转动方向和幅度,并通过控制云台对图像采集设备进行转动处理,具体的,转动方向由检测框中心与图像中心的相对矢量方向决定。而转动量则由检测框中心与图像中心的欧式距离决定。当欧氏距离小于200像素时则转动量为0,认为目标处于图像中心区域,记检测框中心为(x,y),图像中心为(x

center

,y

center

)。图像尺寸为wxh,k为当前物距下调整相机单位移动距离的参数,k在实际测试过程中进行确定。则时间转动速度v保持不变。根据转动时间来确定每次人员检测后图像采集设备的转动量。转动到预定位置后即进行s53。

160.在s52中,参数k的确定方法为:当跟踪目标的像素尺寸小于60*60像素时,k为0.15;当跟踪目标的像素尺寸大于60*60像素小于100*100像素时,k为0.35,当跟踪目标的像素大于100*100像素小于250*250时,k为0.45;当跟踪目标的像素大于250*250像素时,k为0。

161.s53,进入调焦过程,根据目标的尺度和置信度是否达到预设阈值来判断是否进行焦距拉近,当目标尺度与置信度未达标,则拉近焦距,每次拉近焦距的幅度为一个较小的固定值,拉近后进行0.2s的自动聚焦。而当目标尺度与置信度达标则进行0.2s的自动聚焦。

162.s54,每完成一次转动调焦过程即进行一次人员检测,根据人员检测结果再微调转动方向、幅度与焦距。上述s52,s53中的转动调焦反复进行,至到达到如下结束条件:检出的人员目标尺度与置信度达到预设阈值或转动调焦达到一个设定的次数上限;若检出的人员目标尺度与置信度达到预设阈值,则以最后一次转动调焦图像中检出的人员区域,进行适当的空间上下文扩充,抠出扩充后区域的图像作为二级人员属性识别的输入图像。若转动调焦达到次数上限且尺度与置信度未达到阈值,则视为未检出人员;

163.s55,在完成本轮检测后,图像采集设备将进入巡检模式,进入下一个预置点,开启新一轮的人员及其属性检测。

164.本优选实施例中,采用图像采集设备跟踪与调焦方法对图像采集设备视野进行调整,可以利用图像采集设备的云台控制功能,将关注点保留在难于区分具体属性的人员身上,获得分辨率更高、细节更丰富的图像数据,有效地搞了二级人员属性识别的检出率,规避了大量误报情况。

165.在一具体实施例中,对检测结果采用时序滤波与检出框位置筛选的方法进行后处理,可以参照以下操作:

166.s61,时序检测滤波:未检测出人员属性时进行连续5帧的相同位置人员的检测,若连续五帧内存在人员属性的检出,则认为该目标佩戴人员属性。该过程能够滤除因为遮挡等原因引起的误检。

167.s62,检出框位置筛选:滤除图像上下左右约200像素距离以内的检出框,即认为它们是误检。该过程能够避免图像周边区域因人员目标拍摄采集不完整等原因引起的误检误识。

168.s63,将经过上面两步筛选的未带人员属性目标作为检测结果进行结果反馈。

169.本优选实施例中,通过滤除边缘图片区域中的检出框,可以滤除因人员属性拍摄

不完整带来的误检,通过时序检测滤波,可以减缓因人员属性被遮挡二导致的误检,可以降低人员属性不合规范目标的误检率。

170.图4为本发明一实施例提供的施工现场人员属性检测系统的组成模块示意图。

171.如图4所示,该实施例提供的施工现场人员属性检测系统,可以包括图像获取模块、一级人员检测模块以及二级人员属性识别模块。其中:

172.图像获取模块,该模块用于获取待检测施工区域的巡检图像;

173.一级人员检测模块,该模块用于构建一级人员检测模型,将巡检图像输入至一级人员检测模型并进行目标人员识别,获得目标人员的所在区域图像,并获取所在区域图像内的目标人员的像素尺寸大小以及置信度,并使得目标人员的尺度大小和置信度满足人员属性识别条件;

174.二级人员属性识别模块,该模块用于构建二级人员属性识别模型,将满足人员属性识别条件的目标人员的所在区域图像输入至二级人员属性识别模型并进行人员属性识别,得到目标人员的属性检测结果,并判断目标人员的属性检测结果是否符合施工安全规范,完成对施工现场人员的属性检测。

175.在一优选实施例中,图像获取模块进行待检测图像的获取,并将采集到的图像数据输入至一级人员检测模块中。

176.在一优选实施例中,一级人员检测模块,使用多尺度的人员检测模型对待检测图像中的人员进行识别与定位,输出图像上人员所在的位置、置信度以及经过放大和三次样条插值后的人员区域图像。将人员位置和置信度进行图像采集设备跟踪与调焦,将经过放大与插值后的人员区域图像输入到二级人员属性检测模块。

177.在一优选实施例中,图像采集设备跟踪与调焦方法,包括:该模块被调用时,根据一级人员检测模块中输送过来的人员位置信息,计算确定图像采集设备转动方向和幅度,然后调用图像采集设备的云台控制模块进行相应角度和幅度的云台转动;转动完成后,即控制图像采集设备进行调焦与自动聚焦。聚焦完成后,重新进行一级人员检测,根据人员检测结果继续微调图像采集设备的转动方向,幅度与焦距。上述跟踪与调焦过程重复进行,直到达到如下两种结束条件:人员目标尺度与置信度达到阈值或者图像采集设备调整次数达到上限。人员目标尺度与置信度达到阈值后,将经过上下文扩充和分辨率上变换后的人员区域图像,输出到二级人员属性检测模块。转动调焦达到一个设定的次数上限且尺度与置信度未达到预设阈值时,则视为未检出人员,将检测信息进行后处理与结果反馈。

178.在一优选实施例中,二级人员属性检测模块,使用二级人员属性检测模型进行人员属性的检测,并将检测结果进行后处理与结果反馈。

179.在一优选实施例中,后处理与结果反馈方法,包括:对人员属性检测结果进行后处理,对边缘检测框进行滤除,对未检出人员属性的人员目标进行时序滤波,减少误检,并将检测结果进行反馈。

180.需要说明的是,本发明提供的方法中的步骤,可以利用系统中对应的模块、装置、单元等予以实现,本领域技术人员可以参照方法的技术方案实现系统的组成,即,方法中的实施例可理解为构建系统的优选例,在此不予赘述。

181.本发明上述实施例提供的施工现场人员属性检测系统,通过远近结合的二级检测结构,将人员与人员属性进行分级检出,同时开发图像采集设备跟踪与调焦模块联合检测

算法形成远近结合的施工现场人员属性检测方法,有利于提高人员属性的检出率,降低误检率,从而满足常规施工场景下人员属性检测需求,节省人力成本,降低施工隐患。

182.图5为本发明一实施例提供的施工现场人员属性检测装置的组成结构示意图。

183.如图5所示,该实施例提供的施工现场人员属性检测装置,可以包括:图像采集设备、云台控制部件以及控制终端;其中:

184.云台控制部件与图像采集设备驱动连接;

185.控制终端控制云台控制部件按照预设方向移动,进而控制图像采集设备转动及调焦;

186.控制终端包括存储器、处理器及存储在存储器上并可在处理器上运行的计算机程序,处理器执行程序时可用于执行上述任一项的方法,或,运行上述的系统。

187.在一优选实施例中,图像采集设备用于对所要检测的目标进行抓拍,获取特定场景下包含待检测目标的图像或视频,用于后续检测。

188.在一优选实施例中,云台控制部件,用于控制图像采集设备运动与焦距去关注预设目标,辅助后续检测,该部件可控制巡检模式,使得图像采集设备按照预设方向移动,并可以调整焦距。

189.在一优选实施例中,控制终端,用于对图像采集设备采集的图像进行检测,得到具体的检测结果,并将检测结果进行显示或反馈至服务器端。

190.在一较佳实施例中,图像采集设备进行施工现场图像的采集,可以包括:相机模块与推流模块。相机模块包括工业相机和镜头,用于将样本的成像进行捕捉形成图像,推流模块负责将图像推流到服务器,将图片传输到检测模块以供检测。

191.在一较佳实施例中,控制终端进行人员检测与人员属性的检测,可以包括:计算机模块和检测模型模块。计算机模块为检测软件提供硬件支持,一方面可以接收图像采集设备输入的待检测图片,一方面可以将检测结果输出给云台控制部件以供图像采集设备跟踪与调焦使用。检测模型模块包含检测信息返回的功能,供服务器端进行事件查看与回溯。

192.在一较佳实施例中,云台控制部件实现控制图像采集设备运动与焦距去关注预设目标,辅助后续检测。可以包括:巡检模式控制模块、跟踪模块和聚焦模块;巡检模式控制模块通过接收一级人员检测的信息,判断是否需要进入二级检测,如果需要则中断当前巡检进入跟踪模式,待到完成跟踪与聚焦流程后重启巡检线程,从当前检测点开始按路径巡检。跟踪模块使用一级人员检测的坐标信息进行图像采集设备校准,将人员所在区域调整到画面中心。聚焦模块通过判断当前人员的尺度与置信度,尺度或置信度不达标时,在完成跟踪之后进行焦距的拉大,直到人员的尺度与置信度达到要求,或者达到调整焦距的上限次数。

193.在本发明另一实施例中,还提供一种计算机可读存储介质,其上存储有计算机程序,当计算机程序中的指令由设备内的处理器执行时,使得设备能够执行上述任一项的施工现场人员属性检测方法,或,运行上述任意一项的施工现场人员属性检测系统。

194.本领域内的技术人员应明白,本发明上述实施例可提供为方法或计算机程序产品。因此,本发明可采用完全硬件实施例、完全软件实施例、或结合软件和硬件方面的实施例的形式。而且,本发明可采用在一个或多个其中包含有计算机可用程序代码的计算机可用存储介质(包括但不限于磁盘存储器、cd-rom、光学存储器等)上实施的计算机程序产品的形式。

195.本发明是参照根据本发明实施例的方法、设备(系统)、和计算机程序产品的流程图和/或方框图来描述的。应理解可由计算机程序指令实现流程图和/或方框图中的每一流程和/或方框、以及流程图和/或方框图中的流程和/或方框的结合。可提供这些计算机程序指令到通用计算机、专用计算机、嵌入式处理机或其他可编程数据处理设备的处理器以产生一个机器,使得通过计算机或其他可编程数据处理设备的处理器执行的指令产生用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的装置。

196.这些计算机程序指令也可存储在能引导计算机或其他可编程数据处理设备以特定方式工作的计算机可读存储器中,使得存储在该计算机可读存储器中的指令产生包括指令装置的制造品,该指令装置实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能。

197.这些计算机程序指令也可装载到计算机或其他可编程数据处理设备上,使得在计算机或其他可编程设备上执行一系列操作步骤以产生计算机实现的处理,从而在计算机或其他可编程设备上执行的指令提供用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的步骤。

198.本发明上述实施例提供的施工现场人员属性检测方法、系统、装置及介质,公开了一种远近结合的施工场所的人员属性检测技术,通过图像采集设备等图像采集设备以及推流器等视频流处理设备来采集待检测样本的图像;将图像输入基于深度卷积神经网络构造的一级人员检测模型,识别出图像中存在的人员,并判断人员置信度与在图像上的呈现尺度是否达标;如果人员在尺度和置信度上满足二级人员属性识别要求,则将上一阶段得到的人员所在的区域图像输入至二级人员属性识别模型中识别当前人员的人员属性是否规范。如果人员在尺度或置信度上未满足二级人员属性识别要求,则调用图像采集设备的跟踪与聚焦模块,将图像采集设备视角调整到模糊人员或小尺度人员的区域,并进行焦距拉近的处理,并循环进行一级人员检测与跟踪聚焦,直到调整次数达到上限,或者人员置信度达到二级检测要求。若调整次数达到上限而置信度未满足二级人员属性识别要求,则视为未检出行人,进行结果反馈。根据二级人员属性识别的结果,后处理模块将对识别为人员属性不合规范的人员进行复核,并将最终检测结果进行可视化反馈处理。本发明上述实施例提供的施工现场人员属性检测方法、系统、装置及介质,通过远近结合的二级检测结构,将人员与人员属性进行分级检出,同时开发图像采集设备跟踪与调焦模块联合检测算法形成远近结合的施工现场人员属性检测方法,有利于提高人员属性不合规范事件的检出准确率,降低误检率,从而满足常规施工场景下人员属性检测需求,节省人力成本,降低施工隐患。

199.尽管已描述了本发明的优选实施例,但本领域内的技术人员一旦得知了基本创造性概念,则可对这些实施例作出另外的变更和修改。所以,所附权利要求意欲解释为包括优选实施例以及落入本发明范围的所有变更和修改。

200.显然,本领域的技术人员可以对本发明进行各种改动和变型而不脱离本发明的精神和范围。这样,倘若本发明的这些修改和变型属于本发明权利要求及其等同技术的范围之内,则本发明也意图包含这些改动和变型在内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1