一种可变压缩率的目标数据压缩方法

1.本发明涉及数据压缩技术领域,具体涉及一种可变压缩率的目标数据压缩方法。

背景技术:

2.随着信息通信技术的发展,全球大数据储量呈爆炸式增长,面对如此庞大的数据量,如果不作处理,就需要庞大的存储设备来保存这些数据,这将产生巨大的存储成本,因此我们需要数据压缩技术对数据进行压缩和处理,减少数据量,节约数据维护的人力与物力,还要保证解压缩后得到数据的误差在需求范围内。

3.传统的压缩方法,对图像、语音和数据等信息都有较大的主观性,解压缩后得到的误差会比较大,为此,本发明提出一种可变压缩率的目标数据压缩方法。

技术实现要素:

4.为解决上述问题,本发明提出了一种可变压缩率的算法,并在反向传播过程用产生的误差直接调节参数,并在一次运行过程中,可以得到不同压缩率下的误差,在误差允许的范围内,选择最大的压缩率,也可同时调整学习率,使误差达到稳定需要的循环次数变小,提高运行速度,从而得到最合适的压缩率和学习率。

5.本发明提供了如下的技术方案。

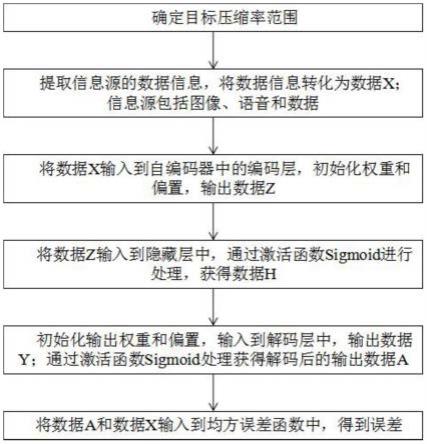

6.一种可变压缩率的目标数据压缩方法,包括以下步骤:

7.获取目标数据x;所述目标数据包括:图像数据或语音数据;

8.将目标数据x输入到自编码器中的编码层,初始化权重和偏置,输出数据z;

9.将数据z输入到自编码器中的隐藏层,通过激活函数sigmoid进行处理,获得数据h;

10.初始化输出权重和偏置,数据h输入到解码层中,输出数据y;通过激活函数sigmoid处理获得解码后的输出数据a;

11.将数据a和目标数据x输入到均方误差函数中,得到误差;

12.采用梯度下降法反向传播调节权重和偏置,在预设目标压缩率范围内循环迭代直至误差最小,输出压缩率以及目标压缩数据。

13.优选地,还包括:

14.确定误差允许范围;

15.在采用梯度下降法反向传播调节权重和偏置的同时,调节学习速度,在误差允许范围内,迭代输出最优压缩率与学习率,并输出此时的压缩数据。

16.优选地,所述数据z:

17.z=w1x+b118.式中,w1为权重,b1为偏置。

19.优选地,所述隐藏层的维度为h,h《n,n为数据x的维度。

20.优选地,所述数据h:

[0021][0022]

式中,z为数据z。

[0023]

优选地,所述数据y:

[0024]

y=w2h+b2[0025]

式中,w2为输出权重,b2为输出偏置。

[0026]

优选地,所述目标数据为图像数据时,将图像数据转化为灰度图,提取灰度图的像素点以矩阵形式保存为目标数据x。

[0027]

本发明的有益效果:

[0028]

本文提出了一种可变压缩率的算法,并在反向传播过程用产生的误差直接调节参数,并在一次运行过程中,可以得到不同压缩率下的误差,在误差允许的范围内,选择最大的压缩率,也可同时调整学习率,使误差达到稳定需要的循环次数变小,提高运行速度,从而得到最合适的压缩率和学习率。

附图说明

[0029]

图1是本发明实施例的可变压缩率的目标数据压缩方法的流程图;

[0030]

图2是本发明实施例图片数据压缩时,隐藏层为50和70,学习率为0.1的迭代曲线图;

[0031]

图3是本发明实施例图片数据压缩时,隐藏层为50和70,学习率为0.15的迭代曲线图;

[0032]

图4是本发明实施例图片数据压缩时,隐藏层为150和100,学习率为0.1的迭代曲线图。

具体实施方式

[0033]

为了使本发明的目的、技术方案及优点更加清楚明白,以下结合附图及实施例,对本发明进行进一步详细说明。应当理解,此处所描述的具体实施例仅用以解释本发明,并不用于限定本发明。

[0034]

实施例1

[0035]

本发明的一种可变压缩率的目标数据压缩方法。如图1-4所示:

[0036]

s1:确定目标需求;

[0037]

s2:提取信息源的数据信息,将数据信息转化为目标数据x;所述信息源包括图像、语音和数据;

[0038]

s3:将目标数据x输入到自编码器中的编码层,初始化权重和偏置,输出数据z;

[0039]

s4:将数据z输入到隐藏层中,通过激活函数sigmoid进行处理,获得数据h;

[0040]

s5:初始化输出权重和偏置,数据h输入到解码层中,输出数据y;通过激活函数sigmoid处理获得解码后的输出数据a;

[0041]

s6:将数据a和目标数据x输入到均方误差函数中,得到误差;

[0042]

s7:在采用梯度下降法反向传播调节权重和偏置的同时,改变压缩率或改变学习率或同时进行改变得到不同的输出结果,根据目标需求,选择合适的方法得到最优参数。

[0043]

本实施例中,

[0044]

以图片为例,输入一张彩色图片,将其转换为灰度图后提取像素点,以像素点矩阵为输入数据。

[0045]

输入数据矩阵(225*315),将数据在隐藏层压缩后再进行解码恢复,得到误差,使用梯度下降法反向传播,通过不断调整权重与偏置,循环迭代使误差变小,得到理想的压缩率和学习率改变压缩率。

[0046]

①

如图2所示,隐藏层的大小:深色线50,浅色线70,此时学习率0.1隐藏层为50时(压缩率约为77.8%),循环迭代稳定后误差大小0.05870757714136944

[0047]

隐藏层为70时(压缩率约为68.9%),循环迭代稳定后误差大小0.03245032085732509

[0048]

②

如图3所示,同

①

的条件下,改变学习率为0.15

[0049]

隐藏层为50时,循环迭代稳定后误差大小0.05947263136777498

[0050]

隐藏层为70时,循环迭代稳定后误差大小0.03088963658291494

[0051]

③

如图4所示,改变隐藏层的大小,学习率0.1,深色线150,浅色线100

[0052]

隐藏层为150时,循环迭代稳定后误差大小0.0001785693376355132

[0053]

隐藏层为100时,循环迭代稳定后误差大小0.0015939471852396137

[0054]

由上述实验结果和数据可得,当输入数据后,压缩率和学习率都可变,学习率和压缩率变大后,误差相应也会提高,所以在误差可接受范围内,尽可能提高学习率,增大压缩率,减少冗余数据,节省存储空间,或根据具体精度要求,选择合适的压缩率和下降速度。

[0055]

以上仅为本发明的较佳实施例而已,并不用以限制本发明,凡在本发明的精神和原则之内所作的任何修改、等同替换和改进等,均应包含在本发明的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1