一种大血管闭塞风险的确定装置和确定方法与流程

1.本公开涉及医疗设备控制领域,特别涉及一种大血管闭塞风险的确定装置和确定方法。

背景技术:

2.卒中是导致人类致死、致残的重大疾病之一,也是位列我国第一位死亡原因。我国卒中的发病率逐年上升,国家卒中筛查数据显示,40

‑

74岁居民首次卒中标化发病率由2002年的189/10万上升至2013年的379/10万,平均每年增长8.3%在新发患者中,缺血性卒中占总体的70%。虽然静脉溶栓是治疗急性缺血性脑卒中的有效方法,然而对于急性大血管闭塞性缺血性卒中,静脉溶栓的血管再通率较低,疗效欠佳,需要进行经动脉药物溶栓、机械碎栓、支架置入及机械取栓等血管内治疗方法开通闭塞血管。

3.血管内治疗需要在具有血管内治疗资质的高级卒中中心进行,而普通的初级卒中中心因不能进行血管内治疗,需要转运到高级卒中中心,从而导致治疗时间的延迟,因此在院前转运环节,对疑似卒中患者进行大血管闭塞的评估,就有重要的意义。然而,通过美国118家机构的报告显示,直接将患者转运至高级卒中中心相较先经过初级卒中中心,再转运至高级卒中中心的病死率低。

4.现有技术存在的问题包括急救车在救治转院过程中,仅对患者评估是否是卒中患者,并未进一步进行大血管闭塞的评估,导致不能进行精准转运,从而有大血管闭塞的脑卒中患者因送到不具备血管内治疗的初级卒中中心而使救治时间延长;此外,院前急救时间紧迫,大血管闭塞的评估项目较多,院前急救救护人员参差不齐,评估结果主观差异比较大,现有的智能fast评估方法,也仅仅是识别是否是卒中,未进一步进行大血管闭塞的评估,因此都无法在院前更精准识别大血管闭塞风险等。

技术实现要素:

5.本公开实施例的目的在于提供一种大血管闭塞风险的确定装置,以解决现有技术中存在的缺乏院前精准识别大血管闭塞风险的问题。

6.为了解决上述技术问题,本公开的实施例采用了如下技术方案:一种大血管闭塞风险的确定装置,包括以下部分:获取模块,其用于获取患者的至少一个特征数据,所述特征数据至少包括眼球运动数据;第一确定模块,其用于基于所述特征数据,确定对应于所述特征数据的评估值;第二确定模块,其用于基于所有的所述评估值,确定所述患者的大血管闭塞风险等级。

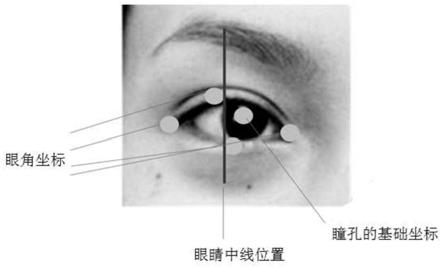

7.在一些实施例中,所述第一确定模块包括:第一确定单元,其用于当所述特征数据为眼球运动数据的情况下,基于所述眼球运动数据确定眼睛区域、瞳孔的基础坐标以及眼睛中线位置坐标;第一获取单元,其用于基于所述眼睛区域、所述瞳孔的基础坐标以及所述眼睛中心位置坐标获取瞳孔的运动数据;第二确定单元,其用于基于所述瞳孔的运动数据,确定对应于所述眼球运动数据的第一评估值。

8.在一些实施例中,在所述眼睛区域中通过瞳孔检测算法确定所述瞳孔的基础坐标以及所述眼睛中线位置坐标。

9.在一些实施例中,所述第一确定模块包括:第三确定单元,其用于当所述特征数据包括面部图像数据的情况下,基于所述面部图像数据,确定面部中线;第四确定单元,其用于在执行预定面部动作的过程中,基于面部监测点和所述面部中线,确定面部对称度;第五确定单元,其用于基于所述面部对称度,确定第二评估值。

10.在一些实施例中,所述面部监测点包括眼角、眼睑、眉心,眉梢、人中、嘴角、牙齿中至少一个。

11.在一些实施例中,所述第一确定模块包括:第六确定单元,其用于当所述特征数据包括第一手臂数据的情况下,基于所述第一手臂数据,确定手臂力量值和手臂对称度;第七确定单元,其用于基于所述手臂力量值和所述手臂对称度,确定第三评估值。

12.在一些实施例中,所述手臂力量值通过相同的双上肢识别点的位置坐标在预定时间内是否保持一致的方式确定,所述手臂对称度通过不同手臂上的对称的双上肢识别点的位置坐标在预定时间内是否保持对称的方式确定。

13.在一些实施例中,所述第一确定模块包括:第二获取单元,其用于当所述特征数据包括第二手臂数据的情况下,基于所述第二手臂数据获取在预定时间内的手臂运动数据;第八确定单元,其用于基于所述手臂运动数据,确定第四评估值。

14.在一些实施例中,所述第二手臂数据通过加速度传感器和陀螺仪传感器获取。

15.在一些实施例中,所述第一确定模块包括:第九确定单元,其用于当所述特征数据包括语言认知数据的情况下,基于所述语言认知数据,确定认知准确度和/或语音匹配度;第十确定单元,其用于基于所述认知准确度和/或所述语音匹配度,确定第五评估值。

16.本公开实施例提供一种快速、客观、智能的大血管闭塞风险的确定装置。本公开实施例通过从眼球凝视维度以及通过其他的例如面部、手臂运动、语音认知等多个维度识别判断疑似卒中患者的大血管闭塞的风险,基于fast

‑

ed的量表基于不同情况给出评估值,并基于评估值进行风险分级的评估,从而识别是否有大血管闭塞风险,为患者推荐对应的卒中中心前往救治,缩短患者转运时间,提高卒中大血管闭塞的救治率,减少卒中患者的致死率和致残率。

附图说明

17.为了更清楚地说明本公开实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本公开中记载的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动性的前提下,还可以根据这些附图获得其他的附图。

18.图1为本公开实施例的确定装置中的眼球运动数据的获取示意图;

19.图2为本公开实施例的确定装置中的眼球运动数据的获取示意图;

20.图3为本公开实施例的确定装置中的眼球运动的分析示意图;

21.图4为本公开实施例的确定装置中的眼球运动的分析示意图;

22.图5为本公开实施例的确定装置中的眼球运动的分析示意图;

23.图6为本公开实施例的确定装置中的面部图像数据的获取示意图;

24.图7为本公开实施例的确定装置中的第一手臂数据的获取示意图;

25.图8为本公开实施例的确定装置中的第一手臂数据的获取示意图;

26.图9为本公开实施例的确定装置中的第二手臂数据的获取示意图;

27.图10为本公开实施例的确定装置中的语言认知数据的获取示意图。

具体实施方式

28.此处参考附图描述本公开的各种方案以及特征。

29.应理解的是,可以对此处申请的实施例做出各种修改。因此,上述说明书不应该视为限制,而仅是作为实施例的范例。本领域的技术人员将想到在本公开的范围和精神内的其他修改。

30.包含在说明书中并构成说明书的一部分的附图示出了本公开的实施例,并且与上面给出的对本公开的大致描述以及下面给出的对实施例的详细描述一起用于解释本公开的原理。

31.通过下面参照附图对给定为非限制性实例的实施例的优选形式的描述,本公开的这些和其它特性将会变得显而易见。

32.还应当理解,尽管已经参照一些具体实例对本公开进行了描述,但本领域技术人员能够确定地实现本公开的很多其它等效形式,它们具有如权利要求所述的特征并因此都位于借此所限定的保护范围内。

33.当结合附图时,鉴于以下详细说明,本公开的上述和其他方面、特征和优势将变得更为显而易见。

34.此后参照附图描述本公开的具体实施例;然而,应当理解,所申请的实施例仅仅是本公开的实例,其可采用多种方式实施。熟知和/或重复的功能和结构并未详细描述以避免不必要或多余的细节使得本公开模糊不清。因此,本文所申请的具体的结构性和功能性细节并非意在限定,而是仅仅作为权利要求的基础和代表性基础用于教导本领域技术人员以实质上任意合适的详细结构多样地使用本公开。

35.本说明书可使用词组“在一种实施例中”、“在另一个实施例中”、“在又一实施例中”或“在其他实施例中”,其均可指代根据本公开的相同或不同实施例中的一个或多个。

36.本公开实施例涉及一种大血管闭塞风险的确定装置,用于患者本人或家属进行脑卒中的大血管闭塞的院前评估。其中,关于大血管闭塞风险的院前评估方法有多种,本公开实施例涉及的大血管闭塞风险的确定装置的核心是采用卒中急救中心分选现场评估(field assessment stroke triagefor emergency destination,简称fast

‑

ed),即通过fast

‑

ed评分的数值确定患者的大血管闭塞的风险等级。研究表明,fast

‑

ed方法与其他方法例如race(动脉闭塞快速评分量表)、cpss(辛辛那提院前卒中量表) 相比,fast

‑

ed≥4、race≥5、cpss≥2的敏感性分别为0.60、0.55、0.56;特异性分别为0.89、0.87、0.85;阳性预测值分别0.72、0.68、0.65;阴性预测值为分别0.82、0.79、0.78。具体地,fast

‑

ed是一个简单的量表,在经典的fast评分的基础上,通过增加具有皮质损伤症状的眼球凝视因素的判定显著提升大血管闭塞风险的评估准确度,当fast

‑

ed≥4时,其对大血管闭塞评价的敏感性为0.60,特异性为0.89,医疗急救专业人员可以此量表从而能够识别和确定患者的大血管闭塞的风险等级,便于使得患者快速分流,精准转运。

37.由于多数院前急救人员非神经专科出身,对于大血管闭塞的评估增加了判定的难度,基于此,为解决这一技术问题,通过采集所述患者包含面部、手臂、语音的视频,应用智能技术智能识别相应的图像,并根据不同维度进行评分,最终输出fast

‑

ed的评分,也就是对于大血管闭塞的风险等级的最终评估值,从而帮助院前急救人员,方便快捷地对大血管闭塞进行评估与预测。此外,本公开实施例可以通过手机等移动终端实现,也可以通过专门的测试设备实现。

38.本公开实施例涉及的大血管闭塞风险的确定装置用于确定患者出现大血管闭塞的风险,其包括获取模块、第一确定模块和第二确定模块,上述模块之间相互耦合,具体地:

39.获取模块,其用于获取患者的至少一个特征数据,所述特征数据至少包括眼球运动数据。

40.为了判断患者出现大血管闭塞的风险,需要首先通过所述获取模块获取所述患者的至少一个特征数据,这里的所述特征数据与每个所述患者的自身状态以及对外界的反应相关,其至少包括眼球运动数据。这里需要说明的是,在采用fast

‑

ed量表对患者的大血管闭塞的风险等级进行评估时,患有脑卒中的所述患者的眼球运动情况往往能够体现出其患病程度,尤其能够反映所述患者的大血管闭塞的风险。通过获取模块,首先获取患者的至少一个特征数据,所述特征数据至少包括眼球运动数据。通过眼球运动数据能够使得对于大血管闭塞风险的评估准确性显著提高。当然这里的所述特征数据还可以包括其他生理性或者运动性数据,这里的特征数据还可以包括面部图像数据、手臂数据、语言认知数据等。

41.在获取所述患者的所述特征数据时,可以采用与所述特征数据相对应的方式获取。例如,在获取所述眼球运动数据时,可以将手机放置在所述患者的眼睛正前方一定距离处,例如30cm

‑

70cm处,首先请所述患者的头部保持不动同时移动所述手机的位置,如图1所示,使得所述患者的眼睛跟随手机移动的方向移动,通过所述手机中的摄像装置记录所述患者的眼睛移动的视频数据。这里的所述视频数据可以作为所述患者的眼球运动数据。当然,基于不同的特征数据需要采用不同的方式获取。

42.第一确定模块,基于所述特征数据,确定对应于所述特征数据的评估值。

43.在通过上述获取模块获取到所述患者的所述特征数据后,通过所述第一确定模块可以基于所述特征数据,确定对应于所述特征数据的评估值,这里的所述评估值用于基于所述特征数据对所述患者的大血管闭塞的风险进行量化处理,以便于后期进行具体评估。具体地,包括以下部分:

44.第一确定单元,其用于当所述特征数据为眼球运动数据的情况下,基于所述眼球运动数据确定眼睛区域、瞳孔的基础坐标以及眼睛中线位置坐标。

45.通过第一确定单元,当获取的所述特征数据为眼球运动数据的情况下,首先确定所述患者的眼睛区域和瞳孔的基础坐标。具体地,将通过所述手机的摄像装置捕获的视频数据进行分解以获取其中的画像帧,如图2所示,在所述图像帧中检测并获取在所述患者的头部保持不动时,基于所述患者的双眼的眼角分别确定的4个位置的4个坐标,通过这4个坐标确定双眼的眼睛区域;在确定所述眼睛区域的基础上,执行基于深度学习的瞳孔检测算法以确定双眼的瞳孔的基础坐标并确定所述患者的双眼的眼睛中线位置坐标。这里的基于深度学习的瞳孔检测算法可以采用现有技术中的算法,在此不再赘述。

46.第一获取单元,其用于基于所述眼睛区域、所述瞳孔的基础坐标以及所述眼睛中

心位置坐标获取所述瞳孔的运动数据。

47.在通过上述第一确定单元确定所述眼睛区域、所述瞳孔的基础坐标以及所述眼睛中线位置坐标后,由于通过移动所述手机的位置,使得所述患者的眼睛跟随所述手机移动的方向移动,从而形成实时的眼球运动数据的视频数据,基于所述眼睛区域、所述瞳孔的基础坐标以及所述眼睛中心位置坐标从视频数据中获取所述瞳孔的运动数据。

48.具体地,在获取的视频数据中,例如首先将所述手机向左移动,判断所述患者的双眼的瞳孔是否可以同时跟随移动,以及获取所述瞳孔的实时位置坐标,基于所述眼睛区域、所述瞳孔的基础坐标以及所述眼睛中心位置坐标通过所述实时位置坐标获取所述瞳孔的运动数据。在这里具体地需要获取以下所述瞳孔在运动中的运动数据,例如包括s1

‑

瞳孔初始位置坐标;s2

‑

瞳孔移动结束位置的坐标;l

‑

水平方向上两个眼角之间的距离即眼睛长距;f

‑

瞳孔运动幅度,f=(s2

‑

s1)/l,当然还可以包括其他数据或信息,例如所述瞳孔的位置是否跨过所述眼睛中线位置坐标以及是否到达所述眼角的位置坐标。然后,将所述手机向右移动,判断所述患者的双眼的瞳孔是否可以同时跟随移动,以及获取所述瞳孔的实时位置坐标,基于所述眼睛区域、所述瞳孔的基础坐标以及所述眼睛中心位置坐标通过所述实时位置坐标获取所述瞳孔的运动数据,同样地,这里的所述运动数据还包括所述瞳孔的位置是否跨过所述眼睛中线位置坐标以及是否到达所述眼角的位置坐标。在这里需要注意的是,在这里在对所述瞳孔移动方向进行评估时仅评估水平方向的移动,不评估其他方向的移动。总的来说,判断所述患者的双眼的瞳孔是否可以跟随手机移动的方向做一致性的移动,同时运动到相应的眼角。

49.第二确定单元,其用于基于所述瞳孔的运动数据,确定对应于所述眼球运动数据的第一评估值。

50.在通过上述获取单元获取所述瞳孔的运动数据后,基于所述瞳孔的运动数据,确定对应于所述眼球运动数据的评估值。例如,如图3所示,如果所述患者的双眼的所述瞳孔都可以根据手机的移动方向,同时向右或向左移动,且双眼的所述瞳孔都跨过眼睛中线位置坐标即双眼的f>50%,且双眼的所述瞳孔都能够运动到眼睛区域的极限,也就是能够到达眼角位置,则认为属于凝视正常,评估值可以设为0分;如图4所示,在以下情况下评估值设为1分,包括(1)双眼的所述瞳孔只能同时向一边移动,例如可以同时向右,但无法同时向左移动;(2)双眼的所述瞳孔的移动位置不够,例如双眼的所述瞳孔都跨过眼睛中线位置坐标即双眼的f>50%,但不能移动到眼角位置;(3)双眼中的一只眼睛的所述瞳孔可以移动,但另一只眼睛的瞳孔不能跟随移动;如图5所示,在以下情况下评估值设为2分,包括(1)所述患者的双眼的瞳孔完全无运动即f=0;(2)所述瞳孔只能有微小运动而无法跨过所述眼睛中线位置坐标即f<50%。

51.在另一个实施例中,在获取患者的至少一个特征数据中,所述特征数据还可以包括面部图像数据,当在所述特征数据包括面部图像数据的情况下,用于基于所述特征数据,确定对应于所述特征数据的评估值的所述第一确定模块还包括以下部分:

52.第三确定单元,其用于当所述特征数据包括面部图像数据的情况下,基于所述面部图像数据,确定面部中线。

53.通过第三确定单元,基于所述面部图像数据,确定面部中线坐标。在通过所述手机获取所述面部图像数据时,可以通过以下方式实现,如图6 所示,例如患者可以通过所述手

机自带的摄像装置实时拍摄面部图像或拍摄预定时间内的面部影像。基于所述面部图像数据或者面部影像数据,确定面部中线。

54.第四确定单元,其用于在执行预定面部动作的过程中,基于面部监测点和所述面部中线,确定面部对称度。

55.在通过上述第三确定单元确定所述面部中线后,通过所述第四确定单元在执行预定面部动作的过程中,基于面部监测点和所述面部中线,确定面部对称度。首先,需要确定需要监测面部对称的面部监测点的位置坐标,这些面部监测点可以是所述患者的面部的眼角、眼睑、眉心,眉梢、人中、嘴角、牙齿等监测点,这里的所述预定面部动作可以是微笑、露齿等动作。在执行所述预定面部动作的过程中,获取所述面部监测点的位置坐标并根据所述面部中线检测面部两侧的对称度,从而确定面部对称度,这里尤其基于面部三角区(双眼和嘴部之间区域)内的所述面部监测点的位置坐标获取所述面部对称度。

56.第五确定单元,其用于基于所述面部对称度,确定第二评估值。

57.在通过上述第四确定单元确定所述面部对称度后,通过第五确定单元可以基于所述面部对称度,确定第二评估值。例如当所述面部对称度≥90%时,认为面部对称基本正常,定义为正常,并将所述第二评估值设为0分;当所述面部对称度<90%,例如出现单边脸痉挛或明显不对称的情况,则所述第二评估值设为1分。

58.在另一个实施例中,在获取患者的至少一个特征数据中,所述特征数据还包括第一手臂数据,当在所述特征数据包括所述第一手臂数据的情况下,用于基于所述特征数据,确定对应于所述特征数据的评估值的第一确定模块还包括以下部分:

59.第六确定单元,其用于当所述特征数据包括所述第一手臂数据的情况下,基于所述第一手臂数据,确定手臂力量值和手臂对称度。

60.通过第六确定单元,基于所述第一手臂数据,确定手臂力量值和手臂对称度。在通过所述手机获取所述第一手臂数据时,可以通过以下方式实现,例如让所述患者的手臂执行预定手臂动作,如图7所示,例如让患者双手平举起并依次放下,进一步如图8所示,采集双上肢关键部位的双上肢识别点在预定时间内的位置信息,这里的所述双上肢识别点包括但不限于肩部、肘、手腕等主要关节部位的位置上,还包括指尖等特殊位置以及各主要部位的最高位置、最低位置等。基于所述双上肢识别点在预定时间内的位置信息确定所述患者的手臂力量值和手臂对称度,例如这里的所述手臂力量值可以通过相同的所述双上肢识别点的位置坐标在预定时间内是否保持一致的方式确定,所述手臂对称度可以通过不同手臂上的对称的所述双上肢识别点的位置坐标在预定时间内是否保持对称的方式确定。

61.第七确定单元,其用于基于所述手臂力量值和手臂对称度,确定第三评估值。

62.当通过上述第六确定单元确定所述手臂力量值和所述手臂对称度后,可以基于所述手臂力量值和手臂对称度,确定第三评估值。例如所述患者的所述手臂力量值大于80,也就是未出现上肢肌无力,双上肢的对称的所述双上肢识别点的手臂对称度≥90%;且10秒内所述手臂对称度未发生改变则所述第三评估值设为0分;如果所述患者的所述手臂力量值在40

‑

80 之间,则意味着中度无力,双上肢的对称的所述双上肢识别点的手臂对称度<90%;或者不同上肢上的对称的所述双上肢识别点在预定时间内的坐标差值一直增大,则所述第三评估值设为1分;如果所述患者的所述手臂力量值小于40,也就是重度无力,并且一侧上肢完全不能运动,则所述第三评估值设为2分。

63.在另一个实施例中,在获取患者的至少一个特征数据中,所述特征数据还包括第二手臂数据,当在所述特征数据包括第二手臂数据的情况下,用于所述基于所述特征数据,确定对应于所述特征数据的评估值的第一确定模块还包括以下部分:

64.第二获取单元,其用于当所述特征数据包括第二手臂数据的情况下,基于所述第二手臂数据获取在预定时间内的手臂运动数据。

65.通过第二获取单元,基于在获取所述第二手臂数据时,可以通过以下方式实现,让所述患者抓取手机并使得手臂执行预定动作,如图9所示,通过所述手机中的加速度传感器和陀螺仪传感器获取手机在初始状态的基础加速度数据,例如设置为αx,αy,αz可分别记为0,0,0;然后获取在初始状态后通过在预定时间内手臂执行预定动作的手臂运动数据,例如20 秒内,例如可以获取前10秒内分别获取手臂抬起过程中所述手机的αx,αy,αz的最大值分别记为maxαx,maxαy,maxαz,在后10秒获取手臂缓慢下落过程中所述手机的角速度值分别计为ωαx,ωαy,ωαz并获取三轴角速度ωαx=(maxαx

‑

αx)/10,ωαy=(maxαy

‑

αy)/10,ωαz=(maxαz

‑

αz)/10。

66.在实际获取所述第一手臂数据或者第二手臂数据时,可以采用以下的测试步骤:

67.(1)患者单手(如左手)持手机,此时患者可以为站立或平卧状态,点击开始评测。

68.(2)单手持手机,根据提示语音,10秒内将手臂缓慢(例如匀速) 举起至水平状态。

69.(3)根据提示语音,10秒后再将手臂缓慢(匀速)放下。

70.等到单手测试结束,将另外一只手重复上述步骤(1)再次进行评测。

71.第八确定单元,其用于基于所述手臂运动数据,确定第四评估值。

72.在通过上述第二获取单元获取在预定时间内的所述手臂运动数据后,可以通过第八确定单元基于所述手臂运动数据确定第四评估值,具体地,(1)如果[|maxαx

‑

αx|≥60

°

|||maxαy

‑

αy|≥60

°

|||maxαz

‑

α z|≥60

°

]&[ωαx≤15

°

/s||ωαy≤15

°

/s||ωαz≤15

°

/s]为真,则定义为未出现上肢肌无力,所述第四评估值设为0分;(2)如果[30

°

≤|maxαx

‑

αx|<60

°

||30

°

≤|maxαy

‑

αy|<60

°

||30

°

≤|maxαz

‑

αz| <60]&[ωαx>15

°

/s||ωαy>15

°

/s||ωαz>15

°

/s]为真,则定义为中度无力,所述第四评估值设为1分;(3)如果|maxαx

‑

αx|<30

°ꢀ

&|maxαy

‑

αy|<30

°

&|maxαz

‑

αz|<30

°

为真,则定义为重度无力,所述第四评估值设为2分。

[0073]

当然,可以通过所述患者的任一手臂获得所述第四评估值,还可以经过左右手臂分别测试后,获得所述第四评估值。例如,只要有一只手臂为中度无力或重度无力,如左手为重度无力,左手为中度无力,确定所述第四评估值设为2分。

[0074]

在另一个实施例中,在获取患者的至少一个特征数据中,所述特征数据还包括语言认知数据,当在所述特征数据包括语言认知数据的情况下,用于基于所述特征数据,确定对应于所述特征数据的评估值的第一确定模块还包括以下部分:

[0075]

第九确定单元,其用于当所述特征数据包括语言认知数据的情况下,基于所述语言认知数据,确定认知准确度和/或语音匹配度。

[0076]

通过第九确定单元,基于所述语言认知数据,确定认知准确度和语音匹配度。在通过所述手机获取所述语言认知数据时,如图10所示,可以通过以下方式实现,例如通过手机播放预定图片,获取患者对于所述图片的语音反馈数据,通过所述语音反馈数据可以确定所述患者对预定图片的认知准确度,其包括能够准确辨认预定图片中的内容并且发音能够与预定图片对应的名称具有相似的发音,也就是获取发音相似度;还可以通过手机播放预

定语句,通过所述手机的语音接收装置获取所述患者跟读所述预定语句的语音反馈数据。进一步地,通过对所述患者朗读的声音进行识别,并与预定语句之间进行比较以判断所述语音反馈数据中语句的抑扬顿挫与播放的所述预定语句之间的文字准确度以及对于语言连贯性和语言速度。例如向患者展示预设的常见物品图片,让所述患者进行辨认,并说出答案并通过语音记录以及通过手机语音播放一段预设文字语音,例如:“xxxxxx, xxxxxx”。

[0077]

第十确定单元,其用于基于所述认知准确度和/或所述语音匹配度,确定第五评估值。

[0078]

在通过上述第九确定单元确定所述认知准确度和/或所述语音匹配度后,可以基于所述认知准确度和所述语音匹配度确定第五评估值。例如在确定的是所述认知准确度的情况下,如果所述患者能够准确辨认物品2件及以上并且所述发音相似度≥75%,则认为所述患者的语言认知能力为正常,所述第五评估值设为0分;如果所述患者能够准确辨认物品2件以下并且所述发音相似度度<75%,则语言运动定义为异常,所述第五评估值设为1 分。

[0079]

在确定的是所述语音匹配度的情况下,如果所述患者的语音记录同标准语音的语音匹配度≥90%,此处主要为语义的识别,语言感知定义为正常,所述第五评估值设为0分;如果所述患者的语音记录同标准语音的语音匹配度<90%,此处主要为语义的识别,语言感知定义为正常,所述第五评估值设为1分。

[0080]

需要注意的是,基于不同的所述特征数据,可以通过对应不同的方式或者通过患者的不同反馈行为获取,也可以通过同一方式或者患者的同一反馈行为获取多个特征数据,例如可以基于可以通过视频数据不但可以获取眼球运动数据,还可以获取面部图像数据或者手臂数据等。

[0081]

以下以手机为例举例说明本公开实施例涉及的大血管闭塞风险的确定装置的一种使用方法:

[0082]

进入测试前,显示确认键,确认患者本人持手机或评估者(第三人) 持手机。

[0083]

一、当选择评估者(第三人)持手机时

[0084]

评估者持手机,将手机对准患者,根据语音提示进行下一步操作。

[0085]

s1“请对着镜头微笑,并露出牙齿”,采集并获取面部图像数据。

[0086]

s2“请头部保持不变,眼睛看手机移动方向”,采集并获取眼球运动数据。

[0087]

s3“请举起左手”,2秒钟后,“请举起右手”,自动计时10秒钟后,“按提示依次放下双手”,“请放下左手”,2秒钟后,“请放下右手”,采集并获取手臂数据;

[0088]

s4“请跟随朗读

‘

xxxxxx,xxxxxx

’”

,采集并获取语言认知数据。

[0089]

在获取相关的特征数据后,可以基于fas

‑

ed量表的方式直接输出最终评估值。

[0090]

二、当选择患者本人持手机时

[0091]

患者进入视频拍摄模式,请跟随语音提示/画面提示进行操作。

[0092]

s1“请对着镜头微笑,并露出牙齿”,采集面部图像数据。

[0093]

s2“请头部保持不变,眼睛随图标移动”,采集眼球运动数据。。

[0094]

s3“请左手持手机举起”,自动计时10秒钟后,“请放下左手”,“请右手持手机举起”,自动计时10秒钟后,“请放下右手”,采集手臂数据。

[0095]

s4“请跟随朗读

‘

xxxxxx,xxxxxx

’”

,采集语言认知数据。

[0096]

在获取相关的特征数据后,可以基于fas

‑

ed量表的方式直接输出最终评估值。

[0097]

例如还可以是:

[0098]

s1“请对着镜头微笑,并露出牙齿”,采集面部图像数据。

[0099]

s2“请左手持手机举至水平位置,请头部保持不变,向左移动手机,眼睛随图标移动”,自动计时10秒钟后,“请放下左手”,“请右手持手机举至水平位置,请头部保持不变,向右移动手机,眼睛随图标移动”,自动计时10秒钟后,“请放下右手”,采集手臂数据和眼球运动数据。

[0100]

s3“请跟随朗读

‘

xxxxxx,xxxxxx

’”

,采集语言认知数据。

[0101]

第二确定模块,其用于基于所有的所述评估值,确定所述患者的大血管闭塞风险等级。

[0102]

在通过上述第一确定模块确定对应于所述特征数据的评估值后,可以基于所述评估值,确定所述患者的大血管闭塞风险等级,当获取的所述特征数据为1项时,可以仅利用该项所述评估值作为最终评估值,当获取的所述特征数据为多项时,每项所述特征数据具有对应的所述评估值,可以将多个所述评估值进行加法运算以获得最终评估值;进一步地,针对获得的所述评估值的情况,将最终评估值与不同阈值进行比较,基于比较的结果确定所述患者的大血管闭塞的风险,例如如果最终评估值超过不同的所述阈值,则认为具有不同的风险等级,基于风险等级可以确定进一步地处理方案。例如最终评估值=第一评估值+第二评估值+第三评估值+第四评估值+第五评估值,其中,如果最终评估值为0,则大血管闭塞的风险很小;如果最终评估值在1分和3分之间,则大血管闭塞的风险较高,可就近转运至初级卒中中心或高级卒中中心;如果最终评估值≥4分,则大血管闭塞的风险较高,需要直接转运至具有取栓能力的高级卒中中心。

[0103]

当然,还可以根据所述评估值的情况进行不同的判断,针对不同的所述评估值分别设置相应的阈值,例如1

‑

2项所述评估值超过对应的阈值则认为有三级风险,3

‑

4项所述评估值超过对应的阈值,则认为有二级风险,如果所有评估值均超过对应的阈值,则认为具有一级风险。

[0104]

本公开的另一实施例提供一种大血管闭塞风险的确定方法,其通过上述实施例的确定装置实现,其包括以下步骤:

[0105]

获取患者的至少一个特征数据,所述特征数据至少包括眼球运动数据;

[0106]

基于所述特征数据,确定对应于所述特征数据的评估值;

[0107]

基于所有的所述评估值,确定所述患者的大血管闭塞风险等级。

[0108]

在一个具体的实施方式中,进一步地,所述基于所述特征数据,确定对应于所述特征数据的评估值包括:

[0109]

当所述特征数据为眼球运动数据的情况下,基于所述眼球运动数据确定眼睛区域、瞳孔的基础坐标以及眼睛中线位置坐标;

[0110]

基于所述眼睛区域、所述瞳孔的基础坐标以及所述眼睛中心位置坐标获取瞳孔的运动数据;

[0111]

基于所述瞳孔的运动数据,确定对应于所述眼球运动数据的第一评估值。

[0112]

在另一个具体的实施方式中,进一步地,所述基于所述特征数据,确定对应于所述特征数据的评估值包括

[0113]

当所述特征数据包括面部图像数据的情况下,基于所述面部图像数据,确定面部中线;

[0114]

在执行预定面部动作的过程中,基于面部监测点和所述面部中线,确定面部对称度;

[0115]

基于所述面部对称度,确定第二评估值。

[0116]

这里的所述面部监测点包括眼角、眼睑、眉心,眉梢、人中、嘴角、牙齿中至少一个。

[0117]

在另一个具体的实施方式中,进一步地,所述基于所述特征数据,确定对应于所述特征数据的评估值包括:

[0118]

当所述特征数据包括第一手臂数据的情况下,基于所述第一手臂数据,确定手臂力量值和手臂对称度;

[0119]

基于所述手臂力量值和所述手臂对称度,确定第三评估值。

[0120]

这里的所述手臂力量值通过相同的双上肢识别点的位置坐标在预定时间内是否保持一致的方式确定,所述手臂对称度通过不同手臂上的对称的双上肢识别点的位置坐标在预定时间内是否保持对称的方式确定。

[0121]

在另一个具体的实施方式中,进一步地,所述基于所述特征数据,确定对应于所述特征数据的评估值包括:

[0122]

当所述特征数据包括第二手臂数据的情况下,基于所述第二手臂数据获取在预定时间内的手臂运动数据;

[0123]

基于所述手臂运动数据,确定第四评估值。

[0124]

这里的所述第二手臂数据通过加速度传感器和陀螺仪传感器获取。

[0125]

在另一个具体的实施方式中,进一步地,所述基于所述特征数据,确定对应于所述特征数据的评估值包括:

[0126]

当所述特征数据包括语言认知数据的情况下,基于所述语言认知数据,确定认知准确度和/或语音匹配度;

[0127]

基于所述认知准确度和/或所述语音匹配度,确定第五评估值。

[0128]

在本公开实施例中,根据眼球运动数据、面部图像数据、手臂数据、语言认知数据等计算并确定患者的大血管闭塞风险等级,其中采用基于深度学习的人脸、肢体、眼部、瞳孔识别算法,实现智能评估。

[0129]

本公开实施例通过从眼球凝视维度以及通过其他的例如面部、手臂运动、语音认知等多个维度识别判断疑似卒中患者的大血管闭塞的风险,基于fast

‑

ed的量表基于不同情况给出评估值,并基于评估值进行风险分级的评估,从而识别是否有大血管闭塞风险,为患者推荐对应的卒中中心前往救治,缩短患者转运时间,提高卒中大血管闭塞的救治率,减少卒中患者的致死率和致残率。

[0130]

以上实施例仅为本公开的示例性实施例,不用于限制本公开,本公开的保护范围由权利要求书限定。本领域技术人员可以在本公开的实质和保护范围内,对本公开做出各种修改或等同替换,这种修改或等同替换也应视为落在本公开的保护范围内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1