一种基于Transformer和长短期记忆网络的污水出水指标BOD5软测量方法

本发明涉及污水出水指标bod5的时序预测领域,特别是涉及一种针对bod5浓度的数据具有非线性、复杂性的软测量技术。本发明是基于高效的多头注意力结构的transformer网络与长短期记忆网络相结合的方法在污水处理bod5软测量领域的具体应用。本发明提高了污水处理中软测量精度并保留了隐藏在时间序列中的时序相关性。

背景技术:

1、水是生态系统和人类健康的重要组成部分。为了确保水资源的可持续利用和环境保护,污水处理过程就尤为重要。污水处理是否达到标准直接影响这生态环境和人体健康。衡量污水处理的质量经常用一些关键的出水指标,比如五日生化需氧量(bod5)是一项用于评估水体中有机污染物浓度的关键指标,该参数定义为有氧生物在特定时间(通常为5天)内在特定温度分解水中有机物所需的溶解氧量。它被用于衡量水体中有机物质分解所需的氧气量。

2、现实污水处理中出水指标的监测往往采用仪器测量,然而有些重要指标通常难以直接测量,这会涉及耗时且昂贵的实验室测试,且测量仪器的精度不稳定,这让出水指标的监测存在滞后性和不稳定性。所以为了提升对污水处理出水指标的监测能力,可以采用间接测量的软测量方法:利用易于测量的辅助变量估算关键变量。在污水处理系统中,利用软测量技术监测产品生产的关键变量,以控制产品质量,降低传统硬件测量的成本。

3、目前bod5软测量建模方法主要有机理建模、经验模型建模和数据驱动建模。机理建模方法为白箱模型,其思路就是将建模对象中发生的全部反应使用公式与方程表达出来,通过这些表达展现出变量间的关系,依据易测变量关系与难测变量间的关系进行计算。机理模型需要知道各参数之间的化学物理关系,较多的化学物理公式,以及操作数据,故其复杂程度高,运算量大,对研究人员拥有的知识要求较高,且模型精度低。经验模型只需关注输入输出变量之间的关系公式来表示系统行为即可,但是模型只注重对平稳状态的描述,难以很好地处理复杂情况和非平稳情况,使用条件有限,模型精度低。数据驱动建模方法为黑箱模型,无需知道各参数之间的内部机理,是一种描述出输入输出变量之间的关系,学习这种关系之后构建出获得输出变量的方法。它的输入通常选择容易测量、采集成本低廉、能够大量获取的变量,而输出变量则是存在测量困难、采集成本昂贵等特点的变量,因此很适合污水处理的相关工作。

4、基于数据驱动的建模方法主要包括多元统计法和人工神经网络法。污水处理中bod5浓度受多种因素的影响,具有较强的非线性特性,而神经网络作为一门非线性科学,适用于对具有多因素性、不确定性、随机性、非线性特点的对象进行研究。然而目前的方法由于使用的神经网络串行计算机制的特点,只能逐步处理数据,无法同时将所有辅助变量的所有历史信息与关键变量进行联系,因此不能准确反应出辅助变量与关键变量之间的权重关系,导致模型软测量结果并不理想。

技术实现思路

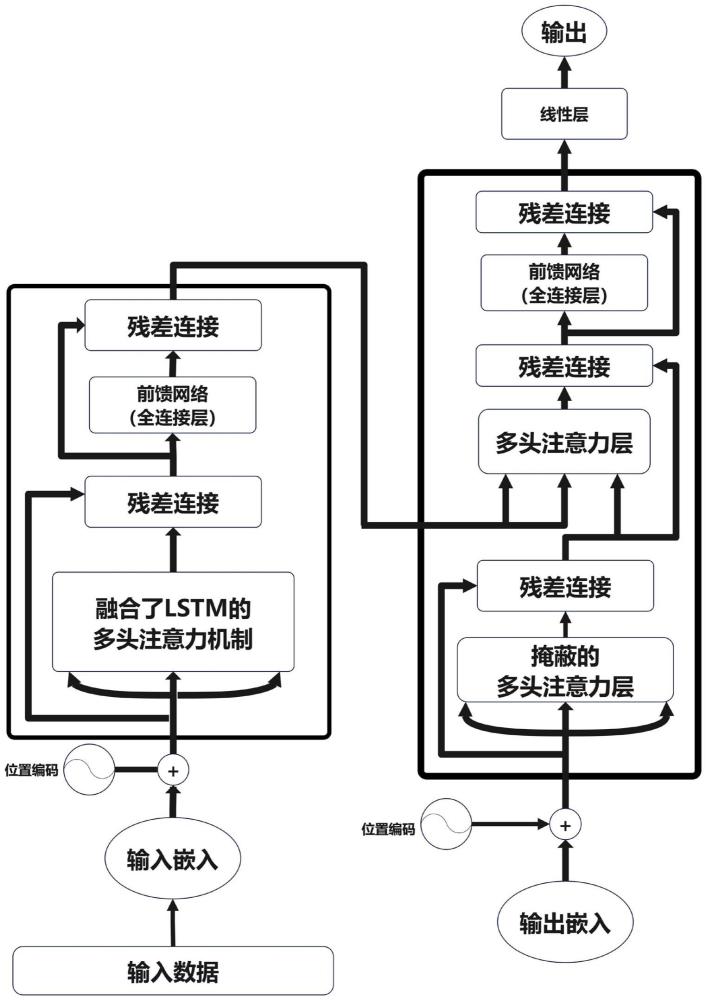

1、为了解决由于bod5软测量过程数据的非线性和时间维度上依赖性导致的软测量结果不准确的问题,本发明提供了一种transformer网络与长短期记忆网络相结合的模型(lstm-former)用于污水处理出水指标bod5的软测量。使用lstm-former将长短期记忆网络加入到transformer的多头注意力层中q、k、v的运算中,通过将数据信息先后经过lstm和多头注意力机制的处理,更进一步解决了污水指标bod5软测量中存在的无法准确分配权重关系的问题。相较于其他神经网络模型,我们的方法独特处在于,这一模型能够利用transformer的多头注意力机制更好地关注到辅助变量与bod5的权重关系,捕捉bod5浓度时间序列数据中的关键特征的同时,也会利用lstm保持对每个辅助变量时间序列数据中的长期依赖关系的关注,弥补了传统transformer模型在单一变量历史信息关注度不足的问题。

2、本发明采用了如下的技术方案及实现步骤:

3、s1:获取某污水处理厂在处理污水之后多个易于测量的出水指标参数和对bod5造成影响的出水指标参数的连续时间数据,构造污水指标原始数据集。

4、s2:对所构造的污水指标初始数据集进行预处理,对异常值进行修正,采用插值法填补数据空缺,构造可用于软测量的完整污水指标数据集。

5、s3:基于预处理后的数据集进行比例划分,构造训练集和测试集。利用训练集数据对lstm-former模型进行参数调优,包括括注意力头层数,模型维度、注意力机制中q、k、v的维度、神经元个数、随机失活率、初始学习率、迭代次数、批次大小。

6、s4:构造可用于软测量bod5浓度的参数调优后的lstm-former模型,确定优化算法,选定激活函数,确保训练序列和原始真实序列之间的动态一致性。

7、s5:基于训练完毕的lstm-former软测量模型对测试集进行预测得到bod5的浓度预测值。并根据预测值与真实值对模型进行性能评估。

8、具体的,受不同的天气环境、降水的影响,随着天气的恶劣情况的增加,bod5浓度的复杂性也随之增加。因此本实验选取暴风雨天气时的污水出水指标数据集对相应天气下的bod5进行浓度软测量。数据集中包含目标变量变量bod5每十五分钟浓度数据以及其他相关变量如可溶性不可降解有机物、可溶性快速可生物降解的有机物、不溶颗粒不可降解有机物、不溶的缓慢可降解有机物、活性异养细菌的生物量、活性自养细菌的生物量、由生物固体衰变而产生的惰性物质、溶解氧、硝酸盐氮、氨氮、可溶性可生物降解有机氮、颗粒状可降解有机氮、碱度和总悬浮固体量。

9、进一步,首先对异常值和空缺值进行检验,然后对异常值进行删除操作,采用中位数插值法对数据集进行空缺值填充。

10、优选的,将数据集的百分之八十五划分为训练集,其余百分之十五划分为测试集。注意力头层数为4,模型维度为512、注意力机制中q、k、v的维度为64、神经元个数为64,随机失活率为0.1,学习率为0.001,迭代次数为200,批次大小为128。

11、进一步,所述模型包含基础lstm框架、一个新的多头注意力运算机制的transformer框架、编码解码输入输出策略和全连接层。lstm细胞单元内部的门结构门结构由三部分组成:遗忘门、输入门和输出门,这些门结构负责对细胞状态和隐藏层状态进行更新。多头注意力层采用全新的运算机制,先将输入序列解码之后输出的q、k、v三个变量分别经过lstm的运算形成新的q、k、v,再将其通过多头注意力机制原本的点积计算、归一化等相关运算,形成最终的注意力头输出。在transformer原因运算机制的基础上先将q、k、v作为lstm输入进行处理,使得模型先从局部具体分析了每个辅助变量历史数据信息中的长期依赖关系,再通过原有注意力机制全局考虑辅助变量和目标变量的权重关系,提高了对系统动态的建模能力。编码解码输入输出结构则是实现了模型对目标序列的输入和输出。全连接层则负责本发明软测量模型最后的结果输出。

12、优选的,所述软测量模型中的损失函数采用标准归一化mse,激活函数采用relu函数,s4的训练过程中,通过adam函数进行学习。

13、与现有技术相比,本发明的有益效果是:

14、(1)将长短期记忆网络融入到transformer网络的多头注意力层的运算中,增强了模型训练时对每个辅助变量的历史信息的分析能力,解决了传统transformer在单一辅助变量历史信息关注度不足的问题。

15、(2)精巧独特的lstm-former结构设计,使得模型既利用transformer的并行计算能力全局考虑辅助变量对关键变量的影响,又利用lstm关注每个辅助变量的序列中的长期依赖关系,更准确地捕捉bod5的数据特征,提高了模型对具有长期依赖特性数据进行软测量时的精度。

- 还没有人留言评论。精彩留言会获得点赞!