一种并联机器人优化方法与流程

1.本发明属于工业机器人技术领域,具体涉及并联机器人优化方法。

背景技术:

2.相较于串联机器人,并联机器人可达到更加高速,高加速度运动,具有更高精度,更高的负载重量比等等优点,因此并联机器人被广泛应用于工业机器人领域,其中商业应用最成功的并联构型为delta构型,双scara构型以及gough-stewart构型。综合考虑到机器人的工业制造成本问题,并联机器人需要在满足给定的灵巧工作空间的前提下,尽可能的缩小机器人的体积,并且获得尽可能高的控制精度。因此对工业用并联机器人进行相应的优化设计显得尤为必要。

3.尽管有大量的文献,研究成果都对并联机器人的控制问题进行了研究,但是其本身的高结构复杂度,控制输入输出的复杂的非线性关系都增加了其精准控制的难度。传统的并联机器人控制方法都是基于内置传感器的机器人模型法,其控制精度严重依赖于极其精准的机器人模型,并且在实际应用当中,由于制造误差,装配误差累积等原因,精准的机器人模型也无法保证并联机器人的控制精度。因此,采用基于外置视觉传感器的视觉伺服控制方法控制并联机器人,可绕过并联机器人的复杂的结构模型,从而获得极佳的控制精度。

4.但是采用视觉伺服控制方法时,视觉传感器类型与位置,待观测视觉目标特征的种类等都会对最终的控制精度产生影响,因此单纯的对并联机器人做出优化设计不能保证获得最佳的控制精度。

技术实现要素:

5.本发明的目的在于提供一种并联机器人优化方法,旨在解决现有的并联机器人的控制精度较低的问题。

6.为实现上述技术目的,本发明采用的技术方案如下:包括以下步骤:

7.确定并联机器人的构型,并为所述并联机器人选定视觉传感器;

8.基于所述视觉传感器建立所述并联机器人的视觉几何投影模型,并对所述视觉几何投影模型进行一阶微分,得到图像雅克比矩阵和并联机器人的基于视觉伺服的运动学方程;

9.基于所述图像雅克比矩阵构建视觉伺服定位误差模型;

10.在可达工作空间内规避第一类奇异、第二类奇异和视觉伺服控制器奇异,得到灵巧工作空间;

11.基于所述视觉伺服定位误差模型和所述灵巧工作空间进行组合优化设计,得到最优视觉传感器加并联机器人组合方案。

12.其中,所述确定并联机器人的构型,并为所述并联机器人选定视觉传感器,包括:

13.确定代优化并联机器人的驱动关节和自由度;

14.基于所述自由度确定视觉伺服待观测图像特征的类型和个数;

15.基于所述类型和所述个数为所述并联机器人选定视觉传感器。

16.其中,所述基于所述视觉传感器建立所述并联机器人的视觉几何投影模型,并对所述几何投影模型进行一阶微分,得到图像雅克比矩阵以及视觉伺服运动学方程,包括:

17.以所述视觉传感器为坐标系原点建立传感器坐标系;

18.基于所述传感器坐标系通过小孔成像原理生成图像特征在相机中的成像图像,得到视觉几何投影模型;

19.对所述视觉几何投影模型进行一阶微分,得到图像雅克比矩阵以及视觉伺服运动学方程。

20.其中,所述基于所述图像雅克比矩阵构建视觉伺服定位误差模型,包括:

21.使用所述图像雅克比矩阵描述图像噪声与位移之间的关系,得到描述关系;

22.基于所述描述关系构建视觉伺服定位误差模型。

23.其中,所述在可达工作空间内规避第一类奇异、第二类奇异和视觉伺服控制器奇异,得到灵巧工作空间,包括:

24.计算所述并联机器人的可达工作空间;

25.通过机器人正向运动学,采用rand函数在各所述驱动关节的运动范围内产生随机数值作为随机变量;

26.基于所述随机变量通过正向运动学计算,得到末端对应的位姿;

27.基于所述末端对应的位姿得到可达工作空间范围;

28.基于所述可达工作空间范围通过所述图像雅克比矩阵计算,得到第一类奇异、第二类奇异和视觉伺服控制器奇异;

29.在所述可达工作空间内规避所述第一类奇异、所述第二类奇异和所述视觉伺服控制器奇异,得到灵巧工作空间。

30.其中,所述基于所述视觉伺服定位误差模型和所述灵巧工作空间进行组合优化设计,得到最优视觉传感器加并联机器人组合方案,包括:

31.建立目标函数;

32.基于所述目标函数确定优化设计参数,其中,所述优化设计参数包括视觉传感器参数,也包括并联机器人尺寸参数;

33.基于所述优化设计参数、所述视觉伺服定位误差模型和所述灵巧工作空间建立全局性能评价指标;

34.基于所述全局性能评价指标对所述并联机器人的所述可达工作空间内设置离散节点,计算所述离散节点函数值的平均值,得到最优视觉传感器加并联机器人组合方案。

35.本发明提供了一种并联机器人优化方法,通过确定并联机器人的构型,并为所述并联机器人选定视觉传感器;基于所述视觉传感器建立所述并联机器人的视觉几何投影模型,并对所述视觉几何投影模型进行一阶微分,得到图像雅克比矩阵和并联机器人的基于视觉伺服的运动学方程;基于所述图像雅克比矩阵构建视觉伺服定位误差模型;在可达工作空间内规避第一类奇异、第二类奇异和视觉伺服控制器奇异,得到灵巧工作空间;基于所述视觉伺服定位误差模型和所述灵巧工作空间进行组合优化设计,得到最优视觉传感器加并联机器人组合方案。本发明将机器人与传感器看做一个相互配合的整体,其参数做出相

应优化,可以保证得到最佳的控制效果,解决了现有的并联机器人的控制精度较低的问题。

附图说明

36.本发明可以通过附图给出的非限定性实施例进一步说明。

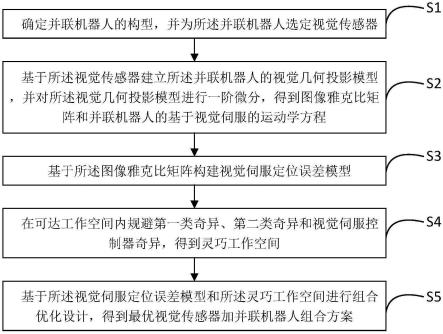

37.图1为本发明提供的一种并联机器人优化方法的流程图。

38.图2为确定并联机器人的构型,并为所述并联机器人选定视觉传感器的流程图。

39.图3为基于所述视觉传感器建立所述并联机器人的视觉几何投影模型,并对所述视觉几何投影模型进行一阶微分,得到图像雅克比矩阵和并联机器人的基于视觉伺服的运动学方程的流程图。

40.图4为基于所述图像雅克比矩阵构建视觉伺服定位误差模型的流程图。

41.图5为在可达工作空间内规避第一类奇异、第二类奇异和视觉伺服控制器奇异,得到灵巧工作空间的流程图。

42.图6为基于所述视觉伺服定位误差模型和所述灵巧工作空间进行组合优化设计,得到最优视觉传感器加并联机器人组合方案的流程图。

43.图7为本发明提供的一种并联机器人优化方法的流程图的原理图。

具体实施方式

44.为了使本领域的技术人员可以更好地理解本发明,下面结合附图和实施例对本发明技术方案进一步说明。

45.如图1-7所示,本发明提供了一种并联机器人优化方法,包括以下步骤:

46.s1确定并联机器人的构型,并为所述并联机器人选定视觉传感器;

47.具体方式为:

48.s11确定代优化并联机器人的驱动关节和自由度;

49.具体的,首先需要确定待优化的并联机器人的类型(拥有几个驱动关节,几个自由度)。

50.s12基于所述自由度确定视觉伺服待观测图像特征的类型和个数;

51.具体的,根据所优化的并联机器人自由度,确定视觉伺服待观测图像特征类型和个数,保证图像特征的个数大于并联机器人的自由度以保证可以实现完全控制。

52.s13基于所述类型和所述个数为所述并联机器人选定视觉传感器。

53.s2基于所述视觉传感器建立所述并联机器人的视觉几何投影模型,并对所述视觉几何投影模型进行一阶微分,得到图像雅克比矩阵和并联机器人的基于视觉伺服的运动学方程;

54.具体方式为:

55.s21以所述视觉传感器为坐标系原点建立传感器坐标系;

56.s22基于所述传感器坐标系通过小孔成像原理生成图像特征在相机中的成像图像,得到视觉几何投影模型;

57.具体的,以视觉传感器为坐标系原点建立传感器坐标系,通过小孔成像原理得到图像特征在相机中的成像图像,即为从并联机器人任务空间到图像特征空间的映射模型。

58.s23对所述视觉几何投影模型进行一阶微分,得到图像雅克比矩阵以及视觉伺服

运动学方程。

59.具体的,对此模型进行一阶微分,可以得到机器人末端速度到图像空间内图像特征变化速度的图像雅克比矩阵(其中代表图像空间内的图像特征变化速度,τc代表传感器坐标下并联机器人末端速度,l为基于图像s的图像雅克比矩阵。

60.s3基于所述图像雅克比矩阵构建视觉伺服定位误差模型;

61.具体方式为:

62.s31使用所述图像雅克比矩阵描述图像噪声与位移之间的关系,得到描述关系;

63.具体的,建立视觉伺服定位误差模型。由于视觉传感器的观测噪声是造成视觉伺服定位误差的直接原因,因此分析所选视觉传感器性能,选定噪声范围(即

±

p像素)。因视觉传感器的噪声都极小,因此可以采用步骤一中得到的机器人末端速度到图像空间内图像特征变化速度的模型方程来描述极其微小的图像噪声(即图像变化量)与并联机器人末端的微小位移(即并联机器人视觉伺服定位误差)之间的关系。

64.s32基于所述描述关系构建视觉伺服定位误差模型。

65.具体的,得到视觉伺服中对于图像观测噪声的定位误差模型δx=l

+

δp(其中δp为选定的图像观测噪声,此处为

±

p个像素点,l

+

为图像雅克比矩阵的伪逆,δx为计算得到的并联机器人视觉伺服的定位误差)。

66.s4在可达工作空间内规避第一类奇异、第二类奇异和视觉伺服控制器奇异,得到灵巧工作空间;

67.具体方式为:

68.s41计算所述并联机器人的可达工作空间;

69.具体的,并联机器人的工作空间分为可达空间和灵巧工作空间。首先对选定的待优化并联机器人,计算可达工作空间。对于自由度低的并联机器人(自由度不大于3),可采用几何分析法得到其可达工作空间,即完全展开并联机器人的单个支腿时的位姿轨迹就是并联机器人的可达工作空间;对于自由度高的并联机器人(自由度大于3),采用蒙特卡洛法数值分析其可达工作空间。

70.s42通过机器人正向运动学,采用rand函数在各所述驱动关节的运动范围内产生随机数值作为随机变量;

71.s43基于所述随机变量通过正向运动学计算,得到末端对应的位姿;

72.s44基于所述末端对应的位姿得到可达工作空间范围;

73.s45基于所述可达工作空间范围通过所述图像雅克比矩阵计算,得到第一类奇异、第二类奇异和视觉伺服控制器奇异;

74.具体的,首先要建立并联机器人的运动学模型其中为并联机器人的驱动关节速度,τ为并联机器人末端速度。矩阵a的行列式det(a)=0时,并联机器人遭遇第一类奇异位姿,此时并联机器人失去一个或以上自由度。矩阵b的行列式det(b)=0时,并联机器人遭遇第二类奇异为,此时并联机器人获得一个或以上的自由度。根据两个行列式数值大小可以判定当前位姿距离各类奇异位姿的距离。同时在视觉伺服中,由于控制器奇异导致系统失去稳定性,控制精度变差,因此要避免出现此类情况。根据步骤一中得到的图像雅克比矩阵 l,对其求的条件数倒数,即可得到矩阵l失秩的条件,根据其条件数倒数的大小可以评价当前位姿距离控制器奇异点的距离。

75.s46在所述可达工作空间内规避所述第一类奇异、所述第二类奇异和所述视觉伺服控制器奇异,得到灵巧工作空间。

76.s5基于所述视觉伺服定位误差模型和所述灵巧工作空间进行组合优化设计,得到最优视觉传感器加并联机器人组合方案。

77.具体方式为:

78.s51建立目标函数;

79.具体的,建立目标函数,对于此优化方法,其目的在于设计得到最小的并联机器人,因此目标函数为此并联机器人的体积,优化目标为min(v),v为待优化并联机器人的体积。

80.s52基于所述目标函数确定优化设计参数;

81.具体的,确定优化设计参数x,在本优化设计中,优化参数分为两部分,一部分为并联机器人的几何参数(底部半径,各连杆长度,末端执行器半径等影响并联机器人几何尺寸的所有参数),第二部分为传感器参数(包括传感器所处空间坐标,角度,带观测图像特征尺寸等)。所述优化设计参数包括视觉传感器参数,也包括并联机器人尺寸参数。

82.s53基于所述优化设计参数、所述视觉伺服定位误差模型和所述灵巧工作空间建立全局性能评价指标;

83.具体的,确定全局性能评价指标(包括并并联机器人在给定位置的定位精度,并联机器人距离第一类奇异,第二类奇异,控制器奇异位置的距离)。

84.δx≤x

max

(δx为步骤二中通过视觉伺服定位误差模型计算得到的数值,x

max

为提前设定的最大定位误差);

85.det(a)》damin(det(a)为并联机器人当前位姿矩阵a的行列式数值,damin为设定的行列式最小值,此处限制可保证并联机器人远离第一类奇异位姿);

86.det(b)》dbmin(det(b)为并联机器人当前位姿矩阵b的行列式数值,dbmin为设定的行列式最小值,此处限制可保证并联机器人远离第二类奇异位姿);

87.k-1

(l)>10-3

(其中k-1

(l)为图像雅克比矩阵l的逆条件数范数,此处限制可保证视觉伺服并联机器人远离控制器奇异位姿)。

88.s54基于所述全局性能评价指标对所述并联机器人的所述可达工作空间内设置离散节点,计算所述离散节点函数值的平均值,得到最优视觉传感器加并联机器人组合方案。

89.上述实施例仅示例性说明本发明的原理及其功效,而非用于限制本发明。任何熟悉此技术的人士皆可在不违背本发明的精神及范畴下,对上述实施例进行修饰或改变。因此,凡所属技术领域中具有通常知识者在未脱离本发明所揭示的精神与技术思想下所完成的一切等效修饰或改变,仍应由本发明的权利要求所涵盖。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1