一种基于颜色概率模型的机械臂视觉驱动控制方法与流程

本发明属于视觉感知驱动,具体涉及一种基于颜色概率模型的机械臂视觉驱动控制方法。

背景技术:

1、室内场景距离传感技术的发展已经带来了大量的落地视觉应用,协作机器人作为人机交互的重要技术手段,与视觉感知的结合能够显著提升生产的灵活性和自动化程度,降低人工操作复杂度,防范一些安全隐患,并提高生产效率。因此,在协作机械臂嵌入智能视觉系统,将机器人视觉算法与硬体及软体设备整合在一起是实现人机交互的有效方案。静止场景的自主抓取和操纵已被广泛研究多年,解决了结构化车间等场景的非人工作业问题。然而针对非合作动态场景的机械臂跟踪导引适用于机器人从事更高级、更灵活的工程应用,但相比之下动态导引更具挑战性,当前行业内尚未出现成熟的该类系统装置或解决方案,依赖于机器人系统搭配更加强大的算力与环境感知能力。

2、视觉驱动通常基于彩色/灰度/深度图像,如果要跟踪的对象只有弱纹理跟踪、单一的颜色特征或仅采用距离感知可能会跟踪失败,不具备连续可控的视觉反馈,难以指导机械臂执行动态场景下的精细化任务(如动态拾贴装、拾取工件等)。目前国内外一些学者研究了动态的机械臂视觉驱动技术。针对视觉伺服驱动过程目标脱离相机视野等缺陷,马洪轩等人公开的“基于视觉伺服的机械臂目标导引方法”,专利号cn 110116410 a,在机械臂本体与目标上预置了标志物且规定了形状以及标志点坐标关系,不适用于非合作目标的跟踪导引且难以保证标志点同时被移动机器人搭载的相机平台所捕获;针对机械臂大范围的高精度跟踪目标与位置定位技术难点,孟浩等人公开的“一种多目相机和线激光辅助机械臂跟踪目标的方法和装置”,专利号cn 114378808a,适用于结构化环境的精确跟踪导引,但当目标物位置变动(如柱状工件滚动)或机械臂基坐标系移动(如安装于移动平台),机械臂末端工具无法实时对目标物做出位姿调整。综上可见,对于动态场景下的机械臂精细化作业任务,传统的视觉驱动控制难以实现机械臂末端工具对目标物的实时姿态调整、无法提供连续精确的视觉反馈。

技术实现思路

1、针对现有技术中存在的缺陷,本发明的目的在于提供一种基于颜色概率模型的机械臂视觉驱动控制方法,使用该方法能够明显改善目标受遮挡、形变的影响,实现机械臂末端工具对目标物的实时姿态调整,视觉驱动机械臂执行精细化作业任务。

2、为实现上述目的,本发明采用的技术方案如下:

3、一种基于颜色概率模型的机械臂视觉驱动控制方法,所述方法在一种基于颜色概率模型的机械臂视觉驱动控制系统上实施,所述系统主要包括视觉模块、机械臂和工作台,其中所述视觉模块包括右目相机和左目相机,所述右目相机和左目相机固定安装在框架上,所述机械臂末端安装有操作工具,目标物放置在所述工作台上;

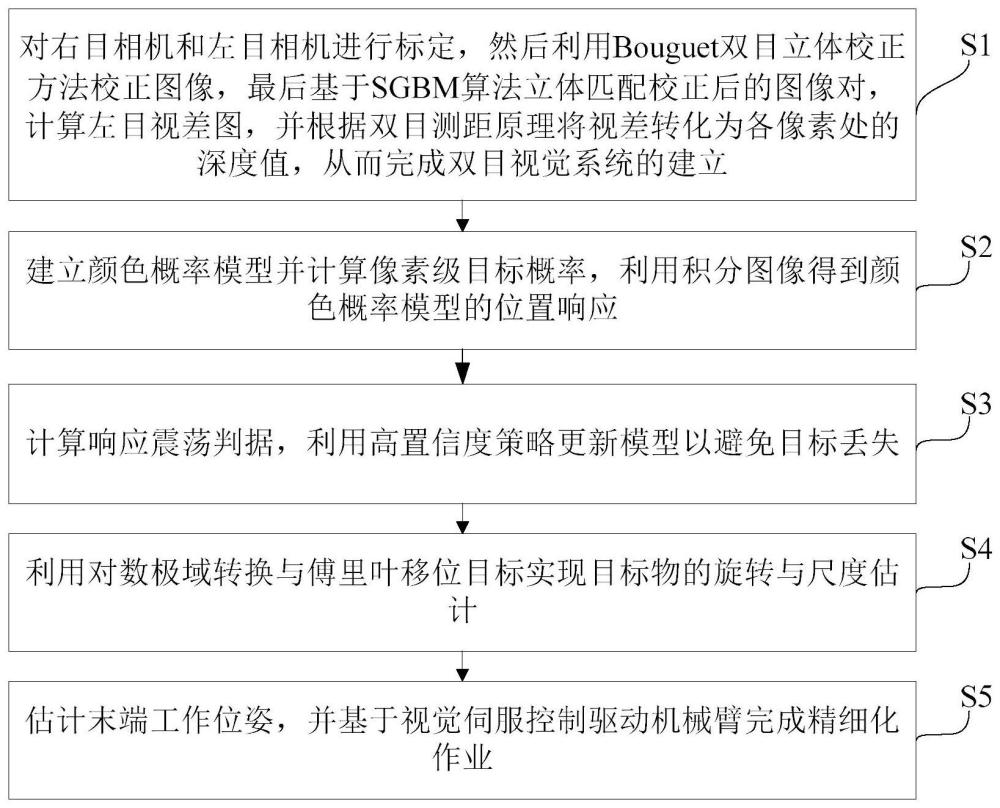

4、所述方法包括以下步骤:

5、s1、对右目相机和左目相机进行标定,然后利用bouguet双目立体校正方法校正图像,最后基于sgbm算法立体匹配校正后的图像对,计算左目视差图,并根据双目测距原理将视差转化为各像素处的深度值,从而完成双目视觉系统的建立;

6、s2、建立颜色概率模型并计算像素级目标概率ρ,利用积分图像得到颜色概率模型的位置响应f;

7、s3、计算响应震荡判据,利用高置信度策略更新模型以避免目标丢失;

8、s4、利用对数极域转换与傅里叶移位目标实现目标物的旋转与尺度估计;

9、s5、估计末端工作位姿,并基于视觉伺服控制驱动机械臂完成精细化作业。

10、进一步,如上所述的基于颜色概率模型的机械臂视觉驱动控制方法,步骤s1中对右目相机和左目相机进行标定具体为:

11、采用张氏标定法对右目相机和左目相机标定,通过多次拍摄标定板,分别获取左目相机和右目相机的内参矩阵ml/mr、畸变参数矩阵dl/dr与外参矩阵;利用外参矩阵解得左、右目相机坐标系之间的相对关系:旋转矩阵r、平移矩阵t、本征矩阵e和基础矩阵f。

12、进一步,如上所述的基于颜色概率模型的机械臂视觉驱动控制方法,步骤s1中利用bouguet双目立体校正方法校正图像具体为:

13、左、右目相机各旋转r的一半实现图像平面共面,再建立行对准换行矩阵rrec,使极点转换到无穷远处实现行对准,使两图像中的每一幅重投影次数最小化,同时使得观测面积最大化;行对准换行矩阵rrec的表达式为:

14、

15、将rrec左乘到分解得到左、右目相机平面共面的校正旋转矩阵:

16、

17、同时获取两相机透视投影矩阵pl与pr,重投影矩阵q,由校正结果计算校正查找映射表,使得两幅图像共面并且行对准,并对校正图像裁剪,使得左右视图的主点重合。

18、进一步,如上所述的基于颜色概率模型的机械臂视觉驱动控制方法,步骤s1中各像素处深度值的计算方法为:

19、depth=f×baseline/disp (3)

20、式(3)中,f表示相机焦距;baseline表示两个相机光心之间的距离,即基线距离;disp表示视差值。

21、进一步,如上所述的基于颜色概率模型的机械臂视觉驱动控制方法,步骤s2中采用基于颜色直方图的贝叶斯分类器估计似然项,得到像素级目标概率ρ,计算公式为:

22、

23、式(4)中:ρ表示每一像素位置是目标的可能性,表达像素级概率;x为像素值,bx表示分配给m(x)的颜色模块的区间b,表示在ω∈m区域上计算的基于颜色的直方图h的区间大小。

24、进一步,如上所述的基于颜色概率模型的机械臂视觉驱动控制方法,步骤s2中积分图像中(x,y)处的值的计算公式为:

25、

26、

27、式(5)中:i(x,y)为原图像像素,为积分图像在(x,y)处的值;

28、颜色概率模型的位置响应计算公式为:

29、

30、进一步,如上所述的基于颜色概率模型的机械臂视觉驱动控制方法,步骤s3中响应震荡判据的计算公式为:

31、

32、式(8)中,fmax、fmin、fw,h分别表示响应最大值、最低值以及位置(m,n)上的响应值;当fmax与ψ都以设定比例大于历史均值时对模型更新,以避免错误的更新污染模型导致跟踪失败。

33、进一步,如上所述的基于颜色概率模型的机械臂视觉驱动控制方法,步骤s4具体为:

34、直角坐标系{r}同对数极坐标系{l}之间的转换关系为:

35、f2(x,y)=f1(x-x0,y-y0) (9)

36、对式(9)进行离散傅立叶变换后,映射到频域上具有如下形式:

37、

38、基于傅里叶位移定理,计算感知图像和参考图像的交叉功率谱:

39、

40、记单位脉冲函数为为傅里叶反变换,c(ξ,η)有如下性质:

41、

42、由此可得峰值的位置,将笛卡尔域的缩放和旋转转化为对数极域的平移,实现目标的尺度与旋转估计:

43、

44、式(13)中,l为旋转轴长度,为估计的尺度因子,为估计的缩放因子。

45、进一步,如上所述的基于颜色概率模型的机械臂视觉驱动控制方法,步骤s5具体为:

46、s51、完成机械臂手眼标定,建立末端工具坐标系相对于机械臂基坐标系间的坐标关系

47、s52、根据已建立的双目立体视觉与手眼关系,将位于左目图像中初始目标物的中心点坐标转换至机器人基坐标系,采用基于位置的视觉伺服导引末端工具至初始位姿;

48、s53、机械臂在颜色概率模型与尺度/旋转估计的驱动下,采用基于图像的视觉伺服动态跟随目标物运动,实现精细化操作。

49、与现有技术相比,本发明提供的基于颜色概率模型的机械臂视觉驱动控制方法,具有以下有益效果:

50、本发明将机械臂控制技术与基于颜色直方图的视觉感知技术相结合,首先建立双目视觉系统,由sgbm立体匹配计算视差并转换为深度值;其次,基于颜色直方图估计似然项得到像素级目标概率,并设计一种位置响应震荡约束的高置信度模型更新策略以避免目标丢失;之后利用对数极域转换与傅里叶移位目标实现目标物的转角与尺度估计,估计末端工作位姿并基于视觉伺服控制率驱动机械臂完成精细化作业。

51、该方法应用低成本的双目相机视觉驱动机械臂,执行精细操作任务,对目标物遮挡、形状改变和旋转鲁棒。本发明提供的方法行之有效,过程简单明了。

- 还没有人留言评论。精彩留言会获得点赞!