本技术涉及火灾防护领域,特别涉及一种前端灭火机器人控制方法及系统。

背景技术:

1、随着我国工业化、城镇化进程的不断推进,大型工业园区、城市建设工地不断增多。然而,这些区域由于环境复杂、可燃物众多,一旦发生火灾往往难以及时发现和扑救,极易造成重大人员伤亡和财产损失。传统的消防模式主要依靠固定的火灾报警设施和人工灭火,存在反应速度慢、覆盖范围有限、灭火效率低等问题,难以满足当前复杂多变的消防安全需求。因此,亟需研发一种能够实现早期火情探测、快速响应、自主灭火的智能消防装备,提升复杂环境的火灾防控和处置能力。

2、近年来,以机器人、物联网、人工智能为代表的新兴技术蓬勃发展,为解决上述消防安全问题提供了新思路。一些学者提出利用智能灭火器机器人实现火情自主探测和灭火作业,通过环境感知、自主导航、智能决策等技术使机器人具备类似于人的智能行为能力,代替消防员执行高危火灾扑救任务。同时,通过大范围部署火灾传感器组成物联网,并将其感知数据用于指挥调度灭火器机器人,可有效扩大火情监测范围,提高灭火装备的反应速度和协同作业效率。将智能灭火器机器人与物联网技术相结合,形成“传感感知-智能分析-自主执行”的全链条智能消防模式,有望从根本上提升复杂环境的火灾预防和应急处置水平。

3、目前,施工工地和工业园区的消防安全问题日益突出。由于这些区域环境复杂多变,部署传统的固定式火灾探测和灭火设施存在诸多不足:一是工地建筑物和设施需要随施工进度实时变化,固定式消防装备难以做到灵活布防;二是大型园区存在大量空旷区域,固定式消防装备覆盖成本高,难以实现全区域监控;三是一旦发生火灾,固定式灭火装置的响应范围有限,难以对大范围火情实施有效扑救。

4、现有的移动式消防装备如遥控履带式消防车,虽然在一定程度上克服了固定式装备的不足,但仍需消防人员现场操控,灭火效率低,且存在人员受伤风险。一些学者针对上述问题,提出利用智能灭火器机器人实现火情自主探测和移动灭火作业。然而,现有的灭火器机器人大多采用单一的本体传感器,难以全面感知复杂火灾环境,导航能力有限,无法适应大范围区域作业需求。此外,由于缺乏与环境监测传感网络的信息交互,机器人获取的火情信息不完备,难以做到火灾早期预警和主动灭火。

5、因此,亟需突破以下技术瓶颈:一是研究复杂环境下多源异构传感器的智能融合与火情区域精确定位技术;二是研究复杂环境下灭火器机器人的自主定位、避障导航与移动作业技术;三是研究消防物联网与智能机器人的信息交互与协同作业调度技术,实现火情的早期预警和主动灭火。

技术实现思路

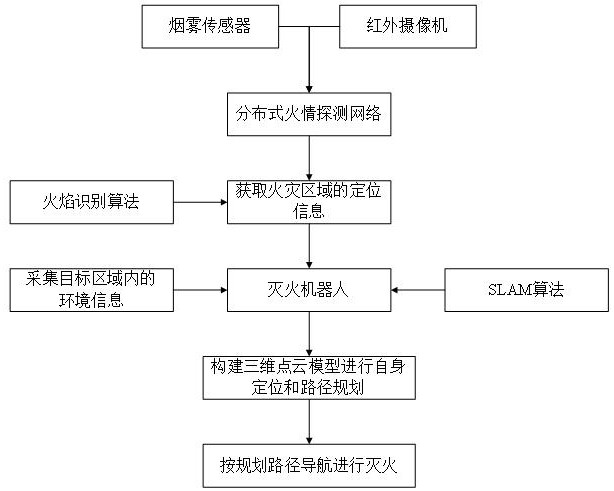

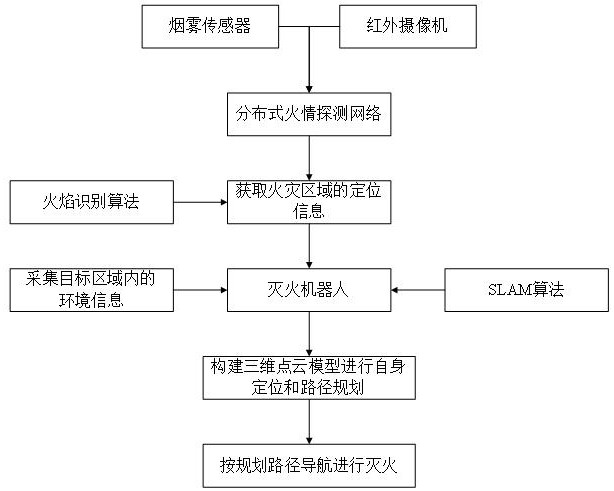

1、针对现有技术中存在的复杂环境下灭火机器人导航能力差的问题,本技术提供了一种前端灭火机器人控制方法及系统,通过组建分布式火情探测网络,利用贝叶斯推理获取火情的精确位置,并根据获取的位置对目标区域进行建图定位和路径规划,以及对规划的路径进行闭环检测等,提高了在复杂环境下灭火机器人的路径导航能力。

2、本技术的目的通过以下技术方案实现。

3、本技术的一个方面提供一种前端灭火机器人控制方法,包括:在目标区域内设置多个烟雾传感器和红外摄像机,烟雾传感器和红外摄像机通过无线通信方式与灭火机器人连接,组成分布式火情探测网络;当分布式火情探测网络通过火焰识别算法监测到火灾时,将发生火灾区域的定位信息发送给灭火机器人;灭火机器人接收到火灾区域的定位信息后,利用搭载的激光雷达传感器采集目标区域内的环境信息,采用同步定位与地图构建slam算法,建立区域内建筑物的三维点云模型,利用构建的三维点云模型进行自身定位和导航路径规划。

4、灭火机器人根据规划的导航路径,导航到发生火灾的区域,进行灭火。包括:灭火机器人根据规划的导航路径,利用激光雷达和视觉传感器感知环境,通过局部路径规划算法dwa,根据局部环境信息和目标点位置,自主导航到火灾区域;达到火灾区域后,控制机器人上的可见光摄像机和红外热成像仪采集火灾现场图像,将采集的可见光图像和红外图像进行配准融合,利用深度学习目标检测算法yolov3,检测火焰区域;将检测到的火焰区域在红外图像中进行定位,根据红外成像仪的内外参数,将火焰像素坐标转换为三维空间坐标,得到火源位置信息;根据火源位置信息控制灭火装置对准火源进行灭火。

5、进一步的,在目标区域内设置多个烟雾传感器和红外摄像机,烟雾传感器和红外摄像机通过无线通信方式与灭火机器人连接,组成分布式火情探测网络,包括:在目标区域的不同位置设置多个烟雾传感器和红外摄像机;其中,烟雾传感器用于检测烟雾浓度,红外摄像机用于采集红外图像;在每个烟雾传感器和红外摄像机上集成lora或wifi无线通信模块,将每个烟雾传感器和红外摄像机的位置信息与在系统中绑定;系统平台实时接收各个传感器节点的数据并进行火情分析及数据预处理。

6、进一步的,当分布式火情探测网络通过火焰识别算法监测到火灾时,将发生火灾区域的定位信息发送给灭火机器人,包括:系统平台将预处理后的各个传感器节点的烟雾浓度数据和红外图像数据进行多源信息融合,采用贝叶斯推理方法,建立火情概率模型;在火情概率模型中,将烟雾浓度数据和红外图像数据作为观测量,将火情发生的概率作为隐变量,通过贝叶斯推理计算在给定观测量的条件下火情发生的后验概率;根据后验概率超过阈值的传感器节点,确定出现火情的区域,将确定区域内传感器节点的位置信息,作为火灾区域的初步定位信息;将初步定位信息传送给灭火机器人,灭火机器人根据自身位置、环境数据确定行走的起始点及终点及导航路径。在到达火灾发生区域以后灭火机器人会根据自身火焰探测器寻找最终起火点,并进行局部导航

7、进一步的,系统平台将预处理后的各个传感器节点的烟雾浓度数据和红外图像数据进行多源信息融合,采用贝叶斯推理方法,建立火情概率模型,包括:将每个传感器节点定义为马尔科夫随机场中的一个节点,节点的观测量为对应节点采集的烟雾浓度数据和红外图像数据;根据传感器节点在空间上的分布,确定每个节点的邻域节点集合,将节点的观测量与邻域节点的观测量进行关联,构建节点之间的空间相关性;基于节点之间的空间相关性,建立马尔科夫随机场模型,将火情发生的状态定义为随机场的隐变量,将所有节点的观测量定义为随机场的观测变量;在马尔科夫随机场中,定义能量函数e(x);采用最小化能量函数e(x),求解马尔科夫随机场中火情发生的最大后验概率估计。

8、进一步的,在马尔科夫随机场中,定义能量函数e(x):,其中,x表示火情发生的状态;表示第i个节点的火情状态,y表示所有节点的观测量,表示第i个节点的观测量;表示第i个节点的局部证据函数,度量观测量与火情状态的相容性,取值越大表示观测量越支持该火情状态,其计算公式为:,其中,和分别表示第i个节点在火情状态xᵢ下的观测量均值和协方差矩阵;表示第i个节点和第j个节点之间的空间相关性函数,度量相邻节点火情状态的相关强度,取值越大表示两个节点的火情状态越趋于一致,其计算公式为:,其中,表示火情状态和之间的距离度量,为相关强度参数;z(y)表示配分函数,用于归一化概率分布,使后验概率p(x|y)的累积概率等于1,其计算公式为:。

9、能量函数综合考虑了节点的局部观测证据和节点间的空间相关性对火情状态估计的影响,通过局部证据函数度量观测量与火情状态的相容性,通过空间相关性函数度量相邻节点火情状态的相关强度,同时用分配函数z(y)对概率分布进行归一化。在最小化能量函数求解火情状态估计时,局部证据项∑iφi(xi,yj)使估计结果与观测数据相吻合,空间相关项∑ijψij(xi,xj)使相邻节点的估计结果趋于一致,两项相互制约,共同作用,使马尔科夫随机场模型能够在观测证据和空间相关性之间取得平衡,更准确地推断出火情发生的位置。该能量函数充分利用了传感器数据的空间相关特性,提高了复杂环境下火情定位的鲁棒性和可靠性。

10、进一步的,灭火机器人对初步定位信息进行校验和优化,得到火灾区域的最终定位信息,包括:采用粒子滤波算法对初步定位信息进行优化,根据火情区域内传感器节点的位置分布,初始化一组粒子样本,每个粒子包含火情位置、粒子先验权重和节点观测数据;根据每个粒子包含的火情位置,估计相应粒子处的烟雾浓度分布和红外辐射分布,将粒子处的估计分布与节点采集的观测数据进行比较,计算对应粒子的似然概率;将粒子的似然概率乘以相应的先验权重,得到粒子的后验权重;根据粒子样本中各个粒子的后验权重,对粒子样本进行重采样,保留后验权重大于阈值的粒子,得到重采样后的粒子样本集合;对重采样后的粒子样本集合迭代进行粒子后验权重计算和粒子重采样,更新粒子样本集合,直至粒子样本集合的分布收敛或迭代次数达到阈值;对收敛后的粒子样本集合中的各个粒子的火情位置进行加权平均,得到火情位置的最大后验概率估计,作为火情区域的最终定位信息。

11、进一步的,灭火机器人接收到火灾区域的定位信息后,利用搭载的激光雷达传感器采集目标区域内的环境信息,采用同步定位与地图构建slam算法,建立区域内建筑物的三维点云模型,利用构建的三维点云模型进行自身定位和导航路径规划,包括:灭火机器人在接收到火灾区域的定位信息后,利用搭载的激光雷达传感器对目标区域进行360°扫描,获取区域内建筑物和障碍物的原始点云数据;对原始点云数据进行下采样以减少数据量,并利用随机采样一致性算法ransac去除地面点,获取预处理后的点云数据;将预处理后的点云数据输入到同步定位与地图构建算法中,获取灭火机器人在目标区域内的实时位姿,并根据实时位姿建立区域内建筑物的三维点云地图;将三维点云地图投影至二维平面,采用栅格地图的形式表示,以灭火机器人当前位置为起点,火灾区域定位信息为目标点,构建起点到目标点的代价地图;在代价地图上,采用a*搜索算法,规划灭火机器人从起点到目标点的导航路径。灭火机器人根据自身位置、环境数据确定行走的起始点及终点及导航路径,在到达火灾发生区域以后灭火机器人会根据自身火焰探测器寻找最终起火点,并进行局部导航。

12、进一步的,将预处理后的点云数据输入到同步定位与地图构建算法中,获取灭火机器人在目标区域内的实时位姿,并根据实时位姿建立区域内建筑物的三维点云地图,包括:以灭火机器人的初始位置为原点,根据灭火机器人的实时位姿,将预处理后的点云数据进行坐标转换,得到以机器人当前位姿为参考系的局部点云地图;将局部点云地图和机器人位姿输入到同步定位与地图构建算法中,采用基于图优化的方法构建因子图模型;根据激光雷达数据和机器人运动模型,采用扩展卡尔曼滤波算法对机器人位姿进行预测,得到机器人位姿的先验估计,并将预测的位姿作为激光雷达里程计因子添加到因子图模型中;在因子图模型中,以激光雷达里程计因子、回环检测因子和局部地图因子作为图中边,构建图中节点间的几何约束关系;通过提取局部点云地图中包含角点和平面点的特征点,采用基于外观和空间几何信息的闭环检测算法,判断机器人当前位置是否达到过先前位置;若检测到闭环,则在因子图模型中添加闭环因子;以构建的因子图模型为基础,构建非线性最小二乘优化问题,求解因子图模型中各节点的最优位姿和特征点位置;将优化后的机器人位姿作为机器人的实时定位结果,根据优化后的机器人位姿,将局部点云地图进行坐标转换,得到区域内建筑物的三维点云地图。

13、进一步的,通过提取局部点云地图中包含角点和平面点的特征点,采用基于外观和空间几何信息的闭环检测算法,判断机器人当前位置是否达到过先前位置;若检测到闭环,则在因子图模型中添加闭环因子,对应当前位姿节点与闭环匹配位姿节点,包括:将局部点云地图划分为大小相同的立方体体素,通过提取每个体素中包含角点或平面点最多的点作为相应体素的特征点,得到局部点云地图的特征点集;计算特征点集中每个特征点的几何描述子和视觉描述子,根据特征点的几何描述子和视觉描述子构建词袋模型,得到局部点云地图的词袋表示向量;将机器人当前位姿节点处的局部点云地图的词袋表示向量与历史位姿节点处的局部点云地图的词袋表示向量进行匹配,计算词袋表示向量之间的相似度;如果相似度大于阈值,则判断机器人当前位置达到过先前位置,检测到闭环;根据局部点云地图的匹配关系,计算当前位姿节点与闭环匹配位姿节点之间的相对位姿变换,在因子图模型中添加闭环因子,闭环因子连接当前位姿节点和闭环匹配位姿节点,表示两个节点之间的相对位姿约束。

14、本技术的另一个方面还提供一种前端灭火机器人控制系统,用于执行本技术的一种前端灭火机器人控制方法。

15、相比于现有技术,本技术的优点在于:

16、本技术利用在目标环境中部署的烟雾传感器和红外摄像机组成分布式火情探测网络,通过烟雾浓度数据和红外图像数据的多源融合,建立基于马尔可夫随机场的火情概率模型,在概率图模型中充分考虑了传感器节点的局部观测证据和节点间的空间相关性,通过贝叶斯推理求解马尔可夫随机场获得火情区域位置的最大后验概率估计,克服了单一传感器在复杂环境下易受干扰的缺陷,提高了火情定位的准确性和可靠性。

17、本技术利用灭火机器人搭载的激光雷达传感器,通过因子图优化实现了同步定位与地图构建。将预处理后的点云数据输入到slam算法中,以机器人位姿和局部点云地图为节点,以激光雷达里程计、回环检测和特征匹配为边,构建因子图模型并求解图优化问题,在线构建起目标区域的三维几何地图,并对机器人位姿进行实时跟踪,使机器人能够在未知环境下同时实现自主定位和地图构建。基于构建的地图,通过将三维点云投影至二维平面并构建代价地图,再利用a*算法进行路径搜索,使机器人能够自主规划出无碰撞的导航路径,实现在复杂环境下的避障导航。

18、本技术提出了一种基于外观和几何信息的闭环检测算法,通过从局部点云地图中提取特征点并构建词袋表示,比较不同位姿节点的词袋向量相似度,判断机器人是否到达过先前位置,在因子图中添加闭环因子对图模型施加闭环约束,通过全局优化有效抑制了里程计漂移。同时,回环检测为因子图提供了位置先验,优化后的位姿与地图更加准确,使灭火机器人能够在复杂环境下长时间保持稳定和精确的导航,提高导航精度。

19、本技术以分布式多传感器融合实现火情探测,将视觉、红外、雷达等多源异构传感器数据进行融合,增强了机器人对环境的感知能力。同时,结合slam算法实现机器人自主定位与建图,使机器人能够在线构建复杂环境的三维几何地图。将环境感知与自主定位导航相结合,使灭火机器人能够全面感知复杂火灾现场环境,并利用现场感知信息实现精准的自主定位和导航。多传感器融合slam提升了灭火机器人的环境适应性,增强了其在复杂灾害现场的作业能力。