歌曲的特征提取模型训练方法、歌曲识别方法及相关设备与流程

1.本发明涉及音频数据处理技术领域,尤其涉及一种歌曲的特征提取模型训练方法、歌曲识别方法及相关设备。

背景技术:

2.听歌识曲作为一种音乐识别方式,在各种终端上的应用越来越多,但听歌识曲在具体的识别过程中,要求必须同歌同曲,这种识别方式对于同一歌手的不同演唱版本,如果伴奏和速度发生细微改变,或者是演唱者的性别和年龄发生些许改变,都会严重影响歌曲的识别结果。

3.而如何准确识别出原版音乐的翻唱版本,则是亟待解决的一个问题。

技术实现要素:

4.本发明实施例提供了一种翻唱歌曲识别方法及相关设备,用于提高对翻唱歌曲识别的准确率。

5.本技术实施例第一方面提供了一种歌曲的特征提取模型训练方法,所述方法包括:

6.获取训练集中待训练音频片段的第一目标嵌入向量,所述第一目标嵌入向量为所述待训练音频片段的频域特征向量;

7.获取所述训练集中待训练音频片段的第一歌词向量;

8.将对应于待训练音频片段的所述第一目标嵌入向量和所述第一歌词向量,输入至初始神经网络的编码层,得到对应于待训练音频片段的融合向量;

9.将待训练音频片段的所述融合向量输入至所述初始神经网络的解码层,得到对应的第二目标嵌入向量和第二歌词向量;

10.基于所述第二目标嵌入向量、所述第一目标嵌入向量、所述第二歌词向量及所述第一歌词向量计算目标损失值;

11.根据所述目标损失值更新所述初始神经模型的模型参数,得到更新后的神经网络模型;

12.若所述更新后的神经网络模型符合收敛条件,则输出所述更新后的神经网络模型中的编码层作为特征提取模型。

13.优选的,若所述更新后的神经网络模型不符合收敛条件,则从所述训练集中获取另外的待训练音频片段,并返回执行所述获取训练集中待训练音频片段的第一目标嵌入向量的步骤,直至所述更新后的神经网络模型符合收敛条件。

14.优选的,所述基于所述第二目标嵌入向量、所述第一目标嵌入向量、所述第二歌词向量及所述第一歌词向量计算目标损失值,包括:

15.根据预设的损失函数,分别计算所述第二目标嵌入向量和所述第一目标嵌入向量之间的第一损失,以及所述第二歌词向量与所述第一歌词向量之间的第二损失;

16.根据所述第一损失和所述第二损失,计算所述目标损失值。

17.优选的,所述获取训练集中待训练音频片段的第一目标嵌入向量,包括:

18.将训练集中的所述待训练音频片段执行时域与频域之间的特征转换,以获取所述待训练音频片段的的频域特征;

19.将所述待训练音频片段的的频域特征输入至kdtn神经网络,得到所述待训练音频片段的第一目标嵌入向量。

20.优选的,所述获取所述训练集中待训练音频片段的第一歌词向量,包括:

21.将训练集中的所述待训练音频片段的音频特征转换为文本特征,以提取出所述待训练音频片段的歌词;

22.将所述待训练音频片段的歌词输入至文本嵌入模型,以得到所述待训练音频片段的第一歌词向量。

23.本技术实施例第二方面提供了一种歌曲识别方法,其特征在于,所述方法包括:

24.获取目标音频片段;

25.提取出所述目标音频片段的歌词向量;

26.提取出所述目标音频片段的目标嵌入向量;

27.将所述目标音频片段的歌词向量和目标嵌入向量输入至本技术实施例第一方面所述的特征提取模型,得到所述目标音频片段的融合向量;

28.根据所述目标音频片段的融合向量,与数据库中每首歌曲的多个音频片段分别对应的多个融合向量,识别出与所述目标音频片段最相似的歌曲。

29.优选的,在所述根据所述目标音频片段的融合向量,与数据库中每首歌曲的多个音频片段分别对应的多个融合向量,识别出与所述目标音频片段最相似的歌曲之前,所述方法还包括:

30.获取数据库中每首歌曲的多个音频片段中的每个音频片段对应的第三歌词向量和第三目标嵌入向量;

31.将所述第三歌词向量和所述第三目标嵌入向量输入至所述特征提取模型,以得到与所述数据库中每首歌曲的多个音频片段分别对应的多个融合向量。

32.优选的,所述根据所述目标音频片段的融合向量,与数据库中每首歌曲的多个音频片段分别对应的多个融合向量,识别出与所述目标音频片段最相似的歌曲,包括:

33.分别计算出所述目标音频片段的融合向量,与所述数据库中每首歌曲的多个音频片段分别对应的多个融合向量之间的多个相似度分数;

34.根据所述多个相似度分数和预设的判断阈值,识别出与所述目标音频片段最相似的歌曲。

35.优选的,所述根据所述多个相似度分数和预设的判断阈值,识别出与所述目标音频片段最相似的歌曲,包括:

36.将所述目标音频片段与所述数据库中每首歌曲的多个音频片段之间的所述多个相似度分数,输入至深度记忆神经网络,以得到所述目标音频片段与每首歌曲之间的目标相似度分数;

37.根据所述目标相似度分数和所述预设的判断阈值,识别出与所述目标音频片段最相似的歌曲。

38.本技术实施例第三方面提供了一种歌曲的特征提取模型训练装置,所述装置包括:

39.获取单元,用于获取训练集中待训练音频片段的第一目标嵌入向量,所述第一目标嵌入向量为所述待训练音频片段的频域特征向量;

40.所述获取单元,还用于获取所述训练集中待训练音频片段的第一歌词向量;

41.输入单元,用于将对应于待训练音频片段的所述第一目标嵌入向量和所述第一歌词向量,输入至初始神经网络的编码层,得到对应于待训练音频片段的融合向量;

42.所述输入单元,还用于将待训练音频片段的所述融合向量输入至所述初始神经网络的解码层,得到对应的第二目标嵌入向量和第二歌词向量;

43.计算单元,用于基于所述第二目标嵌入向量、所述第一目标嵌入向量、所述第二歌词向量及所述第一歌词向量计算目标损失值;

44.更新单元,用于根据所述目标损失值更新所述初始神经模型的模型参数,得到更新后的神经网络模型;

45.输出单元,用于若所述更新后的神经网络模型符合收敛条件,则输出所述更新后的神经网络模型中的编码层作为特征提取模型。

46.优选的,所述获取单元,还用于:

47.若所述更新后的神经网络模型不符合收敛条件,则从所述训练集中获取另外的待训练音频片段,并返回执行所述获取训练集中待训练音频片段的第一目标嵌入向量的步骤,直至所述更新后的神经网络模型符合收敛条件。

48.优选的,所述计算单元具体用于:

49.根据预设的损失函数,分别计算所述第二目标嵌入向量和所述第一目标嵌入向量之间的第一损失,以及所述第二歌词向量与所述第一歌词向量之间的第二损失;

50.根据所述第一损失和所述第二损失,计算所述目标损失值。

51.优选的,所述获取单元,具体用于:

52.将训练集中的所述待训练音频片段执行时域与频域之间的特征转换,以获取所述待训练音频片段的的频域特征;

53.将所述待训练音频片段的的频域特征输入至kdtn神经网络,得到所述待训练音频片段的第一目标嵌入向量。

54.优选的,所述获取单元,具体用于:

55.将训练集中的所述待训练音频片段的音频特征转换为文本特征,以提取出所述待训练音频片段的歌词;

56.将所述待训练音频片段的歌词输入至文本嵌入模型,以得到所述待训练音频片段的第一歌词向量。

57.本技术实施例第四方面提供了一种歌曲识别装置,所述装置包括:

58.获取单元,用于获取目标音频片段;

59.提取单元,用于提取出所述目标音频片段的歌词向量;

60.所述提取单元,还用于提取出所述目标音频片段的目标嵌入向量;

61.输入单元,用于将所述目标音频片段的歌词向量和目标嵌入向量输入至本技术实施例第一方面所述的特征提取模型,得到所述目标音频片段的融合向量;

62.识别单元,用于根据所述目标音频片段的融合向量,与数据库中每首歌曲的多个音频片段分别对应的多个融合向量,识别出与所述目标音频片段最相似的歌曲。

63.优选的,所述获取单元还用于:

64.获取数据库中每首歌曲的多个音频片段中的每个音频片段对应的第三歌词向量和第三目标嵌入向量;

65.将所述第三歌词向量和所述第三目标嵌入向量输入至所述特征提取模型,以得到与所述数据库中每首歌曲的多个音频片段分别对应的多个融合向量。

66.优选的,所述识别单元,具体用于:

67.分别计算出所述目标音频片段的融合向量,与所述数据库中每首歌曲的多个音频片段分别对应的多个融合向量之间的多个相似度分数;

68.根据所述多个相似度分数和预设的判断阈值,识别出与所述目标音频片段最相似的歌曲。

69.优选的,所述识别单元,具体用于:

70.将所述目标音频片段与所述数据库中每首歌曲的多个音频片段之间的所述多个相似度分数,输入至深度记忆神经网络,以得到所述目标音频片段与每首歌曲之间的目标相似度分数;

71.根据所述目标相似度分数和所述预设的判断阈值,识别出与所述目标音频片段最相似的歌曲。

72.本技术实施例还提供了一种计算机可读存储介质,其上存储有计算机程序,所述计算机程序被处理器执行时,用于实现本技术实施例中第一方面所述的歌曲的特征提取模型训练方法或本技术实施例中第二方面所述的歌曲识别方法。

73.本技术实施例还提供了一种电子设备,包括存储器、处理器、电源模块、传感器模块、输入/输出模块,其特征在于,所述处理器在执行存储于存储器上的计算机程序时,用于实现本技术实施例中第一方面所述的歌曲的特征提取模型训练方法或本技术实施例中第二方面所述的歌曲识别方法。

74.从以上技术方案可以看出,本发明实施例具有以下优点:

75.获取训练集中待训练音频片段的第一目标嵌入向量,所述第一目标嵌入向量为所述待训练音频片段的频域特征向量,获取所述训练集中待训练音频片段的第一歌词向量;将对应于待训练音频片段的所述第一目标嵌入向量和所述第一歌词向量,输入至初始神经网络的编码层,得到对应于待训练音频片段的融合向量;将待训练音频片段的所述融合向量输入至所述初始神经网络的解码层,得到对应的第二目标嵌入向量和第二歌词向量;基于所述第二目标嵌入向量、所述第一目标嵌入向量、所述第二歌词向量及所述第一歌词向量计算目标损失值;根据所述目标损失值更新所述初始神经模型的模型参数,得到更新后的神经网络模型;若所述更新后的神经网络模型符合收敛条件,则输出所述更新后的神经网络模型中的编码层作为特征提取模型。

76.本技术实施例中,在训练特征提取模型时,不仅利用了待训练音频特征的频域特征,还利用了待训练音频特征的歌词特征,使得该模型在训练过程中,不仅可以识别歌曲的曲调,还可以识别歌曲的歌词,从而提升了该模型对歌曲识别的准确率。

附图说明

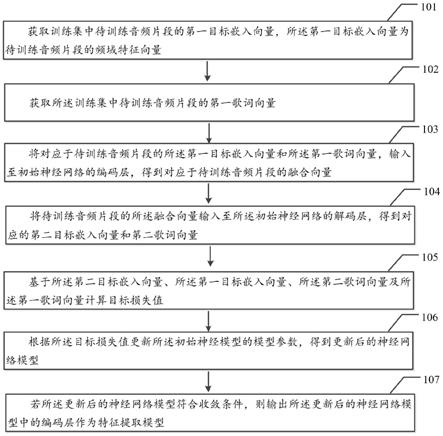

77.图1为本技术实施例中歌曲的特征提取模型训练方法的一个实施例示意图;

78.图2为本技术实施例中歌曲的特征提取模型训练方法的另一个实施例示意;

79.图3为本技术图1实施例中步骤105的细化步骤;

80.图4为本技术图1实施例中步骤101的细化步骤;

81.图5为本技术实施例中kdtn神经网络的架构示意图;

82.图6为本技术图1实施例中步骤102的细化步骤;

83.图7为本技术实施例中歌曲识别方法的一个实施例示意图;

84.图8为本技术实施例中歌曲识别方法的另一个实施例示意图;

85.图9为本技术图7实施例中步骤705的细化步骤;

86.图10为本技术实施例中歌曲识别方法的另一个实施例示意图;

87.图11为本技术实施例中歌曲的特征提取模型训练装置的一个实施例示意图;

88.图12为本技术实施例中歌曲识别装置的一个实施例示意图;

89.图13为本技术实施例中初始神经网络的结构示意图。

具体实施方式

90.本发明实施例提供了一种歌曲的特征提取模型训练方法、歌曲识别方法及相关设备,用于提高对歌曲识别的准确率。

91.为了使本技术领域的人员更好地理解本发明方案,下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明一部分的实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都应当属于本发明保护的范围。

92.本发明的说明书和权利要求书及上述附图中的术语“第一”、“第二”、“第三”、“第四”等是用于区别类似的对象,而不必用于描述特定的顺序或先后次序。应该理解这样使用的数据在适当情况下可以互换,以便这里描述的实施例能够以除了在这里图示或描述的内容以外的顺序实施。此外,术语“包括”和“具有”以及他们的任何变形,意图在于覆盖不排他的包含,例如,包含了一系列步骤或单元的过程、方法、系统、产品或设备不必限于清楚地列出的那些步骤或单元,而是可包括没有清楚地列出的或对于这些过程、方法、产品或设备固有的其它步骤或单元。

93.为方便理解,下面对本技术实施例中的歌曲的特征提取模型训练方法进行描述,请参阅图1,本技术实施例中歌曲的特征提取模型训练方法的一个实施例,包括:

94.101、获取训练集中待训练音频片段的第一目标嵌入向量,所述第一目标嵌入向量为待训练音频片段的频域特征向量;

95.为了提升对歌曲识别的准确率,本技术实施例利用训练集中的训练样本对识别歌曲的模型进行训练,在具体的训练过程中,先获取训练集中待训练音频片段的第一目标嵌入向量,然后将待训练音频片段的第一目标嵌入向量作为输入量,输入至初始神经网络中进行训练,其中,第一目标嵌入向量为待训练音频片段的频域特征向量。

96.关于第一目标嵌入向量的生成过程,将在下面的实施例中进行详细描述,此处不

再赘述。

97.102、获取所述训练集中待训练音频片段的第一歌词向量;

98.为了提升对歌曲识别的准确率,本技术实施例除了将第一目标嵌入向量作为模型的输入量以外,还获取训练集中待训练音频片段的第一歌词向量,并将待训练音频片段的第一歌词向量也输入至初始神经网络中进行训练。

99.103、将对应于待训练音频片段的所述第一目标嵌入向量和所述第一歌词向量,输入至初始神经网络的编码层,得到对应于待训练音频片段的融合向量;

100.具体的,本技术实施例中的初始神经网络包括编码层和解码层,其中,编码层的作用为降低输入量的维度,以融合歌曲的曲调信息和歌词信息。为方便理解,图13给出了初始神经网络结构的示意图。

101.本技术实施例将待训练音频片段的第一目标嵌入向量和第一歌词向量输入至初始神经网络的编码层,以得到对应于待训练音频片段的融合向量,以将待训练音频片段的第一目标嵌入向量和第一歌词向量,合成为待训练音频片段的融合向量。

102.其中,编码层为包括输入层、隐藏和输出层的神经网络结构,具体的,关于输入层、隐藏和输出层的描述,与现有技术中的一致,此处不再赘述。

103.104、将待训练音频片段的所述融合向量输入至所述初始神经网络的解码层,得到对应的第二目标嵌入向量和第二歌词向量;

104.进一步,为了检测编码层中的神经网络结构对第一目标嵌入向量和第一歌词向量融合的准确率,本技术实施例将待训练音频片段的融合向量输入至初始神经网络的解码层,以得到与融合向量对应的第二目标嵌入向量和第二歌词向量。

105.并基于第二目标嵌入向量、第二歌词向量、第一目标嵌入向量和第一歌词向量的差值,衡量编码层中的神经网络结构对第一目标嵌入向量和第一歌词向量融合的准确率。

106.105、基于所述第二目标嵌入向量、所述第一目标嵌入向量、所述第二歌词向量及所述第一歌词向量计算目标损失值;

107.具体的,在利用第二目标嵌入向量、第二歌词向量、第一目标嵌入向量和第一歌词向量衡量编码层中神经网络结构的准确率时,可以是基于所述第二目标嵌入向量、所述第一目标嵌入向量、所述第二歌词向量及所述第一歌词向量计算目标损失值。

108.进一步,得到目标损失值后,还可以基于该目标损失值对初始神经网络模型的编码层和解码层中的模型参数进行修正。

109.至于目标损失值的具体计算过程,将在下面的实施例中进行描述,此处不再赘述。

110.106、根据所述目标损失值更新所述初始神经模型的模型参数,得到更新后的神经网络模型;

111.得到目标损失值后,根据目标损失值更新初始神经模型的模型参数,以得到更新后的神经网络模型。

112.具体的,在利用目标损失值,对初始神经模型的模型参数进行更新时,可以是基于目标损失值和反向传播算法,对初始神经模型的模型参数进行更新。

113.而基于目标损失值和反向传播算法,对初始神经模型的模型参数(即编码层和解码层的模型参数)的更新过程在现有技术中都有详细描述,此处不再赘述。

114.107、若所述更新后的神经网络模型符合收敛条件,则输出所述更新后的神经网络

模型中的编码层作为特征提取模型。

115.具体的,利用目标损失值和反向传播算法,对初始神经网络模型的模型参数进行更新后,若更新后的神经网络模型符合收敛条件,则输出更新后的神经网络模型中的编码层作为特征提取模型。

116.其中,若更新后的神经网络模型符合收敛条件,是指更新后的神经网络模型在输入待训练音频片段后,在步骤105中得到的目标损失值趋于一个稳定的数值。

117.本技术实施例中,获取训练集中待训练音频片段的第一目标嵌入向量;获取所述训练集中待训练音频片段的第一歌词向量;将对应于待训练音频片段的所述第一目标嵌入向量和所述第一歌词向量,输入至初始神经网络的编码层,得到对应于待训练音频片段的融合向量;将待训练音频片段的所述融合向量输入至所述初始神经网络的解码层,得到对应的第二目标嵌入向量和第二歌词向量;基于所述第二目标嵌入向量、所述第一目标嵌入向量、所述第二歌词向量及所述第一歌词向量计算目标损失值;根据所述目标损失值更新所述初始神经模型的模型参数,得到更新后的神经网络模型;若所述更新后的神经网络模型符合收敛条件,则输出所述更新后的神经网络模型中的编码层作为特征提取模型。

118.因为本技术实施例,在训练特征提取模型时,将第一目标嵌入向量和第一歌词向量作为输入量对初始神经网络模型的模型参数进行训练,即在对初始神经网络的模型参数进行训练时,不仅利用了待训练音频片段的第一目标嵌入向量(即待训练音频片段的频域特征向量),还利用了待训练音频片段的第一歌词向量(即待训练音频片段的歌词特征向量),故训练后的特征提取模型可以基于歌曲的多个特征向量对歌曲进行识别,从而提升了特征提取模型对歌曲识别的准确率。

119.基于图1所述的实施例,若所述更新后的神经网络模型不符合收敛条件,则执行图2所述的实施例,其中,歌曲的特征提取模块的训练方法的另一个实施例,包括:

120.201、获取训练集中待训练音频片段的第一目标嵌入向量,所述第一目标嵌入向量为待训练音频片段的频域特征向量;

121.202、获取所述训练集中待训练音频片段的第一歌词向量;

122.203、将对应于待训练音频片段的所述第一目标嵌入向量和所述第一歌词向量,输入至初始神经网络的编码层,得到对应于待训练音频片段的融合向量;

123.204、将待训练音频片段的所述融合向量输入至所述初始神经网络的解码层,得到对应的第二目标嵌入向量和第二歌词向量;

124.205、基于所述第二目标嵌入向量、所述第一目标嵌入向量、所述第二歌词向量及所述第一歌词向量计算目标损失值;

125.206、根据所述目标损失值更新所述初始神经模型的模型参数,得到更新后的神经网络模型;

126.需要说明的是,本技术实施例中步骤201至步骤206的描述,与图1实施例中描述的类似,此处不再赘述。

127.207、判断更新后的神经网络模型是否符合收敛条件;

128.得到更新后的神经网络模型以后,进一步判断更新后的神经网络模型是否符合收敛条件,若是,则执行步骤208,若否,则执行步骤209。

129.需要说明的是,本技术实施例中步骤207的执行主体可以与步骤201至206中的执

行主体相同,也可以与步骤201至步骤206中的执行主体不同,此处不做具体限制。

130.208、输出所述更新后的神经网络模型中的编码层作为特征提取模型;

131.若更新后的神经网络模型符合收敛条件,则输出更新后的神经网络模型中的编码层作为特征提取模型。

132.209、则从所述训练集中获取另外的待训练音频片段,并返回执行步骤201至步骤207,直至所述更新后的神经网络模型符合收敛条件。

133.若更新后的神经网络模型不符合收敛条件,则从训练集中获取另外的待训练样本,并利用另外的待训练样本,返回执行步骤201至207,直至更新后的神经网络模型符合收敛条件为止。

134.需要说明的是,步骤209中在获取另外的待训练音频片段时,另外的待训练音频片段都是区别于已经执行过训练的待训练音频片段,具体在实现时,可以是对训练集中的所有待训练音频片段进行标记,使得每个待训练音频片段都有一个自身的唯一标识码,从而在选择另外的待训练音频片段时,使得所选取的当前待训练音频片段区别于已经执行过训练的待训练音频片段,或者,还可以是在一个待训练音频片段执行完训练后,将完成训练的待训练音频片段从训练集中移除,从而使得在从训练集中选择另外的待训练音频片段时,使得所选取的当前待训练音频片段区别于已经执行过训练的待训练音频片段。

135.本技术实施例中,对更新后的神经网络模型不符合收敛条件时,特征提取模型的训练过程做了完整的描述,提升了特征提取模型训练过程的完备性。

136.基于图1所述的实施例,下面对步骤105做详细描述,请参阅图3,图3为步骤105的细化步骤:

137.301、根据预设的损失函数,分别计算所述第二目标嵌入向量和所述第一目标嵌入向量之间的第一损失,以及所述第二歌词向量与所述第一歌词向量之间的第二损失;

138.具体的,在基于第二目标嵌入向量、第一目标嵌入向量、第二歌词向量和第一歌词向量,计算目标损失值时,可以是基于预设的损失函数,分别计算第二目标嵌入向量和第一目标嵌入向量之间的第一损失,以及第二歌词向量与第一歌词向量之间的第二损失。

139.其中,预设的损失函数可以是交叉熵损失函数、平方损失函数或绝对值损失函数等,此处对损失函数的具体形式不做限制。

140.302、根据所述第一损失和所述第二损失,计算所述目标损失值。

141.得到第一损失和第二损失后,可以将第一损失和第二损失进行叠加,从而得到目标损失值,也可以是设置第一损失的第一权重,第二损失的第二权重,然后基于第一损失和第一权重,以及第二损失和第二权重,计算目标损失值。

142.本技术实施例中,对基于第二目标嵌入向量、第一目标嵌入向量、第二歌词向量和第一歌词向量,计算目标损失值的过程做了详细描述,提升了目标损失值计算过程的可靠性。

143.基于图1所述的实施例,下面接着对图1实施例中的步骤101做详细描述,请参阅图4,图4为步骤101的细化步骤:

144.401、将所述训练集中的待训练音频片段执行时域与频域之间的特征转换,以获取所述待训练音频片段的的频域特征;

145.本技术实施例在获取待训练音频片段的第一目标嵌入向量时,先将待训练音频片

段执行时域与频域之间的特征转换,如将目标音频片段做傅里叶变换,或恒q变换(cqt),以获取待训练音频片段的频域特征。

146.进一步,傅里叶变换和恒q变换的具体过程在现有技术中都有详细描述,此处不再赘述。

147.402、将所述待训练音频片段的的频域特征输入至kdtn神经网络,得到所述待训练音频片段的第一目标嵌入向量。

148.得到带训练音频片段的频域特征后,将其频域特征输入至kdtn神经网络,以得到与待训练音频片段对应的第一目标嵌入向量,为方便理解,图5给出了kdtn神经网络的架构示意图。

149.其中,k表示key

‑

invariant convolution neural network,它的作用主要是获取关键的恒常量序列,也即获取本技术实施例中待训练音频片段的频域特征;

150.d表示dilated temporal pyramid convolution network,它的主要作用主要是利用音乐中的局部时间环境;

151.t表示temporal self

‑

attention,它的主要作用是利用音乐中的全局时间环境;

152.ap表示average pool,它的主要作用对接收到的特征做下采样,以对特征做降维处理。

153.当待训练音频片段的频域特征{x1}输入至kdtn网络以后,会得到一个定长的嵌入向量l

x

,也即待训练音频片段的第一目标嵌入向量。

154.本技术实施例中,对获取训练集中待训练音频片段的第一目标嵌入向量的过程做了详细描述,提升了第一目标嵌入向量计算过程的可靠性。

155.基于图1所述的实施例,下面对图1实施例中的步骤102做详细描述,请参阅图6,图6为步骤102的细化步骤:

156.601、将所述训练集中的待训练音频片段的音频特征转换为文本特征,以提取出所述训练集中待训练音频片段的歌词;

157.具体的,在获取待训练音频片段的歌词向量时,先将待训练音频片段的音频特征转换为文本特征,以得到待训练音频片段的歌词。

158.具体的,转换为歌词的过程可以是通过语音

‑

文本转换模块,或具有语音

‑

文本转换模块的设备来实现,此处不做具体限制。

159.602、将所述待训练音频片段的歌词输入至文本嵌入模型,以得到所述训练集中待训练音频片段的第一歌词向量。

160.得到待训练音频片段的歌词以后,将待训练音频片段的歌词输入至文本嵌入模型,以得到待训练音频片段的歌词向量。

161.具体的,文本嵌入模型可以是词嵌入向量(wordembedding)模型、one

‑

hot矩阵表示模型等,此处不做具体限制,而对于将待训练音频片段的歌词输入至词嵌入向量(wordembedding)模型或one

‑

hot矩阵表示模型中,以得到待训练音频片段的歌词向量的具体过程在现有技术中也有详细描述,此处不再赘述。

162.本技术实施例中,对获取训练集中待训练音频片段的第一歌词向量的过程做了详细描述,提升了第一歌词向量计算过程的可靠性。

163.上面对本技术实施例中歌曲的特征提取模型的训练方法做了详细描述,下面接着

对本技术实施例中歌曲的识别方法进行描述,请参阅图7,本技术实施例中歌曲识别方法的一个实施例,包括:

164.701、获取目标音频片段;

165.为了在终端上对目标音频片段进行识别,本技术实施例中的终端需要先获取目标音频片段,其中,本实施例中的目标音频片段为请求终端进行识别的音频片段。具体的,本技术实施例中的终端可以为手机、pad、计算机及可穿戴设备中的任何一种,此处不做具体限制。

166.进一步,本技术中的获取动作可以是终端主动从其他设备中读取目标音频片段,或是终端被动接收其他设备发送的目标音频片段。

167.702、提取出所述目标音频片段的歌词向量;

168.得到目标音频片段后,提取出该目标音频片段的歌词向量,具体的,提取目标音频片段的歌词向量的过程,与图6实施例中获取待训练音频片段的第一歌词向量的过程类似,此处不再赘述。

169.703、提取出所述目标音频片段的目标嵌入向量;

170.得到目标音频片段后,提取出目标音频片段的目标嵌入向量,具体的,提取目标音频片段的目标嵌入向量的过程,与图4实施例中获取待训练音频片段的第一目标嵌入向量的过程类似,此处不再赘述。

171.704、将所述目标音频片段的歌词向量和目标嵌入向量输入至特征提取模型,得到所述目标音频片段的融合向量;

172.得到目标音频片段的的歌词向量和目标嵌入向量后,将目标音频片段的的歌词向量和目标嵌入向量,输入至图1至图6实施例中的特征提取模型,以得到目标音频片段的融合向量。

173.需要说明的是,本技术实施例中的特征提取模型为图1至图6实施例中更新后的神经网络模型中的编码层,也即在对歌曲进行识别时,只利用了更新后的神经网络模型中的编码层,以通过该编码层将目标音频片段的歌词向量和目标嵌入向量降低维度,以得到融合了目标音频片段歌词特征和曲调特征的融合向量。

174.705、根据所述目标音频片段的融合向量,与数据库中每首歌曲的多个音频片段分别对应的多个融合向量,识别出与所述目标音频片段最相似的歌曲。

175.得到目标音频片段的融合向量后,根据目标音频片段的融合向量,与数据库中每首歌曲的多个音频片段分别对应的多个融合向量,以识别出与目标音频片段最相似的歌曲。

176.具体的,在根据目标音频片段的融合向量,与数据库中每首歌曲的多个音频片段分别对应的多个融合向量,识别目标音频片段最相似的歌曲时,可以是根据向量之间的相似度算法对两个向量之间的相似度进行计算,如皮尔逊相关系数、欧几里德距离、cosine相似度、tanimoto系数、曼哈顿距离等来计算两个向量之间的相似度,并根据相似度的大小识别出与目标音频片段最相似的歌曲。

177.本技术实施例中,获取目标音频片段;提取出所述目标音频片段的歌词向量;提取出所述目标音频片段的目标嵌入向量;将所述目标音频片段的歌词向量和目标嵌入向量输入至特征提取模型,得到所述目标音频片段的融合向量;根据所述目标音频片段的融合向

量,与数据库中每首歌曲的多个音频片段分别对应的多个融合向量,识别出与所述目标音频片段最相似的歌曲。

178.因为本技术实施例中的歌曲识别方法可以通过目标音频片段的融合向量,对目标音频片段的最相似歌曲进行识别,而目标音频片段的融合向量中不仅有目标音频片段的曲调特征,还有目标音频片段的歌词特征,故本技术实施例中的歌曲识别方法,可以提升识别与目标音频片段最相似歌曲的准确率。

179.基于图7所述的实施例,在根据所述目标音频片段的融合向量,与数据库中每首歌曲的多个音频片段分别对应的多个融合向量,识别出与所述目标音频片段最相似的歌曲之前,还执行执行以下步骤,请参阅图8,本技术实施例中歌曲识别方法的另一个实施例,包括:

180.801、获取数据库中每首歌曲的多个音频片段中的每个音频片段对应的第三歌词向量和第三目标嵌入向量;

181.容易理解的是,在根据所述目标音频片段的融合向量,与数据库中每首歌曲的多个音频片段分别对应的多个融合向量,识别出与所述目标音频片段最相似的歌曲之前,还应该获取数据库中每首歌曲的多个音频片段中每个音频片段所对应的第三歌词向量和第三目标嵌入向量。

182.其中,获取每个音频片段对应的第三歌词向量和第三目标嵌入向量的过程,与图4及图6中获取待训练音频片段的第一歌词向量和第一目标嵌入向量的过程类似,此处不再赘述。

183.802、将所述第三歌词向量和所述第三目标嵌入向量输入至所述特征提取模型,以得到所述数据库中每首歌曲的多个音频片段分别对应的多个融合向量。

184.得到每个音频片段对应的第三歌词向量和第三目标嵌入向量后,将每个音频片段对应的第三歌词向量和第三目标嵌入向量,输入至特征提取模型中,即可获取与每首歌曲的多个音频片段分别对应的多个融合向量。

185.需要说明的是,本技术实施例中的特征提取模型为图1至图6实施例中更新后的神经网络模型中的编码层,主要是将第三歌词向量和第三嵌入向量降低维度,以得到融合了歌词特征和曲调特征的融合向量。

186.本技术实施例中,对数据库中与每首歌曲的多个音频片段分别对应的多个融合向量的获取过程做了详细描述,提升了本技术实施例中获取与每首歌曲的多个音频片段分别对应的多个融合向量的可靠性。

187.基于图7所述的实施例,下面对步骤705做详细描述,请参阅图9,图9为步骤705的细化步骤:

188.901、分别计算出所述目标音频片段的融合向量,与所述数据库中每首歌曲的多个音频片段分别对应的多个融合向量之间的多个相似度分数;

189.具体的,根据目标音频片段的融合向量和数据库中与每首歌曲的多个音频片段分别对应的多个融合向量,识别与目标音频片段最相似的歌曲时,可以是计算目标音频片段的融合向量,与所述数据库中每首歌曲的多个音频片段分别对应的多个融合向量之间的多个相似度分数。

190.如:可以计算目标音频片段的融合向量与数据库中每首歌曲的多个音频片段分别

对应的多个融合向量之间的多个余弦距离,并将余弦距离作为相似度分数。具体的,假设目标音频片段的融合向量为l

x

,而与每首歌曲的多个音频片段对应的融合向量为l

c

和l

e

,且l

x

与l

c

之间的夹角为

ɑ

,l

x

与l

e

之间的夹角为β,则目标音频片段与多个音频片段之间的相似度分数为1

‑

cos

ɑ

和1

‑

cosβ。

191.需要说明的是,在计算相似度分数时,除了采用余弦距离,还可以采用欧式距离或编辑距离等,此处对计算相似度分数的算法不做具体限制。

192.902、根据所述多个相似度分数和预设的判断阈值,识别出与所述目标音频片段最相似的歌曲。

193.得到目标音频片段与数据库中每首歌曲的多个音频片段之间的多个相似度分数后,进一步根据预设的判断阈值,即可识别出与目标音频片段最相似的歌曲。

194.本技术实施例中对计算目标音频片段与每个音频片段之间的相似度分数的过程做了详细描述,提升了相似度分数计算过程的可靠性。

195.基于图9所述的实施例,在识别目标音频片段最相似歌曲的过程中,会出现目标音频音频片段在目标歌曲中的划分位置(即目标音频片段在目标歌曲中的起始位置和截止位置),与数据库中目标歌曲的多个音频片段的划分位置都不相同的情况,而为了提升对目标音频片段识别的准确率,还可以执行以下步骤,请参阅图10,歌曲识别方法的另一个实施例,包括:

196.1001、将所述目标音频片段与所述数据库中每首歌曲的多个音频片段之间的所述多个相似度分数,输入至深度记忆神经网络,以得到所述目标音频片段与每首歌曲之间的目标相似度分数;

197.本技术实施例中的深度记忆神经网络是带有记忆功能的,具体的深度记忆神经网络可以是循环神经网络(recurrent neural network,rnn)或长短记忆网络(long short

‑

term memory,lstm)等神经网络。

198.因为当同一首歌曲包括多个片段时,在目标音频片段与同一首歌曲中的每个片段做匹配时,希望神经网络可以将目标音频片段与每个片段的匹配结果做记忆,并把该记忆结果传递给神经网络,使得神经网络在将目标音频片段与当前片段做匹配时,都能够携带目标音频片段与当前片段之前的每个片段的匹配结果,故本技术实施例中的神经网络为深度记忆神经网络,而循环神经网络和长短记忆神经网络作为两种具体的神经网络形式,都可以在数据传递过程中,带有记忆功能。

199.需要说明的是,循环神经网络和长短记忆神经网络只是作为深度记忆网络的两种具体表现形式,此处对深度记忆神经网络的具体形式不做限制。

200.对应的,当每首歌曲都包括多个片段时,则深度记忆神经网络的输入量为:目标音频片段与每首歌曲的多个音频片段之间的多个相似度分数,而深度神经网络的输出量为:目标音频片段的目标相似度分数。

201.下面对深度记忆神经网络的数据输入和输出过程进行描述:

202.假设目标音频片段与每首歌曲的多个音频片段之间的多个相似度分数为x1、x2...xn,则将x1、x2...xn输入至深度记忆神经网络后,会得到目标音频片段与数据库中每首歌曲的目标相似度分数xw。

203.1002、根据所述目标相似度分数和所述预设的判断阈值,识别出与所述目标音频

片段最相似的歌曲。

204.进一步,得到目标相似度分数后,即可根据目标相似度分数和预设的判断阈值,识别出与目标音频片段最相似的歌曲。

205.本技术实施例中,对当目标音频片段的划分位置(即目标音频片段的起点和终点),与每首歌曲的多个音频片段的划分位置不同时,对目标音频片段的识别过程做了详细描述,从而进一步提升了对与目标音频片段最相似歌曲的识别准确率。

206.上面对本技术实施例中的特征提取模型训练方法做了描述,下面接着对本技术实施例中的特征提取模型训练装置进行描述,请参阅图11,本技术实施例中特征提取模型训练装置的一个实施例,包括:

207.获取单元1101,用于获取训练集中待训练音频片段的第一目标嵌入向量,所述第一目标嵌入向量为所述待训练音频片段的频域特征向量;

208.所述获取单元1101,还用于获取所述训练集中待训练音频片段的第一歌词向量;

209.输入单元1102,用于将对应于待训练音频片段的所述第一目标嵌入向量和所述第一歌词向量,输入至初始神经网络的编码层,得到对应于待训练音频片段的融合向量;

210.所述输入单元1102,还用于将待训练音频片段的所述融合向量输入至所述初始神经网络的解码层,得到对应的第二目标嵌入向量和第二歌词向量;

211.计算单元1103,用于基于所述第二目标嵌入向量、所述第一目标嵌入向量、所述第二歌词向量及所述第一歌词向量计算目标损失值;

212.更新单元1104,用于根据所述目标损失值更新所述初始神经模型的模型参数,得到更新后的神经网络模型;

213.输出单元1105,用于若所述更新后的神经网络模型符合收敛条件,则输出所述更新后的神经网络模型中的编码层作为特征提取模型。

214.优选的,所述获取单元1101,还用于:

215.若所述更新后的神经网络模型不符合收敛条件,则从所述训练集中获取另外的待训练音频片段,并返回执行所述获取训练集中待训练音频片段的第一目标嵌入向量的步骤,直至所述更新后的神经网络模型符合收敛条件。

216.优选的,所述计算单元1103具体用于:

217.根据预设的损失函数,分别计算所述第二目标嵌入向量和所述第一目标嵌入向量之间的第一损失,以及所述第二歌词向量与所述第一歌词向量之间的第二损失;

218.根据所述第一损失和所述第二损失,计算所述目标损失值。

219.优选的,所述获取单元1101,具体用于:

220.将训练集中的所述待训练音频片段执行时域与频域之间的特征转换,以获取所述待训练音频片段的的频域特征;

221.将所述待训练音频片段的的频域特征输入至kdtn神经网络,得到所述待训练音频片段的第一目标嵌入向量。

222.优选的,所述获取单元1101,具体用于:

223.将训练集中的所述待训练音频片段的音频特征转换为文本特征,以提取出所述待训练音频片段的歌词;

224.将所述待训练音频片段的歌词输入至文本嵌入模型,以得到所述待训练音频片段

的第一歌词向量。

225.因为本技术实施例,在训练特征提取模型时,通过输入单元1102将第一目标嵌入向量和第一歌词向量作为输入量对初始神经网络模型的模型参数进行训练,即在对初始神经网络的模型参数进行训练时,不仅利用了待训练音频片段的第一目标嵌入向量(即待训练音频片段的频域特征向量),还利用了待训练音频片段的第一歌词向量,故训练后的特征提取模型可以基于歌曲的多个特征向量对歌曲进行识别,从而提升了特征提取模型对歌曲的识别率。

226.下面接着对本技术实施例中的歌曲识别装置进行描述,请参阅图12,本技术实施例中歌曲识别装置的一个实施例,包括:

227.获取单元1201,用于获取目标音频片段;

228.提取单元1202,用于提取出所述目标音频片段的歌词向量;

229.所述提取单元,还用于提取出所述目标音频片段的目标嵌入向量;

230.输入单元1203,用于将所述目标音频片段的歌词向量和目标嵌入向量输入至本技术实施例第一方面所述的特征提取模型,得到所述目标音频片段的融合向量;

231.识别单元1204,用于根据所述目标音频片段的融合向量,与数据库中每首歌曲的多个音频片段分别对应的多个融合向量,识别出与所述目标音频片段最相似的歌曲。

232.优选的,所述获取单元1201还用于:

233.获取数据库中每首歌曲的多个音频片段中的每个音频片段对应的第三歌词向量和第三目标嵌入向量;

234.将所述第三歌词向量和所述第三目标嵌入向量输入至所述特征提取模型,以得到与所述数据库中每首歌曲的多个音频片段分别对应的多个融合向量。

235.优选的,所述识别单元1204,具体用于:

236.分别计算出所述目标音频片段的融合向量,与所述数据库中每首歌曲的多个音频片段分别对应的多个融合向量之间的多个相似度分数;

237.根据所述多个相似度分数和预设的判断阈值,识别出与所述目标音频片段最相似的歌曲。

238.优选的,所述识别单元1204,具体用于:

239.将所述目标音频片段与所述数据库中每首歌曲的多个音频片段之间的所述多个相似度分数,输入至深度记忆神经网络,以得到所述目标音频片段与每首歌曲之间的目标相似度分数;

240.根据所述目标相似度分数和所述预设的判断阈值,识别出与所述目标音频片段最相似的歌曲。

241.本技术实施例中,识别单元1204可以通过目标音频片段的融合向量,对目标音频片段的最相似歌曲进行识别,而目标音频片段的融合向量中不仅有目标音频片段的曲调特征,还有目标音频片段的歌词特征,故本技术实施例中的歌曲识别方法,可以提升识别与目标音频片段最相似歌曲的准确率。

242.上面从模块化功能实体的角度对本发明实施例中的翻唱歌曲识别设备进行了描述,下面从硬件处理的角度对本发明实施例中的电子设备进行描述:

243.该电子设备用于实现翻唱歌曲识别设备的功能,本发明实施例中电子设备的一个

实施例包括:

244.存储器、处理器、电源模块、传感器模块、输入/输出模块;

245.存储器用于存储计算机程序,处理器用于执行存储器中存储的计算机程序时,可以实现如下步骤:

246.获取训练集中待训练音频片段的第一目标嵌入向量,所述第一目标嵌入向量为所述待训练音频片段的频域特征向量;

247.获取所述训练集中待训练音频片段的第一歌词向量;

248.将对应于待训练音频片段的所述第一目标嵌入向量和所述第一歌词向量,输入至初始神经网络的编码层,得到对应于待训练音频片段的融合向量;

249.将待训练音频片段的所述融合向量输入至所述初始神经网络的解码层,得到对应的第二目标嵌入向量和第二歌词向量;

250.基于所述第二目标嵌入向量、所述第一目标嵌入向量、所述第二歌词向量及所述第一歌词向量计算目标损失值;

251.根据所述目标损失值更新所述初始神经模型的模型参数,得到更新后的神经网络模型;

252.若所述更新后的神经网络模型符合收敛条件,则输出所述更新后的神经网络模型中的编码层作为特征提取模型。

253.在本发明的一些实施例中,处理器,还可以用于实现如下步骤:

254.若所述更新后的神经网络模型不符合收敛条件,则从所述训练集中获取另外的待训练音频片段,并返回执行所述获取训练集中待训练音频片段的第一目标嵌入向量的步骤,直至所述更新后的神经网络模型符合收敛条件。

255.在本发明的一些实施例中,处理器,还可以用于实现如下步骤:

256.根据预设的损失函数,分别计算所述第二目标嵌入向量和所述第一目标嵌入向量之间的第一损失,以及所述第二歌词向量与所述第一歌词向量之间的第二损失;

257.根据所述第一损失和所述第二损失,计算所述目标损失值。

258.在本发明的一些实施例中,处理器,还可以用于实现如下步骤:

259.将训练集中的所述待训练音频片段执行时域与频域之间的特征转换,以获取所述待训练音频片段的的频域特征;

260.将所述待训练音频片段的的频域特征输入至kdtn神经网络,得到所述待训练音频片段的第一目标嵌入向量。

261.在本发明的一些实施例中,处理器,还可以用于实现如下步骤:

262.将训练集中的所述待训练音频片段的音频特征转换为文本特征,以提取出所述待训练音频片段的歌词;

263.将所述待训练音频片段的歌词输入至文本嵌入模型,以得到所述待训练音频片段的第一歌词向量。

264.本发明实施例还提供了一种电子设备,该电子设备的处理器在执行存储器中存储的计算机程序时,可以实现如下步骤:

265.获取目标音频片段;

266.提取出所述目标音频片段的歌词向量;

267.提取出所述目标音频片段的目标嵌入向量;

268.将所述目标音频片段的歌词向量和目标嵌入向量输入至本技术实施例第一方面所述的特征提取模型,得到所述目标音频片段的融合向量;

269.根据所述目标音频片段的融合向量,与数据库中每首歌曲的多个音频片段分别对应的多个融合向量,识别出与所述目标音频片段最相似的歌曲。

270.在本发明的一些实施例中,在所述根据所述目标音频片段的融合向量,与数据库中每首歌曲的多个音频片段分别对应的多个融合向量,识别出与所述目标音频片段最相似的歌曲之前,处理器,还可以用于实现如下步骤:

271.获取数据库中每首歌曲的多个音频片段中的每个音频片段对应的第三歌词向量和第三目标嵌入向量;

272.将所述第三歌词向量和所述第三目标嵌入向量输入至所述特征提取模型,以得到与所述数据库中每首歌曲的多个音频片段分别对应的多个融合向量。

273.在本发明的一些实施例中,处理器,还可以用于实现如下步骤:

274.分别计算出所述目标音频片段的融合向量,与所述数据库中每首歌曲的多个音频片段分别对应的多个融合向量之间的多个相似度分数;

275.根据所述多个相似度分数和预设的判断阈值,识别出与所述目标音频片段最相似的歌曲。

276.在本发明的一些实施例中,处理器,还可以用于实现如下步骤:

277.将所述目标音频片段与所述数据库中每首歌曲的多个音频片段之间的所述多个相似度分数,输入至深度记忆神经网络,以得到所述目标音频片段与每首歌曲之间的目标相似度分数;

278.根据所述目标相似度分数和所述预设的判断阈值,识别出与所述目标音频片段最相似的歌曲。

279.可以理解的是,上述说明的电子设备中的处理器执行所述计算机程序时,也可以实现上述对应的各装置实施例中各单元的功能,此处不再赘述。示例性的,所述计算机程序可以被分割成一个或多个模块/单元,所述一个或者多个模块/单元被存储在所述存储器中,并由所述处理器执行,以完成本发明。所述一个或多个模块/单元可以是能够完成特定功能的一系列计算机程序指令段,该指令段用于描述所述计算机程序在所述翻唱歌曲识别设备中的执行过程。例如,所述计算机程序可以被分割成上述翻唱歌曲识别设备中的各单元,各单元可以实现如上述相应翻唱歌曲识别设备说明的具体功能。

280.所述电子设备可以是桌上型计算机、笔记本、掌上电脑及云端服务器等计算设备。所述电子设备可包括但不仅限于处理器、存储器。本领域技术人员可以理解,处理器、存储器仅仅是计算机装置的示例,并不构成对计算机装置的限定,可以包括更多或更少的部件,或者组合某些部件,或者不同的部件,例如所述电子设备还可以包括输入输出设备、网络接入设备、总线等。

281.所述处理器可以是中央处理单元(central processing unit,cpu),还可以是其他通用处理器、数字信号处理器(digital signal processor,dsp)、专用集成电路(application specific integrated circuit,asic)、现成可编程门阵列(field

‑

programmable gate array,fpga)或者其他可编程逻辑器件、分立门或者晶体管逻辑器件、

分立硬件组件等。通用处理器可以是微处理器或者该处理器也可以是任何常规的处理器等,所述处理器是所述计算机装置的控制中心,利用各种接口和线路连接整个计算机装置的各个部分。

282.所述存储器可用于存储所述计算机程序和/或模块,所述处理器通过运行或执行存储在所述存储器内的计算机程序和/或模块,以及调用存储在存储器内的数据,实现所述计算机装置的各种功能。所述存储器可主要包括存储程序区和存储数据区,其中,存储程序区可存储操作系统、至少一个功能所需的应用程序等;存储数据区可存储根据终端的使用所创建的数据等。此外,存储器可以包括高速随机存取存储器,还可以包括非易失性存储器,例如硬盘、内存、插接式硬盘,智能存储卡(smart media card,smc),安全数字(secure digital,sd)卡,闪存卡(flash card)、至少一个磁盘存储器件、闪存器件、或其他易失性固态存储器件。

283.本发明还提供了一种计算机可读存储介质,该计算机可读存储介质用于实现翻唱歌曲识别设备的功能,其上存储有计算机程序,计算机程序被处理器执行时,处理器,可以用于执行如下步骤:

284.获取训练集中待训练音频片段的第一目标嵌入向量,所述第一目标嵌入向量为所述待训练音频片段的频域特征向量;

285.获取所述训练集中待训练音频片段的第一歌词向量;

286.将对应于待训练音频片段的所述第一目标嵌入向量和所述第一歌词向量,输入至初始神经网络的编码层,得到对应于待训练音频片段的融合向量;

287.将待训练音频片段的所述融合向量输入至所述初始神经网络的解码层,得到对应的第二目标嵌入向量和第二歌词向量;

288.基于所述第二目标嵌入向量、所述第一目标嵌入向量、所述第二歌词向量及所述第一歌词向量计算目标损失值;

289.根据所述目标损失值更新所述初始神经模型的模型参数,得到更新后的神经网络模型;

290.若所述更新后的神经网络模型符合收敛条件,则输出所述更新后的神经网络模型中的编码层作为特征提取模型。

291.在本发明的一些实施例中,计算机可读存储介质存储的计算机程序被处理器执行时,处理器,可以具体用于执行如下步骤:

292.若所述更新后的神经网络模型不符合收敛条件,则从所述训练集中获取另外的待训练音频片段,并返回执行所述获取训练集中待训练音频片段的第一目标嵌入向量的步骤,直至所述更新后的神经网络模型符合收敛条件。

293.在本发明的一些实施例中,计算机可读存储介质存储的计算机程序被处理器执行时,处理器,可以具体用于执行如下步骤:

294.根据预设的损失函数,分别计算所述第二目标嵌入向量和所述第一目标嵌入向量之间的第一损失,以及所述第二歌词向量与所述第一歌词向量之间的第二损失;

295.根据所述第一损失和所述第二损失,计算所述目标损失值。在本发明的一些实施例中,计算机可读存储介质存储的计算机程序被处理器执行时,处理器,可以具体用于执行如下步骤:

296.将训练集中的所述待训练音频片段执行时域与频域之间的特征转换,以获取所述待训练音频片段的的频域特征;

297.将所述待训练音频片段的的频域特征输入至kdtn神经网络,得到所述待训练音频片段的第一目标嵌入向量。

298.在本发明的一些实施例中,计算机可读存储介质存储的计算机程序被处理器执行时,处理器,可以具体用于执行如下步骤:

299.将训练集中的所述待训练音频片段的音频特征转换为文本特征,以提取出所述待训练音频片段的歌词;

300.将所述待训练音频片段的歌词输入至文本嵌入模型,以得到所述待训练音频片段的第一歌词向量。

301.本发明实施例还提供了另一种计算机可读存储介质,计算机可读存储介质存储的计算机程序被处理器执行时,处理器,可以具体用于执行如下步骤:

302.获取目标音频片段;

303.提取出所述目标音频片段的歌词向量;

304.提取出所述目标音频片段的目标嵌入向量;

305.将所述目标音频片段的歌词向量和目标嵌入向量输入至本技术实施例第一方面所述的特征提取模型,得到所述目标音频片段的融合向量;

306.根据所述目标音频片段的融合向量,与数据库中每首歌曲的多个音频片段分别对应的多个融合向量,识别出与所述目标音频片段最相似的歌曲。

307.在本发明的一些实施例中,在所述根据所述目标音频片段的融合向量,与数据库中每首歌曲的多个音频片段分别对应的多个融合向量,识别出与所述目标音频片段最相似的歌曲之前,计算机可读存储介质存储的计算机程序被处理器执行时,处理器,可以具体用于执行如下步骤:

308.获取数据库中每首歌曲的多个音频片段中的每个音频片段对应的第三歌词向量和第三目标嵌入向量;

309.将所述第三歌词向量和所述第三目标嵌入向量输入至所述特征提取模型,以得到与所述数据库中每首歌曲的多个音频片段分别对应的多个融合向量。

310.在本发明的一些实施例中,计算机可读存储介质存储的计算机程序被处理器执行时,处理器,可以具体用于执行如下步骤:

311.分别计算出所述目标音频片段的融合向量,与所述数据库中每首歌曲的多个音频片段分别对应的多个融合向量之间的多个相似度分数;

312.根据所述多个相似度分数和预设的判断阈值,识别出与所述目标音频片段最相似的歌曲。

313.在本发明的一些实施例中,计算机可读存储介质存储的计算机程序被处理器执行时,处理器,可以具体用于执行如下步骤:

314.将所述目标音频片段与所述数据库中每首歌曲的多个音频片段之间的所述多个相似度分数,输入至深度记忆神经网络,以得到所述目标音频片段与每首歌曲之间的目标相似度分数;

315.根据所述目标相似度分数和所述预设的判断阈值,识别出与所述目标音频片段最

相似的歌曲。

316.可以理解的是,所述集成的单元如果以软件功能单元的形式实现并作为独立的产品销售或使用时,可以存储在相应的一个计算机可读取存储介质中。基于这样的理解,本发明实现上述相应的实施例方法中的全部或部分流程,也可以通过计算机程序来指令相关的硬件来完成,所述的计算机程序可存储于一计算机可读存储介质中,该计算机程序在被处理器执行时,可实现上述各个方法实施例的步骤。其中,所述计算机程序包括计算机程序代码,所述计算机程序代码可以为源代码形式、对象代码形式、可执行文件或某些中间形式等。所述计算机可读介质可以包括:能够携带所述计算机程序代码的任何实体或装置、记录介质、u盘、移动硬盘、磁碟、光盘、计算机存储器、只读存储器(rom,read

‑

only memory)、随机存取存储器(ram,random access memory)、电载波信号、电信信号以及软件分发介质等。需要说明的是,所述计算机可读介质包含的内容可以根据司法管辖区内立法和专利实践的要求进行适当的增减,例如在某些司法管辖区,根据立法和专利实践,计算机可读介质不包括电载波信号和电信信号。

317.在本技术所提供的几个实施例中,应该理解到,所揭露的系统,装置和方法,可以通过其它的方式实现。例如,以上所描述的装置实施例仅仅是示意性的,例如,所述单元的划分,仅仅为一种逻辑功能划分,实际实现时可以有另外的划分方式,例如多个单元或组件可以结合或者可以集成到另一个系统,或一些特征可以忽略,或不执行。另一点,所显示或讨论的相互之间的耦合或直接耦合或通信连接可以是通过一些接口,装置或单元的间接耦合或通信连接,可以是电性,机械或其它的形式。

318.所述作为分离部件说明的单元可以是或者也可以不是物理上分开的,作为单元显示的部件可以是或者也可以不是物理单元,即可以位于一个地方,或者也可以分布到多个网络单元上。可以根据实际的需要选择其中的部分或者全部单元来实现本实施例方案的目的。

319.另外,在本发明各个实施例中的各功能单元可以集成在一个处理单元中,也可以是各个单元单独物理存在,也可以两个或两个以上单元集成在一个单元中。上述集成的单元既可以采用硬件的形式实现,也可以采用软件功能单元的形式实现。

320.以上所述,以上实施例仅用以说明本发明的技术方案,而非对其限制;尽管参照前述实施例对本发明进行了详细的说明,本领域的普通技术人员应当理解:其依然可以对前述各实施例所记载的技术方案进行修改,或者对其中部分技术特征进行等同替换;而这些修改或者替换,并不使相应技术方案的本质脱离本发明各实施例技术方案的精神和范围。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1