一种基于语音识别方法、装置和计算机设备与流程

本技术涉及计算机,具体涉及一种基于语音识别方法、装置和计算机设备。

背景技术:

1、语音识别,其目标是将人类的语音中的词汇内容转换为计算机可读的输入,例如控件、二进制编码或者字符序列,等等。随着人工智能技术的快速发展,可以利用人工智能模型进行语音识别。此外,随着数据处理技术的进步以及移动互联网的快速普及,语音识别被广泛地运用到了社会的各个领域。其中,不同领域对应的语音场景可能会不同,而且同一个领域中可能会存在着多个不同语音场景,这为将人工智能技术应用到语音识别中带来了极大地挑战。

技术实现思路

1、本技术实施例提出了一种基于语音识别方法、装置和计算机设备,可以提高语音识别模型适配各种语音场景的效率和提高语音识别的准确性。

2、本技术实施例提供了一种基于语音识别方法,包括:

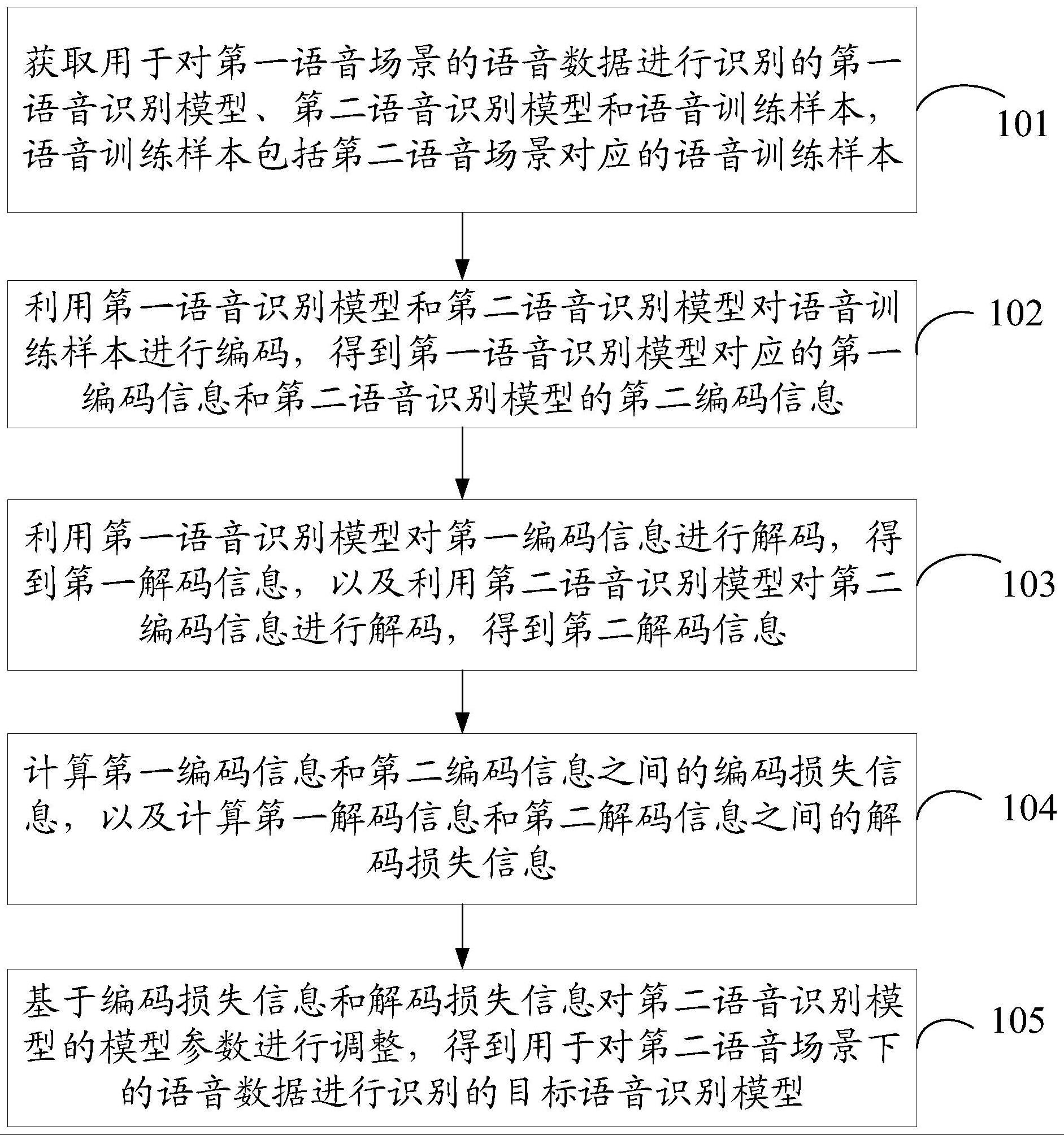

3、获取用于对第一语音场景的语音数据进行识别的第一语音识别模型、第二语音识别模型和语音训练样本,所述语音训练样本包括第二语音场景对应的语音训练样本;

4、利用所述第一语音识别模型和所述第二语音识别模型对所述语音训练样本进行编码,得到所述第一语音识别模型对应的第一编码信息和所述第二语音识别模型对应的第二编码信息;

5、利用所述第一语音识别模型对所述第一编码信息进行解码,得到第一解码信息,以及利用所述第二语音识别模型对所述第二编码信息进行解码,得到第二解码信息;

6、计算所述第一编码信息和所述第二编码信息之间的编码损失信息,以及计算所述第一解码信息和所述第二解码信息之间的解码损失信息;

7、基于所述编码损失信息和所述解码损失信息对所述第二语音识别模型的模型参数进行调整,得到用于对所述第二语音场景下的语音数据进行识别的目标语音识别模型。

8、相应的,本技术实施例还提供了一种基于语音识别装置,包括:

9、获取单元,用于获取用于对第一语音场景的语音数据进行识别的第一语音识别模型、第二语音识别模型和语音训练样本,所述语音训练样本包括第二语音场景对应的语音训练样本;

10、编码单元,用于利用所述第一语音识别模型和所述第二语音识别模型对所述语音训练样本进行编码,得到所述第一语音识别模型对应的第一编码信息和所述第二语音识别模型对应的第二编码信息;

11、解码单元,用于利用所述第一语音识别模型对所述第一编码信息进行解码,得到第一解码信息,以及利用所述第二语音识别模型对所述第二编码信息进行解码,得到第二解码信息;

12、计算单元,用于计算所述第一编码信息和所述第二编码信息之间的编码损失信息,以及计算所述第一解码信息和所述第二解码信息之间的解码损失信息;

13、调整单元,用于基于所述编码损失信息和所述解码损失信息对所述第二语音识别模型的模型参数进行调整,得到用于对所述第二语音场景下的语音数据进行识别的目标语音识别模型。

14、在一实施例中,所述计算单元,可以包括:

15、第一计算子单元,用于计算所述第一对齐解码信息和所述第二对齐解码信息之间的对齐解码损失信息;

16、第二计算子单元,用于计算所述第一注意力解码信息和所述第二注意力解码信息之间的注意力解码损失信息;

17、第一融合子单元,用于将所述对齐解码损失信息和所述注意力解码损失信息进行融合,得到所述解码损失信息。

18、在一实施例中,所述第一计算子单元,可以包括:

19、相除模块,用于将所述第一对齐解码信息和所述第二对齐解码信息进行相除,得到相除信息;

20、对数运算模块,用于对所述相除信息进行对数运算,得到运算后信息;

21、相乘模块,用于计算所述运算后信息和所述第二对齐解码信息进行相乘,得到所述对齐解码损失信息。

22、在一实施例中,所述计算单元,可以包括:

23、第三计算子单元,用于计算每个第一编码子信息及其对应的第二编码子信息之间的编码损失子信息;

24、第二融合子单元,用于将多个编码损失子信息进行融合,得到所述编码损失信息。

25、在一实施例中,所述第二融合子单元,可以包括:

26、排序模块,用于基于每个编码损失信息的数值量,将每个编码损失子信息进行排序,得到排序后的编码损失子信息;

27、确定模块,用于根据排序后的编码损失子信息,确定每个编码损失子信息对应的融合参数;

28、第一算术运算模块,用于将每个编码损失子信息及其对应的融合参数进行算术运算,得到所述编码损失信息。

29、在一实施例中,所述调整单元,可以包括:

30、第四计算子单元,用于计算所述第二语音识别模型对应的第二解码信息和预设标签之间的标签损失信息;

31、第三融合子单元,用于将所述编码损失信息和所述解码损失信息进行融合,得到模型损失信息;

32、第四融合子单元,用于将所述模型损失信息和所述标签损失信息进行融合,得到目标融合信息;

33、调整子单元,用于基于所述目标融合信息对所述第二语音识别模型的模型参数进行调整,得到用于对所述第二语音场景下的语音数据进行识别的目标语音识别模型。

34、在一实施例中,所述第三融合子单元,可以包括:

35、比较模块,用于将所述编码损失信息、所述对齐解码损失信息和所述注意力解码损失信息进行比较,得到比较结果;

36、生成模块,用于基于所述比较结果,分别生成编码损失信息、对齐解码损失信息和注意力解码损失信息对应的融合参数;

37、第二算术运算模块,用于分别将编码损失信息、对齐解码损失信息和注意力解码损失信息及其对应的融合参数进行算术运算,得到所述模型损失信息。

38、在一实施例中,所述编码单元,可以包括:

39、前向处理子单元,用于利用所述第一语音识别模型和所述第二语音识别模型对所述语音训练样本进行前向处理,得到第一语音识别模型对应的第一前向信息和第二语音识别模型对应的第二前向信息;

40、自注意力特征提取子单元,用于利用所述第一语音识别模型对所述第一前向信息进行自注意力特征提取,得到第一自注意力特征信息,以及利用所述第二语音识别模型对所述第二前向信息进行自注意力特征提取,得到第二自注意力特征信息;

41、卷积运算子单元,用于利用所述第一语音识别模型对所述第一自注意力特征信息进行卷积运算,得到第一语音识别模型对应的第一编码信息,以及利用所述第二语音识别模型对所述第二自注意力信息进行卷积运算,得到所述第二语音识别模型对应的第二编码信息。

42、在一实施例中,所述前向处理子单元,可以包括:

43、归一化处理模块,用于利用所述第一语音识别模型和所述第二语音识别模型对所述语音训练样本进行归一化处理,得到第一归一化后信息和第二归一化后信息;

44、线性转换模块,用于利用所述第一语音识别模型对所述第一归一化后信息进行线性转换,得到第一线性转换后信息,以及利用所述第二语音识别模型对所述第二归一化后信息进行线性转换,得到第二线性转换后信息;

45、非线性激活模块,用于利用所述第一语音识别模型对第一线性转换后信息进行非线性激活,得到所述第一前向信息,以及利用所述第二语音识别模型对第二线性转换后信息进行非线性激活,得到所述第二前向信息。

46、在一实施例中,所述解码单元,可以包括:

47、对齐处理子单元,用于利用所述第一语音识别模型对所述第一编码信息进行对齐处理,得到第一对齐后信息,以及利用所述第二语音识别模型对所述第二编码信息进行对齐处理,得到第二对齐后信息;

48、分布拟合子单元,用于利用所述第一语音识别模型对所述第一编码信息进行分布拟合,得到第一分布信息,以及利用所述第二语音识别模型对所述第二编码信息进行分布拟合,得到第二分布信息;

49、修正子单元,用于利用所述第一对齐后信息对所述第一分布信息进行修正,得到所述第一编码信息,以及利用所述第二对齐后信息对所述第二分布信息进行修正,得到所述第二编码信息。

50、本技术实施例还提供了一种计算机程序产品或计算机程序,该计算机程序产品或计算机程序包括计算机指令,该计算机指令存储在计算机可读存储介质中。计算机设备的处理器从计算机可读存储介质读取该计算机指令,处理器执行该计算机指令,使得该计算机设备执行上述一方面的各种可选方式中提供的方法。

51、相应的,本技术实施例还提供一种存储介质,所述存储介质存储有指令,所述指令被处理器执行时实现本技术实施例任一提供的基于语音识别方法。

52、本技术实施例可以获取用于对第一语音场景的语音数据进行识别的第一语音识别模型、第二语音识别模型和语音训练样本,语音训练样本包括第二语音场景对应的语音训练样本;利用第一语音识别模型和第二语音识别模型对语音训练样本进行编码,得到第一语音识别模型对应的第一编码信息和第二语音识别模型的第二编码信息;利用第一语音识别模型对第一编码信息进行解码,得到第一解码信息,以及利用第二语音识别模型对第二编码信息进行解码,得到第二解码信息;计算第一编码信息和第二编码信息之间的编码损失信息,以及计算第一解码信息和第二解码信息之间的解码损失信息;基于编码损失信息和解码损失信息对第二语音识别模型的模型参数进行调整,得到用于对第二语音场景下的语音数据进行识别的目标语音识别模型,可以提高语音识别模型适配各种语音场景的效率和提高语音识别的准确性。

- 还没有人留言评论。精彩留言会获得点赞!