单声道音频中的第三人声识别方法及系统与流程

1.本发明涉及声纹识别技术领域,具体涉及一种单声道音频中的第三人声识别方法、系统、计算机设备以及非易失性计算机可读存储介质。

背景技术:

2.目前,在银行私募产品销售业务场景下,对客户已提交的认购信息需通过远程视频的方式进行风险告知和认购信息确认,以保证客户知晓风险信息和本人确认。整个视讯过程中,监管要求必须由客户独立口述完成,不允许第三人提示或他人代答等不合规行为的出现。以上不合规行为若漏查错查,可能会造成经营风险。当前视讯方式是线上ai数字机器人与客户视讯、线下人工质检视讯视频相结合的方式,若人工质检存在不合规问题,则当前视讯无效,需联系客户进行二次视讯。即现有技术中采用纯人工的视讯第三人声识别方法,不但费时费力,人工成本高,而且,识别准确率较低。

3.因此,本技术提出一种在单声道音频数据下,对视讯过程中第三人声识别的方法。

技术实现要素:

4.鉴于上述现有技术的不足之处,本发明的目的在于提供一种可用于金融科技或其他相关领域的单声道音频中的第三人声识别方法、系统、计算机设备以及非易失性计算机可读存储介质,旨在解决现有技术中采用纯人工的视讯第三人声识别方法,不但费时费力,人工成本高,而且,识别准确率较低的问题。

5.为了达到上述目的,本发明采取了以下技术方案:

6.一种单声道音频中的第三人声识别方法,其中,包括:

7.获取客户远程视讯中的单声道音频流;

8.提取所述单声道音频流内的声纹嵌入特征;

9.基于所述声纹嵌入特征识别所述单声道音频流内的说话人转换点,并根据所述说话人转换点得到对应的说话人转换区间;

10.提取所述说话人转换区间开始结束前后设定值内的声纹嵌入特征,通过谱聚类算法,判断所述说话人转换区间内是否有类型个数大于两人的声音片段;

11.若有,则将类型个数大于两人的声音片段选出,判定所述单声道音频流内有第三人声;若无,则判断所述单声道音频流内无第三人声。

12.在进一步的技术方案中,所述的单声道音频中的第三人声识别方法,其中,所述提取所述单声道音频流内的声纹嵌入特征,包括:

13.使用vad算法去除所述单声道音频流内的非语音部分,保留所述单声道音频流内的语音部分;

14.提取保留的所述语音部分内每秒音频的梅尔频率倒谱图;

15.将所述梅尔频率倒谱图输入至预先训练好的tdnn声纹嵌入模型中,根据输出结果获取所述单声道音频流内的声纹嵌入特征。

16.在进一步的技术方案中,所述的单声道音频中的第三人声识别方法,其中,所述基于所述声纹嵌入特征识别所述单声道音频流内的说话人转换点,并根据所述说话人转换点得到对应的说话人转换区间,包括:

17.基于所述声纹嵌入特征识别所述单声道音频流内是否有说话人转换点;

18.若有,则根据所述说话人转换点得到对应的说话人转换区间;

19.若否,则判断所述单声道音频流内无第三人声。

20.在进一步的技术方案中,所述的单声道音频中的第三人声识别方法,其中,所述若有,则将类型个数大于两人的声音片段选出,判定所述单声道音频流内有第三人声,包括:

21.若有,则将类型个数大于两人的声音片段选出,判定所述单声道音频流内有第三人声,并输出异常开始和结束的时间。

22.一种单声道音频中的第三人声识别系统,其中,包括:

23.获取模块,用于获取客户远程视讯中的单声道音频流;

24.提取模块,用于提取所述单声道音频流内的声纹嵌入特征;

25.识别模块,用于基于所述声纹嵌入特征识别所述单声道音频流内的说话人转换点,并根据所述说话人转换点得到对应的说话人转换区间;

26.聚类模块,用于提取所述说话人转换区间开始结束前后设定值内的声纹嵌入特征,通过谱聚类算法,判断所述说话人转换区间内是否有类型个数大于两人的声音片段;

27.结果输出模块,用于若有,则将类型个数大于两人的声音片段选出,判定所述单声道音频流内有第三人声;若无,则判断所述单声道音频流内无第三人声。

28.在进一步的技术方案中,所述的单声道音频中的第三人声识别系统,其中,所述提取所述单声道音频流内的声纹嵌入特征,包括:

29.使用vad算法去除所述单声道音频流内的非语音部分,保留所述单声道音频流内的语音部分;

30.提取保留的所述语音部分内每秒音频的梅尔频率倒谱图;

31.将所述梅尔频率倒谱图输入至预先训练好的tdnn声纹嵌入模型中,根据输出结果获取所述单声道音频流内的声纹嵌入特征。

32.在进一步的技术方案中,所述的单声道音频中的第三人声识别系统,其中,所述基于所述声纹嵌入特征识别所述单声道音频流内的说话人转换点,并根据所述说话人转换点得到对应的说话人转换区间,包括:

33.基于所述声纹嵌入特征识别所述单声道音频流内是否有说话人转换点;

34.若有,则根据所述说话人转换点得到对应的说话人转换区间;

35.若否,则判断所述单声道音频流内无第三人声。

36.在进一步的技术方案中,所述的单声道音频中的第三人声识别系统,其中,所述若有,则将类型个数大于两人的声音片段选出,判定所述单声道音频流内有第三人声,包括:

37.若有,则将类型个数大于两人的声音片段选出,判定所述单声道音频流内有第三人声,并输出异常开始和结束的时间。

38.一种计算机设备,其中,所述计算机设备包括至少一个处理器;以及,

39.与所述至少一个处理器通信连接的存储器;其中,

40.所述存储器上存储有可被所述至少一个处理器执行的计算机程序,所述计算机程

序被所述至少一个处理器执行时,可实现:

41.获取客户远程视讯中的单声道音频流;

42.提取所述单声道音频流内的声纹嵌入特征;

43.基于所述声纹嵌入特征识别所述单声道音频流内的说话人转换点,并根据所述说话人转换点得到对应的说话人转换区间;

44.提取所述说话人转换区间开始结束前后设定值内的声纹嵌入特征,通过谱聚类算法,判断所述说话人转换区间内是否有类型个数大于两人的声音片段;

45.若有,则将类型个数大于两人的声音片段选出,判定所述单声道音频流内有第三人声;若无,则判断所述单声道音频流内无第三人声。

46.在进一步的技术方案中,所述的计算机设备,其中,所述提取所述单声道音频流内的声纹嵌入特征,包括:

47.使用vad算法去除所述单声道音频流内的非语音部分,保留所述单声道音频流内的语音部分;

48.提取保留的所述语音部分内每秒音频的梅尔频率倒谱图;

49.将所述梅尔频率倒谱图输入至预先训练好的tdnn声纹嵌入模型中,根据输出结果获取所述单声道音频流内的声纹嵌入特征。

50.在进一步的技术方案中,所述的计算机设备,其中,所述基于所述声纹嵌入特征识别所述单声道音频流内的说话人转换点,并根据所述说话人转换点得到对应的说话人转换区间,包括:

51.基于所述声纹嵌入特征识别所述单声道音频流内是否有说话人转换点;

52.若有,则根据所述说话人转换点得到对应的说话人转换区间;

53.若否,则判断所述单声道音频流内无第三人声。

54.在进一步的技术方案中,所述的计算机设备,其中,所述若有,则将类型个数大于两人的声音片段选出,判定所述单声道音频流内有第三人声,包括:

55.若有,则将类型个数大于两人的声音片段选出,判定所述单声道音频流内有第三人声,并输出异常开始和结束的时间。

56.一种非易失性计算机可读存储介质,其中,所述非易失性计算机可读存储介质存储有计算机程序,所述计算机程序被至少一个处理器执行时,可实现:

57.获取客户远程视讯中的单声道音频流;

58.提取所述单声道音频流内的声纹嵌入特征;

59.基于所述声纹嵌入特征识别所述单声道音频流内的说话人转换点,并根据所述说话人转换点得到对应的说话人转换区间;

60.提取所述说话人转换区间开始结束前后设定值内的声纹嵌入特征,通过谱聚类算法,判断所述说话人转换区间内是否有类型个数大于两人的声音片段;

61.若有,则将类型个数大于两人的声音片段选出,判定所述单声道音频流内有第三人声;若无,则判断所述单声道音频流内无第三人声。

62.在进一步的技术方案中,所述的非易失性计算机可读存储介质,其中,所述提取所述单声道音频流内的声纹嵌入特征,包括:

63.使用vad算法去除所述单声道音频流内的非语音部分,保留所述单声道音频流内

的语音部分;

64.提取保留的所述语音部分内每秒音频的梅尔频率倒谱图;

65.将所述梅尔频率倒谱图输入至预先训练好的tdnn声纹嵌入模型中,根据输出结果获取所述单声道音频流内的声纹嵌入特征。

66.在进一步的技术方案中,所述的非易失性计算机可读存储介质,其中,所述基于所述声纹嵌入特征识别所述单声道音频流内的说话人转换点,并根据所述说话人转换点得到对应的说话人转换区间,包括:

67.基于所述声纹嵌入特征识别所述单声道音频流内是否有说话人转换点;

68.若有,则根据所述说话人转换点得到对应的说话人转换区间;

69.若否,则判断所述单声道音频流内无第三人声。

70.在进一步的技术方案中,所述的非易失性计算机可读存储介质,其中,所述若有,则将类型个数大于两人的声音片段选出,判定所述单声道音频流内有第三人声,包括:

71.若有,则将类型个数大于两人的声音片段选出,判定所述单声道音频流内有第三人声,并输出异常开始和结束的时间。

72.相较于现有技术,本发明提供了一种单声道音频中的第三人声识别方法及系统,其中,所述方法包括:获取客户远程视讯中的单声道音频流;提取所述单声道音频流内的声纹嵌入特征;基于所述声纹嵌入特征识别所述单声道音频流内的说话人转换点,并根据所述说话人转换点得到对应的说话人转换区间;提取所述说话人转换区间开始结束前后设定值内的声纹嵌入特征,通过谱聚类算法,判断所述说话人转换区间内是否有类型个数大于两人的声音片段;若有,则将类型个数大于两人的声音片段选出,判定所述单声道音频流内有第三人声;若无,则判断所述单声道音频流内无第三人声。通过本发明的单声道音频中的第三人声识别方法,可解决现有技术中采用纯人工的视讯第三人声识别方法,不但费时费力,人工成本高,而且,识别准确率较低的问题。

附图说明

73.为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发明中记载的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其它的附图。

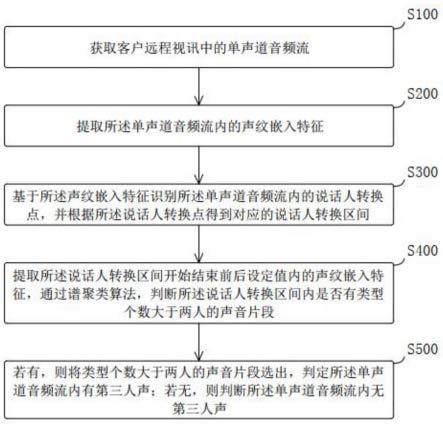

74.图1为本发明实施例提供的单声道音频中的第三人声识别方法的流程示意图。

75.图2为本发明实施例提供的单声道音频中的第三人声识别系统的功能模块示意图。

76.图3为本发明实施例提供的所述计算机设备的硬件结构示意图。

具体实施方式

77.为使本发明的目的、技术方案及效果更加清楚、明确,以下参照附图并举实施例对本发明进一步详细说明。应当理解,此处所描述的具体实施例仅用以解释本发明,并不用于限定本发明。

78.在本发明的描述中,所使用的“包含”、“包括”、“具有”、“含有”等,均为开放性的用

语,即意指包含但不限于。参考术语“一个实施例”、“一个具体实施例”、“一些实施例”、“例如”等的描述意指结合该实施例或示例描述的具体特征、结构或者特点包含于本技术的至少一个实施例或示例中。在本说明书中,对上述术语的示意性表述不一定指的是相同的实施例或示例。而且,描述的具体特征、结构或者特点可以在任何的一个或多个实施例或示例中以合适的方式结合。各实施例中涉及的步骤顺序用于示意性说明本技术的实施,其中的步骤顺序不作限定,可根据需要作适当调整。

79.下面结合附图,详细说明本发明的各种非限制性实施方式。

80.请参阅图1,本发明实施例提供的一种单声道音频中的第三人声识别方法,其中,包括:

81.s100、获取客户远程视讯中的单声道音频流;

82.s200、提取所述单声道音频流内的声纹嵌入特征;

83.s300、基于所述声纹嵌入特征识别所述单声道音频流内的说话人转换点,并根据所述说话人转换点得到对应的说话人转换区间;

84.s400、提取所述说话人转换区间开始结束前后设定值内的声纹嵌入特征,通过谱聚类算法,判断所述说话人转换区间内是否有类型个数大于两人的声音片段;

85.s500、若有,则将类型个数大于两人的声音片段选出,判定所述单声道音频流内有第三人声;若无,则判断所述单声道音频流内无第三人声。

86.进一步地,所述的单声道音频中的第三人声识别方法,其中,所述提取所述单声道音频流内的声纹嵌入特征,包括:

87.使用vad算法去除所述单声道音频流内的非语音部分,保留所述单声道音频流内的语音部分;

88.提取保留的所述语音部分内每秒音频的梅尔频率倒谱图;

89.将所述梅尔频率倒谱图输入至预先训练好的tdnn声纹嵌入模型中,根据输出结果获取所述单声道音频流内的声纹嵌入特征。

90.具体地,vad(voice activity detection)算法在语音信号处理中,例如语音增强、语音识别等领域有着非常重要的作用,它的作用是从一段语音(纯净或带噪)信号中标识出语音片段与非语音片段,vad算法通常包括两个部分,特征提取和语音/非语音判决。

91.本实施例中,对于获取的所述单声道音频流,使用vad算法,计算出每一帧的能量和音高,再将小于阈值的帧从所述单声道音频流中去除,去掉非语音部分,只保留语音部分,这样,可有效的去除由于静音所带来的错误信息,之后,再提取保留的所述语音部分内每秒音频的梅尔频率倒谱图,得到针对每一帧的数据能量坐标;

92.将得到的所述梅尔频率倒谱图输入至预先训练好的tdnn(时延神经网络)声纹嵌入模型中,根据输出结果获取所述单声道音频流内的声纹嵌入特征。tdnn时延神经网络对特征有较强的抽象能力,有能力表达声纹特征在时间上的关系,具有时间不变性。在tdnn声纹嵌入模型的训练过程中,使用多个全链接层,得到更全方面和多维度的说话人声纹信息,通过tdnn声纹嵌入模型,经过一层最大池化层(max pooling),池化层后使用多个全联接层将tdnn声纹嵌入模型的输出向量累积下来后,计算均值和标准方差作为下一步声纹嵌入的信息。

93.进一步地,所述的单声道音频中的第三人声识别方法,其中,所述基于所述声纹嵌

入特征识别所述单声道音频流内的说话人转换点,并根据所述说话人转换点得到对应的说话人转换区间,包括:

94.基于所述声纹嵌入特征识别所述单声道音频流内是否有说话人转换点;

95.若有,则根据所述说话人转换点得到对应的说话人转换区间;

96.若否,则判断所述单声道音频流内无第三人声。

97.本实施例中,利用cnn(卷积神经网络)模型多层卷积核将声音特征分离,得到声纹的低层退化特征和高层语义特征,声纹特征总共为128维,对于前后3秒的声纹嵌入特征进行预测。训练中,为了平衡同性别音频的训练数据,调整计算分类结果损失函数交叉熵的权重,通过归一化指数函数(softmax)

[0098][0099]

将cnn模型多分类的结果以概率形式体现,使用auc-roc(area under curve)auc_roc(a)=p(a(xi)<a(xi)yi=0,yi=1)计算曲线下方的面积,找到最优阈值0.6,进而判断是否有说话人转换,得到说话人转换点。

[0100]

得到模型cnn模型初步的预测时间和预测概率之后,使用nonmaximum suppression(非极大值抑制)的算法,具体算法如下:

[0101]

建造一个存放待处理后选时间区间的集合h,初始化为n个输出概率大于0.6的时间点;

[0102]

将所有集合h中的时间点进行排序,遍历集合h中的时间点,当a的时间点和a+1的时间点小于1s时,将两点合并,时间点和概率同时放入m集合中,直到接下来的相邻两点的时间点大于1s;

[0103]

平均合并时间点形成的时间区间的概率,最终得到一个时间区间和概率的集合;若集合中的时间区间的概率大于0.75,那么说明该时间区间内有说话人转换点;

[0104]

本实施例利用非极大值抑制的算法可找到最佳的预测时间区间,减少cnn模型在同一说话人转换点多次误报的情况,得到更准确的结果。

[0105]

进一步地,在得到预测的说话人转换区间后,提取该转换区间开始结束前后10秒的tdnn声纹嵌入模型的声纹嵌入特征,使用两层bi-lstm模型,二值交叉熵作为损失函数(binary cross entropy),计算每秒与每秒之间的声纹相似矩阵,得到每对相似矩阵的概率,提升相似性打分性能。该lstm模型较之前普通的余弦相似度更具有稳定性,网络隐藏层提取更深层次的声纹信息,同时保留了时间信息,得到更多的声纹特征向量,由于声音片段是具有时序性的,所以使用lstm模型可以得到历史信息,未来信息对当前状态的影响,具有一定的记忆效应,可以长期的保存音频的输入信息。

[0106]

进一步地,通过bi-lstm模型之后,得到每秒与每秒之间声纹嵌入特征的相似度矩阵,将所有的相似度矩阵合并,然后将相似的声纹矩阵进行谱聚类(spectral clustering),谱聚类是一种基于图论的聚类方法,将带权无向图划分为两个或两个以上的最优子图,使子图内部尽量相似,而子图间的距离尽量距离较远,以达到常见的聚类的目的。

[0107]

聚类过程如下:

[0108]

创建无向图g=(v,e),v表示顶点集合,即样本集合,即一个顶点为一个样本;e表

示边集合;

[0109]

设样本数为n,即顶点数为n;

[0110]

权重矩阵:w,为n*n的矩阵,其值w

i,j

为各边的权重,表示顶点i,j样本之间的相似性。对于任意w

i,j

=w

i,j

,w

i,j

=0,即对角线上元素为0;

[0111]

通常情况下,相似度小于某一阈值的两个顶点不相连,否则链接两顶点的边的权值为两个样本的相似性度量函数的值;

[0112]

定义n*n的矩阵:d,其第i行,第i列的元素(对角线上)元素为w第i行所有元素的和,即i顶点与其他所有顶点的相似性之和,

[0113][0114]

建立laplacian矩阵l以及l'=d-1/2

ld-1/2

,并标准化laplacian矩阵;

[0115]

求矩阵l'的(除0外)前k小个特征值及其对应的特征向量;

[0116]

利用q'=d

1/2

q求得对应的k个q;

[0117]

使用k-means算法进行聚类,得到所对应的k个cluster;

[0118]

将图g分割为k个子图,所要断开的边的权重之和为损失函数

[0119]

cut(g1,g2)=∑

i∈g1,j∈g2

w(i,j);

[0120]

在聚类过程中,通过对模型的不断调整,得到了相似度分割最好的阈值0.15,得到最优的解,这样可以在聚类过程中得到最佳的类别个数。

[0121]

谱聚类可以让子集间相似度最小而单独一个子集内部相似度最大,可以将不同的声纹片段尽可能的远离,将更相似的声纹片段进行聚合。另外,通过使用laplacian eigenmap进行降维,计算复杂度较其他的聚类算法运算量小,还优化了在稀疏矩阵下求特征值和特征向量的算法。

[0122]

进一步地,所述的单声道音频中的第三人声识别方法,其中,所述若有,则将类型个数大于两人的声音片段选出,判定所述单声道音频流内有第三人声,包括:

[0123]

若有,则将类型个数大于两人的声音片段选出,判定所述单声道音频流内有第三人声,并输出异常开始和结束的时间。

[0124]

具体地,即判定所述单声道音频流内含有除了坐席人员、顾客之外的第三人声音,并输出异常开始和结束的时间。

[0125]

本实施例的单声道音频中的第三人声识别方法,相比现有技术中采用纯人工的视讯第三人声识别方法,具有更灵活和更准确的识别能力,可以不光检测出单声道音频流内说话人转换点,还能检测出单声道音频流内含有几个不同的人的声纹信息,本实施例的方法保证了在远程私募视讯过程中全流程的对客户自主回答进行实时精准监测,对私募销售过程中的风险把控进一步加强,提升了经营风险监测能力,提升了客户认购私募产品时的线上体验。

[0126]

应该理解的是,虽然本技术提供了如实施例或流程图所述的方法操作步骤,但基于常规或者无创造性的劳动可以包括更多或者更少的操作步骤,这些操作步骤并不是必然按照实施例或流程图的顺序依次执行。实施例或流程图中列举的步骤顺序仅仅为众多步骤执行顺序中的一种方式,不代表唯一的执行顺序。而且,实施例或流程图中的至少一部分步骤可以包括多个子步骤或者多个阶段,这些子步骤或者阶段并不必然是在同一时刻执行完成,而是可以在不同的时刻执行,这些子步骤或者阶段的执行顺序也不必然是依次进行,而

是可以与其它步骤或者其它步骤的子步骤或者阶段的至少一部分轮流、交替或者同步地执行。

[0127]

基于上述实施例,请参阅图2,本发明还提供了一种单声道音频中的第三人声识别系统,其中,包括:

[0128]

获取模块11,用于获取客户远程视讯中的单声道音频流;

[0129]

提取模块12,用于提取所述单声道音频流内的声纹嵌入特征;

[0130]

识别模块13,用于基于所述声纹嵌入特征识别所述单声道音频流内的说话人转换点,并根据所述说话人转换点得到对应的说话人转换区间;

[0131]

聚类模块14,用于提取所述说话人转换区间开始结束前后设定值内的声纹嵌入特征,通过谱聚类算法,判断所述说话人转换区间内是否有类型个数大于两人的声音片段;

[0132]

结果输出模块15,用于若有,则将类型个数大于两人的声音片段选出,判定所述单声道音频流内有第三人声;若无,则判断所述单声道音频流内无第三人声。

[0133]

具体实施方式见上述方法实施例,此处不再赘述。

[0134]

进一步地,所述的单声道音频中的第三人声识别系统,其中,所述提取所述单声道音频流内的声纹嵌入特征,包括:

[0135]

使用vad算法去除所述单声道音频流内的非语音部分,保留所述单声道音频流内的语音部分;

[0136]

提取保留的所述语音部分内每秒音频的梅尔频率倒谱图;

[0137]

将所述梅尔频率倒谱图输入至预先训练好的tdnn声纹嵌入模型中,根据输出结果获取所述单声道音频流内的声纹嵌入特征。

[0138]

具体实施方式见上述方法实施例,此处不再赘述。

[0139]

进一步地,所述的单声道音频中的第三人声识别系统,其中,所述基于所述声纹嵌入特征识别所述单声道音频流内的说话人转换点,并根据所述说话人转换点得到对应的说话人转换区间,包括:

[0140]

基于所述声纹嵌入特征识别所述单声道音频流内是否有说话人转换点;

[0141]

若有,则根据所述说话人转换点得到对应的说话人转换区间;

[0142]

若否,则判断所述单声道音频流内无第三人声。

[0143]

具体实施方式见上述方法实施例,此处不再赘述。

[0144]

进一步地,所述的单声道音频中的第三人声识别系统,其中,所述若有,则将类型个数大于两人的声音片段选出,判定所述单声道音频流内有第三人声,包括:

[0145]

若有,则将类型个数大于两人的声音片段选出,判定所述单声道音频流内有第三人声,并输出异常开始和结束的时间。

[0146]

具体实施方式见上述方法实施例,此处不再赘述。

[0147]

基于上述实施例,请参阅图3,本发明还提供了一种计算机设备,其中,所述计算机设备10包括:

[0148]

存储器120以及一个或多个处理器110,图3中以一个处理器110为例进行介绍,处理器110和存储器120可以通过通信总线或者其他方式连接,图3中以通过通信总线连接为例。

[0149]

处理器110用于完成计算机设备10的各种控制逻辑,其可以为通用处理器、数字信

号处理器(dsp)、专用集成电路(asic)、现场可编程门阵列(fpga)、单片机、arm(acorn risc machine)或其它可编程逻辑器件、分立门或晶体管逻辑、分立的硬件组件或者这些部件的任何组合。还有,处理器110还可以是任何传统处理器、微处理器或状态机。处理器110也可以被实现为计算设备的组合,例如,dsp和微处理器的组合、多个微处理器、一个或多个微处理器结合dsp核、或任何其它这种配置。

[0150]

存储器120作为一种非易失性计算机可读存储介质,可用于存储非易失性软件程序、非易失性计算机可执行程序以及模块,如本发明实施例中的单声道音频中的第三人声识别方法对应的计算机程序。处理器110通过运行存储在存储器120中的非易失性软件程序、指令以及单元,从而执行计算机设备10的各种功能应用以及数据处理,即实现上述方法实施例中的单声道音频中的第三人声识别方法。

[0151]

存储器120可以包括存储程序区和存储数据区,其中,存储程序区可存储操作装置、至少一个功能所需要的应用程序;存储数据区可存储根据计算机设备10使用所创建的数据等。此外,存储器120可以包括高速随机存取存储器,还可以包括非易失性存储器,例如至少一个磁盘存储器件、闪存器件、或其他非易失性固态存储器件。在一些实施例中,存储器120可选包括相对于处理器110远程设置的存储器,这些远程存储器可以通过网络连接至计算机设备10。上述网络的实例包括但不限于互联网、企业内部网、局域网、移动通信网及其组合。

[0152]

一个或者多个单元存储在存储器120中,当被一个或者多个处理器110执行时,可实现如上述任一项方法实施例中的单声道音频中的第三人声识别方法,例如,可实现以上描述的图1中的方法步骤s100至步骤s500。

[0153]

本领域技术人员可以理解,图3中示出的硬件结构示意图,仅仅是与本发明方案相关的部分结构的示意图,并不构成对本发明方案所应用于其上的计算机设备的限定,具体的计算机设备可以包括比图中所示更多的部件,或者组合某些部件,或者具有不同的部件布置。

[0154]

基于上述实施例,本发明还提供了一种非易失性计算机可读存储介质,其中,所述非易失性计算机可读存储介质存储有计算机程序,所述计算机程序被至少一个处理器执行时,可实现如上述任一项方法实施例中的单声道音频中的第三人声识别方法,例如,可实现以上描述的图1中的方法步骤s100至步骤s500。

[0155]

作为示例,非易失性存储介质能够包括只读存储器(rom)、可编程rom(prom)、电可编程rom(eprom)、电可擦rom(eeprom)或闪速存储器。易失性存储器能够包括作为外部高速缓存存储器的随机存取存储器(ram)。通过说明并非限制,ram可以以诸如同步ram(sram)、动态ram、(dram)、同步dram(sdram)、双数据速率sdram(ddr sdram)、增强型sdram(esdram)、synchl ink dram(sldram)以及直接rambus(兰巴斯)ram(drram)之类的许多形式得到。本文中所描述的操作环境的所公开的存储器组件或存储器旨在包括这些和/或任何其他适合类型的存储器中的一个或多个。

[0156]

本发明的另一种实施例提供了一种计算机程序产品,所述计算机程序产品包括存储在非易失性计算机可读存储介质上的计算机程序,所述计算机程序包括程序指令,当所述程序指令被处理器执行时,可实现如上述任一项方法实施例中的单声道音频中的第三人声识别方法,例如,可实现以上描述的图1中的方法步骤s100至步骤s500。

[0157]

以上所描述的实施例仅仅是示意性的,其中作为分离部件说明的单元可以是或者也可以不是物理上分开的,作为单元显示的部件可以是或者也可以不是物理单元,即可以位于一个地方,或者也可以分布到多个网络单元上。可以根据实际需要选择其中的部分或者全部模块来实现本实施例方案的目的。

[0158]

通过以上的实施例的描述,本领域的技术人员可以清楚地了解到各实施例可借助软件加通用硬件平台的方式来实现,当然也可以通过硬件实现。基于这样的理解,上述技术方案本质上或者说对相关技术做出贡献的部分可以以软件产品的形式体现出来,该计算机软件产品可以存在于计算机可读存储介质中,如rom/ram、磁碟、光盘等,包括若干指令用以使得一台计算机装置(可以是个人计算机,服务器,或者网络装置等)执行各个实施例或者实施例的某些部分的方法。

[0159]

除了其他之外,诸如“能够”、“能”、“可能”或“可以”之类的条件语言除非另外具体地陈述或者在如所使用的上下文内以其他方式理解,否则一般地旨在传达特定实施方式能包括(然而其他实施方式不包括)特定特征、元件和/或操作。因此,这样的条件语言一般地还旨在暗示特征、元件和/或操作对于一个或多个实施方式无论如何都是需要的或者一个或多个实施方式必须包括用于在有或没有输入或提示的情况下判定这些特征、元件和/或操作是否被包括或者将在任何特定实施方式中被执行的逻辑。

[0160]

已经在本文中在本说明书和附图中描述的内容包括能够提供单声道音频中的第三人声识别方法、系统、计算机设备以及非易失性计算机可读存储介质的示例。当然,不能够出于描述本公开的各种特征的目的来描述元件和/或方法的每个可以想象的组合,但是可以认识到,所公开的特征的许多另外的组合和置换是可能的。因此,显而易见的是,在不脱离本公开的范围或精神的情况下能够对本公开做出各种修改,但是,所有这些各种修改都应属于本发明所附权利要求的保护范围。此外,或在替代方案中,本公开的其他实施例从对本说明书和附图的考虑以及如本文中所呈现的本公开的实践中可能是显而易见的。意图是,本说明书和附图中所提出的示例在所有方面被认为是说明性的而非限制性的。尽管在本文中采用了特定术语,但是它们在通用和描述性意义上被使用并且不用于限制的目的。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1