1.本发明涉及声音信号采集与处理的技术领域,具体地,涉及毫米波雷达与麦克风融合的声学传感方法和系统。

背景技术:2.随着物联网的迅速普及和发展,声音作为人类获取信息的主要途径,逐渐也成为通讯和人机交互的重要方式。因此,许多基于声音感知方法的交互应用在各个行业都得到了开发。例如,车载声控交互、智能家居、智能手机语音助手等。

3.根据传感器的种类可以分为纯音频的声学感知方法和多传感器融合的方法。

4.纯音频的声学感知方法:纯音频感知方法主要使用麦克风作为传感器,其中根据麦克风的数量可进一步分为单麦克风声音感知方法和多麦克风阵列的声音感知方法。

5.多传感器融合的声学感知方法主要为视觉-听觉融合的声学感知方法。这种方法模拟人类对声音信息的感知,在声音获取中整合和分析了目标声源的图像信息,进而获取更高质量的声源信息。

6.1、纯音频的声学感知方法

7.单麦克风方法:这种单麦克风的声音感知方法在复杂和强噪音干扰的情况下表现不佳。另外,单麦克风在语音分离领域限制较多,多声源信号混叠,分离后语音信号的排序问题一直是单麦克风语音分离的难点。

8.多麦克风阵列方法:多麦克风通过阵列的方法虽然可以对目标区域的声源进行定位,并分离目标区域的声源,但是往往需要多个麦克风进行阵列,导致装置通常较为庞大,成本较高,并且由于缺少距离分辨率,其指向性较差,计算复杂度高。

9.2、视觉-听觉融合的声学感知方法:

10.这种方法主要使用麦克风和相机作为传感器。但由于相机对光照条件要求较为苛刻,因此这种方法无法实现全天时全天候的声音感知。并且相机对入射的角度有严格要求,且会引发潜在的隐私泄露问题。

11.在公告号为cn107564539b的专利文献中公开了一种面向麦克风阵列的声学回声消除方法,麦克风阵列实时采集近端信号和回声信号的数据,选取其中一个麦克风的通道信号,根据自适应滤波思想和独立成分分析算法构建初始化模型,根据初始化模型建立回声消除模型对麦克风单通道信号进行回声消除,根据初始回声消除模型以及单通道的滤波器系数去构建麦克风阵列中其他麦克风的回声消除估计模型进行回声消除,本发明能对多通道的麦克风阵列进行声学回声消除,提供有效的数据处理和提高语音识别率;本发明提供的装置通过将声学传感器布置于一个环形传感器阵列上的关键位置,测量系统的多通道录音信号和回声信号进行回声消除,获取麦克风阵列的回声消除信号,最终达到提高语音识别率的目的。

12.因此,需要提出一种新的技术方案。

技术实现要素:13.针对现有技术中的缺陷,本发明的目的是提供一种毫米波雷达与麦克风融合的声学传感方法和系统。

14.根据本发明提供的一种毫米波雷达与麦克风融合的声学传感方法,所述方法包括如下步骤:

15.步骤s1:利用毫米波雷达对目标声源进行探测,并根据回波信号估计目标声源的振动信息x(t),并从中提取目标声源的雷达声音信号;

16.步骤s2:对目标声源的雷达声音信号以及麦克风采集到的混合声音信号进行预处理;将目标声源的雷达声音信号和麦克风采集到的混合声音信号进行分帧处理,并对信号进行信息增强;

17.步骤s3:对雷达声音信号进行分析,利用模拟雷达声音信号或者真实实测雷达声音信号构建训练数据集;设计网络模型,对神经网络模型进行训练;

18.步骤s4:将信息增强后的信号输入训练好的神经网络中,获取输出数据;

19.步骤s5:对神经网络输出的数据进行恢复,获取需要提取的目标声音信号。

20.优选地,所述步骤s1利用毫米波雷达和麦克风获取目标声源的雷达声音信号以及混合声音信号;

21.获取振动信息x(t)的具体方法为:

22.步骤s1.1:使用毫米波雷达发射并接收信号,并获取基带信号的干涉相位演变信息

23.步骤s1.2:根据基带信号的相位信息计算出目标处的振动信息:其中λ为载波波长。

24.优选地,所述步骤s2将目标声源的雷达声音信号和麦克风采集到的混合声音信号进行分帧处理,并对信号进行信息增强;

25.其具体方法如下:

26.步骤s2.1:将采集到的雷达声音信号以及混合声音信号进行分帧;

27.步骤s2.2:对分帧后的每一帧信号做频谱分析,并分别获取麦克风信号和雷达声音信号的实部谱和虚部谱。

28.优选地,所述步骤s3包括如下步骤:

29.步骤s3.1:对雷达声音信号进行分析,包括但不仅限于根据真实声音信号对其进行模拟并获取雷达声音信号数据,或者使用实测的方法获取雷达声音信号数据;

30.步骤s3.2:设计网络模型,网络模型包含一个模型激活函数和用于声音融合的编解码器结构;模型激活函数根据雷达声音信号的能量判断当前时刻目标说话人的状态;若当前时刻目标说话人正在说话,则激活用于分离的编解码器结构;反之,则不激活该结构,而使用零掩码;

31.步骤s3.3:使用数据对该模型进行训练,获取较为优秀的训练模型。

32.优选地,所述步骤s5根据恢复后的实数谱和虚数谱进行融合,获取需要提取的分离后的真实信号的时域信息;

33.融合的具体方法:

34.步骤s5.1:将神经网络恢复后得到的实数谱和虚数谱进行融合,得到恢复目标信号的复数谱;

35.步骤s5.2:对恢复信号的复数谱进行包括但不仅限于逆短时傅里叶变换在内的恢复方法,获取目标信号的时域信息。

36.本发明还提供一种毫米波雷达与麦克风融合的声学传感系统,所述系统应用于上述中的毫米波雷达与麦克风融合的声学传感方法,所述系统包括信号采集装置和融合处理模块;所述信号采集装置包括麦克风和毫米波雷达;

37.麦克风:采集环境内的所有声源信号;

38.毫米波雷达:包括收发天线、ad转换器、滤波器、信号放大器、混频器、功率分配器和信号发生器;毫米波雷达获取天线辐射范围内目标雷达声音信号,并将雷达声音信号传输至融合处理模块,进行目标声源的分离;

39.融合处理模块:根据麦克风采集到环境内的所有声源信号,以及毫米波雷达获取雷达声音信号,对信号进行预处理,并将其通过神经网络对两者信号进行融合,并对目标声源进行增强和分离,获得高保真的单一目标声源信号。

40.与现有技术相比,本发明具有如下的有益效果:

41.1、本发明通过引入毫米波雷达进行融合的声音采集,提供一种毫米波雷达与麦克风融合的声学传感方法与系统,通过毫米波雷达声源体振动感知获取目标声源的参考声信号,并基于深度学习网络融合麦克风和毫米波雷达的声信号,解决了单麦克风多声源混叠、麦克风阵列在声源定位上缺少距离分辨率和指向性差的局限性,同时解决了毫米波雷达声音信号采集难以保持高保真的难题,从而实现复杂声学环境可靠和高保真的目标声信号采集,能够有效抑制噪声干扰以及其他声源的干扰;

42.2、本发明通过引入深度学习框架,构建麦克风和雷达的特征融合网络,实现了毫米波雷达与麦克风融合的声学传感方法,相较于视觉-听觉融合的声学感知方法,该方法不受光照条件的影响,可以实现全天时全天候的声学感知,并且无隐私泄露风险;

43.3、本发明通过对采集的声音信号进行分帧处理,结合深度学习网络框架,提高了信号处理的实时性,解决了语音处理延迟高的难点,使得系统实现了实时处理;

44.4、本发明通过信息增强的方法,对语音信号的实部谱和虚部谱分别进行提取和恢复,增强了网络训练模型的准确性和可靠性,同时解决了恢复声信号相位估计不准确的难点,提高了恢复信号的质量;

45.5、本发明通过添加网络激活函数(目标语音活动检测),提高了信号分离的效率和质量。

附图说明

46.通过阅读参照以下附图对非限制性实施例所作的详细描述,本发明的其它特征、目的和优点将会变得更明显:

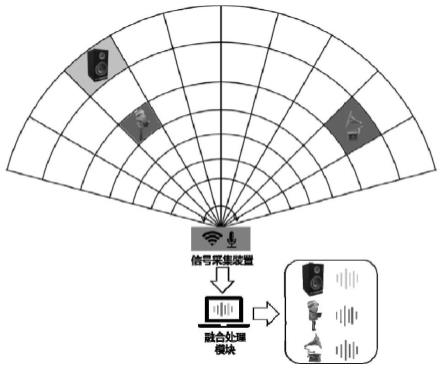

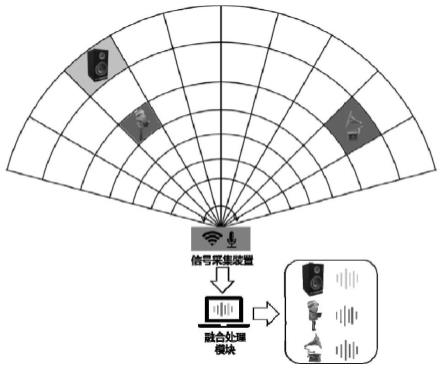

47.图1为本发明的系统结构示意图;

48.图2为本发明实施例的网络模型图;

49.图3为本发明实施例用于声音融合的编码解码网络结构示意图;

50.图4为本发明实施例融合恢复声音信号的时频表示实验结果对比图。

具体实施方式

51.下面结合具体实施例对本发明进行详细说明。以下实施例将有助于本领域的技术人员进一步理解本发明,但不以任何形式限制本发明。应当指出的是,对本领域的普通技术人员来说,在不脱离本发明构思的前提下,还可以做出若干变化和改进。这些都属于本发明的保护范围。

52.实施例1:

53.根据本发明提供的一种毫米波雷达与麦克风融合的声学传感方法,方法包括如下步骤:

54.步骤s1:利用毫米波雷达对目标声源进行探测,并根据回波信号估计目标声源的振动信息x(t),并从中提取目标声源的雷达声音信号;利用毫米波雷达和麦克风获取目标声源的雷达声音信号以及混合声音信号;

55.获取振动信息x(t)的具体方法为:

56.步骤s1.1:使用毫米波雷达发射并接收信号,并获取基带信号的干涉相位演变信息

57.步骤s1.2:根据基带信号的相位信息计算出目标处的振动信息:其中λ为载波波长。

58.步骤s2:对目标声源的雷达声音信号以及麦克风采集到的混合声音信号进行预处理;将目标声源的雷达声音信号和麦克风采集到的混合声音信号进行分帧处理,并对信号进行信息增强;将目标声源的雷达声音信号和麦克风采集到的混合声音信号进行分帧处理,并对信号进行信息增强;

59.其具体方法如下:

60.步骤s2.1:将采集到的雷达声音信号以及混合声音信号进行分帧;

61.步骤s2.2:对分帧后的每一帧信号做频谱分析,并分别获取麦克风信号和雷达声音信号的实部谱和虚部谱。

62.步骤s3:对雷达声音信号进行分析,利用模拟雷达声音信号或者真实实测雷达声音信号构建训练数据集;设计网络模型,对神经网络模型进行训练;

63.步骤s3.1:对雷达声音信号进行分析,包括但不仅限于根据真实声音信号对其进行模拟并获取雷达声音信号数据,或者使用实测的方法获取雷达声音信号数据;

64.步骤s3.2:设计网络模型,网络模型包含一个模型激活函数和用于声音融合的编解码器结构;模型激活函数根据雷达声音信号的能量判断当前时刻目标说话人的状态;若当前时刻目标说话人正在说话,则激活用于分离的编解码器结构;反之,则不激活该结构,而使用零掩码;

65.步骤s3.3:使用数据对该模型进行训练,获取较为优秀的训练模型。

66.步骤s4:将信息增强后的信号输入训练好的神经网络中,获取输出数据。

67.步骤s5:对神经网络输出的数据进行恢复,获取需要提取的目标声音信号;根据恢复后的实数谱和虚数谱进行融合,获取需要提取的分离后的真实信号的时域信息;

68.融合的具体方法:

69.步骤s5.1:将神经网络恢复后得到的实数谱和虚数谱进行融合,得到恢复目标信

号的复数谱;

70.步骤s5.2:对恢复信号的复数谱进行包括但不仅限于逆短时傅里叶变换在内的恢复方法,获取目标信号的时域信息。

71.本发明还提供一种毫米波雷达与麦克风融合的声学传感系统,系统应用于上述中的毫米波雷达与麦克风融合的声学传感方法,系统包括信号采集装置和融合处理模块;信号采集装置包括麦克风和毫米波雷达;

72.麦克风:采集环境内的所有声源信号;

73.毫米波雷达:包括收发天线、ad转换器、滤波器、信号放大器、混频器、功率分配器和信号发生器;毫米波雷达获取天线辐射范围内目标雷达声音信号,并将雷达声音信号传输至融合处理模块,进行目标声源的分离;

74.融合处理模块:根据麦克风采集到环境内的所有声源信号,以及毫米波雷达获取雷达声音信号,对信号进行预处理,并将其通过神经网络对两者信号进行融合,并对目标声源进行增强和分离,获得高保真的单一目标声源信号。

75.实施例2:

76.实施例2为实施例1的优选例,以更为具体地对本发明进行说明。

77.本发明提供一种基于毫米波雷达与麦克风融合的声学传感方法,包括:目标声源振动信号的提取、信号预处理、语音增强分离和信号恢复。

78.其具体的方法流程包括:

79.步骤1:利用毫米波雷达对目标声源进行探测,并根据回波信号估计目标声源的振动信息x(t),并从中提取目标声源的雷达声音信号;

80.获取振动信息x(t)的具体方法为:

81.步骤1.1:使用毫米波雷达(连续波多普勒雷达或调频连续波雷达)发射并接收信号,并获取基带信号的干涉相位演变信息

82.步骤1.2:根据基带信号的相位信息计算出目标处的振动位移信息:其中λ为载波波长。

83.提取目标声源的雷达声音信号的具体方法为:

84.步骤1.3:使用将目标声源的振动位移信息通过低通滤波器,以消除声源的低频抖动,进而获取的雷达声音信号。

85.步骤2:对目标声源的雷达声音信号以及麦克风采集到的混合声音信号进行预处理。将目标声源的雷达声音信号和麦克风采集到的混合声音信号进行分帧处理,并对其进行信息增强。

86.其具体方法如下:

87.步骤2.1:将采集到的雷达声音信号和麦克风混合声音信号进行分帧。

88.步骤2.2:对分帧后的每一帧信号做频谱分析,分别获取雷达声音信号和麦克风混合声音信号的实部谱和虚部谱。

89.步骤3:对雷达声音信号进行分析,利用大量模拟雷达声音信号或者真实实测雷达声音信号构建大量雷达声音信号训练数据集,然后设计网络模型,对神经网络模型进行训练。

90.步骤3.1:对雷达声音信号进行分析,包括但不仅限于根据真实信号模拟其雷达声音信号来获取大量雷达声音信号数据(例如使用低通滤波器或者机器学习的方式),也可使用实测的方法获取大量雷达声音数据。

91.步骤3.2:设计网络模型,网络模型如图2所示,该模型包含一个模型激活函数和用于声音融合的编解码器结构。用于声音融合的编码解码网络结构如图3所示。其中模型激活函数主要作用是根据雷达声音信号的能量来判断当前时刻目标说话人的状态。若当前时刻目标说话人正在说话,则激活用于分离的编解码器结构。反之,则不激活该结构,而使用零掩码。这样一方面可以提高模型分离的效果,另一方面可以提高模型的运行速度,提高模型的实时性,即通过添加用于声音融合的编解码网络结构的网络激活函数(目标语音活动检测),提高了信号分离的效率和质量。

92.步骤3.3:使用大量数据对该模型进行训练,获取较为优秀的训练模型。

93.步骤4:将信息增强后的信号输入训练好的神经网络当中,获取输出数据。将待分离麦克风信号和雷达声音信号的实数谱和虚数谱分别输入神经网络中,获取训练后的实数谱和虚数谱。

94.步骤5:对神经网络输出的数据进行恢复,获取需要提取的目标信号。根据恢复后的实数谱和虚数谱进行融合,获取需要提取的分离后的真实信号的时域信息,语音信号恢复前后的对比实验结果,如图4所示,其中混合时频图为麦克风采集到的混合声音信号(包含目标声源和干扰噪声)的时频图,目标信号时频图为用于测试的干净目标信号时频图,雷达信号时频图为雷达采集到的雷达声音信号的时频图,恢复信号时频图为使用本方法后输出的信号时频图。

95.融合的具体方法:

96.步骤5.1:将神经网络恢复后得到的实数谱和虚数谱进行融合,得到恢复目标信号的复数谱。

97.步骤5.2:对恢复信号的复数谱进行包括但不仅限于逆短时傅里叶变换在内的恢复方法,获取目标信号的时域信息。

98.需要指出的是,本发明通过信息增强的方法,对语音信号的实部谱和虚部谱分别进行提取和恢复,增强了网络训练模型的准确性和可靠性,同时解决了恢复声信号相位估计不准确的难点,提高了恢复信号的质量;

99.通过上述步骤的处理,本发明通过引入毫米波雷达进行融合的声音采集,解决了单麦克风多声源混叠、麦克风阵列在声源定位上缺少距离分辨率和指向性差的局限性,同时解决了毫米波雷达声音信号采集难以保持高保真的难题,从而实现复杂声学环境可靠和高保真的目标声信号采集,能够有效抑制噪声干扰以及其他声源的干扰。

100.基于毫米波雷达与麦克风融合的声学传感系统,包括:信号采集装置和融合处理模块。其中信号采集装置包括麦克风和毫米波雷达。该系统如图1所示。

101.麦克风:用于采集环境内的所有声源信号。

102.毫米波雷达:毫米波雷达包括:收发天线、ad转换器、滤波器、信号放大器、混频器、功率分配器、信号发生器。主要用于获取天线辐射范围内目标雷达声音信号,并将该信息传输至融合处理模块,进行目标声源的分离。

103.融合处理模块:根据麦克风采集到环境内的所有声源信号,以及毫米波雷达获取

到的目标雷达声音信号,对信号进行预处理,并将其通过神经网络对两者信号进行融合,并对目标声源进行增强和分离。

104.本领域技术人员可以将本实施例理解为实施例1的更为具体的说明。

105.本领域技术人员知道,除了以纯计算机可读程序代码方式实现本发明提供的系统及其各个装置、模块、单元以外,完全可以通过将方法步骤进行逻辑编程来使得本发明提供的系统及其各个装置、模块、单元以逻辑门、开关、专用集成电路、可编程逻辑控制器以及嵌入式微控制器等的形式来实现相同功能。所以,本发明提供的系统及其各项装置、模块、单元可以被认为是一种硬件部件,而对其内包括的用于实现各种功能的装置、模块、单元也可以视为硬件部件内的结构;也可以将用于实现各种功能的装置、模块、单元视为既可以是实现方法的软件模块又可以是硬件部件内的结构。

106.以上对本发明的具体实施例进行了描述。需要理解的是,本发明并不局限于上述特定实施方式,本领域技术人员可以在权利要求的范围内做出各种变化或修改,这并不影响本发明的实质内容。在不冲突的情况下,本技术的实施例和实施例中的特征可以任意相互组合。