一种基于数字孪生的无人驾驶运动规划方法

1.本发明属于无人驾驶技术领域,更具体地,涉及一种基于数字孪生的无人驾驶运动规划方法。

背景技术:

2.无人驾驶汽车,主要依靠无人驾驶系统实现自动驾驶的目的,即是通过车载传感系统感知道路环境,自动规划行车路线并控制车辆到达预定目标的智能汽车。近几年来,大量投资者及互联网从业者涌入智能汽车领域,带动无人驾驶技术的井喷式发展,使得完全的无人驾驶在可预见的将来能够实现。

3.由于汽车行驶速度较快,若无人驾驶系统路线规划不合理,会对车内乘员、车外人员或环境造成重大的伤害,因此无人驾驶系统的安全性、可靠性必须达到相关要求,才允许量产上路。目前的无人驾驶系统必须在相应的物理场景中训练和测试运动规划等决策算法,这样的成本较高、周期较长、且不够全面,不利于无人驾驶技术的快速发展。

4.为解决上述技术问题,中国专利cn110716558a公开了一种基于数字孪生技术的非公开道路用自动驾驶系统,但是其应用于非公开道路的自动驾驶系统,而对于公开道路,驾驶环境更为复杂,紧急场景或突发场景多,因此潜在的危险更多,对无人驾驶系统的可靠性安全要求更高,因此其不适用于公开道路的无人驾驶系统。

技术实现要素:

5.本发明为克服上述现有技术中的至少一个缺陷,提供一种基于数字孪生的无人驾驶运动规划方法,其能够应对突发的紧急事件,提高无人驾驶车辆应对紧急驾驶场景的反应速度,提高无人驾驶的安全性、可靠性,且其适用于开放公开的道路。

6.为解决上述技术问题,本发明采用的技术方案是:

7.提供一种基于数字孪生的无人驾驶运动规划方法,其特征在于,包括:获取车辆周围的环境数据及车身姿态数据;

8.根据环境数据及车身姿态数据构建数字孪生驾驶场景;

9.生成多种紧急事件模拟驾驶场景,并分别对多种紧急事件模拟驾驶场景进行规划得到多个分别对应的规划结果;

10.将数字孪生驾驶场景与多种紧急事件模拟驾驶场景进行实时匹配,得到匹配紧急事件模拟驾驶场景;

11.将匹配紧急事件模拟驾驶场景对应的规划结果传送到车辆。

12.本方案中通过预先生成多种紧急事件模拟驾驶场景,且对多种紧急事件模拟驾驶场景均作出运动规划,得到相应的规划结果,在进行无人驾驶运动规划时,将车辆的数字孪生驾驶场景与多种紧急事件模拟驾驶场景进行匹配,若匹配成功,则表示车辆处于紧急驾驶场景中,需要做出紧急规划,则将已经计算好的相应的规划结果同步到车辆即可,这样省去了在判别为紧急场景后再进行规划的过程,大大缩短了紧急驾驶场景的规划时间,提高

了无人驾驶车辆的反应灵敏度以及安全性、可靠性。

13.优选地,上述的环境数据包括车辆前方的rgb序列图像数据、车辆周围环境的点云图像数据、车辆周围的高精度地图数据,车身姿态数据包括车辆速度、车辆加速度、车辆坐标、车辆航向角。

14.优选地,上述的采用rtk

‑

slam(载波相位差分

‑

即时定位与地图构建技术)获取车辆绝对坐标,接收rtk(载波相位差分技术)基准站播发的网络差分数据、接收cors(城市连续运行参考站系统)差分数据、接收车辆位置的差分数据;使用cors模式进行定位,得到局部的高精度地图。

15.优选地,上述的构建数字孪生驾驶场景具体为:

16.对rgb序列图像数据进行检测得到交通信号信息,并根据交通信号信息提取可行路径;

17.对点云图像数据进行检测得到障碍物速度、障碍物航向角、障碍物位置;根据障碍物位置得到障碍物图像;

18.将车辆坐标映射为车身位置图像;

19.将可行路径、障碍物位置图像、车身位置图像融合得到多语义通道图像;

20.将车辆姿态数据、多语义通道图像、障碍物速度及障碍物航向角拼接形成数字孪生驾驶场景。

21.优选地,上述的提取可行路径具体包括:

22.利用yolo(you only look once)v3网络的对rgb序列图像进行目标检测得到交通标志与信号灯;

23.使用非极大值法抑制重叠检测;

24.对检测到的交通标志与信号灯分类,得到交通信号信息;

25.以车辆坐标为中心提取局部高精度地图,进行车道线提取和拼接,构建局部路网图;

26.利用交通信号信息在路网图中提取车辆当前的可行路径。

27.优选地,上述的对点云图像数据进行检测得到障碍物速度、障碍物航向角、障碍物位置过程为:

28.将点云图像在二维透射图像空间中映射;

29.在二维透视图像空间的一次回归结构基础上,对点云图像进行扩展,生成三维障碍物对应的立体框。

30.优选地,上述的生成多种紧急事件模拟驾驶场景具体包括:

31.采集多种紧急事件的数字驾驶场景构建训练数据集,将不同紧急事件的数字驾驶场景编码为特征矢量,作为不同紧急事件的条件,并对多种紧急事件的数字驾驶场景设置参数及分类,得到样本库;

32.定义多个高斯分布,并对服从高斯分布的隐矢量进行随机采样,得到相应的表达矢量;

33.根据表达矢量及条件,生成不同种类的虚拟紧急场景;

34.根据样本库对不同种类的紧急事件模拟数字驾驶场景进行对抗训练,最终得到多个紧急事件模拟驾驶场景。

35.优选地,上述的多种紧急事件的数字驾驶场景包括紧急刹车、紧急变道、行人冲入机动车道、行人闯红灯。

36.优选地,上述的分别对多种紧急事件模拟驾驶场景进行规划得到多个分别对应的规划结果具体包括:

37.提取数字孪生驾驶场景的时空信息以及车身姿态数据,利用深度确定性策略梯度算法训练运动规划模型,得到ddpg模型;

38.将多种紧急事件数字驾驶场景输入ddpg模型,得到相应的规划结果。

39.优选地,上述的规划结果包括车辆的转向角、油门或电门开度、制动力矩。

40.还提供一种用于实现基于数字孪生的无人驾驶运动规划方法的系统,包括无人驾驶车辆终端、处理终端、通信模块;无人驾驶车辆终端设置有环境数据获取模块与车身姿态数据获取模块,处理终端设置有通信连接的环境感知单元、场景构建单元、运动规划单元;无人驾驶终端与处理终端通过通信模块通信连接;

41.车辆周围环境数据获取模块用于获取无人驾驶车辆终端周围的环境数据并传送到环境感知计算单元;

42.车身姿态数据获取模块用于获取无人驾驶车辆终端的车身姿态数据并传送到场景构建单元;

43.环境感知单元用于根据环境数据得到无人驾驶车辆终端周围的环境信息并传送到场景构建单元;

44.场景构建单元用于根据接收到的环境信息及车身姿态数据融合构建得到数字孪生驾驶场景;

45.运动规划单元用于生成多种紧急事件模拟驾驶场景,并得到多个分别对应的规划结果,将与数字孪生驾驶场景匹配的紧急事件模拟驾驶场景对应的规划结果传送到无人驾驶车辆终端。

46.与现有技术相比,有益效果是:

47.本方案中通过预先生成多种紧急事件模拟驾驶场景,且对多种紧急事件模拟驾驶场景均作出运动规划,得到相应的规划结果,在进行无人驾驶运动规划时,将车辆的数字孪生驾驶场景与多种紧急事件模拟驾驶场景进行匹配,若匹配成功,则表示车辆处于紧急驾驶场景中,需要做出紧急规划,则将已经计算好的相应的规划结果同步到车辆即可,这样省去了在判别为紧急场景后再进行规划的过程,大大缩短了紧急驾驶场景的规划时间,提高了无人驾驶车辆的反应灵敏度以及安全性、可靠性;并且,由于加入了对紧急事件的运动规划,使得无人驾驶系统能够应对开放道路的各种不确定性因素。

附图说明

48.图1是本发明基于数字孪生的无人驾驶运动规划方法的流程示意框图;

49.图2是本发明基于数字孪生的无人驾驶运动规划方法的数字孪生驾驶场景构建过程框图;

50.图3是本发明基于数字孪生的无人驾驶运动规划方法的紧急事件模拟驾驶场景生成过程框图;

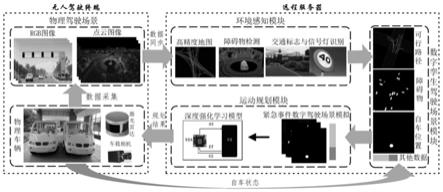

51.图4是实现本发明基于数字孪生的无人驾驶运动规划方法的系统方框示意图。

具体实施方式

52.附图仅用于示例性说明,不能理解为对本发明的限制;为了更好说明本实施例,附图某些部件会有省略、放大或缩小,并不代表实际产品的尺寸;对于本领域技术人员来说,附图中某些公知结构及其说明可能省略是可以理解的。附图中描述位置关系仅用于示例性说明,不能理解为对本发明的限制。

53.本发明实施例的附图中相同或相似的标号对应相同或相似的部件;在本发明的描述中,需要理解的是,若有术语“上”、“下”、“左”、“右”“长”“短”等指示的方位或位置关系为基于附图所示的方位或位置关系,仅是为了便于描述本发明和简化描述,而不是指示或暗示所指的装置或元件必须具有特定的方位、以特定的方位构造和操作,因此附图中描述位置关系的用语仅用于示例性说明,不能理解为对本专利的限制,对于本领域的普通技术人员而言,可以根据具体情况理解上述术语的具体含义。

54.下面通过具体实施例,并结合附图,对本发明的技术方案作进一步的具体描述:

55.实施例:

56.如图1至图3所示为一种基于数字孪生的无人驾驶运动规划的方法的实施例,包括:

57.获取车辆周围的环境数据及车身姿态数据;

58.根据所述环境数据及车身姿态数据构建数字孪生驾驶场景;

59.生成多种紧急事件模拟驾驶场景,并分别对所述多种紧急事件模拟驾驶场景进行规划得到多个分别对应的规划结果;

60.将所述数字孪生驾驶场景与所述多种紧急事件模拟驾驶场景进行实时匹配,得到匹配紧急事件模拟驾驶场景;

61.将所述匹配紧急事件模拟驾驶场景对应的规划结果传送到车辆。

62.本实施例中的环境数据包括车辆前方的rgb序列图像数据、车辆周围环境的点云图像数据、车辆周围的高精度地图数据,车身姿态数据包括车辆速度、车辆加速度、车辆坐标、车辆航向角。

63.其中,rgb序列图像数据可通过车载彩色摄像机采集,摄像机的参数优选为分辨率为200万像素,视频采样频率为60hz,焦距为50mm。

64.另外,点云图像数据可通过激光雷达采集,激光雷达的参数优选为16线中距离激光雷达,波长为900nm,垂直分辨率为2

°

,水平分辨率为0.2

°

,扫描频率为10hz。

65.本实施例中的采用rtk

‑

slam(载波相位差分

‑

即时定位与地图构建技术)获取车辆绝对坐标,接收rtk(载波相位差分技术)基准站播发的网络差分数据、接收cors(城市连续运行参考站系统)差分数据、接收车辆位置的差分数据;使用cors模式进行定位,得到局部的高精度地图。

66.如图2所示,本实施例中的构建数字孪生驾驶场景具体为:

67.对rgb序列图像数据进行检测得到交通信号信息,并根据交通信号信息提取可行路径;

68.对点云图像数据进行检测得到障碍物速度、障碍物航向角、障碍物位置,其中障碍物速度、障碍物航向角用一维矢量表示;其中,障碍物包括机动车、非机动车、行人、路面设施等;

69.将障碍物位置进行防射变换和二值化,并映射为背景为黑色的二值图像,障碍物为表示为白色矩阵,即可得到障碍物图像;

70.通过gps(全球卫星定位系统)和rtk矫正车辆坐标,并将车辆坐标位置映射到黑色背景的图像中,采用白色实心圆表示车辆,即可得到车身位置图像;

71.将可行路径、障碍物位置图像、车身位置图像各自作为独立的通道,融合得到多语义通道图像;其中,多语义通道图像与车辆实时物理驾驶场景同步;

72.将车辆姿态数据、多语义通道图像、障碍物速度及障碍物航向角拼接形成数字孪生驾驶场景,其中数字孪生驾驶场景与车辆物理驾驶场景同步。

73.本实施例中的提取可行路径具体包括:

74.利用yolo(you only look once)v3网络的对rgb序列图像进行目标检测得到交通标志与信号灯;

75.使用非极大值法抑制重叠检测;

76.对检测到的交通标志与信号灯分类,得到交通信号信息;

77.以车辆坐标为中心提取局部高精度地图,进行车道线提取和拼接,构建局部路网图;其中,局部路网图为二值图像,背景为黑色,车道线为白色;

78.利用交通信号信息在路网图中提取车辆当前的可行路径。

79.本实施例中的对点云图像数据进行检测得到障碍物速度、障碍物航向角、障碍物位置过程为:

80.将点云图像在二维透射图像空间中映射;

81.在二维透视图像空间的一次回归结构基础上,对点云图像进行扩展,生成三维障碍物对应的立体框。

82.如图3所示,本实施例中的生成多种紧急事件模拟驾驶场景具体包括:

83.采集多种紧急事件的数字驾驶场景构建训练数据集,将不同紧急事件的数字驾驶场景编码为特征矢量,作为不同紧急事件的条件,并对多种紧急事件的数字驾驶场景设置参数及分类,得到样本库;

84.定义多个高斯分布,并对服从高斯分布的隐矢量进行随机采样,得到相应的表达矢量;

85.根据表达矢量及条件,生成不同种类的虚拟紧急场景;

86.根据样本库对不同种类的紧急事件模拟数字驾驶场景进行对抗训练,最终得到多个紧急事件模拟驾驶场景。

87.具体地,本实施例中基于改进的条件生成对抗网络构建模拟器,其中模拟器包括编码器、生成器、分类器、判别器实现紧急事件模拟驾驶场景的生成与训练;其中,编码器用于对驾驶场景进行编码和降维,生成器用于生成多种紧急事件模拟驾驶场景,判别器用于判断数字驾驶场景属于训练数据集或由生成器生成。在样本库中利用判别器、生成器、分类器进行对抗学习,生成器接受隐矢量,并对隐矢量进行参数学习,得到一个驾驶场景,尽可能生成接近样本库的驾驶场景,将此驾驶场景与在样本库中的驾驶场景进行比较,判别器判断两者是样本库中的驾驶场景还是生成器中的场景,通过学习不断提高自身判别能力,尽可能将生成器生成的驾驶场景识别出来;同时分类器对不同类别的驾驶场景进行分类,以不断提高自身分类能力,尽可能将生成器生成的驾驶场景分类正确。最终使得生成器、判

别器、分类器达到平衡状态,可以生成最大限度接近真实场景的紧急事件模拟驾驶场景。

88.本实施例中的多种紧急事件的数字驾驶场景包括紧急刹车、紧急变道、行人冲入机动车道、行人闯红灯等,当然这不能理解为对本方案的限定,在具体实施过程中,可根据需要生成其他类型的紧急事件的数字驾驶场景。

89.本实施例中的分别对多种紧急事件模拟驾驶场景进行规划得到多个分别对应的规划结果具体包括:

90.提取数字孪生驾驶场景的时空信息以及车身姿态数据,利用深度确定性策略梯度算法训练运动规划模型,得到ddpg模型;

91.将多种紧急事件数字驾驶场景输入ddpg模型,得到相应的规划结果。

92.本实施例中的规划结果包括车辆的转向角、油门或电门开度、制动力矩。将规划结果同步到车辆后,即可控制车辆做出相应的动作,以做紧急规避。

93.如图4所示,本实施例还提供一种用于实现上述基于数字孪生的无人驾驶运动规划方法的系统,包括无人驾驶车辆终端、处理终端、通信模块;无人驾驶车辆终端设置有环境数据获取模块与车身姿态数据获取模块,处理终端设置有通信连接的环境感知单元、场景构建单元、运动规划单元;无人驾驶终端与处理终端通过通信模块通信连接;

94.车辆周围环境数据获取模块用于获取无人驾驶车辆终端周围的环境数据并传送到环境感知计算单元;

95.车身姿态数据获取模块用于获取无人驾驶车辆终端的车身姿态数据并传送到场景构建单元;

96.环境感知单元用于根据环境数据得到无人驾驶车辆终端周围的环境信息并传送到场景构建单元;

97.场景构建单元用于根据接收到的环境信息及车身姿态数据融合构建得到数字孪生驾驶场景;

98.运动规划单元用于生成多种紧急事件模拟驾驶场景,并得到多个分别对应的规划结果,将与数字孪生驾驶场景匹配的紧急事件模拟驾驶场景对应的规划结果传送到无人驾驶车辆终端。

99.本实施例中的环境信息获取模块包括激光雷达、摄像机;激光雷达用于获取无人驾驶车辆终端周围的点云图像数据,其参数优选为16线中距离激光雷达,波长为900nm,垂直分辨率为2

°

,水平分辨率为0.2

°

,扫描频率为10hz;摄像机用于获取无人驾驶车辆终端周围的rgb序列图像数据,其参数优选为200万像素,视频采样频率为60hz,焦距为50mm。

100.本实施例中的车身姿态数据获取模块包括用于获取无人驾驶车辆终端坐标和高精度地图的gps单元、用于获取无人驾驶车辆终端加速度及航向角的imu单元、用于获取无人驾驶车辆终端速度的速度传感器。

101.本实施例中的处理终端为云服务平台,通信模块为采用5g通信技术的无线高速通信模块,此时无人驾驶车辆终端上设置有ecu(电子控制单元),云服务平台通过通信模块与无人驾驶车辆终端上的ecu进行无线高速通信,以对接收到的数据进行相应的处理计算,并得到规划结果并传送到ecu中。需要说明的是,本实施例中采用云服务平台与5g无线高速通信模块均为参考的实施方式,不能理解为对本方案的限定,无线高速通信模块当然也可以采用6g等新一代的无线通信技术;或者通信模块为有线通信模块,此时,处理终端可为集成

在无人驾驶车辆终端ecu上的芯片,这样同样可以实现本方案的功能。

102.本实施例中运动规划单元包括模拟器和规划器,模拟器用于生成多种紧急事件模拟驾驶场景,规划器用于根据紧急事件模拟驾驶场景生成相应的规划结果。

103.本实施例中通过预先生成多种紧急事件模拟驾驶场景,且对多种紧急事件模拟驾驶场景均作出运动规划,得到相应的规划结果,在进行无人驾驶运动规划时,将车辆的数字孪生驾驶场景与多种紧急事件模拟驾驶场景进行匹配,若匹配成功,则表示车辆处于紧急驾驶场景中,需要做出紧急规划,则将已经计算好的相应的规划结果同步到车辆即可,这样省去了在判别为紧急场景后再进行规划的过程,大大缩短了紧急驾驶场景的规划时间,提高了无人驾驶车辆的反应灵敏度以及安全性、可靠性;并且,由于加入了对紧急事件的运动规划,使得无人驾驶系统能够应对开放道路的各种不确定性因素,使其能够面对开放道路中不确定的驾驶环境因素。

104.本发明是参照本技术实施例的方法、设备(系统)、和计算机程序产品的流程图或方框图来描述的,应理解可由计算机程序指令实现流程图或方框图中的每一流程或方框、以及流程图或方框图中的流程或方框的结合。可提供这些计算机程序指令到通用计算机、专用计算机、嵌入式处理机或其他可编程数据处理设备的处理器以产生一个机器,使得通过计算机或其他可编程数据处理设备的处理器执行的指令产生用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的装置。

105.尽管上面已经示出和描述了本发明的实施例,可以理解的是,上述实施例是示例性的,不能理解为对本发明的限制,本领域的普通技术人员在本发明的范围内可以对上述实施例进行变化、修改、替换和变型。

106.显然,本发明的上述实施例仅仅是为清楚地说明本发明所作的举例,而并非是对本发明的实施方式的限定。对于所属领域的普通技术人员来说,在上述说明的基础上还可以做出其它不同形式的变化或变动。这里无需也无法对所有的实施方式予以穷举。凡在本发明的精神和原则之内所作的任何修改、等同替换和改进等,均应包含在本发明权利要求的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1