一种用于推荐系统的解离化异构图注意力的方法及系统

1.本技术涉及推荐系统领域,具体而言,涉及一种用于推荐系统的解离化异构图注意力的方法及系统。

背景技术:

2.推荐系统为提供个性化的用户服务带来了巨大帮助,它可以有效帮助用户从海量的选择中发觉自己感兴趣的商品。过去,已有方法曾大规模采用基于协同过滤的推荐模型(例如矩阵分解),这类模型假设已经出现了相似选择的用户倾向于在未来也有相似的偏好。但是这类算法面临两个难题:用户商品交互记录的稀疏性和“冷启动”问题。针对这两个问题,很多模型都尝试将交互记录转化成富含特征的用户、商品数据条目,从而融入其它上下文信息,然后将这些数据用于监督学习,进而预测某个用户在某个商品上的关联分数。然而,这些模型总是将每条用户商品的交互记录视为一个孤立的数据条目,忽略了不同交互数据条目之间的联系。

3.异构信息网络是一类含有多种类型的节点和/或边的网络,它能够利用丰富的上下文信息对用户-商品交互数据中蕴含的异质性和复杂性进行建模。特别地,异构信息网络上的元路径——种组合关系连通节点对,在捕获两个节点之间的关联语义信息时十分常用。最近的一些使用异构信息网络来实现推荐系统的工作将用户、商品和上下文实体表征为不同类型的节点。这些工作可以分为两大类,第一类借助元路径或融合领域知识的嵌入表示来编码用户和商品的关联度,并将此关联度用于加强推荐系统的表现,如shi等人在用户、商品构成的异构信息网络中通过元路径计算用户节点间的相似度,通过其他相似用户对目标商品的偏好来推断目标用户的偏好;与之相对,第二类则直接使用图神经网络聚合邻居信息,借助图神经网络强大的表示能力来获得更好的用户和商品的表征,如wang等人通过在用户、商品构建的异构信息网络中使用图神经网络获得用户、商品表征用于推荐。

4.然而,现有技术中异构信息网络存在如下缺点:

5.第一,上述工作中的绝大部分都没能将隐含因素解离开来。如推荐系统中,“电子产品”的特点由几个方面导出。由于不同类型的边反映的是同一个节点不同方面的特征,因此学习解离化的特征比保留各种因素的相互作用更自然也更适合于异构信息网络。

6.第二,前述工作直接将元路径简化为边信息或连通路径,忽略了每个因素单独的作用。事实上,不同的语义关系对于对应的解离化的特征是有明确影响的。例如,用户的购买行为表明这件商品在某些人群中很受欢迎;这件商品是笔记本电脑,适合办公室人群;它的品牌是苹果因此被苹果的粉丝所喜爱,这些关系分别对商品的购买情况、种类、品牌等方面产生影响。

7.第三,以上两个缺点的存在使得上述推荐系统申请无法获得高鲁棒性及可解释性,也就是说,它们不能显式地建模用户在特定类型商品上的偏好。因此,我们认为包含解离化特征的异构信息网络更适用于构建推荐系统。具体来说,用户和商品的表示都可以被解离为相同数目的多个方面表示。通过计算目标用户和商品在不同方面的匹配分数,我们

可以显式地获得用户在具有特定特征的商品上的偏好模型。

技术实现要素:

8.本技术的主要目的在于提供一种用于推荐系统的解离化异构图注意力的方法以至少部分解决现有技术中存在的上述问题。所述一种用于推荐系统的解离化异构图注意力的方法,包括:

9.s2:构建异构信息网络;

10.s4:解离所述异构信息网络中的目标节点和所述目标节点的直接邻居点的特征并转化,获取转化特征;

11.s6:关系内聚合所述转化特征,并获取第一聚合结果;

12.s8:关系间聚合所述转化特征,并获取第二聚合结果;

13.s10:根据所述第一聚合结果及所述第二聚合结果推荐最终结果。

14.可选地,构建异构信息网络包括:

15.s21:给定用户集合商品集合及用户-商品交互矩阵y∈y

m*n

;

16.s22:通过将用户,商品抽象为节点,其交互抽象为边,首先构造用户-商品二部图;根据用户、商品上下文信息,将其对应上下文考虑为多种类型连边及对应不同类型节点;

17.s23:将所述节点加入所述二部图中构成包含用户、商品及其上下文信息的异构信息网络

18.可选地,解离所述异构信息网络中的目标节点和所述目标节点的直接邻居点的特征并转化,获取转化特征包括:

19.s41:将直接邻居节点s按照和目标节点t的元关系类型进行分组得到同一关系类型直接邻居节点集合n

ψ

(e);

20.s42:投影类型为的目标节点,将其特征投至k个不同子空间上,如下公式所示,

[0021][0022]

其中公式中的矩阵代表对于t所在类别,t的特征向量映射入第k个子空间的权重矩阵,σ代表激活函数,t为网络结构上的目标节点,s为所述目标节点的直接邻居。类似地,直接邻居节点s的特征也投影至k个对应的子空间。

[0023]

可选地,关系内聚合所述转化特征,并获取第一聚合结果包括:

[0024]

s61:对于同一类型邻居s∈n

ψ

(e),根据下面的公式获得s节点对于t节点在元关系ψ(e)下第k个方面的重要程度:

[0025][0026]

其中,是针对元关系ψ(e)的注意力向量,是目标节点

和源节点转化后在第k个方面的特征,||表示连接运算;选择作为初始条件;

[0027]

s62:对各个方面进行加权求和,得到在元关系ψ(e)下节点s对t节点的重要程度,计算公式如下:

[0028][0029]

其中,是第k个方面在元关系ψ(e)的权重,其中最大的权重表示该元关系对应的主要方面,将其全部初始化为并在关系间聚合后循环进行调整;

[0030]

s63:对于t所有同一类型邻居节点s∈n

ψ

(e),通过softmax函数进行标准化,并通过加权聚集该类型邻居节点特征:

[0031][0032][0033]

可选地,关系间聚合所述转化特征,并获取第二聚合结果包括:

[0034]

s81:令r

ψ

(e),k表示元关系ψ(e)由于第k个方面的因素而与节点t相关的可能性,从而其有限制条件r

ψ

(e),k≥0和通过用如下方式获取其关联权重:

[0035][0036]

其中w为权重矩阵,q

ψ

(e)是针对元关系ψ(e)的语义注意力向量,这种关联权重可以进一步通过softmax函数进行标准化:

[0037][0038]

s82:在聚集了所有与目标节点t相关的元关系ψ

t

的邻居节点特征后,迭代搜索各个元关系的主要影响方面,进而获取t的表征表示如下:

[0039][0040]

对于迭代轮数i=1,2,...,i,输出的轮流反馈指导对应元关系下邻居组n

ψ

(e)内的注意力权重,目标节点t通过图神经网络循环聚集更新后的最终节点表征为

[0041]

可选地,根据所述第一聚合结果及所述第二聚合结果推荐最终结果包括:

[0042]

s101:获得关于t的表征向量集{z

u,1

,z

u,2

...,z

u,k

},;

[0043]

s102:再把商品设为一个目标节点,并得到对应的k个方面的嵌入向量集{z

υ,1

,z

υ,2

...,z

υ,k

};

[0044]

s103:对用户商品在每个方面的特征向量对应进行组合,以估计用户对目标商品在不同组合上的偏好程度;

[0045]

s104:分别将用户、商品对应的k个方面嵌入向量集输入至自注意力层,分别得到用户、商品组合后对应的表示集合:

[0046][0047][0048]

ψ(z

u,k

,z

u,m

)=《w

queryzu,k

,w

keyzu,m

》

[0049]

其中,w

quert

,w

key

,w

value

表示用户自注意力层查询、键、值的权重,其将用户在不同方面的信息映射至查询、键、值空间;ψ(.,.)为注意力函数,其计算用户不同方面特征的相似程度,可以通过神经网络或者内积计算;

[0050]

s105:获得商品组合后对应的表示集合;

[0051]

s106:将得到的用户、商品组合后不同方面的表示对应进行内积,来估计用户对目标商品在第k个方面上的偏好程度,再将所有方面偏好相加,作为推荐分数:

[0052][0053]

根据所述分数考虑问题情景的需要,挑选得分最高的一个或几个商品,推荐给用户。

[0054]

根据本技术的另一个方面,还提供了一种用于推荐系统的解离化异构图注意力的系统,包括:

[0055]

构建异构信息网络模块,用于构建异构信息网络;

[0056]

解离特征转化模块,用于解离所述异构信息网络中的目标节点和所述目标节点的直接邻居点的特征并转化,获取转化特征;

[0057]

关系内聚合模块,用于关系内聚合所述转化特征,并获取第一聚合结果;

[0058]

关系间聚合模块,用于关系间聚合所述转化特征,并获取第二聚合结果;

[0059]

推荐模块,用于根据所述第一聚合结果及所述第二聚合结果推荐最终结果。

[0060]

本技术还公开了一种计算机设备,包括存储器、处理器和存储在所述存储器内并能由所述处理器运行的计算机程序,所述处理器执行所述计算机程序时实现上述任一项所述的方法。

[0061]

本技术还公开了一种计算机可读存储介质,非易失性可读存储介质,其内存储有计算机程序,所述计算机程序在由处理器执行时实现上述任一项所述的方法。

[0062]

与现有技术相比,本技术具有如下有益效果:

[0063]

1.本技术提出了一个全新的解离化异构图注意力神经网络用于推荐系统。与以往将相互影响的因素笼统处理的模型不同,本技术显式地对不同层面的因素及其在语义关系下的相应影响进行了建模。具体来说,本技术将带有丰富上下文信息的用户-商品交互数据表示为一个异构信息网络,该网络包含了不同类型的节点及节点对间的对应关系。给定节点特征作为输入,将它们投影到不同的嵌入空间,并提出了一个语义嵌入传播层来识别图神经网络信息信息传播过程中的不同关系语义主要影响节点表示的某一特定方面。

[0064]

2.本技术摒弃了以往手动设计元路径的方式,而是利用节点的单跳关系并使用注意力机制来平滑地产生元路径。通过堆积多个嵌入传播层,每种节点—特别是用户和商品,都将聚集来自各个元路径的嵌入表示,从而捕获更高阶的关联信息。

[0065]

3.本技术提出了异构信息网络上反映不同方面特征的解离化表示。该机制具有泛化到其余异构信息网络应用场景上的潜力。

[0066]

4.本技术提出了一种解离化嵌入传播层,这种结构可以迭代识别节点对间关系影响的主要方面,并将对应信息语义化地传播出去。此外,还通过自动抽取元路径,使得这个模型更加具备了实际应用价值。

[0067]

5.本技术在几个真实数据集上进行了大量实验来评估我们提出的模型。实验结果表明,模型不仅超越了现有的最佳模型,而且对于推荐内容具备很好的可解释性。

附图说明

[0068]

构成本技术的一部分的附图用来提供对本技术的进一步理解,使得本技术的其它特征、目的和有益效果变得更明显。本技术的示意性实施例附图及其说明用于解释本技术,并不构成对本技术的不当限定。在附图中:

[0069]

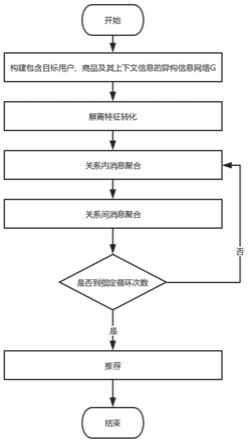

图1是根据本技术一个实施例的用于推荐系统的解离化异构图注意力的方法的流程示意图;

[0070]

图2是根据本技术一个实施例的用于推荐系统的解离化异构图注意力的方法的流程示意图;

[0071]

图3是根据本技术一个实施例的用于推荐系统的解离化异构图注意力的方法的估计用户对目标商品在不同组合上的偏好程度示意图;

[0072]

图4是根据本技术一个实施例的计算机设备的示意图;

[0073]

图5是根据本技术一个实施例的计算机可读存储介质的示意图。

具体实施方式

[0074]

为了使本技术领域的人员更好地理解本技术申请,下面将结合本技术实施例中的附图,对本技术实施例中的技术申请进行清楚、完整地描述,显然,所描述的实施例仅仅是本技术一部分的实施例,而不是全部的实施例。基于本技术中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都应当属于本技术保护的范围。

[0075]

需要说明的是,本技术的说明书和权利要求书及上述附图中的术语“第一”、“第二”等是用于区别类似的对象,而不必用于描述特定的顺序或先后次序。应该理解这样使用的数据在适当情况下可以互换,以便这里描述的本技术的实施例。此外,术语“包括”和“具有”以及他们的任何变形,意图在于覆盖不排他的包含,例如,包含了一系列步骤或单元的过程、方法、系统、产品或设备不必限于清楚地列出的那些步骤或单元,而是可包括没有清楚地列出的或对于这些过程、方法、产品或设备固有的其它步骤或单元。

[0076]

需要说明的是,在不冲突的情况下,本技术中的实施例及实施例中的特征可以相互组合。下面将参考附图并结合实施例来详细说明本技术。

[0077]

请参照图1-图3,本技术一实施例提供了一种用于推荐系统的解离化异构图注意力的方法,包括:

[0078]

s2:构建异构信息网络;

[0079]

s4:解离所述异构信息网络中的目标节点和所述目标节点的直接邻居点的特征并转化,获取转化特征;

[0080]

s6:关系内聚合所述转化特征,并获取第一聚合结果;

[0081]

s8:关系间聚合所述转化特征,并获取第二聚合结果;

[0082]

s10:根据所述第一聚合结果及所述第二聚合结果推荐最终结果。

[0083]

在本技术一实施例中,构建异构信息网络包括:

[0084]

s21:给定用户集合商品集合及用户-商品交互矩阵y∈y

m*n

;

[0085]

s22:通过将用户,商品抽象为节点,其交互抽象为边,首先构造用户-商品二部图;根据用户、商品上下文信息,将其对应上下文考虑为多种类型连边及对应不同类型节点;

[0086]

s23:将所述节点加入所述二部图中构成包含用户、商品及其上下文信息的异构信息网络

[0087]

在本技术一实施例中,解离所述异构信息网络中的目标节点和所述目标节点的直接邻居点的特征并转化,获取转化特征包括:

[0088]

s41:将直接邻居节点s按照和目标节点t的元关系类型进行分组得到同一关系类型直接邻居节点集合n

ψ

(e);

[0089]

s42:投影类型为的目标节点,将其特征投至k个不同子空间上,如下公式所示,

[0090][0091]

其中公式中的矩阵代表对于t所在类别,t的特征向量映射入第κ个子空间的权重矩阵,σ代表激活函数,t为网络结构上的目标节点,s为所述目标节点的直接邻居。类似地,直接邻居节点s的特征也投影至k个对应的子空间。

[0092]

在本技术一实施例中,关系内聚合所述转化特征,并获取第一聚合结果包括:

[0093]

s61:对于同一类型邻居s∈n

ψ

(e),根据下面的公式获得s节点对于t节点在元关系ψ(e)下第k个方面的重要程度:

[0094][0095]

其中,是针对元关系ψ(e)的注意力向量,是目标节点和源节点转化后在第k个方面的特征,||表示连接运算;选择作为初始条件;

[0096]

s62:对各个方面进行加权求和,得到在元关系ψ(e)下节点s对t节点的重要程度,计算公式如下:

[0097][0098]

其中,是第k个方面在元关系ψ(e)的权重,其中最大的权重表示该元关系对应的主要方面,将其全部初始化为并在关系间聚合后循环进行调整;

[0099]

s63:对于t所有同一类型邻居节点s∈n

ψ

(e),通过softmax函数进行标准化,并通过加权聚集该类型邻居节点特征:

[0100][0101][0102]

在本技术一实施例中,关系间聚合所述转化特征,并获取第二聚合结果包括:

[0103]

s81:令r

ψ

(e),k表示元关系ψ(e)由于第k个方面的因素而与节点t相关的可能性,从而其有限制条件r

ψ

(e),k≥0和通过用如下方式获取其关联权重:

[0104][0105]

其中w为权重矩阵,q

ψ

(e)是针对元关系ψ(e)的语义注意力向量,这种关联权重可以进一步通过softmax函数进行标准化:

[0106][0107]

s82:在聚集了所有与目标节点t相关的元关系ψ

t

的邻居节点特征后,迭代搜索各个元关系的主要影响方面,进而获取t的表征表示如下:

[0108]

[0109]

对于迭代轮数i=1,2,...,i,输出的轮流反馈指导对应元关系下邻居组n

ψ

(e)内的注意力权重,目标节点t通过图神经网络循环聚集更新后的最终节点表征为

[0110]

在本技术一实施例中,根据所述第一聚合结果及所述第二聚合结果推荐最终结果包括:

[0111]

s101:获得关于t的表征向量集{z

u,1

,z

u,2

...,z

u,k

},;

[0112]

s102:再把商品设为一个目标节点,并得到对应的k个方面的嵌入向量集{z

υ,1

,z

υ,2

...,z

υ,k

};

[0113]

s103:对用户商品在每个方面的特征向量对应进行组合,以估计用户对目标商品在不同组合上的偏好程度;

[0114]

s104:分别将用户、商品对应的k个方面嵌入向量集输入至自注意力层,分别得到用户、商品组合后对应的表示集合:

[0115][0116][0117]

ψ(z

u,k

,z

u,m

)=《w

queryzu,k

,w

keyzu,m

》

[0118]

其中,w

quert

,w

key

,w

value

表示用户自注意力层查询、键、值的权重,其将用户在不同方面的信息映射至查询、键、值空间;ψ(.,.)为注意力函数,其计算用户不同方面特征的相似程度,可以通过神经网络或者内积计算;

[0119]

s105:获得商品组合后对应的表示集合;

[0120]

s106:将得到的用户、商品组合后不同方面的表示对应进行内积,来估计用户对目标商品在第k个方面上的偏好程度,再将所有方面偏好相加,作为推荐分数:

[0121][0122]

根据所述分数考虑问题情景的需要,挑选得分最高的一个或几个商品,推荐给用户。

[0123]

本技术旨在学习解离化的用户、商品表示,在构建好的用户、商品及上下文在内的异构信息网络中,给定一个目标节点t,我们将它的源邻居s根据元关系进行分组,并把他们的属性投影到不同的子空间从而在不同的方面抽取其特征。随后,对于每个元关系组,我们在每个方面中聚合源邻居的特征,从而捕获特定的语义信息。接着,我们提出的机制迭代识别每种元关系的主要影响方面,并聚合从而更新目标节点t各个方面的特征。我们将这种解离化嵌入传播层第l层的输出记作d

(l)

,它可能被用作第l+1层的输入。在实践中,我们可能堆叠l层这种子结构来抽取多跳邻居节点的信息,为了反映出近邻影响大远邻影响小的特

点,我们规定每一层的子空间数单调递增,即k

(1)

≥k

(2)

≥

…

≥k

(l)

。我们的申请主要包含五步,其中第一至四步模型图如图2所示:

[0124]

第一步:异构信息网络构建

[0125]

给定用户集合商品集合及用户-商品交互矩阵y∈y

m*n

后,通过将用户,商品抽象为节点,其交互抽象为边,首先构造用户-商品二部图。同时,考虑用户、商品上下文信息,将其对应上下文如(用户间朋友关系、商品-品牌关系、商品-门类等)考虑为多种类型连边及对应不同类型节点,将这些关系、节点加入二部图中构成包含用户、商品及其上下文信息的异构信息网络

[0126]

第二步:解离特征转化

[0127]

给定网络结构上的目标节点t和它的直接邻居s,将s按照和t的元关系类型进行分组得到n

ψ

(e)(例如,一个电影t可能与导演a和演员b、c相连,则将a分为一组,b,c分为一组),对于类型为的目标节点,我们用对其进行投影,将其特征投至k个不同子空间上,如公式所示,

[0128][0129]

其中公式中的矩阵实质上代表了对于t所在类别,t的特征向量映射入第k个子空间的权重矩阵,σ代表激活函数。类似地,直接邻居节点s的特征也投影至k个对应的子空间。

[0130]

第三步:关系内聚合

[0131]

经过上述类型特定的解离话特征转化后,对于目标节点,其同一类型的邻居节点在各个方面也扮演着重要性不等的角色,因此我们引入注意力机制来学习不同层面下节点的权重,对于同一类型邻居s∈n

ψ

(e),其在第k个方面(对应第一步中的第k个子空间)的重要性计算如下:

[0132][0133]

其中,是针对元关系ψ(e)的注意力向量,是目标节点和源节点转化后在第k个方面的特征,||表示连接运算。这里我们选择和源节点转化后在第k个方面的特征,||表示连接运算。这里我们选择作为初始条件。通过该公式,可以计算在元关系ψ(e)下s节点对于t节点第k个方面的重要程度。接着,我们对各个方面进行加权求和,得到在元关系ψ(e)下s对t节点的重要程度,计算公式如下:

[0134][0135]

其中,是第k个方面在元关系ψ(e)的权重,其中最大的权重表示该元关系对应的主要方面,我们将其全部初始化为并在关系间聚合后循环进行调整。接

下来,对于t所有同一类型邻居节点s∈n

ψ

(e),我们通过softmax函数进行标准化,并通过加权聚集该类型邻居节点特征:

[0136][0137][0138]

这相当于在第k个方面上利用注意力机制聚合了t的所有同一类型邻居节点的特征,从而聚集生成了该类型邻居对应元关系在方面k上的特征表示。特别要说明的是,对于每一种元关系,其特征表示都是独立生成的,其具有语义特异性,并且能够捕获对应的语义信息。

[0139]

第四步:关系间聚合

[0140]

尽管获得了元关系展露出来的语义信息,但由于每个元关系关注不同方面的特征,我们不能直接融合所有元关系的语义信息来描述某个特点方面k的信息。我们记r

ψ

(e),k为元关系ψ(e)由于第k个方面的因素而与节点t相关的可能性,从而其有限制条件r

ψ

(e),k≥0和我们将用如下方式获取其关联权重

[0141][0142]

其中w为权重矩阵,q

ψ

(e)是针对元关系ψ(e)的语义注意力向量。这种关联权重可以进一步通过softmax函数进行标准化:

[0143][0144]

在聚集了所有与目标节点t相关的元关系ψ

t

的邻居节点特征后,我们迭代搜索各个元关系的主要影响方面,进而获取t的表征表示如下:

[0145][0146]

对于迭代轮数i=1,2,...,i,输出的可以轮流反馈指导对应元关系下邻居组n

ψ

(e)(第二步按元关系分出的各个节点组)内的注意力权重(第三步的注意力权重)。目标节点t通过图神经网络循环聚集更新后的最终节点表征,可以被表示为

[0147]

第五步:推荐

[0148]

我们将用户节点作为目标节点t,由前三步可以得到t的一个表征向量集{z

u,1

,z

u,2

...,z

u,k

},作为用户不同方面的特征表示。类似地,我们再把商品视为一个目标节点,并

得到对应的k个方面的嵌入向量集{z

υ,1

,z

υ,2

…

,z

υ,k

}。我们将对用户商品在每个方面的特征向量对应进行组合,来估计用户对目标商品在不同组合上的偏好程度,如图3所示。

[0149]

对于用户、商品对应的k个方面嵌入向量集,我们分别将其输入至自注意力层,分别得到用户、商品组合后对应的表示集合,以用户自注意力层为例即

[0150][0151][0152]

ψ(z

u,k

,z

u,m

)=《w

queryzu,k

,w

keyzu,m

》

[0153]

其中,w

quert

,w

key

,w

value

表示用户自注意力层查询、键、值的权重,其将用户在不同方面的信息映射至查询、键、值空间;ψ(

·

,

·

)为注意力函数,其计算用户不同方面特征的相似程度,可以通过神经网络或者内积计算。同理,也可以得到商品组合后对应的表示集合。最后,将得到的用户、商品组合后不同方面的表示对应进行内积,来估计用户对目标商品在第k个方面上的偏好程度,再将所有方面偏好相加,作为我们的推荐分数:

[0154][0155]

根据这个评分,我们将考虑问题情景的需要,挑选得分最高的一个或几个商品,推荐给用户。

[0156]

本技术中第二步解离特征转化可以通过如映射至其他空间如双曲空间中等其他映射方法进行替换,第五步推荐可以通过推荐方法中其他特征组合进行替换,包括推荐系统中常用的fm模型,ffm模型,deepfm模型等。

[0157]

根据本技术的另一个方面,本技术一实施例还提供了一种用于推荐系统的解离化异构图注意力的系统,包括:

[0158]

构建异构信息网络模块,用于构建异构信息网络;

[0159]

解离特征转化模块,用于解离所述异构信息网络中的目标节点和所述目标节点的直接邻居点的特征并转化,获取转化特征;

[0160]

关系内聚合模块,用于关系内聚合所述转化特征,并获取第一聚合结果;

[0161]

关系间聚合模块,用于关系间聚合所述转化特征,并获取第二聚合结果;

[0162]

推荐模块,用于根据所述第一聚合结果及所述第二聚合结果推荐最终结果。

[0163]

与现有技术相比,本技术具有如下有益效果:

[0164]

1.本技术提出了一个全新的解离化异构图注意力神经网络用于推荐系统。与以往将相互影响的因素笼统处理的模型不同,本技术显式地对不同层面的因素及其在语义关系下的相应影响进行了建模。具体来说,本技术将带有丰富上下文信息的用户-商品交互数据表示为一个异构信息网络,该网络包含了不同类型的节点及节点对间的对应关系。给定节点特征作为输入,将它们投影到不同的嵌入空间,并提出了一个语义嵌入传播层来识别图神经网络信息信息传播过程中的不同关系语义主要影响节点表示的某一特定方面。

[0165]

2.本技术摒弃了以往手动设计元路径的方式,而是利用节点的单跳关系并使用注意力机制来平滑地产生元路径。通过堆积多个嵌入传播层,每种节点—特别是用户和商品,都将聚集来自各个元路径的嵌入表示,从而捕获更高阶的关联信息。

[0166]

3.本技术提出了异构信息网络上反映不同方面特征的解离化表示。该机制具有泛化到其余异构信息网络应用场景上的潜力。

[0167]

4.本技术提出了一种解离化嵌入传播层,这种结构可以迭代识别节点对间关系影响的主要方面,并将对应信息语义化地传播出去。此外,还通过自动抽取元路径,使得这个模型更加具备了实际应用价值。

[0168]

5.本技术在几个真实数据集上进行了大量实验来评估我们提出的模型。实验结果表明,模型不仅超越了现有的最佳模型,而且对于推荐内容具备很好的可解释性。

[0169]

关键概念:

[0170]

(1)异构信息网络:

[0171]

一个异构信息网络被定义为一个基本的图表示其中为构建异构信息网络,为网络中包含的节点集合,ε为网络中关系集合。网络中存在一个节点类型映射函数以及边类型映射函数对于网络任意一个节点或者连边e∈ε,其都属于对应节点类型集合或边类型集合异构信息网络具有的性质。

[0172]

(2)元路径和元关系:

[0173]

异构信息网络中一条路径被称为元路径,如果它符合如下形式:(简写为)。这条路径描述了节点类型与间的复合关系其中代表关系上的复合运算。对于特定数据集中带有语义的元路径选择,其总是需要根据领域专家的先验知识手动选出。随着元路径长度的逐渐增多,我们很难找到最优的元路径。

[0174]

因此,我们把元路径分为独立的元关系,并且基于不同的元关系进行自动组合用于生成元路径。对于一条从源节点s到目标节点t的连边edgee=(s,t),其上的元关系可以定义为《φ(s),ψ(e),φ(t)》,其表示了两类节点之间的语义关系。给定一个目标节点t和元关系ψ(e),可以存在多个类型为φ(s)的源邻居节点。

[0175]

(3)图嵌入表示学习和图神经网络

[0176]

图嵌入表示学习算法首先从输入的图数据中学习得到节点或整个图的特征表示,然后将这些特征表示应用于后续图相关应用任务,如节点分类、链接预测和可视化等。随着神经网络在计算机视觉、语音识别、自然语言处理等领域迅猛发展,深度学习在图表示学习中也开始被广泛研究,图神经网络通过通过对图中节点的信息进行局部聚合,即图中节点信息扩散,在图中实现端到端表示学习任务,其中主要包含两个模块,邻居节点间消息聚集和目标节点信息更新。

[0177]

(4)解离化表示学习

[0178]

解离化表示学习旨在学习数据中潜在独立的多种因素,与传统表示学习将多种因素混合表示不同,解离化表示通过区分特定的多种因素使得每个因素对应嵌入表示中的独

特部分。与传统表示学习相比,解离化表示学习更具有鲁棒性与可解释性。

[0179]

(5)基于异构信息网络的推荐系统:

[0180]

基于异构信息网络的推荐问题可以被描述为如下形式。在一个特定的推荐情境下,给定一个用户集合和商品集合存在一个用户-商品交互矩阵y∈y

m*n

,其中yuυ=1表示用户u和商品υ进行过交互,否则yuυ=0。此外,我们还有用户和商品对应的上下文信息,如用户间的社交关系,商品的品牌和门类等。用户、商品以及他们的上下文信息被我们抽象为异构信息网络上不同类型节点。我们的任务是预测用户u对于没有交互过的商品υ是否有潜在的兴趣。特别地,我们会学习u和υ解耦和后不同方面的低维向量表示,并应用于预测函数其中代表用户u在未来与商品υ进行交互的可能性,θ表示预测函数的模型参数。

[0181]

请参照图4,本技术还提供了一种计算机设备,包括存储器、处理器和存储在所述存储器内并能由所述处理器运行的计算机程序,所述处理器执行所述计算机程序时实现上述任一项所述的方法。

[0182]

请参照图5,一种计算机可读存储介质,非易失性可读存储介质,其内存储有计算机程序,所述计算机程序在由处理器执行时实现上述任一项所述的方法。

[0183]

显然,本领域的技术人员应该明白,上述的本发明的各模块或各步骤可以用通用的计算装置来实现,它们可以集中在单个的计算装置上,或者分布在多个计算装置所组成的网络上,可选地,它们可以用计算装置可执行的程序代码来实现,从而,可以将它们存储在存储装置中由计算装置来执行,或者将它们分别制作成各个集成电路模块,或者将它们中的多个模块或步骤制作成单个集成电路模块来实现。这样,本发明不限制于任何特定的硬件和软件结合。

[0184]

以上所述仅为本技术的优选实施例而已,并不用于限制本技术,对于本领域的技术人员来说,本技术可以有各种更改和变化。凡在本技术的精神和原则之内,所作的任何修改、等同替换、改进等,均应包含在本技术的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1