量化食管粘膜IPCLs血管形态分布的深度检测网络的制作方法

量化食管粘膜ipcls血管形态分布的深度检测网络

技术领域

[0001]

本发明属于医学图像处理技术领域,具体涉及一种量化食管粘膜ipcls血管形态分布的深度检测网络。

背景技术:

[0002]

食管癌和胃癌是中国等发展中国家常见的上消化道恶性肿瘤,中国新发病例超过全球总病例数的40%,发病率和死亡率显著高于世界平均水平

[10]

。根据中国肿瘤登记中心的最新数据统计,中国食管癌及胃癌的新发病例分别位居恶性肿瘤发病第六位和第二位。食管癌和胃癌预后较差,5年相对生存率分别为20.9%和27.4%,给卫生医疗带来严重负担

[11,13-14]

。规范的上消化道癌症筛查、治疗、随访是降低癌症发病率和死亡率的有效手段。其中窄带成像内镜筛查是发现上消化道癌症的首选手段。窄带成像内镜下食管粘膜病变的病理类型、浸润深度判断主要依据其特有的上皮乳头内毛细血管袢(intrapapillary capillary loops,ipcls)血管形态。

[0003]

根据inoue和arima提出的分型标准

[15]

,一般可将血管分为a、b1、b2和b3四种类型。其中a型指观察到非异常血管;b1型指观察到襻状异常血管,血管扩张,形态呈蛇形,口径不同、形状不均一,直径为20-30微米,其浸润深度为m1-m2层;b2型指观察到非襻状血管,血管形态呈不规则树枝状或多重状,其浸润深度为m3-sm1层;b3型指观察到粗大的绿色血管,血管高度扩张,其浸润深度为sm2层。

[0004]

ipcl血管的类型、数量、分布对临床上的治疗决策有着重要的指导作用。例如提示浸润深度较深的ipcl出现大量的聚集,可能提示食管病变进入了中晚期,不适合微创治疗,甚至不适合手术治疗;相反,如果浸润深度较深的ipcl分布零散,则病人可能还有手术的机会。

[0005]

在临床上,ipcl的观察受人为主观因素的影响很大,因为不同于常规的胃肠镜成像方式,ipcl的观察需要在nbi模式下,使用放大胃镜对病变的表面进行10-50倍的放大。与显微镜的原理相同,在放大模式下医生将会得到一种接近于200个细微结构/视野的图像。在这种情况下临床医生需要对所有结构都进行观察,极其容易产生视觉上的疲劳,再加上临床经验的不足,在针对5-10个视野进行观察后,临床医生往往只记住了印象特别深刻的部位“参考墨菲定律”,缺乏一个客观的、可量化的概念,容易造成对病情的误判,造成医疗决策的错误。

[0006]

本项研究能使临床医生摆脱主观因素(大量精细观察造成的疲劳、疏漏、经验不足等)影响,只需要对病灶进行放大操作,通过计算机分析,得到针对所有视野的ipcl预测,包括各类型血管的数量、比例、聚集情况,能帮助医生对病灶进行更准确的判断。

[0007]

深度卷积神经网络是一种机器学习技术,可以有效避免人为因素,自动从有标记的大量数据中学习如何提取丰富的具有代表性的视觉特征。该技术使用反向传播优化算法,让机器更新其内部参数,学习输入图像到标签的映射关系。近年来,深度卷积神经网络大大提高了计算机视觉中各项任务的性能。

[0008]

2012年,krizhevsky等人

[1]

首次在imagenet

[2]

图像分类比赛中应用深度卷积神经网络,并以15.3%的top-5错误率获得冠军,引起了深度学习的热潮。2015年,simonyan等人

[3]

提出了16和19层的神经网络vgg-16和vgg-19,增加了网络的参数量,进一步提升了imagenet图像分类任务的结果。2016年,he等人

[4]

使用152层的残差网络resnet取得了超过了人眼的分类效果。

[0009]

深度卷积神经网络不仅在图像分类任务中有卓越的表现,在一些结构化输出的任务中,如物体检测

[5-7]

、语义分割

[8,9]

中也同样取得了卓越的效果。如果将深度卷积神经网络应用在计算机辅助诊断中,则可以辅助医生做出更好的医疗诊断,早发现、早治疗,提高治疗效果。

[0010]

本发明提供了一种聚簇分布先验自嵌入的检测网络,它能够充分挖掘癌灶潜在的聚簇分布先验,并提取丰富的特征,同时实现早期食管鳞癌的癌灶检测和诊断。

技术实现要素:

[0011]

本发明的目的在于提供一种量化食管粘膜ipcls血管形态分布的聚簇分布先验自嵌入的深度检测网络,排除人为因素影响,实现对窄带成像内镜图像的自动诊断。

[0012]

本发明提供的聚簇分布先验自嵌入的检测网络,是基于目标检测神经网络的,具体包括:特征提取骨干网络、特征金字塔网络、区域候选网络、兴趣区域池化与聚簇分布先验自嵌入的癌灶分类网络,以及在窄带成像内镜图像上进行可视化的辅助诊断系统;其中:

[0013]

(1)所述特征提取骨干网络,在resnet-50

[4]

基础上构建,包括50个卷积层,用于提取输入图像的特征图(即作为特征金字塔的特征提取器)。具体是分别在resnet-50模型的layer1,2,3,4层的末尾抽取特征图,抽取出的特征图分别拥有256、512、1024、2048通道,特征图的大小分别为1/4、1/8、1/16、1/32的原图大小;特征图送入特征金字塔网络

[12]

;

[0014]

(2)特征金字塔网络,用于将不同尺度的特征相融合,首先使用1

×

1的卷积将特征图全部统一到256通道,随后自顶向下逐层将上层的特征上采样至两倍大小,并与下层的特征相加,进行3

×

3的卷积;这样就得到了多尺度的特征图:其大小分别为1/4、1/8、1/16、1/32的原图大小,通道数均为256通道;

[0015]

(3)所述区域候选网络,用于提取可能的病灶区域;其中,首先使用锚生成器

[5]

生成密集的矩形候选框;矩形的候选框共有5

×

3种不同的尺寸,由五种不同的大小(如宽为32,64,128,256,512)与三种不同的形状(如1:1,1:2,2:1)组合而成;特征金字塔中各层的特征经过一个3

×

3的卷积和一个1

×

1卷积,通过softmax来判断上述候选框属于正样本或负样本;最后通过12通道1

×

1的卷积,进行三种形状的边界框回归(每个box有4个坐标,故为3

×

4=12通道),修正不精确的候选框;

[0016]

(4)所述兴趣区域池化与聚簇分布先验自嵌入的癌灶分类网络,其中,兴趣区域池化是通过对兴趣区域池化将特征池化到可疑病灶区域;聚簇分布先验自嵌入的癌灶分类网络用于对癌灶进行分类;具体地,将感兴趣区域用与坐标轴平行的矩形边界框框出,并给出该区域的癌灶分类结果,即正常(即a类)区域或病变区域(即b1、b2、b3类);该网络首先从特征金字塔不同层级的特征图中提取感兴趣区域,将其对齐,并最大池化至7

×

7,从而使得每个兴趣区域对应于一个256

×7×

7大小的特征;随后将每个感兴趣区域的特征与其相邻的k个近邻的特征叠加(即将特征通道连接合并),形成一个(256

×

k)

×7×

7形状的特征图,从

而使得分类网络运用到了潜在的癌灶分布先验;此后通过全连接层产生两条输出支路:第一条支路输出每个特征区域的位置偏移量,用于进一步修正检测框的位置;第二条支路通过softmax函数计算特征的分类概率,得出区域的癌灶类别;其中全连接层将展平(256

×

k)

×7×

7形状的特征图,形成(12544

×

k)

×1×

1的特征,而全连接层的输出为1024通道,第一条支路的输出为20通道,即每个类别对应边界框四个坐标5

×

4,第二条支路的输出为5通道,即包含负样本在内的5个类别;

[0017]

(5)所述在窄带成像内镜图像上进行可视化的辅助诊断系统,即最后在窄带成像内镜图像上进行可视化显示,使用不同的颜色对癌灶进行框选标记。具体地,输入为窄带成像内镜图像;使用前述网络对癌灶进行检测和诊断,使用不同颜色的检测框代表不同的癌灶类型,即用绿色、红色、紫色、黑色分别代表a、b1、b2、b3四类,同时标记出检测框的分类置信度。随后对所有检测框的置信度进行筛选,剔除掉置信度小于阈值t1的所有检测框,再运用非极大值抑制剔除掉交并比大于阈值t2的多余重叠框。其中t1、t2取遍[0,1]范围内步长为0.05的所有值,并通过比较f

1-分数来确定最优的阈值t1、t2。

[0018]

本发明网络模型的训练方法如下:

[0019]

训练前,对resnet-50模型的网络参数进行随机初始化,并将训练集中的图像进行缩放,使得其分辨率不超过800

×

1333,其对应的边界框也同时进行同比例缩放。

[0020]

训练时,首先将图像按照均值=[0.485,0.456,0.406]和标准差=[0.229,0.224,0.225]对图像的三通道(r、g、b)进行归一化处理。使用adam优化算法

[16]

,设初始学习率为10-4

,两次估计的指数衰减率:β1设为0.9、β2为0.999,权重衰减为0,并使用小批量随机梯度下降策略,批大小设置为8来最小化损失函数;训练共进行n轮;由于训练集中各类型血管的分布不均衡,b2、b3类型的血管得不到充分的训练,使用focal loss作为癌灶分类网络的损失函数,其中,负样本、a、b1、b2、b3的权重分别为c1、c2、c3、c4、c5,具体根据训练集中各血管的分布比例经过多次实验后确定。

[0021]

本发明中,输入窄带成像内镜的图像后,仅经过一次前向传播,即可得到癌灶的检测与诊断结果。

[0022]

本发明的有益效果在于:

[0023]

本发明设计了一种聚簇分布先验自嵌入的检测网络,以窄带成像内镜图像为输入,同时实现早期食管鳞癌的癌灶检测和诊断。待测试图像只需经过一次前向传播,即可获得检测和诊断结果,检测和分类任务共享部分网络参数,有效减少计算量,提高诊断效率。实验结果表明,本发明可以精确地检测出早期食管鳞癌的癌灶区域,并基于检测框提供准确的诊断结果,减少人为因素影响,提高临床诊断的效率和准确率。

附图说明

[0024]

图1为本发明的网络框架图。

[0025]

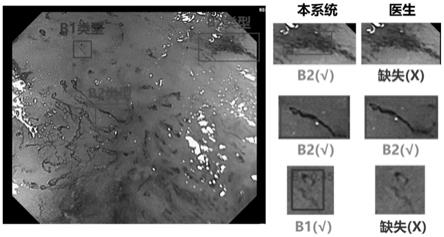

图2为窄带成像内镜图像输入到网络模型中后本发明检测与诊断的效果示意图。其中,(a)为窄带成像内镜图像,(b)为本发明对图像中的癌灶进行检测和分类的结果,(c)为医生凭借经验对图像中的癌灶进行检测和分类的结果。

[0026]

图3为本发明与医生在窄带成像内镜图像中检测与诊断的可视化效果对比。

[0027]

图4为本发明与医生在窄带成像内镜图像中检测与诊断的不同分类的召回率对

比。

[0028]

图5为本发明通过特征提取网络进行特征提取后的特征图展示。

具体实施方式

[0029]

下面对本发明实施方案进行详细说明,但是本发明的保护范围不局限于所述实施例。

[0030]

本发明采用图1所示的网络框架,使用144张由多名资历丰富的医生协同标注的窄带成像内镜图像进行训练,从而得到一个能够对窄带成像内镜图像进行食道鳞癌癌灶自动检测及诊断的模型。具体流程为:

[0031]

(1)训练前,对resnet-50模型的网络参数进行随机初始化,并将训练集中的图像进行缩放,使得其分辨率不超过800

×

1333,其对应的边界框也同时进行同比例缩放。。

[0032]

(2)训练时,首先将图像按照均值=[0.485,0.456,0.406]和标准差=[0.229,0.224,0.225]对图像的三通道(r、g、b)进行归一化处理;使用adam优化算法

[16]

,设初始学习率为10-4

,两次估计的指数衰减率β1设为0.9、β2为0.999,权重衰减为0,并使用小批量随机梯度下降策略,批大小设置为8来最小化损失函数;训练共进行n轮;由于训练集中各类型血管的分布不均衡,b2、b3类型的血管得不到充分的训练,使用focal loss作为癌灶分类网络的损失函数,其中,负样本、a、b1、b2、b3的权重分别为c1、c2、c3、c4、c5,具体根据训练集中各血管的分布比例经过多次实验后确定。

[0033]

(3)测试时,将窄带成像内镜图像进行缩放,使得其分辨率不超过800

×

1333,输入到已经训练好的模型中,模型将输出所有检测到的血管的外包围框、对应的癌灶类别(包括正常类别a,以及异常类别b1、b2、b3共计四类)及其置信度p。特别地,由于窄带成像内镜图像中包含的血管数量较多,每张图像的检测框数量上限设定为250个。设定阈值t1为0.3,当p>0.3时,则保留该外包围框,否则移除该外包围框。设定阈值t2为0.3,对剩余的外包围框进行非极大值抑制,从而仅保留在邻域内(交并比大于阈值t2时)置信度p最高的包围框。

[0034]

图2展示了窄带成像内镜图像输入到网络模型中后本发明检测与诊断的效果,其中,(a)为原窄带成像内镜图像;(b)为本发明对图像中的癌灶进行检测所得到的外包围框以及对应的分类和置信度,不同颜色分别代表了不同的癌灶类型,即用绿色、红色、紫色、白色分别代表a、b1、b2、b3四类;(c)为多名具有多年临床实践、经验丰富的医生经过讨论后协同对图像中的癌灶进行检测和分类的结果。从图中可以看到本系统在癌灶的检测及分类上与多名经验丰富的医生联合判断的结果基本一致,表明本发明具有很强的应用价值。

[0035]

图3展示了本发明与单个医生在窄带成像内镜图像中检测与诊断的可视化效果对比,其中检测与诊断的参考依据(即标准结果)是由多名资历丰富的医生协同标注的。由此可见,单个医生在进行检测与诊断时,难免会产生错漏,无法达到较高的敏感度,而本发明的系统相较单个医生不仅有着更快的判断速度(每张图像小于1秒),也有着更高的准确性。

[0036]

图4为本发明与单个医生在窄带成像内镜图像中检测与诊断的不同分类的召回率对比,其中检测与诊断的参考依据(即标准结果)是由多名资历丰富的医生协同标注的。可以看到,本发明在召回率上远高于单个医生,召回率的含义为真实癌灶检出并正确分类的比率,也就意味着本发明比单个医生检测诊断错漏的情况要少得多。

[0037]

图5为本发明通过特征提取网络进行特征提取后的特征图展示,可以看到在特征

提取后,血管和非血管的特征值相差很大,这表明特征提取网络能很有效地从窄带成像内镜图像中提取用于检测和诊断的关键特征。

[0038]

表1、表2为本发明与单个医生在窄带成像内镜图像中检测与诊断的敏感度、精确率、召回率分析情况。表1是本发明的网络在取k=4(即分类使用4个近邻的特征融合)时的性能;表2为单个医生检测与诊断的结果。检测与诊断的评判标准是由多名资历丰富的医生协同标注的。因此本发明在召回率上超越了单个医生的检测与诊断水平,体现了本发明的临床使用价值。

[0039]

表1

[0040]

类型tpfpfn敏感度精确率召回率a169267530.7610.3880.669b132484892490.9290.8690.916b29840700.5830.7100.466b3202250.8000.4760.500overall35358183770.9040.8120.884

[0041]

表2

[0042]

病变类型tpfpfn敏感度精确率召回率a

-----

0.50b1

-----

0.70b2

-----

0.93b3

-----

1.00overall

-----

0.67

[0043]

参考文献

[0044]

[1]krizhevsky,a.,sutskever,i.&hinton,g.e.imagenet classification with deep convolutional neural networks.advances in neural information processing systems,1097-1105(2012).

[0045]

[2]russakovsky,o.,deng,j.,su,h.et al.imagenet large scale visual recognition challenge.international journal of computer vision 115,211-252(2015).

[0046]

[3]simonyan,k.&zisserman a.very deep convolutional networks for large-scale image recognition.international conference on representation learning,(2014).

[0047]

[4]he,k.,zhang,x.,ren,s.&sun,j.deep residual learning for image recognition.ieee conference on computer vision and pattern recognition,770-778(2016).

[0048]

[5]girshick,r.,donahue,j.,darrell,t.&malik,j.rich feature hierarchies for accurate object detection and semantic segmentation.ieee conference on computer vision and pattern recognition,580-587(2014).

[0049]

[6]girshick,r.fast r-cnn.ieee international conference on computer vision,1440-1448(2015).

[0050]

[7]ren,s.,he,k.,girshick,r.&sun,j.faster r-cnn:towards real-time object detection with region proposal networks.neural information processing systems,(2015).

[0051]

[8]long,j.,shelhamer,e.&darrell,t.fully convolutional networks for semantic segmentation.ieee international conference on computer vision,3431-3440(2015).

[0052]

[9]chen,l.,papandreou,g.,kokkinos,i.,murphy,k.&yuille,a.l.deeplab:semantic image segmentation with deep convolutional nets,atrous convolution,and fully connected crfs.ieee transactions on pattern analysis and machine intelligence 40,834-848(2018).

[0053]

[10]ervik m,l f,ferlay j,et al.cancer today.lyon,france:international agency for research on cancer.cancer today.[eb/ol].[2017-02-26].

[0054]

[11]陈万青,郑荣寿,张思维,等.2013年中国恶性肿瘤发病和死亡分析[j].中国肿瘤,2017,26(1):1-7.

[0055]

[12]tsung-yi lin,piotr doll

á

r,ross b.girshick,kaiming he,bharathhariharan,serge j.belongie:feature pyramid networks for object detection.cvpr 2017:936-944.

[0056]

[13]zeng h,zheng r,guo y,et al.cancer survival in china,2003-2005:a population based study[j].int j cancer,2015,136(8)

[0057]

[14]chen wq,zheng rs,baade pd,et al.cancer statistics in china,2015[j].ca cancer j clin,2016,66(2):115-132.

[0058]

[15]inoue h,kaga m,ikeda h,et al.magnification endoscopyin esophageal squamous cell carcinoma:a review of theintrapapillary capillary loop classification[j].anngastroenterol,2015,28(1):41-48.

[0059]

[16]diederik p.kingma,jimmy ba.adam:a method for stochastic optimization.iclr(poster)2015.

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1