一种基于全局运动统计特征的团队体育视频关键帧提取方法

1.本发明属于视频分析领域。

背景技术:

2.视频在电影,监控,体育,新闻等许多领域无处不在。视频文件的数量巨大,使得分析和理解视频内容的工作量相当繁重。此外,在视频数据库中进行视频浏览会消耗大量时间,因此,可以协助用户进行快速浏览的视频摘要是一个重要且不断发展的研究领域。关键帧提取是视频摘要的一种重要方式,它可以通过一系列视频帧以可视化的方式来表示视频的摘要。

3.体育视频是一种广播电视视频,如足球、篮球等团队体育项目由于深受人们的喜爱,具有广泛的群众基础,因而对团队体育视频的研究具有广阔的应用前景。准确的关键帧提取可以有助于视频集锦的生成,对比赛内容的快速浏览,比赛技术统计信息的提取等应用场合。

4.现有的视频关键帧提取方法的总体框架如下:首先检测镜头边界,然后将视频切分为镜头视频片段。之后使用颜色或光流等特征通过帧聚类来提取关键帧。因为位于同一视频中的关键事件对应的视频帧往往都具有较为相似的视觉特征,故这些方法难以有效地提取与比赛事件相关的关键帧。

5.vennila等使用了马尔可夫链,转移概率矩阵和其他手段来增强视觉特征的聚类结果,以获得更高置信度的中心聚类。mendi等则使用混合光流来计算视频帧中的运动矢量,然后根据运动特征时间曲线找出局部极小值,再选择相应的帧作为关键帧。

6.vennila等的算法所提取的关键帧在大多数情况下可以准确地描述视频的主要内容,但是对于颜色特征相近的视频帧聚类效果并不理想。mendi等的算法可以有效地描绘视频的镜头运动并动态提取关键帧,但是该算法易受到一些冗余的局部运动特征影响。

7.对于体育视频而言,比赛镜头的视频帧往往都具有较为相似的视觉特征,故现有方法难以有效地提取与比赛事件相关的关键帧。而对于原始视频只做基本的镜头切分对于体育视频来说是不够的,因为一个镜头往往会包含多个事件,故需要细粒度的视频切分。此外,针对体育视频的算法所常用的运动特征是从光流中提取的,光流既包括来自摄像机的全局运动,也包含来自队员在场上的局部运动,甚至涉及比赛logo或记分板的变化。混合光流是上述来自不同主体的运动光流的混合,其中某些部分与事件无关,并且无法对关键帧的提取提供帮助,冗余的信息反而可能会影响基于光流的算法性能。

技术实现要素:

8.本发明的目的是提供了一种基于全局运动统计特征的团队体育视频关键帧提取方法。众所周知,团队体育视频中的大多数事件都是进攻与防守转换,这与全局运动转换有着紧密联系。因此,通过使用基于全局运动的细粒度切分,可以使得从细粒度片段中提取的关键帧与关键事件更加相关。故本发明在提取比赛镜头后,基于全局运动的镜头水平平移

量进行细粒度的视频切分;再根据全局运动统计特征来提取候选关键帧,最后从候选关键帧集合中提取代表性关键帧以去除冗余帧来得到最终的关键帧集合。此外,构建了一个数据集sportkf,其中包括来自四种团队体育项目(篮球,足球,美式橄榄球和曲棍球)的25个视频,共112分钟,含197,878帧,其中含764个关键帧。

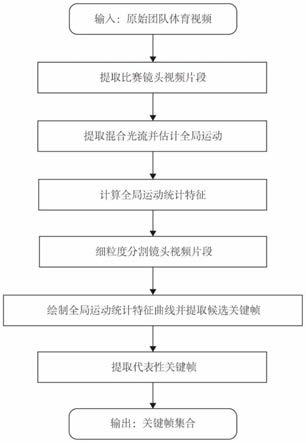

9.图1是本发明技术方案的主流程图。如图1所示,本发明提出的一种基于全局运动统计特征的团队体育视频关键帧提取方法包括下列步骤:

10.1、通过一种基于颜色特征的团队体育视频比赛镜头提取方法提取比赛镜头视频片段。

11.2、提取每个镜头视频片段中视频帧的混合光流并估计全局运动。

12.3、计算视频帧对应的全局运动统计特征,包括镜头缩放量和平移量。

13.4、基于镜头的水平平移量,将镜头视频片段进一步切分为细粒度视频片段。

14.5、绘制镜头合平移量和合缩放量的曲线,依据曲线的极大值提取每个细粒度视频片段中的候选关键帧。

15.6、结合时空一致性与层次聚类从候选关键帧集中提取代表性关键帧,

16.得到最终的关键帧集合。

17.步骤1:

18.输入:原始团队体育视频

19.输出:比赛镜头视频片段集合。

20.步骤2:

21.输入:比赛镜头视频片段的视频帧

22.输出:视频帧对应的全局光流场

23.步骤3:

24.输入:视频帧四个角点的全局光流值

25.输出:全局运动统计特征:包括镜头的缩放量和平移量

26.如图2镜头平移缩放示意图(该示意图表示镜头从原始镜头范围转换至缩放和平移后的镜头范围对应的点的位移。其中矩形p

tl

p

bl

p

br

p

tr

代表原始镜头范围,矩形p’tl

p’bl

p’br

p'

tr

代表变换后的镜头范围。为了更直观地说明这一过程,假设将运动分为平移然后缩放两步,则虚线矩形代表中间步骤平移后的镜头范围。)所示,

[0027][0028][0029][0030]

式中x

zoom

,y

zoom

分别为镜头在x,y方向上的缩放向量,mag

zoom

则是镜头的合缩放量。(x

tl

,y

tl

),(x

br

,y

br

)分别为视频帧左上和右下角点的全局运动向量。

[0031]

x

trans

=x

tl

‑

x

zoom

[0032]

y

trans

=y

tl

‑

y

zoom

[0033]

[0034]

式中x

trans

,y

trans

分别为镜头在x,y方向上的平移向量,dis

trans

则是镜头的合平移量。

[0035]

步骤4:

[0036]

输入:比赛镜头视频片段集合

[0037]

输出:细粒度视频片段集合

[0038]

trans_con=sgn(x

trans

(frame

i

)

·

x

trans

(frame

i+1

))

[0039]

其中sgn(x)函数返回x的符号,x>0,则sgn(x)=1;x=0,则sgn(x)=0;x<0,则sgn(x)=

‑

1;x

trans

(frame

i

),x

trans

(frame

i+1

)分别为第i帧,第i+1帧对应镜头在x方向上的平移向量。

[0040]

具体操作:在每个镜头视频片段中,逐一计算第i帧与第i+1帧对应的trans_con,如果trans_con=

‑

1,则分隔开第i帧与第i+1帧,直至计算到每个镜头视频片段的倒数第二个视频帧为止;之后将第一个间隔之前的帧存为第一个细粒度视频片段,之后将每两个间隔之间的帧存为相应的细粒度视频片段,最后一个细粒度视频片段由最后一个间隔之后的所有帧组成;

[0041]

步骤5:

[0042]

输入:细粒度视频片段集合的所有视频帧

[0043]

输出:候选关键帧集

[0044]

步骤一:对每个细粒度视频片段,绘制视频帧序列的合缩放量变化曲线mag

zoom

(f)以及合平移量变化曲线dis

trans

(f)(f为视频帧序列对应的帧号)。

[0045]

步骤二:同时扫描合平移量与合缩放量变化曲线。以合缩放量变化曲线为例,找到f1,f3,f2为连续的三个视频帧,如果mag

zoom

(f3)>mag

zoom

(f1)且mag

zoom

(f3)>mag

zoom

(f2),则f3为mag

zoom

(f)曲线的一个极大值对应的帧号。dis

trans

(f)曲线同理。若同帧号的f3既为mag

zoom

(f)曲线的极大值对应的帧号,又是dis

trans

(f)曲线的极大值对应的帧号,则把f3对应的帧选为关键帧;重复步骤二直至查找完毕;

[0046]

步骤三:遍历已经提取出的初步关键帧集,找到两帧k1,k2,如果k2‑

k1≥med(med值为设定的阈值,med越大,满足提取中间帧条件的相邻关键帧就越少,进而提取的中间帧也越少,反之亦然),则提取原细粒度视频片段帧集中帧号(表示对x向下取整)的视频帧,并存入按帧号大小排列的候选关键帧集中;重复步骤三直至查找完毕;

[0047]

候选关键帧提取示例见图3。

[0048]

步骤6:

[0049]

输入:候选关键帧集

[0050]

输出:最终关键帧集

[0051]

基于时空一致性的代表性关键帧提取:

[0052]

步骤一:将所有候选关键帧对应的全局光流场(步骤2输出)进行彩色编码,得到全局光流图像;

[0053]

步骤二:将所有全局光流图像从rgb颜色空间转换至hsi颜色空间;

[0054]

步骤三:将所有hsi颜色空间的全局光流图像按对应关键帧的时间序列进行排序;

[0055]

步骤四:计算所有hsi颜色空间的全局光流图像对应的hi通道二维直方图;

[0056]

步骤五:利用基于python3.7的opencv库中的comparehist函数,将method参数设置为cv2.histcmp_bhattacharyya,计算相邻图像hi通道二维直方图的巴氏距离b;

[0057]

巴氏距离用于测量两个离散数据的概率分布。在直方图相似度计算时,巴氏距离具有很好的效果,其计算直方图相似度的公式如下:

[0058][0059][0060]

其中,h1和h2为两个直方图,n为直方图组数,h

i

[m]表示第m组对应的频率;值越小,相关度越高,完全匹配为0,完全不匹配则为1;

[0061]

步骤六:如果b>th

b

,检测这两幅相邻图像对应的关键帧是否被提取,如果未被提取,则提取未被提取的关键帧;

[0062]

基于层次聚类的代表性关键帧提取:

[0063]

步骤七:将所有全局光流图像按对应关键帧此前所在的细粒度视频片段进行分组,且按时间序列进行排序;

[0064]

步骤八:计算每幅全局光流图像对应的rgb三通道直方图,并横向拼接为一个包含768个特征值的数组;

[0065]

步骤九:利用基于pyhton3.7的scipy库中的cluster.hierarchy模块可以实现对每组中所有全局光流图像对应的数组进行层次聚类,将method设置为average linkage,将簇间距离阈值设置为th

hc

;

[0066]

步骤十:提取聚类后每一簇中,与每个数组距离最小的数组对应的关键帧;

[0067]

步骤十一:检测每个细粒度视频片段的首末候选关键帧是否被提取,如果未被提取,则提取未被提取的关键帧;

[0068]

步骤十二:将上述提取出的关键帧取并集,移除重复的关键帧。得到最终的关键帧集。

[0069]

本发明提出了一种基于全局运动统计特征的团队体育视频关键帧提取方法,引入全局运动可以对视频进行细粒度切分,并能有效提取视频关键帧。在sportkf数据集上的实验结果表明,提出的kegms可以达到最佳性能。该方法可以有效地对帧间颜色特征相近的团队体育视频进行关键帧提取,同时有效地规避了一些冗余的局部运动特征对基于光流提取关键帧算法的影响。此外,细粒度的视频切分可以更好地使提取出的关键帧与比赛中的关键事件相对应。

[0070]

为了全面评价本发明的性能,使用生成视频关键帧集的精度、召回率、f值指标作为客观标准对摘要的质量进行评价。三个客观评价视频关键帧的标准精度(p)、召回率(r)和f值(f)的计算公式分别如下:

[0071][0072]

[0073][0074]

式中,n

matched

表示算法自动提取出的关键帧与数据集中人工提取关键帧的匹配程度;n

as

表示自动提取出的关键帧数量;n

us

表示人工提取出的关键帧数量。

[0075]

精度可反映使用算法自动提取出的关键帧匹配数据集中人工提取关键帧的能力,召回率可反映匹配的关键帧数量占人工提取出的关键帧数量的比例。同时,这两个标准之间相互制约,通常情况下较高的召回率对应较低的精度,反之亦然。因此,为了综合衡量精度和召回率,选择f值作为评估视频摘要综合质量的指标。

[0076]

另外,还提出了一种基于颜色特征的团队体育视频比赛镜头提取方法。具体实施步骤如下:

[0077]

输入:原始团队体育视频

[0078]

输出:比赛镜头视频片段集合

[0079]

定义:

[0080]

s={s1,s2,

……

,s

s

}:经过视频切分后的镜头视频片段集合;

[0081]

f:镜头视频片段的视频帧集合;

[0082]

am

r

:视频帧中所有像素点对应r通道取值的算术平均值;

[0083]

am

g

:视频帧中所有像素点对应g通道取值的算术平均值;

[0084]

am

b

:视频帧中所有像素点对应b通道取值的算术平均值;

[0085]

r

r

:镜头视频片段中am

r

的极差;

[0086]

r

g

:镜头视频片段中am

g

的极差;

[0087]

r

b

:镜头视频片段中am

b

的极差;

[0088]

镜头视频片段中所有视频帧对应am

r

的算术平均值;

[0089]

镜头视频片段中所有视频帧对应am

g

的算术平均值;

[0090]

镜头视频片段中所有视频帧对应am

b

的算术平均值;

[0091]

a

rgb

:将按行顺序堆叠的数组;

[0092]

c

max

:经过k

‑

means聚类后拥有镜头视频片段最多的一类;

[0093]

th

bs

:用于区分候选基准镜头和所有其他镜头的阈值;

[0094]

cbs:候选基准镜头视频片段集合;

[0095]

s

fm

:cbs中具有视频帧数最多的镜头视频片段;

[0096]

镜头视频片段s

fm

对应的

[0097]

镜头视频片段s

fm

对应的

[0098]

镜头视频片段s

fm

对应的

[0099]

与的百分误差;

[0100]

与的百分误差;

[0101]

与的百分误差;

[0102]

th

gs

:用于区分比赛镜头和非比赛镜头的阈值;

[0103]

s’:比赛镜头视频片段集合。

[0104]

步骤一:切分视频为视频镜头片段,并将视频按图片形式逐帧保存,得到s

[0105]

步骤二:计算所有视频帧的am

r

,am

g

,am

b

[0106]

步骤三:计算所有镜头视频片段的r

r

,r

g

,r

b;

和a

rgb

[0107]

步骤四:对所有镜头视频片段对应的a

rgb

进行k

‑

means聚类,并找出c

max

[0108]

步骤五:对c

max

中所有镜头视频片段进行如下操作:如果r

r

,r

g

,r

b

中至少有一个小于等于th

bs

,则将该镜头视频片段存入cbs

[0109]

步骤六:找到

[0110]

步骤七:计算所有镜头视频片段的并对所有镜头视频片段进行如下操作:如果均小于等于th

gs

,则将其存入s’。

[0111]

取值:th

bs

=100,th

gs

=15%。

[0112]

利用python图像处理库pil的imagestat模块中的mean属性,可以计算单一镜头视频片段内每帧的三个通道像素值的平均值am

r

,am

g

,am

b

。公式如下:

[0113][0114]

式中,r,g,b分别为视频帧中像素点对应的rgb颜色像素值,n为像素点个数。

[0115][0116]

式中,n为单一镜头视频片段内包含的视频帧个数。

[0117][0118][0119][0120]

本发明利用颜色特征来提取团队体育视频的比赛镜头,利用整幅视频帧的主色差异来剔除特写、场外镜头,而保留下视频中主要的比赛镜头。已有的相关工作中,镜头的分类往往专注于场地本身,本方法不拘泥于这种常规思想,提出了一种新思路。首先该方法不受限于场地因素,可适用于多项团队体育运动,同时这一方法也可以很好地弥补镜头边界检测方法中的部分误检:若非比赛镜头中存在错误切分,整个镜头也会被识别出来并移除,不会对后续视频的研究分析产生影响。所以本方法可提取整个团队体育视频中最主要的比赛镜头部分,为后续的语义事件检测及摘要生成奠定了很好的结构化基础。

[0121]

为检验本方法的效果,将本方法应用于sportkf数据集,并将5段足球视频与于俊清等提出的方法作查全率与查准率的比较,其中查全率与查准率的计算公式如下:

[0122]

查全率=(实检数

‑

误检数)/应检数

[0123]

查准率=(实检数

‑

误检数)/实检数

[0124]

对于提取出的比赛镜头,四种团队体育运动的查全率为100%,查准率为86.67%。而针对于足球视频,于俊清等提出的方法的查全率为93.2%,而本方法的查全率达到了100%;于俊清等提出的方法的查准率为88.7%,而本方法的查全率达到了93.4%。

[0125]

实验结果表明,本方法对于比赛镜头的检测与识别取得了较好的效果,相对于较具有代表性的于俊清等提出的方法,在查全率和查准率方面均有所提高。

附图说明

[0126]

图1主流程图

[0127]

图2镜头平移缩放示意图

[0128]

图3候选关键帧提取示意图

[0129]

图4层次聚类树状图

[0130]

图5代表性关键帧提取流程图

[0131]

图6(a)第12126号帧(b)第12127号帧

[0132]

图7(a)第11263号帧(b)第11274号帧

[0133]

图8(a)第11263号帧对应的全局光流图

[0134]

(b)第11274号帧对应的全局光流图

[0135]

图9(a)第11263号帧对应的hsi颜色空间下的全局光流图

[0136]

(b)第11274号帧对应的hsi颜色空间下的全局光流图

[0137]

图10(a)第11263号帧对应全局光流图的hi通道二维直方图

[0138]

(b)第11274号帧对应全局光流图的hi通道二维直方图

[0139]

图11流程图

[0140]

图12sportkf数据集视频封面

[0141]

图13远镜头

[0142]

图14特写镜头

[0143]

图15logo镜头

具体实施方式

[0144]

以输入一段时长7分钟,帧宽度640,帧高度360,帧率30帧/秒的nba比赛视频为例(以下具体数值均取小数点后2位,四舍五入)。

[0145]

步骤1:

[0146]

输入:原始团队体育视频(本例含共33个镜头,12593帧)

[0147]

输出:不含广告、特写镜头等相对冗余内容的比赛镜头视频片段集合(包含序号2,4,6,9,13,15,17,21,25,27,31共11个镜头,均为比赛镜头,且并没有漏检)。

[0148]

步骤2:

[0149]

输入:比赛镜头视频片段的视频帧

[0150]

输出:视频帧的全局光流场

[0151]

光流是空间运动物体在观察成像平面上的像素运动的瞬时速度,是利用图像序列中像素在时间域上的变化以及相邻帧之间的相关性来找到上一帧跟当前帧之间存在的对

应关系,从而计算出的相邻帧之间物体的运动信息。如输入两幅连续帧,图6左图为第12126号帧,图6右图为第12127号帧,那么对比可得第12127号帧对应的全局光流场。

[0152]

本例中第12127号帧的全局光流场为一个640

×

360的二维数组,其中每一个数组对应该点像素值的全局光流值。以该光流场的四个角点的全局光流值为例:左上(2.38,1.73),左下(2.38,

‑

2.07),右下(

‑

1.58,

‑

2.07),右上(

‑

1.58,1.73)。

[0153]

步骤3:

[0154]

输入:视频帧四个角点的全局光流值

[0155]

输出:全局运动统计特征(包括镜头的缩放量和平移量)

[0156]

以第12127号帧为例,其四个角点的全局光流值为:左上(2.38,1.73),左下(2.38,

‑

2.07),右下(

‑

1.58,

‑

2.07),右上(

‑

1.58,1.73)。即x

tl

=2.38,y

tl

=1.73,x

br

=

‑

1.58,y

br

=

‑

2.07,

[0157]

依据公式(1)可计算出x

zoom

≈1.98

[0158]

依据公式(2)可计算出y

zoom

≈1.90

[0159]

依据公式(3)可计算出mag

zoom

≈2.74

[0160]

依据公式(4)可计算出x

trans

≈0.40

[0161]

依据公式(5)可计算出y

tran

≈

‑

0.17

[0162]

依据公式(6)可计算出dis

trans

≈0.43

[0163]

步骤4:

[0164]

输入:比赛镜头视频片段集合

[0165]

输出:细粒度视频片段集合

[0166]

trans_con=sgn(x

trans

(frame

i

)

·

x

trans

(frame

i+1

))

[0167]

以第12126号帧和第12127号帧为例,第12126号帧对应的x

trans

=

‑

0.18,而第12127号帧对应的x

trans

=0.40,则x

trans

(12126)

·

x

trans

(12127)乘积为负,故trans_con=

‑

1(sgn(x)函数返回x的符号,x>0,则sgn(x)=1;x=0,则sgn(x)=0;x<0,则sgn(x)=

‑

1),则需要将第12126号帧和第12127号帧分隔开,第12126号帧属于序号30镜头的第17细粒度片段,而第12127号帧属于序号30镜头的第18细粒度片段。其对应的事件为失误后对方的快攻,存在攻防转换。

[0168]

步骤5:

[0169]

输入:细粒度视频片段集合的所有视频帧

[0170]

输出:候选关键帧集

[0171]

以图3对应的第350号帧至480号帧的曲线(图3所示完整曲线)为例,提取出对应“跳球”事件的为第360号帧。找到f1=359,f3=360,f2=361,此时mag

zoom

(f1)=3.78,mag

zoom

(f3)=6.10,mag

zoom

(f2)=3.54,则f3=360为mag

zoom

(f)曲线的一个极大值对应的帧号;dis

trans

(f1)=3.59,dis

trans

(f3)=5.69,dis

trans

(f2)=3.31,则f3=360为dis

trans

(f)曲线的一个极大值,故f3=360既为mag

zoom

(f)曲线的极大值对应的帧号,又是dis

trans

(f)曲线的极大值对应的帧号,则提取第360号帧存入候选关键帧集。

[0172]

本例中med设为20,如遍历序号为20镜头的第1个细粒度视频片段时,找到k1=7107,k2=7191,则满足k2‑

k1≥med,故提取f

m

=(7107+7191)|2+1=7150的视频帧(对应“罚篮”事件),按帧号序列存入候选关键帧集中。

[0173]

步骤6:

[0174]

输入:候选关键帧集

[0175]

输出:最终关键帧集

[0176]

基于时空一致性的代表性关键帧提取:

[0177]

候选关键帧集中,以序号为30的镜头视频片段的第9细粒度片段中的11263号帧与11274号帧为例,这两帧为相邻候选关键帧。

[0178]

则彩色编码后的图像如图8所示。

[0179]

转换为hsi颜色空间后的图像如图9所示。

[0180]

hsi颜色空间的全局光流图像对应的hi通道二维直方图如图10所示。

[0181]

计算得这两相邻候选关键帧全局光流图hi通道二维直方图的巴氏距离b=0.38;

[0182]

本例中th

b

设为0.22,而0.38>0.22,故提取11263号帧(对应事件两分上篮刚结束)与11274号帧(对应事件篮板刚开始)。

[0183]

基于层次聚类的代表性关键帧提取:

[0184]

以序号为30的镜头视频片段的第9细粒度片段为例,其聚类过程如图4所示。本例中th

hc

设为4.00,即簇间距离阈值设置为4.00,图4中以虚线所示可划分为5个聚类簇,从左至右第一簇包含对应帧号为11111,11116,11121,11124,11138,11260,11263,11274,共8幅全局光流图的对应数组,第二簇包含对应帧号为11150共1幅全局光流图的对应数组,第三簇包含对应帧号为11221,11241共2幅全局光流图的对应数组,第四簇包含对应帧号为11173共1幅全局光流图的对应数组,第五簇包含对应帧号为11155,11197,11189,11210共4幅全局光流图的对应数组。

[0185]

第一簇中,与每个数组距离最小的数组对应的关键帧号为11260,第二簇中对应帧号为11150,第三簇中对应帧号为11221,第四簇中对应帧号为11173,第五簇中对应帧号为11155。

[0186]

提取后检测序号为30的镜头视频片段的第9细粒度片段的首末关键帧是否被提取,即对应帧号为11111与11274号帧,这两帧并未被提取,故提取。

[0187]

将上述提取出的关键帧取并集,如11274号帧,在基于时空一致性的代表性关键帧提取中被提取,基于层次聚类的代表性关键帧提取中同样被提取,故移除重复的帧,则可得到最终的关键帧集,含523帧,占原始帧数12593的4.15%,即去除了95.85%的冗余帧。

[0188]

将本发明(kegms)与两种代表性关键帧提取方案进行比较,包括mendi等提出的基于运动特征的算法和vennila等提出的基于颜色特征的算法(sfke)。本发明提供了两组结果,一组具有高f值(th

b

=0.26,th

hc

=3.80);另一组具有高召回率(th

b

=0.22,th

hc

=4.00),且不关注f值。比较结果示于表1中。

[0189]

表1对比实验

[0190] prfmendi0.070.850.129sfke0.300.600.398kegms(高f值)0.310.760.441kegms(高召回)0.100.980.174

[0191]

可以发现,高召回率的kegms获得最高的召回率0.98,高于相比较的算法至少

均小于等于th

gs”的条件,故存入s’;相反,如图14所在镜头(序号为3),对应的并不满足

““

均小于等于th

gs”的条件,故并不存入s’;本例中最终的结果比赛镜头视频片段集合s’包含序号2,4,6,9,13,15,17,21,25,27,31共11个镜头,均为比赛镜头,且并没有漏检。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1