基于多通道数据特征融合的人脸识别活体检测方法和装置与流程

1.本发明涉及机器视觉技术领域,尤其涉及一种基于多通道数据特征融合的人脸识别活体检测方法和装置。

背景技术:

2.目前,人脸识别技术日趋成熟,商业化应用愈加广泛,然而人脸极易用照片、视频等方式进行复制,为防止恶意者伪造和窃取他人的人脸照片或视频用于身份认证,需要研发人脸识别活体检测技术,即判断提交的生物特征是否来自有生命的个体。

3.人脸识别活体检测技术在实际商用化场景中的需求日益强烈,目前基于3d摄像头的人脸识别活体检测算法是设计多个网络分别输入3d摄像头采集的各种数据,多个网络的结果串联得出是否活体的判断,或者,利用其中部分数据主要是深度数据做软件算法方案来判断活体。

4.现有方案一方面是总计算量大、总耗时长,另外,判断精度不够高。

技术实现要素:

5.针对现有技术中的问题,本发明提供一种基于多通道数据特征融合的人脸识别活体检测方法和装置、电子设备以及计算机可读存储介质,能够至少部分地解决现有技术中存在的问题。

6.为了实现上述目的,本发明采用如下技术方案:

7.第一方面,提供一种基于多通道数据特征融合的人脸识别活体检测方法,包括:

8.获取待检测图像的rgb数据、ir灰度数据以及depth深度数据,该rgb数据包括各像素的r值、g值、b值,该ir灰度数据包括各像素的gray值,该depth深度数据包括各像素的depth值;

9.将该待检测图像的各像素的r值、g值、b值、gray值以及depth值融合为4个特征值得到该待检测图像的特征数据;

10.将该特征数据作为检测样本输入预训练的深度学习神经网络模型,并将该深度学习神经网络模型的输出作为该待检测图像是否含有活体的检测结果。

11.进一步地,该将该待检测图像的各像素的r值、g值、b值、gray值以及depth值融合为4个特征值包括:

12.计算一像素的r值与gray值的平均值作为第一特征值;

13.计算该像素的g值与gray值的平均值作为第二特征值;

14.计算该像素的b值与gray值的平均值作为第三特征值,并将该像素的depth值作为第四特征值;

15.其中,该待检测图像的各像素对应的4个特征值组成该待检测图像的特征数据。

16.进一步地,该将该待检测图像的各像素的r值、g值、b值、gray值以及depth值融合为4个特征值得到该待检测图像的特征数据之前,还包括:

17.根据该待检测图像的rgb数据检测该待检测图像中的人脸;

18.若该待检测图像中不含人脸则结束本次检测。

19.进一步地,该将该待检测图像的各像素的r值、g值、b值、gray值以及depth值融合为4个特征值得到该待检测图像的特征数据之前,还包括:

20.根据rgb数据检测出的rgb人脸位置分别定位ir人脸位置和depth人脸位置,并根据人脸位置分别抠取对应的人脸框;

21.将抠取的rgb人脸框、ir人脸框以及depth人脸框分别缩放到预设大小,并分别获取缩放后的rgb人脸框、ir人脸框以及depth人脸框内对应的rgb数据、ir灰度数据以及depth深度数据,作为特征融合得到特征数据的数据基础。

22.进一步地,该将该待检测图像的各像素的r值、g值、b值、gray值以及depth值融合为4个特征值得到该待检测图像的特征数据之前,还包括:

23.根据数据采集设备的出厂标定信息对该待检测图像的rgb数据、ir灰度数据以及depth深度数据进行像素对齐。

24.进一步地,该深度学习神经网络模型为cnn模型。

25.进一步地,该cnn模型为轻量级网络模型mobilenet v2。

26.第二方面,提供一种基于多通道数据特征融合的人脸识别活体检测装置,包括:

27.数据获取模块,获取待检测图像的rgb数据、ir灰度数据以及depth深度数据,该rgb数据包括各像素的r值、g值、b值,该ir灰度数据包括各像素的gray值,该depth深度数据包括各像素的depth值;

28.特征提取模块,将该待检测图像的各像素的r值、g值、b值、gray值以及depth值融合为4个特征值得到该待检测图像的特征数据;

29.活体检测模块,将该特征数据作为检测样本输入预训练的深度学习神经网络模型,并将该深度学习神经网络模型的输出作为该待检测图像是否含有活体的检测结果。

30.第三方面,提供一种基于多通道特征融合的人脸识别活体检测方法,包括:

31.获取待检测图像的rgb数据、depth深度数据,所述rgb数据包括各像素的r值、g值、b值,所述depth深度数据包括各像素的depth值;

32.将所述待检测图像的各像素的r值、g值、b值、depth值融合为四通道特征值得到所述待检测图像的特征数据;

33.将所述特征数据作为检测样本输入预训练的深度学习神经网络模型,并将所述深度学习神经网络模型的输出作为所述待检测图像是否含有活体的检测结果。

34.进一步地,所述将所述待检测图像的各像素的r值、g值、b值、depth值融合为四通道特征值包括:

35.将一像素的r值作为第一特征值;

36.将所述像素的g值作为第二特征值;

37.将所述像素的b值作为第三特征值;

38.将所述像素的depth值作为第四特征值;

39.其中,所述待检测图像的各像素对应的4个特征值组成所述待检测图像的特征数据。

40.进一步地,所述将所述待检测图像的各像素的r值、g值、b值、depth值融合为四通

道特征值得到所述待检测图像的特征数据之前,还包括:

41.根据所述待检测图像的rgb数据检测所述待检测图像中的人脸;

42.若所述待检测图像中不含人脸则结束本次检测。

43.进一步地,所述将所述待检测图像的各像素的r值、g值、b值、depth值融合为四通道特征值得到所述待检测图像的特征数据之前,还包括:

44.根据rgb数据检测出的rgb人脸位置定位depth人脸位置,并根据人脸位置抠取对应的人脸框;

45.将抠取的rgb人脸框、depth人脸框分别缩放到预设大小,并分别获取缩放后的rgb人脸框、depth人脸框内对应的rgb数据、depth深度数据,作为特征融合得到特征数据的数据基础。

46.进一步地,所述将所述待检测图像的各像素的r值、g值、b值、depth值融合为四通道特征值得到所述待检测图像的特征数据之前,还包括:

47.根据数据采集设备的出厂标定信息对所述待检测图像的rgb数据、depth深度数据进行像素对齐。

48.进一步地,所述深度学习神经网络模型为cnn模型。

49.进一步地,所述cnn模型为轻量级网络模型mobilenet v2。

50.第四方面,提供一种基于多通道特征融合的人脸识别活体检测装置,包括:

51.数据获取模块,获取待检测图像的rgb数据、depth深度数据,所述rgb数据包括各像素的r值、g值、b值,所述depth深度数据包括各像素的depth值;

52.特征提取模块,将所述待检测图像的各像素的r值、g值、b值、depth值融合为四通道特征值得到所述待检测图像的特征数据;

53.活体检测模块,将所述特征数据作为检测样本输入预训练的深度学习神经网络模型,并将所述深度学习神经网络模型的输出作为所述待检测图像是否含有活体的检测结果。

54.第五方面,提供一种电子设备,包括存储器、处理器及存储在存储器上并可在处理器上运行的计算机程序,该处理器执行该程序时实现上述的基于多通道数据特征融合的人脸识别活体检测方法的步骤。

55.第六方面,提供一种计算机可读存储介质,其上存储有计算机程序,该计算机程序被处理器执行时实现上述的基于多通道数据特征融合的人脸识别活体检测方法的步骤。

56.本发明提供一种基于多通道数据特征融合的人脸识别活体检测方法和装置,该方法包括:获取待检测图像的rgb数据、ir灰度数据以及depth深度数据,该rgb数据包括各像素的r值、g值、b值,该ir灰度数据包括各像素的gray值,该depth深度数据包括各像素的depth值;将该待检测图像的各像素的r值、g值、b值、gray值以及depth值融合为4个特征值得到该待检测图像的特征数据;将该特征数据作为检测样本输入预训练的深度学习神经网络模型,并将该深度学习神经网络模型的输出作为该待检测图像是否含有活体的检测结果,其中,通过将待检测图像的各像素的r值、g值、b值、gray值以及depth值5通道数据融合为4个特征值,使用融合后的数据作为深度学习神经网络模型的输入,利用一个深度学习神经网络模型实现人脸识别活体检测,提高神经网络的复用度,降低总计算量和总耗时,提高了判断精度。

57.另外,本发明提供的另一种基于多通道特征融合的人脸识别活体检测方法和装置,该方法包括:获取待检测图像的rgb数据、depth深度数据,所述rgb数据包括各像素的r值、g值、b值,所述depth深度数据包括各像素的depth值;将所述待检测图像的各像素的r值、g值、b值、depth值融合为四通道特征值得到所述待检测图像的特征数据;将所述特征数据作为检测样本输入预训练的深度学习神经网络模型,并将所述深度学习神经网络模型的输出作为所述待检测图像是否含有活体的检测结果,其中,通过将待检测图像的各像素的r值、g值、b值、depth值融合为四通道特征值,使用融合后的数据作为深度学习神经网络模型的输入,利用一个深度学习神经网络模型实现人脸识别活体检测,提高神经网络的复用度,降低总计算量和总耗时,提高了判断精度。

58.为让本发明的上述和其他目的、特征和优点能更明显易懂,下文特举较佳实施例,并配合所附图式,作详细说明如下。

附图说明

59.为了更清楚地说明本申请实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图是本申请的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。在附图中:

60.图1为本发明实施例中的服务器s1与客户端设备b1之间的架构示意图;

61.图2为本发明实施例中的服务器s1、客户端设备b1及数据库服务器s2之间的架构示意图;

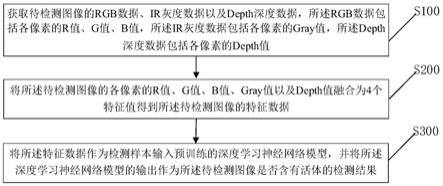

62.图3是本发明实施例中的基于五通道数据特征融合的人脸识别活体检测方法的流程示意图一;

63.图4示出了本发明实施例中步骤s200的具体步骤;

64.图5是本发明实施例中的基于五通道数据特征融合的人脸识别活体检测方法的流程示意图二;

65.图6是本发明实施例中的基于五通道数据特征融合的人脸识别活体检测方法的流程示意图三;

66.图7是本发明实施例中的基于五通道数据特征融合的人脸识别活体检测方法的流程示意图四;

67.图8是本发明实施例中的基于五通道数据特征融合的人脸识别活体检测装置的结构框图;

68.图9是本发明实施例中的基于rgbd四通道特征融合的人脸识别活体检测方法的流程示意图一;

69.图10示出了本发明实施例中步骤s200的具体步骤;

70.图11是本发明实施例中的基于rgbd四通道特征融合的人脸识别活体检测方法的流程示意图二;

71.图12是本发明实施例中的基于rgbd四通道特征融合的人脸识别活体检测方法的流程示意图三;

72.图13是本发明实施例中的基于rgbd四通道特征融合的人脸识别活体检测方法的

流程示意图四;

73.图14是本发明实施例中的基于rgbd四通道特征融合的人脸识别活体检测装置的结构框图;

74.图15为本发明实施例电子设备的结构图。

具体实施方式

75.为了使本技术领域的人员更好地理解本申请方案,下面将结合本申请实施例中的附图,对本申请实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本申请一部分的实施例,而不是全部的实施例。基于本申请中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都应当属于本申请保护的范围。

76.本领域内的技术人员应明白,本发明的实施例可提供为方法、系统、或计算机程序产品。因此,本发明可采用完全硬件实施例、完全软件实施例、或结合软件和硬件方面的实施例的形式。而且,本发明可采用在一个或多个其中包含有计算机可用程序代码的计算机可用存储介质(包括但不限于磁盘存储器、cd

‑

rom、光学存储器等)上实施的计算机程序产品的形式。

77.需要说明的是,本申请的说明书和权利要求书及上述附图中的术语“包括”和“具有”以及他们的任何变形,意图在于覆盖不排他的包含,例如,包含了一系列步骤或单元的过程、方法、系统、产品或设备不必限于清楚地列出的那些步骤或单元,而是可包括没有清楚地列出的或对于这些过程、方法、产品或设备固有的其它步骤或单元。

78.需要说明的是,在不冲突的情况下,本申请中的实施例及实施例中的特征可以相互组合。下面将参考附图并结合实施例来详细说明本申请。

79.人脸识别活体检测技术在实际商用化场景中的需求日益强烈,目前基于3d摄像头的人脸识别活体检测算法是设计多个网络分别输入3d摄像头采集的各种数据,多个网络的结果串联得出是否活体的判断,或者,利用其中部分数据主要是深度数据做软件算法方案来判断活体。现有方案一方面是总计算量大、总耗时长,另外,判断精度不够高。

80.为至少部分解决现有技术中的上述技术问题,本发明实施例提供了一种基于多通道数据特征融合的人脸识别活体检测方法,提高神经网络的复用度,降低总计算量和总耗时,提高了判断精度。

81.有鉴于此,本申请提供了一种基于多通道数据特征融合的人脸识别活体检测装置,该装置可以为一种服务器s1,参见图1,该服务器s1可以与至少一个客户端设备b1通信连接,所述客户端设备b1可以将待检测图像的数据发送至所述服务器s1,所述服务器s1可以在线接收待检测图像。一种方式为:所述服务器s1可以在线或者离线对获取的待检测图像进行预处理,获取待检测图像的rgb数据、ir灰度数据以及depth深度数据,所述rgb数据包括各像素的r值、g值、b值,所述ir灰度数据包括各像素的gray值,所述depth深度数据包括各像素的depth值;将所述待检测图像的各像素的r值、g值、b值、gray值以及depth值融合为4个特征值得到所述待检测图像的特征数据;将所述特征数据作为检测样本输入预训练的深度学习神经网络模型,并将所述深度学习神经网络模型的输出作为所述待检测图像是否含有活体的检测结果。而后,所述服务器s1可以将待检测图像是否含有活体的检测结果

在线发送至所述客户端设备b1。所述客户端设备b1可以在线接收所述待检测图像是否含有活体的检测结果。

82.另一种方式为:所述服务器s1可以在线或者离线对获取的待检测图像进行预处理,获取待检测图像的rgb数据、depth深度数据,所述rgb数据包括各像素的r值、g值、b值,所述depth深度数据包括各像素的depth值;将所述待检测图像的各像素的r值、g值、b值、depth值融合为四通道特征值得到所述待检测图像的特征数据;将所述特征数据作为检测样本输入预训练的深度学习神经网络模型,并将所述深度学习神经网络模型的输出作为所述待检测图像是否含有活体的检测结果。而后,所述服务器s1可以将待检测图像是否含有活体的检测结果在线发送至所述客户端设备b1。所述客户端设备b1可以在线接收所述待检测图像是否含有活体的检测结果。

83.另外,参见图2,所述服务器s1还可以与至少一个数据库服务器s2通信连接,所述数据库服务器s2用于存储训练样本集。所述数据库服务器s2在线将所述训练样本集发送至所述服务器s1,所述服务器s1可以在线接收所述训练样本集,而后应用所述训练样本集对所述模型进行模型训练。

84.基于上述内容,所述数据库服务器s2还可以用于存储测试用样本数据。所述数据库服务器s2在线将测试用样本数据发送至所述服务器s1,所述服务器s1可以在线接收所述测试用样本数据,而后应用测试样本对所述模型进行模型测试,并将该模型的输出作为测试结果,再基于所述测试结果及对应的已知判断结果,判断当前模型是否符合预设要求,若是,则将当前模型作为用于基于五通道数据特征融合的人脸识别活体检测的目标模型;若当前模型不符合所述预设要求,则对当前模型进行优化和/或应用更新后的训练样本集重新对该模型进行模型训练。

85.基于上述内容,所述客户端设备b1可以具有显示界面,使得用户能够根据界面查看所述服务器s1发送的所述待检测图像是否含有活体的检测结果。

86.可以理解的是,所述客户端设备b1可以包括智能手机、平板电子设备、网络机顶盒、便携式计算机、台式电脑、个人数字助理(pda)、车载设备、智能穿戴设备等。其中,所述智能穿戴设备可以包括智能眼镜、智能手表、智能手环等。

87.在实际应用中,进行基于五通道数据特征融合的人脸识别活体检测的部分可以在如上述内容所述的服务器s1侧执行,即,如图1所示的架构,也可以所有的操作都在所述客户端设备b1中完成,且该所述客户端设备b1可以直接与数据库服务器s2进行通信连接。具体可以根据所述客户端设备b1的处理能力,以及用户使用场景的限制等进行选择。本申请对此不作限定。若所有的操作都在所述客户端设备b1中完成,所述客户端设备b1还可以包括处理器,用于进行基于五通道数据特征融合的人脸识别活体检测的具体处理。

88.所述服务器与所述客户端设备之间可以使用任何合适的网络协议进行通信,包括在本申请提交日尚未开发出的网络协议。所述网络协议例如可以包括tcp/ip协议、udp/ip协议、http协议、https协议等。当然,所述网络协议例如还可以包括在上述协议之上使用的rpc协议(remote procedure call protocol,远程过程调用协议)、rest协议(representational state transfer,表述性状态转移协议)等。

89.在本申请的一个或多个实施例中,所述测试用样本数据为未包含在用于模型训练的样本中的,且针对所述测试用样本,需获取其已知判断结果。

90.图3是本发明实施例中的基于五通道数据特征融合的人脸识别活体检测方法的流程示意图一;如图3所示,该基于五通道数据特征融合的人脸识别活体检测方法可以包括以下内容:

91.步骤s100:获取待检测图像的rgb数据、ir灰度数据以及depth深度数据,所述rgb数据包括各像素的r值、g值、b值,所述ir灰度数据包括各像素的gray值,所述depth深度数据包括各像素的depth值;

92.其中,通过3d摄像头采集待检测图像的rgb数据、ir灰度数据以及depth深度数据,值得说明的是,3d摄像头产品目前有双目结构光(rgb+ir)方案、tof(单个ir摄像头)方案,本发明实施例可采用tof方案外加rgb摄像头的结构形式。

93.具体地,对彩色rgb和红外ir添加帧同步信号,同步采集rgb数据和ir灰度数据,depth数据是3d深度生成算法对该帧数据进行处理生成,具体地,可基于rgb数据和ir灰度数据生成depth数据,或者根据ir灰度数据生成depth数据。tof方案只需要ir灰度数据即可生成depth数据。

94.步骤s200:将所述待检测图像的各像素的r值、g值、b值、gray值以及depth值融合为4个特征值得到所述待检测图像的特征数据;

95.值得说明的是,gray是采用色彩认知的一种称呼,也就是说图像是灰度图,y是该数据从属的一种格式yuv中的y部分,属于专业图像格式中的信息,本发明实施例中利用的gray值也可以称为y/gray或y(gray)。

96.步骤s300:将所述特征数据作为检测样本输入预训练的深度学习神经网络模型,并将所述深度学习神经网络模型的输出作为所述待检测图像是否含有活体的检测结果。

97.具体地,将整幅图像中各个像素的数据都进行五通道融合,每个像素点都由融合后的4个特征值表征,融合后的数据作为检测样本输入预训练的深度学习神经网络模型,将深度学习神经网络模型作为一个分类器,得到的分类结果可以一是0或1,可以用0表征待检测图像中不含活体,用1表征待检测图像中含活体,相反亦可,本发明实施例对此不作限制。

98.通过上述技术方案,将待检测图像的各像素的r值、g值、b值、gray值以及depth值5通道数据融合为4个特征值,使用融合后的数据作为深度学习神经网络模型的输入,利用一个深度学习神经网络模型实现人脸识别活体检测,提高神经网络的复用度,降低总计算量和总耗时,提高了判断精度。

99.在一个可选的实施例中,参见图4,该步骤s200可以包括以下内容:

100.步骤s210:计算一像素的r值与gray值的平均值作为第一特征值;

101.步骤s220:计算所述像素的g值与gray值的平均值作为第二特征值;

102.步骤s230:计算所述像素的b值与gray值的平均值作为第三特征值,并将所述像素的depth值作为第四特征值;

103.其中,所述待检测图像的各像素对应的4个特征值组成所述待检测图像的特征数据。

104.具体地,将五通道数据融合成四通道数据(c1,c2,c3,c4),其中,c1=(r+gray)/2,c1=(g+gray)/2,c3=(b+gray)/2,c4=depth。

105.通过采用上述技术方案,融合rgb数据、ir灰度数据以及depth深度数据三种数据中的五通道数据,使用融合后的数据作为神经网络的输入,提高神经网络的复用度,有效降

低该活体检测功能的总计算量和总耗时,同时将各路数据信息都做了融合使用保留了数据的互补性优势。

106.在一个可选的实施例中,参见图5,该基于五通道数据特征融合的人脸识别活体检测方法还可以包括:

107.步骤s400:根据所述待检测图像的rgb数据检测所述待检测图像中的人脸;

108.若所述待检测图像中不含人脸则结束本次检测;否则,执行步骤s200。

109.其中,采用人脸检测算法进行人脸检测。

110.通过采用上述技术方案,能够在进行后续检测计算过程之前,预先判断待检测图像中是否包含人脸,如果没有人脸则不存在活体检测的必要,因此可提前结束流程,避免在待检测图像中没有人脸时浪费计算资源,进一步提高效率降低运算量。

111.在一个可选的实施例中,参见图6,该基于五通道数据特征融合的人脸识别活体检测方法还可以包括:

112.步骤s500:根据rgb数据检测出的rgb人脸位置分别定位ir人脸位置和depth人脸位置,并根据人脸位置分别抠取对应的人脸框;

113.步骤s600:将抠取的rgb人脸框、ir人脸框以及depth人脸框分别缩放到预设大小,并分别获取缩放后的rgb人脸框、ir人脸框以及depth人脸框内对应的rgb数据、ir灰度数据以及depth深度数据,作为特征融合得到特征数据的数据基础。

114.具体地,通过定位并抠取人脸rect(矩形区域)后,分别将各路数据中抠取的人脸缩放到相同的预定大小,比如64

×

64、128

×

128等,而后对缩放后的数据进行通道融合,以进一步减少计算量,提高检测精度。

115.在一个可选的实施例中,参见图7,该基于五通道数据特征融合的人脸识别活体检测方法还可以包括:

116.步骤s700:根据数据采集设备的出厂标定信息对所述待检测图像的rgb数据、ir灰度数据以及depth深度数据进行像素对齐。

117.其中,通过将rgb、ir、depth数据进行像素对齐,使每个像素位置的像素属于相同的像素目标,能够使得后续根据rgb中人脸位置精准定位ir和depth数据中的人脸位置提供帮助,进一步提高活体检测的精度和稳定性。

118.通过采用上述技术方案,通过3d摄像头采集的rgb,depth和对应ir摄像头的gray数据做像素对齐后融合进行融合,融合是将三种对齐后数据做像素级别的叠加rgb+d+g,以rgb数据为例,它是一种三通道的数据,每个像素有r+g+b三种信息,在此基础上融合depth和gray数据后每个像素就是r+g+b+depth+gray五通道数据,然后将融合后的数据输入到定制优化的深度学习cnn网络,该网络输出结果为活体或非活体。

119.在一个可选的实施例中,该深度学习神经网络模型为cnn模型。

120.cnn卷积神经网络适合对图像数据结构进行数据分类和回归,举例来说,本发明实施例可以选用移动端轻量级的神经网络结构mobilenet v2,另外,还可以对mobilenet v2做深入的匹配训练任务的裁剪和优化,使得最终的浮点计算量为1.5mflops。

121.在一个可选的实施例中,该基于五通道数据特征融合的人脸识别活体检测方法还可以包括:模型训练步骤。

122.在模型训练过程中可以针对使用场景采集多组训练数据,比如1万组左右的训练

数据,10000组左右的测试数据(正负样本比例6:4),正样本数据6000组,负样本数据4000组左右,训练过程中通过对每组数据中rgb数据随机加入亮度、对比度、噪音等进行数据expand,对y/gray数据加入亮度、噪音;深度数据不做任何数据扩充;训练后的模型在测试集上测试精度达到非常高的精度水平。

123.具体地,利用上述提供的技术方案,先对训练数据进行人脸检测、像素对齐、人脸区域抠取、数据缩放、数据特征提取融合后,输入预建立的网络模型中,将网络模型的输出与对应训练样本的标签比较,而后反向调节网络模型的参数,实现模型训练。

124.值得说明的是,本发明实施例提供的基于五通道数据特征融合的人脸识别活体检测方案,在单算法模型的前提下充分利用了已有数据的融合信息,可以最大程度的降低训练样本的数量的前提下达到符合商用化预定的训练精度。

125.在一个可选的实施例中,该基于五通道数据特征融合的人脸识别活体检测方法还可以包括:模型测试步骤。

126.具体地,获取预知标签(标签表示该测试样本是否含有活体人脸)的测试样本若干,将测试样本输入预训练的神经网络模型,并将模型的输出与对应的标签比较,基于此,判断预训练的神经网络模型的精度,并将模型的精度与预设要求进行比较,若满足要求,则应用该模型进行检测,若不满要求,则调整模型或者重新组织训练样本进行重训练,直至模型精度满足测试要求。

127.值得说明的是,本发明实施例提供的基于五通道数据特征融合的人脸识别活体检测方法还可以集成在图像采集处理一体的设备上,以便实时采集图像数据,实时进行图像处理。

128.基于同一发明构思,本申请实施例还提供了一种基于五通道数据特征融合的人脸识别活体检测装置,可以用于实现上述实施例所描述的方法,如下面的实施例所述。由于基于五通道数据特征融合的人脸识别活体检测装置解决问题的原理与上述方法相似,因此基于五通道数据特征融合的人脸识别活体检测装置的实施可以参见上述方法的实施,重复之处不再赘述。以下所使用的,术语“单元”或者“模块”可以实现预定功能的软件和/或硬件的组合。尽管以下实施例所描述的装置较佳地以软件来实现,但是硬件,或者软件和硬件的组合的实现也是可能并被构想的。

129.图8是本发明实施例中的基于五通道数据特征融合的人脸识别活体检测装置的结构框图。如图8所示,该基于五通道数据特征融合的人脸识别活体检测装置具体包括:数据获取模块10、特征提取模块20以及活体检测模块30。

130.数据获取模块10获取待检测图像的rgb数据、ir灰度数据以及depth深度数据,所述rgb数据包括各像素的r值、g值、b值,所述ir灰度数据包括各像素的gray值,所述depth深度数据包括各像素的depth值;

131.特征提取模块20将所述待检测图像的各像素的r值、g值、b值、gray值以及depth值融合为4个特征值得到所述待检测图像的特征数据;

132.活体检测模块30将所述特征数据作为检测样本输入预训练的深度学习神经网络模型,并将所述深度学习神经网络模型的输出作为所述待检测图像是否含有活体的检测结果。

133.通过上述技术方案,将待检测图像的各像素的r值、g值、b值、gray值以及depth值5

通道数据融合为4个特征值,使用融合后的数据作为深度学习神经网络模型的输入,利用一个深度学习神经网络模型实现人脸识别活体检测,提高神经网络的复用度,降低总计算量和总耗时,提高了判断精度。

134.图9是本发明实施例中的基于rgbd四通道特征融合的人脸识别活体检测方法的流程示意图一;如图9所示,该基于rgbd四通道特征融合的人脸识别活体检测方法可以包括以下内容:

135.步骤s100’:获取待检测图像的rgb数据、depth深度数据,所述rgb数据包括各像素的r值、g值、b值,所述depth深度数据包括各像素的depth值;

136.其中,通过3d摄像头采集待检测图像的rgb数据、depth深度数据,值得说明的是,3d摄像头产品目前有双目结构光(rgb+ir)方案、tof(单个ir摄像头)方案,本发明实施例可采用tof方案外加rgb摄像头的结构形式,也可采用双目结构光方案中的rgb+depth深度信息的形式。

137.具体地,对彩色rgb和红外ir添加帧同步信号,同步采集rgb数据和ir灰度数据,depth数据是3d深度生成算法对该帧数据进行处理生成,具体地,可基于rgb数据和ir灰度数据生成depth数据,或者根据ir灰度数据生成depth数据。tof方案只需要ir灰度数据即可生成depth数据。

138.步骤s200’:将所述待检测图像的各像素的r值、g值、b值、depth值融合为四通道特征值得到所述待检测图像的特征数据;

139.步骤s300’:将将所述特征数据作为检测样本输入预训练的深度学习神经网络模型,并将所述深度学习神经网络模型的输出作为所述待检测图像是否含有活体的检测结果。

140.具体地,将整幅图像中各个像素的数据都进行四通道融合,每个像素点都由融合后的4个特征值表征,融合后的数据作为检测样本输入预训练的深度学习神经网络模型,将深度学习神经网络模型作为一个分类器,得到的分类结果可以一是0或1,可以用0表征待检测图像中不含活体,用1表征待检测图像中含活体,相反亦可,本发明实施例对此不作限制。

141.通过上述技术方案,将待检测图像的各像素的r值、g值、b值、depth值融合为四通道特征值,使用融合后的数据作为深度学习神经网络模型的输入,利用一个深度学习神经网络模型实现人脸识别活体检测,提高神经网络的复用度,降低总计算量和总耗时,提高了判断精度。

142.在一个可选的实施例中,参见图10,该步骤s200’可以包括以下内容:

143.步骤s210’:将一像素的r值作为第一特征值;

144.步骤s220’:将所述像素的g值作为第二特征值;

145.步骤s230’:将所述像素的b值作为第三特征值;

146.步骤s240’:将所述像素的depth值作为第四特征值。

147.其中,所述待检测图像的各像素对应的4个特征值组成所述待检测图像的特征数据。

148.具体地,将rgb数据、depth深度数据融合成四通道数据(c1,c2,c3,c4),其中,c1=r,c1=g,c3=b,c4=depth。

149.通过采用上述技术方案,融合rgb数据、depth深度数据,使用融合后的数据作为神

经网络的输入,提高神经网络的复用度,有效降低该活体检测功能的总计算量和总耗时,同时将各路数据信息都做了融合使用保留了数据的互补性优势。

150.在一个可选的实施例中,参见图11,该基于rgbd四通道特征融合的人脸识别活体检测方法还可以包括:

151.步骤s400’:根据所述待检测图像的rgb数据检测所述待检测图像中的人脸;

152.若所述待检测图像中不含人脸则结束本次检测;否则,执行步骤s200’。

153.其中,采用人脸检测算法进行人脸检测。

154.通过采用上述技术方案,能够在进行后续检测计算过程之前,预先判断待检测图像中是否包含人脸,如果没有人脸则不存在活体检测的必要,因此可提前结束流程,避免在待检测图像中没有人脸时浪费计算资源,进一步提高效率降低运算量。

155.在一个可选的实施例中,参见图12,该基于rgbd四通道特征融合的人脸识别活体检测方法还可以包括:

156.步骤s500’:根据rgb数据检测出的rgb人脸位置定位depth人脸位置,并根据人脸位置抠取对应的人脸框;

157.步骤s600’:将抠取的rgb人脸框、depth人脸框分别缩放到预设大小,并分别获取缩放后的rgb人脸框、depth人脸框内对应的rgb数据、depth深度数据,作为特征融合得到特征数据的数据基础。

158.具体地,通过定位并抠取人脸rect(矩形区域)后,分别将各路数据中抠取的人脸缩放到相同的预定大小,比如64

×

64、128

×

128等,而后对缩放后的数据进行通道融合,以进一步减少计算量,提高检测精度。

159.在一个可选的实施例中,参见图13,该基于rgbd四通道特征融合的人脸识别活体检测方法还可以包括:

160.步骤s700’:根据数据采集设备的出厂标定信息对所述待检测图像的rgb数据、depth深度数据进行像素对齐。

161.其中,通过将rgb、depth进行像素对齐,使每个像素位置的像素属于相同的像素目标,能够使得后续根据rgb中人脸位置精准定位depth中的人脸位置提供帮助,进一步提高活体检测的精度和稳定性。

162.通过采用上述技术方案,通过rgb数据和depth数据做像素对齐后进行融合,融合是将两种对齐后数据做像素级别的叠加rgb+d,以rgb数据为例,它是一种三通道的数据,每个像素有r+g+b三种信息,在此基础上融合depth数据后每个像素就是r+g+b+depth四通道数据,然后将融合后的数据输入到定制优化的深度学习cnn网络,该网络输出结果为活体或非活体。

163.在一个可选的实施例中,该深度学习神经网络模型为cnn模型。

164.cnn卷积神经网络适合对图像数据结构进行数据分类和回归,举例来说,本发明实施例可以选用移动端轻量级的神经网络结构mobilenet v2,另外,还可以对mobilenet v2做深入的匹配训练任务的裁剪和优化,使得最终的浮点计算量为1.5mflops。

165.在一个可选的实施例中,该基于rgbd四通道特征融合的人脸识别活体检测方法还可以包括:模型训练步骤。

166.在模型训练过程中可以针对使用场景采集多组训练数据,比如1万组左右的训练

数据,10000组左右的测试数据(正负样本比例6:4),正样本数据6000组,负样本数据4000组左右,训练过程中通过对每组数据中rgb数据随机加入亮度、对比度、噪音等进行数据expand,深度数据不做任何数据扩充;训练后的模型在测试集上测试精度达到非常高的精度水平。

167.具体地,利用上述提供的技术方案,先对训练数据进行人脸检测、像素对齐、人脸区域抠取、数据缩放、数据特征提取融合后,输入预建立的网络模型中,将网络模型的输出与对应训练样本的标签比较,而后反向调节网络模型的参数,实现模型训练。

168.值得说明的是,本发明实施例提供的基于rgbd四通道特征融合的人脸识别活体检测方案,在单算法模型的前提下充分利用了已有数据的融合信息,可以最大程度的降低训练样本的数量的前提下达到符合商用化预定的训练精度。

169.在一个可选的实施例中,该基于rgbd四通道特征融合的人脸识别活体检测方法还可以包括:模型测试步骤。

170.具体地,获取预知标签(标签表示该测试样本是否含有活体人脸)的测试样本若干,将测试样本输入预训练的神经网络模型,并将模型的输出与对应的标签比较,基于此,判断预训练的神经网络模型的精度,并将模型的精度与预设要求进行比较,若满足要求,则应用该模型进行检测,若不满要求,则调整模型或者重新组织训练样本进行重训练,直至模型精度满足测试要求。

171.值得说明的是,本发明实施例提供的基于五通道数据特征融合的人脸识别活体检测方法还可以集成在图像采集处理一体的设备上,以便实时采集图像数据,实时进行图像处理。

172.基于同一发明构思,本申请实施例还提供了一种基于rgbd四通道特征融合的人脸识别活体检测装置,可以用于实现上述实施例所描述的方法,如下面的实施例所述。由于基于rgbd四通道特征融合的人脸识别活体检测装置解决问题的原理与上述方法相似,因此基于rgbd四通道特征融合的人脸识别活体检测装置的实施可以参见上述方法的实施,重复之处不再赘述。以下所使用的,术语“单元”或者“模块”可以实现预定功能的软件和/或硬件的组合。尽管以下实施例所描述的装置较佳地以软件来实现,但是硬件,或者软件和硬件的组合的实现也是可能并被构想的。

173.图14是本发明实施例中的基于rgbd四通道特征融合的人脸识别活体检测装置的结构框图。如图14所示,该基于rgbd四通道特征融合的人脸识别活体检测装置具体包括:数据获取模块10’、特征提取模块20’以及活体检测模块30’。

174.数据获取模块10’获取待检测图像的rgb数据、depth深度数据,所述rgb数据包括各像素的r值、g值、b值,所述depth深度数据包括各像素的depth值;

175.特征提取模块20’将所述待检测图像的各像素的r值、g值、b值、depth值融合为四通道特征值得到所述待检测图像的特征数据;

176.活体检测模块30’将所述特征数据作为检测样本输入预训练的深度学习神经网络模型,并将所述深度学习神经网络模型的输出作为所述待检测图像是否含有活体的检测结果。

177.通过上述技术方案,将待检测图像的各像素的r值、g值、b值、depth值融合为四通道特征值,使用融合后的数据作为深度学习神经网络模型的输入,利用一个深度学习神经

网络模型实现人脸识别活体检测,提高神经网络的复用度,降低总计算量和总耗时,提高了判断精度。

178.上述实施例阐明的装置、模块或单元,具体可以由计算机芯片或实体实现,或者由具有某种功能的产品来实现。一种典型的实现设备为电子设备,具体的,电子设备例如可以为个人计算机、膝上型计算机、蜂窝电话、相机电话、智能电话、个人数字助理、媒体播放器、导航设备、电子邮件设备、游戏控制台、平板计算机、可穿戴设备或者这些设备中的任何设备的组合。

179.在一个典型的实例中电子设备具体包括存储器、处理器以及存储在存储器上并可在处理器上运行的计算机程序,所述处理器执行所述程序时实现上述的基于五通道数据特征融合的人脸识别活体检测方法的步骤。

180.下面参考图15,其示出了适于用来实现本申请实施例的电子设备600的结构示意图。

181.如图15所示,电子设备600包括中央处理单元(cpu)601,其可以根据存储在只读存储器(rom)602中的程序或者从存储部分608加载到随机访问存储器(ram))603中的程序而执行各种适当的工作和处理。在ram603中,还存储有系统600操作所需的各种程序和数据。cpu601、rom602、以及ram603通过总线604彼此相连。输入/输出(i/o)接口605也连接至总线604。

182.以下部件连接至i/o接口605:包括键盘、鼠标等的输入部分606;包括诸如阴极射线管(crt)、液晶显示器(lcd)等以及扬声器等的输出部分607;包括硬盘等的存储部分608;以及包括诸如lan卡,调制解调器等的网络接口卡的通信部分609。通信部分609经由诸如因特网的网络执行通信处理。驱动器610也根据需要连接至i/o接口605。可拆卸介质611,诸如磁盘、光盘、磁光盘、半导体存储器等等,根据需要安装在驱动器610上,以便于从其上读出的计算机程序根据需要被安装如存储部分608。

183.特别地,根据本发明的实施例,上文参考流程图描述的过程可以被实现为计算机软件程序。例如,本发明的实施例包括一种计算机可读存储介质,其上存储有计算机程序,该计算机程序被处理器执行时实现下述上述的基于五通道数据特征融合的人脸识别活体检测方法的步骤。

184.在这样的实施例中,该计算机程序可以通过通信部分609从网络上被下载和安装,和/或从可拆卸介质611被安装。

185.计算机可读介质包括永久性和非永久性、可移动和非可移动媒体可以由任何方法或技术来实现信息存储。信息可以是计算机可读指令、数据结构、程序的模块或其他数据。计算机的存储介质的例子包括,但不限于相变内存(pram)、静态随机存取存储器(sram)、动态随机存取存储器(dram)、其他类型的随机存取存储器(ram)、只读存储器(rom)、电可擦除可编程只读存储器(eeprom)、快闪记忆体或其他内存技术、只读光盘只读存储器(cd

‑

rom)、数字多功能光盘(dvd)或其他光学存储、磁盒式磁带,磁带磁磁盘存储或其他磁性存储设备或任何其他非传输介质,可用于存储可以被计算设备访问的信息。按照本文中的界定,计算机可读介质不包括暂存电脑可读媒体(transitory media),如调制的数据信号和载波。

186.为了描述的方便,描述以上装置时以功能分为各种单元分别描述。当然,在实施本申请时可以把各单元的功能在同一个或多个软件和/或硬件中实现。

187.本发明是参照根据本发明实施例的方法、设备(系统)、和计算机程序产品的流程图和/或方框图来描述的。应理解可由计算机程序指令实现流程图和/或方框图中的每一流程和/或方框、以及流程图和/或方框图中的流程和/或方框的结合。可提供这些计算机程序指令到通用计算机、专用计算机、嵌入式处理机或其他可编程数据处理设备的处理器以产生一个机器,使得通过计算机或其他可编程数据处理设备的处理器执行的指令产生用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的装置。

188.这些计算机程序指令也可存储在能引导计算机或其他可编程数据处理设备以特定方式工作的计算机可读存储器中,使得存储在该计算机可读存储器中的指令产生包括指令装置的制造品,该指令装置实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能。

189.这些计算机程序指令也可装载到计算机或其他可编程数据处理设备上,使得在计算机或其他可编程设备上执行一系列操作步骤以产生计算机实现的处理,从而在计算机或其他可编程设备上执行的指令提供用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的步骤。

190.还需要说明的是,术语“包括”、“包含”或者其任何其他变体意在涵盖非排他性的包含,从而使得包括一系列要素的过程、方法、商品或者设备不仅包括那些要素,而且还包括没有明确列出的其他要素,或者是还包括为这种过程、方法、商品或者设备所固有的要素。在没有更多限制的情况下,由语句“包括一个

……”

限定的要素,并不排除在包括所述要素的过程、方法、商品或者设备中还存在另外的相同要素。

191.本领域技术人员应明白,本申请的实施例可提供为方法、系统或计算机程序产品。因此,本申请可采用完全硬件实施例、完全软件实施例或结合软件和硬件方面的实施例的形式。而且,本申请可采用在一个或多个其中包含有计算机可用程序代码的计算机可用存储介质(包括但不限于磁盘存储器、cd

‑

rom、光学存储器等)上实施的计算机程序产品的形式。

192.本申请可以在由计算机执行的计算机可执行指令的一般上下文中描述,例如程序模块。一般地,程序模块包括执行特定任务或实现特定抽象数据类型的例程、程序、对象、组件、数据结构等等。也可以在分布式计算环境中实践本申请,在这些分布式计算环境中,由通过通信网络而被连接的远程处理设备来执行任务。在分布式计算环境中,程序模块可以位于包括存储设备在内的本地和远程计算机存储介质中。

193.本说明书中的各个实施例均采用递进的方式描述,各个实施例之间相同相似的部分互相参见即可,每个实施例重点说明的都是与其他实施例的不同之处。尤其,对于系统实施例而言,由于其基本相似于方法实施例,所以描述的比较简单,相关之处参见方法实施例的部分说明即可。

194.以上所述仅为本申请的实施例而已,并不用于限制本申请。对于本领域技术人员来说,本申请可以有各种更改和变化。凡在本申请的精神和原理之内所作的任何修改、等同替换、改进等,均应包含在本申请的权利要求范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1