视频剪辑方法、装置、电子设备以及存储介质与流程

1.本公开涉及计算机信息领域,具体地,涉及一种视频剪辑方法、装置、电子设备以及存储介质。

背景技术:

2.在线下课场景下,学生会因缺课或者复习而有回看补课视频的需求。未经处理的补课录像视频会包含大量的与授课内容相关度低的内容,如果包含过多冗余信息,会浪费学生观看补课视频的时间对网络资源和存储资源造成极大的浪费,也会对网络资源和存储资源造成极大的浪费。然而在相关技术中,即使对补课录像视频进行处理,也需要人工对视频进行剪辑,不仅效率低下人力成本也较高。

技术实现要素:

3.为了解决相关技术中存在的问题,本公开提供一种视频剪辑方法、装置、电子设备以及存储介质。

4.为了实现上述目的,本公开第一方面提供一种视频剪辑方法,所述方法包括:

5.获取教学视频,所述教学视频是对教室内的课堂场景进行拍摄得到的;

6.根据所述教学视频中的图像信息和/或音频信息,确定所述教学视频中与授课内容无关的视频片段的开始时间以及结束时间;

7.根据所述开始时间以及所述结束时间,从所述教学视频中删除所述视频片段。

8.可选地,根据所述教学视频中的图像信息和音频信息,确定所述教学视频中与授课内容无关的视频片段的开始时间以及结束时间,包括:

9.确定所述图像信息中的教师是否处于点名姿态;

10.在确定所述教师处于点名姿态的情况下,将所述教师处于点名姿态对应的音频信息通过语音识别转写技术转写为文字,并将所述文字与学生名单对比,得到第一对比结果;

11.在所述第一对比结果表征所述文字与所述学生名单中的学生姓名相匹配的情况下,将确定所述图像信息中的教师处于所述点名姿态的时刻作为点名阶段的开始时间;并,

12.根据所述第一比对结果,将转写得到的文字最后一次与所述学生名单中的学生姓名相匹配的时间作为所述点名阶段的结束时间。

13.可选地,根据所述教学视频中的图像信息,确定所述教学视频中与授课内容无关的视频片段的开始时间以及结束时间,包括:

14.在确定所述教师处于点名姿态的情况下,将所述教师处于点名姿态对应的图像输入预先训练的唇语识别模型,得到教师唇语对应的文字,并将所述教师唇语对应的文字与学生名单对比,得到唇语对比结果;

15.在所述唇语对比结果表征所述教师唇语对应的文字与所述学生名单中的学生姓名相匹配的情况下,将确定所述图像信息中的教师处于所述点名姿态的时刻作为点名阶段的开始时间;并,

16.根据所述唇语比对结果,将教师唇语对应的文字最后一次与所述学生名单中的学生姓名相匹配的时间作为所述点名阶段的结束时间。

17.可选地,根据所述教学视频中的图像信息和音频信息,确定所述教学视频中与授课内容无关的视频片段的开始时间以及结束时间,包括:

18.在确定所述教师处于点名姿态的情况下,将所述教师处于点名姿态对应的图像输入预先训练的唇语识别模型得到唇语特征、将所述教师处于点名姿态对应的音频信息通过语音识别转写技术转写得到语音特征;

19.按照时间顺序,分别得到所述唇语特征以及所述语音特征的时间特征序列;

20.将所述唇语特征的时间特征序列以及所述语音特征的时间特征序列融合,再进行转写,得到教师说话内容对应的文字;

21.将所述教师说话内容对应的文字与学生名单对比,根据对比结果确定点名阶段的开始时间以及结束时间。

22.可选地,确定所述图像信息中的教师是否处于点名姿态包括:

23.根据骨骼点检测技术,确定所述图像信息中的教师是否手持手机或纸质名单;

24.根据视线检测技术,确定所述图像信息中的教师的视线是否多次在手机或纸质名单与其他位置之间进行切换;

25.在所述教师手持手机或纸质名单,且所述教师的视线多次在手机或纸质名单与其他位置之间进行切换的情况下,确定所述图像信息中的教师处于点名姿态。

26.可选地,所述根据视线检测技术,确定所述图像信息中的教师的视线是否多次在手机或纸质名单与其他位置之间进行切换包括:

27.所述根据视线检测技术,获取所述图像信息中的多个采样帧中的多个教师视线角度;

28.针对所述多个采样帧中每相邻的两个采样帧,计算所述两个采样帧中两个所述教师视线角度的余弦距离,若所述余弦距离小于视线集中阈值,则确定所述两个采样帧中教师看的是同一位置,若所述余弦距离大于视线集中阈值,则确定所述两个采样帧中教师看的是不同位置;

29.在确定所述相邻的两个采样帧中教师看的是同一位置的情况下,记录所述两个采样帧中的教师视线角度;

30.根据记录得到的教师视线角度的分布情况,确定所述教师看向手机或纸质名单的教师视线角度的角度范围;

31.根据每一所述采样帧中的教师视线角度以及所述角度范围,生成特征向量,所述特征向量中的一个特征值表征一个所述采样帧中的教师视线角度是否处于所述角度范围;

32.将所述特征向量输入预先训练完成的二分类模型,得到所述二分类模型输出的表征教师的视线是否多次在手机或纸质名单与其他位置之间进行切换的结果。

33.可选地,根据所述教学视频中的图像信息和音频信息,确定所述教学视频中与授课内容无关的视频片段的开始时间以及结束时间,包括:

34.根据所述教学视频中的图像信息确定课前准备阶段的疑似开始时刻;

35.根据所述疑似开始时刻之后的音频信息,判断所述疑似开始时刻之后的第一预设时长内是否无人说话;

36.在确定所述疑似开始时刻之后的第一预设时长内无人说话的情况下,将所述疑似开始时刻作为课前准备阶段的开始时间;并,

37.将所述开始时间之后,基于音频信息检测到的教师开始说话的时间作为所述课前准备阶段的结束时间。

38.可选地,所述教学视频中的图像信包括教学投影图像,所述根据所述教学视频中的图像信息确定课前准备阶段的疑似开始时刻,包括:

39.在确定所述图像信息中的教学投影图像保持同一画面超过第二预设时长的情况下,将所述教学投影图像开始保持所述画面的时刻为第一疑似开始时刻;或者,

40.在确定所述图像信息中教师站立在同一位置超过第三预设时长的情况下,确定所述教师站立在所述位置的时刻为第二疑似开始时刻;或者,

41.在确定所述图像信息中的学生的状态与预设的课前准备状态相匹配的情况下,将初始确定所述学生的状态与所述课前准备状态相匹配的时刻作为第三疑似开始时刻。

42.可选地,根据所述教学视频中的图像信息和/或音频信息,确定所述教学视频中与授课内容无关的视频片段的开始时间以及结束时间,包括:

43.在预设时间段内启动课间休息检测,所述预设时间段的开始时间距离所述教学视频的开始时间第一间隔时长,所述预设时间段的结束时间距离所述教学视频的结束时间第二间隔时长;

44.其中,所述课间休息检测包括根据以下至少一种检测方式的检测结果确定课间休息阶段的开始时间:

45.根据所述图像信息检测所述学生出入教室的时间;检测所述图像信息中的投影图像切换为与教学内容无关的投影图像的时间;根据所述音频信息检测所述教室内的噪声大于预设阈值的时间;

46.所述课间休息检测还包括以下至少一种检测方式的检测结果确定课间休息阶段的结束时间:检测所述图像信息中的投影图像切换为与教学相关的投影图像的时间;根据所述音频信息检测所述教室内的噪声低于所述预设阈值的时间。

47.可选地,根据所述教学视频中的图像信息和音频信息,确定所述教学视频中与授课内容无关的视频片段的开始时间以及结束时间,包括:

48.在根据所述图像信息确定教室中大于预设数量的学生姿态或位置发生变化时,将所述教室中大于预设数量的学生姿态或位置发生变化对应的音频信息进行声音分类;

49.在所述声音分类的结果表征有多人说话的情况下,对所述教室中大于预设数量的学生姿态或位置发生变化对应的音频信息进行分离,得到所述教师的说话内容,并对所述说话内容通过语音识别转写技术转写为文字;

50.将所述文字与预设词典进行匹配;

51.若匹配成功,则确定所述教室中大于预设数量的学生姿态或位置发生变化的时刻为课堂整顿阶段的开始时间;并,

52.确定所述声音分类的结果表征多人说话结束的时刻为所述课堂整顿阶段的结束时间;或,根据所述图像信息确定教室中小于预设数量的学生姿态或位置发生变化的时刻所述课堂整顿阶段的结束时间。

53.可选地,所述图像信息还包括投影图像,根据所述教学视频中的图像信息和音频

信息,确定所述教学视频中与授课内容无关的视频片段的开始时间以及结束时间,包括:

54.在确定所述教室内的投影仪在播放视频时,将所述图像信息中的投影图像和/或所述投影仪播放视频时对应的音频信息与预先建立的白名单对比得到第二对比结果;

55.若所述第二对比结果表征与所述白名单不匹配,则将所述视频开始播放的时刻作为播放教学无关视频的开始时间,将所述视频播放结束的时刻所述播放教学无关视频的结束时间。

56.可选地,根据所述教学视频中的图像信息和音频信息,确定所述教学视频中与授课内容无关的视频片段的开始时间以及结束时间,包括:

57.根据所述图像信息获取所述教室内学生的移动轨迹,以及根据所述音频信息判断所述教室内是否播放音乐和教师的说话内容是否与预先标定的游戏字典匹配;

58.在所述移动轨迹与预设的表征游戏互动场景的学生移动轨迹相匹配的情况下,若所述教室内播放音乐,或者所述教师的说话内容与所述游戏字典匹配,则确定当前视频片段为游戏互动阶段;

59.根据学生开始移动的时刻、所述教室内开始播放音乐的时刻、以及教师的说话内容初始与所述游戏字典匹配的时刻中的至少一者,确定所述游戏互动阶段的开始时刻;

60.根据所述音频信息,基于所述教室内停止播放音乐或者最后一次检测到所述教室的说话内容初始与所述游戏字典匹配的时刻,确定所述游戏互动阶段的结束时刻;或者,根据所述移动轨迹确定所述学生回归到听课位置的时刻,确定所述游戏互动阶段的结束时刻。

61.可选地,根据所述教学视频中的音频信息,确定所述教学视频中与授课内容无关的视频片段的开始时间以及结束时间,包括:

62.通过语音识别转写技术将所述音频信息中教师说的话转写为文字;

63.将所述文字与预设敏感词词典进行匹配;

64.若存在与所述预设敏感词词典匹配的词语,则将出现所述词语的句子的开始时刻作为不规范授课行为的开始时间,将出现所述词语的句子的结束时刻作为所述不规范授课行为的结束时间。

65.可选地,所述根据所述开始时间以及所述结束时间,从所述教学视频中删除所述视频片段,包括:

66.将所述视频片段生成缩略图展示给用户,并提醒所述用户是否确定删除该视频片段;

67.在接收到所述用户下发的确定删除指令的情况下,根据所述开始时间以及所述结束时间,从所述教学视频中删除所述视频片段。

68.本公开第二方面提供一种视频剪辑装置,所述装置包括:

69.获取模块,用于获取教学视频,所述教学视频是对教室内的课堂场景进行拍摄得到的;

70.确定模块,用于根据所述教学视频中的图像信息和/或音频信息,确定所述教学视频中与授课内容无关的视频片段的开始时间以及结束时间;

71.删除模块,用于根据所述开始时间以及所述结束时间,从所述教学视频中删除所述视频片段。

72.本公开第三方面提供一种电子设备,包括:

73.存储器,其上存储有计算机程序;

74.处理器,用于执行所述存储器中的所述计算机程序,以实现本公开第一方面中任一项所述方法的步骤。

75.本公开第四方面提供一种计算机可读存储介质,其上存储有计算机程序,该程序被处理器执行时实现本公开第一方面中任一项所述方法的步骤。

76.通过上述技术方案,通过教学视频中的图像信息和/或音频信息自动将教学视频中的与教学无关的视频片段删除,一方面能够减少学生观看补课视频时浪费的时间,另一方面也可以减少对网络资源和存储资源造成的浪费,并且,无需人工进行处理,既提高了处理速度,还降低了人力成本。

77.本公开的其他特征和优点将在随后的具体实施方式部分予以详细说明。

附图说明

78.附图是用来提供对本公开的进一步理解,并且构成说明书的一部分,与下面的具体实施方式一起用于解释本公开,但并不构成对本公开的限制。在附图中:

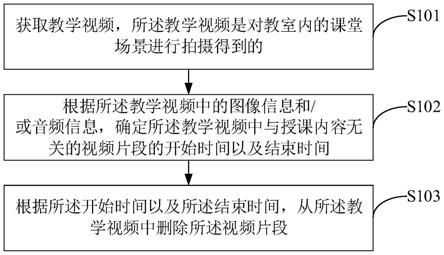

79.图1是根据一示例性实施例示出的一种视频剪辑方法的流程图。

80.图2是根据一示例性实施例示出的一种视频剪辑方法的实施场景的示意图。

81.图3是根据一示例性实施例示出的一种视频剪辑装置的框图。

82.图4是根据一示例性实施例示出的一种电子设备的框图。

具体实施方式

83.以下结合附图对本公开的具体实施方式进行详细说明。应当理解的是,此处所描述的具体实施方式仅用于说明和解释本公开,并不用于限制本公开。

84.图1是根据一示例性实施例示出的一种视频剪辑方法的流程图,该方法的执行主体可以是边缘算力盒子,如图1所示,所述方法包括:

85.s101、获取教学视频,所述教学视频是对教室内的课堂场景进行拍摄得到的。

86.s102、根据所述教学视频中的图像信息和/或音频信息,确定所述教学视频中与授课内容无关的视频片段的开始时间以及结束时间。

87.s103、根据所述开始时间以及所述结束时间,从所述教学视频中删除所述视频片段。

88.其中,图2是根据一示例性实施例示出的一种视频剪辑方法的实施场景的示意图,如图2所示,教室中可以配置有两个监控摄像头,第一摄像头21指向黑板方向,能够拍摄教师、黑板的图像,也可以拍摄到投影仪的图像,第二摄像头22可以设置在黑板的上方指向学生方向,用于拍摄学生方向的图像;还可以配置一个投影仪23以及麦克风24,麦克风可以设置在讲台附近用于拾取教师的声音。该方法的执行主体边缘算力盒子20通过与上述两个监控摄像头21、摄像头22、投影仪23以及麦克风24获取包括图像信息和音频信息的教学视频,图像信息可以包括三路视频流,分别由两个监控摄像头拍摄的视频流以及投影仪的视频流。边缘算力盒子20执行完成上述视频剪辑方法之后,还能够将处理完成的教学视频上传至目标服务器,以供学生回看,在一种可能的实施方式中,可以只上传第一摄像头21拍摄到

的视频流对应的图像信息,减少对网络资源和存储资源造成的浪费。对于学生回看的补课视频,补课视频的图像信息可以是教学视频中第一摄像头21拍摄到的视频流经过本公开实施例处理后的视频流。

89.本领域技术人员应理解,由于在人工智能算法领域对图像要求较高,进而对摄像头的焦距、视角宽度、角度、高度的要求较高,在采用常规的图像算法时,采用广角摄像头拍摄教室内图像可能会造成图像畸变,导致步骤s102中确定的与授课内容无关的视频片段的开始时间以及结束时间有误,删除与授课内容相关的内容。

90.因此,在对教室内的课堂场景进行拍摄时,优选使用视角为50度左右的高清摄像头、并对摄像头的高度、位置、角度进行限定,例如,如图2中用于拍摄学生方向的第二摄像头22需要设置在黑板上方距离地面2米,且处于黑板的中心线上;或者,在步骤s102中,根据所述教学视频中的图像信息确定所述教学视频中与授课内容无关的视频片段的开始时间以及结束时间时,采用能够适应于广角摄像头的图像算法,可以减小实施场景中对摄像头位置、清晰度、甚至数量的要求,然而对图像算法的要求较高,进而提高了边缘算力盒子的算力要求。

91.在本公开实施例中,通过教学视频中的图像信息和/或音频信息自动将教学视频中的与教学无关的视频片段删除,一方面能够减少学生观看补课视频时浪费的时间,另一方面也可以减少对网络资源和存储资源造成的浪费,并且,无需人工进行处理,既提高了处理速度,还降低了人力成本。

92.在本公开实施例具体实施时,可以通过一些实施方式可以将视频片段中的例如教师点名的片段、课前准备的片段、课间休息的片段、教师播放与授课内容无关视频的片段、游戏互动的片段、维持秩序的片段、不合适的授课内容的片段删除。

93.例如,针对教师点名的视频片段,在一些可选地实施例中,根据所述教学视频中的图像信息和音频信息,确定所述教学视频中与授课内容无关的视频片段的开始时间以及结束时间,包括:

94.确定所述图像信息中的教师是否处于点名姿态;

95.在确定所述教师处于点名姿态的情况下,将所述教师处于点名姿态对应的音频信息通过语音识别转写技术转写为文字,并将所述文字与学生名单对比,得到第一对比结果;

96.在所述第一对比结果表征所述文字与所述学生名单中的学生姓名相匹配的情况下,将确定所述图像信息中的教师处于所述点名姿态的时刻作为点名阶段的开始时间;并,

97.根据所述第一比对结果,将转写得到的文字最后一次与所述学生名单中的学生姓名相匹配的时间作为所述点名阶段的结束时间。

98.其中,图像信息中的教师可以是如图2所示的朝向黑板方向的第一摄像头21拍摄得到的,学生名单是边缘算力盒子20从教务系统或者考勤系统拉取的课程信息中得到的,例如,在边缘算力盒子20检测到当前时间为目标课程的上课时间的情况下,请求教务系统或考勤系统发送目标课程的课程信息,课程信息包括目标课程的学生名单;或者,根据所述课程信息,请求考勤系统发送目标课程的学生名单。本公开实施例对如何获取学生名的方法不作限定。

99.由于在教师点名时会保持固定的一种姿势,例如手持并看向手机,再逐一念出每一个学生的名字,采用本方案,能够通过图像处理技术,确定教师是否处于点名姿态,并通

过音频处理技术,确定教师是否正在点名,通过图像处理技术与音频处理技术的结合,实现了从教学视频中删除教师点名的片段。

100.在又一些可选地实施例中,还可以采用唇语识别技术,在确定所述教师处于点名姿态的情况下,将所述教师处于点名姿态对应的图像输入预先训练的唇语识别模型,得到教师唇语对应的文字,并将所述教师唇语对应的文字与学生名单对比,得到唇语对比结果;

101.在所述唇语对比结果表征所述教师唇语对应的文字与所述学生名单中的学生姓名相匹配的情况下,将确定所述图像信息中的教师处于所述点名姿态的时刻作为点名阶段的开始时间;并,

102.根据所述唇语比对结果,将教师唇语对应的文字最后一次与所述学生名单中的学生姓名相匹配的时间作为所述点名阶段的结束时间。

103.然而,在相关技术中针对唇语识别均是近场识别,即被识别的人脸需要占据摄像头拍摄的主体位置。在本公开的实施场景中,采集教师图像的摄像头距离教师面部较远,并且,由于在拍摄教学视频时,为了学生能够正常观看,不可能通过调整第一摄像头21的焦距以拍摄较大的教师脸部图像。为了解决相关技术中存在的拍摄图像教师脸部图像较小的问题,可以通过超分辨率的方式解决。

104.因此,在一种可能的实施方式中,可以将图像信息输入预先训练的目标超分模型,以得到目标教师脸部图像;

105.并根据该目标教师脸部图像进行唇语识别。

106.现有的超分方法大多数采用降采样的方式,从高清图像获取低质量图像,再以低质量图片作为输入,高清图片作为标签来训练gan(generative adversarial networks,生成式对抗网络)模型,但是在本公开的实施场景中,图像质量低不是因为降采样造成的,所以此方法训练的超分模型效果会不理想。

107.因此,在一种可能的实施方式中,目标超分模型的训练可以通过设置2个摄像头用于采集教师的图像,且上述2个摄像头的内部参数、安装高度、俯视角度均相同,其中一个摄像头可以是第一摄像头21以正常的焦距拍摄教学图像,该教学图像包括教师的第一面部图像,另一个摄像头以光学变焦的方式拉近教师的人脸,以拍摄较大的教师第二面部图像;并以第一面部图像作为输入,第二面部图像作为输出进行训练,得到目标超分模型。

108.进一步,由于在目标超分模型训练时,需要训练数据的输入与输出能够像素级对齐。因此,还可以通过确定上述2个摄像头的间距,并根据上述安装高度、俯视角度,对教师进行双目测距,将三维空间的点云进行对齐后,转化为二维空间的坐标点对齐,以实现第一面部图像与第二面部图像达到像素级对齐,并将对齐后的第一面部图像以及第二面部图像分别作为输入与输出进行训练。

109.再进一步,由于第一面部图像以及第二面部图像的画质畸变程度受到摄像头内部参数的影响,因此,可以提取上述2个摄像头的内参畸变参数组成2*2的第一卷积核,以及内参矩阵组成3*3的第二卷积核,并分别将第一卷积核、第二卷积核作用于第一、第二面部图像的三通道,分别得到六个新通道;将第一图像的六个新通道与三通道作为输入,第二面部图像的六个新通道与三通道作为输出,训练得到目标超分模型,以减小摄像头画质畸变对目标超分模型训练的影响。

110.在相关技术中针对唇语识别还需要被识别的脸部图像为正面脸部图像,而在本公

开的实施场景中,采集得到的教师图像常为俯视视角。为了得到教师的正脸图像,还可以将上述目标教师脸部图像输入透视校正模型,以得到正视的目标教师脸部图像。

111.进一步地,透视校正模型的输入参数包括三通道的图像,以及图像中每个像素点的二维空间坐标,输出参数包括三通道的图像,以及图像中每个像素点的三维空间坐标,以预测每个像素点的二维坐标对应的三维坐标,用于辅助教师头像的校正。

112.由于在具体实施时,可能受到各种影响导致唇语识别、语音转写均可能准确度较低,因此,在一些可选地实施例中,可以将所述点名姿态对应的图像输入预先训练的唇语识别模型得到唇语特征、将所述教师处于点名姿态对应的音频信息通过语音识别转写技术转写得到语音特征;按照时间顺序,分别得到该唇语特征以及语音特征的时间特征序列;

113.将唇语特征的时间特征序列以及语音特征的时间特征序列融合,再进行转写,得到老师说话内容对应的文字,以提高文字转写的准确率。

114.在一些可选地实施例中,确定所述图像信息中的教师是否处于点名姿态包括:

115.根据骨骼点检测技术,确定所述图像信息中的教师是否手持手机或纸质名单;

116.根据视线检测技术,确定所述图像信息中的教师的视线是否多次在手机或纸质名单与其他位置之间进行切换;

117.在所述教师手持手机或纸质名单,且所述教师的视线多次在手机或纸质名单与其他位置之间进行切换的情况下,确定所述图像信息中的教师处于点名姿态。

118.其中,骨骼点检测技术主要检测人体的一些关键点,如关节,五官等,通过关键点描述人体骨骼信息,确定所述图像信息中的教师是否手持手机或纸质名单可以是将该人体骨骼信息输入预先训练的神经网络模型,根据该神经网络模型输出的结果确定的。

119.可选地,在确定所述图像信息中的教师是否手持手机或纸质名单还可以包括确定图像信息中的教师是否看向电脑显示器或者桌面上的某一物体。进一步地,教师手持的物体、看向的物体可以是通过本领域的目标检测技术确定的。

120.采用本方案,可以通过骨骼点检测技术以及视线检测技术更加准确的确定教师是否处于点名姿态。

121.进一步地,所述根据视线检测技术,确定所述图像信息中的教师的视线是否多次在手机或纸质名单与其他位置之间进行切换包括:

122.所述根据视线检测技术,获取所述图像信息中的多个采样帧中的多个教师视线角度;

123.针对所述多个采样帧中每相邻的两个采样帧,计算所述两个采样帧中两个所述教师视线角度的余弦距离,若所述余弦距离小于视线集中阈值,则确定所述两个采样帧中教师看的是同一位置,若所述余弦距离大于视线集中阈值,则确定所述两个采样帧中教师看的是不同位置;

124.在确定所述相邻的两个采样帧中教师看的是同一位置的情况下,记录所述两个采样帧中的教师视线角度;

125.根据记录得到的教师视线角度的分布情况,确定所述教师看向手机或纸质名单的教师视线角度的角度范围;

126.根据每一所述采样帧中的教师视线角度以及所述角度范围,生成特征向量,所述特征向量中的一个特征值表征一个所述采样帧中的教师视线角度是否处于所述角度范围;

127.将所述特征向量输入预先训练完成的二分类模型,得到所述二分类模型输出的表征教师的视线是否多次在手机或纸质名单与其他位置之间进行切换的结果。

128.其中,余弦距离用于体现教师视线方向上的相对差异,通过计算相邻采样帧中教师的视线角度的相对差异,并设置一个视线集中阈值,在两个采样帧中教师视线角度差异较大时,确认教师在两个采样帧对应的时间看向的位置为不同位置。由于学生名单的位置较为固定,因此,通过统计教师看向同一位置的视线角度分布,当视线角度分布最为密集的地方即可认为是学生名单的位置,而视线角度密度大于一定阈值的角度范围可以认为是看向纸质名单的角度范围。进一步,示例地,可以将教师看向学生名单的时刻,即采样帧中的视线角度在视线角度密度大于一定阈值的角度范围内时采样帧对应的时刻,记为0,将教师没有看向学生名单的时刻记为1。每一次可以统计20个采样帧,构成一个20维的由特征值为0或1构成的特征向量,并将该特征向量输入预先训练完成的二分类模型,以确定教师是否多次在手机或纸质名单与其他位置之间进行切换。

129.采用本方案,可以通过视线检测技术检测采样帧中的教师视线角度,并通过计算多个采样帧的教师视线角度的余弦距离,确定看向学生名单的视线角度范围,再通过统计多个采样帧看向学生名单的时刻以及未看向学生名单的时刻,根据预先训练的二分类模型,确定多个采样帧对应的这段时间的视频中教师是否多次在手机或纸质名单与其他位置之间进行切换。

130.针对课前准备的视频片段,在一些可选地实施例中,根据所述教学视频中的图像信息和音频信息,确定所述教学视频中与授课内容无关的视频片段的开始时间以及结束时间,包括:

131.根据所述教学视频中的图像信息确定课前准备阶段的疑似开始时刻;

132.根据所述疑似开始时刻之后的音频信息,判断所述疑似开始时刻之后的第一预设时长内是否无人说话;

133.在确定所述疑似开始时刻之后的第一预设时长内无人说话的情况下,将所述疑似开始时刻作为课前准备阶段的开始时间;并,

134.将所述开始时间之后,基于音频信息检测到的教师开始说话的时间作为所述课前准备阶段的结束时间。

135.其中,值得说明的是,音频信息可以是通过如图2所示的设置在讲台附近的麦克风24拾取的,由于麦克风24距离学生有一定距离,并且为了更好的拾取教师的声音会自动从音频信息中剔除音量较小的杂声,因此当仅有部分学生小声交头接耳时,也可以认定为无人说话。

136.另外,课前准备阶段的疑似开始时刻可以限定在课程开始时间后的一定时间内,例如,边缘算力盒子20在边缘算力盒子20检测到当前时间为目标课程开课后的半个小时之后,则无需进行上述根据所述教学视频中的图像信息确定课前准备阶段的疑似开始时刻的步骤。

137.采用本方案,通过图像处理技术以及音频处理技术,可以将例如教师在上课之前整理教案或者调试ppt时对应的与教学无关的课前准备阶段的视频删除。

138.可选地,所述教学视频中的图像信包括教学投影图像,所述根据所述教学视频中的图像信息确定课前准备阶段的疑似开始时刻,包括:

139.在确定所述图像信息中的教学投影图像保持同一画面超过第二预设时长的情况下,将所述教学投影图像开始保持所述画面的时刻为第一疑似开始时刻;或者,

140.在确定所述图像信息中教师站立在同一位置超过第三预设时长的情况下,确定所述教师站立在所述位置的时刻为第二疑似开始时刻;或者,

141.在确定所述图像信息中的学生的状态与预设的课前准备状态相匹配的情况下,将初始确定所述学生的状态与所述课前准备状态相匹配的时刻作为第三疑似开始时刻。

142.其中,如图2所示,投影图像可以是边缘算力盒子20与投影仪23连接,投影仪23通过采集hdmi接口的信号获取到的,也可以是通过指向投影仪23投影的画面的摄像头采集的。图像信息中的学生可以是图2中第二摄像头22采集到的。学生的状态与预设的课前准备状态相匹配可以是当超过预设数量的学生在座位上,且处于练习、翻书、交头接耳的状态。

143.采用本方案,可以在ppt长时间处于没有播放,或者停止在一页长时间没有变化的情况下,以及教师长时间在某一位置长时间没有移动,以及学生处于课前准备状态的任一情况被检测到时,将检测到的时刻作为疑似开始时刻。进一步地,在三种情况的有多个被检测到时,可以将最早检测到的时刻作为该疑似开始时刻。

144.针对课间休息的视频片段,在一些可选地实施例中,根据所述教学视频中的图像信息和/或音频信息,确定所述教学视频中与授课内容无关的视频片段的开始时间以及结束时间,包括:

145.在预设时间段内启动课间休息检测,所述预设时间段的开始时间距离所述教学视频的开始时间第一间隔时长,所述预设时间段的结束时间距离所述教学视频的结束时间第二间隔时长;

146.其中,所述课间休息检测包括根据以下至少一种检测方式的检测结果确定课间休息阶段的开始时间:

147.根据所述图像信息检测所述学生出入教室的时间;检测所述图像信息中的投影图像切换为与教学内容无关的投影图像的时间;根据所述音频信息检测所述教室内的噪声大于预设阈值的时间;

148.所述课间休息检测还包括以下至少一种检测方式的检测结果确定课间休息阶段的结束时间:检测所述图像信息中的投影图像切换为与教学相关的投影图像的时间;根据所述音频信息检测所述教室内的噪声低于所述预设阈值的时间。

149.其中,若一节课的时间为40分钟,该预设时间段可以是开始上课的第15至第25分钟,即第一间隔时长与第二间隔时长均为15分钟。确定教室内的噪声大于或者小于预设阈值的方法可以是检测音频信息中说话声音超过预设分贝的人的数量,当该数量超过对应的预设阈值时,则确认当前教室内的噪声大于预设阈值;或者,可以将音频信息中说话声音超过预设分贝的人说的话进行语音转写,匹配转写结果与上课内容的关联性,在关联性较低时,则确认当前教室内的噪声大于预设阈值,本公开实施例对如何确定教室内的噪声大于或者小于预设阈值不作限定。

150.采用本方案,能够根据教学视频的图像信息和/或音频信息,确定课件休息的时间段,以将课件休息时间对应的视频片段从教学视频中删除,减少了学生观看补课视频时浪费的时间,减少了对网络资源和存储资源造成的浪费,既提高了处理速度,还降低了人力成本。

151.针对课堂整顿的视频片段,在另一些可选地实施例中,根据所述教学视频中的图像信息和音频信息,确定所述教学视频中与授课内容无关的视频片段的开始时间以及结束时间,包括:

152.在根据所述图像信息确定教室中大于预设数量的学生姿态或位置发生变化时,将所述教室中大于预设数量的学生姿态或位置发生变化对应的音频信息进行声音分类;

153.在所述声音分类的结果表征有多人说话的情况下,对所述教室中大于预设数量的学生姿态或位置发生变化对应的音频信息进行分离,得到所述教师的说话内容,并对所述说话内容通过语音识别转写技术转写为文字;

154.将所述文字与预设词典进行匹配;

155.若匹配成功,则确定所述教室中大于预设数量的学生姿态或位置发生变化的时刻为课堂整顿阶段的开始时间;并,

156.确定所述声音分类的结果表征多人说话结束的时刻为所述课堂整顿阶段的结束时间;或,根据所述图像信息确定教室中小于预设数量的学生姿态或位置发生变化的时刻所述课堂整顿阶段的结束时间。

157.其中,音频信息进行分离,得到所述教师的说话内容,可以是通过识别音频信息中音量最大的声音进行分离;或者,可以是预先存储教师的声纹,识别音频信息中与预先存储的教师声纹匹配的声音进行分离。预设字典例如可以包括“安静”、“肃静”、“开始上课”等词汇。

158.采用本方案,可以实现将教师维护教学秩序对应的视频片段从教学视频中删除,减少了学生观看补课视频时浪费的时间,减少了对网络资源和存储资源造成的浪费,既提高了处理速度,还降低了人力成本。

159.针对播放与课堂无关视频的视频片段,在另一些可选地实施例中,所述图像信息还包括投影图像,根据所述教学视频中的图像信息和音频信息,确定所述教学视频中与授课内容无关的视频片段的开始时间以及结束时间,包括:

160.在确定所述教室内的投影仪在播放视频时,将所述图像信息中的投影图像和/或所述投影仪播放视频时对应的音频信息与预先建立的白名单对比得到第二对比结果;

161.若所述第二对比结果表征与所述白名单不匹配,则将所述视频开始播放的时刻作为播放教学无关视频的开始时间,将所述视频播放结束的时刻所述播放教学无关视频的结束时间。

162.采用本方案,可以通过图像处理技术和/或音频处理技术,将投影图像或对应的音频与白名单进行对比,以确定教师播放的视频是否为与课堂相关的视频,在播放的视频与课堂无关时,例如教师播放动画片时,将播放与课堂无关的视频对应的时间从教学视频中删除,减少了学生观看补课视频时浪费的时间,减少了对网络资源和存储资源造成的浪费,既提高了处理速度,还降低了人力成本。

163.针对游戏互动的视频片段,在另一些可选地实施例中,根据所述教学视频中的图像信息和音频信息,确定所述教学视频中与授课内容无关的视频片段的开始时间以及结束时间,包括:

164.根据所述图像信息获取所述教室内学生的移动轨迹,以及根据所述音频信息判断所述教室内是否播放音乐和教师的说话内容是否与预先标定的游戏字典匹配;

165.在所述移动轨迹与预设的表征游戏互动场景的学生移动轨迹相匹配的情况下,若所述教室内播放音乐,或者所述教师的说话内容与所述游戏字典匹配,则确定当前视频片段为游戏互动阶段;

166.根据学生开始移动的时刻、所述教室内开始播放音乐的时刻、以及教师的说话内容初始与所述游戏字典匹配的时刻中的至少一者,确定所述游戏互动阶段的开始时刻;

167.根据所述音频信息,基于所述教室内停止播放音乐或者最后一次检测到所述教室的说话内容初始与所述游戏字典匹配的时刻,确定所述游戏互动阶段的结束时刻;或者,根据所述移动轨迹确定所述学生回归到听课位置的时刻,确定所述游戏互动阶段的结束时刻。

168.由于在低幼的课堂场景中,经常会出现做课堂互动游戏的情况。虽然课堂互动游戏对现场上课学生的学习效果有促进作用,但是对于课后回看补课的学生几乎没有帮助,需要剪辑掉。采用本方案,可以根据学生的轨迹确定学生处于游戏过程中时,或者根据音频信息确定教室内在播放音乐、教师在指挥或参与游戏时,将游戏互动过程对应的视频片段从教学视频中删除,减少了学生观看补课视频时浪费的时间,减少了对网络资源和存储资源造成的浪费,既提高了处理速度,还降低了人力成本。

169.针对不合适的授课内容的视频片段,在又一些可选地实施例中,根据所述教学视频中的音频信息,确定所述教学视频中与授课内容无关的视频片段的开始时间以及结束时间,包括:

170.通过语音识别转写技术将所述音频信息中教师说的话转写为文字;

171.将所述文字与预设敏感词词典进行匹配;

172.若存在与所述预设敏感词词典匹配的词语,则将出现所述词语的句子的开始时刻作为不规范授课行为的开始时间,将出现所述词语的句子的结束时刻作为所述不规范授课行为的结束时间。

173.其中,敏感词词典可以收录尽可能多的例如骂人词汇等,并可以不断进行补充完善。采用本方案,可以通过音频处理技术,将授课教师不规范的授课行为的过程从原始教学视频中移除,减少了学生观看补课视频时浪费的时间,减少了对网络资源和存储资源造成的浪费,既提高了处理速度,还降低了人力成本。

174.可选地,所述根据所述开始时间以及所述结束时间,从所述教学视频中删除所述视频片段,包括:

175.将所述视频片段生成缩略图展示给用户,并提醒所述用户是否确定删除该视频片段;

176.在接收到所述用户下发的确定删除指令的情况下,根据所述开始时间以及所述结束时间,从所述教学视频中删除所述视频片段。

177.采用本方案,可以将智能处理与人工处理结合,能够避免在智能处理时,将包括课堂内容的视频片段误删除。

178.图3是根据一示例性实施例示出的一种视频剪辑装置30的框图,所述装置30可以是边缘算力盒子,或者边缘算力盒子的一部分,所述装置30包括:

179.获取模块31,用于获取教学视频,所述教学视频是对教室内的课堂场景进行拍摄得到的;

180.确定模块32,用于根据所述教学视频中的图像信息和/或音频信息,确定所述教学视频中与授课内容无关的视频片段的开始时间以及结束时间;

181.删除模块33,用于根据所述开始时间以及所述结束时间,从所述教学视频中删除所述视频片段。

182.可选地,确定模块32还包括:

183.第一确定子模块,用于确定所述图像信息中的教师是否处于点名姿态;

184.第一对比子模块,用于在确定所述教师处于点名姿态的情况下,将所述教师处于点名姿态对应的音频信息通过语音识别转写技术转写为文字,并将所述文字与学生名单对比,得到第一对比结果;

185.第二确定子模块,用于在所述第一对比结果表征所述文字与所述学生名单中的学生姓名相匹配的情况下,将确定所述图像信息中的教师处于所述点名姿态的时刻作为点名阶段的开始时间;

186.第三确定子模块,用于根据所述第一比对结果,将转写得到的文字最后一次与所述学生名单中的学生姓名相匹配的时间作为所述点名阶段的结束时间。

187.可选地,确定模块32还包括:

188.唇语对比子模块,用于在确定所述教师处于点名姿态的情况下,将所述教师处于点名姿态对应的图像输入预先训练的唇语识别模型,得到教师唇语对应的文字,并将所述教师唇语对应的文字与学生名单对比,得到唇语对比结果;

189.第四确定子模块,用于在所述唇语对比结果表征所述教师唇语对应的文字与所述学生名单中的学生姓名相匹配的情况下,将确定所述图像信息中的教师处于所述点名姿态的时刻作为点名阶段的开始时间;

190.第五确定子模块,用于根据所述唇语比对结果,将教师唇语对应的文字最后一次与所述学生名单中的学生姓名相匹配的时间作为所述点名阶段的结束时间。

191.可选地,确定模块33还包括:

192.特征获取模块,用于在确定所述教师处于点名姿态的情况下,将所述教师处于点名姿态对应的图像输入预先训练的唇语识别模型得到唇语特征、将所述教师处于点名姿态对应的音频信息通过语音识别转写技术转写得到语音特征;

193.特征排序模块,用于按照时间顺序,分别得到所述唇语特征以及所述语音特征的时间特征序列;

194.转写子模块,用于将所述唇语特征的时间特征序列以及所述语音特征的时间特征序列融合,再进行转写,得到教师说话内容对应的文字;

195.第六确定子模块,用于将所述教师说话内容对应的文字与学生名单对比,根据对比结果确定点名阶段的开始时间以及结束时间。

196.可选地,第一确定子模块具体用于:

197.根据骨骼点检测技术,确定所述图像信息中的教师是否手持手机或纸质名单;

198.根据视线检测技术,确定所述图像信息中的教师的视线是否多次在手机或纸质名单与其他位置之间进行切换;

199.在所述教师手持手机或纸质名单,且所述教师的视线多次在手机或纸质名单与其他位置之间进行切换的情况下,确定所述图像信息中的教师处于点名姿态。

200.可选地,第一确定子模块还用于:

201.所述根据视线检测技术,获取所述图像信息中的多个采样帧中的多个教师视线角度;

202.针对所述多个采样帧中每相邻的两个采样帧,计算所述两个采样帧中两个所述教师视线角度的余弦距离,若所述余弦距离小于视线集中阈值,则确定所述两个采样帧中教师看的是同一位置,若所述余弦距离大于视线集中阈值,则确定所述两个采样帧中教师看的是不同位置;

203.在确定所述相邻的两个采样帧中教师看的是同一位置的情况下,记录所述两个采样帧中的教师视线角度;

204.根据记录得到的教师视线角度的分布情况,确定所述教师看向手机或纸质名单的教师视线角度的角度范围;

205.根据每一所述采样帧中的教师视线角度以及所述角度范围,生成特征向量,所述特征向量中的一个特征值表征一个所述采样帧中的教师视线角度是否处于所述角度范围;

206.将所述特征向量输入预先训练完成的二分类模型,得到所述二分类模型输出的表征教师的视线是否多次在手机或纸质名单与其他位置之间进行切换的结果。

207.可选地,确定模块32还包括:

208.第七确定子模块,用于根据所述教学视频中的图像信息确定课前准备阶段的疑似开始时刻;

209.判断子模块,用于根据所述疑似开始时刻之后的音频信息,判断所述疑似开始时刻之后的第一预设时长内是否无人说话;

210.第八确定子模块,用于在确定所述疑似开始时刻之后的第一预设时长内无人说话的情况下,将所述疑似开始时刻作为课前准备阶段的开始时间;

211.第九确定子模块,用于将所述开始时间之后,基于音频信息检测到的教师开始说话的时间作为所述课前准备阶段的结束时间。

212.可选地,第七确定子模块用于:

213.在确定所述图像信息中的教学投影图像保持同一画面超过第二预设时长的情况下,将所述教学投影图像开始保持所述画面的时刻为第一疑似开始时刻;或者,

214.在确定所述图像信息中教师站立在同一位置超过第三预设时长的情况下,确定所述教师站立在所述位置的时刻为第二疑似开始时刻;或者,

215.在确定所述图像信息中的学生的状态与预设的课前准备状态相匹配的情况下,将初始确定所述学生的状态与所述课前准备状态相匹配的时刻作为第三疑似开始时刻。

216.可选地,确定模块32还用于:

217.在预设时间段内启动课间休息检测,所述预设时间段的开始时间距离所述教学视频的开始时间第一间隔时长,所述预设时间段的结束时间距离所述教学视频的结束时间第二间隔时长;

218.其中,所述课间休息检测包括根据以下至少一种检测方式的检测结果确定课间休息阶段的开始时间:

219.根据所述图像信息检测所述学生出入教室的时间;检测所述图像信息中的投影图像切换为与教学内容无关的投影图像的时间;根据所述音频信息检测所述教室内的噪声大

于预设阈值的时间;

220.所述课间休息检测还包括以下至少一种检测方式的检测结果确定课间休息阶段的结束时间:检测所述图像信息中的投影图像切换为与教学相关的投影图像的时间;根据所述音频信息检测所述教室内的噪声低于所述预设阈值的时间。

221.可选地,确定模块32还用于:

222.在根据所述图像信息确定教室中大于预设数量的学生姿态或位置发生变化时,将所述教室中大于预设数量的学生姿态或位置发生变化对应的音频信息进行声音分类;

223.在所述声音分类的结果表征有多人说话的情况下,对所述教室中大于预设数量的学生姿态或位置发生变化对应的音频信息进行分离,得到所述教师的说话内容,并对所述说话内容通过语音识别转写技术转写为文字;

224.将所述文字与预设词典进行匹配;

225.若匹配成功,则确定所述教室中大于预设数量的学生姿态或位置发生变化的时刻为课堂整顿阶段的开始时间;并,

226.确定所述声音分类的结果表征多人说话结束的时刻为所述课堂整顿阶段的结束时间;或,根据所述图像信息确定教室中小于预设数量的学生姿态或位置发生变化的时刻所述课堂整顿阶段的结束时间。

227.可选地,所述图像信息还包括投影图像,确定模块32还用于:

228.在确定所述教室内的投影仪在播放视频时,将所述图像信息中的投影图像和/或所述投影仪播放视频时对应的音频信息与预先建立的白名单对比得到第二对比结果;

229.若所述第二对比结果表征与所述白名单不匹配,则将所述视频开始播放的时刻作为播放教学无关视频的开始时间,将所述视频播放结束的时刻所述播放教学无关视频的结束时间。

230.可选地,确定模块32还用于:

231.根据所述图像信息获取所述教室内学生的移动轨迹,以及根据所述音频信息判断所述教室内是否播放音乐和教师的说话内容是否与预先标定的游戏字典匹配;

232.在所述移动轨迹与预设的表征游戏互动场景的学生移动轨迹相匹配的情况下,若所述教室内播放音乐,或者所述教师的说话内容与所述游戏字典匹配,则确定当前视频片段为游戏互动阶段;

233.根据学生开始移动的时刻、所述教室内开始播放音乐的时刻、以及教师的说话内容初始与所述游戏字典匹配的时刻中的至少一者,确定所述游戏互动阶段的开始时刻;

234.根据所述音频信息,基于所述教室内停止播放音乐或者最后一次检测到所述教室的说话内容初始与所述游戏字典匹配的时刻,确定所述游戏互动阶段的结束时刻;或者,根据所述移动轨迹确定所述学生回归到听课位置的时刻,确定所述游戏互动阶段的结束时刻。

235.可选地,确定模块32还用于:

236.通过语音识别转写技术将所述音频信息中教师说的话转写为文字;

237.将所述文字与预设敏感词词典进行匹配;

238.若存在与所述预设敏感词词典匹配的词语,则将出现所述词语的句子的开始时刻作为不规范授课行为的开始时间,将出现所述词语的句子的结束时刻作为所述不规范授课

行为的结束时间。

239.可选地,所述删除模块33还包括:

240.提示子模块,用于将所述视频片段生成缩略图展示给用户,并提醒所述用户是否确定删除该视频片段;

241.删除子模块,用于在接收到所述用户下发的确定删除指令的情况下,根据所述开始时间以及所述结束时间,从所述教学视频中删除所述视频片段。

242.在本公开实施例中,通过教学视频中的图像信息和/或音频信息自动将教学视频中的与教学无关的视频片段删除,一方面能够减少学生观看补课视频时浪费的时间,另一方面也可以减少对网络资源和存储资源造成的浪费,并且,无需人工进行处理,既提高了处理速度,还降低了人力成本。

243.关于上述实施例中的装置,其中各个模块执行操作的具体方式已经在有关该方法的实施例中进行了详细描述,此处将不做详细阐述说明。

244.图4是根据一示例性实施例示出的一种电子设备40的框图。如图4所示,该电子设备40可以包括:处理器41,存储器42。该电子设备40还可以包括多媒体组件43,输入/输出(i/o)接口44,以及通信组件45中的一者或多者。

245.其中,处理器41用于控制该电子设备40的整体操作,以完成上述的视频剪辑方法中的全部或部分步骤。存储器42用于存储各种类型的数据以支持在该电子设备40的操作,这些数据例如可以包括用于在该电子设备40上操作的任何应用程序或方法的指令,以及应用程序相关的数据,例如联系人数据、收发的消息、课程信息、图片、音频、视频等等。该存储器42可以由任何类型的易失性或非易失性存储设备或者它们的组合实现,例如静态随机存取存储器(static random access memory,简称sram),电可擦除可编程只读存储器(electrically erasable programmable read

‑

only memory,简称eeprom),可擦除可编程只读存储器(erasable programmable read

‑

only memory,简称eprom),可编程只读存储器(programmable read

‑

only memory,简称prom),只读存储器(read

‑

only memory,简称rom),磁存储器,快闪存储器,磁盘或光盘。多媒体组件43可以包括屏幕和音频组件。其中屏幕例如可以是触摸屏,音频组件用于输出和/或输入音频信号。例如,音频组件可以包括一个麦克风,麦克风用于接收外部音频信号。所接收的音频信号可以被进一步存储在存储器42或通过通信组件45发送。音频组件还包括至少一个扬声器,用于输出音频信号。i/o接口44为处理器41和其他接口模块之间提供接口,上述其他接口模块可以是键盘,鼠标,按钮等。这些按钮可以是虚拟按钮或者实体按钮。通信组件45用于该电子设备40与其他设备之间进行有线或无线通信。无线通信,例如wi

‑

fi,蓝牙,近场通信(near field communication,简称nfc),2g、3g、4g、nb

‑

iot、emtc、或其他5g等等,或它们中的一种或几种的组合,在此不做限定。因此相应的该通信组件45可以包括:wi

‑

fi模块,蓝牙模块,nfc模块等等。

246.在一示例性实施例中,电子设备40可以被一个或多个应用专用集成电路(application specific integrated circuit,简称asic)、数字信号处理器(digital signal processor,简称dsp)、数字信号处理设备(digital signal processing device,简称dspd)、可编程逻辑器件(programmable logic device,简称pld)、现场可编程门阵列(field programmable gate array,简称fpga)、控制器、微控制器、微处理器或其他电子元

件实现,用于执行上述的视频剪辑方法。

247.在另一示例性实施例中,还提供了一种包括程序指令的计算机可读存储介质,该程序指令被处理器执行时实现上述的视频剪辑方法的步骤。例如,该计算机可读存储介质可以为上述包括程序指令的存储器42,上述程序指令可由电子设备40的处理器41执行以完成上述的视频剪辑方法。

248.以上结合附图详细描述了本公开的优选实施方式,但是,本公开并不限于上述实施方式中的具体细节,在本公开的技术构思范围内,可以对本公开的技术方案进行多种简单变型,这些简单变型均属于本公开的保护范围。

249.另外需要说明的是,在上述具体实施方式中所描述的各个具体技术特征,在不矛盾的情况下,可以通过任何合适的方式进行组合,为了避免不必要的重复,本公开对各种可能的组合方式不再另行说明。

250.此外,本公开的各种不同的实施方式之间也可以进行任意组合,只要其不违背本公开的思想,其同样应当视为本公开所公开的内容。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1