一种基于AR智能眼镜的局部图像识别方法及系统与流程

一种基于ar智能眼镜的局部图像识别方法及系统

技术领域

1.本发明涉及智能ar设备相关领域,具体是一种基于ar智能眼镜的局部图像识别方法及系统。

背景技术:

2.ar(augmented reality,即增强现实),是一种将现实世界与虚拟信息进行融合的技术,也就是用虚拟信息对真实世界进行增强的技术,其通过虚拟信息与真实世界的两种信息进行相互补充与修正,在多媒体、三维模型、智能交互以及传感器等多种技术手段的配合下,达到更好的支持工作和娱乐的目的。

3.近年随着ar技术的不断发展,已经有越来越多的ar相关技术与设备逐渐问世,更多的ar相关设备的功能与使用群众更加倾向于民用消费级别,部分ar设备具有一定的创作者支持功能,能够增加创作者的创作行为方式,激发创作者的创作潜力与欲望,根据现有技术中的ar设备与技术,我们不难发现,ar设备逐渐在取代现有技术中的移动设备作为下一代智能终端,但ar现阶段依然不成熟的ar技术潜在的其他应用空间是仍是一个十分广阔的发展机遇。

4.将现有的ar智能眼睛技术与图像识别进行配合,可用于对移动单位的追踪定位,能够对相关机构的工作起到十分有效的协助效果,现有技术中在进行移动单位尤其是对人员的追踪时,大多由追踪人员人工进行,对于处于远距离人群中的待追踪人员难以进行有效的识别和追踪,且辅助追踪的监控系统也存在死角较多,使用不灵敏的问题。

技术实现要素:

5.本发明的目的在于提供一种基于ar智能眼镜的局部图像识别方法及系统,以解决上述背景技术中提出的问题。

6.为实现上述目的,本发明提供如下技术方案:一种基于ar智能眼镜的局部图像识别方法,包括以下步骤:实时获取设备视野范围内的动态图像信息,并对图像信息进行三维运动特征分析,生成运动体标记;对运动体标记进行动态图像采集,并提取运动体标记的特征信息;将运动体标记的特征信息与预设对象信息进行交叉对比分析,生成追踪指令;通过内部网向协同设备发送追踪指令,并对运动体进行追踪。

7.作为本发明的进一步方案:所述动态图像信息为数个连续的以预设时间间隔采集的静态图像组合而成,所述预设时间间隔用以表征设备视野范围的运动角速度,所述预设时间间隔与设备视野范围的运动角速度呈反比关系设置。

8.作为本发明的再进一步方案:所述动态图像信息还包括距离数据与设备位置信息,所述距离数据用以表征动态图像数据上各图像点距离设备的直线距离;所述并对图像信息进行三维运动特征分析,生成运动体标记的步骤,具体包括:

实时记录并存储设备位置信息,建立三维空间模型,并生成设备运动轨迹;逐帧读取动态图像信息中的静态图像信息,并获取静态图像信息中的距离信息与设备位置信息;根据与设备位置信息相对应的静态图像信息中的距离信息在三维空间模型中建立实时物体模型,并存储;根据不断更新的实时物体模型生成物体模型运动轨迹;根据物体模型运动轨迹对处于运动状态的物体模型进行运动体标记。

9.作为本发明的再进一步方案:所述对运动体标记进行动态图像采集,并提取运动体标记的特征信息的步骤,具体包括:根据实时物体模型获取运动体标记的相对位置与距离数据;根据运动体标记的相对位置与距离数据进行局部图像高清实时采样,获取局部动态高清图像;对局部动态高清图像进行特征提取,生成运动标记体的特征信息。

10.作为本发明的再进一步方案:所述方法预设有预设对象信息,所述预设对象信息为预先采集的追踪对象的特征信息,所述将运动体标记的特征信息与预设对象信息进行交叉对比分析,生成追踪指令的步骤,具体包括:根据预设对象信息建立特征比对模型,所述特征比对模型用以表征与预设对象信息的重合度;获取运动体标记的特征信息,并根据特征比对模型对运动体标记的特征信息进行比对分析,生成比对结果,若比对结果为高度重合,则生成提示信息,并输出追踪指令为追踪。

11.作为本发明的再进一步方案:所述通过内部网向协同设备发送追踪指令,并对运动体进行追踪的步骤,具体包括:当追踪指令为追踪时,提取对应运动体标记与追踪指令;将运动体标记与追踪指令发送给协同设备;根据对应的运动标记体信息在三维空间模型中进行持续追踪。

12.作为本发明的再进一步方案:所述方法还包括:接收来自协同设备的运动体标记与追踪指令;根据接收的运动体标记对三维空间模型中的运动体标记进行检索识别;若三维空间模型中的运动体标记与接收的运动体标记一致,则在三维空间模型中进行持续追踪。

13.第二方面,本发明实施例旨在提供一种基于ar智能眼镜的局部图像识别系统,所述局部图像识别系统具体包含:全局构建模块,用于实时获取设备视野范围内的动态图像信息,并对图像信息进行运动特征分析,生成运动体标记;采样识别模块,用于根据运动体标记对局部图像进行高清放大采样,生成运动体标记的特征信息;追踪识别模块,用于将运动体标记的特征信息与预设对象信息进行交叉对比分析,生成追踪指令;

协同追踪模块,用于通过内部网向协同设备发送追踪指令,并对运动体进行追踪。

14.作为本发明的进一步方案:所述全局构建模块具体包括:环境图像采集单元,用于实时获取设备视野范围内的动态图像信息空间运动模型单元,用于实时记录并存储设备位置信息,建立三维空间模型,并生成设备运动轨迹;逐帧读取动态图像信息中的静态图像信息,并获取静态图像信息中的距离信息与设备位置信息;根据与设备位置信息相对应的静态图像信息中的距离信息在三维空间模型中建立实时物体模型,并存储;根据不断更新的实时物体模型生成物体模型运动轨迹;运动体识别单元,用于根据物体模型运动轨迹对处于运动状态的物体模型进行运动体标记。

15.作为本发明的再进一步方案:所述采样识别模块具体包括:个体相对定位模块,用于根据实时物体模型获取运动体标记的相对位置与距离数据;个体图像采集单元,用于根据运动体标记的相对位置与距离数据进行局部图像高清实时采样,获取局部动态高清图像;个体特征采集单元,用于对局部动态高清图像进行特征提取,生成运动标记体的特征信息。

16.与现有技术相比,本发明的有益效果是:本发明提供了一种基于ar智能眼镜的局部图像识别方法及系统,实现了基于ar眼镜的多设备协同对象自动识别追踪系统,大有效的提高了相关人员在公众人群较多的场合对待追踪人员的识别和追踪效率,解决了现有追踪方式的诸多问题。

附图说明

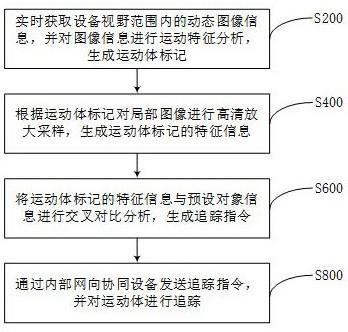

17.图1为一种基于ar智能眼镜的局部图像识别方法的流程框图。

18.图2为一种基于ar智能眼镜的局部图像识别方法中生成运动体标记的具体流程步骤框图。

19.图3为一种基于ar智能眼镜的局部图像识别方法中生成特征信息的具体流程步骤框图。

20.图4为一种基于ar智能眼镜的局部图像识别方法中输出追踪指令的具体流程步骤框图。

21.图5为一种基于ar智能眼镜的局部图像识别系统的结构框图。

22.图6为一种基于ar智能眼镜的局部图像识别系统中全局构建模块的结构框图。

23.图7为一种基于ar智能眼镜的局部图像识别系统中采样识别模块的结构框图。

具体实施方式

24.为了使本发明的目的、技术方案及优点更加清楚明白,以下结合附图及实施例,对本发明进行进一步详细说明。应当理解,此处所描述的具体实施例仅仅用以解释本发明,并不用于限定本发明。

25.以下结合具体实施例对本发明的具体实现方式进行详细描述。

26.如图1所述,为本发明一个实施例提供的一种基于ar智能眼镜的局部图像识别方法,包括以下步骤:s200,实时获取设备视野范围内的动态图像信息,并对图像信息进行三维运动特征分析,生成运动体标记。

27.s400,对运动体标记进行动态图像采集,并提取运动体标记的特征信息。

28.s600,将运动体标记的特征信息与预设对象信息进行交叉对比分析,生成追踪指令。

29.s800,通过内部网向协同设备发送追踪指令,并对运动体进行追踪。

30.本发明实施例中,在步骤s200中,这里的设备指的是ar眼镜此类穿戴式的便携ar设备,这里以ar眼镜为例进行说明;本方法使用与实现的场景为至少含有一台ar具备该方法执行能力的ar眼镜,多台ar设备同时使用能够获得更好的使用效果,相关人员在进行使用时,佩戴ar眼镜对周边环境进行观察,寻找目标人物或对象出现,进行任务追踪,此时,佩戴的ar眼镜会对视线方向的图像进行不断的拍摄采集,通过对采集的图像进行处理,对图像中的移动物体进行判断和标记,以方便进行局部图像的采集识别,然后在步骤s400中,ar眼镜会对所有标记的移动物体(即方法中所描述的运动体标记)进行局部的高清图像采集,并通过该采集的图像进行特征分析提取该移动物体的特征信息,获取特征信息之后,步骤s600将特征信息与相关人员预先设置的所要进行追踪的人员特征信息进行比对识别,如果相同,则说明检索到了追踪人员,则对其进行持续追踪,防止目标丢失;其中s800中存在将追踪指令发送给协同设备的步骤,这里的协同设备指的是一同执勤任务中的其它相关人员所携带的ar设备,通过多台设备进行数据交换,能够使得设备群覆盖更大的扫描范围,提高追踪到所要追踪的人员的成功率,也一定程度上减少了追踪过程中目标丢失的情况的发生,即使其中一台设备的目标追踪丢失,依然可以通过其它协同设备获取目标的相对地理位置。

31.作为本发明另一个优选的实施例,所述动态图像信息为数个连续的以预设时间间隔采集的静态图像组合而成,所述预设时间间隔用以表征设备视野范围的运动角速度,所述预设时间间隔与设备视野范围的运动角速度呈反比关系设置。

32.本发明实施例中,对步骤s200中的动态图像信息进行了解释和说明,这里的动态图像指的是按预设时间间隔连续采集的静态图像的集合,而这里的预设时间间隔并不是恒定不变的时间间隔,在设备中设有速度传感器,其能够感知到设备也就是ar眼镜在佩戴者头上相对于佩戴者颈部的转动角速度,当佩戴者头部相对转动缓慢或相对静止时,ar眼镜中采集的真实环境画面中的环境变换速度就相对较慢,此时预设间隔时间较长,可以减轻设备的运行压力,提高检测准确率,对采集的运动体标记进行更好的识别;而当佩戴者转头速度极快时,因真实环境画面会快速的掠过ar眼镜的可视范围,因此此时需要更短的预设间隔时间让ar眼镜采集更多的静态图像以形成动态图像信息,完成后续步骤中三维空间模型的建立。

33.如图2所示,作为本发明另一个优选的实施例,所述动态图像信息还包括距离数据与设备位置信息,所述距离数据用以表征动态图像数据上各图像点距离设备的直线距离;所述对图像信息进行三维运动特征分析,生成运动体标记的步骤,具体包括:s202,实时记录并存储设备位置信息,建立三维空间模型,并生成设备运动轨迹。

34.s203,逐帧读取动态图像信息中的静态图像信息,并获取静态图像信息中的距离信息与设备位置信息。

35.s204,根据与设备位置信息相对应的静态图像信息中的距离信息在三维空间模型中建立实时物体模型,并存储。

36.s205,根据不断更新的实时物体模型生成物体模型运动轨迹。

37.s206,根据物体模型运动轨迹对处于运动状态的物体模型进行运动体标记。

38.本发明实施例中,是对步骤s200的具体拓展说明,步骤s200会自行建立一个三维空间模型,然后根据所采集的动态图像信息中的距离数据与位置信息结合设备自身的运动轨迹信息建立三维的空间模型,这里的位置信息表示的是相对于ar眼镜的正视方向的角度信息,距离数据则是指与ar眼镜的距离;随着实时变化更新的动态图像信息,在三维空间模型中会对周边环境进行一个大致的描绘,便会产生相对空间静止的物体和不断移动的物体,然后步骤对相对移动的物体进行标记,方便后续步骤的局部取样进行特征提取,静止的物体则作为环境内容不做处理。

39.如图3所示,作为本发明再一个优选的实施例,所述对运动体标记进行动态图像采集,并提取运动体标记的特征信息的步骤,具体包括:s401,根据实时物体模型获取运动体标记的相对位置与距离数据。

40.s402,根据运动体标记的相对位置与距离数据进行局部图像高清实时采样,获取局部动态高清图像。

41.s403,对局部动态高清图像进行特征提取,生成运动标记体的特征信息。

42.本发明实施例中,对提取特征信息的步骤进行了详细说明,当一个物体被进行运动体标记时,说明此时该物体已经被采集多组不同的相对位置信息和距离信息,而根据这多组数据便可以确定其相对于ar眼镜的相对位置,此时设置在ar眼镜上的具有高清图像采集功能的机构便会以此为基准进行定位放大和对焦,获取对象的高清图像,也就是ar眼镜整个视角中局部位置的高清图像,再通过对图像进行特征提取处理,便能够生成运动标记体的特征信息。

43.如图4所示,作为本发明再一个优选的实施例,所述方法预设有预设对象信息,所述预设对象信息为预先采集的追踪对象的特征信息,所述将运动体标记的特征信息与预设对象信息进行交叉对比分析,生成追踪指令的步骤,具体包括:s601,根据预设对象信息建立特征比对模型,所述特征比对模型用以表征与预设对象信息的重合度。

44.s602,获取运动体标记的特征信息,并根据特征比对模型对运动体标记的特征信息进行比对分析,生成比对结果。

45.s603,比对结果为高度重合,则生成提示信息,并输出追踪指令为追踪。

46.本发明实施例中,所说明的为对特征信息进行比对分析的过程,该技术基于现有技术,在对比分析完成后,如果为追踪目标,则通过闪烁ar眼镜显示屏或是声音提示的方式告知佩戴者以进行提醒,然后对对象进行持续追踪。

47.作为本发明再一个优选的实施例,所述通过内部网向协同设备发送追踪指令,并对运动体进行追踪的步骤,具体包括:当追踪指令为追踪时,提取对应运动体标记与追踪指令。

48.将运动体标记与追踪指令发送给协同设备。

49.根据对应的运动标记体信息在三维空间模型中进行持续追踪。

50.具体的来说,所述方法还包括:接收来自协同设备的运动体标记与追踪指令。

51.根据接收的运动体标记对三维空间模型中的运动体标记进行检索识别。

52.若三维空间模型中的运动体标记与接收的运动体标记一致,则在三维空间模型中进行持续追踪。

53.本发明实施例中,对多设备之间的协同方式进行了简单的步骤描述,即当某一设备检测到追踪对象时,会通过数据交换的方式使得另一个设备也对该对象进行同步追踪,这样能够大大的提升追踪效率,且多设备协同能够增加视野覆盖范围,防止目标的丢失。

54.如图5所示,本发明还提供了一种基于ar智能眼镜的局部图像识别系统,其包含:s100,全局构建模块,用于实时获取设备视野范围内的动态图像信息,并对图像信息进行运动特征分析,生成运动体标记。

55.s300,采样识别模块,用于根据运动体标记对局部图像进行高清放大采样,生成运动体标记的特征信息。

56.s500,追踪识别模块,用于将运动体标记的特征信息与预设对象信息进行交叉对比分析,生成追踪指令。

57.s700,协同追踪模块,用于通过内部网向协同设备发送追踪指令,并对运动体进行追踪。

58.作为本发明另一个优选的实施例,所述全局构建模块具体包括:s101,环境图像采集单元,用于实时获取设备视野范围内的动态图像信息。

59.s102,空间运动模型单元,用于实时记录并存储设备位置信息,建立三维空间模型,并生成设备运动轨迹;逐帧读取动态图像信息中的静态图像信息,并获取静态图像信息中的距离信息与设备位置信息;根据与设备位置信息相对应的静态图像信息中的距离信息在三维空间模型中建立实时物体模型,并存储;根据不断更新的实时物体模型生成物体模型运动轨迹。

60.s103,运动体识别单元,用于根据物体模型运动轨迹对处于运动状态的物体模型进行运动体标记。

61.本发明实施例中,这里的环境图像采集单元包含数个距离传感器,角度传感器和焦距不可变的广角图像采集镜头与cmos等。

62.作为本发明再一个优选的实施例,所述采样识别模块具体包括:s301,个体相对定位模块,用于根据实时物体模型获取运动体标记的相对位置与距离数据。

63.s302,个体图像采集单元,用于根据运动体标记的相对位置与距离数据进行局部图像高清实时采样,获取局部动态高清图像。

64.s303,个体特征采集单元,用于对局部动态高清图像进行特征提取,生成运动标记体的特征信息。

65.本发明实施例中,这里的个体图像采集单元包括焦距可变对焦可调的图像采集镜头与cmos等。

66.应该理解的是,虽然本发明各实施例的流程图中的各个步骤按照箭头的指示依次显示,但是这些步骤并不是必然按照箭头指示的顺序依次执行。除非本文中有明确的说明,这些步骤的执行并没有严格的顺序限制,这些步骤可以以其它的顺序执行。而且,各实施例中的至少一部分步骤可以包括多个子步骤或者多个阶段,这些子步骤或者阶段并不必然是在同一时刻执行完成,而是可以在不同的时刻执行,这些子步骤或者阶段的执行顺序也不必然是依次进行,而是可以与其它步骤或者其它步骤的子步骤或者阶段的至少一部分轮流或者交替地执行。

67.本领域普通技术人员可以理解实现上述实施例方法中的全部或部分流程,是可以通过计算机程序来指令相关的硬件来完成,所述的程序可存储于一非易失性计算机可读取存储介质中,该程序在执行时,可包括如上述各方法的实施例的流程。其中,本技术所提供的各实施例中所使用的对存储器、存储、数据库或其它介质的任何引用,均可包括非易失性和/或易失性存储器。非易失性存储器可包括只读存储器(rom)、可编程rom(prom)、电可编程rom(eprom)、电可擦除可编程rom(eeprom)或闪存。易失性存储器可包括随机存取存储器(ram)或者外部高速缓冲存储器。作为说明而非局限,ram以多种形式可得,诸如静态ram(sram)、动态ram(dram)、同步dram(sdram)、双数据率sdram(ddrsdram)、增强型sdram(esdram)、同步链路(synchlink) dram(sldram)、存储器总线(rambus)直接ram(rdram)、直接存储器总线动态ram(drdram)、以及存储器总线动态ram(rdram)等。

68.本领域技术人员在考虑说明书及实施例处的公开后,将容易想到本公开的其它实施方案。本技术旨在涵盖本公开的任何变型、用途或者适应性变化,这些变型、用途或者适应性变化遵循本公开的一般性原理并包括本公开未公开的本技术领域中的公知常识或惯用技术手段。说明书和实施例仅被视为示例性的,本公开的真正范围和精神由权利要求指出。

69.应当理解的是,本公开并不局限于上面已经描述并在附图中示出的精确结构,并且可以在不脱离其范围进行各种修改和改变。本公开的范围仅由所附的权利要求来限制。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1