一种头部三维重建方法及设备与流程

1.本技术涉及三维重建技术领域,尤其涉及一种头部三维重建方法及设备。

背景技术:

2.头部重建在游戏角色造型、虚拟现实应用、虚拟试衣、个性化塑像定制等方面具有广泛的应用。头部重建方式包括:1)采用专业造型软件(如maya、3ds max等)进行头部建模,这需要用户对软件本身有深入了解,并掌握相关的艺术知识,而且不易个性化定制;2)利用专业三维激光扫描设备采集的头部数据进行重建,由于激光扫描设备成本较高而无法普及;3)驱动数据库(人头数据库)中的头部模型运动进行重建,相对于前两种方式,更利于推广和应用。

3.利用参数化头部模型可以从单张图片中重建人体头部的三维模型生成人头数据库。参数化头部模型是指对预先采集的高精度三维人体头部数据进行降维分析(例如主成分分析法或者网络自编码等),得到一组基函数,对这组基函数进行线性或非线性混合,生成不同的头部模型。其中,基函数的混合参数作为人体头部的参数化表达。

4.一般的,利用参数化头部模型从单张图片中重建头部三维模型时,头部的几何形状会保持完整的拓扑形状,但对于头部的纹理数据,受限于相机拍摄角度,不能完整的获取人脸的纹理数据,因此,重建的头部三维模型(特别是侧脸区域)存在失真,影响重建模型的三维表达效果。

5.目前,解决头部三维模型失真的技术方案主要有两种,一种是通过单张图像,渲染3d头部模型从任意角度旋转到当前角度的带遮挡伪影和瑕疵的人脸图像,从而和原图像构建训练数据对,形成自我监督训练深度学习模型,基于训练好的深度学习模型进行侧脸生成及人脸补全,重建过程中用到了两次人脸纹理获取、两次三维空间旋转和两次渲染,保留了原有的纹理细节及光照,但是计算过程较为复杂,目前无法实时运行,在实时通讯场景应用性较差;二是对多相机采集的多张纹理图片按一定方式进行的区域融合,从而得到完整的人脸纹理数据,但纹理融合效果受限于采集设备的布置及采集场景的选取等,并且仅仅通过多角度布置的相机采集的图像进行纹理融合,在人脸快速运动时出现纹理偏差,导致人脸无法补全。

技术实现要素:

6.本技术实施例提供了一种头部三维重建方法及设备,用以对人脸的纹理数据进行补全,提高头部重建模型的真实性。

7.第一方面,本技术实施例提供一种头部三维重建方法,包括:

8.获取相机采集的原始图像,对所述原始图像进行人脸识别,得到人脸图像;

9.从所述人脸图像中提取驱动参数,并用提取的驱动参数驱动参数化头部模型运动,得到驱动后的头部三维几何模型,所述参数化头部模型是基于初始人脸图像中提取的头部参数预先构建的;

10.对所述人脸图像进行语义分割,得到各个独立的子区域;

11.根据所述各个子区域各自的像素点的颜色值与镜像像素点的颜色值的差值,分别对所述各个子区域进行纹理补全;

12.对补全后的各个子区域进行融合,得到人脸的完整纹理数据;

13.根据所述完整纹理数据渲染所述头部三维几何模型,得到重建后的头部稠密表面模型。

14.第二方面,本技术实施例提供一种重建设备,包括存储器、处理器;

15.所述存储器,被配置为存储计算机程序指令以及预设的参数化头部模型;

16.所述处理器,被配置为根据所述计算机程序指令,执行以下操作:

17.获取相机采集的原始图像,对所述原始图像进行人脸识别,得到人脸图像;

18.从所述人脸图像中提取驱动参数,并用提取的驱动参数驱动参数化头部模型运动,得到驱动后的头部三维几何模型,所述参数化头部模型是基于初始人脸图像中提取的头部参数预先构建的;

19.对所述人脸图像进行语义分割,得到各个独立的子区域;

20.根据所述各个子区域各自的像素点的颜色值与镜像像素点的颜色值的差值,分别对所述各个子区域进行纹理补全;

21.对补全后的各个子区域进行融合,得到人脸的完整纹理数据;

22.根据所述完整纹理数据渲染所述头部三维几何模型,得到重建后的头部稠密表面模型。

23.第三方面,本技术提供一种计算机可读存储介质,计算机可读存储介质存储有计算机可执行指令,计算机可执行指令用于使计算机执行本技术实施例提供的头部三维重建方法。

24.本技术的上述实施例中,通过识别原始图像得到人脸图像,利用从人脸图像中提取的驱动参数驱动基于头部参数预先构建的参数化头部模型运动,得到头部三维几何模型,并对人脸图像进行语义解析,得到各个独立的子区域,考虑到面部角度与相机角度存在偏差,在一定程度上导致面部(特别是侧脸区域)纹理数据缺失,因此,利用人脸的对称性和肤色一致性,根据各个子区域各自的像素点的颜色值与镜像像素点的颜色值的差,分别对各个子区域进行了纹理补全,得到人脸的完整纹理数据,基于完整纹理数据渲染头部三维几何模型,提高了重建的头部稠密表面模型的真实性,进而增强了远程三维交互的沉浸感。

附图说明

25.为了更清楚地说明本技术实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图是本技术的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动性的前提下,还可以根据这些附图获得其他的附图。

26.图1示例性示出了本技术的实施例提供的重建系统架构图;

27.图2示例性示出了本技术实施例提供的头部三维重建方法流程图;

28.图3示例性示出了本技术实施例提供的三种头部参数与头部模型的关系示意图;

29.图4a示例性示出了本技术实施例提供的人脸语义分割示意图;

30.图4b示例性示出了本技术实施例提供的另一人脸语义分割示意图;

31.图5示例性示出了本技术实施例提供的空洞区域确定示意图;

32.图6示例性示出了本技术实施例提供的另一空洞区域确定示意图;

33.图7示例性示出了本技术实施例提供的补全纹理数据的完整流程图;

34.图8示例性示出了本技术实施例提供的重建设备硬件结构图。

具体实施方式

35.为使本技术的目的、实施方式和优点更加清楚,下面将结合本技术示例性实施例中的附图,对本技术示例性实施方式进行清楚、完整地描述,显然,所描述的示例性实施例仅是本技术一部分实施例,而不是全部的实施例。

36.基于本技术描述的示例性实施例,本领域普通技术人员在没有作出创造性劳动前提下所获得的所有其他实施例,都属于本技术所附权利要求保护的范围。此外,虽然本技术中公开内容按照示范性一个或几个实例来介绍,但应理解,可以就这些公开内容的各个方面也可以单独构成一个完整实施方式。

37.需要说明的是,本技术中对于术语的简要说明,仅是为了方便理解接下来描述的实施方式,而不是意图限定本技术的实施方式。除非另有说明,这些术语应当按照其普通和通常的含义理解。

38.此外,术语“包括”和“具有”以及他们的任何变形,意图在于覆盖但不排他的包含,例如,包含了一系列组件的产品或设备不必限于清楚地列出的那些组件,而是可包括没有清楚地列出的或对于这些产品或设备固有的其它组件。

39.本技术中使用的术语“模块”,是指任何已知或后来开发的硬件、软件、固件、人工智能、模糊逻辑或硬件或/和软件代码的组合,能够执行与该元件相关的功能。

40.本技术实施例提供一种头部三维重建方法及设备,通过对人脸图像进行语义分割,区分眉毛、眼睛、鼻子、嘴唇、耳朵、脸颊、头发、配饰等子区域,利用人脸对称性和肤色一致性,对各个子区域中缺失的纹理数据进行补全,并对补全后的各个子区域的纹理数据进行融合,得到人脸的完整纹理数据,在参数化头部模型的基础上,对驱动后的头部三维集合模型进行纹理渲染,从而保证在头部拓扑形状不变的情况下,提高重建模型的真实感。相对于采用深度学习算法来解决头部失真,无需预先构建训练样本进行模型训练,计算过程简单,实时性强;相对于对多相机拍摄多张图像的进行融合,降低了设备配置要求,且适用于实时运动的场景。

41.下面对本技术实施例中的名词给出解释说明。

42.双色反射模型:用来描述非匀质物体表面的物理光照现象,光线在经过物体表面反射后可能发生漫反射和镜面反射两种情况,反射光的光谱成分由这两部分光的光谱成分共同决定。本技术实施例中,人体为非匀质物体。

43.漫反射:是入射光线进入物体表面经过多次折反射吸收后返回物体表面的光,其光谱成分由物体材质的反射特性决定的。

44.镜面反射:是入射光线在物体表面的直接反射,与物体表面相对于光源位置的朝向、粗超程度有关,其光谱成分近似于光源的光谱成分。

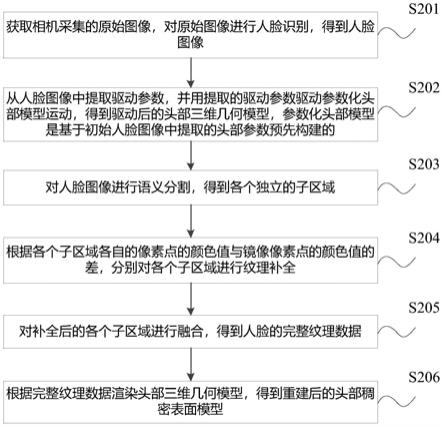

45.下面结合附图详细描述本技术的实施例。

46.图1示例性示出了本技术实施例提供的重建系统架构图;如图1所示,相机100实时采集运动过程中目标对象的原始图像,并将采集的原始图像通过有线或无线的方式传输给重建设备200,由重建设备200基于接收的原始图像重建头部稠密表面模型。

47.需要说明的是,本技术实施例提供的重建设备200仅是一种示例,包括但不限于具有交互功能的笔记本电脑、台式机、平板、智能手机、vr/ar眼镜等具有交互功能的显示终端。

48.需要说明的是,对于具有摄像头的重建设备,也可以由重建设备采集目标对象的原始图像。

49.图2示例性示出了本技术实施例提供的头部三维重建方法流程图,如图2所示,该流程由重建设备执行,主要包括以下几步:

50.s201:获取相机采集的原始图像,对原始图像进行人脸识别,得到人脸图像。

51.在s201中,要解决头部模型失真,需要对原始图像进行分割与识别,得到人脸图像。人脸图像的获取方式包括但不限于模型检测法(例如隐马尔可夫模型(hidden markov model,hmm,hmm)、支持向量机(support vector machine,svm)等)、边缘特征检测(例如canny边缘检测、sobel边缘检测等)、统计理论方法(例如贝叶斯学习法、k

‑

means聚类法等)等。本技术的一些实施例考虑到图像采集时光照、姿态等因素的影响,还采用卷积神经网络(convolutional neural networks,cnn)(例如dlib、libfacedetection等开源库)进行人脸的识别与输出。

52.在一些实施例中,图像采集的过程受到采集场景光照的影响,人体表面的光照强度实际上由漫反射光和镜面反射光线性组合而成,其中漫反射光代表的是人体表面的颜色,镜面反射光代表的是光源色度。由于人体表面材质以及各器官组件与光源的角度不同,人体不同部位的亮度有所差别。为了减小光照对纹理数据的影响,需要对人脸图像进行去高光处理。

53.一种可选的方式为,利用镜面反射估计出光源色度后,结合双色反射模型和人脸图像的颜色信息,对人脸图像进行高光去除。

54.另一种可选的方式为,预先建立人脸图像的高光分布图数据集,利用循环对抗学习生成网络(cycle generator adversarial networks,cyclegan)学习镜面反射和漫反射之间的关系,进一步地,基于镜面反射和漫反射之间的关系,对人脸图像进行高光去除。

55.s202:从人脸图像中提取驱动参数,并用提取的驱动参数驱动参数化头部模型运动,得到驱动后的头部三维几何模型。

56.在s202中,参数化头部模型是基于初始人脸图像中提取的头部参数预先构建的。经典的参数化头部模型主要包括三维可变形人脸模型(3d morphable face model,3dmm)、flame模型等,头部参数主要包括头部形状参数、面部表情参数、头部位姿参数,脸部的形状可以看作这三个参数共同作用的结果。

57.其中,参数化头部模型通过少量的参数表达一个具有实时非刚性变形特点的人体头部模型,可以以单张图片为基础生成拓扑一致的头部三维几何模型,并且不受不可见区域几何缺失的影响。

58.在s202中,采用基于flam模型构建的参数化头部模型。其中,参数化头部模型由标准的线性混合蒙皮(linear blend skinning,lbs)和混合形状(blend shape)两部分构成,

其采用的标准网格模型中网格顶点数为n=5023,关节数为k=4(分别位于颈部、下颚和两个眼球)。参数化头部模型公式为:

[0059][0060][0061]

其中,表示头部形状参数,表示头部姿态参数(包括头部骨架的运动参数),为面部表情参数。可以唯一标识头部三维几何模型的一个顶点坐标。w()表示线性蒙皮函数,用于将头部模型网格t沿关节进行变换,j()表示预测不同头部关节点位置的函数,t表示头部模型网格,b

s

()表示头部形状参数对头部模型网格t的影响函数,b

p

()表示头部姿态参数对头部模型网格t的影响函数,b

e

()表示面部表情参数对头部模型网格t的影响函数,tp

(

)表示在头部形状参数、头部姿态参数和面部表情参数的共同作用下对头部模型网格t进行形变的函数,s、p、e、ω分别表示头部形状权重、头部姿态权重、面部表情权重,蒙皮权重。s、p、e、ω是通过对预先构建的头部样本数据训练得到的。

[0062]

图3示例性示出了本技术实施例提供的三种头部参数与头部模型的关系示意图,其中,(a)部分表示头部形状参数对几何模型的影响,(b)部分表示头部姿态参数对几何模型的影响,(c)部分表示面部表情参数对几何模型的影响。

[0063]

在s202中,基于预先构建的参数化头部模型,从实时采集的人脸图像(rgb图像)中提取驱动参数,包括头部位姿参数面部表情参数通过提取的驱动参数驱动参数化头部模型运动,得到驱动后头部三维几何模型运动。

[0064]

在一些实施例中,当使用的相机为rgbd相机时,得到的初始人脸图像为带有深度信息的rgbd人脸图像,可根据rgbd人脸图像中的深度信息优化参数化头部模型。具体的,从rgbd人脸图像中提取人脸的深度信息,将提取的深度信息映射为人脸的头部参数,利用映射后的头部参数优化从rgb图像中提取的头部形状参数、面部表情参数、头部位姿参数,从而弥补参数化头部模型相对粗糙的结果,提高头部的几何精度,进而增强头部三维几何模型的真实感。

[0065]

s203:对人脸图像进行语义分割,得到各个独立的子区域。

[0066]

在s203中,人脸解析是语义图像分割的一种特殊情况,给定一张人脸图像,计算不同语义成分(如头发、面部皮肤、眼睛、眉毛、鼻子、嘴、耳朵、脸颊等,其中,鼻子、眼睛、嘴巴等器官视为人脸的内部组件,头发、帽子、面部皮肤等视为人脸的外部组件)在人脸图像中的像素级标签映射。

[0067]

具体实施时,采用感兴趣区域正切形变法(region of interest tanh

‑

warping,roi tanh

‑

warping)将人脸图像形变到预设尺度,然后输入至训练好的解析模型对人脸进行语义分割,得到头发、面部皮肤、眼睛、眉毛、鼻子、嘴、耳朵等多个子区域,再通过roi tanh

‑

warping的逆函数将分割后的人脸图像形变回去。如图4a所示,(a)部分为原始人脸图像,(b)部分为分割后的图像。

[0068]

在一些实施例中,考虑到人脸图像的全局特征,对人脸图像进行语义分割时,也可得到头部配饰(如帽子、发夹等)子区域,如图4b所示。

[0069]

s204:根据各个子区域各自的像素点的颜色值与镜像像素点的颜色值的差值,分

别对各个子区域进行纹理补全。

[0070]

人脸纹理数据的缺失主要来源于面部角度与相机(单相加)角度偏差过大,在一定程度上导致面部(特别是耳朵、脸颊的侧脸区域)出现空洞及条纹状的纹理缺失。利用人脸肤色一致性及人脸对称性,根据各个子区域各自的像素点的颜色值与镜像像素点的颜色值的差,可分别对各个子区域进行纹理补全。由于各个子区域相互独立,且逐帧人脸图像的同一子区域在时域上可进行纹理叠加(例如,第一帧人脸图像中鼻子的子区域和第二帧人脸图像中鼻子的子区域进行纹理加权),因此,各个子区域可分别进行补全。

[0071]

下面针对各个子区域中的任意一个子区域为例,描述纹理补全过程。

[0072]

从子区域中获取任意一个像素点,确定获取的像素点的颜色值与像素点的镜像像素点的颜色值的第一差值,将第一差值与预设颜色阈值进行比较,若第一差值大于预设颜色阈值,表明对称的两像素点的肤色差距较大,不满足肤色一致性,则从获取的像素点的目标邻域内选取预设数目的临近像素点,并分别确定各个临近像素点的颜色值与各自镜像像素点的颜色值的第二差值,若各个第二差值中大于预设像素阈值的第二差值对应的临近像素点的个数大于预设值,则确定目标邻域为空洞区域,补全空洞区域的纹理数据,得到纹理补全后的子区域。

[0073]

可选的,镜像像素点为同一子区域内的像素点,如图5所示,点q为鼻子子区域内的一个像素点,其镜像像素点为q’,点q与点q’的颜色值的差值大于预设颜色阈值,点q的目标邻域用不规则实线圈出,并从目标邻域内选取了n(n=6)个临近像素点,其中,有5个临近像素点(在图5中用虚线圆圈表示)与其各自的镜像像素点的颜色差值大于预设像素阈值,大于预设值4,在而确定目标邻域为需要进行纹理补全的空洞区域。

[0074]

可选的,镜像像素点为不同子区域内的像素点,如图6所示,点p为左耳子区域内的一个像素点,其镜像像素点p’为右耳子区域内的像素点,点p与点p’的颜色值的差值大于预设颜色阈值,点p的目标邻域用不规则实线圈出,并从目标邻域内选取了n(n=6)个临近像素点,其中,有5个临近像素点(在图6中用虚线圆圈表示)与其各自的镜像像素点的颜色差值大于预设像素阈值,大于预设值4,在而确定目标邻域为需要进行纹理补全的空洞区域。

[0075]

进一步地,确定空洞区域后,根据预设的初始颜色值、人脸图像的颜色均值、以及多帧人脸图像中子区域的颜色加权值,补全空洞区域的纹理数据。补全公式如下:

[0076]

t

c

=t+ε(x)+θ

ꢀꢀꢀ

公式3

[0077]

其中,t表示预设的初始颜色值,ε(x)表示该像素点对应的子区域的颜色加权值,θ表示人脸图像的颜色均值。

[0078]

其中,预设的初始颜色值是根据人脸纹理模板设置的。人脸纹理模板主要利用人脸图像数据集进行颜色加权,生成包含完整纹理数据的纹理模板,预设的初始颜色值为人脸图像数据集加权后的颜色均值。

[0079]

在本技术的实施例中,因相机实时采集交互过程中原始图像,可得到多帧序列人脸图像,因此,可对多帧人脸图像中的同一子区域的颜色值进行加权计算。具体的,假设第一帧人脸图像作为起始图像,对多帧人脸图像的各个子区域中的同一子区域的颜色值进行加权,分别得到各个子区域加权后的颜色值。其中,多帧人脸图像可以是连续的多帧人脸图像,也可以是非连续的多帧人脸图像。

[0080]

例如,将第一帧人脸图像至第10帧人脸图像中的鼻子子区域的颜色值进行加权计

算,得到加权后鼻子子区域的颜色值,将第一帧人脸图像至第10帧人脸图像中的左耳子区域的颜色值进行加权计算,得到加权后左耳子区域的颜色值。

[0081]

需要说明的是,本技术实施例对起始图像的选取不做限制性要求,例如,还可以选取人脸可见区域范围最大的图像作为起始图像。

[0082]

在一些实施例中,由于遮挡或旋转角度的问题,当从子区域中获取任意一个像素点为不存在对应镜像像素点的单一像素点时,将单一像素点的颜色值设置为预设的初始颜色值。

[0083]

在另一些实施例中,当从子区域中获取任意一个像素点存在对应镜像像素点,但不为空洞区域内的有效像素点时,根据人脸图像的颜色均值、以及多帧人脸图像中子区域的颜色加权值,确定有效像素点的颜色值。

[0084]

s205:对补全后的各个子区域进行融合,得到人脸的完整纹理数据。

[0085]

在s204中,采用泊松融合算法(poisson blending)各个子区域的纹理数据进行融合,从而得到人脸的完整纹理数据。

[0086]

s206:根据完整纹理数据渲染头部三维几何模型,得到重建后的头部稠密表面模型。

[0087]

在s205中,根据完整纹理数据渲染头部三维几何模型,提高了头部稠密表面模型的真实性,进而增强了交互过程中的沉浸感。

[0088]

人脸纹理数据的完整性直接影响了重建模型的真实性,在本技术的实施例中,利用人脸的对称性和肤色一致性进行纹理补全。图7示例性示出了本技术实施例提供的补全纹理数据的完整流程图,如图7所示,主要包括以下几步:

[0089]

s701:根据人脸图像中像素点的颜色值,确定人脸图像的颜色均值。

[0090]

s702:获取预设的纹理模板,得到预设的初始颜色值。

[0091]

s703:选取初始图像,对多帧人脸图像中各个子区域中相同的子区域进行颜色加权,分别得到各个子区域各自的颜色加权值。

[0092]

该步骤中,初始图像可以为第一帧图像,也可以为人脸可见区域面积最大的图像。各个子区域为人脸图像予以分割后的区域,包括头发、面部皮肤、眼睛、眉毛、鼻子、嘴、耳朵等多个子区域。

[0093]

s704~s705:针对各个子区域中的任意一个子区域,从该子区域中获取任意一个像素点,并确定获取的像素点是否为不存在镜像像素点的单一像素点,若是,执行s706,否则执行s707。

[0094]

s706:将单一像素点的颜色值设置为预设的初始颜色值,以补全单一像素点的纹理数据。

[0095]

s707~s708:确定获取的像素点的颜色值与像素点的镜像像素点的颜色值的第一差值,并确定第一差值是否大于预设颜色阈值,若是,执行s709,否则s712。

[0096]

该步骤中,若第一差值大于预设颜色阈值,根据人脸的对称性和肤色一致性,表明该像素点为无效的空洞点。

[0097]

s709:从获取的像素点的目标邻域内选取预设数目的临近像素点,并分别确定各个临近像素点的颜色值与各自镜像像素点的颜色值的第二差值。

[0098]

s710:确定各个第二差值中大于预设颜色阈值的第二差值对应的临近像素点的个

数是否大于预设值,若是,执行s711,否则,表明获取的像素点为有效像素点,执行s712。

[0099]

该步骤中,若各个第二差值中大于预设颜色阈值的第二差值对应的临近像素点的个数超过预设值,表明目标邻域内空洞点较多,该目标邻域可能为空洞区域,纹理确实严重,需要进行纹理补全。

[0100]

s711:确定目标邻域为空洞区域,根据预设的初始颜色值、人脸图像的颜色均值、以及多帧人脸图像中该像素点对应的子区域的颜色加权值,补全空洞区域的纹理数据。

[0101]

s712:根据人脸图像的颜色均值、以及多帧人脸图像中该像素点对应的子区域的颜色加权值,确定有效像素点的颜色值。

[0102]

基于相同的技术构思,本技术实施例提供一种重建设备,该重建设备可执行本技术实施例提供的头部三维重建方法,并能达到相同的技术效果,在此不再重复。

[0103]

参见图8,该重建设备包括存储器801以及处理器802,存储器801被配置为存储计算机存续指令以及预先构建的参数化头部模型,处理器802被配置为根据存储器801存储的计算机程序指令,执行以下操作:

[0104]

获取相机采集的原始图像,对原始图像进行人脸识别,得到人脸图像;

[0105]

从人脸图像中提取驱动参数,并用提取的驱动参数驱动参数化头部模型运动,得到驱动后的头部三维几何模型,参数化头部模型是基于初始人脸图像中提取的头部参数预先构建的;

[0106]

对人脸图像进行语义分割,得到各个独立的子区域;

[0107]

根据各个子区域各自的像素点的颜色值与镜像像素点的颜色值的差值,分别对各个子区域进行纹理补全;

[0108]

对补全后的各个子区域进行融合,得到人脸的完整纹理数据;

[0109]

根据完整纹理数据渲染头部三维几何模型,得到重建后的头部稠密表面模型。

[0110]

可选的,处理器802根据各个子区域各自的像素点的颜色值与镜像像素点的颜色值的差值,分别对各个子区域进行纹理补全,具体被配置为:

[0111]

针对各个子区域中的任意一个子区域,从子区域中获取任意一个像素点,确定获取的像素点的颜色值与像素点的镜像像素点的颜色值的第一差值;

[0112]

若第一差值大于预设颜色阈值,则从像素点的目标邻域内选取预设数目的临近像素点,并分别确定各个临近像素点的颜色值与各自镜像像素点的颜色值的第二差值;

[0113]

若各个第二差值中大于预设颜色阈值的第二差值对应的临近像素点的个数大于预设值,则确定目标邻域为空洞区域,补全空洞区域的纹理数据,得到纹理补全后的子区域。

[0114]

可选的,处理器802补全空洞区域的纹理数据,具体被配置为:

[0115]

根据预设的初始颜色值、人脸图像的颜色均值、以及多帧人脸图像中子区域的颜色加权值,补全空洞区域的纹理数据。

[0116]

可选的,处理器802还被配置为:

[0117]

针对子区域中不存在对应镜像像素点的单一像素点,将单一像素点的颜色值设置为预设的初始颜色值;以及

[0118]

针对存在对应镜像像素点但不为空洞区域内的有效像素点,根据人脸图像的颜色均值、以及多帧人脸图像中子区域的颜色加权值,确定有效像素点的颜色值。

[0119]

可选的,相机为rgbd相机时,初始人脸图像为rgbd人脸图像,处理器802基于初始人脸图像中提取的头部参数预先构建参数化头部模型,具体被配置为:

[0120]

从rgbd人脸图像中提取人脸深度信息;

[0121]

根据人脸深度信息优化头部参数;

[0122]

基于优化后的头部参数预先构建参数化头部模型。

[0123]

可选的,头部参数包括头部形状参数、头部姿态参数、面部表情参数,参数化头部模型公式为:

[0124][0125][0126]

其中,表示头部形状参数,表示头部姿态参数,为面部表情参数,w()表示线性蒙皮函数,j()表示预测不同头部关节点位置的函数,t表示头部模型网格,b

s

()表示头部形状参数对头部模型网格t的影响函数,b

p

()表示头部姿态参数对头部模型网格t的影响函数,b

e

()表示面部表情参数对头部模型网格t的影响函数,t

p

()表示在头部形状参数、头部姿态参数和面部表情参数的共同作用下对头部模型网格t进行形变的函数,s、p、e、ω分别表示头部形状权重、头部姿态权重、面部表情权重,蒙皮权重。

[0127]

需要说明的是,图8仅示出了实施本技术实施例所必须的硬件,除此之外,还可包括显示器、控制器、扬声器等常规硬件。

[0128]

需要说明的是,本技术实施例上述涉及的处理器可以是中央处理器(central processing unit,cpu),通用处理器,数字信号处理器(digital signal processor,dsp),专用集成电路(application

‑

specific integrated circuit,asic),现场可编程门阵列(field programmable gate array,fpga)或者其他可编程逻辑器件、晶体管逻辑器件、硬件部件或者其任意组合。其可以实现或执行结合本技术公开内容所描述的各种示例性的逻辑方框,模块和电路。处理器也可以是实现计算功能的组合,例如包含一个或多个微处理器组合,dsp和微处理器的组合等等。其中,所述存储器可以集成在所述处理器中,也可以与所述处理器分开设置。

[0129]

本技术实施例还提供了一种计算机可读存储介质,计算机可读存储介质存储有计算机可执行指令,计算机可执行指令用于使计算机执行上述实施例中的方法。

[0130]

本技术实施例还提供一种计算机程序产品,用于存储计算机程序,该计算机程序用于执行前述实施例的方法。

[0131]

最后应说明的是:以上各实施例仅用以说明本技术的技术方案,而非对其限制;尽管参照前述各实施例对本技术进行了详细的说明,本领域的普通技术人员应当理解:其依然可以对前述各实施例所记载的技术方案进行修改,或者对其中部分或者全部技术特征进行等同替换;而这些修改或者替换,并不使相应技术方案的本质脱离本技术各实施例技术方案的范围。

[0132]

为了方便解释,已经结合具体的实施方式进行了上述说明。但是,上述示例性的讨论不是意图穷尽或者将实施方式限定到上述公开的具体形式。根据上述的教导,可以得到多种修改和变形。上述实施方式的选择和描述是为了更好的解释原理以及实际的应用,从而使得本领域技术人员更好的使用所述实施方式以及适于具体使用考虑的各种不同的变

形的实施方式。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1