一种文本摘要生成模型训练系统和方法与流程

1.本技术涉及文本摘要生成模型建立技术领域,具体而言,涉及一种文本摘要生成模型训练系统和方法。

背景技术:

2.文本摘要获取旨在准确抓取文本关键信息,现有的文本摘要获取方法主要由抽取式和生成式两种,抽取式文本摘要获取是从文本中直接抽取相关的句子,生成式文本摘要获取是基于输入的文本生成一个摘要。随着自然语言处理(natural language processing,nlp)的发展,生成式文本摘要是目前主流的文本摘要获取方式。

3.目前大多数的生成式文本摘要获取模型都是采用transformer框架(一种模型结构),虽然这里模型在不同的文本理解任务中很受欢迎,但该方式存在两个方面的问题:1、在使用过程中表现效果不佳,主要原因在于模型对不同噪音的鲁棒性很差,如数据损坏、分布不均衡等;2、由于基于transformer(transformer-based)的句向量由预训练模型的字向量或词向量组合而成,因而会导致句向量的全局语义弱,而文本摘要的获取又是一个非常需要全局语义的下游任务。

4.针对相关技术中生成式文本摘要获取的鲁棒性差和句向量的全局语义弱的问题,目前尚未提出有效的解决方案。

技术实现要素:

5.本技术的主要目的在于提供一种文本摘要生成模型训练系统和方法,以解决相关技术中鲁棒性差和句向量的全局语义弱的问题。

6.为了实现上述目的,第一方面,本技术提供了一种文本摘要生成模型训练系统,该系统包括:文本增强模块,用于对当前原始训练文本以句级别分别进行两次数据增强,得到两个当前训练文本增强数据;文本编码模块,用于结合当前训练文本过程损失值对所述两个当前训练文本增强数据分别进行文本编码,得到对应的两个当前训练文本表征数据;文本解码模块,用于结合所述当前训练文本过程损失值对所述两个当前训练文本表征数据分别进行文本解码,得到对应的两个当前训练解码文本;以及训练控制模块,用于根据所述两个当前训练解码文本和相应的当前训练文本目标摘要计算得到新的训练文本过程损失值,用所述新的训练文本过程损失值对所述当前训练文本过程损失值进行更新,并根据所述新的训练文本过程损失值的大小进行训练控制。

7.根据本技术的文本摘要生成模型训练系统,所述训练控制模块计算得到新的训练文本过程损失值包括:根据所述两个当前训练解码文本中的第一当前训练解码文本和所述当前训练文本目标摘要利用自监督对比学习算法得到第一当前中间损失值;根据所述两个当前训练解码文本中的第二当前训练解码文本和所述当前训练文本目标摘要利用自监督对比学习算法得到第二当前中间损失值;以及将所述第一当前中间损失值和所述第二当前中间损失值叠加得到所述新的训练文本过程损失值。

8.根据本技术的文本摘要生成模型训练系统,该系统还包括:模型优化模块,用于根据所述两个当前训练文本增强数据和所述新的训练文本过程损失值计算得到新的优化损失值;其中,所述训练控制模块还用于用所述新的优化损失值对所述当前训练文本过程损失值进行更新,并根据所述新的优化损失值的大小进行训练控制。

9.根据本技术的文本摘要生成模型训练系统,所述模型优化模块计算得到新的优化损失值包括:根据所述两个当前训练文本增强数据中的第一当前训练文本增强数据和第二当前训练文本增强数据利用自监督对比学习算法得到对比损失值;以及根据所述对比损失值和所述新的训练文本过程损失值来计算所述新的优化损失值。

10.根据本技术的文本摘要生成模型训练系统,所述文本增强模块以句级别进行数据增强的方式包括:从所述当前原始训练文本中随机选取并复制一个或多个句子,将复制后的一个或多个句子随机插入所述当前原始训练文本中;从所述当前原始训练文本中随机选取一个句子,并变换所选取句子的位置;从所述当前原始训练文本中随机删除一个句子;以及从所述当前原始训练文本中随机选取一个句子,并将所选取句子的前向句子与后向句子互换位置,其中,所述前向句子为在所选取句子之前的句子,所述后向句子为在所选取句子之后的句子。

11.第二方面,本技术还提供了文本摘要生成模型训练方法,该方法包括:对当前原始训练文本以句级别分别进行两次数据增强,得到两个当前训练文本增强数据;结合当前训练文本过程损失值对所述两个当前训练文本增强数据分别进行文本编码,得到对应的两个当前训练文本表征数据;结合所述当前训练文本过程损失值对所述两个当前训练文本表征数据分别进行文本解码,得到对应的两个当前训练解码文本;以及根据所述两个当前训练解码文本和相应的当前训练文本目标摘要计算得到新的训练文本过程损失值,用所述新的训练文本过程损失值对所述当前训练文本过程损失值进行更新,并根据所述新的训练文本过程损失值的大小进行训练控制。

12.根据本技术的文本摘要生成模型训练方法,所述计算得到新的训练文本过程损失值包括:根据所述两个当前训练解码文本中的第一当前训练解码文本和所述当前训练文本目标摘要利用自监督对比学习算法得到第一当前中间损失值;根据所述两个当前训练解码文本中的第二当前训练解码文本和所述当前训练文本目标摘要利用自监督对比学习算法得到第二当前中间损失值;以及将所述第一当前中间损失值和所述第二当前中间损失值叠加得到所述新的训练文本过程损失值。

13.根据本技术的文本摘要生成模型训练方法,该方法还包括:根据所述两个当前训练文本增强数据和所述新的训练文本过程损失值计算得到新的优化损失值;以及用所述新的优化损失值对所述当前训练文本过程损失值进行更新,并根据所述新的优化损失值的大小进行训练控制。

14.根据本技术的文本摘要生成模型训练方法,所述计算得到新的优化损失值包括:根据所述两个当前训练文本增强数据中的第一当前训练文本增强数据和第二当前训练文本增强数据利用自监督对比学习算法得到对比损失值;以及根据所述对比损失值和所述新的训练文本过程损失值来计算所述新的优化损失值。

15.根据本技术的文本摘要生成模型训练方法,所述以句级别进行数据增强的方式包括:从所述当前原始训练文本中随机选取并复制一个或多个句子,将复制后的一个或多个

句子随机插入所述当前原始训练文本中;从所述当前原始训练文本中随机选取一个句子,并变换所选取句子的位置;从所述当前原始训练文本中随机删除一个句子;以及从所述当前原始训练文本中随机选取一个句子,并将所选取句子的前向句子与后向句子互换位置,其中,所述前向句子为在所选取句子之前的句子,所述后向句子为在所选取句子之后的句子。

16.本技术通过对训练文本分别进行两次数据增强后再进行编码和解码,进而得到文本摘要,通过更新迭代训练文本过程损失值使模型达到最优,既提高了文本摘要获取过程中的鲁棒性,又加强了句向量的全局语义,实现了自动获取文本摘要的最佳效果。

附图说明

17.构成本技术的一部分的附图用来提供对本技术的进一步理解,使得本技术的其它特征、目的和优点变得更明显。本技术的示意性实施例附图及其说明用于解释本技术,并不构成对本技术的不当限定。在附图中:

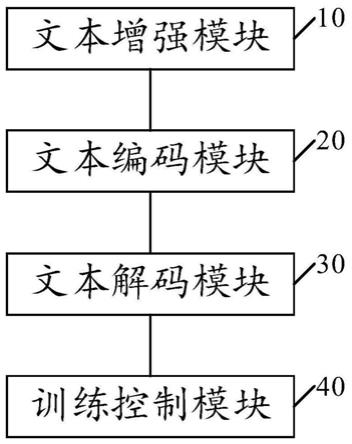

18.图1是根据本技术实施例提供的文本摘要生成模型训练系统的框图;以及

19.图2是根据本技术实施例提供的文本摘要生成模型训练方法的流程图。

具体实施方式

20.为了使本技术领域的人员更好地理解本技术方案,下面将结合本技术实施例中的附图,对本技术实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本技术一部分的实施例,而不是全部的实施例。基于本技术中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都应当属于本技术保护的范围。

21.需要说明的是,本技术的说明书和权利要求书及上述附图中的术语“第一”、“第二”等是用于区别类似的对象,而不必用于描述特定的顺序或先后次序。应该理解这样使用的数据在适当情况下可以互换,以便这里描述的本技术的实施例。此外,术语“包括”和“具有”以及他们的任何变形,意图在于覆盖不排他的包含,例如,包含了一系列步骤或单元的过程、方法、系统、产品或设备不必限于清楚地列出的那些步骤或单元,而是可包括没有清楚地列出的或对于这些过程、方法、产品或设备固有的其它步骤或单元。

22.在本技术中,术语“上”、“下”、“左”、“右”、“前”、“后”、“顶”、“底”、“内”、“外”、“中”、“竖直”、“水平”、“横向”、“纵向”等指示的方位或位置关系为基于附图所示的方位或位置关系。这些术语主要是为了更好地描述本技术及其实施例,并非用于限定所指示的装置、元件或组成部分必须具有特定方位,或以特定方位进行构造和操作。

23.并且,上述部分术语除了可以用于表示方位或位置关系以外,还可能用于表示其他含义,例如术语“上”在某些情况下也可能用于表示某种依附关系或连接关系。对于本领域普通技术人员而言,可以根据具体情况理解这些术语在本技术中的具体含义。

24.另外,术语“多个”的含义应为两个以及两个以上。

25.需要说明的是,在不冲突的情况下,本技术中的实施例及实施例中的特征可以相互组合。下面将参考附图并结合实施例来详细说明本技术。

26.图1是根据本技术实施例提供的文本摘要生成模型训练系统的框图,如图1所示,

该系统包括文本增强模块10、文本编码模块20、文本解码模块30和训练控制模块40。

27.文本增强模块10用于对当前原始训练文本以句级别分别进行两次数据增强,得到两个当前训练文本增强数据。以句级别进行数据增强,指的是以句子为单位进行数据增强,一般情况下,一个句子以句号结尾,在文档(例如一篇文章、一段话等)中识别出句子是本领域的常规技术。对当前原始训练文本以句级别分别进行两次数据增强得到两个当前训练文本增强数据,具体来说,通过两次数据增强可以得到第一当前训练文本增强数据和第二当前训练文本增强数据,两次数据增强的方式一般是不同的,对原始文本以句级别进行数据增强的方式有多种,具体将在下文中进行阐述。

28.文本编码模块20用于结合当前训练文本过程损失值对所述两个当前训练文本增强数据分别进行文本编码,得到对应的两个当前训练文本表征数据。当前训练文本过程损失值的初值可以预先设置一个值,文本编码模块20在第一次进行训练进行文本编码时可以采用预先设置的当前训练文本过程损失值的初值,之后就以迭代的方式进行。

29.文本编码模块20可以通过文本编码器来实现,本技术中所采用的文本编码器为本领域的现有设备。对第一当前训练文本增强数据进行文本编码后得到第一当前训练文本表征数据,对第二当前训练文本增强数据进行文本编码后得到第二当前训练文本表征数据。

30.进一步地,本技术中的文本编码模块20可以采用两个文本编码器,对每一个当前训练文本增强数据分别进行两次文本编码,那么,对第一当前训练文本增强数据进行两次文本编码后得到第一当前训练文本表征数据,对第二当前训练文本增强数据进行两次文本编码后得到第二当前训练文本表征数据。应当理解,在采用两个文本编码器的情况下,在解码过程中也相应地进行两次文本解码。

31.文本解码模块30用于结合当前训练文本过程损失值对两个当前训练文本表征数据分别进行文本解码,得到对应的两个当前训练解码文本。文本解码模块30是对文本编码模块20得到的当前训练文本表征数据进行文本解码的,对第一当前训练文本表征数据进行文本解码后得到第一当前训练解码文本,对第二当前训练文本表征数据进行文本解码后得到第二当前训练解码文本。

32.对应于文本编码模块20采用两个文本编码器,文本解码模块30采用两个文本解码器,那么对第一当前训练文本表征数据进行两次文本解码后得到第一当前训练解码文本,对第二当前训练文本表征数据进行两次文本解码后得到第二当前训练解码文本。

33.本领域技术人员应当理解,不同的当前训练文本过程损失值会引起文本编码模块20中权值的变化,在本技术中,当前训练文本过程损失值作为文本编码模块20的一个输入参数,当前训练文本过程损失值不同,文本编码模块20输出的解码文本也会有变化,与文本编码模块20类似,不同的过程损失值同样会引起文本解码模块30中权值的变化,为了使文本解码模块30的解码规则与文本编码模块20的编码规则相适应,文本解码模块30中所采用的过程损失值与文本编码模块20中所采用的过程损失值是相同的。

34.训练控制模块40用于根据两个当前训练解码文本和相应的当前训练文本目标摘要计算得到新的训练文本过程损失值,用新的训练文本过程损失值对当前训练文本过程损失值进行更新,并根据新的训练文本过程损失值的大小进行训练控制。需要说明的是,用新的训练文本过程损失值对当前训练文本过程损失值进行更新是个迭代的过程,也就是用新的训练文本过程损失值对当前训练文本过程损失值进行替换,每次采用不同的原始训练文

本,当前训练文本过程损失值也就是不同的,是用新的训练文本过程损失值替换的,直至结束训练,本技术中,可以预先设置训练文本过程损失值阈值,在新的训练文本过程损失值小于训练文本过程损失值阈值的情况下,停止训练,此时文本编码模块20和文本解码模块30中的权值也就确定了。应当理解,在初次进入训练过程时,可以对当前训练文本过程损失值预先设置初值,技术人员可以根据经验设置当前训练文本过程损失值的初值。

35.新的训练文本过程损失值可以首先传送至文本解码模块30,再通过文本解码模块30传送至文本编码模块20,这可以理解为反向传播,也可以是通过其它的消息传递的方式将新的训练文本过程损失值传送至文本解码模块30和文本编码模块20。

36.本领域技术人员应当理解,在整个训练过程中,是采用多个训练文本对模型进行训练的。

37.文本编码模块20和文本解码模块30结合当前训练文本过程损失值来进行编码和解码是本领域的常规技术,本技术中,文本编码模块20所采用的编码器和文本解码模块30所采用的解码器是现有技术可获取的设备,于此对编码器利用过程损失值进行编码的过程和解码器利用过程损失值进行解码的过程不予赘述。

38.训练控制模块40计算得到新的训练文本过程损失值包括:根据两个当前训练解码文本中的第一当前训练解码文本和当前训练文本目标摘要利用自监督对比学习算法得到第一当前中间损失值;根据两个当前训练解码文本中的第二当前训练解码文本和当前训练文本目标摘要利用自监督对比学习算法得到第二当前中间损失值;将第一当前中间损失值和第二当前中间损失值叠加得到新的训练文本过程损失值。

39.自监督对比学习算法是本领域的常规算法,在向自监督对比学习算法模型中输入解码文本和摘要的情况下,通过自监督对比学习算法模型就可以计算得到损失值,在本技术中,利用自监督对比学习算法模型,输入第一当前训练解码文本和当前训练文本目标摘要得到第一当前中间损失值m1,输入第二当前训练解码文本和当前训练文本目标摘要得到第二当前中间损失值m2,将第一当前中间损失值m1和第二当前中间损失值m2叠加得到新的训练文本过程损失值g。

40.本技术提供的文本摘要生成模型训练系统还包括模型优化模块(图中未示出),该模型优化模块用于根据两个当前训练文本增强数据和新的训练文本过程损失值计算得到新的优化损失值;其中,训练控制模块40还用于用新的优化损失值对当前训练文本过程损失值进行更新,并根据新的优化损失值的大小进行训练控制。

41.本技术中,可以用新的优化损失值来替换当前训练文本过程损失值,直至结束训练,本技术中,可以预先设置优化损失值阈值,在新的优化损失值小于优化损失值阈值的情况下,停止训练,此时文本编码模块20和文本解码模块30中的权值也就确定了。

42.本技术中,优化损失值阈值与训练文本过程损失值阈值可以相同,也可以不同,本领域技术人员可以根据实际情况来设定,在实际操作中,具体根据新的优化损失值来确定训练是否结束还是根据新的训练文本过程损失值来确定训练是否结束,本领域技术人员也可以根据实际情况来设定。

43.其中,模型优化模块计算得到新的优化损失值包括:根据两个当前训练文本增强数据中的第一当前训练文本增强数据和第二当前训练文本增强数据利用自监督对比学习算法得到对比损失值;根据对比损失值和新的训练文本过程损失值来计算新的优化损失

值。

44.在本技术中,利用自监督对比学习算法模型,输入第一当前训练文本增强数据和第二当前训练文本增强数据得到对比损失值y,其中,新的优化损失值s计算公式如下:

45.s=αy+(1-α)g

ꢀꢀꢀꢀꢀꢀ

(1)

46.在公式(1)中,s表示新的优化损失值,y表示对比损失值,g表示新的训练文本过程损失值,α表示超参数,α的取值范围为0到1之间,本领域技术人员可以根据实际情况对α进行取值。

47.文本增强模块10以句级别进行数据增强的方式包括:从当前原始训练文本中随机选取并复制一个或多个句子,将复制后的一个或多个句子随机插入当前原始训练文本中;从当前原始训练文本中随机选取一个句子,并变换所选取句子的位置;从当前原始训练文本中随机删除一个句子;从当前原始训练文本中随机选取一个句子,并将所选取句子的前向句子与后向句子互换位置,其中,前向句子为在所选取句子之前的句子,后向句子为在所选取句子之后的句子。

48.具体来说,本发明中所采用的数据增强的方式主要有四种:

49.1、随机插入:从当前原始训练文本中随机选取并复制一个或多个句子,将复制后的一个或多个句子随机插入当前原始训练文本中,例如,当前原始训练文本共有5句话,编号及顺序为12345,假设选取的句子为2,则执行随机插入后,得到的文本增强数据的文本为123245、122345、123425等;

50.2、随机变换:从当前原始训练文本中随机选取一个句子,并变换所选取句子的位置,例如,当前原始训练文本共有5句话,编号及顺序为12345,假设选取的句子为3,则执行随机变换后,得到的文本增强数据的文本为13245、31245、12435等。

51.3、随机删除:从当前原始训练文本中随机删除一个句子,例如,当前原始训练文本共有5句话,编号及顺序为12345,假设随机删除的句子为3号句子,则执行随机删除后,得到的文本增强数据的文本为1245。

52.4、文本旋转:从当前原始训练文本中随机选取一个句子,并将所选取句子的前向句子与后向句子互换位置,其中,前向句子为在所选取句子之前的句子,后向句子为在所选取句子之后的句子,例如,当前原始训练文本共有5句话,编号及顺序为12345,假设选取的句子为2,则前向句子及顺序为1,后向句子及顺序为345,在执行文本旋转后,得到的文本增强数据的文本为34521,在假设选取的句子为3,则前向句子及顺序为12,后向句子及顺序为45,在执行文本旋转后,得到的文本增强数据的文本为45312。

53.本技术中对当前原始训练文本进行数据增强的方式包括随机插入、随机变换、随机删除和文本旋转四种,每次进行数据增强的方式可以是不同的方式,也可以是相同的方式。

54.图2是根据本技术实施例提供的文本摘要生成模型训练方法的流程图,如图2所示,该方法包括:

55.步骤s201,对当前原始训练文本以句级别分别进行两次数据增强,得到两个当前训练文本增强数据;

56.步骤s202,结合当前训练文本过程损失值对两个当前训练文本增强数据分别进行文本编码,得到对应的两个当前训练文本表征数据;

57.步骤s203,结合当前训练文本过程损失值对两个当前训练文本表征数据分别进行文本解码,得到对应的两个当前训练解码文本;

58.步骤s204,根据两个当前训练解码文本和相应的当前训练文本目标摘要计算得到新的训练文本过程损失值;

59.步骤s205,用新的训练文本过程损失值对当前训练文本过程损失值进行更新;

60.步骤s206,根据新的训练文本过程损失值的大小进行训练控制。

61.其中,计算得到新的训练文本过程损失值包括:根据两个当前训练解码文本中的第一当前训练解码文本和当前训练文本目标摘要利用自监督对比学习算法得到第一当前中间损失值;根据两个当前训练解码文本中的第二当前训练解码文本和当前训练文本目标摘要利用自监督对比学习算法得到第二当前中间损失值;将第一当前中间损失值和第二当前中间损失值叠加得到新的训练文本过程损失值。

62.其中,本技术提供的文本摘要生成模型训练方法还包括:根据两个当前训练文本增强数据和新的训练文本过程损失值计算得到新的优化损失值;用新的优化损失值对当前训练文本过程损失值进行更新,并根据新的优化损失值的大小进行训练控制。

63.其中,计算得到新的优化损失值包括:根据两个当前训练文本增强数据中的第一当前训练文本增强数据和第二当前训练文本增强数据利用自监督对比学习算法得到对比损失值;根据对比损失值和新的训练文本过程损失值来计算新的优化损失值。

64.其中,以句级别进行数据增强的方式包括:从当前原始训练文本中随机选取并复制一个或多个句子,将复制后的一个或多个句子随机插入所述当前原始训练文本中;从当前原始训练文本中随机选取一个句子,并变换所选取句子的位置;从当前原始训练文本中随机删除一个句子;从当前原始训练文本中随机选取一个句子,并将所选取句子的前向句子与后向句子互换位置,其中,前向句子为在所选取句子之前的句子,后向句子为在所选取句子之后的句子。

65.需要说明的是,本发明提供的文本摘要生成模型训练方法的具体细节及益处与本发明提供的文本摘要生成模型训练系统类似,于此不予赘述。

66.以上所述仅为本技术的优选实施例而已,并不用于限制本技术,对于本领域的技术人员来说,本技术可以有各种更改和变化。凡在本技术的精神和原则之内,所作的任何修改、等同替换、改进等,均应包含在本技术的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1