一种基于文本的图像编辑方法和电子设备

1.本技术涉及图像处理领域,尤其涉及一种基于文本的图像编辑方法和电子设备。

背景技术:

2.众所周知,基于文本的图像编辑是一种根据给定文本编辑源图像的技术,该技术是多媒体领域的研究热点并具有重要的应用价值。现有基于注意的生成对抗网络(manipulating attention generative adversarial network,manigan)用于根据文本描述内容对待编辑的源图像进行图像编辑。但是,manigan在根据输入文本对源图像进行编辑时,输出的图像编辑结果往往不符合用户要求。

3.因此,如何使得manigan输出的图像编辑结果符合用户要求是当前急需解决的问题。

技术实现要素:

4.本技术提出了一种基于文本的图像编辑方法和电子设备,能够解决manigan输出的图像编辑结果不符合用户要求的问题。

5.第一方面,提供了一种基于文本的图像编辑方法,包括:获取目标源图像的图像整体特征和图像局部特征,以及目标文本的句子整体特征和句子词特征;根据所述图像整体特征、所述图像局部特征、所述句子整体特征和所述句子词特征,基于图像编辑模型对所述目标源图像进行编辑,得到目标编辑图像;其中,所述图像编辑模型包括:采样编码模块和至少一个级联的生成模块;所述图像编辑模型对所述目标源图像的处理过程包括:利用所述采样编码模块对所述图像整体特征、所述句子整体特征和所述图像局部特征进行采样编码处理,得到第一编辑图像,并输出所述第一编辑图像;响应于用户指令,将所述第一编辑图像、所述图像局部特征和所述句子词特征输入所述至少一个级联的生成模块中进行高维视觉特征提取,得到所述目标编辑图像,或者将所述目标源图像、所述图像局部特征和所述句子词特征输入到所述至少一个级联的生成模块中进行高维视觉特征提取,得到所述目标编辑图像。

6.上述方法可以由电子设备上的芯片执行。相比现有manigan根据文本对待编辑的源图像进行编辑并直接输出可能不符合用户要求的编辑结果,本技术在现有manigan中引入采样编码模块,形成改进的manigan;该采用编码模块会将中间编辑结果(即第一编辑图像)输出,以方便用户判断该中间编辑结果是否符合要求,若符合要求,则将中间编辑结果继续向至少一个级联的生成模块传递;若不符合要求,则不会将该中间结果继续向至少一个级联的生成模块传递,而是用目标源图像代替该中间编辑结果继续向至少一个级联的生成模块传递。由此可见,改进的manigan在根据目标文本对目标源图像编辑时,可以对中间编辑结果进行控制,并及时剔除不符合要求的中间编辑结果,以防止前一级输出不符合要求的结果影响后一级输出结果的准确性,从而为用户编辑出更加符合要求的目标编辑图像。

7.可选地,所述生成模块包括:第一自动解码器、第一自注意力模块、第二上采样模块和第二自动编码器,所述第一自动解码器用于恢复输入信息的高维视觉特征,得到第一高维特征图像,所述输入信息为第一编辑图像或者为前一层生成模块的输出信息;所述第一自注意力模块用于对所述第一高维特征图像和所述句子词特征进行融合以及处理,得到句子语义信息特征;所述第二上采样模块用于对所述句子语义信息特征进行特征融合和上采样处理,得到第二上采样结果;所述第二自动编码器用于对所述第二上采样结果进行高维视觉特征提取,得到输出信息,当所述生成模块为所述至少一个级联的生成模块中的最后一级生成模块时,所述输出信息为目标编辑图像。

8.可选地,所述第一自注意力模块包括:自注意力层和第一带噪声仿射组合模块,所述自注意力层用于对所述第一高维特征图像和所述句子词特征进行特征融合;所述第一带噪声仿射组合模块用于对所述自注意力层的输出结果与所述第一高维特征图像的拼接结果,以及所述图像局部特征进行特征融合。

9.在上述第一自注意力模块中引入第一带噪声仿射组合模块,该第一带噪声仿射组合模块通过引入高斯噪声能够增强生成模块编辑图像的可靠性,从而避免了生成模块因图像中存在随机噪声而影响编辑结果可靠性的情况出现。

10.可选地,所述采样编码模块包括:第一上采样模块和第一自动编码器,所述第一上采样模块用于对所述图像整体特征、所述句子整体特征和所述图像局部特征进行上采样处理,得到第一上采样结果;所述第一自动编码器用于根据所述第一上采样结果生成第一编辑图像。

11.可选地,所述第一上采样模块包括:多个相同的上采样层、第二带噪声仿射组合模块和第三带噪声仿射组合模块,第一上采样模块的输入是所述句子整体特征、所述图像整体特征和所述图像局部特征,所述多个相同的上采样层中相邻的两个上采样层中,后一上采样层的输入是前一上采样层的输出;所述第二带噪声仿射组合模块位于所述多个相同的上采样层中任意两个上采样层中间,用于对所述任意两个上采样层中前一上采样层输出的结果和所述图像局部特征进行特征融合;所述第三带噪声仿射组合模块用于对所述多个相同的上采样层中最后一个上采样层的输出结果和所述图像局部特征进行特征融合。

12.在第一上采样模块中引入第二带噪声仿射组合模块和第三带噪声仿射组合模块可以进一步对第一上采样模块中不同上采样层的输出结果进行视觉特征增强。

13.可选地,所述图像编辑模型还包括:细节修正模型,用于对所述目标编辑图像进行细节修改;所述细节修正模型用于处理所述图像局部特征、所述句子词特征和所述目标编辑图像,得到目标修正图像;所述细节修正模型包括:第一细节修正模块、第二细节修正模块、融合模块和生成器,其中,所述第一细节修正模块用于对所述图像局部特征、第一随机噪声和所述句子词特征进行细节修改,得到第一细节特征;所述第二细节修正模块用于对所述目标编辑图像对应的图像局部特征、第二随机噪声和所述句子词特征进行细节修改,得到第二细节特征;所述融合模块用于对所述第一细节特征和所述第二细节特征进行特征融合;所述生成器用于根据所述融合模块的输出结果生成所述目标修正图像。

14.在上述图像编辑模型中增加细节修正模型能够对图像编辑模型输出的目标编辑图像进行进一步的细节修改和增强,从而得到高分辨率的目标修正图像。

15.可选地,所述第一细节修正模块包括第四带噪声仿射组合模块、第五带噪声仿射

组合模块、第六带噪声仿射组合模块、第二自注意力模块、第一残差网络和第一线性网络;所述第四带噪声仿射组合模块用于对所述第一随机噪声和所述图像局部特征进行特征融合,得到第一融合特征;所述第二自注意力模块用于对所述第一融合特征和所述句子词特征进行特征融合;所述第五带噪声仿射组合模块对所述第二自注意力模块的输出结果与所述第一随机噪声的拼接结果、以及所述图像局部特征进行特征融合;所述第一残差网络用于对所述第五带噪声仿射组合模块的输出结果进行视觉特征提取;所述第一线性网络用于对所述图像局部特征进行线性变换;所述第六带噪声仿射组合模块用于对所述第一残差网络的输出结果和所述第一线性网络的输出结果进行特征融合。

16.在上述第一细节修正模块中增加多个带噪声仿射组合模块,可以增强细节修正模型的可靠性。

17.可选地,所述第二细节修正模块包括第七带噪声仿射组合模块、第八带噪声仿射组合模块、第九带噪声仿射组合模块、第三自注意力模块、第二残差网络和第二线性网络;所述第七带噪声仿射组合模块用于对所述第二随机噪声和所述目标编辑图像对应的图像局部特征进行特征融合,得到第一融合特征;所述第三自注意力模块用于对所述第一融合特征和所述句子词特征进行特征融合;所述第八带噪声仿射组合模块对所述第三自注意力模块的输出结果与所述第二随机噪声的拼接结果、以及所述目标编辑图像对应的图像局部特征进行特征融合;所述第二残差网络用于对所述第八带噪声仿射组合模块的输出结果进行视觉特征提取;所述第二线性网络用于对所述目标编辑图像对应的图像局部特征进行线性变换;所述第九带噪声仿射组合模块用于对所述第二残差网络的输出结果和所述第二线性网络的输出结果进行特征融合。

18.在上述第二细节修正模块中增加多个带噪声仿射组合模块,可以增强细节修正模型的可靠性。

19.可选地,所述细节修正模型的训练方式包括:根据有条件的生成器损失函数、无条件的生成器损失函数和语义对比函数训练所述细节修正模型的生成器;根据有条件的判别器损失函数和无条件的判别器损失函数训练所述细节修正模型的判别器。

20.上述根据有条件的生成器损失函数、无条件的生成器损失函数和语义对比函数训练所述细节修正模型的生成器,能够使得生成器生成的图像编辑结果(即目标编辑图像)更加符合目标文本描述的内容和用户要求。上述根据有条件的判别器损失函数和无条件的判别器损失函数训练所述细节修正模型的判别器,能够使得判断器的识别结果更加准确。

21.可选地,所述图像编辑模型的训练方法包括:利用预设的损失函数和训练集对初始模型进行训练,得到所述图像编辑模型;其中,所述预设的损失函数包括与n个子网络分别对应的子函数和n-1个自动编解码器的损失函数,所述初始模型包括n个子网络,所述n个子网络为所述采样编码模块和至少一个生成模块分别对应的初始模型;训练过程中,当第i个子网络的输出图像不满足预设条件时,采用第i+1至第n个子网络对应的子函数和第i个至第i+1个自动编解码器的损失函数,对初始模型进行训练,0≤i<n。

22.在上述图像编辑模型训练的过程中,对n个子网络进行训练是通过自动编解码器跳过输出结果不符合要求的前级子网络而优先训练后级子网络,由于跳过时使用目标源图像而不是中间编辑结果(比如,第一编辑图像),因此,能够避免潜在的前级子网络输出的错误结果向后级子网络传播。后级子网络优先训练能够给前级子网络带来更好的更新梯度,

从而使得前级子网络的收敛效果更好。

23.第二方面,提供了一种电子设备,包括用于执行第一方面中任一种方法的模块。

24.第三方面,提供了一种计算机可读存储介质,所述计算机可读存储介质存储了计算机程序,当所述计算机程序被处理器执行时,使得处理器执行第一方面中任一项所述的方法。

附图说明

25.为了更清楚地说明本技术实施例中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本技术的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动性的前提下,还可以根据这些附图获得其他的附图。

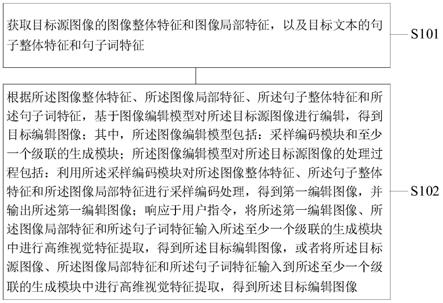

26.图1为本发明实施例中一种基于文本的图像编辑方法流程示意图;

27.图2为本发明实施例中图像编辑模型的结构示意图;

28.图3为本发明实施例中细节修正模型的结构示意图;

29.图4为本发明实施例中图像编辑模型对目标源图像的处理过程示意图;

30.图5为本发明实施例中一种电子设备的结构示意图。

具体实施方式

31.以下描述中,为了说明而不是为了限定,提出了诸如特定系统结构、技术之类的具体细节,以便透彻理解本技术实施例。然而,本领域的技术人员应当清楚,在没有这些具体细节的其它实施例中也可以实现本技术。在其它情况中,省略对众所周知的系统、装置以及方法的详细说明,以免不必要的细节妨碍本技术的描述。

32.应当理解,当在本技术说明书和所附权利要求书中使用时,术语“包括”指示所描述特征、整体、步骤、操作、元素和/或组件的存在,但并不排除一个或多个其它特征、整体、步骤、操作、元素、组件和/或其集合的存在或添加。

33.还应当理解,在本技术说明书和所附权利要求书中使用的术语“和/或”是指相关联列出的项中的一个或多个的任何组合以及所有可能组合,并且包括这些组合。

34.另外,在本技术说明书和所附权利要求书的描述中,术语“第一”、“第二”、“第三”等仅用于区分描述,而不能理解为指示或暗示相对重要性。

35.在本技术说明书中描述的参考“一个实施例”或“一些实施例”等意味着在本技术的一个或多个实施例中包括结合该实施例描述的特定特征、结构或特点。因此,在本说明书中的不同之处出现的语句“在一个实施例中”、“在一些实施例中”、“在其他一些实施例中”、“在另外一些实施例中”等不是必然都参考相同的实施例,而是意味着“一个或多个但不是所有的实施例”,除非是以其他方式另外特别强调。术语“包括”、“包含”、“具有”及它们的变形都意味着“包括但不限于”,除非是以其他方式另外特别强调。

36.基于文本的图像编辑是多媒体领域的研究热点并具有重要的应用价值。manigan用于根据文本描述内容对待编辑的源图像进行图像编辑。但是,现有manigan在根据文本描述内容对源图像进行编辑时无法对图像编辑的中间结果进行处理,往往导致manigan输出的图像编辑结果不符合用户要求。本技术为了解决现有manigan输出的图像编辑结果更加

符合用户要求,在现有manigan的多层级生成对抗网络中引入自动编解码器,该自动编解码器可以将中间编辑结果输出给用户,以方便用户对manigan中间输出的编辑结果进行直接控制,从而得到更加符合用户要求的目标编辑图像。

37.下面结合附图和具体实施例对本技术做进一步详细说明。

38.为了解决manigan输出的图像编辑结果不符合用户要求的问题,本技术提出了一种基于文本的图像编辑方法,如图1所示,该方法由电子设备执行,该方法包括:

39.s101,获取目标源图像的图像整体特征和图像局部特征,以及目标文本的句子整体特征和句子词特征。

40.示例性地,电子设备获取目标源图像的图像整体特征和图像局部特征,以及目标文本的句子整体特征和句子词特征。该目标源图像来自ms-coco(即microsoft common objects in context)数据集和cub200数据集;上述目标文本是指记录用户编辑目标源图像的文字信息,比如,目标源图像为一只鸟,若用户想要将这只鸟的羽毛染成红色和头部染成黄色,则可将这些编辑需求以文字的形式记录在目标文本中,即该目标文本的具体内容为将这只鸟的羽毛染成红色和头部染成黄色。

41.上述图像整体特征(即全局图像特征)是指能表示整幅图像的特征,用于描述图像颜色和形状等整体特征,比如,颜色特征、纹理特征和形状特征;上述图像局部特征(即局部图像特征)是图像特征的局部表达,它反映了图像上具有的局部特性。

42.通常情况下,可利用视觉几何组(visual geometry group,vgg)网络提取上述目标源图像的图像整体特征和图像局部特征;可利用一种特殊的循环神经网络(recurrent neural network,rnn),即长短期记忆(long short-termmemory,lstm)网络,来提取目标文本的句子整体特征和句子词特征。

43.s102,根据图像整体特征、图像局部特征、句子整体特征和句子词特征,基于图像编辑模型对目标源图像进行编辑,得到目标编辑图像;其中,图像编辑模型包括:采样编码模块和至少一个级联的生成模块;图像编辑模型对目标源图像的处理过程包括:利用采样编码模块对图像整体特征、句子整体特征和图像局部特征进行采样编码处理,得到第一编辑图像,并输出第一编辑图像;响应于用户指令,将第一编辑图像、图像局部特征和句子词特征输入至少一个级联的生成模块中进行高维视觉特征提取,得到目标编辑图像,或者将目标源图像、图像局部特征和句子词特征输入到至少一个级联的生成模块中进行高维视觉特征提取,得到目标编辑图像。

44.示例性地,如图2所示,目标源图像i是一张尺寸大小为128

×

128,通道数为3的小鸟图片,在该小鸟图片中,小鸟腹部的羽毛为白色,嘴巴为灰色,头部和颈部的羽毛均为灰白相间色;vgg网络对该128

×

128的目标源图像i进行特征提取,得到该目标源图像i对应的图像整体特征ci和图像局部特征mi,其中,该图像整体特征ci是一个128

×

1的列向量;图像局部特征mi的尺寸大小为128

×

128且通道数为128;又比如,目标文本t的具体内容为将小鸟腹部羽毛变成黄色、嘴巴变为黄色,以及头部和颈部的羽毛均变为灰黄相间色;lstm网络对该目标文本t进行特征提取,得到目标文本t对应的句子整体特征c

t

和句子词特征m

t

,其中,句子整体特征c

t

和句子词特征m

t

均为128

×

1的列向量。

45.如图2所示,图像编辑模型201包括:采样编码模块g

00

和至少一个级联的生成模块(比如,g

01

、g

02

),其中,采样编码模块g

00

包括第一上采样模块f0和第一自动编码器g0,该第一

上采样模块f0对图像整体特征ci和句子整体特征c

t

进行上采样处理,得到第一上采样结果;第一自动编码器g0对该第一上采样结果进行编码处理,并生第一编辑图像

46.可选地,如图2所示,第一上采样模块f0包括:多个相同的上采样层、第二带噪声仿射组合模块2011a和第三带噪声仿射组合模块2011b,第一上采样模块f0的输入是句子整体特征c

t

、图像整体特征ci和图像局部特征mi,多个相同的上采样层中相邻的两个上采样层中,后一上采样层的输入是前一上采样层的输出;第二带噪声仿射组合模块2011a位于多个相同的上采样层中任意两个上采样层中间,用于对任意两个上采样层中前一上采样层输出的结果和图像局部特征mi进行特征融合;第三带噪声仿射组合模块2011b用于对多个相同的上采样层中最后一个上采样层的输出结果和图像局部特征mi进行特征融合。

47.上述多个相同的上采样层可以是三个上采样层,也可以是四个上采样层,本技术对此不作任何限定,用户可以根据实际需求设定多个上采样层的具体数量。本技术仅以图2中第一上采样模块f0中包含4个上采样层为例,来说明该4个上采样层结合第二带噪声仿射组合模块2011a对句子整体特征c

t

、图像整体特征ci和图像局部特征mi进行特征提取以及特征融合的处理过程。

48.上述第二带噪声仿射组合模块2011a可以位于第一上采样模块f0中4个上采样层中任意两个上采样层中间,比如,图2中,第一上采样模块f0的4个上采样层中,前三个上采样层对输入128

×

1的图像整体特征ci和128

×

1的句子整体特征c

t

进行上采样处理,输出尺寸大小为32

×

32且通道数为64的内部特征(即32

×

32

×

64的内部特征);第二带噪声仿射组合模块2011a位于第一上采样模块f0中第三上采样层和第四上采样层之间;该第二带噪声仿射组合模块2011a根据图像局部特征mi对第三上采样层输出的上采样结果(即前三个上采样层输出的32

×

32

×

64的内部特征)进行视觉特征增强,得到32

×

32

×

64的第一增强上采样结果;该第一增强上采样结果先经过第四上采样层的上采样处理并输出64

×

64

×

32的视觉特征,该64

×

64

×

32的视觉特征再经过第三带噪声仿射组合模块2011b进行进一步地视觉特征增强并输出增强后的64

×

64

×

32的视觉特征;该第三带噪声仿射组合模块2011b根据图像局部特征mi对第四上采样层输出的上采样结果(即多个相同的上采样层中最后一个上采样层的输出结果)进行视觉特征增强。

49.上述第一自动编码器g0对第三带噪声仿射组合模块2011b输出的增强后的64

×

64

×

32的视觉特征进行特征提取和编码处理,并输出尺寸大小为64

×

64且通道数为3的第一编辑图像(即64

×

64

×

3的第一编辑图像)。用户可以通过直接观察64

×

64

×

3的第一编辑图像来判断其是否符合要求;若64

×

64

×

3的第一编辑图像符合用户的要求,则将该64

×

64

×

3的第一编辑图像输入至少一个级联的生成模块中进行后续处理,如图2中(ⅰ)所述;若64

×

64

×

3的第一编辑图像不符合用户的要求,则将该64

×

64

×

3的第一编辑图像舍弃并用128

×

128

×

3的目标源图像i代替第一编辑图像输入至生成模块g

01

中进行后续编辑处理,如图2中(ⅱ)所述,其中,由于采样编码模块g

00

生成的第一编辑图像被舍弃了,因此,将采样编码模块g

00

包含的网络结构用虚线框表示,以说明因第一编辑图像不

符合用户要求,故将采样编码模块g

00

生成第一编辑图像的步骤跳过,直接将128

×

128

×

3的目标源图像i输入至生成模块g

01

中进行图像编辑。由此可见,因采样编码模块g

00

生成第一编辑图像不符合要求而直接用128

×

128

×

3的目标源图像i代替第一编辑图像输入至生成模块g

01

进行图像编辑,从而避免了不符合用户要求的第一编辑图像(即错误的第一编辑图像)继续向后传播的情况。

50.示例性地,若用户判断64

×

64

×

3的第一编辑图像符合要求,则该用户会向电子设备发送确认指令,电子设备根据接收到用户发送的确认指令将64

×

64

×

3的第一编辑图像输入至少一个级联的生成模块中进行高维视觉特征提取,得到目标编辑图像,如图2中(ⅰ)所述;若用户判断64

×

64

×

3的第一编辑图像不符合要求,则该用户会向电子设备发送拒绝指令,电子设备根据接收到用户发送的拒绝指令将64

×

64

×

3的第一编辑图像舍弃并将128

×

128

×

3的目标源图像i输入至少一个级联的生成模块(比如,生成模块g

01

)中进行高维视觉特征提取,得到目标编辑图像,如图2中(ⅱ)所述。

51.上述至少一个级联的生成模块可以是1个生成模块,也可以是两个生成模块,本技术对此不作任何限定,用户可以根据实际需求设定生成模块的数量。本技术仅以图2中图像编辑模型包含2个生成模块为例,来说明该两个生成模块配合采样编码模块对中间编辑结果(比如,第一编辑图像)进行进一步地图像编辑以生成目标编辑图像的过程。

52.示例性地,如图2所示,上述生成模块g

01

包括:第一自动解码器e0、第一自注意力模块2012c、第二上采样模块f1和第二自动编码器g1,第一自动解码器e0用于恢复第一编辑图像(即输入信息)的高维视觉特征,得到第一高维特征图像;第一自注意力模块2012c用于对第一高维特征图像和句子词特征m

t

进行融合以及拼接处理,得到句子语义信息特征;第二上采样模块f1用于对句子语义信息特征进行特征融合和上采样处理,得到第二上采样结果;第二自动编码器g1用于对第二上采样结果进行高维视觉特征提取,得到输出信息。

53.图2中生成模块g

01

对第一编辑图像(比如,上述64

×

64

×

3的第一编辑图像)的处理过程如下:第一自动解码器e0对上述64

×

64

×

3的第一编辑图像进行高维视觉特征恢复,得到尺寸大小为64

×

64且通道数为32(即64

×

64

×

32)的第一高维特征图像;之后,第一自注意力模块2012c对64

×

64

×

32的第一高维特征图像、128

×

1的句子词特征m

t

和128

×

128

×

128的图像局部特征mi进行特征融合以及拼接处理,并生成带有细粒度句子语义信息的高维视觉特征(即句子语义信息特征);该句子语义信息特征的尺寸大小为64

×

64且通道数为32(即64

×

64

×

32);再之后,第二上采样模块f1对64

×

64

×

32的句子语义信息特征进行特征融合和上采样处理,生成尺寸大小为128

×

128且通道数为32(即128

×

128

×

32)的视觉特征图像(即第二上采样结果);该第二上采样模块f1包含两个残差网络和一个上采样层,其中,两个残差网络用于对句子语义信息特征进行融合,该上采样层用于提升图像的空间分辨率;最后,第二自动编码器g1对第二上采样结果进行高维视觉特征提取和编码处理,生成尺寸大小为128

×

128且通道数为3(即128

×

128

×

3)的第二编辑图像

54.可选地,第二上采样结果可以先经过带噪声仿射组合模块2012b,该带噪声仿射组合模块2012b将第二上采样结果和128

×

128

×

128的图像局部特征mi进行融合,并生成尺寸大小为128

×

128且通道数为32(即128

×

128

×

32)的视觉特征图像;之后,第二自动编码器g1对128

×

128

×

32的视觉特征图像进行高维视觉特征提取和编码处理,输出尺寸大小为128

×

128且通道数为3的第二编辑图像(即128

×

128

×

3的第二编辑图像)。

55.上述第一自注意力模块2012c包括:自注意力层f

atten

和第一带噪声仿射组合模块2012a,自注意力层f

atten

用于对第一高维特征图像和句子词特征进行特征融合;第一带噪声仿射组合模块2012a用于对自注意力层f

atten

的输出结果与第一高维特征图像的拼接结果,以及图像局部特征mi进行特征融合。比如,自注意力层f

atten

对上述64

×

64

×

32的第一高维特征图像和128

×

1的句子词特征进行特征融合,并将融合结果与第一高维特征图像进行拼接;第一带噪声仿射组合模块2012a对拼接结果以及128

×

128

×

128的图像局部特征mi进行特征融合。

56.第二自动编码器g1输出的128

×

128

×

3的第二编辑图像用户可以通过直接观察该128

×

128

×

3的第二编辑图像来判断其是否符合要求。

57.示例性地,若用户判断128

×

128

×

3的第二编辑图像符合要求,则该用户会向电子设备发送确认指令,电子设备根据接收到用户发送的确认指令将128

×

128

×

3的第二编辑图像输入下一个级联的生成模块中进行高维视觉特征提取,得到目标编辑图像;若用户判断128

×

128

×

3的第二编辑图像不符合要求,则该用户会向电子设备发送拒绝指令,电子设备根据接收到用户发送的拒绝指令将生成模块g

01

生成128

×

128

×

3的第二编辑图像舍弃(即不考虑生成模块g

00

生成第一编辑图像)并将128

×

128

×

3的目标源图像输入下一个级联的生成模块(比如,生成模块g

02

)中进行高维视觉特征提取,得到目标编辑图像,从而避免了不符合用户要求的第二编辑图像(即错误的第二编辑图像)继续向后传播的情况。

58.示例性地,如图2所示,上述生成模块g

01

之后的下一个级联的生成模块g

02

包括:第二自动解码器e1、第二自注意力模块2013c、第三上采样模块f2和生成器g2,第二自动解码器e1用于恢复第二编辑图像(即前一层生成模块g

01

的输出信息)的高维视觉特征,得到第二高维特征图像;第二自注意力模块2013c用于对第二高维特征图像和句子词特征m

t

进行融合以及拼接处理,输出第二编辑图像对应的句子语义信息特征;第三上采样模块f2用于对第二编辑图像对应的句子语义信息特征进行特征融合和上采样处理,得到第三上采样结果;生成器g2用于对第三上采样结果进行高维视觉特征提取。

59.图2中生成模块g

02

对第二编辑图像(比如,上述128

×

128

×

3的第二编辑图像)的处理过程如下:第二自动解码器e1对上述128

×

128

×

3的第二编辑图像进行高维视觉特征恢复,得到尺寸大小为128

×

128且通道数为32(即128

×

128

×

32)的第二高维特征图像;之后,第二自注意力模块2013c对128

×

128

×

32的第二高维特征图像、128

×

1的句子词特征

(w1(m)+noise),b

rnd

(m)=b2(b1(m)+noise),通过w

rnd

(m)和b

rnd

(m)计算目标源图像的区域特征m(比如,前述的图像局部特征mi)的权重和偏差,h表示视觉特征(比如,自注意力层f

atten

的输出结果与第一高维特征图像的拼接结果),noise为高斯噪声,

⊙

是hadamard元素积。第一带噪声仿射组合模块2012a通过引入高斯噪声能够增强采样编码模块以及生成模块编辑图像的可靠性,从而使得采样编码模块以及生成模块不会因为图像中存在的随机噪声而影响编辑结果的可靠性。

66.特此说明,除第一带噪声仿射组合模块2012a以外,本技术中所提及的其他带噪声仿射组合模块(比如,第二带噪声仿射组合模块、第三带噪声仿射组合模块等)的核心算法与第一带噪声仿射组合模块2012a的核心算法相同,本技术对此不再赘述。

67.示例性地,图像编辑模型的训练方法包括:利用预设的损失函数和训练集对初始模型进行训练,得到图像编辑模型;其中,预设的损失函数包括与n个子网络分别对应的子函数和n-1个自动编解码器损失函数,初始模型包括n个子网络,该n个子网络为采样编码模块和至少一个生成模块分别对应的初始模型;训练过程中,当第i个子网络的输出图像不满足预设条件时,采用第i+1至第n个子网络对应的子函数和第i个至第i+1个自动编解码器损失函数,对初始模型进行训练,0≤i<n。

68.例如,如图2所示,图像编辑模型201的训练方法包括:利用ms-coco和cub200数据集和预设损失函数借助判别器(比如,判别器d0、判别器d1和判别器d2)以生成对抗的形式进行训练,得到图像编辑模型201;上述初始模型是指图像编辑模型201未训练前的网络模型;该初始模型包括n=3个子网络和两个(n-1=3-1)自动编解码器,这3个子网络分别是采样编码模块g

00

、生成模块g

01

和生成模块g

02

;两个自动编解码器分别是自动编码器g

0-自动解码器e0和自动编码器g

1-自动解码器e1;上述预设的损失函数为3个自网络的损失函数和两个自动编解码器的损失函数。在训练过程中,比如,n=3,当第1(即i=1)个子网络(比如,采样编码模块g

00

)的输出图像不满足预设条件时,采用第2(即i+1=1+1)至第3个子网络对应的子函数(即生成模块g

01

对应的损失函数和生成模块g

02

对应的损失函数)和第1个至第2个自动编解码器损失函数(即自动编码器g

0-自动解码器e0的损失函数和自动编码器g

1-自动解码器e1的损失函数),对初始模型进行训练。

69.在对初始模型进行训练时,会采用如下三种预设的损失函数进行训练。这三种预设的损失函数具体如下:

70.第一预设的损失函数:

71.第二预设的损失函数:

72.第三预设的损失函数:上式中,b表示训练时跳过的子网络个数,i=0,1,2;l

g,i

表示manigan网络中相应层级的损失函数,l

g,0

为采样编码模块g

00

所处层级对应的损失函数,l

g,1

为生成模块g

01

所处层级对应的损失函数,l

g,2

为生成模块g

02

所处层级对应的损失函数;上述式中,i

′

表示目标编辑图像,i

′

~p

g,i(i,t)

是指目标编辑图像i

′

是初始模型在给定训练图像i和随机选择的目标文本t的情况下生成的。

73.上述自动编解码器的损失函数为而其中,为自动编码器g

0-自动解码器e0的损失函数,为自动编码器g

1-自动解码器e1的损失函数;gi由3

×

3卷积层和tanh激活函数组成,ei包含atanh函数、3

×

3卷积层、leaky relu层和实例规范化层(instance normalization)。由gi和ei组成的自动编解码器将中间编辑结果反馈给用户,用户可以对不同子网络生成的中间结果进行直接控制,以防止错误的中间编辑结果影响整个图像编辑模型201输出结果的准确性。

74.示例性地,以第一预设的损失函数训练初始模型为例,该第一预设损失函数训练初始模型时,不需要跳过任何子网络。即,将训练图像的图像整体特征ci和图像局部特征mi,以及训练文本的句子整体特征c

t

输入至采样编码模块g

00

中,采样编码模块g

00

输出第一训练编辑图像,若用户判断该第一训练编辑图像符合用户要求,则将第一训练编辑图像输入至生成模块g

01

中;生成模块g

01

对第一训练编辑图像和训练图像的图像局部特征mi进行编辑处理并生成第二训练编辑图像;若用户判断该第二训练编辑图像符合用户要求,则将第二训练编辑图像输入至生成模块g

02

中;生成模块g

02

对第二训练编辑图像和训练图像的图像局部特征mi进行编辑处理并生成第三训练编辑图像;若用户判断该第三训练编辑图像符合用户要求,则根据第一预设的损失函数训练初始模型的情况完成;若用户判断该第三训练编辑图像不符合用户要求,则重复上述训练过程。由于自动编码器g

0-自动解码器e0和自动编码器g

1-自动解码器e1分布在采样编码模块g

00

、生成模块g

01

和生成模块g

02

之间(见图2),因此,在根据第一预设的损失函数训练初始模型时,也训练了自动编码器g

0-自动解码器e0和自动编码器g

1-自动解码器e1。

75.示例性地,以第二预设的损失函数训练初始模型为例,该第二预设损失函数训练初始模型时,需要跳过采样编码模块g

00

处理训练图像的图像整体特征ci和图像局部特征mi,以及训练文本的句子整体特征c

t

的过程。而是直接训练图像输入至生成模块g

01

中;生成模块g

01

对训练图像和训练图像的图像局部特征mi进行编辑处理并生成第四训练编辑图像;若用户判断该第四训练编辑图像符合用户要求,则将第四训练编辑图像输入至生成模块g

02

中;生成模块g

02

对第四训练编辑图像和训练图像的图像局部特征mi进行编辑处理并生成第五训练编辑图像;若用户判断该第五训练编辑图像符合用户要求,则根据第二预设的损失函数训练初始模型的情况完成;若用户判断该第五训练编辑图像不符合用户要求,则重复上述训练过程。由于生成模块g

01

和生成模块g

02

之间仅有自动编码器g

1-自动解码器e1(见图2),因此,在根据第二预设的损失函数训练初始模型时,也训练了自动编码器g

1-自动解码器e1。

76.示例性地,以第三预设的损失函数训练初始模型为例,该第三预设损失函数训练初始模型时,需要跳过采样编码模块g

00

处理训练图像的图像整体特征ci和图像局部特征mi,以及训练文本的句子整体特征c

t

的过程,以及跳过生成模块g

01

对采样编码模块g

00

输出的编辑结果和训练图像的图像局部特征mi进行编辑处理的过程。而是直接将训练图像输入至生成模块g

02

中;生成模块g

02

对训练图像和训练图像的图像局部特征mi进行编辑处理并生成第六训练编辑图像;若用户判断该第六训练编辑图像符合用户要求,则根据第三预设的损失函数训练初始模型的情况完成;若用户判断该第六训练编辑图像不符合用户要求,则重复上述训练过程。由于生成模块g

02

没有自动编解码器,因此,在根据第三预设的损失函数

训练初始模型时,不需要训练自动编解码器。

77.由于多层对抗网络(即上述n个子网络)难以训练和收敛的特点,因此,在训练初始模型时借助自动编解码器来随机跳过低层对抗网络(比如,跳过采样编码模块g

00

)而优先训练高层网络(比如,生成模块g

01

,或者,生成模块g

02

),比如,当b=1时,跳过采样编码模块g

00

,优先训练生成模块g

01

和生成模块g

02

;当b=2时,跳过采样编码模块g

00

和生成模块g

01

,上述训练方法具有如下优点:a)由于在跳过低层子网络时下一级子网络的输入使用的是原始训练图像而不是低层子网络输出的不符合用户要求的编辑结果(即错误编辑结果),因此,能够避免潜在的低层子网络生成的错误编辑结果向高层子网络传播;b)优先训练高层子网络能够给低层子网络带来更好的更新梯度,从而能够使得低层子网络的收敛效果更好。

78.示例性地,图像编辑模型还包括:细节修正模型(symmetrical detail correction module,scdm),用于对目标编辑图像进行细节修改;细节修正模型用于处理图像局部特征、句子词特征和目标编辑图像,得到目标修正图像;细节修正模型包括:第一细节修正模块、第二细节修正模块、融合模块和生成器,其中,第一细节修正模块用于对图像局部特征、第一随机噪声和句子词特征进行细节修改,得到第一细节特征;第二细节修正模块用于对目标编辑图像对应的图像局部特征、第二随机噪声和句子词特征进行细节修改,得到第二细节特征;融合模块用于对第一细节特征和第二细节特征进行特征融合;生成器用于根据融合模块的输出结果生成目标修正图像。

79.如图2所示,图像编辑模型201还包括细节修正模型2014,该细节修正模型2014根据目标源图像i的图像局部特征mi和文本描述t的句子词特征m

t

对生成模块g

02

生成的目标编辑图像进行细节修改和校正,得到目标修正图像该细节修正模型2014包括:第一细节修正模块301、第二细节修正模块302、融合模块f

fuse

和生成器g

0s

,其中,第一细节修正模块301对图像局部特征mi、第一随机噪声noise1和句子词特征m

t

进行细节修改,得到第一细节特征,并将第一细节特征输入到融合模块f

fuse

;第二细节修正模块302对目标编辑图像(比如,生成模块g

02

输出的第三编辑图像)对应的图像局部特征第二随机噪声noise2和句子词特征m

t

进行细节修改,得到第二细节特征,并将第二细节特征输入到融合模块f

fuse

;融合模块f

fuse

对第一细节特征和第二细节特征进行特征融合,并将融合结果输入到生成器g

0s

中;生成器g

0s

对融合模块f

fuse

的输出结果进行编码并生成目标修正图像

80.示例性地,如图3所示,第一细节修正模块301包括第四带噪声仿射组合模块3011、第五带噪声仿射组合模块3013、第六带噪声仿射组合模块3015、第二自注意力模块3012、第一残差网络3014和第一线性网络3016;其中,第四带噪声仿射组合模块3011对第一随机噪声noise1和图像局部特征mi进行特征融合,得到第一融合特征,并将第一融合特征输入到第二自注意力模块3012;第二自注意力模块3012对第一融合特征和句子词特征m

t

进行特征融合,并将融合结果与第一随机噪声noise1进行拼接,得到拼接结果;该拼接结果输入到第五带噪声仿射组合模块3013中;第五带噪声仿射组合模块3013对该拼接结果、以及图像局部特征mi进行特征融合,并将融合结果输入至第一残差网络3014中;第一残差网络3014对第五带噪声仿射组合模块3013输出的融合结果进行视觉特征提取,并将视觉特征提取结果输入到第六带噪声仿射组合模块3015;第一线性网络3016对图像局部特征mi进行线性变

换,并将线性变换结果输入第六带噪声仿射组合模块3015;第六带噪声仿射组合模块3015对第一残差网络3014输出的视觉特征提取结果和第一线性网络3016输出的线性变换结果进行特征融合,得到第一细节特征xi。

81.示例性地,如图3所示,第二细节修正模块302包括第七带噪声仿射组合模块3021、第八带噪声仿射组合模块3023、第九带噪声仿射组合模块3025、第三自注意力模块3022、第二残差网络3024和第二线性网络3026;其中,第七带噪声仿射组合模块3021对第二随机噪声noise2和目标编辑图像对应的图像局部特征(比如,生成模块g

02

输出的第三编辑图像对应的图像局部特征)进行特征融合,得到第一融合特征,并将第一融合特征输入至第三自注意力模块3022中;第三自注意力模块3022对第一融合特征和句子词特征m

t

进行特征融合,并将特征融合结果与第二随机噪声noise2进行拼接,最后将拼接结果输入至第八带噪声仿射组合模块3023;第八带噪声仿射组合模块3023对该拼接结果、以及目标编辑图像对应的图像局部特征(比如,生成模块g

02

输出的第三编辑图像对应的图像局部特征)进行特征融合,并将融合结果输入至第二残差网络3024;第二残差网络3024对第八带噪声仿射组合模块的输出的融合结果进行视觉特征提取,并将该视觉特征提取结果输入至第九带噪声仿射组合模块3025中;第二线性网络3026对目标编辑图像对应的图像局部特征(比如,生成模块g

02

输出的第三编辑图像对应的图像局部特征)进行线性变换,并将线性变换结果输入至第九带噪声仿射组合模块3025中;第九带噪声仿射组合模块3025对第二残差网络3024输出的视觉特征提取结果和第二线性网络3026输出的线性变换结果进行特征融合,得到第二细节特征上述图像局部特征是利用vgg网络对第三编辑图像进行特征提取得到的。

82.上述融合模块f

fuse

对第六带噪声仿射组合模块3015输出的第一细节特征xi和第九带噪声仿射组合模块3025输出的第二细节特征进行特征融合,并将融合结果输入到生成器g

0s

中;生成器g

0s

对融合模块f

fuse

的输出融合结果进行编码并生成目标修正图像

83.可选地,第一细节修正模块301的输入和第二细节修正模块302的输入可以互相交换,即第一细节修正模块301的输入可以是目标编辑图像(比如,生成模块g

02

输出的第三编辑图像)对应的图像局部特征第二随机噪声noise2和句子词特征m

t

;第二细节修正模块302的输入可以是图像局部特征mi、第一随机噪声noise1和句子词特征m

t

。相应地,第一细节修正模块301的输出为第二细节特征第一细节修正模块301的输出为第一细节特征xi。

84.图3中,融合模块f

fuse

的核心算法如下:

[0085][0086]

其中,f

residual

是残差网络,β1和β2是线性网络层对输入的第一细节特征xi和第二细节特征进行计算而得到的一对注意力权重。该融合模块f

fuse

可以自适应地选择是基于目标源图像修改图像特征还是基于图像编辑模型生成的目标编辑图像来修改图像特征,从而增强修改图像的细节特征。上述生成器g

0s

将融合模块f

fuse

的输出结果转化为最终的目标修

正图像

[0087]

示例性地,细节修正模型2014的训练方式包括:根据有条件的生成器损失函数、无条件的生成器损失函数和语义对比函数训练细节修正模型的生成器;根据有条件的判别器损失函数和无条件的判别器损失函数训练细节修正模型的判别器;其中,训练的数据集为ms-coco数据集和cub200数据集;有条件的生成器损失函数如下:

[0088][0089]

其中,l

gs,0

为有条件的生成器损失函数,l

ds,0

为有条件的判别器损失函数;ds为图像编辑模型中细节修正模型的判别器;是指目标修正图像是细节修正模型(sdcm)在给定训练图像i和该训练图像i的描述文本ti的情况下生成的;i~p

data

指训练图像i是从真实数据中采样获得的;t为随机选择的目标文本,是语义对比函数,目的是使目标修正图像相对于随机选择的目标文本t更接近于训练图像i的描述文本ti。上述函数定义为:

[0090][0091]

其中,ρc是对比度控制阈值;l

corre

是controlgan中关联函数,用于描述训练文本和目标修正图像的匹配程度。

[0092]

上述无条件的生成器损失函数如下:

[0093][0094]

其中,l

gs,1

为无条件的生成器损失函数,l

ds,1

为无条件的判别器损失函数;;ds为图像编辑模型中细节修正模块的判别器;是指目标修正图像是细节修正模型(sdcm)在给定训练图像i和随机选择的目标文本t的情况下生成的。细节修正模型2014中生成器和判别器的总损失函数分别为:

[0095][0096]

其中,l

gs

为生成器的总损失函数,l

ds

为判别器的总损失函数;l

controlgan

为文本和图像的多模态损失函数,用于提升图像编辑结果和目标文本的匹配程度;上述图像局部特征是利用vgg网络对目标修正图像进行特征提取得到的,图像局部特征mi是利用vgg网络对目标源图像i进行特征提取得到的,函数l

damsm

为定义在manigan中的文本与图像相似性函数;l

reg

函数为图像编辑模型中定义的正则化项,用于加强修改效果,在细节修正模型训练的过程中,随机地使用训练图像i和目标修正图像相互替换,以加速细节修正模型的训练过程。

[0097]

为了便于理解,下面结合图4对本技术提供的基于文本的图像编辑方法的整体流程进行示例性说明。

[0098]

如图4所示,可配置编辑部分是指用户可以对图像编辑模型中的采样编码模块g

00

、生成模块g

01

和生成模块g

02

输出的中间编辑结果进行控制,并且,通过判断中间编辑结果而选择性地跳过某些模块。将不符合用户要求的中间编辑结果用目标源图像代替,从而实现根据目标文本对目标源图像的编辑过程。下面通过图4中(a)~(h)的子流程图,来说明用户对图像编辑模型中的采样编码模块g

00

、生成模块g

01

和生成模块g

02

输出的中间编辑结果进行随机控制的过程。

[0099]

图4中,(a)完整流程:用户向图像编辑模型中输入目标源图像的图像整体特征和图像局部特征,以及目标文本的句子整体特征和句子词特征,图像编辑模型中的采样编码模块g

00

输出的第一编辑图像符合用户要求;采样编码模块g

00

将第一编辑图像输入至生成模块g

01

中,生成模块g

01

对第一编辑图像进行处理并输出的第二编辑图像也符合用户要求;将第二编辑图像输入至生成模块g

02

;生成模块g

02

对第二编辑图像进行处理并生成的第三编辑图像也符合用户要求,生成模块g

02

将第三编辑图像(即目标编辑图像)输入至细节修正模型(scdm)中,该细节修正模型(scdm)对第三编辑图像进行细节修正并得到目标修正图像。

[0100]

图4中,(b)跳过g

00

:用户向图像编辑模型中输入目标源图像的图像整体特征和图像局部特征,以及目标文本的句子整体特征和句子词特征,图像编辑模型中的采样编码模块g

00

输出的第一编辑图像不符合用户要求;该采样编码模块g

00

输出的第一编辑图像舍弃,并用目标源图像代替第一编辑图像输入至生成模块g

01

中,生成模块g

01

对目标源图像进行处理并输出的第二编辑图像符合用户要求;将第二编辑图像输入至生成模块g

02

;生成模块g

02

对第二编辑图像进行处理并生成的第三编辑图像也符合用户要求,生成模块g

02

将第三编辑图像(即目标编辑图像)输入至细节修正模型(scdm)中,该细节修正模型(scdm)对第三编辑图像进行细节修正并得到目标修正图像。

[0101]

图4中,(c)跳过g

00

和g

01

:用户向图像编辑模型中输入目标源图像的图像整体特征和图像局部特征,以及目标文本的句子整体特征和句子词特征,图像编辑模型中的采样编码模块g

00

输出的第一编辑图像不符合用户要求;该采样编码模块g

00

输出的第一编辑图像舍弃,并用目标源图像代替第一编辑图像输入至生成模块g

01

中,生成模块g

01

对目标源图像进行处理并输出的第二编辑图像也不符合用户要求;该生成模块g

01

将第二编辑图像舍弃,并用目标源图像代替第二编辑图像输入至生成模块g

02

;生成模块g

02

对目标源图像进行处理并生成的第三编辑图像符合用户要求,生成模块g

02

将第三编辑图像(即目标编辑图像)输入至细节修正模型(scdm)中,该细节修正模型(scdm)对第三编辑图像进行细节修正并得到目标修正图像。

[0102]

图4中,(d)仅用scdm(即跳过g

00

、g

01

和g

02

):用户向图像编辑模型中输入目标源图像的图像整体特征和图像局部特征,以及目标文本的句子整体特征和句子词特征,图像编辑模型中的采样编码模块g

00

输出的第一编辑图像不符合用户要求;该采样编码模块g

00

输出的第一编辑图像舍弃,并用目标源图像代替第一编辑图像输入至生成模块g

01

中,生成模块g

01

对目标源图像进行处理并输出的第二编辑图像也不符合用户要求;该生成模块g

01

将第二编辑图像舍弃,并用目标源图像代替第二编辑图像输入至生成模块g

02

;生成模块g

02

对

目标源图像进行处理并生成的第三编辑图像也不符合用户要求,该生成模块g

02

将第三编辑图像舍弃,并用目标源图像代替第三编辑图像输入至细节修正模型(scdm)中,该细节修正模型(scdm)根据目标源图像的图像局部特征和目标文本的句子词特征对目标源图像进行细节修正并得到目标修正图像。

[0103]

图4中,(e)跳过scdm:用户向图像编辑模型中输入目标源图像的图像整体特征和图像局部特征,以及目标文本的句子整体特征和句子词特征,图像编辑模型中的采样编码模块g

00

输出的第一编辑图像符合用户要求;采样编码模块g

00

将第一编辑图像输入至生成模块g

01

中,生成模块g

01

对第一编辑图像进行处理并输出的第二编辑图像也符合用户要求;将第二编辑图像输入至生成模块g

02

;生成模块g

02

对第二编辑图像进行处理并生成的第三编辑图像也符合用户要求,该第三编辑图像即为目标编辑图像。

[0104]

图4中,(f)重复g

01

:用户向图像编辑模型中输入目标源图像的图像整体特征和图像局部特征,以及目标文本的句子整体特征和句子词特征,图像编辑模型中的采样编码模块g

00

输出的第一编辑图像符合用户要求;采样编码模块g

00

将第一编辑图像输入至生成模块g

01

中,生成模块g

01

对第一编辑图像进行处理并输出的第二编辑图像不符合用户要求;该生成模块g

01

可以反复利用,直到输出符合用户要求的第二编辑图像;比如,生成模块g

01

重新根据第一编辑结果进行处理并生成新的第二编辑图像符合要求,并将该新的第二编辑图像输入至生成模块g

02

;生成模块g

02

对新的第二编辑图像进行处理并生成的第三编辑图像也符合用户要求,生成模块g

02

将第三编辑图像(即目标编辑图像)输入至细节修正模型(scdm)中,该细节修正模型(scdm)对第三编辑图像进行细节修正并得到目标修正图像。

[0105]

图4中,(g)重复g

02

:用户向图像编辑模型中输入目标源图像的图像整体特征和图像局部特征,以及目标文本的句子整体特征和句子词特征,图像编辑模型中的采样编码模块g

00

输出的第一编辑图像符合用户要求;采样编码模块g

00

将第一编辑图像输入至生成模块g

01

中,生成模块g

01

对第一编辑图像进行处理并输出的第二编辑图像符合用户要求;生成模块g

02

对第二编辑图像进行处理并生成的第三编辑图像不符合用户要求,该生成模块g

02

可以反复利用,直到输出符合用户要求的第三编辑图像(即目标编辑图像);比如,生成模块g

02

重新根据第二编辑结果进行处理并生成新的第三编辑图像符合要求,并将该新的第三编辑图像输入至生成模块g

02

;生成模块g

02

将新的第三编辑图像(即目标编辑图像)输入至细节修正模型(scdm)中,该细节修正模型(scdm)对新的第三编辑图像进行细节修正并得到目标修正图像。

[0106]

图4中,(h)重复scdm:用户向图像编辑模型中输入目标源图像的图像整体特征和图像局部特征,以及目标文本的句子整体特征和句子词特征,图像编辑模型中的采样编码模块g

00

输出的第一编辑图像符合用户要求;采样编码模块g

00

将第一编辑图像输入至生成模块g

01

中,生成模块g

01

对第一编辑图像进行处理并输出的第二编辑图像符合用户要求;生成模块g

02

对第二编辑图像进行处理并生成的第三编辑图像符合用户要求,生成模块g

02

将第三编辑图像(即目标编辑图像)输入至细节修正模型(scdm)中,该细节修正模型(scdm)对第三编辑图像进行细节修正并得到第四编辑图像不符合用户要求,该细节修正模型(scdm)可以反复利用,直到输出符合用户要求的第四编辑图像(即目标修正图像);比如,细节修正模型(scdm)重新根据第三编辑结果进行处理并生成新的第四编辑图像符合要求,该新的第四编辑图像即为目标修正图像。

[0107]

本技术提出的上述技术方案与现有技术相比存在的有益效果如下:

[0108]

相比现有manigan根据文本对待编辑的源图像进行编辑并直接输出可能不符合用户要求的编辑结果,本技术在现有manigan中引入采样编码模块,形成改进的manigan;该采用编码模块会将中间编辑结果(即第一编辑图像)输出,以方便用户判断该中间编辑结果是否符合要求,若符合要求,则将中间编辑结果继续向至少一个级联的生成模块传递;若不符合要求,则不会将该中间结果继续向至少一个级联的生成模块传递,而是用目标源图像代替该中间编辑结果继续向至少一个级联的生成模块传递。由此可见,改进的manigan在根据目标文本对目标源图像编辑时,可以对中间编辑结果进行控制,并及时剔除不符合要求的中间编辑结果,以防止前一级输出不符合要求的结果影响后一级输出结果的准确性,从而为用户编辑出更加符合要求的目标编辑图像。

[0109]

在上述第一自注意力模块中引入第一带噪声仿射组合模块,该第一带噪声仿射组合模块通过引入高斯噪声能够增强生成模块编辑图像的可靠性,从而避免了生成模块因图像中存在随机噪声而影响编辑结果可靠性的情况出现。

[0110]

在第一上采样模块中引入第二带噪声仿射组合模块和第三带噪声仿射组合模块可以进一步对第一上采样模块中不同上采样层的输出结果进行视觉特征增强。

[0111]

在上述图像编辑模型中增加细节修正模型能够对图像编辑模型输出的目标编辑图像进行进一步的细节修改和增强,从而得到高分辨率的目标修正图像。

[0112]

在上述第一细节修正模块中增加多个带噪声仿射组合模块,可以增强细节修正模型的可靠性。

[0113]

在上述第二细节修正模块中增加多个带噪声仿射组合模块,可以增强细节修正模型的可靠性。

[0114]

上述根据有条件的生成器损失函数、无条件的生成器损失函数和语义对比函数训练所述细节修正模型的生成器,能够使得生成器生成的图像编辑结果(即目标编辑图像)更加符合目标文本描述的内容和用户要求。上述根据有条件的判别器损失函数和无条件的判别器损失函数训练所述细节修正模型的判别器,能够使得判断器的识别结果更加准确。

[0115]

在上述图像编辑模型训练的过程中,对n个子网络进行训练是通过自动编解码器跳过输出结果不符合要求的前级子网络而优先训练后级子网络,由于跳过时使用目标源图像而不是中间编辑结果(比如,第一编辑图像),因此,能够避免潜在的前级子网络输出的错误结果向后级子网络传播。后级子网络优先训练能够给前级子网络带来更好的更新梯度,从而使得前级子网络的收敛效果更好。

[0116]

图5示出了本技术提供了一种电子设备的结构示意图。图5中的虚线表示该单元或该模块为可选的。电子设备500可用于实现上述方法实施例中描述的方法。电子设备500可以是终端设备或服务器或芯片。

[0117]

电子设备500包括一个或多个处理器501,该一个或多个处理器501可支持电子设备500实现图1所对应方法实施例中的方法。处理器501可以是通用处理器或者专用处理器。例如,处理器501可以是中央处理器(central processing unit,cpu)。cpu可以用于对电子设备500进行控制,执行软件程序,处理软件程序的数据。电子设备500还可以包括通信单元505,用以实现信号的输入(接收)和输出(发送)。

[0118]

例如,电子设备500可以是芯片,通信单元505可以是该芯片的输入和/或输出电

路,或者,通信单元505可以是该芯片的通信接口,该芯片可以作为终端设备的组成部分。

[0119]

又例如,电子设备500可以是终端设备,通信单元505可以是该终端设备的收发器,或者,通信单元505可以是该终端设备的收发电路。

[0120]

电子设备500中可以包括一个或多个存储器502,其上存有程序504,程序504可被处理器501运行,生成指令503,使得处理器501根据指令503执行上述方法实施例中描述的方法。可选地,存储器502中还可以存储有数据(如待测芯片的id)。可选地,处理器501还可以读取存储器502中存储的数据,该数据可以与程序504存储在相同的存储地址,该数据也可以与程序504存储在不同的存储地址。

[0121]

处理器501和存储器502可以单独设置,也可以集成在一起,例如,集成在终端设备的系统级芯片(system on chip,soc)上。

[0122]

处理器501执行启动老化测试的方法的具体方式可以参见方法实施例中的相关描述。

[0123]

应理解,上述方法实施例的各步骤可以通过处理器501中的硬件形式的逻辑电路或者软件形式的指令完成。处理器501可以是cpu、数字信号处理器(digital signal processor,dsp)、现场可编程门阵列(field programmable gate array,fpga)或者其它可编程逻辑器件,例如,分立门、晶体管逻辑器件或分立硬件组件。

[0124]

本技术还提供了一种计算机程序产品,该计算机程序产品被处理器501执行时实现本技术中任一方法实施例所述的方法。

[0125]

该计算机程序产品可以存储在存储器502中,例如是程序504,程序504经过预处理、编译、汇编和链接等处理过程最终被转换为能够被处理器501执行的可执行目标文件。

[0126]

本技术还提供了一种计算机可读存储介质,其上存储有计算机程序,该计算机程序被计算机执行时实现本技术中任一方法实施例所述的方法。该计算机程序可以是高级语言程序,也可以是可执行目标程序。

[0127]

该计算机可读存储介质例如是存储器502。存储器502可以是易失性存储器或非易失性存储器,或者,存储器502可以同时包括易失性存储器和非易失性存储器。其中,非易失性存储器可以是只读存储器(read-only memory,rom)、可编程只读存储器(programmable rom,prom)、可擦除可编程只读存储器(erasable prom,eprom)、电可擦除可编程只读存储器(electrically eprom,eeprom)或闪存。易失性存储器可以是随机存取存储器(random access memory,ram),其用作外部高速缓存。通过示例性但不是限制性说明,许多形式的ram可用,例如静态随机存取存储器(static ram,sram)、动态随机存取存储器(dynamic ram,dram)、同步动态随机存取存储器(synchronous dram,sdram)、双倍数据速率同步动态随机存取存储器(double data rate sdram,ddr sdram)、增强型同步动态随机存取存储器(enhanced sdram,esdram)、同步连接动态随机存取存储器(synchlink dram,sldram)和直接内存总线随机存取存储器(direct rambus ram,drram)。

[0128]

本领域的技术人员可以清楚地了解到,为了描述的方便和简洁,上述描述的装置和设备的具体工作过程以及产生的技术效果,可以参考前述方法实施例中对应的过程和技术效果,在此不再赘述。

[0129]

在本技术所提供的几个实施例中,所揭露的系统、装置和方法,可以通过其它方式实现。例如,以上描述的方法实施例的一些特征可以忽略,或不执行。以上所描述的装置实

施例仅仅是示意性的,单元的划分,仅仅为一种逻辑功能划分,实际实现时可以有另外的划分方式,多个单元或组件可以结合或者可以集成到另一个系统。另外,各单元之间的耦合或各个组件之间的耦合可以是直接耦合,也可以是间接耦合,上述耦合包括电的、机械的或其它形式的连接。

[0130]

以上所述实施例仅用以说明本技术的技术方案,而非对其限制。尽管参照前述实施例对本技术进行了详细的说明,本领域的普通技术人员应当理解:其依然可以对前述各实施例所记载的技术方案进行修改,或者对其中部分技术特征进行等同替换,而这些修改或者替换,并不使相应技术方案的本质脱离本技术各实施例技术方案的精神和范围,均应包含在本技术的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1