一种基于外观与形态解耦的长时期跨摄像头目标关联方法及系统

workshops(cvprw).2020:830-831.)从人脸区域和身体区域联合提取行人身份信息,并融合二者作为统一的行人身份表征。

5.对比来看,虽然这些方法推动了长时期跨摄像头目标关联任务的发展,但仍存在诸多限制。例如,基于人脸信息的长时期跨摄像头目标关联方法依赖人脸检测方法,但受限于人脸检测方法不能很好地检测非正脸的情况;基于隐式形态表征的方法缺乏可解释性,且需要复杂的模型在特征空间构建换衣行人样本和原始样本间的关系;步态信息则需要依赖视频数据才能准确地获取,而不适用于基于彩色图像的长时期跨摄像头目标关联任务。

技术实现要素:

6.针对现有技术存在的技术问题,本发明的目的是提供一种基于外观与形态解耦的长时期跨摄像头目标关联方法及系统。通过估计行人目标的轮廓,并以残差学习的方式保留外观信息。本发明既不需要采用隐式身份特征学习中复杂的对抗学习模型就能提取行人的形态信息,又可避免挖掘基于显式身份特征学习中涉及隐私的人脸信息及不可靠的行人步态信息。

7.本发明采用的技术方案如下:

8.一种基于外观与形态解耦的长时期跨摄像头目标关联方法,包括以下步骤:

9.1)输入长时期跨摄像头目标关联数据集中的训练图像;

10.2)对输入的训练图像进行人体稠密解析估计;

11.3)利用边缘估计方法对得到的人体稠密解析估计结果进行处理,以提取人体轮廓图像;

12.4)求取步骤1)中训练图像与步骤3)中人体轮廓图像的残差,得到人体外观图像;

13.5)利用形态表征模型对步骤3)中的人体轮廓图像进行高级语义特征提取;

14.6)利用外观表征模型对步骤4)中的人体外观图像进行高级语义特征提取;

15.7)利用三元组损失函数和识别损失函数对步骤5)和步骤6)提取的特征进行监督学习,实现外观表征模型和形态表征模型的参数优化;

16.8)实际部署阶段,可以采用步骤1)-步骤4)的方式对测试图像进行人体轮廓图像提取和人体外观图像提取。并采用步骤7)学习的形态表征模型和外观表征模型分别从人体轮廓图像和人体外观图像提取形态特征和外观特征。将从同一行人图像提取的形态特征和外观特征进行串联,组合为最终的行人特征。

17.9)利用步骤8)中提及的提取行人图像特征的方式对待查询行人图像和候选行人图像分别进行特征提取,通过计算特征间的余弦距离作为相似性得分。选取得分最高的候选行人为跨摄像头场景中的关联目标。

18.其中,步骤1)-步骤4)属于图像预处理阶段,包括人体轮廓图像的生成和外观图像的提取;步骤5)-步骤7)对形态表征模型和外观表征模型的训练部分,通过参数优化便于部署阶段提取特征;步骤8)-步骤9)属于基于外观与形态解耦的长时期跨摄像头目标关联方法的测试阶段,用于实际部署时在跨摄像头场景下去待查询行人进行匹配和关联。

19.进一步地,步骤1)和步骤9)中提及的训练图像、待查询行人图像和候选行人图像均为利用现有行人检测算法直接检测即可得到的结果,而非从监控摄像头直接获取的原始数据。

20.进一步地,步骤2)采用人体稠密解析估计方法对原始的行人图像进行变换,以便于进一步的提取人体轮廓图像;步骤3)采用边缘估计方法和人体稠密解析估计方法来提取人体轮廓图像,以进一步用于行人的形态特征提取;步骤4)采用残差计算的方式,实现行人图像中外观信息与形态信息的显式解耦,这样的方式被用于解决长时期场景下行人可能会更换衣物等问题;步骤5)和步骤6)分别提取高级空间中行人的形态表征和外观表征。

21.进一步地,步骤5)和步骤6)分别提及的形态表征模型和外观表征模型为同样的网络结构,可采用现有的常用的图像分类模型(如resnet-50)。但形态表征模型和外观表征模型在训练阶段其参数是独立训练,二者没有共享关系。由于采用相同的网络,所以利用形态表征模型和外观表征模型提取的行人形态特征和外观特征也具有相同的维度。

22.一种基于外观与形态解耦的长时期跨摄像头目标关联系统,其包括:

23.图像预处理模块,负责对输入的训练图像进行人体稠密解析估计,并利用边缘估计方法对得到的人体稠密解析估计结果进行处理,以提取人体轮廓图像,然后求取训练图像与人体轮廓图像的残差,得到人体外观图像;

24.长时期跨摄像头目标关联模型训练模块,负责对长时期跨摄像头目标关联模型中的行人形态表征模型和外观表征模型进行参数优化学习;在三元组损失函数和识别损失函数的监督下,对两个表征模型的参数进行优化;

25.长时期跨摄像头目标关联模块,负责将待查询行人图像与候选行人图像分别输入图像预处理模块中,提取相应的人体轮廓图像和人体外观图像;然后,分别将得到的人体轮廓图像和人体外观图像送入由长时期跨摄像头目标关联模型训练模块训练得到的形态表征模型和外观表征模型,以提取对应图像的形态特征和外观特征;接着,通过串联形态特征和外观特征,得到待查询行人图像和候选行人图像的最终行人特征;最后,通过比较二者间的相似性,确定候选行人图像是否为目标,实现长时期跨摄像头目标关联。

26.本发明的有益效果如下:

27.本发明通过对行人图像进行外观信息和形态信息的解耦,可以解决在长时期跨摄像头场景下较难匹配目标行人的问题。将行人外观信息和形态信息显式地分开,并分别在高级特征空间中进行表示,有助于提取更具语义性的行人身份特征。此外,将行人外观特征与形态特征进行串联,得到更加可靠的行人身份特征。而本发明尝试挖掘行人的形态信息,有助于长时期场景下行人可能换衣的问题,更适合真实场景下的跨摄像头目标关联。该发明可被引入智能监控系统、目标跟踪系统、目标关联系统中,实现更加完备的智能监控技术。

附图说明

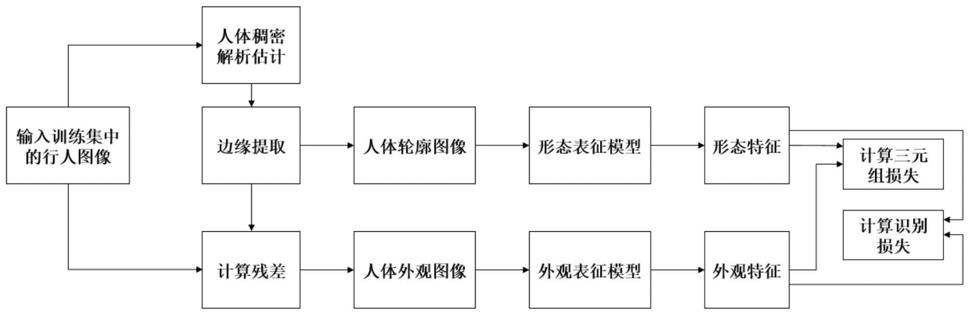

28.图1.基于外观与形态解耦的长时期跨摄像头目标关联模型训练示意图。

29.图2.基于外观与形态解耦的长时期跨摄像头目标关联测试流程图。

具体实施方式

30.为使本发明的上述目的、特征和优点能够更加明显易懂,下面通过具体实施例和附图,对本发明做进一步说明。

31.如图1为本发明的基于外观与形态解耦的长时期跨摄像头目标关联模型图,包括

以下几个步骤:

32.步骤1,输入训练集图像及其对应的数据标签。

33.设输入的原始图像为ii,在实际训练过程中,输入的图像数据往往为一批数据,以保证在训练优化过程中能更稳定地优化模型参数。

34.步骤2,利用现有的方法densepose(alp g

ü

ler r,neverova n,kokkinos i.densepose:dense human pose estimation in the wild.proceedings of the ieee/cvf conference on computer vision and pattern recognition(cvpr).2018:7297-7306.)进行人体稠密解析估计。估计过程可以表示为:

35.c

*

(x,y)=argmaxcp(c|ii(x,y))

36.其中,(x,y)表示图像ii中像素的笛卡尔坐标,p(c|ii(x,y))表示像素ii(x,y)属于第c个身体部位的概率,以及c

*

(x,y)表示像素ii(x,y)预测的身体部位。

37.步骤3,利用任意的边缘检测算法提取步骤2估计结果的行人轮廓图像,行人轮廓图像表示为

38.步骤4,利用步骤1中的原始图像ii和步骤3中到的行人轮廓图像提取行人的外观图像提取的方式为计算残差,即

[0039][0040]

步骤5,将图像和分别送入形态表征模型和外观表征模型中提取特征。

[0041]

其中,形态表征模型和外观表征模型可以选择目前流行的经典卷积神经网络结构,如vgg net、inception net、resnet-50及resnet-101等。两个模型的目的是分别将对应的图像映射到高级语义空间中。利用形态表征模型可以从轮廓图像中提取行人的形态表征f

is

,可以表示为:

[0042][0043]

利用外观表征模型可以从外观图像中提取行人的外观表征f

ia

,可以表示为:

[0044][0045]

其中,w

shape

和w

app

分别表示形态表征模型和外观表征模型,两个模型采用相同的网络结构,但参数不共享。

[0046]

步骤6,利用三元组损失函数(schroff f,kalenichenko d,philbin j.facenet:aunified embedding for face recognition and clustering.proceedings of the ieee/cvf conference on computer vision and pattern recognition(cvpr).2015:815-823)和识别损失函数对特征f

is

和f

ia

进行监督学习(采用三元组损失函数和识别损失函数同时监督形态特征和外观特征的学习),以实现形态表征模型和外观表征模型的参数优化。

[0047]

其中,三元组损失函数的定义为:

[0048][0049]

特征f表示训练批次中的任一样本的特征,为与特征f的行人身份相同的正样本集合,为与特征f的行人身份相同的负样本集合。而和分别表示fa的正负

样本。m为阈值。d表示特征间的距离。

[0050]

识别损失函数的定义为:

[0051][0052]

其中,c为训练集中包含的行人数量,w为训练的分类器,t为转置操作,fj为第j类特征。值得注意的是,无论是三元组损失函数中提及的f,还是在识别损失中提及的f,在本方法中均分别用f

is

和f

ia

进行替换,以计算损失值。

[0053]

步骤7,利用常用的优化算法进行反向传播,以更新形态表征模型和外观表征模型中的参数。

[0054]

如图2为基于外观与形态解耦的长时期跨摄像头目标关联测试流程图,包括以下几个步骤:

[0055]

步骤1,输入待查询行人图像和跨摄像头场景下的候选行人图像。

[0056]

步骤2,分别对待查询行人图像和候选行人图像进行人体稠密解析估计。

[0057]

步骤3,利用训练阶段所采用的边缘估计算法对步骤2)中估计的结果进行边缘估计,以提取行人的轮廓图像。

[0058]

步骤4,计算原始图像与轮廓图像的残差,以分别提取待查询行人图像和跨摄像头场景下的候选行人图像所对应的行人外观图像。

[0059]

步骤5,利用训练阶段训练好的形态表征模型和外观表征模型分别对步骤3)所得的轮廓图像与步骤4)所得的外观图像进行形态特征提取和外观特征提取。

[0060]

步骤6,串联待查询行人图像的形态特征和外观特征作为待查询行人特征。串联候选行人图像的形态特征和外观特征作为候选行人特征。

[0061]

步骤7,计算待查询行人特征和候选行人特征间的余弦距离。

[0062]

步骤8,重复步骤1

–

步骤7对所有候选图像分别进行上述操作。对待查询行人特征与不同候选行人特征间的余弦距离进行排序,选取余弦距离最大的候选行人图像为目标行人图像,实现长时期跨摄像头的目标匹配。该步骤采用余弦距离作为相似性评估方法,以比较待查询行人图像和候选行人图像间的相似性。

[0063]

基于同一发明构思,本发明的另一实施例提供一种基于外观与形态解耦的长时期跨摄像头目标关联系统,其包括:

[0064]

图像预处理模块,负责对输入的训练图像进行人体稠密解析估计,并利用边缘估计方法对得到的人体稠密解析估计结果进行处理,以提取人体轮廓图像,然后求取训练图像与人体轮廓图像的残差,得到人体外观图像;

[0065]

长时期跨摄像头目标关联模型训练模块,负责对长时期跨摄像头目标关联模型中的行人形态表征模型和外观表征模型进行参数优化学习;在三元组损失函数和识别损失函数的监督下,对两个表征模型的参数进行优化;

[0066]

长时期跨摄像头目标关联模块,负责将待查询行人图像与候选行人图像分别输入图像预处理模块中,提取相应的人体轮廓图像和人体外观图像;然后,分别将得到的人体轮廓图像和人体外观图像送入由长时期跨摄像头目标关联模型训练模块训练得到的形态表征模型和外观表征模型,以提取对应图像的形态特征和外观特征;接着,通过串联形态特征

和外观特征,得到待查询行人图像和候选行人图像的最终行人特征;最后,通过比较二者间的相似性,确定候选行人图像是否为目标,实现长时期跨摄像头目标关联。

[0067]

基于同一发明构思,本发明的另一实施例提供一种电子装置(计算机、服务器、智能手机等),其包括存储器和处理器,所述存储器存储计算机程序,所述计算机程序被配置为由所述处理器执行,所述计算机程序包括用于执行本发明方法中各步骤的指令。

[0068]

基于同一发明构思,本发明的另一实施例提供一种计算机可读存储介质(如rom/ram、磁盘、光盘),所述计算机可读存储介质存储计算机程序,所述计算机程序被计算机执行时,实现本发明方法的各个步骤。

[0069]

以上实施例仅用以说明本发明的技术方案而非对其进行限制,本领域的普通技术人员可以对本发明的技术方案进行修改或者等同替换,而不脱离本发明的精神和范围,本发明的保护范围应以权利要求书所述为准。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1