确定经训练的神经网络的可信度的制作方法

1.本发明涉及神经网络的领域,并且特别涉及由外部提供方托管给使用第一神经网络的电子设备的神经网络的领域。

背景技术:

2.chen,xinyu等人的“tensorview:visualizing the training of convolutional neural network using paraview”(proceedings of the 1st workshop on distributed infrastructures for deep learning,2017年)公开了一种用于可视化卷积神经网络的训练的机制。

3.liu,dongyu等人的“deeptracker:visualizing the training process of convolutional neural networks”(acm transactions on intelligent systems and technology(tist)10.1,2018年,第1-25页)公开了一种用于可视化卷积神经网络的训练过程的方法。

4.人工智能方法的进步已经引起对准确快速地执行许多自动化过程的神经网络的需求增加。实际上,神经网络在各种各样的应用中越来越多地得到使用,例如在医学、消费电子产品和监测设备的领域中。期望具有相对较低的处理功率的电子设备(“低功率设备”)来利用神经网络。然而,利用神经网络来训练和执行推断是在计算上昂贵的过程,这可能影响这种低功率设备的操作。

5.一种用于使得(低功率)电子设备能够访问第一神经网络的功能的方法是将第一神经网络托管在具有相对较大的处理功率或能力的外部提供方或设备(例如,云计算提供方)上。外部提供方能够基于由(低功率)电子设备提供或指示的数据来执行对第一神经网络的必要训练和操作。

6.换句话说,在希望使用第一神经网络的(低功率)电子设备与训练和托管第一神经网络的外部提供方(例如,云计算提供方)之间可以存在工作负荷的分布。在第一神经网络的使用期间(在训练之后),(低功率)电子设备可以向外部提供方提供输入数据,该外部提供方使用第一神经网络处理输入数据以生成期望的输出推断以供(低功率)电子设备使用。

7.然而,需要由外部提供方提供的输出推断是准确且可信的。似乎合理的是,外部提供方的不道德操作者可能希望在第一神经网络的训练和/或推断期间减少其计算负荷(例如以节省金钱或处理资源),例如通过使用更简单但不太准确的神经网络来训练或执行推断以实现这一点。

技术实现要素:

8.因此,期望确保由外部提供方使用的第一神经网络或由外部提供方提供的输出推断是准确且可信的。本发明由独立权利要求来限定。从属权利要求限定了有利的实施例。

9.根据依据本发明的一个方面的示例,提供了一种确定第一神经网络的训练的可信度的计算机实施的方法,其中,所述训练由外部提供方来执行。所述神经网络可以被配置用

于执行电子设备所期望的计算任务。因此,所述第一神经网络可以由外部提供方托管给所述电子设备。

10.所述计算机实施的方法可以包括:以指令指示外部提供方例如基于真实情况数据集来训练神经网络,所述真实情况数据集提供针对所述电子设备所期望的所述计算任务的样本输入数据条目和对应的样本输出数据条目;在由所述外部提供方执行的所述第一神经网络的所述训练期间,(例如使用监测设备)监测所述第一神经网络的一个或多个权重的第一集合的值;并且使用所述监测设备基于所监测的所述第一神经网络的一个或多个权重的所述第一集合的值来确定所述第一神经网络的所述训练的可信度。

11.本公开内容提出了通过监测在第一神经网络的训练期间(在时间上)存在的一个或多个权重来监测或评估第一神经网络的训练(的进展)。本发明人认识到,监测关于权重的信息的操作能够用于准确地确定第一神经网络的训练的可信度的度量或其他指标,因此确定第一神经网络本身的可信度的度量或其他指标。

12.确定第一神经网络的训练的可信度可以包括生成指示第一神经网络的训练的可信度的可信度指标,例如包括二值、分类或数值(例如连续)数据。本领域技术人员将容易想到用于存储关于(第一)神经网络的可信度的信息的各种数据格式。

13.可信度可以包括外部提供方是否根据(例如外部提供方与将利用第一神经网络的电子设备之间)商定的训练流程和/或期望的训练流程来训练第一神经网络的度量(例如,二值、分类或数值度量)。因此,可信度是关于外部提供方根据某种预定训练流程/协议来训练第一神经网络的程度的评估。

14.换句话说,可信度可以是响应于与由外部提供方执行的预期或期望训练流程的偏差的指标(例如,值、度量或数据)。本发明认识到,由外部提供方执行的神经网络的训练的可信度能够(例如由与外部提供方分开的监测设备)通过使用所监测的所述神经网络的一个或多个权重的第一集合的值来评估。

15.监测设备适于通过从第一神经网络的训练的不同训练时期获得一个或多个权重的第一集合的值来监测一个或多个权重的第一集合。所述获得可以在第一神经网络的训练期间(例如通过外部提供方在特定时期完成之后发送该时期的值)执行,也可以在第一神经网络的训练之后(例如通过外部提供方存储特定时期的值并且稍后将这些值提供给监测设备)执行。

16.因此,监测一个或多个权重的第一集合的值的步骤可以是在第一神经网络的训练的不同训练时期之后由监测设备获得第一神经网络的一个或多个权重的第一集合的值的步骤。

17.在一些实施例中,所述第一神经网络的一个或多个权重的所述第一集合不包括所述第一神经网络的所有权重。换句话说,一个或多个权重的第一集合可以仅包括第一神经网络的权重的子集。该实施例提高了监测第一神经网络的训练的计算功效。

18.优选地,使用与所述外部提供方分开的监测设备来执行监测一个或多个权重的所述第一集合的值的步骤和确定所述训练的所述可信度的步骤。

19.在至少一个示例中,监测一个或多个权重的第一集合的步骤包括以指令指示所述外部提供方在所述第一神经网络的所述训练的每个训练时期之后:确定至少处理一个或多个权重的所述第一集合的值的散列函数的输出是否满足第一预定准则;并且响应于确定所

述散列函数的所述输出满足所述第一预定准则,将一个或多个权重的所述第一集合的值发送到所述监测设备;并且其中,确定所述第一神经网络的所述训练的可信度的步骤包括:在所述监测设备处确定处理所发送的一个或多个权重的所述第一集合的值的相同散列函数的所述输出是否满足所述预定准则。

20.本公开内容认识到,如果外部提供方试图(例如通过提供满足散列函数的权重的伪造值或虚假值)欺骗或绕过用于确定第一神经网络的训练的可信度的散列函数方法,则它们将需要生成既执行期望的计算任务又能够伪造将验证散列函数的权重的值的神经网络。这将可能导致需要比简单地执行第一神经网络的适当训练更高的计算复杂度。

21.因此,能够通过在第一神经网络的训练期间引入报告任务(散列函数)来确保第一神经网络的可信度,从而使得简单地执行所请求的第一神经网络的训练在计算上不太复杂(而不是执行不太复杂的神经网络的训练)。

22.在一些实施例中,所述散列函数和/或所述预定准则被选择为使得每当所述散列函数的所述输出满足所述第一预定准则的时刻之间的训练时期的平均数量在8至32之间。

23.在8至32个训练时期之后报告权重的第一集合的值引起在监测设备处随时间监测权重的第一集合的值的计算复杂度较小,同时使得能够在整个训练过程中连续且重复地监测第一神经网络的训练。

24.在一些示例中,每当散列函数的输出满足预定准则的时刻之间的训练时期的平均数量可以是16。

25.在一些实施例中,散列函数和/或第一预定准则被选择为使得每当散列函数的输出满足第一预定准则的时刻之间的训练时期的平均数量在训练时期的总数的0.5%至10%之间,例如,在训练时期的总数的1%至5%之间。

26.关于训练时期的总数的信息将是可容易获得的,例如,根据到外部网络的训练指令而获得,因为训练时期的总数可以是已知的或预先选择的。

27.所述第一预定准则可以包括所述散列函数的所述输出的预定数量的最低有效位具有预定模式。

28.举例来说,最低有效位的预定数量可以是4,并且预定模式可以是“0000”。预定模式的其他示例对于本领域技术人员来说将是显而易见的,例如,“1111”、“0011”、“0001”或任何其他组合的模式。位的其他预定数量对于本领域技术人员来说也将是显而易见的,并且本领域技术人员将意识到,对位的不同预定数量的使用方式可以引起每当散列函数的输出满足第一预定准则的时刻之间的训练时期的平均数量发生改变。

29.当然,不是使用最低有效位,而是可以使用散列函数的输出的任何其他合适的信息(例如,最高有效位、散列函数的输出的所有位的xor和等)。

30.优选地,散列函数包括处理一个或多个权重的第一集合的值和加密密钥以产生输出。所提出的散列函数提供了处理一个或多个权重的第一集合的值的合适但低复杂度的方法。然而,其他合适的散列函数对于本领域技术人员来说将是显而易见的。

31.任选地,确定所述第一神经网络的所述训练的可信度的步骤包括在所述监测设备处确定一个或多个权重的所述第一集合的值是否随时间收敛。

32.使一个或多个权重的第一集合的值收敛(例如,其中一个或多个权重的第一集合的每个值随时间收敛)指示例如第一神经网络的训练正在适当地推进并且外部提供方不是

简单地随机修改权重的集合的值。确定一个或多个权重的第一集合的值是否收敛使得能够准确识别第一神经网络的训练的可信度。

33.在一些实施例中,一个或多个权重的所述第一集合包括所述第一神经网络的一条或多条权重迹线的第一集合。

34.权重迹线是其中每个权重链接所述第一神经网络的不同层的权重的集合,其中,所述权重迹线将来自所述第一神经网络的所有层的神经元链接在一起。由于权重迹线覆盖了第一神经网络的所有层,因此这使得在可信度正被监测时第一神经网络更加难以进行欺骗(例如防止第一神经网络仅训练第一神经网络的层的子集)。

35.代替使用权重迹线的第一集合,实施例可以简单地定义一个或多个权重的第一集合包括用于第一神经网络的每个层的不同权重。

36.监测一个或多个权重的第一集合的值的步骤可以包括(例如使用所述监测设备)使用私人信息检索过程来获得一个或多个权重的所述第一集合的值。私人信息检索过程使得监测设备能够保持正从外部提供方请求的权重,从而降低外部提供方将能够欺骗和绕过可信度核查的可能性。特别地,获得的步骤包括使用监测设备从外部提供方检索一个或多个权重的第一集合的值,而不向外部提供方揭示哪个(哪些)值已经被检索。

37.监测一个或多个权重的第一集合的值的步骤可以包括:获得所述第一神经网络的所有权重的第一值;并且获得所述第一神经网络的所有权重的第二值,所述第二值是自从所述第一神经网络的所述权重具有所述第一值以来已经在所述第一神经网络上执行了一个或多个训练时期之后的所有权重的值。

38.确定所述第一神经网络的所述训练的可信度的步骤可以包括:在所述监测设备处初始化具有所述第一值的权重的第二神经网络;在所述第一神经网络的具有所述第一值的权重与所述第一神经网络的具有所述第二值的权重之间,在所述第二神经网络上执行与在所述第一神经网络上执行的训练时期的数量相同数量的一个或多个训练时期,以产生部分训练的第二神经网络;并且将所述部分训练的第二神经网络的所有权重的值与所有权重的所述第二值进行比较。

39.该实施例使得监测设备能够通过验证由外部提供方执行的训练时期的集合被正确执行来验证外部提供方关于训练未被欺骗。虽然该验证步骤在计算上比先前描述的方法(例如,监测权重的收敛和/或检测满足某种预定准则的权重的值)更昂贵,但是该方法更加难以被外部提供方冒充或绕过。

40.在一些实施例中,一个或多个训练时期的数量是1。

41.一些实施例还包括:当所述外部提供方已经完成了对所述第一神经网络的训练时,(例如在所述监测设备处)从所述外部提供方获得所述第一神经网络作为最终训练的神经网络;使用所述监测设备在所述最终训练的神经网络上执行一个或多个另外的训练时期以生成进一步训练的神经网络;并且在所述监测设备处将所述进一步训练的神经网络的一个或多个权重的第二集合的值与所述最终训练的神经网络的一个或多个权重的第二集合的值进行比较,以确定所述最终训练的神经网络的可信度。

42.在一些实施例中,所述方法包括在所述监测设备处进行比较的步骤,包括:响应于所述进一步训练的神经网络的一个或多个权重的第二集合的值与所述最终训练的神经网络的一个或多个权重的第二集合的值相差超过预定量,确定所述最终训练的神经网络是不

可信的。

43.在一些实施例中,在最终训练的神经网络上执行一个或多个另外的训练时期之前,所述方法可以包括尝试精简所述最终训练的神经网络。如果无法精简最终训练的神经网络,则可以确定最终训练的神经网络是可信的。

44.优选地,所述监测设备包括期望执行所述计算任务的电子设备。

45.本发明的实施例可以提供一种包括指令的计算机程序(产品),当所述程序由计算机运行时,所述指令使所述计算机执行本文描述的任何计算机实施的方法的步骤。还提出了一种包括指令的计算机可读(存储)介质,所述指令在由计算机运行时使所述计算机执行本文描述的任何方法(的步骤)。还提出了一种计算机可读数据载体,其上存储有本文描述的任何计算机程序(产品)。还提出了一种承载本文描述的任何计算机程序(产品)的数据载体信号。

46.还提出了一种被配置为确定用于执行电子设备所期望的计算任务的第一神经网络的训练的可信度的监测设备,其中,所述第一神经网络由外部提供方托管给所述电子设备,其中,已经以指令指示所述外部提供方例如基于真实情况数据集来训练第一神经网络,所述真实情况数据集提供针对所述电子设备所期望的计算任务的样本输入数据条目和对应的样本输出数据条目。

47.所述监测设备被配置为:在所述由外部提供方执行的所述第一神经网络的所述训练期间监测所述第一神经网络的一个或多个权重的第一集合的值;并且基于所监测的所述第一神经网络的一个或多个权重的所述第一集合的值来确定所述第一神经网络的所述训练的可信度。

48.参考下文描述的(一个或多个)实施例,本发明的这些方面和其他方面将变得显而易见并且得到阐明。

附图说明

49.为了更好地理解本发明并且为了更清楚地示出可以如何将本发明付诸实施,现在将仅通过举例的方式来参考附图,在附图中:

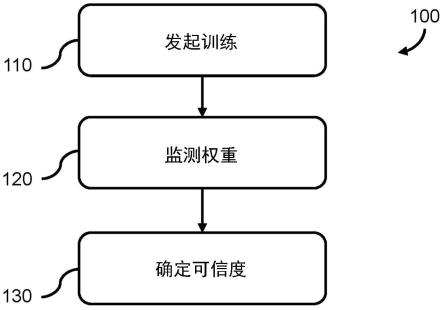

50.图1是图示根据本发明的普通实施例的方法的流程图;

51.图2图示了用于改善的背景理解的神经网络;

52.图3是图示根据实施例的方法的流程图;

53.图4是图示根据实施例的方法的流程图;

54.图5是图示根据实施例的方法的流程图;

55.图6图示了根据实施例的包括监测设备的系统;并且

56.图7是图示方法的流程图。

具体实施方式

57.将参考附图来描述本发明的实施例。

58.应当理解,详细描述和具体示例在指示装置、系统和方法的示例性实施例的同时,仅旨在用于图示的目的,而并不旨在限制本发明的范围。根据以下描述、权利要求和附图将更好地理解本发明的装置、系统和方法的这些和其他特征、方面和优点。应当理解,附图仅

仅是示意性的且并未按比例绘制。还应当理解,在整个附图中,使用相同的附图标记来指示相同或相似的部分。

59.本发明提供了一种用于确定第一神经网络的训练的可信度并由此确定经训练的神经网络的可信度的机制。在训练过程期间监测第一神经网络的权重的集合的值。所监测的值用于确定第一神经网络的训练的可信度。

60.本发明依赖于这样的认识:神经网络的外部提供方可能试图简化训练过程(例如执行不完整的训练)或者训练更简单的神经网络。所提出的机制在训练期间监测权重的值,以确定第一神经网络的训练的可信度并由此确定经训练的神经网络的可信度。

61.在本技术的背景下,可信度可以包括关于外部提供方根据某种预定训练流程/协议来训练第一神经网络的程度的指标/评估。因此,可信度可以包括外部提供方是否根据(例如外部提供方与将利用第一神经网络的电子设备之间)商定的训练流程和/或期望的训练流程来训练第一神经网络的度量(例如,二值、分类或数值度量)。

62.换句话说,可信度是响应于与由外部提供方执行的预期或期望的训练流程的偏差的指标(例如,值、度量或数据)。可信度可以例如是指示训练是否如预期/期望的那样收敛、训练过程是否正确生成针对特定散列函数的输出和/或训练过程是否满足某种其他预定准则的指标。

63.图1是图示本发明的普通方法100的流程图,以理解本发明背后的基本构思。

64.方法100被配置用于确定由外部提供方/设备执行的第一神经网络的训练的可信度,该外部提供方/设备在期望将第一神经网络用于某个处理任务的电子设备外部。

65.方法100包括在外部提供方或外部设备上发起第一神经网络的训练的步骤110。这可以包括以指令指示外部提供方基于某种训练数据来训练第一神经网络。

66.特别地,步骤110包括以指令指示外部提供方基于真实情况数据集来训练第一神经网络,真实情况数据集提供针对电子设备所期望的计算任务的样本输入数据条目和对应的样本输出数据条目。

67.步骤110可以包括例如向外部提供方发送指令信号以发起训练。

68.指令信号可以识别真实情况数据集或包含能用于训练第一神经网络的真实情况数据集的存储器。指令信号可以例如包含促进或使得外部提供方能够访问这样的数据库或存储器的信息(例如,识别信息和/或安全信息)。

69.作为另一示例,指令信号可以包括真实情况数据集本身。

70.在已经发起了训练之后,方法100随后移动到在由外部提供方执行的第一神经网络的训练期间监测第一神经网络的一个或多个权重的第一集合的值的步骤120。步骤120由监测设备来执行。一个或多个权重的第一集合优选包括第一神经网络的所有权重的子集。

71.监测设备适于通过从第一神经网络的训练的不同训练时期获得一个或多个权重的第一集合的值来监测一个或多个权重的第一集合。所述获得可以在第一神经网络的训练期间(例如通过外部提供方在特定时期完成之后发送该时期的值)执行,也可以在第一神经网络的训练之后(例如通过外部提供方存储特定时期的值并且稍后将这些值提供给监测设备)执行。

72.通过监测一个或多个权重的第一集合,能够适当地监测训练过程的进展。特别地,监测权重的第一集合使得能够(例如通过确定训练是否正在推进或者是否确实如预期的那

样推进)评估训练过程的可信度。

73.监测权重的第一集合可以包括例如监测设备(例如使用私人信息检索过程)周期性地或伪随机地请求外部提供方将权重的第一集合的值传递到监测设备。

74.作为另一示例,可以通过以指令指示外部提供方在权重的第一集合的值满足某种预定准则的情况下提交权重的第一集合的值来执行监测权重的第一集合的操作。“提交”过程可以包括:外部提供方在权重的第一集合的值满足某种预定准则的情况下将权重的第一集合的值直接传递到监测设备,或者外部提供方存储权重的第一集合的值(优选还存储某种时期标识信息)以便稍后将其发送到监测设备。

75.例如,当处理权重的第一集合的函数的输出满足某种预定准则时,可以满足预定准则。优选地,预定准则被选择为使得它引起以伪随机方式(即,每x个训练时期,其中x是伪随机的(但是可以具有预定的平均值))提交权重的第一集合的值。

76.在一些示例中,只有在完成了对第一神经网络的训练之后才将权重的第一集合的值发送到监测网络。因此,外部提供方可以在权重的第一集合的值满足某种预定准则时存储权重的第一集合的值,并且一旦训练完成就将所有存储的值(例如连同它们何时被存储的指示符——例如,存储时期标识信息)传递到监测设备。

77.在其他示例中,以周期性间隔将所存储的权重的第一集合的值发送到监测网络。例如,外部提供方可以(在任选地删除存储的值以增加可用的存储器空间之前)以周期性间隔将所有存储的值(例如以及它们何时被存储的指示符——例如,其存储的顺序)传递到监测设备。

78.在其他示例中,只有当所存储的值满足某种其他预定准则(例如,已经存储了一定数量的值,或者已经存储了一定数量的训练时期的值)时,才将所存储的权重的第一集合的值发送到监测网络。

79.在其他示例中,只有响应于监测设备的请求,才将所存储的权重的第一集合的值发送到监测设备。

80.一旦所存储的权重的第一集合的值被发送到监测设备,就可以删除所存储的权重的第一集合的值以减少存储器使用。

81.当将存储的值传递到监测设备时,外部提供方还可以包括某种具有所存储的值的基于时间的信息,其例如指示值的顺序、获得值的时间和/或获得每个值的训练时期的标识符。当存储或提交值的第一集合(将值的第一集合存储在存储器单元中/提交到存储器单元)时,可以获得该信息并将该信息与值的第一集合一起存储。

82.以这种方式,监测设备能够在第一神经网络的训练期间监测第一神经网络的权重的第一集合的值,因为(在训练期间获得的)值被存储并发送到监测设备以用于分析、监测和/或评估的目的。

83.促进权重的第一集合的监测(即,将权重的第一集合的值传递到监测设备)的其他示例对于本领域技术人员来说将是显而易见的。

84.方法100还包括使用监测设备基于所监测的第一神经网络的一个或多个权重的第一集合的值来确定第一神经网络的训练的可信度的过程130。

85.过程130可以包括例如确定可信度的度量,其可以是可信度的二值、分类和/或数值度量。

86.过程130可以包括例如确定权重的第一集合是否随时间收敛(指示正在适当执行训练过程)。

87.这可以例如通过针对权重的第一集合中的每个权重确定权重的(在第一时间点获得的)第一值与(在第二时间点获得的)第二值之间的差值并随后对所有差值进行组合(例如,求和或者求平均)来执行。这提供了不同时间点之间的距离的指标,其能够用于确定权重是否随时间收敛(例如,距离是否随时间变得更小)。

88.在另一或另外的示例中,如果以指令指示外部提供方在权重的第一集合的值满足(即,响应于它们满足)某种预定准则的情况下/时提交权重的第一集合的值,则监测设备可以核查权重的第一集合的值是否确实满足预定准则(从而核查训练过程是否正在适当推进)。

89.如果外部提供方想要进行欺骗,则他将需要伪造满足预定准则的权重的第一集合的值,同时还产生执行期望任务的经训练的神经网络。发明人认识到,该过程将需要比简单地适当执行训练更多的计算工作。

90.图2示意性地图示了用于理解本发明的实施例的神经网络200的简单表示。

91.如本领域中众所周知的,神经网络由被布置在多个层中的多个节点或神经元形成。每个神经元的值是前一层中的一个或多个神经元的加权值(或者,对于第一层来说是输入数据的特征的值)的函数。

92.在第一神经网络的训练期间,迭代地修改权重的值,每个迭代修改发生在单个训练时期(其更新第一神经网络中的所有权重)中。当第一神经网络的输出满足(与训练数据集相比的)某种预定准确度准则时(如本领域中众所周知的那样)和/或在已经完成了预定数量的训练时期之后,训练就完成了。

93.权重的第一集合可以包括对第一神经网络的权重的选择。例如,权重的伪随机选择。

94.在优选实施例中,权重的第一集合包括第一神经网络的一条或多条权重迹线。权重迹线是从第一(或“输入”)层的节点跟踪到最终(或“输出”)层的节点的权重的集合,并且包括每个层之间的单个权重。因此,权重迹线中的权重的数量等于第一神经网络中的层的数量减一。

95.由于权重迹线使用将第一神经网络的每个层连接到彼此的权重,因此使用一条或多条权重迹线使得在可信度正被监测时第一神经网络更加难以进行欺骗,因为它能够帮助降低第一神经网络将尝试仅训练第一神经网络的层的子集的可能性。

96.为了改善的理解,以实线图示了两条示例性权重迹线(其中,虚线指示第一神经网络的其他权重)。

97.图3图示了根据实施例的方法300。

98.方法300包括在外部提供方上发起第一神经网络的训练的步骤310。这可以根据任何先前描述的方法(例如关于参考图1描述的步骤110)来执行。

99.然后,方法300执行迭代过程315以监测第一神经网络的权重的第一集合的值,并且作为监测的结果,确定由外部提供方执行的训练过程是否是可信的。

100.迭代过程315包括获得权重的第一集合的值的步骤320,并且在过程331-336中处理所获得的值以确定训练过程(关于最新获得的值)是否是可信的。

101.执行迭代过程315,直到训练过程完成了并且已经获得了要由监测设备获得的权重的第一集合的所有值。

102.因此,方法300包括接收权重的第一集合的值的步骤320。这也可以根据任何先前描述的方法(例如关于参考图1所描述的步骤120)来执行。

103.对于过程315的第一次迭代,步骤320可以包括获得权重的第一集合的最早可用值,即,与训练过程的最早可用训练时期相关联的值。对于过程315的后续迭代,步骤320可以包括获得权重的第一集合的下一最早可用值。

104.如前所述,响应于值满足某种预定准则(例如当满足基于散列的(伪)随机条件时),可以(由监测设备)以指令指示外部提供方将权重的第一集合的值传递或发送到监测设备。在这种场景中,步骤320可以简单地包括直接从外部提供方获得所发送的权重的第一集合的值。

105.在其他示例中,外部提供方可以响应于权重的第一集合的值满足某种预定准则而(暂时地)存储权重的第一集合的值,并且稍后将所存储的值传递到监测设备。先前已经描述了用于这种途径的方法。

106.在这种场景中,步骤320可以包括获得权重的第一集合的下一最早的存储的值的集合——即,与存储权重的第一集合的值的最早训练时期相关联的值。

107.因此,更一般地,当权重的第一集合的值满足某种预定准则时,可以例如在步骤310中以指令指示外部提供方“提交”(例如,传送或存储)权重的第一集合的值。由步骤320执行的精确过程可以取决于如何提交权重的第一集合的值。

108.紧邻在权重的第一集合的值满足预定准则之前的(即,引起权重的第一集合满足准则的)训练时期能够被标记为“提交时期”。这是因为提交时期引起权重的第一集合的值被提交(即,传送(或存储以供稍后传送))到监测设备。关于提交时期(例如,识别外部提供方已经执行了多少训练时期以达到提交时期)的信息也可以被传送到监测设备以供分析。

109.优选地,预定准则被选择为使得在平均上由外部提供方在第一神经网络上执行的训练的每8个和32个训练时期并且更优选地每16次应当满足该预定准则。换句话说,应当在平均上在由外部提供方执行的训练的每8个至32个训练时期之间提交权重的第一集合的值。

110.这些值在确保监测足够的信息以使得整个训练过程能够被监测以供信任并同时减少被传递到监测设备并由监测设备处理的信息量(这是使外部提供方执行第一神经网络的训练背后的意图)之间提供了良好的平衡。

111.例如,如果在权重的第一集合的级联值上执行的散列函数的输出满足某种预定准则(例如,如果输出的预定数量的最高/最低有效位等于预定模式(或预定模式的集合中的一个预定模式)),则可以满足预定准则。

112.例如,输出的预定数量的最高/最低有效位可以是4个最低有效位,并且预定模式可以是“0000”。这引起在平均上每16个时期满足预定准则。用于修改时期的平均数量的其他合适数量的最高/最低有效位和模式将是显而易见的。

113.在一些实施例中,散列函数和/或第一预定准则被选择为使得每当散列函数的输出满足第一预定准则的时刻之间的训练时期的平均数量在训练时期的总数的0.5%至10%之间,例如,在训练时期的总数的1%至5%之间。

114.关于训练时期的总数的信息将是可容易获得的,例如,根据到外部网络的训练指令而获得,因为训练时期的总数可以是已知的或预先选择的。

115.合适的散列函数可以处理一个或多个权重的第一集合的值和加密密钥以产生输出。换句话说,散列函数可以是加密散列函数。加密散列函数的合适示例是安全散列算法2(sha),例如,sha256。然而,其他合适的加密函数对于本领域技术人员来说将是显而易见的,例如,bcrypt、whirlpool、sha3、blake2/blake3等,并且可以包括尚未开发的任何加密散列函数。

116.为了减少开销/延迟(例如,由散列函数引入的开销/延迟),权重的第一集合的大小应当是小的,但是仍然代表整个神经网络。例如,权重的第一集合中的权重的数量可以位于权重的总数的5-10%之间的范围内。

117.在权重的第一集合包括权重迹线的情况下,出于相似的原因,第一集合中的权重迹线的数量可以包括权重迹线的总数的5%至10%之间的数量。

118.然后,方法300执行用于确定第一神经网络的训练的可信度(即,第一神经网络本身的可信度)的过程331-336。

119.过程330包括核查所接收的权重的第一集合的值是否满足用于发送或存储所述值的预定准则的步骤331,该预定准则是以指令指示外部提供方遵循的预定准则。

120.响应于所接收的权重的第一集合的值不满足预定准则,方法300在步骤332中记录所接收的值未能满足该准则。然后,该方法移动到步骤333。

121.否则,如果所接收的权重的第一集合的值满足预定准则,则该方法直接移动到步骤333。当然,可以存在记录所接收的值成功满足预定准则的中间步骤(未示出)。

122.步骤333包括确定权重的第一集合的值是否收敛,即,变得彼此更接近。响应于确定权重的第一集合的值指示第一神经网络未能收敛,可以执行记录未能收敛的步骤334。

123.特别地,步骤333可以包括确定所获得的权重的第一集合的值与(最紧邻的)先前获得的权重的集合的值(例如,在过程315的紧邻的先前迭代中获得的权重的集合的值)之间的距离。

124.在一个示例中,可以在对所确定的个体距离进行求和或者求平均(或者以其他方式进行组合)之前通过针对权重的第一集合中的每个权重确定所述权重的值与所述权重的先前值之间的(绝对)距离(或“个体距离”)来计算所获得的权重的第一集合的值与先前获得的权重的第一集合的值之间的距离。

125.以等式的形式,所获得的权重的第一集合的值与先前获得的权重的第一集合的值之间的距离d能够被计算为:

[0126][0127]

其中,w指示权重的值,m表示权重的第一集合中的不同权重,j+1指示获得的权重的第一集合的值,并且j表示先前获得的权重的集合的值。

[0128]

能够进一步处理这个确定的距离d以确定第一神经网络是否收敛。

[0129]

例如,步骤333还可以包括将所确定的距离与在过程315的先前迭代中确定的距离(“较早确定的距离”)进行比较。如果所确定的距离小于较早确定的距离,则能够假定权重的第一集合的值正确收敛。

[0130]

如果所确定的距离大于较早确定的距离,则可以执行记录未能收敛的步骤334。在执行步骤334之后,过程315移动到步骤335。

[0131]

如果所确定的距离小于较早确定的距离,则过程315可以简单地移动到步骤335。当然,可以存在记录所接收的值成功满足准则的中间步骤(未示出)。

[0132]

本领域技术人员将意识到,在已经对过程315执行了多次迭代(例如至少三次迭代)后才可以执行步骤333的整个过程。特别地,仅仅可能的是,一旦已经确定了权重的第一集合的值的不同实例之间的两个距离,就将所确定的距离与较早确定的距离进行比较。

[0133]

因此,步骤333(在步骤315的多次迭代中)有效地包括:确定权重的第一集合的值之间的距离或误差是否收敛,并且在步骤334中记录未能收敛。

[0134]

步骤335包括处理所记录的值未能满足预定准则的情况和/或所记录的未能收敛的情况,以确定训练过程的可信度。如果步骤335确定训练过程是不可信的,则可以执行记录不可信的指标的步骤337。

[0135]

例如,如果(即,通过步骤332和334的不同迭代)记录了多于预定数量的未能满足预定准则/未能收敛(例如,在步骤332中记录了多于第一预定数量的未能满足预定准则/未能收敛和/或在步骤334中记录了多于第二预定数量的未能满足预定准则/未能收敛),则可以认为训练过程是不可信的。

[0136]

可用于监测设备的权重的第一集合的值的重复的未能满足预定准则/未能收敛可以指示训练过程是不可信的——例如,训练尚未正确推进或者未能正确推进。然而,承认训练过程可能无意地引起短暂的发散(因为这在训练期间是自然的),因此可以适当地选择未能满足预定准则/未能收敛的第二预定数量以将这种情况考虑在内(例如可以是大于1的值)。

[0137]

作为另一示例,可用于监测设备以满足预定准则的权重的第一集合的值的重复的未能满足预定准则/未能收敛指示训练过程是不可信的,所述预定准则定义了值是否被传递/存储到监测设备。

[0138]

优选地,当确定训练过程的可信度时,记录并监测这两种形式的未能满足预定准则/未能收敛。

[0139]

在这种场景中,如果外部提供方希望进行欺骗(例如,被错误地认为是“可信的”),则需要伪造验证散列函数并且还随时间收敛的权重的第一集合的值。这将要求高水平的计算复杂度,这被认为比简单地正确执行训练过程在计算上更加复杂。

[0140]

为了避免外部提供方简单地重复提供相同的值的第一集合的值(努力规避上述未能满足预定准则/未能收敛的过程),步骤333可以包括在距离与较早计算的距离完全相同时记录未能收敛。

[0141]

以这种方式,响应于所确定的未能满足预定准则/未能收敛满足某种预定准则,可以例如在步骤337中生成不可信的二值指标。步骤337的执行可以终止过程315。

[0142]

当然,可以例如响应于由步骤332和334(的不同迭代)记录的(累积的)未能满足预定准则/未能收敛的数量而生成非二值指标。未能满足预定准则/未能收敛的次数越多,第一神经网络的可信度就越低。这可以包括使用函数来处理未能满足预定准则/未能收敛的数量。

[0143]

迭代地重复过程315,直到训练过程完成并且已经处理了要被传递到监测设备的

值的第一集合的值的所有实例(例如,满足预定准则的值的第一集合的所有实例)为止。这可以通过确定步骤336来执行,当满足这些准则时,确定步骤336退出过程315。

[0144]

换句话说,可以执行过程330,直到训练过程完成并且已经处理了作为训练过程的结果的由监测设备获得的第一数据集的所有值为止。这可以在步骤336中进行确定。

[0145]

在退出过程315后,可以执行记录训练过程的可信度指标的步骤338,假定尚未记录训练过程的不可信的指标(即,尚未执行步骤337)。

[0146]

当然,响应于步骤335确定训练过程是不可信的,可以提前终止(例如,中断)过程315。

[0147]

在一些另外的实施例中,方法300被配置为还包括在训练过程期间监测外部提供方的提交的频率。特别地,步骤331可以(例如基于针对提交的预定准则的选择)核查权重的第一集合的值的提交在平均上根据预期提交频率发生。

[0148]

外部提供方未能维持(平均)预期提交频率可以指示第一神经网络未被适当训练(例如,第一神经网络未被完全训练,或仅第一神经网络的子集被训练),因此第一神经网络的训练是不可信的。

[0149]

图4图示了根据本发明的另一实施例的用于确定第一神经网络的训练的可信度的替代方法400。

[0150]

可以与参考图3描述的方法300并行地执行方法400。

[0151]

方法400包括以指令指示外部提供方基于真实情况数据集来训练第一神经网络的步骤410,真实情况数据集提供针对电子设备所期望的计算任务的样本输入数据条目和对应的样本输出数据条目;

[0152]

然后,方法400执行获得第一神经网络的所有权重的第一值的步骤420。因此,对于该实施例,“权重的第一集合”包括第一神经网络的所有权重。

[0153]

然后,方法400执行获得第一神经网络的所有权重的第二值的步骤430。第二值是自从第一神经网络的权重具有第一值以来已经在第一神经网络上执行了一个或多个训练时期之后的所有权重的值。具有第一值和第二值的第一神经网络之间的训练时期的数量对于监测设备可以是已知的(或以其他方式被提供给监测设备),并且可以是例如1或5。

[0154]

在一些实施例中,方法300是与方法400一起执行的,在这种情况下,所有权重的第一值可以是紧邻在(方法300的)“提交时期”之前的所有权重的值,并且所有权重的第二值可以是紧接在“提交时期”之后的所有权重的值。

[0155]

然后,方法400执行在监测设备处初始化具有第一值的权重的第二神经网络的步骤440。

[0156]

然后,方法400移动到使用监测设备来训练初始化的第二神经网络的步骤450。在步骤450中执行与由外部提供方在具有第一值和具有第二值的(外部提供方的)第一神经网络的权重之间执行的训练时期相同数量的训练时期。

[0157]

然后,该方法在步骤460中确定经训练的第二神经网络的所有权重的值与在步骤430中获得的(外部提供方的)第一神经网络的所有权重的第二值的相似度。这可以通过计算经训练的第二神经网络的所有权重的值与(外部提供方的)第一神经网络的所有权重的第二值之间的距离或差异来执行。

[0158]

在一个示例中,可以通过针对经训练的第二神经网络的每个权重确定所述权重的

值与外部提供方的第一神经网络的对应权重的对应第二值之间的(绝对)距离(或“个体距离”)并对个体距离进行组合(例如,求和或者求平均)来计算距离。这可以使用等式(1)的适配版本来执行。

[0159]

然后,该方法执行基于所计算的相似度来确定经训练的第二神经网络与具有第二值的第一神经网络是否足够相似的确定步骤470。步骤470可以包括例如确定相似度是否违反预定阈值。

[0160]

响应于确定经训练的第二神经网络与具有第二值的(外部提供方的)第一神经网络没有足够相似,该方法可以执行记录(外部提供方的)神经网络(的训练)不可信的步骤480。

[0161]

图5图示了用于确定经训练的神经网络是否可信的方法500。方法500可以由被配置为确定经训练的(第一)神经网络的可信度的监测设备来执行。

[0162]

图5的方法500可以在已经训练了第一神经网络并且例如通过遵循参考图1、图3和/或图4描述的方法而确定第一神经网络可信之后执行。这补充了这个先前描述的过程的可信度确定,并且提高了将使用可信神经网络的可能性。

[0163]

替代地,该过程可以是独立过程(例如,在不需要执行参考图1、图3和/或图4描述的方法的情况下执行)。

[0164]

通常,方法500是用于确定最终训练的神经网络的可信度的过程的实施例。最终训练的神经网络是当外部提供方已经完成了对神经网络的训练时由外部提供方输出的神经网络。方法500可以包括尝试进一步训练最终训练的神经网络,并且响应于第一神经网络的权重的集合的值在训练期间显著变化(例如变化超过预定量)而确定最终训练的神经网络是不可信的。

[0165]

实施例还可以包括尝试精简最终训练的神经网络,其中,无法精简指示最终训练的神经网络是可信的。

[0166]

过程500包括获得经训练的神经网络的步骤510。该步骤可以通过监测设备从外部提供方获得经训练的第一神经网络(即,“最终训练的第一神经网络”)来执行。特别地,如果监测设备已经知晓第一神经网络的结构,则步骤510可以包括获得第一神经网络的所有权重的值。

[0167]

然后,过程500移动到尝试精简第一神经网络的步骤520。然后,在步骤530中(基于步骤520的结果)确定第一神经网络是否是可精简的。

[0168]

响应于第一神经网络不是可精简的(即,在步骤520中无法精简第一神经网络),该方法执行记录第一神经网络可信的步骤590。

[0169]

响应于第一神经网络是可精简的(即,在步骤520中成功精简第一神经网络),该方法执行进一步训练(精简的)神经网络(例如在第一神经网络上执行至少一个另外的训练时期)的步骤540。

[0170]

随后,执行将进一步训练的神经网络的权重的集合的值与(在步骤510中)原始获得的第一神经网络的权重的相同集合的值进行比较的步骤550。该过程可以包括:确定进一步训练的神经网络的权重的集合的每个值与(原始的)第一神经网络的权重的集合的对应值之间的距离或差异,并且累积所确定的距离。因此,可以获得进一步训练的神经网络和原始获得的神经网络的权重的集合的值之间的总距离。

[0171]

随后,执行确定是否存在权重的集合的值的显著变化的步骤560。这可以例如通过确定总距离是否违反预定阈值来执行。

[0172]

响应于步骤560确定不存在权重的集合的值的显著变化,执行记录第一神经网络可信的步骤590。否则,执行记录第一神经网络不可信的步骤570。

[0173]

可以省去步骤520和530,并且方法500可以简单地尝试执行步骤540-590。类似地,在一些实施例中,可以省去步骤540-560。

[0174]

总之,监测设备可以获得最终训练的ai模型,并且通过重新训练ai模型和/或使用精简技术来验证ai模型是否被正确训练。监测设备能够执行以下动作以便实现这样的决定。

[0175]

如果无法精简所获得的神经网络,则外部提供方在训练期间没有进行欺骗。否则,如果能够精简所获得的神经网络,则在另外的时期内精简和训练第一神经网络。

[0176]

如果(例如使用距离测量方法)未发现权重的值发生显著变化,则能够确定外部提供方在训练过程期间没有进行欺骗。如果存在权重的值的显著变化,则能够确定外部提供方训练不足或错误地训练了第一神经网络,使得第一神经网络不可信。

[0177]

方法500认识到训练不足(例如执行了太少的训练时期)或将虚设神经元附加到第一神经网络可能导致神经网络尚未被优化,但是仍然能够执行期望的任务(但具有较低的准确度)。因此,方法500的基本构思是核查是否能够精简要由外部提供方使用的经训练的模型,并且如果是,则进一步训练该模型。如果既能够精简经训练的模型又能够进一步训练经训练的模型,则这指示经训练的模型是不可信的。

[0178]

图6图示了其中可以发生该方法的实施例的系统600。

[0179]

系统600包括希望执行要求第一神经网络的某种计算任务的电子设备610、620。电子设备610、620将第一神经网络的训练和使用外包给外部提供方660。所述设备可以通过网络690(例如,互联网)进行通信。

[0180]

特别地,已经以指令指示外部提供方基于真实情况数据集来训练第一神经网络,真实情况数据集提供针对电子设备所期望的计算任务的样本输入数据条目和对应的样本输出数据条目

[0181]

系统600包括被配置为确定第一神经网络的训练的可信度的监测设备610。监测设备610本身是本发明的实施例。

[0182]

监测设备600被配置为:在由外部提供方执行的第一神经网络的训练期间监测第一神经网络的一个或多个权重的第一集合的值;并且基于所监测的第一神经网络的一个或多个权重的第一集合的值来确定第一神经网络的训练的可信度。

[0183]

本领域技术人员将能够容易地使监测设备适于执行任何先前描述的方法。在一些示例中,监测设备610包括期望执行计算任务的电子设备。换句话说,监测设备610和电子设备可以是同一个设备。在其他示例中,监测设备610和电子设备620是不同的设备。

[0184]

本发明的构思可以在由外部提供方利用完全训练的神经网络执行的推断过程期间应用于完全训练的神经网络。

[0185]

图7是图示根据这样的构思的方法700的流程图。

[0186]

特别地,提出了确定由外部提供方执行的推断的可信度的方法700,所述外部提供方被配置为使用第一神经网络来执行电子设备所期望的计算任务。方法700可以由例如被

形成为电子设备本身的一个方面的监测设备来执行。

[0187]

该方法包括以指令指示外部提供方响应于关于推断动作的信息满足某种第二预定准则而提交关于推断动作的信息(例如向监测设备传送关于推断动作的信息或者存储关于推断动作的信息以用于稍后传送给监测设备)的步骤710。

[0188]

然后,在过程720中,监测设备可以处理所提交的关于推断动作的信息,以确定由外部提供方执行的推断的可信度。过程720可以在由外部提供方执行的整个推断过程中(例如在外部提供方执行用于电子设备的推断过程的整个时间中)执行。

[0189]

过程720可以包括确定所提交的信息是否满足第二预定准则的步骤721。这有效地使得监测设备能够核查是否正在将正确的神经网络用于推断动作。

[0190]

优选地,第二预定准则被选择为使得外部提供方在平均上每y个推断动作提交信息,其中,y是4至64之间(例如,4至32之间,例如,8至32之间,例如,16)的值。

[0191]

过程720还可以包括监测正被提交的信息之间的推断动作的平均数量的步骤722,并且如果这偏离第二预定准则的选择,则确定外部提供方正在不一致地使用经训练的神经网络并且由外部提供方(并且因此经训练的神经网络)执行的推断因此是不准确或不可靠的。

[0192]

关于推断动作的(提交)信息可以包括以下各项的级联或另一组合:输入数据、第一神经网络的权重、部分处理的数据(例如,在推断动作期间在第一神经网络的一个或多个节点处的值)和/或输出数据。

[0193]

第二预定准则可以例如是基于散列的(伪)随机条件。换句话说,当处理关于推断动作的信息的散列函数的输出满足某种预定准则、预定值或预定模式时,可以满足第二预定准则。

[0194]

合适的散列函数可以处理关于推断动作的信息和加密密钥以产生输出。换句话说,散列函数可以是加密散列函数。

[0195]

加密散列函数的合适示例是安全散列算法2(sha),例如,sha256。然而,其他合适的加密函数对于本领域技术人员来说将是显而易见的,例如,bcrypt、whirlpool、sha3、blake2/blake3等,并且可以包括尚未开发的任何加密散列函数。

[0196]

如果在关于推断动作的信息上执行的散列函数的输出满足某种预定准则(例如,如果输出的预定数量的最高/最低有效位等于预定模式(或预定模式的集合中的一个预定模式)),则可以满足第二预定准则。

[0197]

例如,输出的预定数量的最高/最低有效位可以是4个最低有效位,并且预定模式可以是“0000”。这引起在平均上每16个推断动作满足预定准则。用于修改推断动作的平均数量的其他合适数量的最高/最低有效位和模式将是显而易见的。

[0198]

应当认识到,外部提供方可能仍然能够通过在部分时间内运行更便宜的模型来进行欺骗,并且具有略小于期望频率但是大到足以保持在可接受的误差范围内的提交率(例如,20个推断动作提交一次而不是期望的16个推断动作提交一次)。

[0199]

为了解决这样的攻击,监测设备或方法可以被配置为(例如在监测设备处)使用外部提供方应该使用的第一神经网络的副本(例如基于要推断的输入数据)来执行它自己的推断操作。监测设备可以以比外部提供方更低的频率执行这种推断,以降低计算功率要求。

[0200]

该方法可以包括在步骤723中基于外部提供方自己的推断操作来确定外部提供方

应当何时发生提交动作。换句话说,方法700可以包括核查外部设备是否已经正确提交了预期推断的步骤723。外部提供方在它应当执行时未能执行提交动作(基于监测设备的确定)指示外部提供方正在不一致或不可靠地使用期望的神经网络,使得由第一神经网络执行的(一个或多个)推断不是可信的。

[0201]

步骤721、722、723提供了过程720的示例子步骤,并且技术人员将能够确定用于处理(满足第二预定准则的)提交的信息以确定用于推断的第一神经网络的可信度的其他步骤。

[0202]

可以在步骤725中处理在步骤721、722和723中的任一步骤中获得的信息,以确定由外部提供方执行的推断是否是可信的(即,可靠的)。例如,外部设备未能在合适的误差容限内满足预期的操作(例如,提交的信息未能满足第二预定准则、提交的推断之间的平均值未能满足预期的平均值或者未能提交预期的推断)可以指示经训练的神经网络是不可信的。

[0203]

如果步骤725确定推断是不可信的,则可以在步骤730中记录这一情况。否则,该方法可以重复过程720。

[0204]

本发明的实施例总体上涉及用于确定神经网络的训练和/或经训练的神经网络的可信度的方法。可以响应于确定神经网络的训练或经训练的神经网络是不可信的而采取各种步骤。

[0205]

例如,监测设备可以以指令指示外部提供方重新训练第一神经网络,例如以迫使外部提供方正确或适当训练第一神经网络。

[0206]

在另一示例中,监测设备可以以指令指示不同的外部提供方使用真实情况数据集来训练神经网络,并且电子设备可以切换到使用不同的外部提供方来执行计算任务。

[0207]

在又一示例中,监测设备可以简单地标记由外部提供方执行的推断可能不准确,并且可以将该信息传送给电子设备的用户以允许他们决定如何继续进行(例如,是否要切换外部提供方,继续当前外部提供方的潜在不太准确的神经网络,以指令指示外部提供方重新训练第一神经网络等)。

[0208]

可以响应于确定第一神经网络的训练或经训练的神经网络不可信而采取的其他步骤对于技术人员来说将是显而易见的。

[0209]

技术人员将能够容易地开发用于执行本文描述的任何方法的处理系统。因此,流程图的每个步骤可以表示由处理系统执行的不同动作,并且可以由处理系统的相应模块来执行。

[0210]

因此,实施例可以利用处理系统。处理系统能够利用软件和/或硬件以多种方式实施,以执行所要求的各种功能。处理器是采用一个或多个微处理器的处理系统的一个示例,可以使用软件(例如,微代码)对所述一个或多个微处理器进行编程以执行所要求的功能。然而,处理系统可以在采用或不采用处理器的情况下被实施,并且还可以被实施为执行一些功能的专用硬件与执行其他功能的处理器(例如,一个或多个编程的微处理器和相关联的电路)的组合。

[0211]

可以在本公开内容的各种实施例中采用的处理系统部件的示例包括但不限于常规的微处理器、专用集成电路(asic)和现场可编程门阵列(fpga)。

[0212]

在各种实施方式中,处理器或处理系统可以与一种或多种存储介质相关联,例如,

易失性和非易失性计算机存储器,例如,ram、prom、eprom和eeprom。可以利用一个或多个程序对存储介质进行编码,所述一个或多个程序当在一个或多个处理器和/或处理系统上被运行时执行所要求的功能。各种存储介质可以被固定在处理器或处理系统内,也可以是可转移的,使得存储在其上的一个或多个程序能够被加载到处理器或处理系统中。

[0213]

应当理解,所公开的方法优选是计算机实施的方法。正因如此,还提出了计算机程序的构思,所述计算机程序包括代码单元,所述代码单元用于当所述程序在处理系统(例如,计算机)上运行时实施任何描述的方法。因此,根据实施例的计算机程序的代码的不同部分、行或块可以由处理系统或计算机来运行以执行本文中描述的任何方法。在一些替代实施方式中,在(一幅或多幅)框图或(一幅或多幅)流程图中注释的功能可以不按图中注释的顺序发生。例如,相继示出的两个框实际上可以基本上同时运行,或者框有时可以以相反的顺序运行,具体取决于所涉及的功能。

[0214]

本领域技术人员通过研究附图、公开内容以及权利要求,在实践请求保护的发明时能够理解并实现对所公开的实施例的变型。在权利要求中,“包括”一词并不排除其他元件或步骤,并且词语“一”或“一个”并不排除多个。单个处理器或其他单元可以实现在权利要求中记载的若干项的功能。能够有利地组合在相互不同的从属权利要求中记载的措施。如果上面讨论了计算机程序,则它可以被存储/分布在合适的介质上,例如与其他硬件一起或作为其他硬件的部分而供应的光学存储介质或固态介质,但是也可以以其他形式分布,例如经由互联网或其他有线或无线的电信系统进行分布。如果术语“适于”用在权利要求书或说明书中,则应当注意,术语“适于”旨在等效于术语“被配置为”。权利要求中的任何附图标记都不应被解释为对范围的限制。

[0215]

总之,本发明的一个方面提供了一种用于确定神经网络的训练的可信度并且由此确定经训练的神经网络的可信度的机制。在训练过程期间监测第一神经网络的权重的集合的值。所监测的值用于确定第一神经网络的训练的可信度。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1