使用基于图的时间分类训练神经网络的制作方法

本发明总体上涉及训练神经网络,并且更具体地,涉及使用基于图的时间分类(gtc)目标来训练神经网络的方法。

背景技术:

1、神经网络可以再现和建模非线性过程,因此在过去几十年中,神经网络已被用于各种学科的众多应用中。神经网络可以通过处理示例来学习(或被训练),每个示例含有已知的“输入”和“结果”,在已知的“输入”和“结果”两者之间形成概率加权关联,这些存储在网(net)本身的数据结构中。来自给定示例的神经网络的训练通常通过确定网络的处理输出(通常是预测)和在本文中也被称为训练标签的目标输出之间的差异来进行。这种差异代表了训练旨在减少的错误。因此,网络然后根据学习规则并使用此错误值调整其加权关联。逐次调整将使神经网络产生与目标输出越来越相似的输出。经过足够数量的这些调整后,可以基于一定标准终止训练。

2、这种类型的训练通常被称为监督学习。在监督学习期间,神经网络通过考虑示例来“学习”执行任务,通常无需用特定于任务的规则来编程。例如,在图像识别中,它们可能通过分析已经被标注为“猫”或“不是猫”的示例图像并使用结果来识别其它图像中的猫来学习识别含有猫的图像。它们在没有猫的任何先验知识(例如,它们有毛皮、尾巴、胡须和类似猫的脸)的情况下做这些。相反,它们从它们处理的示例自动生成识别特征。

技术实现思路

1、技术问题

2、然而,要执行此类监督学习,需要将图像标注为猫或狗。这种标注是乏味和费力的过程。此外,在此图像识别示例中,标注是无歧义的。图像含有猫、狗或者不含有猫或狗。这种无歧义的标签并不总是可行的。例如,一些训练应用处理其中定时可变的序列问题。时间变量可以在其中输入序列具有不同于输出序列的长度的这种训练中创建一对多或多对一的歧义。

3、具体来说,一些训练神经网络的方法使用连接主义时间分类(ctc)目标函数算法。ctc是在训练标签序列与根据输入到神经网络的观察序列而计算出的、由神经网络输出的更长的标签概率序列之间没有可用的时间对齐信息时训练神经网络所使用的损失函数。这种缺失的时间对齐信息在神经网络输出的标签概率序列与作为使用ctc目标函数可以求解的训练标签序列的、用于训练的监督信息之间创建了时间歧义。

4、然而,ctc目标函数仅适用于解决神经网络训练期间的时间歧义。如果需要考虑其它类型的歧义,则ctc目标函数将失败。

5、技术方案

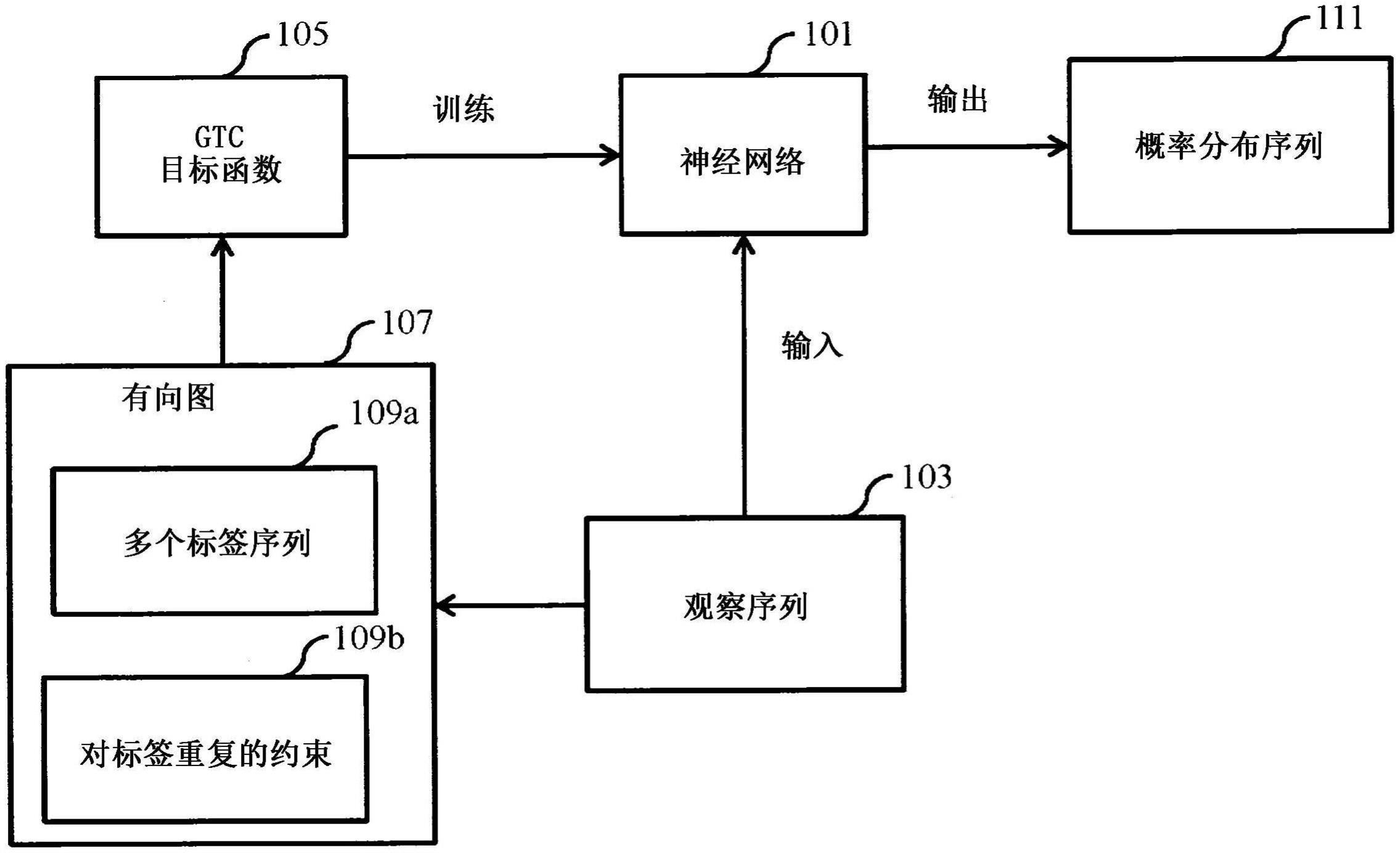

6、一些实施方式基于以下认识:ctc目标函数的原理非常适用于一些情况但不适用于其它情况。具体来说,ctc目标函数正在使用插入到用于训练的训练标签序列中的每个训练标签之前和之后的附加空白标签。此外,ctc允许无限标签重复,并使用特定规则以从一个标签转移到另一标签。通过遵循ctc规则,包含空白标签的标签序列可以扩展到观察序列的长度。这种扩展允许在训练期间考虑时间对齐。存在使用ctc规则可以将标签序列扩展到观察序列的长度的多种方法。然而,所有这些方法仅适用于在时间上对齐特定标签序列,而在其它情况下会失败。

7、然而,一些实施方式基于以下认识:现代应用的复杂性不仅限于解决时间歧义的时间对齐。例如,在一些情况下,训练标签本身的定义是有歧义的,因此训练不仅需要解决时间歧义而且需要解决标签歧义。例如,当以自动方式产生训练标签时,可能出现标签歧义。事实上,当由人类操作员手动产生训练标签时,标签可以做得精确、准确,并且可以被视为真实的。然而,当以自动化方式产生标签时,例如在半监督学习中,标签的准确性是不确定的。此外,即使由人类操作标注期间,标注过程也可能非常费力,有时只能部分地执行(例如在弱标签情况下),从而造成标签歧义。附加地或另选地,人类操作员也可能对标签序列内的一个或更多个特定标签不确定,并且对于它们不确定的每个标签,使用通配符标签或潜在标签的集合而不是单个标签。

8、为此,一些实施方式的目的是变换ctc目标的原理以提供不仅适用于时间对齐而且适用于标签对齐和/或其它目的的不同的训练目标函数。

9、一些实施方式基于以下认识:ctc目标的规则强制在由神经网络输出的标签概率序列与标签序列之间的单调对齐,从而防止标签对齐。这不应该让人感到惊讶,因为单调对齐对应于解决一维歧义,即,时域中的歧义。此外,用于插入空白标签和用于从标签序列中的一个标签转移到另一标签的特定ctc规则可以表示为图。ctc不考虑图,但如果考虑的话,对于ctc,这样的图将是有向图,该有向图将可以访问标签的顺序固定,使得仅允许由神经网络输出的标签概率序列与标签序列之间的单调对齐。虽然ctc目标和/或ctc规则的定义不是基于图的,但一些实施方式是基于以下认识:ctc目标的问题或限制可以通过有向图来例示并使用基于图的定义来解决。

10、具体而言,如果ctc规则使训练标签序列的监督信息驻留在强制由神经网络生成的标签概率序列与训练标签序列之间单调对齐的有向图上,则一些实施方式通过使用用于利用有向图进行训练的监督信息来打破单调对齐规则来改变此限制。虽然具有单调对齐规则的有向图允许仅在时间维度上的变化,但是有向图的非单调特征允许在时间维度和标签维度二者上的变化,以在训练期间考虑不同的标签序列。因此,训练目标将不再是ctc,并且本文称为基于图的时间分类(gtc)目标。

11、为此,一些实施方式公开了使用驻留在具有非单调对齐属性的非单调有向图上的监督信息用gtc目标来训练神经网络。可以参照单调对齐属性来说明非单调对齐属性。图的单调性或单调对齐属性由在去除标签重复和空白标签后,可通过从特定开始节点转移到特定结束节点而从图生成的标签序列的数量来定义。

12、如本文所定义的,具有单调对齐属性的图(诸如将遵循ctc规则的图)只能输出单个标签序列,而具有非单调对齐属性的图可以输出多个不同的标签序列。也如本文所定义的,并且如本领域技术人员通常理解的,具有在时间上不同布置的相同标签次序或具有不同的空白标签填充的标签序列被认为是相同的标签序列并且被本公开视为单个标签序列。例如,按照ctc的定义,在去除复制标签重复然后空白标签产生作为输入到ctc目标的训练标签序列的单一标签序列的坍缩过程之后填充的标签序列。在具有非单调对齐的gtc设置中,这样的坍缩可以和/或将产生多个标签序列。

13、为此,在一些实施方式中,具有非单调对齐的有向图的结构允许多个唯一标签序列将标签序列映射到概率分布序列。为了实现这种非单调对齐,形成有向图的节点和边的结构包括其中有向图中的至少一个节点通过边连接到代表不同的非空白标签的多个其它节点的多个非空白连接以及通过连接多个非空白节点的边所形成的环中的一种或者组合。

14、一些实施方式基于以下认识:在有向图上呈现监督信息允许应用不同的规则以按与这种训练的原理一致的方式来训练神经网络。这是因为有向图的结构与训练的前向-后向算法所使用的可微分方法一致。因此,如果希望强制施加于训练的规则被呈现为有向图的结构的一部分,则可以以与前向-后向算法一致的可微分方式将这样的规则强制施加于训练。

15、这种规则的示例是对标签重复的约束。具体来说,在ctc目标中,为了将训练标签序列展开到观察序列的长度,可以将标签重复标签训练序列的长度与观察序列的长度之间的差所允许的次数一样多的次数。然而,这种不受约束的重复要求会浪费计算资源。没有有向图,对训练强制施加重复约束是具有挑战性的。然而,借助有向图,可以将重复约束合并到有向图本身的结构中。

16、因此,附加地或另选地对于有向图的非单调对齐,一些实施方式使用有向图的结构在训练期间强制施加对标签重复的约束,该约束指定了标签的最小重复次数、标签的最大重复次数,或两者。对代表标签的节点的标签重复的这种约束可以通过去除节点的自转移并向节点添加至代表相同标签的其它节点的转移来实现。

17、因此,具有来自由代表标签和标签之间的转移的边连接的节点的有向图的监督信息允许强制施加用于训练神经网络的灵活规则。例如,一些实施方式公开了在所有训练标签之间不插入空白标签或使用多个不同的空白标签的情况下,用gtc目标训练神经网络。附加地或另选地,一些实施方式公开了使用可以包括多个状态的每个标签的隐藏马尔可夫(markov)模型(hmm)类拓扑,用gtc目标来训练神经网络。附加地或另选地,一些实施方式公开了使用具有与成本或加权因子相关联的节点之间的转移的有向图,用gtc目标来训练神经网络。

18、除了使用驻留在有向图上的监督信息之外,一些实施方式还修改了gtc目标函数以容纳标签对齐。例如,gtc目标函数是通过使通过将给定有向图展开到由神经网络输出的标签概率序列的长度,从给定有向图可以生成的具有特定开始节点和结束节点的所有节点序列路径的条件概率之和最大化来定义的。通过基于计算前向和后向变量并将两者拼接在一起的动态规划算法,可以有效地计算gtc训练损失和梯度。

19、神经网络的基于gtc的训练旨在通过优化神经网络的标签预测使得通过编码标签信息的有向图可以生成最佳整体预测的标签序列,并且使得对于训练样本集和基于图的标签信息对而言所有可能的标签序列预测的误差最小化,来更新神经网络的可训练参数。可训练参数的示例包括神经网络的神经元的权重、超参数等。

20、附加地或另选地,一些实施方式基于以下实现:gtc目标函数和有向图允许不仅考虑多个标签序列而且考虑多个标签序列的不同概率。这种考虑对于gtc目标函数是有利的,这是因为这种考虑可以适配特定情况的监督信息。为此,在一些实施方式中,针对至少一些边或转移用不同的权重对有向图进行加权。这些转移的权重用于计算标签序列的条件概率。

21、因此,一个实施方式公开了一种计算机实现的方法,该方法通过使用来自由代表标签和标签之间的转移的边连接的节点的有向图的监督信息、使用基于图的时间分类(gtc)目标函数训练神经网络,其中有向图代表由神经网络输出的概率分布序列和标签的可能的对齐路径,其中有向图的结构指定了标签序列和概率分布序列之间的非单调对齐以及标签序列中对标签重复的约束中的一种或组合,其中神经网络的输入是观察序列,并且神经网络的输出是在标签的集合中的所有标签上的概率分布序列。

22、该方法包括:实施神经网络,以将观察序列变换为概率分布序列;以及基于gtc目标函数更新神经网络的参数,gtc目标函数被配置为使通过将有向图展开到概率分布序列的长度并将每个展开的节点和边的序列映射到标签序列而生成的所有可能的标签序列的条件概率之和最大化,其中所有标签序列的条件概率之和是根据由神经网络确定的概率分布序列和驻留在有向图的边上的权重而估计的。

- 还没有人留言评论。精彩留言会获得点赞!