基于宽激活循环神经网络的近无损压缩图像软解码方法

1.本发明属于数字图像处理技术领域,涉及一种图像软解码方法,具体涉及一种基于宽激活循环神经网络的近无损压缩图像软解码方法。

背景技术:

2.在遥感影像、远程医疗、物联网等领域,图像编码器通常封装在高集成度的芯片中。为了提升图像质量而修改片上系统的编码器通常是一个很棘手的问题。而图像软解码的优势,就是可以在不修改编码器的同时,完成压缩图像质量的提升。

3.软解码实际上是一种病态逆问题。先前的软解码技术多是基于显式的图像建模和优化。如基于自回归模型、基于稀疏、随机游走图等。近年来,随着卷积神经网络的火热,研究人员舍弃了基于手工设计特征的方法,转而借助卷积神经网络来设计一种由数据驱动的、端到端的软解码器。由于具有更大的感受野并且不需要显示优化,基于卷积神经网络的软解码器在图像质量提升以及运行时间上均优于基于建模的软解码器。然而,多数基于网络的软解码技术只是将图像软解码任务视为一种常规的图像恢复任务。这种假设并不适用于近无损压缩这一类有约束图像恢复任务。

4.近无损压缩图像技术是一种较为特殊的图像压缩技术。除了要求高压缩率和高图像质量以外,近无损压缩技术还约束图像中每一个像素点的峰值绝对误差。该约束可以保留图像中微小的局部特征,因此近无损压缩技术常被用于遥感影像和远程医疗这一类对压缩图像质量极其敏感的领域。

5.zhou jiantao等人在期刊《ieee transactions on image processing》上发表了一篇题目为“l2 restoration of l

∞-decode images via soft-decision estimation”的学术论文,公开了一种基于自回归模型的近无损压缩图像软解码方法。该方法通过正则化量化误差来提升低比特率图像恢复质量。然而基于自回归模型的方法在处理由数据驱动的问题时效果通常不如卷积神经网络好。

6.zhang xi等人在期刊《data compression conference》上发表了一篇题目为“near-losslessl

∞-constrained image decompression via deep neural network”的学术论文,公开了一种基于生成式对抗网络的近无损压缩软解码方法。该方法通过添加一种无穷范数约束的损失函数来约束软解码方法,从而实现近无损压缩图像的恢复。但该方法本身所使用的网络层数较深,网络权重参数较多,且仅能恢复压缩系数为6,8,10的近无损压缩图像。对于软解码器而言,仅支持三种压缩系数的恢复是远远不够的。此外,该方法所采用的无穷范数约束的损失函数并不能有效的限制解码图像的像素恢复区间。

7.综上所述,现有的软解码方法存在重建压缩图像质量不够清晰,且像素边界约束不够严格的问题。

技术实现要素:

8.本发明的目的在于,针对上述现有技术中的不足,提供一种基于宽激活循环神经

网络的近无损压缩图像软解码方法,以解决现有技术中重建压缩图像质量不够清晰,且像素边界约束不够严格的问题。

9.本发明的技术思路是:采用宽激活卷积神经网络结构,以循环方式构建近无损压缩软解码器,利用一种规范化的激活函数,满足恢复图像的像素边界约束,完成多种压缩系数的恢复。在保证解码图像质量提升的前提下,通过添加结构性无穷范数约束,满足近无损压缩软解码方法的像素边界约束,提升解码图像质量。

10.为实现上述目的,本发明采用的技术方案如下:

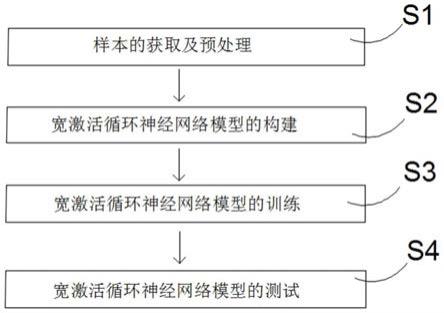

11.本技术提供一种基于宽激活循环神经网络的近无损压缩图像软解码方法,该方法包括如下步骤:s1,样本的获取及预处理;s2,宽激活循环神经网络模型的构建;s3,宽激活循环神经网络模型的训练;s4,宽激活循环神经网络模型的测试。

12.更进一步地,预处理包括将样本进行近无损压缩。

13.更进一步地,预处理包括将样本以4:1的比例划分为训练样本集和测试样本集。

14.更进一步地,宽激活循环神经网络模型包括特征提取部分、特征推理部分、图像重建部分。

15.更进一步地,特征提取部分为图像升维网络,包括输入层和卷积层。

16.更进一步地,卷积层的卷积核尺寸为3

×

3。

17.更进一步地,特征推理部分为宽激活神经网络,包括输入层、四个卷积层、残差层。

18.更进一步地,四个卷积层中两个卷积层的卷积核尺寸为1

×

1。

19.更进一步地,两个卷积层的激活函数均为relu激活函数。

20.更进一步地,图像重建部分为图像降维网络,包括输入层、卷积层、残差层。

21.与现有技术相比,本发明的有益效果:

22.(1)本发明使用宽激活与循环神经网络相结合的形式,极大的降低了网络的参数量,同时图像重建效果仍优于其他同类方法,提升了压缩图像重建质量。

23.(2)本发明通过引入一种规范化的激活函数结构,在不需要额外训练函数的同时,仍严格的限制了重建图像的像素边界,有效提升压缩图像重建质量。

附图说明

24.图1为本发明提供的一种基于宽激活循环神经网络的近无损压缩图像软解码方法的示意图;

25.图2为本发明提供的一种基于宽激活循环神经网络的近无损压缩图像软解码方法中步骤s2构建的宽激活循环神经网络的示意图;

26.图3为本发明提供的一种基于宽激活循环神经网络的近无损压缩图像软解码方法与其他图像恢复方法效果对比图。

具体实施方式

27.为了使本发明的实施过程更加清楚,下面将会结合附图进行详细说明。

28.本发明提供了一种基于宽激活循环神经网络的近无损压缩图像软解码方法,如图1所示,具体步骤如下:

29.s1,样本的获取及预处理;

30.本发明的待恢复图像可以来自于现有的数据库也可以来自于直接拍摄,具体地,本发明训练使用的图像来自于现有数据库divk2k,其图像为900张2k*1k的图像。训练完成后,本发明既可应用于数据库图像恢复,也能应用于直接拍摄图像恢复。预处理包括近无损压缩、划分训练样本集和测试样本集、规范化。将m张分辨率大小为n

×

k的图像样本x,并对每个图像样本使用近无损压缩方法进行压缩,进一步得到m张经过近无损压缩方法压缩后的图像样本其中,m≥900,n≥2000,k≥1000,这有利于构建数量充足的数据集,加快网络的训练收敛,提高网络的泛化性,具体地,图像样本的数量不少于900张,可以保证本发明方法有充足的训练样本集去学习压缩后的图像样本与图像样本x之间的映射关系;像素需要高于2000*1000除了可以保证充足的训练以外,高分辨率的图像样本含有更多的细节信息,这有助于本发明方法学习细节的恢复,更具体地,图像样本的近无损压缩是一种通过降低图像样本质量来达到压缩目的的方法,因此压缩前的图像样本必须要保证分辨率够高,图像样本够清晰,才能够保证神经网络更好地学习压缩前后的图像样本之间的映射关系,从而较好的重建压缩图像。量化系数为近无损压缩时对图像样本x进行近无损压缩的量化系数,量化系数为整数,例如,选择量化系数为2时,近无损压缩会针对预测误差进行除2量化,像素值[0,1,2,3,4]将变为[0,0,1,1,2],具体地,量化系数越大,图像失真越严重,占用存储越小;量化系数越小,图像保真度高,但是占用内存下降的少。用户在进行近无损压缩时,需要基于内存和保真度的需求综合考量,以决定量化系数的具体数值。具体地,近无损压缩方法可以参考x.wu等人公开的名称为“calic-a context based adaptive lossless image codec”的学术论文中的介绍。本发明方法适用于不同量化系数近无损压缩下的图像重建任务,本发明方法的适用性较强。

[0031]

将图像样本x及对应的近无损压缩后的图像样本随机地以4:1的比例划分为训练样本集和测试样本集;训练样本集中含有图像样本x中的4/5及对应的近无损压缩后的图像样本中的4/5,测试样本集中含有图像样本x中的1/5及对应的近无损压缩后的图像样本中的1/5;由于本发明方法构建图像样本集数量较大,这样能够将大部分样本用于训练,留小部分样本用作测试,这样既保证了训练数据的充分,又有一定数量的数据测试方法的泛化性。规范化是将图像样本规范化至-1-+1,具体地,以图像样本减去多位图像样本最大值的均值,再将其除以多位图像样本的最大值,更具体地,本发明中,令该图像样本减去8位图像最大值的均值128,再将其除以最大值255,即可得到规范化至-1-+1的图像,其中均值128以及最大值255是固定不变的,处理公式为:规范化至-1-+1能够保证图像的最小最大值在-1-+1之间,这样可以使得训练时神经网络得到的重建图像和图像样本x之间的误差不会太大,便于训练的快速收敛。

[0032]

s2,宽激活循环神经网络模型的构建;

[0033]

s21,如图2所示,宽激活循环神经网络模型包括特征提取部分、特征推理部分、图像重建部分。其中,特征提取部分为图像升维网络,包括输入层和卷积层,用于提升输入样本图像维度,这样可以将输入图像样本映射到另一高维特征空间,此外,更高维度的图像样本也具有更多的特征,以便后续特征提取;特征推理部分为宽激活神经网络,包括输入层、多个卷积层、残差层,用于生成重建图像残差;图像重建部分为图像降维网络,包括输入层、卷积层、残差层,用于降低输入样本图像维度,这样能够降低图像维度至与输出图像维度一

致,以便后续的数学操作,同时将输入样本图像和重建残差组合成最终预测的重建图像。

[0034]

具体地,特征提取部分包括输入层和一个卷积层,即输入层

→

第一卷积层。特征推理部分包括输入层、四个卷积层、一个残差层,依次设置为:输入层

→

第二卷积层

→

第三卷积层

→

第四卷积层

→

第五卷积层

→

第一残差层。在不改变图像样本大小的情况下,第二卷积层进一步提升图像样本的维度,如表1所示,图像样本通道数由64增加至256,因此可被卷积操作提取到的特征也相应增加。第三卷积层降低图像样本的维度,如表1所示,图像样本通道数由256降为48时,即对特征进行了筛选,这样第二卷积层和第三卷积层对图像样本维度的提升和降低分别对特征进行丰富和筛选,本发明方法能够提取到更多有效的特征,提高重建图像的质量。第四卷积层(3

ⅹ

1)和第五卷积层(1

ⅹ

3)是卷积核(3

ⅹ

3)的等效替代,其功能是将图像样本维度恢复至与输入维度一致,以便进行循环推理;等效替代的优势是尽管层数增加了,但是卷积参数由3

ⅹ

3减少为(1

ⅹ

3)

ⅹ

2。第一残差层的作用是将第五卷积层的输出与输入层进行相加,这样有助于训练误差的反向传递,便于方法快速学习,需要注意,第一残差层的输出并不会直接进入图像重建部分,而是会再一次返回特征推理部分的输入层,以此循环12次。由于仅用四层卷积层做特征推理是完全不够的,但是增加卷积层数又会极大的增加方法的运算复杂性以及运算时间,为了保证足够的推理,同时不增加方法复杂度,本发明方法采用循环的方式进行特征推理。循环12次是基于运行时间及重建效果的权衡。如果循环次数小于12,则会降低图像重建质量;循环次数大于12,重建效果会有一定提升,但是运算时间也相应的增加了。在保证重建图像质量的前提下,为了尽可能的减小宽激活循环神经网络模型的运行时间,本发明选择循环次数为12。

[0035]

具体地,图像重建部分包括输入层、一个卷积层、一个残差层,依次设置为:输入层

→

第六卷积层

→

第二残差层,同特征推理的第一残差层一样,该第二残差层将第六卷积层的输出与待恢复图像进行相加操作,第六卷积层的作用是改变输入的维度至与待恢复图像一致,由于本发明中的相加操作均为相同尺寸、相同通道的图像间的逐像素相加,因此图像的维度必须一致,这样第二残差层才能进行相加操作。除第六卷积层的输出通道外,其他卷积层卷积核的尺寸、步长、以及输出通道数只会影响本发明方法的运算时间,不会对图像样本的恢复效果有较大影响,只需要注意保证输出通道数的大小关系,即第二卷积层应大于第一卷积层,第三和第四卷积层应小于第二和第五卷积层,以便满足特征的丰富及筛选功能。第六卷积层的输出维度需与待恢复图像一致,因此输出通道数固定为1。

[0036]

关于特征提取部分、特征推理部分、图像重建部分的激活函数选择,由于relu函数在输入为正值时,为线性函数,在输入为负时,则输出为零,输出为零意味着对应输入的梯度不需要计算,因此运算速度较快,elu与relu的不同之处在于,输入为负时,elu会输出一个较小的值,即输出不为零,这样输入为负值时也可以输出特征,能够提取更多的特征,为了提取更多的特征本发明特征提取部分选择elu函数,为了提高特征推理的速度,特征推理部分选择了relu;图像样本在输入宽激活循环神经网络模型前进行了规范化,因此在宽激活循环神经网络模型最终输出前,为避免宽激活循环神经网络模型预测值域超出-1-+1的范围,图像重建部分选择使用tanh函数,能够将预测结果强制规范化至-1-+1,以便后续的逆变换操作。进行一次图像重建包括在特征提取部分进行一次特征提取部分,然后进入特征推理部分循环进行十二次,推理循环结束后进入图像重建部分,输出得到重建图像,即完成一次图像重建。本发明中特征提取部分、特征推理部分、图像重建部分的各个卷积层参数

设置详见表1,表1中的参数设置仅为一个示例。

[0037]

表1:特征提取部分、特征推理部分、图像重建部分的各个卷积层参数设置。

[0038][0039]

如图2所示,量化系数τ为步骤s1中图像样本x进行近无损压缩时的量化系数,是取值范围为2~10的9个整数,每次进行恢复图像样本时需由用户输入。对于不同的图像样本恢复时,能够选择不同的量化系数τ,以得到质量更高的重建压缩图像,本发明方法的适用性较强。具体地,输入宽激活循环神经网络模型前待恢复图像中的每个像素都除以该量化系数τ:image/τ,;激活函数tanh输出图像样本的每个像素与量化系数τ进行相乘:image

×

τ,这样方便在预测过程中保证关系式的统一,从而提高本发明方法重建图像的效率。

[0040]

s22,定义宽激活循环神经网络的损失函数l:

[0041][0042]

其中,x是图像样本,是使用近无损压缩方法压缩后的图像样本,f是宽激活循环神经网络模型,d=h

×w×

c,h是x和的高度,w是x和的宽度,c是x和的通道数。本发明以二范数约束作为损失函数,不需要针对像素边界约束设计损失函数,像素边界约束已通过如图2所示的量化系数τ和激活函数的设置实现,具体地,图像样本x与压缩后的图像样本满足如下关系式:

[0043][0044]

其中e∈[-1,+1]

[0045]

其中,τ为量化系数,e为图像样本x和使用近无损压缩方法压缩后的图像样本之间的误差,即表示图像样本残差。本发明方法得到的重建图像与图像样本x应当是一致的,即本发明方法得到的重建图像与待恢复图像样本同样有如下关系式:

[0046][0047]

其中e∈[-1,+1]

[0048]

本发明方法使用tanh函数表示误差e,因此有如下关系式:

[0049]

[0050]

其中,为图像重建部分,是tanh函数的输入。从而,本发明方法通过函数约束实现像素边界约束,相比于通过损失函数设计像素边界约束的方法,本发明的像素边界约束更加严格,能够有效提升重建图像的质量,保证了严格的像素边界约束,提升人的视觉感官体验。

[0051]

表2:本发明方法与l-inftycnn方法的对比。

[0052][0053]

具体地,将本发明方法与l-inftycnn方法在live1数据集上针对三种量化系数的结果进行对比,对比结果展示在表2中,其中峰值信噪比(psnr)越大,无穷范数边界最大值越小代表像素边界约束更加严格,重建图像的质量越高。在量化系数为6,8,10时,本发明方法的psnr均大于l-inftycnn方法,本发明方法的无穷范数边界最大值均小与l-inftycnn方法,即本发明方法的像素边界约束更加严格,重建图像的质量更高。为确保对比结果的可靠性,对比时本发明方法采用的数据集和量化系数等均与该学术论文一致。具体参数对比如表2所示,相关数据来源于x.zhang等人公开的名称为“near-lossless`l∞-constrained image decompression via deep neural network”的学术论文。

[0054]

s3,宽激活循环神经网络模型的训练;

[0055]

将训练样本集中的近无损压缩图像样本作为宽激活循环神经网络模型的输入,对宽激活循环网络模型进行e次迭代训练,得到训练好的宽激活循环网络模型,其中,e≥150,具体训练步骤为:

[0056]

s31,初始化宽激活神经网络,特征提取部分和图像重建部分的参数,设置当前迭代次数为t,最大迭代次数为e,e≥150,并令t=0。

[0057]

s32,将近无损压缩图像样本输入特征提取部分,得到升维后的图像样本提升维度为从1到64,将输入图像样本映射到另一高维特征空间,高维度的样本图像具有更多的特征,以便后续特征提取。

context based adaptive lossless image codec”的学术论文)、arcnn方法恢复图像的结果(参考于c.dong等人发表的名称为“compression artifacts reduction by a deep convolutional network”的学术论文)、srcnn方法恢复图像的结果(参考于c.dong等人发表的名称为“image super-resolution using deep convolutional networks”的学术论文)、fsrcnn方法恢复图像的结果(参考于c.dong等人发表的名称为“accelerating the super-resolution convolutional neural network”的学术论文)、shufflenet方法恢复图像的结果(参考于x.zhang等人发表的名称为“shufflenet:an extremely efficient convolutional neural network for mobile devices”的学术论文)、ghostnet方法恢复图像的结果(参考于k.han等人发表的名称为“ghostnet:more features from cheap operations”的学术论文)、pan方法恢复图像的结果(参考于h.zhao等人发表的名称为“efficient image super-resolution using pixel attention”的学术论文)、mirnet方法恢复图像的结果(参考于s.w.zamir等人发表的名称为“learning enriched features for real image restoration and enhancement”的学术论文)、本发明方法恢复图像的结果(wrsd);其中arcnn、srcnn、fsrcnn、shufflenet、ghostnet、pan方法均属于图像恢复方法,mirnet方法属于参考模型恢复图像的方法。由于mirnet的参数量远远大于本方法的参数量(600倍),其恢复图像的质量优于其他对比方法,因此mirnet方法的结果主要作为参考。由图3中的5组较小图像的对比能够看出,本发明方法恢复的图像相比于其他对比方法得到的恢复结果更加平滑和自然,因此依据本发明方法重建的压缩图像较清晰,重建图像的质量较高。

[0065]

本技术中采用的硬件测试平台为:主频为3.60ghz的intel core i7 cpu,8gb的内存;软件仿真平台为:ubuntu 16.04 64位操作系统,pycharm开发平台;软件仿真语言:python;使用深度学习框架:pytorch。

[0066]

以上仅为本发明的优选实施例而已,并不用于限制本发明,对于本领域的技术人员来说,本发明可以有各种更改和变化。凡在本发明的精神和原则之内,所作的任何修改、等同替换、改进等,均应包含在本发明的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1