一种基于卷积神经网络的隐匿物品语义定位方法与流程

1.本发明涉及图像处理技术领域,具体涉及一种基于卷积神经网络的隐匿物品语义定位方法。

背景技术:

2.随着国际安全形势的日益严峻以及毫米波成像技术的发展,毫米波人体安检成像设备成为机场、车站以及其他人群密集场所进行安全检查的重要选项。尤其在2018年6月,中国民航总局颁布《民用航空毫米波人体成像安全检查设备鉴定内控标准》及《民用航空毫米波人体成像安全检查设备违禁物品探测能力测试程序》(以下简称《内控标准》和《测试程序》),正式将毫米波人体成像设备纳入中国民航安检设备清单。文件中对安检设备的指标和功能有了明确规定,毫米波人体安检将在国内有广阔的发展前景。

3.毫米波成像设备具有成像分辨率高和能穿透衣物的特点,这使得其具有发现隐藏在衣物中的物品的优势,但该特点同时会造成旅客隐私暴露的问题。在《内控标准》中规定,毫米波人体安检仪必须具有一定的隐私保护功能,比如所获得的人体安检图像在后台显示时必须对人员脸部进行模糊处理以保护隐私,在对外显示的安检员界面上,不显示原始成像结果,取而代之的是标注了物品位置的人偶图像,至于如何标注物品位置,《内控标准》并没有做明确约束。目前,在人体图像隐私保护方面已经有一些公开发表的工作,比如叶金晶等人发表了一种基于图形学方法的毫米波人体图像隐私保护方法(叶金晶,周健,孙谦晨等.主动毫米波成像隐私保护算法[j].红外与毫米波学报,2017,36(4):505-512.)。但目前还未见公开发表的论文或专利论述将物品位置信息投影到人偶图像上的方法。根据对市场上现有产品的调研,目前主流的方法是用标注点或者标注框的形式将物品位置投影到人偶图像上,但由于各个人体的体态差别,而人偶图像则采用固定的模型,所以这种标注形式难免会具有一定的歧义性,给安检员的检查工作带来不便。

技术实现要素:

[0004]

为了解决上述问题,本发明提出了一种基于卷积神经网络的隐匿物品语义定位方法,包括以下步骤:

[0005]

构建模型,所述模型采用全卷积神经网络结构;

[0006]

对构建的模型进行训练;训练的目标是优化全卷积神经网络中各卷积操作的具体参数,使输入的训练图片的损失函数满足条件;

[0007]

将待定位图片输入训练好的模型得到划分结果;

[0008]

对待定位图片上的隐匿物品进行检测定位;

[0009]

对待定位图片上的隐匿物品进行语义定位;

[0010]

根据隐匿物品的语义定位结果,得到隐匿物品的在人体上的区域。

[0011]

进一步地,所述全卷积神经网络的输入为人体安检图像,通过卷积计算、池化计算、反卷积计算以及特征图复制拼接操作,得到特征图,特征图的尺寸为h

×w×

c,其中h和w

分别为输入图片的高和宽,c表示该特征图的通道数量,即该处的像素所属的区域。

[0012]

进一步地,输入的训练图片的损失函数为图片中各像素损失函数的平均值;所述各像素损失函数的具体公式为:

[0013][0014]

其中,l

ij

表示坐标为(i,j)的像素的损失函数,p

ijk

为手工标注的像素类别,其值非0即1;

[0015]qijk

表示归一化后的特征图中各像素的像素值,其具体公式为:

[0016][0017]

其中,x

ijk

为特征图的每个像素值,i,j,k依次为图片高、宽以及通道数的坐标。

[0018]

进一步地,所述对构建的模型训练的具体过程为:

[0019]

更新训练图片,并输入到构建的模型中;

[0020]

对图片进行增强操作;

[0021]

采用前向传播计算网络输出特征图;

[0022]

结合手工标注结果,计算损失函数,若输入的训练图片的损失函数小于设定标准,则结束训练;否则采用后向传播算法更新参数优化梯度,重复上述步骤,直到输入的训练图片的损失函数小于设定标准,结束训练。

[0023]

进一步地,对图片进行的增强操作具体包括图片裁剪、放射变换、对比度调整、亮度调整及其随机组合。

[0024]

进一步地,所述物品语义定位具体为:

[0025]

隐匿物品在人体上的语义位置i的具体公式为:

[0026]

i=argmax(pu)(u=1,2,

…

c)

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(3)

[0027]

其中,pu为某一隐匿物品在u类区域的几率,具体公式为:

[0028][0029]

其中,s(

·

)运算的意义为计算集合中像素点的个数,d为根据物品检测框的坐标得到的某隐匿物品所占据的像素集合,所述物品检测框的坐标在对物品进行检测定位的过程中得到。

[0030]

进一步地,根据隐匿物品在人体上的语义位置i对隐匿物品所属区域进行细分,具体为:比较物品检测框的中心位置与其所属区域的中心位置,若物品检测框的中心位置小于其所属区域的中心位置,则物品位于人体的左半侧,否则位于人体的右半侧。

[0031]

进一步地,采用交变比对训练好的模型进行评估,所述模型评估具体为:记r

uv

为第u类区域被推断为第v类区域的像素点个数,则r

uu

为第u类区域分类准确的像素点个数,r

uv

(u≠v)为第u类区域被错误划分为其他区域的像素点个数,r

vu

(u≠v)为其他区域被错误划分为第u类区域的像素点个数;对于第u类区域,模型划分结果与手工标注的交并比iouu为:

[0032]

[0033]

本发明与现有技术相比,其显著优点为:

[0034]

(1)本发明提出的方法可降低物品定位的歧义性,提高安检员手工详查的效率。

[0035]

(2)本发明提出的方法基于卷积神经网络技术,具有很强的特征提取能力,在充分模型得到充分训练的条件下,对人体部位识别的准确率很高,可以适应各类不同性别、体型的毫米波人体图像,且在旅客接受检查时,可降低对旅客的姿势准确度要求。

[0036]

(3)本发明在模型训练完成后可快速部署应用,无需迭代计算,人体部位划分与物品定位的计算复杂度较低,可进行实时处理与显示,具备很高的实用价值。

附图说明

[0037]

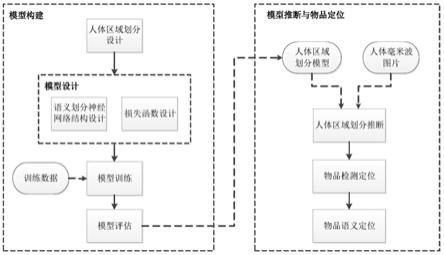

图1本实施例方法的流程图。

[0038]

图2a人体安检图像划分图例的人体毫米波图像,

[0039]

图2b人体安检图像划分图例的人体部位手工标注结果。

[0040]

图3本发明实施例的人体部位语义划分网络结构示意图。

[0041]

图4本发明实施例的人体部位语义划分模型训练步骤的流程图。

[0042]

图5a本发明实施例基于卷积神经网络的模型对示例a的人体的划分结果。

[0043]

图5b本发明实施例基于卷积神经网络的模型对示例b的人体的划分结果。

[0044]

图5c本发明实施例基于卷积神经网络的模型对示例c的人体的划分结果。

[0045]

图5d本发明实施例基于卷积神经网络的模型对示例d的人体的划分结果。

[0046]

图6a本发明实施例中对示例a的物品检测定位结果。

[0047]

图6b本发明实施例中对示例b的物品检测定位结果。

[0048]

图6c本发明实施例中对示例c的物品检测定位结果。

[0049]

图6d本发明实施例中对示例d的物品检测定位结果。

[0050]

图7a1本发明实施例中示例a的物品在模型划分后的图片上的映射。

[0051]

图7a2本发明实施例中示例a的物品在人偶图像上的最终的语义定位结果。

[0052]

图7b1本发明实施例中示例b的物品在模型划分后的图片上的映射。

[0053]

图7b2本发明实施例中示例b的物品在人偶图像上的最终的语义定位结果。

[0054]

图7c1本发明实施例中示例c的物品在模型划分后的图片上的映射。

[0055]

图7c2本发明实施例中示例c的物品在人偶图像上的最终的语义定位结果。

[0056]

图7d1本发明实施例中示例d的物品在模型划分后的图片上的映射。

[0057]

图7d2本发明实施例中示例d的物品在人偶图像上的最终的语义定位结果。

具体实施方式

[0058]

以下结合附图对本发明的一种基于卷积神经网络的隐匿物品语义定位方法的具体实施方式做详细说明,方法的具体实现流程如图1所示。

[0059]

方法分为“模型构建”与“模型推断与物品定位”两部分,“模型构建”部分输出人体区域划分模型用于“模型推断与物品定位”。

[0060]“模型构建”分为以下几个步骤:

[0061]

1.人体区域划分设计

[0062]

在合作式人体安检过程中,要求被检人员的姿势为手臂与躯干分开、双脚分开站

立,人体的部位互相不会遮挡,这为应用语义定位提供了便利的条件。为实现物品语义定位的准确性与合理性,应当使人体图像的语义划分足够详细同时又具有明确的生理学含义。以人体正面为例,可将人体分为头颈部、胸部、腹部、上臂、下臂、大腿、小腿这几类部位,除头颈部外,另将背景算作一类,共划分为8类区域,其余部位又可分为左侧与右侧,划分图例如图2所示,图2a人体安检图像划分图例的人体毫米波图像,图2b人体安检图像划分图例的人体部位手工标注结果。

[0063]

2.模型设计

[0064]

a)语义划分神经网路结构设计

[0065]

用于进行人体部位进行语义划分的卷积神经网络结构如图3所示,网络的输入为原始的人体安检图像,通过一系列的卷积计算、池化计算、反卷积计算以及特征图复制拼接操作,最终得到特征图,特征图的尺寸为h

×w×

c,其中h和w分别为输入图片的高和宽,而c代表该特征图的通道数量,表示每个通道代表该处的像素属于哪一区域,本实施例中c=8,即将特征图分为8类区域。

[0066]

b)损失函数设计

[0067]

特征图的每个像素值记为x

ijk

,其中i,j,k依次为图片高、宽以及通道数的坐标,通过卷积、池化以及上采样等操作后,特征图像素的取值范围为实数,为得到各像素的类别信息,首先实用softmax函数对各通道数据进行归一化,得到归一化后的特征图,其各像素的值为q

ijk

,其计算公式为

[0068][0069]

对于每个像素位置,使用交叉熵函数计算模型推断的特征图与真实标注的类别的差异,以此作为损失函数l

ij

,其计算公式为

[0070][0071]

其中p

ijk

为手工标注的像素类别,其值非0即1,且在该模型中,人体各区域互不重叠,因此对某一固定i,j位置,仅有一个通道位置的值为1,其余均为0。整幅输入的训练图片的损失函数为图片中各像素损失函数的平均值。

[0072]

3.模型训练

[0073]

模型训练的基本流程如图4所示。模型训练过程是迭代式的,每一次迭代流程开始时,将用于训练的图片输入卷积神经网络得到输出结果,再结合手工标注结果得到本次计算的损失函数。模型训练的目标是优化网络中各卷积操作的具体参数,以使损失函数最小化。模型参数的优化方向(也即各参数的梯度)通过后向传播算法得到。

[0074]

为了避免模型仅适用于少量特定的图像,需要预先准备较多的人体安检图片进行训练。且在图片输入模型前,需要对图片进行裁剪、仿射变换、对比度/亮度调整等操作以进一步提升模型的泛化能力。

[0075]

本实施例中的训练数据集来自4名不同身材的实验人员的毫米波图像,共计300幅,图像尺寸为710

×

354。输入的训练图片大小固定为320

×

320,通过在原始图像上随机裁剪得到,输出特征图尺寸为320

×

320

×

8,为提升模型训练的效率,每次输入4张图片的裁剪

结果进行同步训练。

[0076]

4.模型评估

[0077]

受系统噪声、背景噪声、系统通道一致性等因素的影响,毫米波图像的背景中会有一定的杂波,其目标图像的边缘较为模糊,因此人体区域的划分不可能做到完全准确。为评估划分的准确性,采用交并比来衡量模型划分结果与手工标注结果之间的差异。记r

uv

为第u类区域被推断为第v类区域的像素点个数,则r

uu

为第u类区域分类准确的像素点个数,r

uv

(u≠v)为第u类区域被错误划分为其他区域的像素点个数,r

vu

(u≠v)为其他区域被错误划分为第u类区域的像素点个数;对于第u类区域,模型划分结果与手工标注的交并比iouu为:

[0078][0079]

测试结果显示,当交并比达到0.8以上时,划分的效果较佳,可以作为后续处理的输入。

[0080]

本实施例中使用75幅各类毫米波人体图像及手工标注的区域信息对上述训练好的模型进行测试,测试得到的各区域推断结果如表1所示,各区域划分的iou指标均超过了0.8,划分效果良好。图5为实际实现的模型对不同体型的人体安检图像的部分划分图例。

[0081]

区域背景头颈胸腹上臂小臂大腿小腿iou0.9570.8810.8770.9010.8330.8180.9000.838

[0082]

表1人体区域划分模型测试结果

[0083]“模型推断与物品定位”包括以下几个步骤:

[0084]

1.人体区域划分推断

[0085]

模型采用了全卷积神经网络结构,因此无需对人体毫米波图片做任何修改,将其直接输入到训练好的模型中即可得到划分结果,每个区域的像素集合记为ru(u=1,2,

…

c)。本实施例的四个示例(示例a、示例b、示例c和示例d)的具体图例的划分结果可参见图5。图5a本发明实施例基于卷积神经网络的模型对示例a的人体的划分结果,图5b本发明实施例基于卷积神经网络的模型对示例b的人体的划分结果,图5c本发明实施例基于卷积神经网络的模型对示例c的人体的划分结果,图5d本发明实施例基于卷积神经网络的模型对示例d的人体的划分结果。

[0086]

2.物品检测定位

[0087]

物品在原始图像上的检测定位方法在本实施例中并不做具体要求,但在应用本实施例的方法前需明确该检测方法给出的物品信息格式。典型的物品检测定位算法通过矩形框给出物品在原始图像上的位置与大小信息,具体的输出格式为矩形框的左上角坐标(x

min

,y

min

)与右下角坐标(x

max

,y

max

)。本实施例以某种输出矩形框的物品检测算法为例,图6为物品在毫米波图像上的检测定位图例。其中,图6a本发明实施例中对示例a的物品检测定位结果,图6b本发明实施例中对示例b的物品检测定位结果,图6c本发明实施例中对示例c的物品检测定位结果,图6d本发明实施例中对示例d的物品检测定位结果。

[0088]

3.物品语义定位

[0089]

根据物品检测框的坐标可以得到某物品所占据的像素集合为d,物品所在的人体区域可根据物品像素集合与区域集合的交集大小来确定,记物品在第u类区域的几率为pu(u=1,2,

…

c),则有

[0090][0091]

其中s(

·

)运算的意义为计算集合中像素点的个数。某物品在人体上的语义位置i可用以下公式确定

[0092]

i=argmax(pu)(u=1,2,

…

c)

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(5)

[0093]

根据物品的语义位置计算结果,即可在人偶图片上标注出物品的区域。人体结构具有明显的左右对称性,因此,可比较物品框中心位置(x

min

+x

max

)/2与其所属区域i的中心位置(像素点水平坐标中位数)的大小,若物品框中心位置位小于区域i的中心位置,则物品位于左半侧,反之,则在右半侧。图7为物品在人偶图像上的语义定位结果图例。

[0094]

在图7a1给出的示例中,共有3个可疑物品,分别位于人体的右侧胸部以及人体大腿两侧,根据前述方法计算得到3个物品所在位置的几率分布如表2所示,可疑物品在人偶上的映射结果如图7a2所示。映射结果正确反映了可疑物品所在的语义位置。

[0095][0096]

表2物品所在位置几率分布(示例a)

[0097]

在图7b1给出的示例中,共有4个可疑物品,分别位于人体胸部、腹部和两侧大腿,根据前述方法计算得到4个物品所在位置的几率分布如表3所示,可疑物品在人偶上的映射结果如图7b2所示。映射结果正确反映了可疑物品所在的语义位置。

[0098][0099]

表3物品所在位置几率分布(示例b)

[0100]

在图7c1给出的示例中,共有4个可疑物品,分别位于人体腹部、左侧小臂和大腿两侧,根据前述方法计算得到4个物品所在位置的几率分布如表4所示,可疑物品在人偶上的映射结果如图7c2所示。映射结果正确反映了可疑物品所在的语义位置。

[0101][0102]

表4物品所在位置几率分布(示例c)

[0103]

在图7d1给出的示例中,共有2个可疑物品,分别位于人体两侧大腿,根据前述方法计算得到4个物品所在位置的几率分布如表4所示,可疑物品在人偶上的映射结果如图7d2所示。映射结果正确反映了可疑物品所在的语义位置。

[0104][0105]

表5物品所在位置几率分布(示例d)

[0106]

本发明与现有技术相比,其显著优点为:

[0107]

(1)本发明提出的方法可降低物品定位的歧义性,提高安检员手工详查的效率。

[0108]

(2)本发明提出的方法基于卷积神经网络技术,具有很强的特征提取能力,在充分模型得到充分训练的条件下,对人体部位识别的准确率很高,可以适应各类不同性别、体型的毫米波人体图像,且在旅客接受检查时,可降低对旅客的姿势准确度要求。

[0109]

(3)本发明在模型训练完成后可快速部署应用,无需迭代计算,人体部位划分与物品定位的计算复杂度较低,可进行实时处理与显示,具备很高的实用价值。

[0110]

以上所述仅为本发明的较佳实施例,并不用以限制本发明,凡在本发明的精神和原则之内,所作的任何修改、等同替换、改进等,均应包含在本发明的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1