基于多重融合深度神经网络的目标识别方法

1.本发明属于图像处理技术领域,涉及一种目标识别方法,具体涉及一种基于多重融合深度神经网络的isar图像与光学图像的目标识别方法,可用于对空间目标的有效识别。

背景技术:

2.目标识别任务是根据不同类别的目标在信息中所反映特征的不同,来对目标进行类别区分。对于雷达目标的识别,传统雷达目标识别方法通过手动设计特征提取器,从原始数据中提取有效特征并实现类别判断,因此需要大量的时间及专家知识,同时,在许多任务中很难界定所提取的特征是否有效,这给雷达目标识别带来了极大的困难。近年来,基于数据驱动的深度学习雷达目标识别方法取得了较大进展,能够避免复杂的特征设计与选择过程,并从数据中自动学习出有效特征。但是,现有深度学习雷达目标识别方法主要为单模态识别,即仅利用单一模态数据进行雷达目标特征提取和类别判断,因此可能存在数据信息量不足的问题,导致无法满足准确识别目标的需求。深度学习多模态融合识别方法是利用多个模态数据的互补信息融合与冗余信息剔除来学习到更好的特征表示,从而有效提升模型识别性能。现有基于深度学习的多模态融合识别方法主要利用卷积神经网络提取特征,但其融合方式较为简单,尚未考虑特征的不同贡献与重要性以及提取多类特征来丰富特征空间的重要性,因此识别准确率还有提升的空间。

3.xueru bai,ye hui,li wang,feng zhou在其发表的论文“radar-based human gait recognition using dual-channel deep convolutional neural network”(ieee transactions on geoscience and remote sensing,2019)中提出了一种基于双通道卷积神经网络的人体姿态识别方法。该方法首先构建了一个短窗长通道模块与一个长窗长通道模块,并基于此构建双通道卷积神经网络;采用雷达回波信号分别做短窗长stft与长窗长stft得到的短窗长时频图与长窗长时频图作为训练样本,其中,短窗长时频图中人体四肢的特征较为明显,长窗长时频图人体躯干的特征较为明显;使用训练样本对双通道卷积神经网络进行训练;将测试样本中输入到训练完成的双通道卷积神经网络中完成识别。该方法通过构建双通道卷积神经网络,对雷达回波信号中提取的短窗长时频图与长窗长时频图进行融合识别,得该网络能同时利用雷达回波信号中所包含的人体四肢信息与躯干信息,有效利用了两个模态数据的互补信息,从而有效提升模型识别性能。但其存在的不足之处在于,仅对两个模态数据提取卷积特征,且对两个模态卷积特征只进行简单的特征拼接,导致特征信息不够丰富、对特征的不同贡献与重要性关注不够的问题,限制了目标识别的精度。

技术实现要素:

4.本发明的目的是针对上述现有技术的不足,提出一种基于多重融合深度神经网络的isar图像与光学图像融合的目标识别方法,旨在解决现有技术进行目标多模态数据融合

识别时,特征信息不够丰富、对特征的不同贡献与重要性关注不够,难以对目标进行准确识别的技术问题。

5.本发明的技术思路是:构建多重融合深度神经网络,通过训练好的多重融合深度神经网络直接对目标的isar图像和光学图像进行融合识别,避免了现有技术进行目标识别时,特征信息不够丰富、对特征拼接细节关注不够,识别正确率较低的问题。本发明利用通道注意力融合网络,对目标的isar图像和光学图像进行精细的卷积特征融合,避免了现有技术难以对通道上的特征细节进行关注的问题;同时通过双线性池化特征融合网络对卷积特征进一步提取双线性池化特征并融合,从而实现对目标的双线性池化融合特征提取。通过相加融合网络对双线性池化融合特征和基于通道注意力的融合特征进行相加融合,提高了目标的特征丰富度,解决了现有技术难以利用isar图像和光学图像对目标进行准确融合识别的问题。

6.为实现上述目的,本发明采取的技术方案包括如下步骤:

7.(1)获取训练样本集r和测试样本集e:

8.获取包括k个目标类别的s幅isar图像a={as|1≤s≤s}和s幅光学图像b={bs|1≤s≤s},并对每幅isar图像as和每幅光学图像bs分别进行归一化,然后对经过归一化后的每幅isar图像和每幅光学图像中包含的目标进行标注,再将m幅归一化isar图像、光学图像及其对应的标签作为训练样本集r,将剩余的归一化isar图像和光学图像及其对应的标签作为测试样本集e,其中k≥3,s≥800,as、bs分别表示对同一目标以相同地面观测视角观测的第s幅isar图像、光学图像;

9.(2)构建基于多重融合深度神经网络的目标识别模型h:

10.构建包括卷积特征提取网络和多重融合深度神经网络的目标识别模型h,多重融合深度神经网络包括双线性池化融合网络、通道注意力融合网络、相加融合网络,其中:

11.卷积特征提取网络包括并行排布的第一卷积特征提取网络和第二卷积特征提取网络;

12.双线性池化融合网络包括并行排布的第一双线性池化特征提取网络和第二双线性池化特征提取网络,以及与该两个双线性池化特征提取网络输出端连接的特征融合层;

13.第一卷积特征提取网络的输出与第一双线性池化特征提取网络以及通道注意力融合网络的输入端连接,第二卷积特征提取网络的输出与第二双线性池化特征提取网络以及通道注意力融合网络的输入端连接;双线性池化融合网络和通道注意力融合网络的输出端与相加融合网络的输入端连接;

14.(3)对基于多重融合深度网络的目标识别模型h进行迭代训练:

15.(3a)初始化迭代次数为t,最大迭代次数t,t≥20,第t迭代的目标识别模型为h

t

,h

t

的权值参数为ω

t

,并令t=1;

16.(3b)将训练样本集r作为基于多重融合深度网络的目标识别模型为h

t

的输入,卷积特征提取网络中的第一卷积特征提取网络对每个isar图像训练样本进行卷积特征提取,得到r对应的isar图像卷积特征集合,同时第二卷积特征提取网络对每个光学图像训练样本进行卷积特征提取,得到r对应的光学图像卷积特征集合;

17.(3c)多重融合深度神经网络对每个isar图像卷积特征与其对应的光学图像卷积

特征进行多重融合:

18.(3c1)双线性池化融合网络中的第一双线性池化特征提取网络对每个isar图像卷积特征进行双线性池化特征提取,同时第二双线性池化特征提取网络对每个光学图像卷积特征进行双线性池化特征提取,特征融合层对所提取的每isar图像的双线性池化特征及其对应的光学图像的双线性池化特征进行特征融合;同时通道注意力融合网络对每个isar图像卷积特征及其对应的光学图像卷积特征进行基于通道注意力的特征融合;

19.(3c2)相加融合网络对双线性池化融合网络得到的每个双线性池化融合特征,与其对应的通道注意力融合网络得到的基于通道注意力的融合特征进行相加融合,得到训练样本集r中每个目标的预测标签y;

20.(3d)采用交叉熵损失函数,通过每个目标的预测标签y及其对应的真实标签y

*

计算h

t

的损失值l

t

,并求取l

t

对权值参数ω

t

的偏导再采用梯度下降法,通过对权值参数ω

t

进行更新;

21.(3e)判断t≥t是否成立,若是,得到训练好的目标识别模型h

*

,否则,令t=t+1,并执行步骤(3b);

22.(4)获取目标isar图像和光学图像的识别结果:

23.将测试样本集e作为训练好的目标分类模型h

*

的输入进行前向传播,得到e中包含的所有目标的预测标签,每个预测标签对应的目标即为识别结果。

24.本发明与现有的技术相比具有以下优点:

25.第一,本发明所构建的目标识别模型包括多重融合深度神经网络,在对该模型进行训练以及获取目标识别结果的过程中,多重融合深度神经网络中的双线性池化融合网络提取了目标的双线性池化融合特征,通道注意力融合网络提取了目标的卷积融合特征,网络模型能够提取目标两类融合特征,使得网络模型提高了对目标特征提取的信息丰富度,克服了现有技术基于神经网络对目标进行识别时仅关注于提取目标单类别特征导致特征信息不够丰富的问题,有效提高了目标识别的准确率。

26.第二,本发明在对目标识别模型进行训练以及获取目标识别结果的过程中,双线性池化融合网络对目标的双线性池化特征进行融合时,通过自适应权重实现对重要特征进行加强的效果;通道注意力融合网络对目标卷积特征进行特征融合时,通道注意力使网络模型可以更关注信息量最大的通道特征,抑制一些不重要的通道特征;因此双线性池化融合网络与通道注意力融合网络在进行特征融合时克服了现有技术先进行特征拼接融合时,对特征的不同贡献与重要性关注不够的问题,实现了更好的对目标提取融合特征,进一步提高了目标识别的准确率。

附图说明

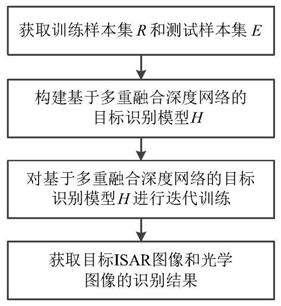

27.图1是本发明的实现流程图;

28.图2是本发明所构建的目标识别模型的结构示意图;

29.图3是本发明所构建的相加融合网络的结构示意图。

具体实施方式

30.下面结合附图和实施例对本发明作进一步的描述。

31.参照图1,本发明包括如下步骤。

32.(1)获取训练样本集r和测试样本集e:

33.获取包括k个目标类别的s幅isar图像a={as|1≤s≤s}和s幅光学图像b={bs|1≤s≤s},每幅图像包含1个目标,并对每幅isar图像as和每幅光学图像bs分别进行归一化,可以解决网络梯度爆炸的问题,然后对经过归一化后的每幅isar图像和每幅光学图像中包含的目标进行标注,再将m幅归一化isar图像、光学图像及其对应的标签作为训练样本集r,将剩余的归一化isar图像和光学图像及其对应的标签作为测试样本集e,其中k≥3,s≥800,as、bs分别表示对同一目标以相同地面观测视角观测的第s幅isar图像、光学图像;其中,本实施例中k=4,s=858,m=468;

34.(2)构建基于多重融合深度神经网络的目标识别模型h:

35.构建包括卷积特征提取网络和多重融合深度神经网络的目标识别模型h,其结构如图2所示,多重融合深度神经网络包括双线性池化融合网络、通道注意力融合网络、相加融合网络,其中:

36.卷积特征提取网络包括并行排布的第一卷积特征提取网络和第二图像卷积特征提取网络;第一卷积特征提取网络和第二卷积特征提取网络均包括六个网络层,每个网络层包括顺次级联的卷积层、批归一化层、relu激活层和最大值池化层,具体参数设置为:第一网络层中的卷积层的卷积核大小为5

×

5个像素,卷积核数量为32个,批归一化层的通道数为32,最大值池化层的窗口大小为2

×

2个像素;第二网络层和第三网络层中的卷积层的卷积核大小为5

×

5个像素,卷积核数量为64个,批归一化层的通道数为64,最大值池化层的窗口大小为2

×

2个像素;第四至六网络层中的卷积层的卷积核大小为3

×

3个像素,卷积核数量为128个,批归一化层的通道数为128,最大值池化层的窗口大小为2

×

2个像素;

37.双线性池化融合网络包括并行排布的第一双线性池化特征提取网络和第二双线性池化特征提取网络,以及与该两个双线性池化特征提取网络输出端连接的特征融合层;第一双线性池化特征提取网络和第二双线性池化特征提取网络均包括顺次连接的双线性池化层、特征归一化层;

38.通道注意力融合网络包括顺次连接的特征通道拼接层和通道注意力单元;通道注意力单元包括并行排列的全局平均池化层和全局最大池化层,以及与全局平均池化层和全局最大池化层的输出顺次级联的第一卷积层、relu激活层、第二卷积层、sigmoid激活层,其中全局平均池化层与全局最大池化层的输出维度均为1

×

1,第一卷积层包括16个卷积核,卷积核的大小为1

×

1,第二卷积层包括256个卷积核,卷积核的大小为1

×

1;

39.相加融合网络,其结构如图3所示,包括并行排布的第一全连接网络和第二全连接网络,以及与第一全连接网络和第二全连接网络的输出顺次级联的相加融合层、softmax层;其中第一全连接网络和第二全连接网络均包括两层全连接层,第一层全连接层神经元个数为128个,第二层全连接层和神经元个数为4个;

40.第一卷积特征提取网络的输出与第一双线性池化特征提取网络以及通道注意力融合网络的输入端连接,第二卷积特征提取网络的输出与第二双线性池化特征提取网络以

及通道注意力融合网络的输入端连接;双线性池化融合网络和通道注意力融合网络的输出端与相加融合网络的输入端连接;

41.(3)对基于多重融合深度网络的目标识别模型h进行迭代训练:

42.(3a)初始化迭代次数为t,最大迭代次数t,t≥20,第t迭代的目标识别模型为h

t

,h

t

的权值参数为ω

t

,并令t=1;其中,本实施例中t=20;

43.(3b)将训练样本集r作为基于多重融合深度网络的目标识别模型为h

t

的输入,卷积特征提取网络中的第一卷积特征提取网络对每个isar图像训练样本进行卷积特征提取,得到r对应的isar图像卷积特征集合,同时第二卷积特征提取网络对每个光学图像训练样本进行卷积特征提取,得到r对应的光学图像卷积特征集合;

44.(3c)多重融合深度神经网络对每个isar图像卷积特征与其对应的光学图像卷积特征进行多重融合:

45.(3c1)双线性池化融合网络中的第一双线性池化特征提取网络对每个isar图像卷积特征进行双线性池化特征提取,同时第二双线性池化特征提取网络对每个光学图像卷积特征进行双线性池化特征提取,特征融合层对所提取的每isar图像的双线性池化特征及其对应的光学图像的双线性池化特征进行特征融合;同时通道注意力融合网络对每个isar图像卷积特征及其对应的光学图像卷积特征进行基于通道注意力的特征融合;

46.第一双线性池化特征提取网络中的双线性池化层对每个isar图像的卷积特征f进行双线性池化,输出结果为x,然后特征归一化层对x进行归一化,输出结果为z:

[0047][0048][0049]

其中,表示双线性池化层的输入卷积特征,d表示输入卷积特征的通道数,l∈l表示输入卷积特征的空间位置,∑表示求和操作,vec表示将矩阵张成向量,f

t

(l)表示f(l)的转置,sgn表示求符号操作,|| ||2表示求2-范数操作;

[0050]

特征融合层对所提取的每幅isar图像的双线性池化特征f

bi

及其对应的光学图像的双线性池化特征f

bo

进行特征融合,输出结果为fb:

[0051][0052]

其中,w

bi

和w

bo

表示可学习权重,表示同位置元素相乘操作,concat(

·

)表示对特征在通道上进行拼接操作;

[0053]

通过双线性池化融合网络,对目标isar图像卷积特征和光学图像卷积特征先进行双线池化特征提取后再进行融合,有效避免了先进行卷积特征融合再进行融合特征双线性池化所带来的计算量成倍增长导致的模型过拟合问题,同时,双线性池化融合网络进行特征融合时能够对双线池化特征的通道细节进行关注,通过自适应权重可以实现突出重要特征的效果,更好的对目标的双线性池化融合特征进行提取;通过通道注意力融合网络对目标isar图像卷积特征和光学图像卷积特征基于通道注意力进行卷积特征融合,使得网络模型可以更关注信息量最大的通道特征,抑制一些不重要的通道特征,更好的汇总卷积特征;

通过对目标的卷积特征和双线性池化特征两种特征的提取,有效解决了深度学习中特征提取不充分的问题。

[0054]

(3c2)相加融合网络对双线性池化融合网络得到的每个双线性池化融合特征,与其对应的通道注意力融合网络得到的基于通道注意力的融合特征进行相加融合,得到训练样本集r中每个目标的预测标签y;其中,相加融合层对第一全连接网络的输出结果和第二全连接网络的输出结果进行相加融合,输出结果为f:

[0055][0056]

其中,wb和wc表示可学习权重,表示同位置元素相乘操作。

[0057]

通过相加融合网络对双线性池化融合网络提取目标的双线性池化融合特征与通道注意力融合网络提取的基于通道注意力的融合特征进行融合识别,两类特征的融合,提高了目标特征丰富度,从而达到深度神经网络对目标isar图像和光学图像的识别准确率提高的效果。

[0058]

(3d)采用交叉熵损失函数,通过每个目标的预测标签y及其对应的真实标签y

*

计算h

t

的损失值l

t

,并求取l

t

对权值参数ω

t

的偏导再采用梯度下降法,通过对权值参数ω

t

进行更新;

[0059]

计算h

t

的损失值l

t

、对权值参数ω

t

进行更新,计算、更新公式分别为:

[0060][0061][0062]

其中,m表示训练样本的数量,表示训练样本集中第m个样本对应的真实标签,ym表示模型h

t

对第m个样本的预测标签,ln表示以e为底的对数操作,表示ω

t

的更新结果,η表示l

t

的学习率,表示求导操作。

[0063]

(3e)判断t≥t是否成立,若是,得到训练好的目标识别模型h

*

,否则,令t=t+1,并执行步骤(3b);

[0064]

(4)获取目标isar图像和光学图像的识别结果:

[0065]

将测试样本集e作为训练好的目标识别模型h

*

的输入进行前向传播,得到e中包含的所有目标的预测标签,每个预测标签对应的目标即为识别结果。

[0066]

下面结合仿真实验对本发明的技术效果作进一步描述。

[0067]

1、仿真条件和内容。

[0068]

仿真实验硬件平台为:处理器为intel xeon silver 4114cpu,处理器主频为2.20ghz,内存为128gb,显卡为nvidia geforce gtx 1080ti;软件平台为windows 10操作系统,matlab2018,python 3.6和tensorflow 1.5。

[0069]

仿真实验所用数据集为雷达在16ghz中心频率,2ghz信号带宽、6

°

积累角条件下获取的4类卫星isar图像和在3ds max中获取的以相同地面观测视角仿真的4类卫星光学图

像,这四类卫星目标分别为:calipso,cloudsat,jason-3,oco2,选取468幅isar图像和对应的光学图像作为训练样本集,390幅isar图像和对应的光学图像作为测试样本集。

[0070]

采用本发明和现有的多模态特征融合方法分别对上述的4类卫星目标isar像和光学图像进行融合识别,得到识别准确率。

[0071]

2、仿真结果分析。

[0072]

应用本发明方法对4类卫星目标isar像和光学图像进行融合识别,首先使用训练样本集训练多重融合深度神经网络,得到训练好的基于多重融合深度神经网络的目标识别模型,然后使用测试样本集在训练好的多重融合深度网络进行测试。

[0073]

通过以下公式,计算目标识别的准确率:

[0074][0075]

其中,c表示测试样本集的识别准确率,e

*

表示测试样本集的样本的总数,h(

·

)表示类别鉴别函数,表示测试样本集中第e个测试样本的真实类别标签,ye表示测试样本集中第e个测试样本对应的多重融合深度网络神经输出结果,当和ye相等时,等于1,否则,等于0。

[0076]

根据e

*

=390,计算得到本发明的识别准确率为90.0%。

[0077]

应用现有的多模态融合识别方法对4类卫星目标isar像和光学图像进行识别,现有的多模态融合识别方法取自huibin li,jian sun等人发表的论文“multimodal 2d+3d facial expression recognition with deep fusion convolutional neural network”,该方法首先对目标多模态图像分别进行卷积特征提取,将得到的卷积特征进行特征通道拼接,再输入到全连接层和softmax层中进行目标识别。在仿真实验中,首先使用训练样本集训练多模态融合识别网络,得到训练好的多模态融合识别网络,然后使用测试样本集在训练好的多模态融合识别网络上进行测试。

[0078]

通过以下公式,计算目标识别的准确率:

[0079][0080]

其中,c表示测试样本集的识别准确率,e

*

表示测试样本集的样本的总数,h(

·

)表示类别鉴别函数,表示测试样本集中第e个测试样本的真实类别标签,ye表示测试样本集中第e个测试样本对应的多模态融合识别网络输出结果,当和ye相等时,等于1,否则,等于0。

[0081]

根据e

*

=390,计算得到基于多模态融合识别方法的识别准确率为86.67%。

[0082]

综上所述,本发明提出的基于多重融合深度神经网络的isar图像与光学图像融合的目标识别方法相比于现有方法,能够有效提高空间目标的识别准确率。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1