一种基于改进DAN的越南场景文字识别方法

一种基于改进dan的越南场景文字识别方法

技术领域

1.本发明涉及文字识别领域,尤其涉及一种基于改进dan的越南场景文字识别方法。

背景技术:

2.自然场景文本识别吸引了很多研究者的关注,其广泛的应用,如:自动驾驶、视觉辅助、招牌识别等进一步突显其应用价值。随着深度学习的发展,自然场景文本识别取得巨大的进步,有很多相应的方法出现。然而,现有的方法大多是基于英语或者法语等这些非声调语言的研究,一些声调语言如越南语的场景文字识别却鲜有研究。

3.越南语是一种声调语言,越南语字符是在拉丁字母的基础上加上九个重音符号或变音符号构成的,其中四个符号用来添加元音,另外五个符号表示越南语的声调,而这五个声调符号决定了每个单词的含义。越南语字符独特的构成,使得自然场景中越南文字的识别相对于现有的针对英语为主的识别技术具有以下问题:

4.1、越南文字字符数量急剧增多,字符间差异性较小,部分字符仅为变音符号的细微差别;

5.2、变音符号相较于拉丁字符形状较小,准确地将其识别会更加困难,变音符号识别错误将导致整个识别结果出错;

6.3、变音符号的存在更易导致注意力漂移问题的发生,从而产生错误的识别结果。

技术实现要素:

7.本发明的目的在于提供一种基于改进dan的越南场景文字识别方法,旨在有效缓解注意力漂移,将变音符号识别的更准确,并且可以有效区分相似字符,识别结果更好。

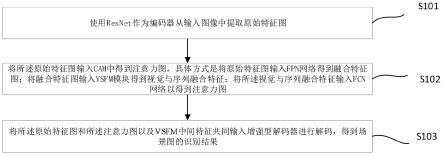

8.为实现上述目的,本发明提供了一种基于改进dan的越南场景文字识别方法,包括使用resnet作为编码器从输入图像中提取原始特征图;

9.将所述原始特征图输入cam中得到注意力图,具体方式是将原始特征图输入fpn网络得到融合特征图;将融合特征图输入vsfm模块得到视觉与序列融合特征;将所述视觉与序列融合特征输入fcn网络以得到注意力图;

10.将所述原始特征图和所述注意力图以及vsfm中间特征共同输入增强型解码器进行解码,得到场景图的识别结果。

11.其中,所述将融合特征图输入vsfm模块得到视觉与序列融合特征的具体步骤是:将融合特征图以宽度为时间步长,输入bi-gru进行水平方向的序列特征建模,得到水平方向的序列建模特征;

12.将融合特征图以高度为时间步长,输入bi-gru进行竖直方向的序列特征建模,得到竖直方向的序列建模特征;

13.将所述水平方向的序列建模特征和所述竖直方向的序列建模特征以及融合特征图进行对应位置的元素相加后得到视觉与序列融合特征。

14.其中,所述将融合特征图以宽度为时间步长,输入bi-gru进行水平方向的序列特

征建模的具体方式是:在水平方向上即从左往右建模,又从右往左建模。

15.其中,所述将融合特征图以高度为时间步长,输入bi-gru进行竖直方向的序列特征建模,得到竖直方向的序列建模特征的具体方式是:在竖直方向上即从上到下建模,又从下到上建模。

16.其中,所述将所述原始特征图和所述注意力图以及vsfm中间特征共同输入增强型解码器进行解码,得到场景图的识别结果的具体步骤是:

17.s301在每一时刻将原始特征图和注意力图进行相乘得到上下文向量,并与前一时刻的解码结果的嵌入向量进行拼接,再和前一时刻的hidden信息一起输入gru,得到当前时刻的hidden信息;

18.s302将hidden信息以及vsfm中间特征在通道维度进行拼接后输入分类器进行分类,得到当前时刻的识别结果;

19.s303重复s301~s302,当预测得到的最大概率的字符为终止符时,停止预测,并将每一时刻的识别结果组合起来后得到最终的识别结果。

20.其中,所述vsfm中间特征为融合特征图在bi-gru进行竖直方向的序列特征建模得到的竖直方向的序列建模特征,并将所述融合特征图和所述竖直方向的序列建模特征在通道维度进行拼接后得到。

21.本发明的一种基于改进dan的越南场景文字识别方法,包括:使用resnet作为编码器从输入图像中提取原始特征图;将所述原始特征图输入cam中得到注意力图,具体方式是将原始特征图输入fpn网络得到融合特征图;将融合特征图输入vsfm模块得到视觉与序列融合特征;将所述视觉与序列融合特征输入fcn网络以得到注意力图;将所述原始特征图和所述注意力图以及vsfm中间特征共同输入增强型解码器进行解码,得到场景图的识别结果,该方法有效缓解注意力漂移,将变音符号识别的更准确,并且可以有效区分相似字符,识别结果更好。

附图说明

22.为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

23.图1是本发明提供的基于改进dan的越南场景文字识别方法的算法结构示意图。

24.图2是本发明提供的基于改进dan的越南场景文字识别方法以及他人方法所生成的注意力图的对比图。

25.图3是本发明提供的基于改进dan的越南场景文字识别方法以及他人方法识别的对比结果示例。

26.图4是本发明的一种基于改进dan的越南场景文字识别方法的流程图。

27.图5是本发明的将融合特征图输入vsfm模块得到视觉与序列融合特征的流程图。

28.图6是本发明的将所述原始特征图和所述注意力图以及vsfm中间特征共同输入增强型解码器进行解码,得到场景图的识别结果的流程图。

具体实施方式

29.下面详细描述本发明的实施例,所述实施例的示例在附图中示出,其中自始至终相同或类似的标号表示相同或类似的元件或具有相同或类似功能的元件。下面通过参考附图描述的实施例是示例性的,旨在用于解释本发明,而不能理解为对本发明的限制。

30.请参阅图1~图6,本发明提供一种基于改进dan的越南场景文字识别方法,包括:

31.s101使用resnet作为编码器从输入图像x中提取原始特征图fo;

32.其中原始特征图fo形状为[n,c,h,w],其中n为待识别的图像数目,c为通道数,h为特征图的高度,w为特征图的宽度。resnet为通用的一种网络结构,计算方式表示为式1:

[0033]fo

=resnet(x)

ꢀꢀ

式1

[0034]

s102将所述原始特征图fo输入cam中得到注意力图attention map,具体方式是将原始特征图fo输入fpn网络得到融合特征图fu;将融合特征图fu输入vsfm模块得到视觉与序列融合特征f

vs

;将所述视觉与序列融合特征f

vs

输入fcn网络以得到注意力图attention map;

[0035]

其中vsfm模块为cam中的一个模块,注意力图attention map记为att,形状为[n,maxt,h,w],maxt代表解码的最大时间步长。fpn是一个经典的特征融合网络,fcn是一个七层的全卷积神经网络。

[0036]

其中,所述将原始特征图fo输入fpn网络得到融合特征图fu的具体步骤是:

[0037]

s201将融合特征图fu以宽度w为时间步长,输入bi-gru进行水平方向的序列特征建模,得到水平方向的序列建模特征f

rnn-h

;

[0038]

具体方式是:在水平方向上即可以从左往右建模,又可以右往左建模,有效增强字符间的关联性,并缓解注意力漂移。

[0039]

其中gru的单元数量为256;具体实施如下,首先对fu进行形状的变换,从形状为[n,c,h,w]变为形状[n

×

h,w,c],计算方式表示为式2:

[0040]fu

=reshape(fu)

ꢀꢀ

式2

[0041]

然后将变换后的fu输入gru,得到水平方向的序列建模特征f

rnn-h

,计算方式表示为式3:

[0042]frnn-h

=bi-gru(fu)

ꢀꢀ

式3

[0043]

然后将f

rnn-h

进行形状变换,使之形状恢复至[n,c,h,w],计算方式表示为式4:

[0044]frnn-h

=reshape(f

rnn-h

)

ꢀꢀ

式4

[0045]

s202将融合特征图fu以高度h为时间步长,输入bi-gru进行竖直方向的序列特征建模,得到竖直方向的序列建模特征f

rnn-v

;

[0046]

具体方式是:在竖直方向上即从上往下建模,又从下往上建模,有效增强拉丁字符与变音符号间的关联性,对变音符号有较好的关注度,同时对字符的大小写更敏感。

[0047]

其中gru的单元数量为256;具体实施如下,首先对fu进行形状的变换,从形状为[n,c,h,w]变为形状[n

×

w,h,c],计算方式表示为式5:

[0048]fu

=reshape(fu)

ꢀꢀ

式5

[0049]

然后将变换后的fu输入gru,得到竖直方向的序列建模特征f

rnn-v

,计算方式表示为式6:

[0050]frnn-v

=bi-gru(fu)

ꢀꢀ

式6

[0051]

然后将f

rnn-v

进行形状变换,使之形状恢复至[n,c,h,w],计算方式表示为式7:

[0052]frnn-v

=reshape(f

rnn-v

)

ꢀꢀ

式7

[0053]

s203将所述水平方向的序列建模特征f

rnn-h

和所述竖直方向的序列建模特征f

rnn-v

以及融合特征图fu进行对应位置的元素相加后得到视觉与序列融合特征f

vs

。

[0054]

具体方式是:将水平方向的序列建模特征f

rnn-h

和竖直方向的序列建模特征f

rnn-v

与融合特征图fu中相同位置的元素进行相加得到视觉与序列融合特征f

vs

。

[0055]

计算方式表示为:

[0056]fvs

(i,j)=f

rnn-h

(i,j)+f

rnn-v

(i,j)+fu(i,j) i∈(0,h)j∈(0,w)

ꢀꢀ

式8

[0057]

将水平方向和竖直方向的结合起来得到可以从上往下建模,又从右往左建模,以及从下往上建模,并从左往右建模。

[0058]

s103将所述原始特征图fo和所述注意力图attention map以及vsfm中间特征f

temp

共同输入增强型解码器进行解码,得到场景图的识别结果.

[0059]

具体步骤是:

[0060]

s301在每一时刻t将原始特征图fo和注意力图attention map进行相乘得到上下文向量c,与前一时刻t-1的解码结果的嵌入向量e进行拼接,再和前一时刻t-1的hidden信息一起输入gru,得到当前时刻t的hidden信息;

[0061]

计算方式表示为式9,并和前一时刻t-1的解码结果e进行拼接,再和前一时刻t-1的hidden信息一起输入gru,得到当前时刻t的hidden信息,计算方式表示为式10,初始的e和hidden为0:

[0062]ct

=fo⊙

att

t

ꢀꢀ

式9

[0063]

hidden

t

=gru([c

t

,e

t-1

],hidden

t-1

)

ꢀꢀ

式10

[0064]

s302将t时刻得到的hidden信息以及vsfm中间特征f

temp

在通道维度进行拼接后输入分类器进行分类,得到当前时刻的识别结果;

[0065]

所述vsfm中间特征为融合特征图fu在bi-gru进行竖直方向的序列特征建模得到的竖直方向的序列建模特征,并将所述融合特征图fu和所述竖直方向的序列建模特征在通道维度进行拼接后得到。

[0066]

采用softmax激活,然后选择当前概率最大的结果作为当前时刻识别得到的字符结果.

[0067]

将hidden信息以及vsfm中间特征f

temp

,在通道维度进行拼接,计算方式表示为11,随后输入分类器classifier进行分类,采用softmax函数激活,得到当前时刻t识别为每个字符的概率logit

t

,计算方式表示为12,然后选择当前概率最大的结果作为当前时刻t识别得到的字符结果res

t

,计算方式表示为13:

[0068]ftemp

(i,j)=f

rnn-v

(i,j)+fu(i,j)

ꢀꢀ

式11

[0069]

logit

t

=softmax(classifier([hidden

t

,f

temp

]))

ꢀꢀ

式12

[0070]

res

t

=afgmax(logit

t

)

ꢀꢀ

式13

[0071]

s303重复s301~s302,当预测得到的最大概率的字符为终止符时,停止预测,并将每一时刻的识别结果组合起来后得到最终的识别结果。

[0072]

下面,结合具体的实施例,对本发明方法效果作进一步说明。

[0073]

本发明提出的基于改进dan的越南场景文字识别方法,其测试环境及实验结果为:

attention network for text recognition[c]//proc of the aaai conf on artificial intelligence.menlo park,ca:aaai,2020,34(07):12216-12224.

[0088]

crnn参照:shi baoguang,bai xiang,yao cong.an end-to-end trainable neural network for image-based sequence recognition and its application to scene text recognition[j].ieee transactions on pattern analysis and machine intelligence,2016,39(11):2298-2304.

[0089]

aster参照:shi baoguang,yang mingkun,wang xinggang,et al.aster:an attentional scene text recognizer with flexible rectification[j].ieee transactions on pattern analysis and machine intelligence.piscataway,nj:ieee,2018,41(9):2035-2048.

[0090]

seed参照:qiao zhi,zhouyu,yang dongbao,et al.seed:semantics enhanced encoder-decoder framework for scene text recognition[c]//proc of the ieee/cvf conf on computer vision and pattern recognition.piscataway,nj:ieee,2020:13528-13537。

[0091]

以上所揭露的仅为本发明一种较佳实施例而已,当然不能以此来限定本发明之权利范围,本领域普通技术人员可以理解实现上述实施例的全部或部分流程,并依本发明权利要求所作的等同变化,仍属于发明所涵盖的范围。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1