一种基于人工智能的解剖变异识别提示方法及系统与流程

1.本发明涉及医学图像处理技术领域,尤其涉及一种基于人工智能的解剖变异识别提示方法及系统。

背景技术:

2.在各专科的外科手术中,解剖变异的存在是各类手术过程中普遍面临的一大难题,而一旦出现,便极有可能引起该变异结构的损伤,导致手术过程中出血、管道损伤、神经损伤,以及术后出血、感染、丧失相关功能乃至不必要的术后残疾及死亡等不良事件的发生,从而使得手术实施存在较高的危险性和潜在的医患纠纷。

3.一方面,由于解剖变异的多元性、罕见性、以及难以预见性,目前医学上往往通过ct、核磁共振、神经电生理和术中各类别造影方式等鉴别解剖变异的存在及其种类;然而即便是如此,手术医师仍在一些情况下因不能预见其确切位置或者操作失误等原因,导致上述不良后果的发生;另一方面,随着人工智能计算机深度学习技术的进一步成熟,及其在医学影像、图片集手术视频处理上的逐步应用,计算机模型已经可以有效的处理ct、mri等影像图片以及手术过程的视频进行实时处理,此类技术的应用可以自动检测异常的解剖结构,并在手术开展过程中实时根据手术的视野进行对应范围的呈现;因此,如何通过人工智能的方式实时提示异常解剖结构的位置,以解决不能预见或判断解剖变异存在与否及其位置而导致的变异结构损伤的问题,是现阶段需要考虑的问题。

技术实现要素:

4.本发明的目的在于克服现有技术的缺点,提供了一种基于人工智能的解剖变异识别提示方法及系统,解决了目前医师因种种原因不能预见或判断解剖变异存在与否及其位置而导致的变异结构损伤的问题。

5.本发明的目的通过以下技术方案来实现:一种基于人工智能的解剖变异识别提示方法,所述识别提示方法包括手术实时识别提示步骤,所述手术实时识别提示步骤包括:实时采集腔镜图像,并根据腔镜器官分割模型和器械关键点检测模型获取实时器官分割数据以及器械关键点数据;通过分析手术前影像学图像获取变异结构和周围器官的位置关系,提取影像学图像变异结构周围器官组织分割数据,并与腔镜分割数据进行对比,实时判断变异结构的位置;实时检测器械关键点和变异结构的位置信息,当器械在变异解剖结构区域进行操作时,对变异解剖结构区域进行提示,手术操作者根据提示进行操作;重复上述步骤,直到手术结束。

6.所述识别提示方法还包括影像学图像及手术图像的标注数据库构建步骤以及模型构建步骤;所述影像学图像及手术图像的标注数据库构建步骤包括:构建多种类型的影像学图像变异解剖结构分割标注数据库和影像学图像器官分

割标注数据库;对手术图片进行抽取,标注构建手术图片下的器官结构分割标注数据和器械关键点标注数据;所述模型构建步骤包括:构建影像学图像变异解剖结构分割模型、影像学图像器官分割模型、腔镜图像器官分割模型、腔镜图像器械关键点检测模型。

7.所述构建多种类型的影像学图像变异解剖结构分割标注数据库和影像学图像器官分割标注数据库包括:收集影像学图像,根据需要标注的解剖结构及其周围的标志性解剖区域所在的区域、体位以及影像学图像采集的角度,初步筛选需要标注的图片或图片组;根据需要标注的变异解剖结构及其周围所在区域对应的不同外科专科,安排多名相应科室且满足主治医师级别的医师通过多边形标注的方式,标注变异解剖结构组织及周围标志性解剖器官,并由至少1名满足主任医师级别的医师对标注结果进行核查;完成用于训练影像学图像器官分割模型和影像学图像变异解剖结构分割模型的数据库的构建。

8.所述对手术图片进行抽取,标注构建手术图片下的器官结构分割标注数据和器械关键点标注数据包括:根据需要训练的不同变异结构部位所在的解剖区域及其对应负责的科室,收集对应科室的各种类型手术视频数据,并将其通过格式转码软件转换为相应格式,按照1秒/帧的时间间隔抽取手术图片;对抽取的图片通过多边形标记器官分割标注图片中的器官分割数据,和通过点标注法标注操作器械的关键点数据,安排多名相应科室且满足主治医师级别的医师进行标注,并由至少1名相应科室且满足主任医师级别的医师对标注结果进行核查;完成用于训练腔镜图像器官分割模型、腔镜图像器械关键点检测模型的数据库的构建。

9.所述影像学图像变异解剖结构分割模型、影像学图像器官分割模型和腔镜图像器官分割模型分别通过影像学图片下的变异解剖结构、影像学图片下与变异结构邻近的器官组织、腔镜手术图片下的器官结构标注数据,使用unet++网络算法进行训练得到;腔镜图像器械关键点检测模型通过腔镜手术图片下的器械关键点标注数据,使用级联金字塔神经网络训练得到。

10.所述影像学图像变异解剖结构分割模型、影像学图像器官分割模型和腔镜图像器官分割模型的unet++由下采样、上采样和跳跃连接三个部分组成,每个节点均由基于2d卷积的数据处理层构成,其中下采样提取图像语义特征,在上采样的时候根据语义信息对原图每个像素进行分类,以达到分割的目的;在跳跃连接中通过增加基于2d卷积的数据处理层,根据不同数据处理层所在的下采样层数分别在数据处理层之间建立两两之间的跳跃连接和相邻采样层之间的上采样连接,以及在不同下采样层数构成的子网络中增加基于l函数的深度监督的剪枝结构,使每个图片的标注数据在不同的卷积深度下的分割结果得以整合,在保证数据处理效率的基础上整合不同下采样深度的训练结果,以提高模型训练的准确度。

11.用于训练腔镜图像器械关键点检测模型的级联金字塔神经网络由globalnet和

refinenet两部分构成;globalnet实现对器械关键点中简单的点进行有效的关键点检测,refinenet实现对不同层信息的融合,更好的综合特征定位器械关键点;globalnet基础网络采用resnet网络,用resnet的不同尺度的特征图的最后一个残差块作为输出组合为特征金字塔,然后各层进行2d卷积将通道数变为相同,将分辨率小的层上采样一次,再对应神经元相加,再对每层都进行2d卷积,生成不同尺寸且具有高级语义的特征图,实现对器械关键点中简单的点进行有效的关键点检测;refinenet对globalnet的4层输出分别接上不同个数的bottleneck模块,再分别经过不同倍率的上采样到同一分辨率,按通道拼接在一起,实现对不同尺度特征的结合,最后经过一个bottleneck模块,再经过变换,得到网络的最终的输出;其中,bottleneck模块由2d卷积、批数据归一化、非线性激活函数组成,对于来自上一层的多通道特征图,首先使用卷积核大小为1的2d卷积将特征图在通道维度上进行降维,再使用卷积核大小为3的2d卷积进行特征计算,最后使用卷积核大小为1的2d卷积在通道维度上升维,从而达到减少参数的数量的目的,进而减少计算量,且在降维之后可以更加有效、直观地进行数据的训练和特征提取。

12.所述影像学图像变异解剖结构分割模型和影像学图像器官分割模型首先使用unet++分割出影像学图片中出现的变异解剖结构及其周围的器官组织,并对变异的解剖结构与其周围的器官组织进行预设条件和互斥;预设条件包括:肝外胆管树一定在肝脏的下方并汇入胰腺或十二指肠,腹腔干及其分支一定在胰腺的上缘并发自腹主动脉,胃十二指肠动脉网一定起源自腹主动脉的上部;不会出现孤立且不发生汇合或分支的脉管和胆管;胆管或动静脉不会穿过胃腔或肠腔;互斥条件包括:肝脏、胃、十二指肠、胆道系统和动静脉系统同时只可能出现一个,且胆道系统或局部区域的主要动静脉网应为连续的管道网络。

13.所述通过分析手术前影像学图像获取变异结构和周围器官的位置关系包括:将影像学图像中各结构的分割识别结果通过python根据其横竖坐标中心点及其极值,生成在最小外界框基础上向外扩大延伸而形成的扩大外界框,扩大外界框中包括变异解剖结果或者周围器官的识别结果,以及周围结构的识别结果;根据扩大外界框与其周围器官识别结果对应范围之间的相交关系,确定获取变异结构和周围器官组织的位置关系。

14.一种基于人工智能的解剖变异识别提示系统,它包括影像图像获取模块、变异解剖结构检测模块、解剖要素区域检测模块和器械检测模块;所述影像图像获取模块用于获取多种类型的影像学图像及相关手术视频数据,并进行处理后得到影像学关键图片序列和视频帧序列;所述变异解剖结构检测模块用于通过unet++网络进行特征提取,将得到的特征图作为后续网络的输入,最后得到对应视频帧中变异结构出现的区域;所述解剖要素区域检测模块用于通过unet++网络进行特征提取,将得到的特征图作为后续网络的输入,最后得到对应视频帧中出现的解剖要素区域的位置,并为变异结构检测模块的运行提供数据支持;所述器械检测模块用于通过cpnet网络进行特征提取,将得到的特征图作为后续网络的输入,最后得到对应的视频中出现的器械尖部的位置。

15.本发明具有以下优点:1、采用人工智能深度学习模型,通过影像学图像识别变异解剖结构及周围器官分布数据,将手术腔镜的器官分割识别结果和影像学器官位置及其标签作比较,从而建立识别提示解剖变异的人工智能系统。在实际手术操作过程中,该系统通过实时在术野中提示变异解剖的位置,形象的为外科医师预先指明变异结构存在的有无及其存在位置,从而使其在手术过程中避免因疏漏而引起的变异结构损伤以及后续带来的严重后果。

16.2、通过更加形象实时的指明变异结构的位置,使得外科医师更好的加深对特殊病例的印象及对该内容的掌握。其对应的病例报道亦能够更为直观的指出解剖变异存在的位置及其规避的方式,为学者提供了更详实的资料。

17.3、通过建立影像学检查和腔镜手术视野之间的对应关系,手术中关键操作的脉络管道结构得到了准确有效的定位,其功能的推演可以延伸至肿瘤、结石、以及异物的定位,为外科手术更为精确的进行提供了重要的条件。

附图说明

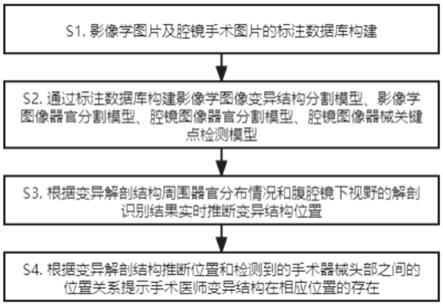

18.图1 为本发明方法的流程示意图;图2 为构建用于训练模型的数据库流程示意图;图3 为通过数据库构建本发明中各个模型的流程示意图;图4 为影像学图片和腔镜图片下的变异解剖结构及器官分割模型的结构示意图;图5 为器械头部关键点检测模型的结构示意图。

具体实施方式

19.为使本技术实施例的目的、技术方案和优点更加清楚,下面将结合本技术实施例中附图,对本技术实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本技术一部分实施例,而不是全部的实施例。通常在此处附图中描述和示出的本技术实施例的组件可以以各种不同的配置来布置和设计。因此,以下结合附图中提供的本技术的实施例的详细描述并非旨在限制要求保护的本技术的保护范围,而是仅仅表示本技术的选定实施例。基于本技术的实施例,本领域技术人员在没有做出创造性劳动的前提下所获得的所有其他实施例,都属于本技术保护的范围。下面结合附图对本发明做进一步的描述。

20.如图1所示,本发明的一种实施方式涉及一种基于人工智能的解剖变异识别提示方法,具体包括以下步骤:s1、收集ct、mri等影像学图片和腔镜手术图片,通过标注影像学图片和腔镜手术图片构建用于训练模型的数据库;s2、通过构建的数据库,使用计算机视觉算法模型训练得到用于识别影像学图片下变异解剖结构、邻近器官组织、腔镜视野下解剖结构、手术操作器械关键点的人工智能计算机模型;s3、根据变异解剖结构周围器官分布情况和腔镜下视野的解剖识别结果,实时推断变异结构在腔镜手术视野下的位置;s4、根据模型在视野下推断出的变异解剖位置和检测到的手术器械头部之间的位置关系,提示手术医师变异结构在相应位置的存在。

21.如图2所示,用于训练模型的标注数据库由ct、mri等影像学图像上标注的变异解剖结构及其邻近器官组织,与腔镜手术视频图片上标注的图片中出现的器官结构及主操作器械关键点等构成;其中影像学图片包括但不限于ct、mri等影像学检查方式得到的对人体组织、器官等进行扫描的医学图片;其中腔镜手术视频包括但不限于肝胆胰外科、胃肠外科、妇科、胸外科、甲状腺外科等科室的腔镜微创手术视频;标注ct、mri等影像学图片中的变异解剖结构及其邻近器官组织、腔镜手术图片中与影像学图片中对应的器官结构、以及腔镜手术图片中的器械关键点的过程,由labelme软件分别通过标注相应解剖结构的多边形边界框和手术器械的头部操作点进行,其中的腔镜手术图片通过对收集到的腔镜手术视频使用ffmpeg软件转码为mpeg-4格式并等时长抽取视频图片的方式进行获取;影像学图片和腔镜手术视频图片的标注由相应科室的2到3名主治及以上级别的医师或阅览过超过500台次手术视频的专业标注人员进行,并由1名相应科室的主任医师对标注结果进行检查;根据标注类别和所需使用计算机视觉算法模型训练的到的模型的不同,对影像学图片和腔镜手术视频图片标注的结果分别用于构建影像学图像变异解剖结构分割模型、影像学图像器官分割模型、腔镜图像器官分割模型、和腔镜图像器械关键点检测模型。

22.ct、mri等影像学图片下标注的变异解剖结构,包括但不限于变异的动脉、静脉、神经、器官结构的主要管道等结构,如副右肝管等,其变异类型包括但不限于走行路径的改变、分支方向或分支数目的改变、管道的缺失或增加、形状的重大改变等,如穿过胰腺实质的异位肝动脉等;影像学图片下标注的变异解剖结构临近器官组织包括但不限于主要脉管结构、肺、心脏、肝脏、胆囊、胰腺、脾脏、胃、子宫、膀胱等位置相对固定且能够对局部解剖位置进行明确定位的结构;解剖结构标注数据库的构建通过系统性标注进行,包括但不限于肝左动脉及其主要分支、肝内胆管树、肝动脉及其肝内分支、腹腔干及其主要分支等标注过程中定义的局部脉管系统。

23.腔镜手术图片中所标注的器官结构,应根据因不同的科室、手术而定义的不同的变异解剖结构周围的器官组织进行选择和定义,其定义的内容和类别,包括但不限于手术过程中涉及的动静脉及其主要分支、胆管及其主要分支、以及主要器官等,应与影像学图片下标注的与变异解剖结构邻近的器官组织相同。

24.腔镜手术图片中标注的器械关键点为主操作器械的尖部及其操作杆的末端,包括但不限于电钩、超声刀、电凝、施夹器、剪刀、持针器、切割闭合器、钉仓等有创腔镜操作器械。

25.如图3所示,影像学图像变异解剖结构分割模型、影像学图像器官分割模型、腔镜图像器官分割模型分别通过影像学图片下的变异解剖结构、影像学图片下的与变异结构邻近的器官组织、和腔镜手术图片下的器官结构等标注数据,使用unet++网络算法训练得到;腔镜图像器械关键点检测模型通过腔镜手术图片下的器械关键点标注数据,使用级联金字

塔神经网络训练得到;上述标注完成的影像学图片下的变异解剖结构、影像学图片下的与变异结构邻近的器官组织、腔镜手术图片下的器官结构、以及腔镜手术图片下的器械关键点等标注数据,按照训练集:验证集:测试集=8:1:1的比例,以视频或病例作为单位,随机分配至3个集合中进行模型的训练和开发。其中影像学图像变异解剖结构分割模型、影像学图像器官分割模型、以及腔镜图像器官分割模型的准确性通过准确度、召回率、平均精度均值、平均交并比等进行衡量;腔镜图像器械关键点检测模型的准确性通过准确度、召回率、平均精度均值和目标关键点相似度(oks)等进行衡量,其中目标关键点相似度的计算公式如下:其中,p表示在真值中某个目标的id,pi表示某个目标关键点的id,表示关键点的可见性为1,即在图片上可见,s

p

表示对应器械所占的面积大小的平方根,di表示标注值和预测关键点之间的欧氏距离,σi表示第i个骨骼点的归一化因子,δ用于将可见点选出来进行计算的函数。

26.以上模型的开发通过anaconda 2021.05(对应python 3.8)平台进行,并以特斯拉v100图形处理器(gpu)作为图形处理器进行模型训练;所有的模型均在imagenet数据库中进行预训练。

27.如图4所示,用于影像学图像变异解剖结构分割模型、影像学图像器官分割模型、和腔镜图像器官分割模型的unet++,由下采样(左侧)、上采样(右侧)、和跳跃连接(图中左右之间的连接)三个部分组成,每个节点(x

i,j

)均由基于2d卷积的数据处理层构成,其中下采样提取图像语义特征,在上采样的时候根据语义信息对原图每个像素进行分类,即达成分割效果,其层数根据数据的性质和不同层数下模型构建的效果进行确定,并以构建效果最优为准;优选的,在原有的unet神经网络的基础上,unet++在跳跃连接中通过相应的增加基于基于2d卷积的数据处理层、根据不同数据处理层所在的下采样层数分别在处理层之间建立两两之间的跳跃连接(同下采样层)和相邻采样层之间的上采样连接(仅限相邻节点)、以及在不同下采样层数构成的子网络中增加基于l函数的深度监督的“剪枝”结构,使得每一个图片的标注数据在不同的卷积深度下的分割结果得以整合,由此在保证数据处理效率的基础上整合不同下采样深度的训练结果,以进择优一步提高模型训练的准确度;其中,每个节点(x

i,j

)按照如下公式输出数据输出结果(x

i,j

):其中,i,j分别代表节点所在的下采样层数和在跳跃连接层致密块中所在的卷积

层数;k表示公式计算过程中节点x

i,j

中的j之不同整数取值,取值范围在0和j-1之间;函数为一个卷积运算,其后紧随一个激活函数;表示上采样运算;而该公式的中括号则表示卷积运算。由此j=0所在的节点只接收一个来自上一节点数据的输入,而j》0所在的节点则接收来自j+1个所在通路的上一节点的数据输入。

28.添加于不同语义层的“剪枝”结构由损失函数l实现其功能,其为结合了二元交叉熵和dice系数的损失函数,其公式表达如下:其中的和分别表示第b个图片的扁平预测概率和扁平标注值,n代表一次训练所抓取的数据样本数量。

29.由于影像学图片和腔镜采集图像差异较大,腔镜图像器官分割模型和影像学图像变异解剖结构分割模型、影像学图像器官分割模型的建模会相互完全独立并分别单独进行,形成彼此完全独立的分割模型。唯独在构建模型的时候会比较分割结果和标注数据,根据模型识别结果和标注值之间的差距进行算法的调整与模型的迭代。

30.影像学图片中的变异解剖结构标签及其周围器官的标注标签会通过基于unet++的计算机网络结构进行学习,最终输出影像学图片中的变异解剖结构及其周围器官的分割结果,通过内置逻辑使得变异解剖结构与周围器官的识别结果互相排斥,即影像学图片中的每个坐标点只有一种识别结果,且以概率最大者为准。

31.为确定变异解剖结构标签及其周围器官之间的位置关系,这些影像学图片中的各结构的分割识别结果会通过python根据其横竖坐标中心点及其极值,生成相对于最小外界框(横边和竖边分别为纵坐标和横坐标极值所在的横线和竖线)的基础之上稍扩大(长、宽分别以横竖坐标中心点为基准,扩大1.2倍左右,以包括到周围其他识别标签为准)而形成的外界框。该外界框除分别包括变异解剖结构(如副右肝管)或其周围器官(如肝脏、胆囊等)的识别结果本身外,亦因其扩大而包括其周围结构的识别结果,如副右肝管识别结果中生成的外界框中包括肝脏、胆囊,而肝脏的外界框则包括胆囊、副右肝管等临近结构。由于变异解剖结构的外界框会圈入其他周围器官结构的识别标签,python语句亦根据外界框和各标签之间的相交关系确定变异解剖结构的外界框中所圈入的其他标签类型。

32.如图5所示,用于训练腔镜图像器械关键点检测模型的级联金字塔神经网络,由globalnet和refinenet两部分构成。其中,globalnet部分对器械关键点进行粗提取,refinenet精细加工难以识别的器械关键点特征。

33.globalnet基础网络采用resnet网络,用resnet的不同尺度的特征图的最后一个残差块作为输出组合为特征金字塔,然后各层进行2d卷积将通道数变为相同,将分辨率小的层上采样一次,再对应神经元相加,再对每层都进行2d卷积。globalnet网络的目的是生成不同尺寸的特征图,都具有高级语义,对不同尺寸的目标,就可以选用不同尺寸的特征图去做识别。通过globalnet网络,可以对器械关键点中简单的点进行有效的关键点检测。

34.refinenet对globalnet的4层输出分别接上不同个数的bottleneck模块,再分别

经过不同倍率的上采样到同一分辨率,按通道拼接在一起,达到了对不同尺度特征的结合,最后经过一个bottleneck模块,再经过简单的变换,得到网络的最终的输出。其中,bottleneck模块由2d卷积、批数据归一化、非线性激活函数组成,对于来自上一层的多通道特征图,首先使用卷积核大小为1的2d卷积将特征图在通道维度上进行降维,再使用卷积核大小为3的2d卷积进行特征计算,最后使用卷积核大小为1的2d卷积在通道维度上升维。从而达到减少参数的数量的目的,进而减少计算量。且在降维之后可以更加有效、直观地进行数据的训练和特征提取。refinenet对不同层信息进行了融合,可以更好的综合特征定位器械关键点。

35.在globalnet中,使用l2 loss对globalnet网络的输出和标签计算所有关键点的损失;在refinenet中,使用l2 loss对网络输出和标签计算所有关键点的损失,然后对损失进行从大到小排序,最后选择top-k个loss用于网络的反向传播。

36.l2 loss的公式如下所示:其中和分别表示第i个样本的真实值和预测值,n表示样本数量。

37.影像学图像变异解剖结构分割模型和影像学图像器官分割模型首先使用unet++分割出影像学图片中出现的变异解剖结构及其周围的器官组织,并对变异的解剖结构与其周围的器官组织进行预设条件和互斥。

38.进一步地,预设条件包括但不限于:肝外胆管树一定在肝脏的下方并汇入胰腺或十二指肠;腹腔干及其分支一定在胰腺的上缘并发自腹主动脉;胃十二指肠动脉网一定起源自腹主动脉的上部;不会出现孤立且不发生汇合或分支的脉管和胆管;胆管或动静脉不会穿过胃腔或肠腔等;进一步地,互斥条件即同种大体器官或脉管系统,如肝脏、胃、十二指肠、胆道系统、动静脉系统等,同时只可能出现一个,且诸如胆道系统或局部区域的主要动静脉网应为连续的管道网络。

39.最终通过以上处理方式确定影像学图片中出现的变异解剖结构及其与周围器官之间的位置关系。

40.腔镜图像器官分割模型和腔镜图像器械关键点检测模型亦设有相似的逻辑:腔镜图像器官分割模型包括分割结果互斥处理,即同种解剖结构只可能出现一个,识别结果以预测概率最高的分割区域为准;腔镜图像器械关键点检测模型包括电钩、超声刀、电凝、施夹器、剪刀、持针器、切割闭合器、钉仓等有创腔镜操作器械只可能在图片中同时出现一次。

41.手术过程中,影像学图像变异解剖结构分割模型和影像学图像器官分割模型将患者影像学检查的模型识别结果与腔镜图像器官分割模型对实时输入该模型的腔镜手术图像的识别结果进行对照,当后者识别到前者所识别到的诸如肝脏、胃、十二指肠、胰腺、脾、肾、肺等大体器官结构时,结合影像学图像变异解剖结构分割模型和影像学图像器官分割模型所识别得到的变异解剖结构及其与周围器官之间的位置关系,推断变异结构在视野下的所在区域。

42.为了在腹腔镜图像上找出影像学图片中分割出的变异结构位置,首先根据前面得出的影像学图片变异结构(如副右肝管)识别结果的扩大外界框与其周围临近器官(如肝脏、胆囊等标签)识别结果对应的范围之间的相交关系,确定获取变异结构和周围器官组织的位置关系,同时在手术过程中,腔镜图像器官分割模型实时接收腹腔镜手术图片,并在腹腔镜图像上通过基于unet++的器官分割对视野下的解剖结构(如肝脏、胆囊等)进行识别。这个识别结果的标签将连同影像学图片变异结构及其周围临近器官的识别结果,通过python等技术进行识别标签比对,并使用一个预定义窗口大小的滑动窗口在图中遍历,以对比窗口中出现的器官组织临近关系是否符合影像学图片中变异结构附近器官位置信息。当滑动窗口检索到腹腔镜手术图片中多个变异解剖外界框中所包含的解剖结构(如肝脏、胆囊等)时,诸如副右肝管在内的变异结构的所在范围便可通过器官的相交关系在视野中提示其在投射视野中所在的范围。

43.手术过程中,腔镜图像器械关键点检测模型实时就实时输入该模型的腔镜手术图像对主操作器械的头部关键点的位置进行检测,当器械头部关键点的位置接近变异解剖结构在视野中的区域或与之重合时,根据变异解剖结构的类别,实时在手术辅助操作屏幕中提示相应变异解剖结构的存在。

44.本发明的另一实施例涉及一种基于人工智能的解剖变异结构识别提示系统,其主要由影像图像获取模块、变异解剖结构检测模块、解剖要素区域检测模块、器械检测模块构成。

45.影像学图像获取模块,其配置来获取腹部ct、cta、mri等影像学检查图片及腔镜胰十二指肠切除术视频流,分别得到影像学关键图片序列和视频帧序列;变异解剖结构检测模块,其配置来利用unet++网络进行特征提取,得到的特征图作为后续的侦测网络的输入,最后得到对应视频帧中变异结构出现的区域;解剖要素区域检测模块,其配置来利用unet++网络进行特征提取,得到的特征图作为后续的侦测网络的输入,最后得到对应视频帧中出现的解剖要素区域的位置,并为变异结构检测模块的运作提供信息支持;器械检测模块,其配置来利用级联金字塔神经网络进行特征提取,得到的特征图作为后续的侦测网络的输入,最后得到对应的视频中出现的器械尖部的位置。

46.以上所述仅是本发明的优选实施方式,应当理解本发明并非局限于本文所披露的形式,不应看作是对其他实施例的排除,而可用于各种其他组合、修改和环境,并能够在本文所述构想范围内,通过上述教导或相关领域的技术或知识进行改动。而本领域人员所进行的改动和变化不脱离本发明的精神和范围,则都应在本发明所附权利要求的保护范围内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1