一种基于MLP的医学图像分割方法

一种基于mlp的医学图像分割方法

技术领域

1.本发明涉及图像处理和机器视觉技术,具体是一种基于mlp的医学图像分割方法。

背景技术:

2.医学图像分割是医学图像处理的关键步骤,在计算机辅助智能诊断中发挥着重要作用。医学图像分割研究涉及许多临床应用中常见任务,如covid-19筛查、息肉分割、肠镜检查等。

3.早期的医学图像分割技术主要是通过基于阈值或边界的分割方法。随后深度学习技术不断发展,深度神经卷积网络cnn(convolutional neural networks,简称cnn)便开始被应用于图像去噪,医学分割等。ronneberger等人提出的u-net和xiao等人提出的res-unet,它们通过下采样提取特征信息,利用上采样和跳跃连接获得不同尺度的特征信息。然而,cnn虽然对医学分割技术做出了有效贡献,却很难进一步突破,因为卷积网络存在提取特征时具有固有归纳偏差、每个卷积还能聚焦于整个图片的子区域,从而注重局部特征而丢失了全局上下文特征、缺少能建模长期依赖关系的能力,虽然通过卷积的不断堆叠和下采样操作可以增大模型的感受野,使卷积能够提取到局部特征之间的相互作用特征,但是该方式会使模型更加复杂且容易过拟合。

4.目前一些研究对特征之间的长期依赖关系进行了建模,如注意力机制和transformer。chen等人提出的transunet利用transformer将cnn提取的特征图编码,并利用提取的全局上下文信息进行远程依赖关系建模;zhang等人提出基于vit的transfuse结合了transformer和cnn,在不损失low-level细节的定位能力的情况下提高全局上下文建模效率。上述模型的成功虽然表明了transformer在医学分割的巨大潜力,但是基于transformer的医学分割有以下问题:(1)transformer通过增强模型的全局特征提取能力,并没有增加局部先验;(2)transformer由于缺少局部先验归纳数据之间的偏差,需要大量的训练数据,使模型收敛;(3)部分医学图像具有固定的位置先验,transformer中的multi-head attention并没有对所有位置之间的参数进行共享,位置信息的利用受到限制。

5.最近tolstikhin等人提出基于mlp的mlp-mixer模型,利用全连接,沿着通道轴和空间轴扁平特征图,进行特征图的编码,使特征图可以产生全局上下文信息建模,虽然mlp-mixer与卷积神经网络和transformer相比,在全局上下文信息建模都更有效,但是mlp-mixer存在以下问题:(1)mlp-mixer沿着空间维度进行线性投影编码空间信息,不仅导致二维特征所携带的位置信息丢失,而且沿着空间维度编码具有二次方增长的计算量;(2)mlp-mixer由于全连接代替卷积,不仅特征图的小尺度物体的空间信息存在丢失,而且缺少局部先验特征;(3)mlp-mixer良好的性能也很大程度上得益于大规模数据的训练,如果没有大规模数据集的训练mlp-mixer的表现仍然落后于cnn和transformer。

技术实现要素:

6.本发明的目的是针对现有技术的不足,而提供一种基于mlp的医学图像分割方法。

这种方法不仅在保持原始空间维度特征结构下,具有敏感的位置感知能力和极少的计算开销,并且有效增加模型提取局部特征和全局上下文信息的能力,增大模型对小尺度物体的特征感知,也能有效地解决由于医学分割数据样本数量相对较少,医学图像中patch的位置嵌入的依赖关系不能很好地学习的问题,从而实现高性能和高效率的医学分割。

7.实现本发明目的的技术方案是:

8.一种基于mlp的医学图像分割方法,包括如下步骤:

9.1)编码:特征图的编码采用基于mlp的医学图像分割模型tgmlp unet(triple gate multilayer perceptron unet,简称tgmlp unet),在tgmlp unet编码器中,首先tgmlp分别沿着高度轴、宽度轴和通道轴编码特征图,然后tgmlp加入全局感知和局部先验模块,这样不仅对特征图的全局上下文信息建模、建立全局之间的外部依赖关系,而且能够使模型对特征图的局部信息更好地提取,最后,tgmlp加入门控机制控制输出的信息量,最大程度地保留特征信息,并且tgmlp的输出的编码特征将被连接一个1

×

1的卷积层,经过卷积后的特征会连接残差映射,并采用add函数将卷积后的特征和输入进tgmlp的特征相加,获得最终的编码后的特征图;

10.2)解码:解码器是由3

×

3卷积层、反卷积、跳跃连接构成,在解码器中卷积的作用是将特征图的通道数减少,反卷积的作用是使特征尺寸依次变大,使用跳跃连接将解码部分中反卷积结果与编码部分的输出进行对应的连接与合并,逐渐恢复特征信息;

11.3)局部分支结构和全局分支结构:tgmlp unet采用tgmlp作为基本构建块,并使用了一种局部-全局训练策略进行训练,tgmlp unet的两个分支结构分别为局部分支结构和全局分支结构,全局分支用来学习长距离特征的关系,局部分支用来弥补patch像素之间失去的局部细节特征,首先,两个分支结构之前医学影像分割图像会经过3个7

×

7卷积层进行特征的初步提取,每个卷积层都有归一化和relu激活函数,其次将局部分支输出的所有patch块特征进行堆叠,然后采用add函数将全局分支和局部分支的提取的特征图进行相加,最后采用1

×

1的卷积层对特征图进行像素级别分类,其中,在tgmlp unet的全局分支设有2个编码器和2个解码器,局部分支中有5个编码器和5个解码器,需要注意的是,不管是全局分支还是局部分支,都是将多个编码器和解码器分别串联起来。

12.所述分割模型tgmlp unet设有三个部分,其中:

13.第一个部分为tmlp(triple mlp,简称tmlp)模块,tmlp模块由三个独立分支组成,每个分支沿着特定的维度即高度、宽度、通道维度进行编码,不仅保持输入特征图的原始空间维度特征结构、保留位置信息并产生具有方向特定位置信息,而且使沿着空间维度编码的二次方增长的计算量减少为线性增长的计算量,因此,在对于给定具有高度h、宽度w和通道c

in

的输入特征映射带有高度轴、宽度轴、通道轴的的i层tgmlp输出si表示为:

14.s

i-1

=chnnel mlp(ln(s

i-2

))+s

i-2

ꢀꢀꢀ

(1),

[0015][0016][0017]

第二个部分为全局感知gp(global perceptron,简称gp)模块和局部先验lp(local priors,简称lp)模块,tmlp中采用全连接作为特征抽取器,能实现了对医学图像的细粒度分割,然而在分割的时候全连接从一个分区提取分割图像特征,易忽视小尺度的物

体,如细胞,并且容易造成医学图像分割物体结构内部局部细节丢失,为了解决这些问题,tmlp加入了全局感知模块和局部先验模块,全局感知模块将特征图进行分区,并传入多个全连接层里面,使特征图的不同分区之间共享参数,减少医学分割小尺度特征信息丢失,更有效地进行全局上下文建模,而局部先验模块构造平行于全连接的cnn和bn(batch normalization,简称bn),采用cnn和bn提取局部特征,使模型避免了特征拆分所导致的局部相关性丢失,

[0018]

全局感知模块分区方式如下:首先,将输入大小为的特征图分成h个区域,特征图将重置为大小为并重新进行轴的排序,特征图大小变为如公式(4)所示:

[0019][0020]

其中rs表示改变张量的形状规格,而不改变数据在内存顺序的函数,permute表示特征图对轴重新排序,然后,采用全局平均池化操作获取大小为的矩阵,并将矩阵输入进bn和一个两层的mlp,获得大小为的权重矩阵,如公式(5)所示:

[0021]vout

=mlp(bn(gap(x

out

)))

ꢀꢀꢀ

(5),

[0022]

其中gap表示全局平均池化,w表示卷积核,mlp表示为了实现同一通道的不同分区之间的相关性,首先将权重矩阵重置为大小然后采用pytorch中的expend函数将权重矩阵大小变为最后,采用add函数将权重矩阵添加到每个分区上,得到大小为的特征图m

out

,如公式(6)所示;

[0023][0024]

全局感知模块实现了每个像素和不同的分区关联,弥补特征提取过程中小尺度物体丢失的问题,

[0025]

在局部先验中,首先将全局感知的输出张量的形状改变为(n,h,w,c),然后构建4个并行的卷积层,每个卷积层后面跟着一个bn层,并将形状改变后的张量输入进4个并行的卷积,4个并行的卷积层解决了特征提取过程中局部结构信息丢失问题,4个卷积核的大小分别为1、3、5、7,卷积的padding用于保证分辨率即p=0,1,2,3,最后,将所有卷积分支的输出和tmlp的输出采用add函数加在一起,作为最后的输出,局部先验的计算方式如公式(7)、公式(8)所示:

[0026]vout

=rs(m

out

,(n,w,h,c))

ꢀꢀꢀ

(7),

[0027][0028]

其中f表示4个卷积层的卷积核,它们分别为1、3、5、7,p为卷积层用来填充的像素

unet编码器中,首先tgmlp分别沿着高度轴、宽度轴和通道轴编码特征图,然后tgmlp加入全局感知和局部先验模块,这样不仅对特征图的全局上下文信息建模、建立全局之间的外部依赖关系,而且能够使模型对特征图的局部信息更好地提取,最后,tgmlp加入门控机制控制输出的信息量,最大程度地保留特征信息,并且tgmlp的输出的编码特征将被连接一个1

×

1的卷积层,经过卷积后的特征会连接残差映射,并采用add函数将卷积后的特征和输入进tgmlp的特征相加,获得最终的编码后的特征图,如图2所示,图2显示对编码器的tgmlp和卷积,值得注意的是在图2中省略了layer norm和残差连接;

[0045]

2)解码:如图3所示,解码器是由3

×

3卷积层、反卷积、跳跃连接构成,在解码器中卷积的作用是将特征图的通道数减少,反卷积的作用是使特征尺寸依次变大,使用跳跃连接将解码部分中反卷积结果与编码部分的输出进行对应的连接与合并,逐渐恢复特征信息;

[0046]

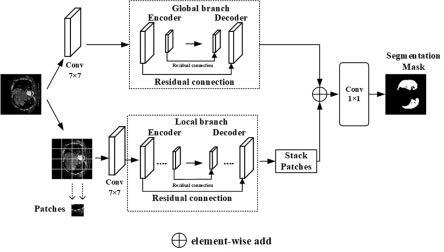

3)局部分支结构和全局分支结构:tgmlp unet采用tgmlp作为基本构建块,并使用了一种局部-全局训练策略进行训练,tgmlp unet的两个分支结构分别为局部分支结构和全局分支结构,全局分支用来学习长距离特征的关系,局部分支用来弥补patch像素之间失去的局部细节特征,首先,两个分支结构之前医学影像分割图像会经过3个7

×

7卷积层进行特征的初步提取,每个卷积层都有归一化和relu激活函数,其次将局部分支输出的所有patch块特征进行堆叠,然后采用add函数将全局分支和局部分支的提取的特征图进行相加,最后采用1

×

1的卷积层对特征图进行像素级别分类,其中,在tgmlp unet的全局分支设有2个编码器和2个解码器,局部分支中有5个编码器和5个解码器,需要注意的是,不管是全局分支还是局部分支,都是将多个编码器和解码器分别串联起来,tgmlp unet的整体架构如图1所示。

[0047]

所述分割模型tgmlp unet设有三个部分,其中:

[0048]

第一个部分为tmlp模块,tmlp模块由三个独立分支组成,每个分支沿着特定的维度即高度、宽度、通道维度进行编码,不仅保持输入特征图的原始空间维度特征结构、保留位置信息并产生具有方向特定位置信息,而且使沿着空间维度编码的二次方增长的计算量减少为线性增长的计算量,因此,在对于给定具有高度h、宽度w和通道c

in

的输入特征映射带有高度轴、宽度轴、通道轴的的i层tgmlp输出si表示为:

[0049]si-1

=chnnel mlp(ln(s

i-2

))+s

i-2

ꢀꢀꢀ

(1),

[0050][0051][0052]

第二个部分为全局感知gp模块和局部先验lp模块,tmlp中采用全连接作为特征抽取器,能实现了对医学图像的细粒度分割,然而在分割的时候全连接从一个分区提取分割图像特征,易忽视小尺度的物体,如细胞,并且容易造成医学图像分割物体结构内部局部细节丢失,为了解决这些问题,tmlp加入了全局感知模块和局部先验模块,全局感知模块将特征图进行分区,并传入多个全连接层里面,使特征图的不同分区之间共享参数,减少医学分割小尺度特征信息丢失,更有效地进行全局上下文建模,而局部先验模块构造平行于全连接的cnn和bn,采用cnn和bn提取局部特征,使模型避免了特征拆分所导致的局部相关性丢失,tmlp结构,如图4所示,其中n,c,h,w分别表示特征图的批次大小,通道数,高度和宽度,p

表示需要填充的像素,h表示对特征图的分割区域大小,在global perceptron会将分区的相关性添加到每个分区上,local priors通过多个并行卷积捕获特征图的局部先验特征,

[0053]

全局感知模块分区方式如下:首先,将输入大小为的特征图分成h个区域,特征图将重置为大小为并重新进行轴的排序,特征图大小变为如公式(4)所示:

[0054][0055]

其中rs表示改变张量的形状规格,而不改变数据在内存顺序的函数,permute表示特征图对轴重新排序,然后,采用全局平均池化操作获取大小为的矩阵,并将矩阵输入进bn和一个两层的mlp,获得大小为的权重矩阵,如公式(5)所示:

[0056]vout

=mlp(bn(gap(x

out

)))

ꢀꢀꢀ

(5),

[0057]

其中gap表示全局平均池化,w表示卷积核,mlp表示为了实现同一通道的不同分区之间的相关性,首先将权重矩阵重置为大小然后采用pytorch中的expend函数将权重矩阵大小变为最后,采用add函数将权重矩阵添加到每个分区上,得到大小为的特征图m

out

,如公式(6)所示;

[0058][0059]

全局感知模块实现了每个像素和不同的分区关联,弥补特征提取过程中小尺度物体丢失的问题,

[0060]

在局部先验中,首先将全局感知的输出张量的形状改变为(n,h,w,c),然后构建4个并行的卷积层,每个卷积层后面跟着一个bn层,并将形状改变后的张量输入进4个并行的卷积,4个并行的卷积层解决了特征提取过程中局部结构信息丢失问题,4个卷积核的大小分别为1、3、5、7,卷积的padding用于保证分辨率即p=0,1,2,3,最后,将所有卷积分支的输出和tmlp的输出采用add函数加在一起,作为最后的输出,局部先验的计算方式如公式(7)、公式(8)所示:

[0061]vout

=rs(m

out

,(n,w,h,c))

ꢀꢀꢀ

(7),

[0062][0063]

其中f表示4个卷积层的卷积核,它们分别为1、3、5、7,p为卷积层用来填充的像素数量,它们分别为0、1、2、3、4,si为公式(3)的值;

[0064]

第三个部分为门控注意力机制,tmlp和局部先验和全局感知模块能使tgmlp以良好的计算效率计算全局上下文特征信息,并且能够在输入特征映射内编码远程交互,然而在大规模医学数据集上进行评估,tgmlp更容易学习到位置偏差,对于小规模医学图像数据集进行实验,位置偏差很难学习,因此编码远程交互位置信息并不完全准确,在学习的位置

差不够准确的情况下,将tmlp添加到tgmlp并不能完全发挥出tmlp的性能,因此提出了一种带门控的tmlp,它可以控制位置偏差对局部位置感知能力影响,通过对tmlp的修改,应用到高度轴的tmlp,可以用公式(8)表示,宽度轴和通道轴同公式(8):

[0065][0066]

其中在tmlp的公式(1)、公式(2)、公式(3)中增加门控机制,它们分别为gc,gh,gw∈r,它们为可学习的参数,共同创建门控机制,通常如果准确地学习位置编码信息,门控将分配比例较大的位置权重给tmlp的各个轴。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1