一种基于深度图神经网络的RASS镇静评分判别方法

一种基于深度图神经网络的rass镇静评分判别方法

技术领域

1.本发明属于计算机视觉与机器学习技术领域,具体涉及一种基于深度图神经网络的rass镇静评分判别方法。

背景技术:

2.随着人工智能和智能信息技术的发展以及计算机性能的不断提升,深度神经网络模型在图像和视频识别上取得了很大的进展,智能识别算法在很多实际检测场景中得到广泛应用,在医疗和救治方面主要体现为对患者的智能监护、对突发事件的预警等。

3.在对患者的监护过程中,icu重症患者由于其疾病的严重性,需接受有创诊治、导管留置、机械通气等治疗方案,采取适当的镇静、镇痛已成为通用的治疗方法。目前普遍采用的浅镇静策略存在非预期的躁动、谵妄等风险,甚至会增加意外拔管、坠床等不良事件发生的概率。而及时地采用richmond躁动-镇静评分(rass评分)判断患者镇静效果,对于保护患者安全方面具有非常重要的作用。

4.目前医院icu患者的监护主要依靠医护人员全天轮流值班,rass镇静评分高度依赖于人工判别,对于患者出现的各类异常行为主要依赖于医护人员的观察去发现。现有的rass镇静评分判别方式存在以下问题:1)医护人员对于rass镇静评分标准的判断存在主观臆断情况,容易导致判别不准确;2)医护人员数量配备无法满足专人监护,对于患者出现的异常行为容易疏漏导致不良后果发生;3)患者的一些异常行为通常伴有预兆,医护人员不容易通过患者的细微表现预测出异常行为的发生。为了应对上述问题,实现适用于icu场景高复杂性和及时响应需求的自动rass评分算法具有非常重要的意义。

技术实现要素:

5.针对现有的rass镇静评分判别方式中存在的问题,本发明的目的在于提供一种基于深度图神经网络的rass镇静评分判别方法,借助深度卷积网络检测视频或动态图像中人的疼痛表情以及异常行为情况,最终通过深度图神经网络架构学习和融合多个特征对rass镇静评分判别。

6.为达到上述目的,提出以下技术方案:

7.一种基于深度图神经网络的rass镇静评分判别方法,包括如下步骤:

8.步骤一:基于retinaface改进网络进行人脸检测和图象矫正;

9.步骤二:针对矫正的图像人脸框和人脸活动单元位置,进行图像预处理,通过改进vgg网络进行基于疼痛检测的特征提取;

10.步骤三:采用级联金字塔模型进行人体姿态估计,得到患者的动作姿态和肢体关键点;

11.步骤四:对关键点区域的图像块进行空间和时间维度固定大小的多层3d卷积和下采样,得到关键点运动特征抽取;

12.步骤五:通过深度图神经网络对人脸区域特征和肢体运动特征进行关系图建模和

联合优化学习,得到判别性更强的高维特征融合;

13.步骤六:通过计算特征融合的加权组合和softmax判别得到单幅图像的rass评分;

14.步骤七:在连续图像序列中,对此rass评分进行加权平均,得到鲁棒性更优的rass评分自动判别和预测。

15.一种基于深度图神经网络rass镇静评分判别方法,包括以下步骤:

16.步骤一:获取视频图像数据,分两路进行患者人脸检测以及异常行为识别,其中人脸检测环节采用基于retinaface改进的网络,加入了人脸校正模块,对于检测出的人眼坐标e0、e1,计算e0e1连线与水平方向的夹角α(逆时针方向),对于图像中任一点像素p0(x0,y0)绕图像中心o顺时针旋转α度后对应的点为p(x,y),则有x=x

0 cosα+y

0 sinα,y=y

0 cosα-x

0 sinα。将旋转后的图像输入到人脸检测网络中得到患者人脸框的坐标;

17.步骤二:根据返回人脸框的左上坐标p1(x1,y1)和右下坐标p2(x2,y2)对原图进行裁切,仅保留原图[x1:x2,y1:y2]部分即人脸部分,将其图像尺寸缩放到224

×

224像素大小,对其进行灰度化、直方图均衡化、均值滤波预处理。将处理后的图片输入到vgg网络改进的卷积神经网络中进行基于疼痛检测的特征提取;

[0018]

步骤三:进行基于人体姿态分析的行为检测,采用级联金字塔(cpn)人体姿态估计的方法,得到患者的动作姿态和肢体关键点,包括肩部、手臂关节点、手腕部关节点,以及手部的位置检测;

[0019]

步骤四:对于连续输入t帧,提取肩部、手部和手臂关节点大小是60

×

40像素的特征图,生成多通道信息。对输入层的每一帧提取五个通道的信息,分别是:灰度值、x方向的梯度、y方向的梯度,x方向的光流、y方向的光流,其中前面三个值对每帧都计算,x和y方向的光流需要两个连续帧才能计算;

[0020]

步骤五:采用一个w

×h×

t的3d卷积核(w

×

h在空间维,t是时间维)在五个通道的每一个通道分别进行卷积。为了增加特征图的个数,在每一个位置都采用两个不同的卷积核,在接下来的下采样层用2

×

2窗口进行下采样,得到相同数目但是空间分辨率较低的特征图嵌入;经过3层卷积和2次下采样后,每连续t帧的输入图像块都被转化为一个128维的特征向量,这个向量捕捉了输入帧的姿态关键点运动信息;

[0021]

步骤六:对目标人脸的活动单元进行定位和特征提取,以人脸疼痛分类提取的整体特征作为上下文特征,构建人脸特征相关的关系图。以关节点、手部得到局部的特征抽取、目标上半身动作特征为上下文构建肢体活动的关系图,通过建立和融合人脸、姿态关系图得到与rass评分关联的图模型;

[0022]

步骤七:学习并优化上述图神经网络的参数,基于此图模型进行推测、池化、降维得到人脸特征和姿态特征融合的高维特征组合。由此高维特征的加权和softmax层可以预测估计每帧的rass评测等级和得分;

[0023]

步骤八:通过一个时间段的rass评测得分,得到一组t帧区间的评测结果p

t

={p1,p2,...,p

t

},同时返回一组c

t

={c1,c2,...,c

t

}表示每帧检测结果的置信度,通过公式得到最终rass镇静评分(-5≤rass≤4)的判别结果。

[0024]

本发明的技术构思为:利用级联金字塔(cpn)姿态估计算法得到姿态估计的结果,利用多层3d卷积下采样抽取每个关键图像块的动作特征;另外,通过卷积神经网络学习疼

痛检测相关的特征;使用图卷积神经网络的算法融合得到每帧的rass估计,最后进行多帧加权平均得到最终rass镇静评分结果。

[0025]

本发明的有益效果为:通过卷积神经网络在空间和时间维度提取出较为可靠的运动特征和疼痛表情特征,进而通过图神经网络方法得到一种鲁棒性强、速度快、准确度高的rass镇静评分判别方法,提高了疼痛表情检测和异常行为识别融合评判的准确度和效率,降低了漏检和误检率。

附图说明

[0026]

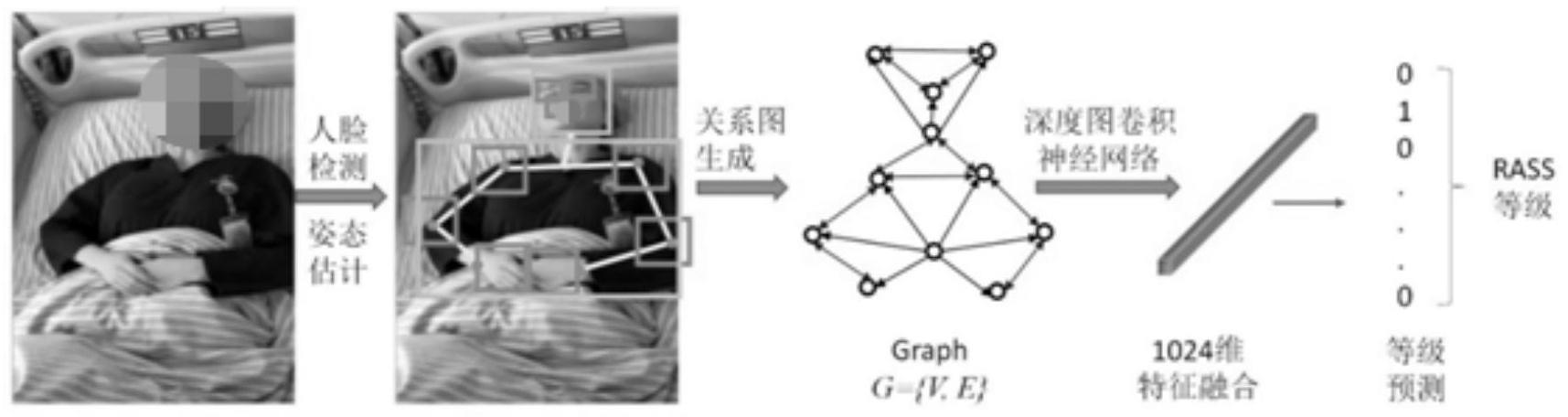

图1为基于人脸活动单元和姿态估计的图神经网络的构建和预测示意图。

[0027]

图2为本发明的流程图。

具体实施方式

[0028]

下面结合附图对本发明做进一步说明。

[0029]

参照图1~2,一种基于图深度神经网络的rass镇静评分判别方法,包括如下步骤:

[0030]

步骤一:本发明采用部署在病人床位前上方俯视的华为智能摄像机(型号d3250-10-siu),获取视频图像数据。分两部分采集数据:(1)人脸检测和人脸活动单元人体;(2)手臂异常行为识别。由于人脸有一定仰角,人脸检测环节采用基于retinaface改进的网络,加入了人脸校正模块,对于检测出的人眼坐标e0、e1,计算e0e1连线与图像水平方向的夹角α(逆时针方向),对于图像中任一点像素p0(x0,y0)绕图像中心进行顺时针旋转,对应的点为p(x,y),则有x=x

0 cosα+y

0 sinα,y=y

0 cosα-x

0 sinα。将旋转后的图像输入到人脸检测网络中得到患者人脸框的坐标;

[0031]

步骤二:按照人脸对齐得到人脸活动单元的位置和特征,主要活动单元包括左右眼区域、嘴部区域动作。为了得到表示疼痛分级的整体人脸特征,还需要根据返回人脸框的左上坐标p1(x1,y1)和右下坐标p2(x2,y2)对人脸图像进行裁切,将人脸部分的图像缩放到224

×

224像素大小,进行灰度化、直方图均衡化、均值滤波等预处理,将处理后的图片输入到vgg网络改进的卷积神经网络中提取基于疼痛检测的特征;

[0032]

步骤三:为了得到手臂异常行为的特征表示,需要进行基于人体姿态分析的行为检测,本方法采用级联金字塔(cpn)人体姿态估计的方法,得到患者的动作姿态和肢体关键点,包括肩部、手臂关节点、手腕部关节点,以及手部的位置检测;

[0033]

步骤四:对于关节点运动特征的提取,考虑连续输入t帧(取t=3),得到肩部、手部和手臂关节点周围大小是60

×

40像素的多通道特征图。对输入层的每一帧提取五个通道的信息,分别是:灰度值、x方向的梯度、y方向的梯度,x方向的光流、y方向的光流,其中前面三个值对每帧都计算,而采用两个连续帧计算x和y方向的光流;

[0034]

步骤五:计算这些通道的特征,采用空间和时间维的3d卷积核,卷积核大小是w

×h×

t的(w

×

h在空间,取w=h=7,t是时间维,取t=3)在每个通道分别进行卷积。为了增加特征图的个数,在每一个位置都采用两个不同的卷积核,在接下来的下采样层用2

×

2窗口进行下采样,得到相同数目但是空间分辨率较低的特征图嵌入;经过3层卷积和2次下采样后,可以得到一个128维的特征向量,这个向量表示每个姿态关键点的运动信息;

[0035]

步骤六:根据疼痛相关的姿态和表情关键点和整体特征构建这些部件的关系图模

型。首先,以目标人脸的活动单元的定位和特征结合人脸疼痛分类提取的整体特征作为上下文特征,构建人脸特征相关的关系图。其次,以关节点和手部检测得到局部的相对连接关系,并结合目标上半身动作特征为上下文构建肢体活动的关系图。然后,融合人脸和姿态关系图得到与rass评分关联的图模型;

[0036]

步骤七:对上述图模型的优化采用6级的图卷积神经网络算法,通过标注的训练样本学习并优化图卷积变换的参数矩阵。在推测过程中,基于此图模型进行特征变换,并池化、降维从而获取人脸特征和姿态特征融合的高维特征组合。由这个高维特征的线性加权和分类层可以预测估计每帧的rass评测等级和得分;

[0037]

步骤八:为了得到更为稳定的rass评测得分,并进行可靠的预测。对于每个时间段t(本方法取t=12)的rass评测得分进行平均。具体方法是,保存并得到一组t帧区间的评测结果p

t

={p1,p2,...,p

t

},考虑其置信度为c

t

={c1,c2,...,c

t

},通过公式得到最终rass镇静评分(-5≤rass≤4)的判别结果。

[0038]

如上所述,本专利实施的具体实现步骤使本发明更加清晰。在本发明的精神和权利要求的保护范围内,对本发明做出的任何修改和改变,都落入本发明的保护范围。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1